生成式AI在金融行业应用的现状、挑战与建议

2024-06-21李振华宫海韵唐伟城

李振华 宫海韵 唐伟城

摘要:2022年末,以ChatGPT为代表的大语言模型技术横空出世,显著提升了人工智能认知力、推理力以及语言力。与此同时,金融行业也在逐步探索生成式AI在金融资讯、投顾、投研等领域的应用。目前,生成式AI应用于金融行业,在技术层面可控性、专业性以及安全性方面仍有待提升,行业层面也面临着算力、训练语料不足等制约。为了使生成式AI更有效地服务于金融行业,海内外市场机构积极探索知识增强、工具增强、数据增强等方式,不断改进生成式AI在金融行业应用的安全可靠性;监管机构亦开展治理规范和行业指引探索,为新技术应用保驾护航。人工智能作为引领新一轮科技革命和产业变革的技术,如何促进其在金融行业释放价值将成为国内外监管机构和市场主体关注的重点。建议通过建设规模化算力基础、行业数据集、开放多元的模型生态等举措支持生成式AI不断完善,从而推动金融业高质量数智化升级。

关键词:生成式AI;金融行业;数智化转型;人工智能治理

中图分类号:F830 文献标识码:A 文章编号:1007-0753(2024)03-0003-09

金融行业一直是先进技术应用的先行者。过去几十年,计算机、移动互联网、云计算、AI等技术推动了金融业从信息化走向数字化。在数字化阶段,移动互联网技术推动了金融服务的线上化、场景化,让更多的用户能够享受到更便捷、多样化的金融服务。2022年末,以ChatGPT为代表的大语言模型技术显著提升了人工智能的认知力、推理力、语言力,人工智能将引领新一轮的科技革命和产业变革。展望未来,数字金融作为中央金融工作会议提出的“五篇大文章”之一,人工智能有望推动数字金融跨越式发展,引领金融行业变革,助力实现金融强国战略。

一、生成式AI在金融行业应用的现状和特点

(一)生成式AI在金融领域应用日趋活跃

一是全球金融机构积极探索生成式AI在业务场景落地。大模型涌现的语言力和推理力,推动人机交互体验升级与AI泛化能力跃迁,让金融机构看到提高工作效率和优化客户体验的应用前景,密切跟进技术探索和落地。根据英伟达针对全球近400家金融机构的调研①,有43%的金融机构已经在使用生成式AI,主要将其用于报告生成(37%)、客户体验优化(34%)、合成数据生成(33%)和营销(32%);另有55%的金融机构正在研究并考虑应用生成式AI。同时,由于金融行业是知识密集型及交互场景丰富的行业,与其他行业相比,其对大模型的需求更高,应用场景更广。根据麦肯锡调研②,金融行业从业者反馈“在工作中常规使用大模型”和“在工作和生活中均常规使用大模型”的数量占比为24%,仅低于技术传媒行业(33%),高于法律会计等专业服务(23%)、消费(18%)、医疗(16%)、先进制造业(16%)和能源材料行业(14%)。

二是从金融业务细分场景来看,生成式AI已覆盖了金融资讯、财富管理、保险、信贷、支付等金融细分领域(见图1)。例如,富国银行使用谷歌云的对话式人工智能平台Dialogflow构建了基于聊天机器人的客户助理;苏黎世保险公司正在测试将ChatGPT技术应用于理赔建模,分析公司最近六年的理赔数据,应用生成式AI找出理赔的具体损失原因,进而改善承保,降低理财成本。

三是AI领域投融资活跃,出现深耕金融的AI技术服务“独角兽”。根据CB Insight统计,2023年前三季度AI融资规模达329亿美元,新出现了16家AI“独角兽”。在金融领域,Quantexa获得

1.29亿美元E轮融资后跃升“独角兽”,估值达到18亿美元。Quantexa打造的生成式AI助手Q Assist,赋能智能数据分析,可用于反欺诈、反洗钱和客户识别,帮助金融公司规避风险和精准运营。目前,汇丰银行、渣打银行、纽约银行、荷兰银行和安联保险等大型金融机构都是其客户。

(二)生成式AI在金融领域应用的特点

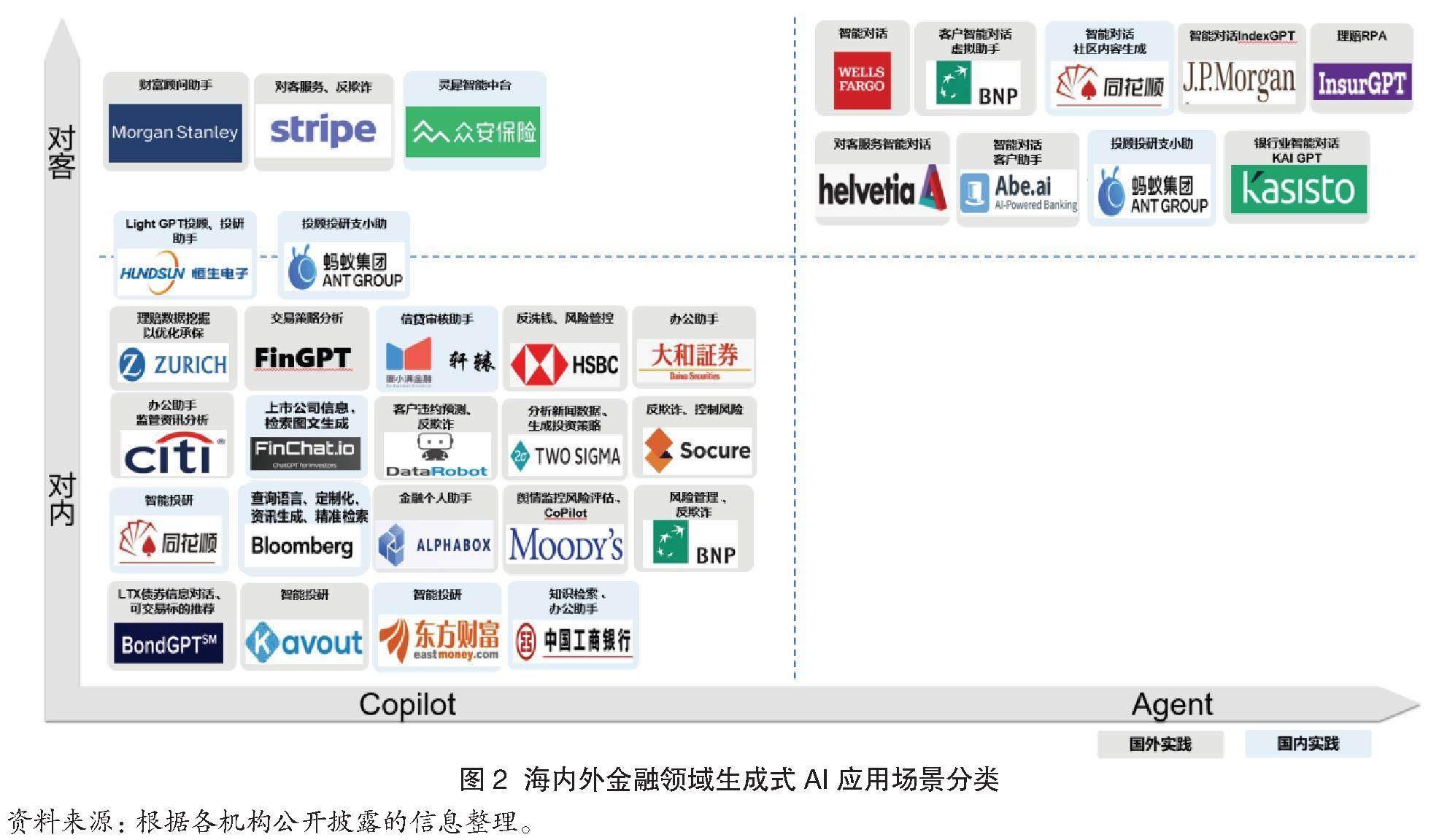

生成式AI在业务流程中扮演的角色以非决策类为主。在业务简单且非决策场景,生成式AI可直接服务客户;在业务复杂或决策场景,生成式AI还是作为助手,赋能内部人员(见图2)。

第一,生成式AI主要服务于归集、分析、生成等非决策环节。从生成式AI服务金融机构的角色定位来看,可以分为提取、归纳、分析和决策,对技术的要求由低到高。以投资场景为例,当下生成式AI可以作为市场数据、行研报告信息抓取的“实习生”,或作为归纳生成行业和投资标的价值分析的“研究助理”,但未能成为做出投资决策的“投资经理”。这是因为决策需要综合事实性信息和经验式复杂形势做出判断,对大模型的技术要求更高,需要长期的迭代演进。例如,在投研领域,Broadridge 子公司LTX打造了Bond GPT。LTX 运用自身整合的Liquidity Cloud中海量的匿名实时交易数据及金融数据,基于GPT-4训练得到债券垂类大模型Bond GPT。用户可以通过自然语言与Bond GPT交流,获得符合需求的公司概况、利率、价格、发布日期、到期日期、债券评级等信息以及可视化图表,为债券投资提供数据及交易信息支持。

第二,直接对客应用较为审慎。目前生成式AI主要用于不涉及强金融建议的智能对话、信息收集分析,对内部员工赋能(Copilot)的应用更加多样、更有深度。得益于生成式AI强大的理解和语言能力,对于金融资讯、业务办理等泛金融知识对话,生成式AI已经可以直接面向客户进行智能对话,大幅弥补过去智能客服并不“智能”的短板。例如,智能客服支小宝,在蚂蚁大模型的赋能下,升级为“支小宝2.0”,将智能对话服务链路解构为意图理解、知识加工、专业工具调用、归纳推理、可控生成、自省等环节。大模型作为交互与认知中枢,其多轮对话的能力大幅提升,并能够基于用户需求适时调用专业金融知识和策略工具(如条件选基、保险评测),直接为客户提供财富管理、保险产品咨询等服务。生成式AI作为财富管理顾问的助手,如“支小助”赋能蚂蚁理财师,能够提升专业度,实现定制化服务。又如,农业银行推出大模型应用(ChatABC),该模型拥有百亿级参数,在知识问答、智能客服、辅助编程、智能办公等领域同步进行试点,其中智能问答场景已提供数百万次问答服务,而辅助编码场景支持代码生成、单测生成、代码翻译等功能,已超过10万行代码投入生产应用。但是,对于更复杂、个性化的对客金融服务,目前仍需要人工参与判断。

第三,大小模型协作成为AI应用技术范式。生成式AI的优势在于理解、推理和生成,而传统判别式AI的优势在于场景适配性强、可控性强,适用于风险管理等复杂决策场景。目前大模型不能直接用于风险决策,但结合传统的有监督机器学习的风控决策引擎,通过不断完善两者数据及应用交互的技术范式,使得智能风控更加实时和主动。例如,为了解决传统的风控决策引擎处理非结构化信息能力的不足,以及无法提供差异化额度和利率等问题,度小满开发了“小满灵犀”风控决策引擎,充分发挥大模型技术的理解、生成、逻辑能力,通过自然语言的方式与客户深度交互,并基于对客户历史信息的理解和客户需求的洞察,提升效率,实现精准授信。

第四,海外金融机构云化部署为快速应用大模型奠定了基础。例如,Morgan Stanley 和Open AI合作推出了基于GPT-4 技术的对话机器人,并利用该机器人管理及调用其庞大的知识库赋能财务顾问。Morgan Stanley知识库部署在Azure云端,数十万页报告内容涵盖投资策略、市场研究和评论以及分析师见解,Open AI通过微调和提示词工程,实现API智能调用知识库内容,并生成财务顾问所需的专业、定制化的投顾信息。云端部署可以满足模型快速部署和高并发调用需求。

二、生成式AI在金融行业的应用趋势和价值

(一)推动金融业的生产力变革

生成式AI全面赋能金融业务各环节及组织前中后台,极大提升了客户营销、运营服务、技术开发以及内部管理效率。人人有助手,生成式AI显著提升了信息处理及内容生成的效率和多样性,可以为营销人员提供丰富的创意文案,为投顾人员提供实时资讯解读和投资策略分析,为技术人员提供代码工具;人人是专家,生成式AI降低了知识获取以及数字化工具应用门槛,秒级完成知识库检索生成,自动调用工具,让每个人快速成为行业专家。据麦肯锡预测③,生成式AI带来的生产力提升将推动银行业收入增长3%—5%,合2 000—3 400亿美元。据UBS预测④,在乐观情景下,预计2025年,生成式AI在对内赋能的场景率先实现大规模落地,预计证券行业、保险行业人工成本减少20%,分别提升证券行业、保险行业利润15%与27%。

(二)重新定义金融服务的用户体验

生成式AI带来客户交互智能化跨越式提升。更有温度,生成式AI带来全新的人机交互体验,意图识别更精准,表达更有“人味”,并随时随地提供专属陪伴;更有深度,生成式AI帮助客户更容易触达金融机构“最强大脑”,如首席投资策略师或首席分析师的洞见,充分调动积累的知识和策略,更好地为客户提供高质量、定制化服务;更多样且易得,以Open AI 推出的GPTs为例,其为开发人员提供了开发工具及市场营销平台,打造了生成式AI领域的“iPhone App Store”,将极大丰富应用生态,促进更多样的智能化金融服务的涌现。

(三)助力金融业务模式跨越式升级

生成式AI将成为“智能引擎”,从信息处理进化到复杂决策,从Copilot跨越到Autopilot,重塑交易决策、产品创设及营销规划等业务环节。此外,生成式AI还将推动业务范式升级。如投顾领域,顾问可依托生成式AI提供千人千面资产配置服务,亦可通过对话机器人进行拟人化、实时交互,加深客户信任,优化投资收益,推动卖方投顾向买方投顾转变,引导投资者理性投资,助力营造良性资本市场环境。

(四)成为数智化风控技术新起点

风险决策方面,生成式AI的泛化能力使其理解加工海量非结构化数据的能力大幅提升,与传统判别式AI模型能力形成互补,支持复杂场景下零人工干预、高精度风控决策。风险监测方面,金融领域风险越来越呈现出隐蔽性、交叉性、跨市场特点,如跨国洗钱,风险识别和控制的难度持续增大,而生成式AI特有的认知推理能力,有望助力更广泛、更敏捷地监测到异常交易,识别数据安全、网络安全漏洞,并自动调度风险管理工具,在第一时间控制风险发酵及传导。

三、技术层面生成式AI在金融行业应用的挑战及应对

生成式AI在金融领域的应用面临多重挑战,除技术本身有待进一步完善之外,还需要满足金融领域的专业性、合规性等要求,主要表现在专业性、可控性、适当性尚有不足,以及存在算法内生性风险。

(一)生成式AI技术在金融行业应用面临的挑战

一是专业知识存在短板。大模型通过海量知识的压缩,积累了广泛的通用知识,具备较强的泛化能力。金融行业具有知识密度高、时效性强、严谨性高等特点,而通用大模型训练中金融语料占比低、数据滞后、金融专业水平不高,导致通用大模型无法在金融领域直接应用。如保险理赔涉及大量保险条款、疾病和医药的关联性知识,而通用大模型在相关领域存在一定的知识欠缺,难以处理具体某种保险“能不能保”“能不能赔”等专业问题。

二是可控性不足。生成式AI实现了语言力、理解力和创造力的跃迁,但伴随的“幻觉”问题导致生成结果不可控,影响在严谨场景中的应用。大模型是基于条件概率逐字生成内容的,但是训练数据质量不足、模型过拟合以及知识理解不足等因素,会导致大模型“一本正经地胡说八道”。以训练数据为例,不准确、不完整的数据或恶意投毒数据,会导致模型在训练过程中学习到这些错误、虚假的数据,并在未来的预测、生成中重现。

三是适当性缺乏保障。金融行业对监管合规性要求高,生成式AI在金融行业的应用也离不开规则的约束和运用,需要其与金融业务相关规范进行价值对齐(Value Alignment),但大模型价值对齐如何充分符合金融安全、投资者适当性、消费者权益保护等金融价值观仍面临技术挑战。

四是算法内生性风险。算法可解释性方面,大模型在参数规模与复杂度上远高于传统AI模型。从参数规模上看,目前主流大模型通常包含百亿到千亿级别以上的参数,而传统AI模型的参数规模一般在百万到千万级别。因此,大模型输出结果的逻辑和决策过程更难以解释。金融领域对决策透明度和可解释性的要求更高,这对大模型应用于金融业务将构成较大挑战。算法歧视方面,大模型基于海量数据开展训练,因此训练数据中本身存在的偏见可能被算法模型固化,导致生成的决策存在歧视。比如在金融服务可得性方面,算法歧视可能会导致歧视性准入门槛与服务定价等问题。算法一致性方面,如果大量金融机构部署应用相似或者同一大模型,可能会导致基于模型建议的业务决策的一致性,从而形成“羊群效应”。美国证监会主席Gary Gensler在2023年10月提出AI会引发金融行业系统性风险的担忧。他解释道,华尔街很多金融机构依赖于少数基础AI模型,从智能投顾业务到股票开户业务等,各方基于相同数据模型做出的决策可能导致“羊群效应”,不利于金融稳定。

(二)市场主体推动生成式AI在金融行业应用的积极对策

生成式AI技术在金融领域的应用还处于探索阶段。为了使生成式AI更有效地服务于金融行业,克服前述大模型自身存在的技术问题以及在金融业务应用中面临的专业性问题,各国的科技公司与金融机构都在积极探索对策。

1.提升金融专业性及可控生成

一个可行的大模型应用范式是解构内容生成链条,将大模型作为交互与认知中枢,主要负责意图识别、信息检索与归纳总结以及内容拼接组合,按需在金融专业领域调用知识引擎以获取高时效性、高精度的金融知识,以及调用自动化策略工具,如投顾推品、保险配置等。为此,可通过知识增强和专业工具组合增强,确保大模型生成内容的专业性。

一是知识增强。形成专业知识库+检索技术组合,将特定金融与相关专业知识库嵌入生成链条,使大模型基于给定的专业知识库生成答案。知识图谱的知识专业性和事实可靠性强,鉴于金融领域有大量高频问题,应用大模型时可深度融合知识图谱,覆盖高严谨性和高复杂性场景,比如保险产品条款解析、核保核赔问题回复。此外,最新、准确的外部数据可以弥补大模型信息时效性的不足。

二是专业工具组合增强。生成式AI在认知和交互方面具有显著优势,而传统判别式AI模型对特定任务决策的可靠性更强,在运筹、量化、图算法方面的表现更为优异。因此,在具体业务场景中,大模型可按需调用专业小模型,如投顾推品、保险配置等,共同完成理解、推理和决策任务,使金融服务更专业、更有深度。

2.强化训练数据质量保障

训练数据质量是影响大模型性能的关键因素之一。目前可用的中文金融语料约有2 000亿token,然而通过模型和人工的清洗和筛选,最终能够达到高质量高标准的语料大约只有10%。在金融领域,数据质量尤为重要,需要从源头开始保障大模型的训练质量和价值取向。为此,一方面要持续加强数据清洗与质量管控,通过数据引入初筛、训练数据去毒、精细化标注,确保模型训练源头数据安全、可控、可追溯;另一方面,共同构建金融行业数据集,如Bloomberg GPT的优秀性能很大程度上源于其在通用语料库之外,构建了一个包含3 635 亿token 的高质量金融领域数据集FinPile,其中的7%是彭博专有的金融数据。

3.持续推动模型迭代优化

为了让大模型的能力与行为和人类的价值、真实意图及伦理原则一致,确保人类在与AI协作中的安全与信任,核心就是价值对齐。价值对齐可以在一定程度上解决大模型错误信息、算法歧视和生成不可控问题。目前在价值对齐的工具开发和工程化建设方面已有许多积极尝试:一是人类反馈强化学习(RLHF),人类训练员对模型输出内容的适当性进行评估,并基于收集到的人类反馈为强化学习构建奖励信号,以实现对模型性能的改进优化。如Open AI、Anthropic等公司通过加入RLHF方式,缓解大模型的“幻觉”问题,从而提高模型的适应性,减少模型的偏见,增强模型的安全性。二是对抗测试(Adversarial Testing),邀请内部或外部的专业人员(红队测试员)对模型发起各种对抗攻击,以发现潜在问题并予以解决。例如,在GPT-4发布之前,Open AI聘请了50多位各领域学者和专家对其模型进行测试。这些红队测试员的任务是向模型提出试探性的或者危险性的问题以测试其反应。通过红队测试员的测试,可以帮助发现模型在不准确信息、有害内容、虚假信息、歧视、语言偏见、社会安全等方面的问题。

4.布局全链条安全检测与防御

建立一体化的大模型安全防控体系,从数据输入、训练和生成各个环节,对有害、敏感信息进行拦截和纠偏,持续开展安全检测。例如Open AI专门训练了一个对有害内容进行过滤的AI模型,用于识别有害的用户输入和模型输出,从而实现对模型的输入数据和输出数据的管控。又如,蚂蚁基于丰富的安全和合规技术推出“蚁鉴2.0”安全检测平台,其由数百个识别模型和数十万个判别规则组成,提供生成式AI安全性评测、可解释性评测以及鲁棒性检测,可支持多模态检测,覆盖文本、语音、图像等多种任务类型,检测标准覆盖内容安全、数据安全、伦理安全三大类,可对大模型生成的内容完成包含个人隐私、意识形态、违法犯罪、偏见与歧视等数百个维度的风险检测,并生成检测报告,通过全方位安全检测、内容过滤、规则召回等安全策略,持续提升大模型生成的准确率。

5.丰富模型和应用的多样性,降低算法一致性风险

2022年末以来,众多科技企业、金融机构积极投入垂直大模型预训练和应用层微调,丰富的模型生态和开发框架有利于降低算法一致性风险。一是通过不断丰富模型生态、场景应用解决方案,金融机构能够选择出算法逻辑多样化的模型以及匹配业务需求的丰富的生成式AI应用产品,缓解市场共振风险。二是大模型现在并未直接用于金融决策,丰富的人机交互将逐步塑造个性化的Copilot和AI Agent,这些根据客户差异化的风险偏好和收益预期等做出的决策建议,有助于避免模型输出一致性的问题,进而避免出现“羊群效应”。三是大模型基于海量实时信息处理能力,将助力完善监管科技,不断提高风险检测灵敏度以及风险应对措施智能化,维护金融稳定。

四、行业层面生成式AI规模化、高质量应用的制约因素和优化展望

中央金融工作会议提出做好科技金融、绿色金融、养老金融、普惠金融、数字金融“五篇大文章”,其中发展数字金融,提升金融机构数字化水平,有助于更好地支持金融强国战略。人工智能作为引领新一轮科技革命和产业变革的技术,对发展数字金融具有战略意义。目前,生成式AI在金融领域的应用还处于初级阶段,面临算力、训练语料不足、技术规范等短板,在推进大模型应用的过程中,不仅需要市场主体的探索和实践,也需要政府的鼓励支持与规范引导。

海外监管主体认识到人工智能的重要战略意义,相继出台了AI战略规划和监管举措,致力于平衡促进技术发展及产业应用与防范潜在风险。为了更好地发挥人工智能对我国数字金融的助推力,需创造包容的监管环境,夯实算力、数据、算法和技术规范基础设施,以促进人工智能可信发展,释放产业变革价值。

(一)生成式AI在金融行业规模化、高质量落地的制约因素

一是在缺乏行业应用指引和技术标准的情况下,多数金融机构存在“不敢用”“不会用”的情况。目前,生成式AI在金融行业的应用进展缓慢,一项针对300多家金融机构的大模型应用现状的调研发现⑤,仅有2%的金融机构处于大模型落地应用阶段。一方面,当前金融监管部门尚未对大模型在金融行业的应用出台相应的指导意见以及业务规范,一定程度上影响了金融机构研发应用大模型的意愿,这将进一步降低金融大模型的市场需求,抑制金融机构与科技公司技术投入的动力和金融大模型技术发展的潜力。另一方面,受限于金融大模型缺乏行业统一、公允的评测标准及技术应用规范,金融机构面临大模型选型难、调试难等“不会用”的问题。

二是多数金融机构存在算力资源约束问题,会限制金融行业大模型的普及应用,加剧行业“马太效应”。根据相关机构估算,训练一个千亿参数级别的大模型大致需要上千张英伟达的A100高性能显卡运行3个月以上的时间,需要上千万美金的投入,对资金与技术的要求很高。从银行业角度看,国内有4 000多家银行,如果每家银行都从0到1自己训练构建一个大模型是不现实的。这是因为一方面多数银行本身规模比较小,存在资金、技术短板;另一方面随着美国对中国芯片出口限制的升级,进一步加剧了国内大模型算力资源紧张。但如果大模型最终只应用于少数具有资金技术实力的大型银行,可能会进一步加大中小银行与大型银行的经营能力差距,强化金融行业的“马太效应”,不利于整个金融行业的健康发展。

三是金融领域高质量语料缺乏,不利于模型迭代升级,也不利于生成内容的专业性及可控性的提升。金融数据的敏感性、隐私性、商业机密性更高,在数据流转方面的监管合规要求更严,从而导致金融机构缺乏数据共享动力,数据割裂现象严重,专业语料的归集难度大。因此训练金融垂直领域的大模型存在明显的金融数据资源约束,有待建立健全跨金融细分领域、时效性强、满足价值对齐要求的专业数据集。

(二)海外AI产业发展举措及监管思路

随着生成式AI的蓬勃发展,AI技术所带来的战略价值和潜在风险也越来越受到关注,世界各国监管主体都在密切跟进AI的演化进展。现阶段主要发达国家在围绕促进生成式AI行业发展的同时,持续关注和防范潜在风险,推动建立监管规则体系,主要监管思路和举措包括“软法”指引和持续迭代、分类分级监管、政府与企业共治、建立跨国治理生态等。

第一,注重促进人工智能长期发展,统筹安全与发展。美国政府认为人工智能是现阶段最具战略意义的技术之一,为了确保美国在发展可信AI的全球领航员地位,其制定了国家层面AI发展框架。2016年美国的总统行政办公室(Executive Office of the President)发布了《国家人工智能研究发展战略规划》,并于2019年和2023年发布更新版,覆盖鼓励AI基础技术长期投资、发展共享公共数据集、保障AI系统安全性等九项举措。以数据为例,明确发展用于人工智能训练和测试的共享公共数据集和环境。具体举措包括:一是开放并提供满足多样化人工智能应用需求的数据集。许多政府数据集已经通过各种网站和平台向研究人员和学生开放。例如,美国国家航空航天局(NASA)地球科学数据集通过NASA的分布式活跃档案中心(DAAC)向公众开放;国家卫生研究院(NIH)的“科技研究基础设施发现、实验和可持续性倡议(STRIDES)”使人们能够访问丰富的数据集和先进的计算基础设施,使用相应工具。二是开发共享的大规模和专业化的高级计算和硬件资源。美国国家人工智能计划(NAIRR)工作组提出建设兼具CPU和GPU的混合算力资源基础设施(即本地和云端计算资源、专用和共享资源),该设施具备多节点加速器,可提供高速网络和充足的内存容量。根据CB Insights统计,截至2023年三季度末,美国拥有全球65%的AI“独角兽”。

第二,政府部门以提示风险和制定标准的“软法”引导技术发展,不设置准入限制,并基于技术发展敏捷治理。例如,2023年1月,美国国家标准与技术研究院(NIST)制定《人工智能风险管理框架》(RMF),通过建立标准的方式引导AI产业实践,对市场仅有建议采纳的软性约束作用,产业实践经验也通过与监管的多轮互动,实现对“软法”的迭代完善。2023年10月,美国白宫发布拜登签署的《关于安全、可靠和可信的AI行政命令》(以下简称《行政命令》),提出安全可靠、保障权利、隐私保护等伦理要求,以确保美国在把握AI前景和管理其风险方面处于领先地位。

第三,明确人工智能分类分级监管思路。欧盟《人工智能法案》的修改草案中,重点引入了以风险为导向的AI系统的分类分级监管制度。该法案提出了四种风险类型的AI系统——不可接受的风险、高风险、有限风险和极低风险,并对不可接受的风险以及高风险等级的AI系统提出了严格的规制措施,同时为人工智能设计了全生命周期的规制措施,要求人工智能产品入市前评估和入市后监测,以便从事前、事中和事后共同治理。对于通用型人工智能(General Purpose AI,GPAI),强调透明度要求。要求GPAI系统和模型必须保持透明度,包括创建技术文档、报告有关训练内容的详细摘要、遵守欧盟版权法以及报告用于训练其模型的数据信息。确保自然人在与AI系统互动时,能及时、清晰、可理解地知道自己正在与AI系统互动。此外,对于具有高风险的GPAI,需满足风险评估、对抗性测试等标准。

第四,政府与企业多元共治成为AI 治理范式。一是美国政府与企业多元共治《行政命令》,促使包括Open AI、谷歌、微软、英伟达等15家企业就开发避免偏见歧视、保护隐私的人工智能做出承诺,包含建立AI安全的新标准、保护美国民众的隐私、促进公平和保障公民权利、提升美国在海外的领导力等八个目标。政府与企业多元共治推动了“软法”主张与产业实践之间的互相促进,如科技公司在AI产品发布前采用的红队测试惯例,成为自愿承诺内容之一。二是欧盟明确政府监管与企业自律相结合的基础模型⑥监管模式。一方面,每个欧盟成员国都将设立监督机构,由人工智能企业所在国的监管机构确保法案的有效实施。另一方面,人工智能企业需承担自律责任,对其算法进行人为控制,提供技术文件,并为“高风险”应用建立风险管理系统。三是新加坡金管局(MAS)与企业及行业协会联盟⑦为金融领域使用生成式AI制定风险框架,确定了包括问责制和治理、监控和稳定性、透明度和可解释性等七个风险维度。

第五,建立人工智能跨国监管互通生态。大模型开发、训练及应用需要越来越多的跨国合作,需要相应的跨国共识和监管协同。2023年11月在英国召开AI安全峰会的28个国家发布了《布莱切利宣言》,旨在推动全球在人工智能安全方面的合作,共同识别风险以及制定跨国政策缓解风险。

(三)促进生成式AI推动金融数智化升级的建议

为了更好地统筹发展和安全,做好“五篇大文章”之一的数字金融,支持金融强国战略落地,建议在监管环境、算力、数据、技术生态等方面,支持金融行业规模化、可持续应用生成式AI。

第一,为生成式AI落地金融行业营造适当包容的监管环境,推动金融机构数智化转型和技术创新的良性互动,监管机构与市场机构合作构建金融大模型技术规范。一是建议监管部门加大对金融机构技术创新的重视程度与支持力度。充分发挥“科技创新试点”等机制的作用,平衡创新和风险管理,明确监管规则,鼓励金融场景应用探索。如果缺乏有效的监管预期引导与政策支持,技术创新将面临巨大的不确定性,不利于引导金融机构技术投入和持续迭代。二是推动政府与企业共同参与AI治理,在监管模式的探索中形成“双轮驱动”。建立畅通互信的沟通机制,基于人工智能监管理念、技术前沿进展和产业实践,共同制定技术规范、风险管理框架和产业应用指引;同时,可以建设监管规制、行业自律、科技伦理指引相结合的多层次治理体系。三是构建金融行业权威的金融大模型评测标准。大模型技术风险管理需要监管机构和市场主体共同建立技术标准及评测体系,引导大模型在金融业务中规范应用。组织独立机构进行技术评测、安全审查、风险监测,多主体参与可为金融大模型的安全应用保驾护航。当前实践表明,大模型评测集是综合评估大模型技术能力与安全性的有效工具,可以由监管机构牵头,组织技术领先的金融大模型金融机构与科技公司,合作构建行业统一的综合金融大模型评测集,并将其逐步转化为监管认可的金融大模型技术标准与评测体系。

第二,探索建立人工智能在金融行业应用的分类分级监管机制。由于人工智能技术的应用场景、风险程度和技术成熟度存在差异,需要制定配套的分层监管举措,进行精细化管理。我国出台的《生成式人工智能服务管理暂行办法》确定了“对生成式人工智能服务实行包容审慎和分类分级监管”的基本理念,金融监管部门可以在此方向上进一步探索生成式AI在金融行业应用的分类分级监管体系。建议基于不同的金融业务模式与流程环节的特点、生成式AI对金融业务价值创造与风险生成的影响机制、金融服务的客户覆盖面等因素,结合国内外金融行业先进实践经验,由监管机构和市场主体共同探索并制定不同金融业务与流程环节中应用生成式AI的风险识别、分类评估、技术规范、差异化流程监测体系、责任认定等配套规则。

第三,加强行业共享的技术基础设施建设,以行业云或团体云为基础,建立金融行业基础大模型,支持各金融机构构建大模型基础能力。一是建立金融领域大模型训练和推理平台试点。由监管机构或政府牵头协调,联合科技公司及金融机构,实现资源集中规划建设、迭代升级,避免行业内“重复造轮子”,造成算力浪费。二是探索建设金融行业云和行业大模型融合的金融机构技术基础设施平台。帮助中小金融机构“一站式”夯实科技底座,构建金融大模型基础能力,加快金融机构从数字化到数智化转型的进程。

第四,推动公共数据开放,共建金融领域专业数据集,完善数据安全规范。一是推动公共数据开放。公共数据的开放将充实大模型通用语料库,为大模型语言力及推理力升级奠定基础。二是建设金融领域专业数据集。建立跨主体数据归集、共享机制及商业模式,缓解数据割裂,避免数据重复收集处理导致的资源浪费。例如,建议由行业协会或监管下属机构归集市场交易数据、研究报告、上市公司公告等行业数据,推动金融语料库建设。三是完善数据安全规范。避免模型训练中数据使用不当导致用户隐私泄露、信息滥用,加强知识产权保护,避免产权不清造成侵权行为和商业纠纷。与此同时,可推行一些数据训练的版权收费豁免。

第五,构建多元分层的大模型技术生态,降低大模型在金融场景应用的成本,缓解模型输出一致性问题。一是构建基础大模型开源技术生态。技术开源可以避免对训练资源要求最高的基础大模型的资源重复投入,促进模型快速迭代,防止技术垄断。二是丰富大模型微调、大小模型交互的金融场景应用技术生态。通过丰富基础大模型在各类金融场景应用所需的内容标注、提示词工程、对抗测试等微调服务,以及与大模型配合的判别式AI小模型技术服务的供给生态,让各类金融机构以较低成本基于自身业务场景特点采购大模型场景落地应用所需的服务,也可以通过多元化差异化的大模型场景应用解决方案降低模型输出一致性的问题,有效避免模型共振导致的“羊群效应”,维护金融稳定。

注释:

① 英伟达, State of AI in Financial Services 2024。

② 麦肯锡,The State of AI in 2023: Generative AI's Breakout

Year,此报告基于对全球1 684位参与者的调研。

③ 麦肯锡, The Economic Potential of Generative AI。

④ 《亚太聚焦:生成式AI如何重塑中国非银金融行业?》。

⑤ 2023年下半年,恒生电子对国内金融机构进行调研走访,被调研对象涵盖券商、公募、银行、三方、保险、信托、期货和私募等。

⑥ 基础模型被定义为一种依托大量数据被规模化训练的AI模型,为确保生成结果之通用性而设计,并能适应广泛的特定任务。

⑦ 包括星展银行、华侨银行、大华银行、渣打银行、花旗新加坡、汇丰银行、谷歌云、微软、MAS、埃森哲和新加坡银行协会组成的联盟。

The Current Status, Challenges, and Recommendations for the Application of Generative AI in the Financial Industry

Abstract: At the end of 2022, large language model technology, exemplified by ChatGPT, emerged dramatically, significantly enhancing artificial intelligence's cognitive, reasoning, and linguistic capabilities. Concurrently, the financial industry is gradually exploring the application of generative AI in areas such as financial information, investment advisory, and investment research. Currently, the application of generative AI in the financial industry still requires improvements in controllability, professionalism, and security at the technical level, and faces constraints such as insufficient computing power and training data at the industry level. To enable generative AI to serve the financial industry more effectively, domestic and international market institutions are actively exploring ways to enhance knowledge, tools, and data, continually improving the safety and reliability of generative AI applications in the financial sector. Regulatory agencies are also developing governance norms and industry guidelines to safeguard the application of new technologies. As artificial intelligence leads a new wave of technological revolution and industrial transformation, how to promote its value in the financial industry will become a focal point for regulatory bodies and market participants worldwide. It is recommended to support the continuous improvement of generative AI by building scalable computing power infrastructure, industry datasets, and an open and diverse model ecosystem, thereby promoting high-quality digital and intelligent upgrades in the financial industry.

Keywords: Generative AI; Financial industry; Digital transformation; AI governance