AttRes34模型在食管鳞状细胞癌诊断中的应用价值

2022-07-02曹燕珍周盼运

曹燕珍,邓 鑫,周盼运,李 敏

(1新疆医科大学第三临床医学院/附属肿瘤医院病理科,乌鲁木齐 830011;新疆大学 2软件学院,3信息科学与工程学院,乌鲁木齐 830046)

食管癌(Esophageal cancer,EC)是一种发生在食管上皮组织的恶性肿瘤,其发病率位居世界恶性肿瘤发病率的第七位[1],我国食管癌发病率居恶性肿瘤发病率的第五位[2]。食管鳞状细胞癌主要通过内镜活检和病理检查进行诊断,而放射学检查一般只起辅助作用[3]。已有研究对巴雷特食管和食管癌的病理分型进行了探索[4-7],但均未涉及食管鳞状细胞癌组织与正常组织间的分类。因此本研究以病理检查作为切入点,提出了基于注意力机制的ResNet34 模型(Attention based ResNet 34 model, AttRes34),探究AttRes34 模型在食管鳞癌组织病理切片图像上的辅助诊断效果。

1 材料与方法

1.1 一般资料对2016年1月-2020年1月新疆医科大学附属肿瘤医院病理科收治的40例食管鳞状细胞癌(低分化、中低分化、中分化、高中分化和高分化各8 例)资料进行回顾性研究,其中男性26 名,女性14名,患者年龄40~76岁,平均年龄(56.0±0.0)岁。本研究所有患者的食管病理组织切片均从医院病理科调取,使用PRECICE 500B 型数字病理成像仪,在40 倍的放大倍数下对组织切片进行扫描,以获得患者的组织病理学图像。本研究已由新疆医科大学附属肿瘤医院伦理委员会批准,批准号为K-2019022,所有受试者均签署知情同意书。

1.2 纳入与排除标准本研究纳入的患者均属于食管鳞状细胞癌,切片结果均经手术组织活检证实。选取患者的病理组织切片时,纳入干净、保存状态良好且对比度清晰度的切片,并排除染色质量较差、存在组织折叠和年代久远的切片。

1.3 切片的处理方法本研究所纳入的切片均采用苏木精-伊红染色法染色,在两位经验丰富的临床医师的帮助下,勾画出患者病理组织切片中诊断明确的肿瘤区域和正常对照组织切片的健康区域。将组织切片水平放置于数字病理成像仪下,以40 倍放大倍数从肿瘤区域和健康区域中各提取6 幅均为1 665×1 393像素的非重叠图像。本研究分别提取240幅食管鳞状细胞癌图像和240 幅正常对照组织图像,共计480幅。

1.4 诊断标准细胞学特征常被作为食管鳞状细胞癌的临床诊断标准,具体包括细胞学异型性、有丝分裂活性和角化程度,以及与正常鳞状上皮的相似性。食管鳞状细胞癌的镜下形态可有或无明显的细胞间桥或角化珠形成,细胞呈巢片状或肉瘤样排列,而正常食管组织镜下食管黏膜为鳞状上皮呈扁平状排列。并且,相比于正常组织,高分化鳞状细胞癌可见含丰富嗜酸性细胞质的增大的细胞和角化珠,细胞学异型性小,核分裂计数较中分化鳞癌和低分化鳞癌低,浸润性边缘呈推挤性,细胞排列规则;中分化鳞状细胞癌具有明显的细胞学异型性,并且细胞排列较不规则,核分裂易找到,通常存在表面角化不全,但不常见角化珠;低分化鳞状细胞癌主要由成巢的基底样细胞组成,可能有中央坏死,肿瘤细胞巢呈片状或砖砌状排列,偶有角化不全或角化细胞[8]。

1.5 图像处理将240 张食管鳞状细胞癌组织病理学图像和240 张正常对照组织图像分别按照6:2:2 的比例划分为训练集、测试集和验证集。对训练集采用的数据增强方式,包括随机亮度抖动、随机对比度抖动、随机饱和度抖动、随机色调抖动、图像旋转90°和图像翻转,以减少由于数据量较少而产生的过拟合现象[9]。将原像素大小为1 665×1 393的切片图像通过滑动窗口算法生成若干像素为224×224的补丁图像,最终生成的训练集共包含12 060张补丁图像,其中食管鳞癌组织和正常对照组织补丁图像各6 030张。

1.6 模型整体流程首先将改进后的滑动窗口算法应用于原切片图像来生成众多的补丁图像;其次,通过AttRes34 模型的Softmax 分类器输出补丁图像的预测结果;最后,通过汇总补丁图像的预测结果(正常、鳞癌)推断出原切片的诊断结果,并进行了可视化输出,见图1。

图1 AttRes34模型整体流程图

1.7 多种ResNet 模型性能指标的测定通过比较精度、召回率、F1 分数等指标来综合衡量ResNet18、ResNet34、ResNet50模型在食管鳞状细胞癌组织病理学图像上的诊断表现,并使用受试者工作特征和混淆矩阵对不同模型的性能进行评估。ROC曲线下的面积(Area under curve,AUC)越接近于1,模型的泛化能力越高;混淆矩阵使用可视化矩阵来展示所预测样本的真正例(True positive,TP),假正例(False posi⁃tive, FP),真反例(True negative, TN),假反例(False negative, FN)指标。本研究所用到的二分类混淆矩阵见表1。

表1 二分类混淆矩阵

1.8 数据模型的建立所有研究均基于Python 平台,运用Pytorch 框架构建研究过程中所需要的模型和机制。使用深度残差网络(ResNet)在图像识别基准(如ImageNet)上展现图像分类性能,将补丁图像作为输入,输出食管鳞状细胞癌组织和正常对照组织的预测概率。模型的可视化输出采用对预测区域叠加彩色编码点的方法[10]。采用卷积块注意模块(Convolu⁃tional block attention module, CBAM)[11]将中间特征映射沿两个独立的维度(通道和空间)顺序推断出注意映射,再将其乘以输入特征映射即可实现自适应特征细化。CBAM 使模型同时获得更好的性能和可解释性[12-13]。本研究参照CBAM 的机制,在ResNet 模型中同时加入了通道注意力机制和空间注意力机制,提升其自主选择聚焦区域,使模型更具分辨性。

2 结果

2.1 不同层数的ResNet 模型的性能指标研究结果ResNet18、ResNet34 和ResNet50 3 种模型在食管鳞状细胞癌诊断中的总体性能比较,ResNet50 模型表现最佳,见表2。

表2 不同层数的ResNet模型性能指标的比较

2.2 不同层数的AttRes 模型的性能指标研究结果AttRes18、AttRes34 和AttRes50 3 种模型在食管鳞状细胞癌诊断中的分类精度和泛化性比较,At⁃tRes34模型表现最佳,对正常组织和鳞癌组织的分类精度分别达到0.812 和0.979,总体准确率达到了0.895,见表3。

表3 不同层数的AttRes模型性能指标的比较

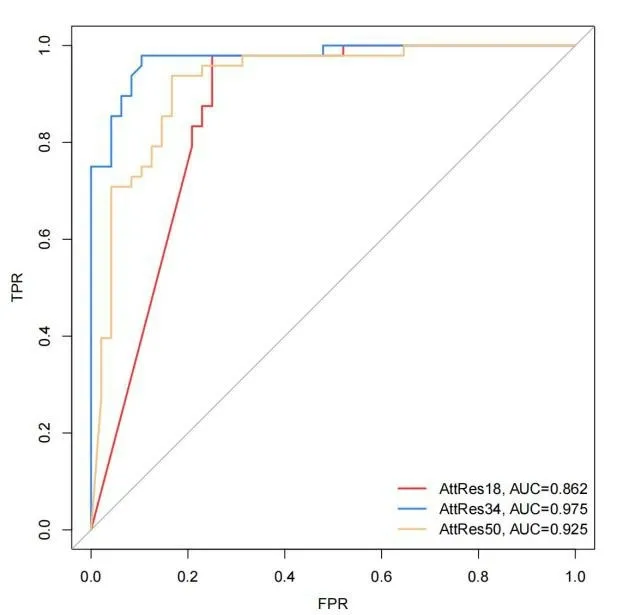

2.3 模型评估的研究结果AttRes18、AttRes34、At⁃tRes50 模型的AUC 值分别为0.862、0.975、0.925。At⁃tRes34 模型的泛化能力最好,其ROC曲线最佳阈值为0.82,AUC 值比AttRes18 和AttRes50 模型分别高0.113和0.050。见图2、3。

图2 AttRes18、AttRes34、AttRes50模型的ROC曲线

2.4 AttRes34 模型的可视化食管鳞状细胞癌组织病理切片原图像经过AttRes34模型预测转换为关注区域的可视化诊断图像,见图4。

图3 AttRes18、AttRes34、AttRes50模型的混淆矩阵

图4 AttRes34模型的可视化输出

3 讨论

本研究分别采用了ResNet18、ResNet34和ResNet50模型,并将注意力机制依次融入3种模型,结果显示,在融入注意力机制后,ResNet18、ResNet34 模型的分类准确率得到了明显提升,但ResNet50 模型的分类准确率却略有下降。分析原因可能是:ResNet18模型由于网络层数较少,所提取的图像特征不足以完成精确的分类任务;ResNet50 模型由于引入瓶颈设计,限制了注意力模块的参数获取,导致其准确率下降;ResNet34 模型相较ResNet18 模型有更多网络层数,能提取到更多的图像特征,且不含ResNet50 模型中的瓶颈模块,在融入注意力机制后准确率获得了飞跃性提升。

本研究采用AttRes34 模型对食管鳞状细胞癌进行辅助诊断,其可视化模块能够帮助医生更好地理解模型的输出结果,在一定程度上减少了人工诊断过程中存在的漏诊等问题。本研究结果显示,At⁃tRes34 模型的准确率比AttRes18 和AttRes50 模型分别高出5.2%和12.5%,且相比于ResNet 原模型表现更佳,能够提供较为准确的辅助诊断意见。

可视化的食管癌检测模型在临床中有着广泛的应用前景,但受组织病理学图像的成像质量等客观因素的影响,模型在分类方面仍有一定的改进空间。在今后的研究中将尝试收集更多种类的食管癌组织病理学图像,以建立分类能力更丰富、泛化能力更高的分类模型,尽可能减轻临床医生在面对大量数据时的阅片压力,提高阅片速度。