基于Adaboost的作战目标属性判定方法

2022-04-07史宪铭李亚娟

李 园, 史宪铭,*, 李亚娟, 赵 美

(1. 陆军工程大学石家庄校区装备指挥与管理系, 河北 石家庄 050003;2. 陆军步兵学院石家庄校区机械化步兵系, 河北 石家庄 050227)

0 引 言

作战目标属性判定主要是依据作战目标的特性来确定目标的点面性质,用以支撑弹种选择和战术决策。在实际作战环境下,点、面目标的属性判定在一定程度上决定了作战方式、武器装备选择和弹药消耗计算方式,科学判定作战目标属性具有重要的理论和现实意义。目前对作战目标属性的判定,主要依据是指挥员经验和历史数据,通常将点目标定义为幅员较小且相对独立的目标,打击时逐个分配;将面目标定义为配置幅员较大的目标,打击时按照面积分配。比如,在武器目标分配研究中,文献[1-2]将对方士兵判定为点目标进行武器分配。在弹药消耗预计研究中,文献[3-4]将地堡判定为面目标、文献[5-6]将敌方坦克群判定为面目标,以公顷为度量单位进行弹药消耗数量的预计。实际上,当地堡群有效毁伤面积对于阵地幅员占比较小或者对方坦克群中各坦克间距离较大时,将地堡群和坦克群中的各个目标视为点目标进行决策,则会使打击决策更为合理,并在一定程度上节省弹药。当对方的装甲车辆、士兵部分处于隐蔽或半隐蔽状态,则更倾向于将该目标判定为面目标。可见,目标属性判定主要依赖于目标特征,尽管作战指挥员可以通过现场情况进行较为有效地判断,但是在当前指挥自动化高度发展的情况下,依靠指挥员现场判断的决策速度慢、效率低且准确性难以保证,迫切需要建立适应性和针对性较强、速度和准确度高的模型算法。

作战目标属性判定问题的本质是进行目标分类,目前常用的分类器有朴素贝叶斯、决策树、人工神经网络和支持向量机等。上述几种常用的分类器存在一些问题:朴素贝叶斯需要计算先验概率,假定了样本数据特征之间的独立性,在处理复杂问题中具有局限性;决策树易出现过度拟合的问题;人工神经网络需要大量的参数,收敛速度慢,并且容易陷入局部最优解;支持向量机对缺失数据、参数调节和和函数的选择较为敏感,单个分类器的准确率往往难以达到分类要求。

相较于采用单个分类器的方式,集成学习算法因其可将多个不同的单个分类器进行组合,分类准确率更高、泛化性能好,而受到越来越多学者的关注。自适应提升(adaptive boosting,Adaboost)算法是一种集成学习算法,通过调整样本权重,循环筛选出若干个单个分类器作为弱分类器,并将其加权组合成强分类器。既能充分运用多种属性,又能灵活划分属性边界,通用性强,计算速度快。弱分类器的选择是Adaboost算法集成的基础,常用的弱分类器有单层决策树、人工神经网络和支持向量机。鉴于单层决策树具有计算复杂度低、结果输出易于理解的优势,本文采用单层决策树作为Adaboost算法的弱分类器。在此基础上,开发适用于作战目标属性判定的Adaboost模型,为作战目标分类程序实现提供模型基础,为提高作战指挥和作战保障决策提供支持。

1 基于Adaboost的作战目标属性判定程序

1.1 作战目标属性判定影响因素分析及特征提取

作战目标属性判定问题的产生,主要由于作战目标幅员以及目标在战场空间配置形态差异所导致。通常对目标属性进行判定以目标配置幅员的大小为主要衡量标准,当目标配置幅员较小时为点目标,反之为面目标。而作战目标配置形态多样,仅依靠目标幅员并不能充分概括以下个体目标和群体目标在战场空间中的配置形态:一是在遮蔽场景下,暴露的配置幅员较小,但实际配置幅员较大的目标,即目标掩蔽程度较大;二是配置幅员较大,同时单位个体间距离也较大的目标,即目标集中程度较小。

根据目标属性判定问题产生的特点和成因,本文提取两种目标特征对目标配置形态进行描述。具体说明如下。

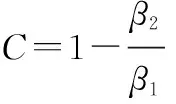

(1) 目标掩蔽程度,可通过目标暴露程度来计算。目标暴露程度为目标隐蔽后通过我方对敌攻击的武器装备可以直接观察到的面积与目标面积的比值,则目标掩蔽程度为

(1)

式中:目标面积由个体目标尺寸和数量决定;目标有效面积指通过我方对敌攻击的武器装备可以直接观察到目标部分的面积。目标掩蔽程度取值范围在0~1之间。当掩蔽程度值为1时,即目标有效面积与目标面积相等,说明目标完全暴露在我打击武器装备视野中;反之,当掩蔽程度值越来越小甚至趋近于0时,说明目标隐蔽程度逐步增大。

(2) 目标集中程度,是目标相对于配置区域的一种测度量,用目标面积与目标配置区域面积的比值来衡量,计算公式为=。其中,目标配置区域可认为是由一定简单形状完全覆盖的单个或多个目标的 区域。简单形状可以是矩形、圆形等,本文采用外接圆,即面积由目标配置区域外接圆面积决定。目标集中程度取值区间在0~1之间,集中度越小表示目标区域形状越分散,集中度越大表示目标区域形状越紧凑。

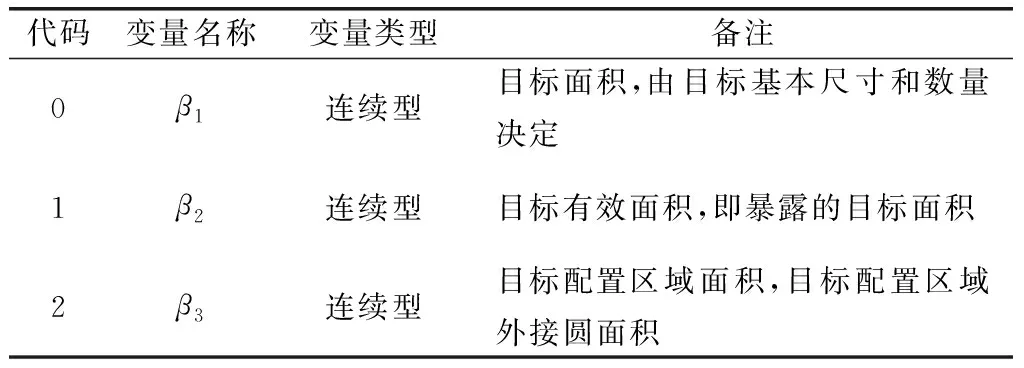

由于目标掩蔽程度和目标集中程度需要通过计算后得到,为了简化模型输入程序,本文直接将两种特征中的基础变量作为目标属性判定模型的初始特征变量进行输入,如表1所示。

表1 模型的初始特征变量Table 1 Initial characteristic variables of model

1.2 作战目标属性判定基本方法

Adaboost算法作为一种集成学习算法,通过调整样本权重,循环筛选出若干个单个分类器作为弱分类器,并将其加权组合成强分类器,来进行决策判断。

1.2.1 基于单层决策树的弱分类器设计

决策树是一种传统的分类算法,结构简单,易于被理解。单层决策树也称决策树桩,是一种简单的决策树,由一个内部节点(根节点)与终端节点(叶子节点)直接相连。结构中的根节点代表一个特征,每个叶子节点代表一种分类结果。单层决策树构造简单,运行速度快,组合成的强分类器可以提高系统计算速度,降低系统计算成本。

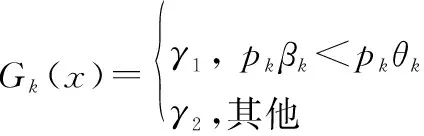

在作战目标属性判定中,弱分类器与目标特征一一对应,基于单层决策树的弱分类器原型为

(2)

式中:为目标特征;为训练后得到的目标特征阈值,即弱分类器的阈值;表示不等式的方向;,为目标属性判定结果,因为-1为点目标,1为面目标,所以当判定结果完全正确时,||=||=1。

1.2.2 基于Adaboost的强分类器设计

Adaboost算法由Freund和Schapire提出,主要解决了早期Boosting算法选择弱分类器时,需要事先确定弱分类器的分类准确率的现实困难。Adaboost算法的核心思想是通过重复调用训练的弱分类器,调整样本在训练集里的权重分布,增加被错误分类的样本权重,从而迫使弱分类器将注意力集中在训练集中的难分类的样本上。算法步骤如下。

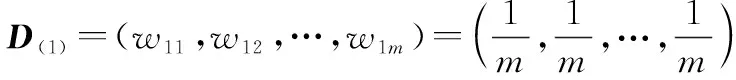

假设输入样本集为={(,),(,),…,(,)},样本数为=1,2,…,,其中∈表示样本特征,∈={-1,+1}表示样本类别,迭代次数=1,2,…,,输出强分类器为()。

初始化样本集权重分布。

(3)

(4)

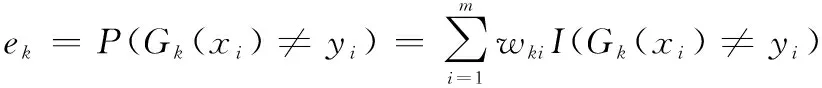

开始迭代计算,达到目标条件后停止。第次迭代时,选取分类误差率最低的弱分类器(),计算弱分类器在权重分布为的样本集上的分类误差率。

(5)

式中:分类正确时(·)取0,反之取1。

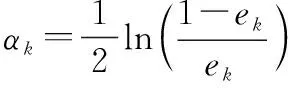

计算()在强分类器中的权重。

(6)

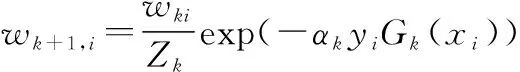

更新样本集的权重+1,。

(7)

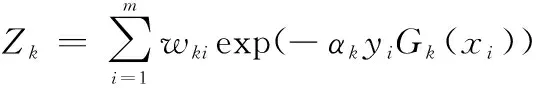

式中:是规范化因子,表达式为

(8)

依据弱分类器权重构建强分类器。

(9)

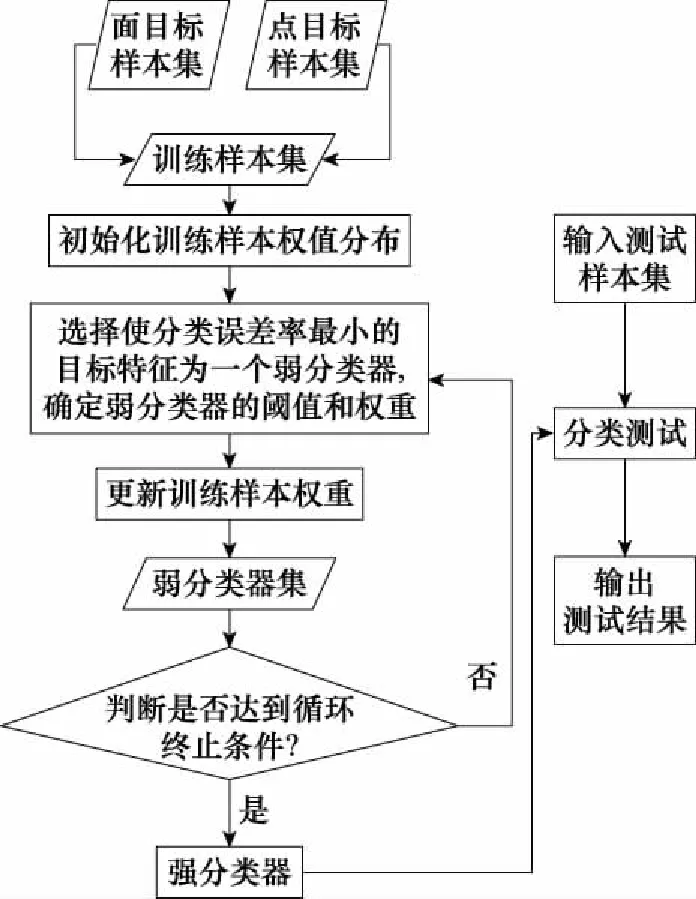

1.3 基于Adaboost的作战目标属性判定流程

基于Adaboost算法的作战目标属性判定流程由训练模块和测试模块组成,如图1所示,其中左侧模块为训练模块,右侧模块为测试模块。训练模块是将准备好的训练样本集,输入到Adaboost算法分类器中,筛选出具有较强分类能力的目标特征作为弱分类器,通过迭代调整弱分类器的权重,直至强分类器的分类结果达到目标要求。检测模块是将测试样本集输入到训练得到的强分类器中,得到分类结果。

图1 基于Adaboost的作战目标属性判定流程Fig.1 Operational target attribute determination process based on Adaboost

2 示例分析

在Windows10操作系统下,使用Python编程语言,以Spyder为开发工具,实现了基于Adaboost算法的作战目标属性判定模型的建立,并在主频为2.6 GHz,内存为8 GB的电脑上进行程序调试。

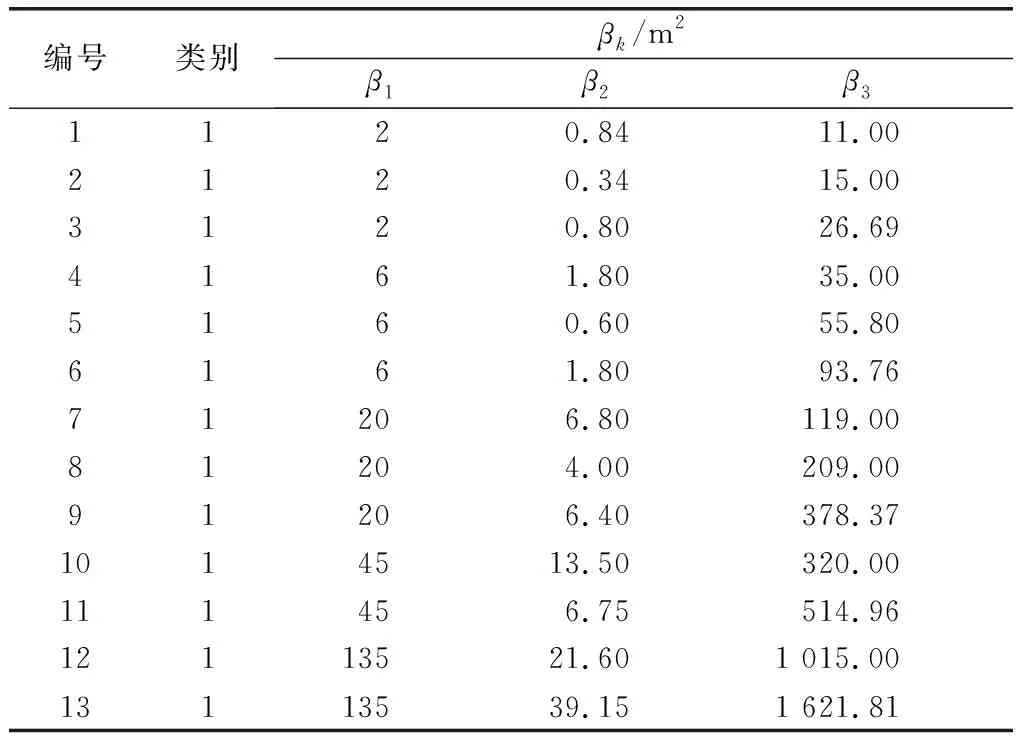

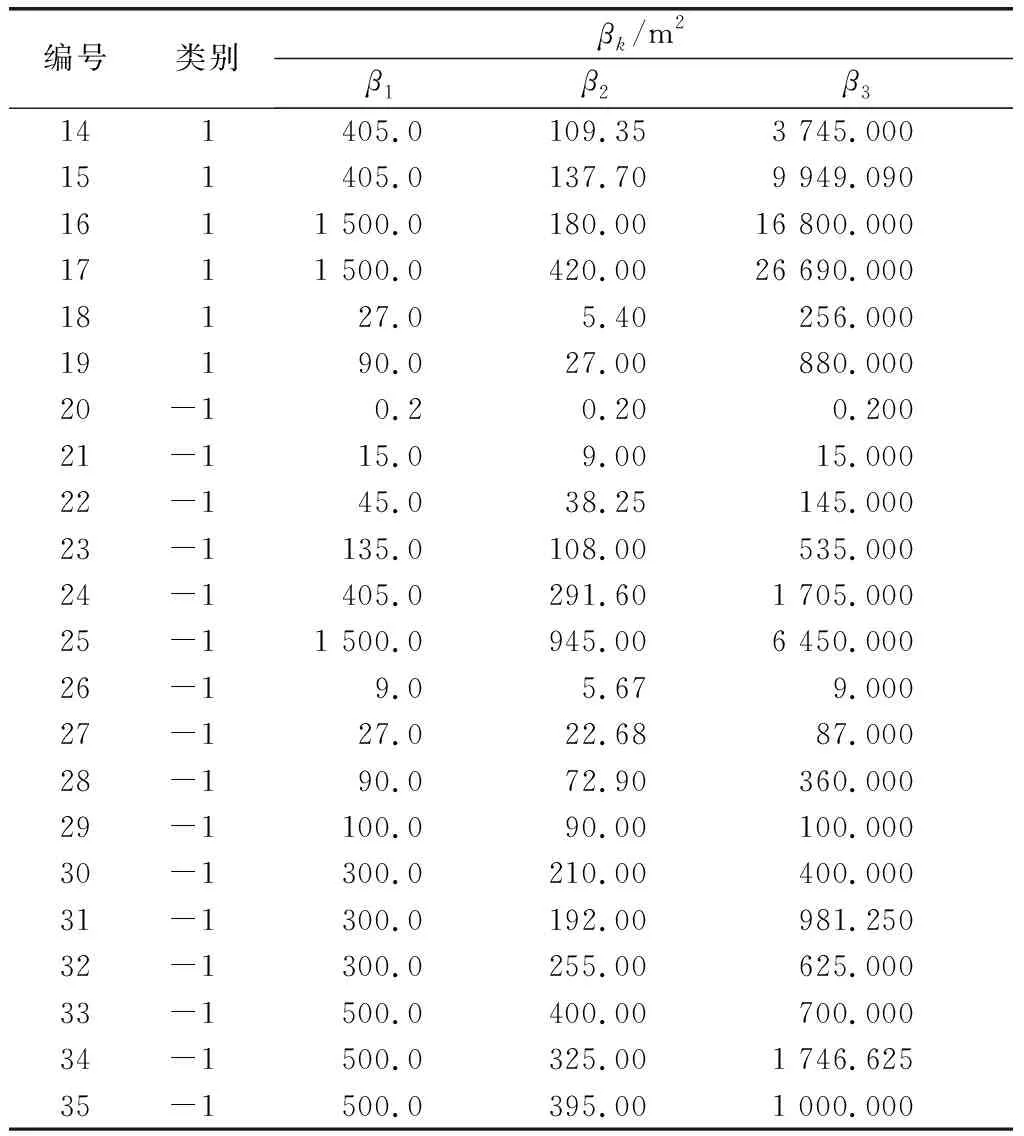

2.1 数据准备

以典型作战目标为基础,根据专家对作战目标点面判定分析结果为依据,得到35个作战目标特征数据作为Adaboost判定模型的样本数据集,如表2所示。

表2 样本数据集Table 2 Sample data set

续表2 Continued Table 2

将上述样本数据的85%作为训练样本,选取剩余15%作为测试样本,进行模型训练和测试。

2.2 模型的训练和测试

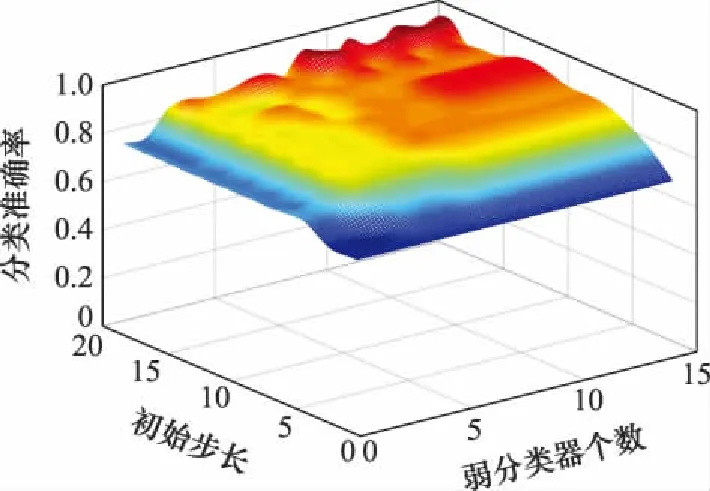

以上述样本集为基础,随机选取30个样本作为训练样本,5个样本作为测试样本。考虑到Adaboost算法中,弱分类器的个数和参数直接影响分类的准确率,为确定最佳的弱分类器个数,分别将弱分类器的初始步长取0~20间的整数,得到弱分类器的初始步长、个数与分类准确率的关系如图2所示。

图2 参数关系图Fig.2 Parameter relationship diagram

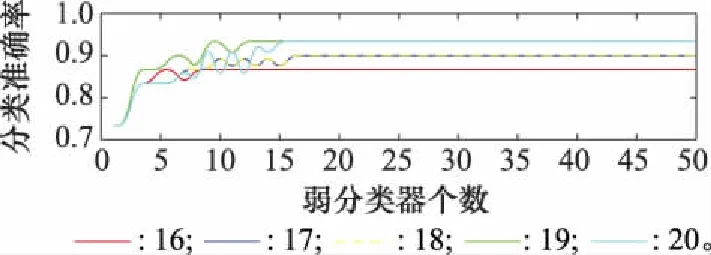

由图2可知,当弱分类器的初始步长大于15时,强分类器的分类准确率更高,因此将弱分类器的初始步长取16~20之间的整数。改变初始步长的值,进一步得到不同初始步长时的分类准确率,如图3所示。当初始步长取19时,强分类器最快达到最高准确率0.933,此时弱分类器个数为9,故初始步长取19。强分类器中各个弱分类器的参数如表3所示。

图3 弱分类器个数-分类准确率曲线图Fig.3 Weak classifier number-classification accuracy curve

表3 弱分类器参数

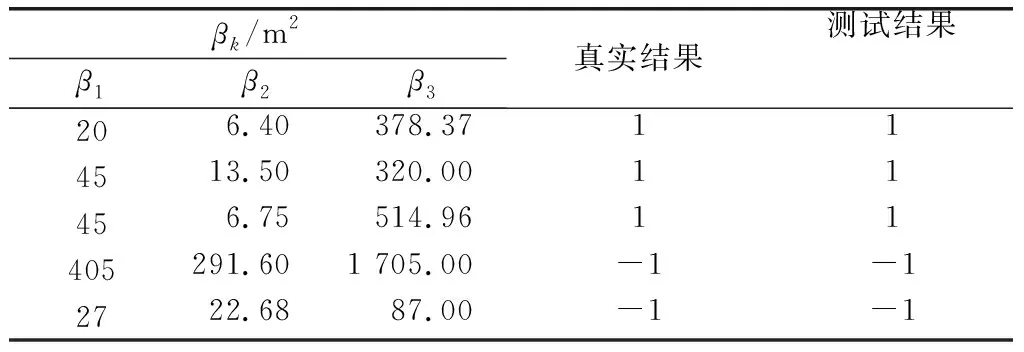

得到弱分类器的参数后,为检测训练得到的Adaboost强分类器在目标属性判定中的分类效果,使用测试样本对得到的强分类器进行测试,并对分类结果进行比较,如表4所示。结果显示,利用训练得到的Adaboost强分类器进行目标属性判定的分类结果与实际分类情况相符,验证了Adaboost算法对目标属性进行判定的科学性。

表4 测试结果Table 4 Test results

2.3 对比分析

为了分析Adaboost算法对作战目标属性判定的有效性,将单层决策树、支持向量机、人工神经网络以及Adaboost分类器,在训练样本上进行对比分析。除了采用前文所用的分类准确率指标进行评估,增加了命中率(true positive rate,TP)、误检率(false positive rate,FP)、受试者工作特征(receiver operating characteristic,ROC)曲线和ROC曲线下面积(area under ROC curve,AUC)4个指标,4种评估指标通过混淆矩阵推导得出,混淆矩阵中包括4个变量,分别为真正例(true positive,TP)、假正例(false positive,FP)、真反例TN(true negative,TN)和假反例(false negative,FN),显然TP+FP+TN+FN=样本总数,本文将面目标作为正样本,点目标作为负样本,如表5所示。

表5 混淆矩阵Table 5 Confusion matrix

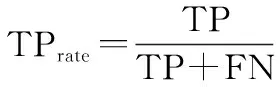

TP指被正确分类的正样本占所有正样本数的比值,取值范围在0~1之间,越接近1分类效果越好,计算公式为

(10)

FP指被错误分类的负样本占所有负样本数的比值,取值范围在0~1之间,越接近0分类效果越好,计算公式为

(11)

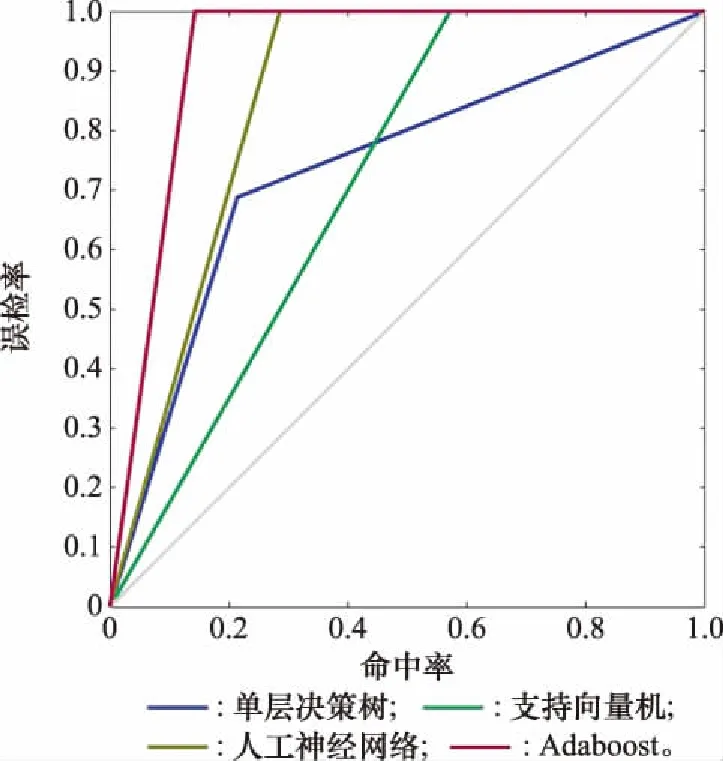

ROC曲线用于评估分类器的分类性能,以TP作为横坐标,FP作为纵坐标,当TP值越大,FP值越小时,即曲线越接近点(0,1),分类器的分类效果越好。AUC是ROC曲线下的面积值,是对ROC曲线评估分类器性能的定量描述,取值介于0~1之间,越接近1说明分类器的分类效果越好。

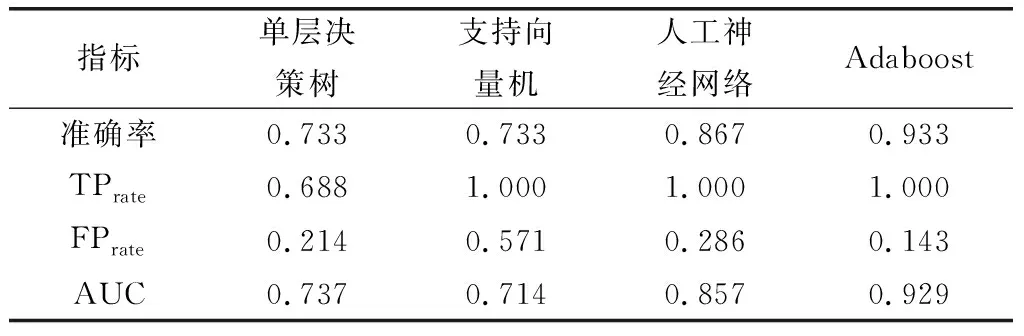

表6是4种分类器在训练样本上的准确率、TP、FP和AUC指标,图4是评估4种分类器性能的受试者工作特征曲线。

表6 4种分类器评价结果Table 6 Comparison of Evaluation results of four classifiers

图4 4种分类器的ROC曲线对比Fig.4 Comparison of ROC curves of four classifiers

经过分析,与单层决策树、支持向量机和人工神经网络3种单个分类器相比,本文使用的Adaboost分类器的分类准确率和AUC值均最高,并且有很大的提升,分类准确率提升最大的为20%,AUC值提升最大的为0.215。同时可以看出,Adaboost分类器的ROC曲线最接近点(0,1),说明Adaboost分类器对于作战目标点、面属性的判定效果最好。证实了Adaboost分类器能对弱分类器的分类效果进行优化,具有良好的分类准确率提升能力,验证了基于Adaboost目标属性判定模型的有效性。

3 结 论

现代高技术战争条件下作战指挥和作战保障都需要以高效的作战目标属性判定为基础,通过采用Adaboost算法,可以快速有效地进行程序实现,提高判定效率和准确度,避免单纯由指挥员人为判定而带来过多的人机交互,大大提高了指挥自动化水平。

在进行作战目标属性判定中,目前常用的分类器大多为单分类器,其准确率往往难以达到要求。本文提出的基于Adaboost的作战目标属性判定方法,采用决策树分类器作为算法框架的内核。通过对35组样本数据进行分类实验。结果表明:① Adaboost分类器可以增强单分类器的分类准确率;② 提出的基于目标特征划分点目标和面目标的方法优于传统的单层决策树、支持向量机和人工神经网络方法。可见,Adaboost算法分类器应用于作战目标属性判定具有科学性和有效性。