基于超像素注意力和孪生结构的半监督高光谱显著性目标检测

2023-10-07秦昊林许廷发李佳男

秦昊林, 许廷发,2,3, 李佳男,3*

(1.北京理工大学 光电学院, 北京 100081; 2.北京理工大学重庆创新中心, 重庆 401120;3.北京理工大学 光电成像技术与系统教育部重点实验室, 北京 100081)

0 引言

显著性目标检测(SOD)技术作为伪装识别、异常检测、动作识别等任务[1-3]的关键技术之一,得到了广泛关注和研究。近年来,随着高光谱图像处理技术的发展,基于高光谱图像的显著性目标检测(HSOD)技术取得了优异的成绩,并展现出了惊人的潜力。与传统的彩色图像(RGB)相比,高光谱图像具有额外的、丰富的光谱信息,能够更准确地反映物体特性。尤其是在复杂环境条件下,例如相似背景、过曝光、不均匀光照等情况,高光谱SOD技术具有更明显的优势。

在先前研究中[4],人们主要使用光谱强度、光谱角距离等浅层手工特征计算每个像素的显著性得分,并生成显著性结果图。但是这些传统方法的鲁棒性和检测精度往往差强人意。近年来,深度学习技术在计算机视觉领域取得了巨大成功[5-7]。受此启发,人们将该技术引入高光谱显著性目标检测任务[8],并提出了具有更高检测性能和鲁棒性的神经网络模型。然而这些模型的训练需要大量带有严格像素级标注的数据样本。这会带来高昂的标注成本[9],限制了深度学习技术在该领域的进一步发展,是一项亟待解决的重要挑战。

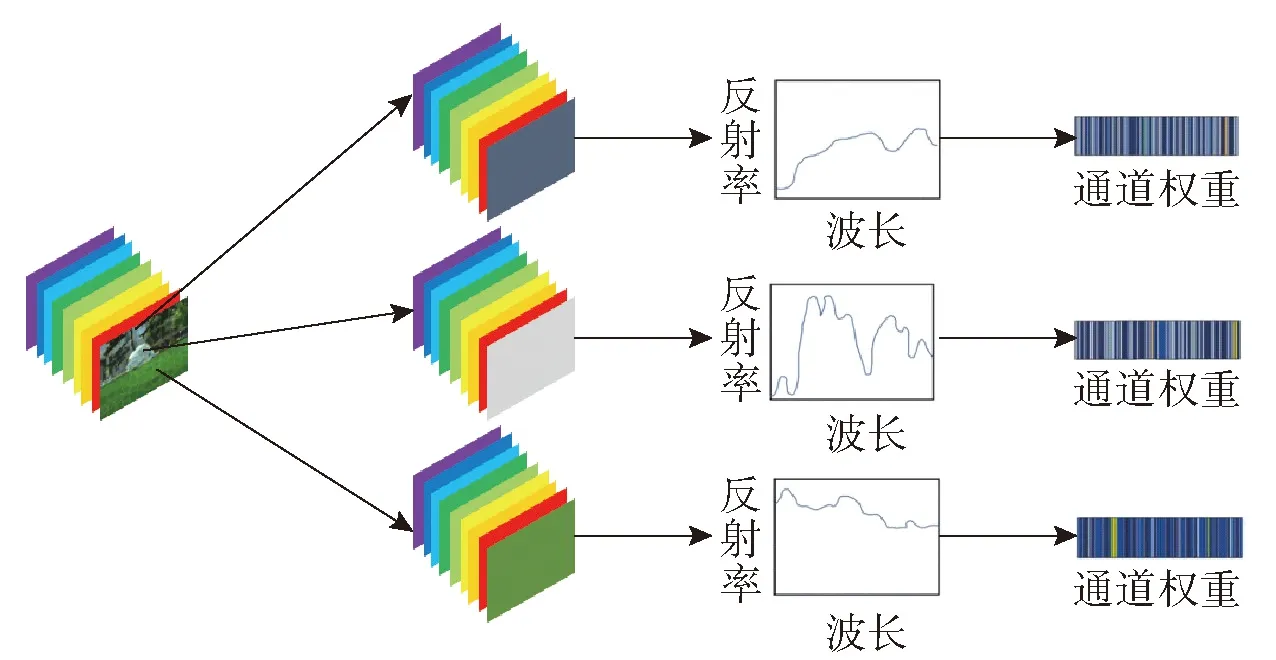

为了解决上述问题,本文采用半监督训练模式降低标注成本,同时充分利用高光谱图像特性以提高检测性能。具体地,高光谱图像中每个像素点都包含了一条完整的光谱曲线,如图1所示。基于这一特性,可以利用超像素方法实现高精度的像素聚类,对人眼无法感知的光谱信息进行捕捉。此外,各光谱通道间的相互影响也是一项值得关注的特性[10]。

图1 网络建立动机示意图

受上述启发,本文提出一种半监督高光谱SOD算法,该算法使用一个小规模全监督数据集和一个大规模弱监督数据集进行半监督训练。其中全监督数据集包含以像素级标注作为标签的少量数据,弱监督数据集具有大量使用显著性边界框作为弱标签的数据。本文提出的算法由孪生预测模块和注意力辅助模块两部分组成。当给定一张输入图像时,孪生预测模块根据对应的弱标签生成两张同源图像作为输入,并利用共享权重参数的两个分支网络分别预测,生成对应的显著性结果图。在训练过程中,通过最小化结果图之间的差异来学习弱标签中的隐式约束。注意力辅助模块引入一个超像素级通道注意力网络,以充分利用光谱信息。在弱标签的指导下,它可以为弱监督数据集中的每张图像生成准确的掩码。在实际训练中,本文首先在全监督数据集上利用像素级标签训练孪生预测模块,并引入注意力辅助模块为弱监督数据集生成掩码,之后利用掩码优化预测模块。本文在多个高光谱和彩色数据集上进行了大量的定量评估和定性分析实验,都展现了优异的SOD效果,同时显著节省了像素级标注成本。

本文的主要贡献可以概括为以下4点:

1)提出了一个半监督检测算法,减少了对全监督数据的需求,有效降低了像素级标注带来的成本。这是半监督训练策略在高光谱SOD任务的首次应用。

2)提出了一个孪生预测模块,以两张同源图像作为输入,有效捕获显著性边界框的隐式约束,使弱标签具有与像素级标签相近的约束能力。

3)提出了注意力辅助模块,它基于超像素级通道注意力网络来充分利用高光谱图像特性,有效抑制了背景的干扰,显著提升了检测性能。

4)在多个高光谱和彩色数据集上对提出的算法进行了性能评估,达到了先进的检测精度,为后续工作提供了新的标准。

1 相关工作

1.1 高光谱SOD

基于高光谱图像的SOD技术是一个新颖且有价值的研究方向。Itti等[11]使用颜色对比度和相对位置方向来计算各像素显著性得分,提出了首个SOD模型。受此启发,Moan等[12]、Liang等[13]、Zhang等[10]先后提出了利用浅层手工特征的高光谱SOD方法。然而这些传统方法在处理复杂情况时表现出了精度低、鲁棒性差的缺陷。为了解决这些问题,Imamoglu等[14]首次将深度学习技术应用于高光谱SOD任务中,提出了基于卷积神经网络的自监督模型。之后Huang等[15]对其进行了优化,通过同时考虑空间和光谱信息进一步提升了模型性能。与传统方法相比,这些基于深度学习技术的神经网络模型显著提高了检测精度和鲁棒性。但是模型的训练需要大量带有像素级标签的训练样本,这将带来高昂的标注工作成本,限制了深度学习技术在该领域的发展。

1.2 半监督训练策略

近年来,在神经网络模型训练中引入半监督训练策略成为各项计算机视觉任务的研究热点。与常用的全监督训练策略相比,半监督训练策略表现出了更强的扩展性,同时大大减少了人工监督成本。例如,Pan等[16]提出了一种双流混合网络来模拟双目视觉以进行SOD。文献[17]提出了一种使用线性反馈系统模型的半监督分类器来生成平滑准确的显著性结果图。然而上述算法只适用于传统彩色图像,无法扩展到光谱图像。据了解,这是首次将半监督训练策略应用于高光谱SOD任务之中。

1.3 注意力机制

注意力机制在SOD任务中发挥了重要作用。Zhang等[18]提出了一种用于遥感图像的密集注意力流体网络。文献[19]使用了一个交叉注意模块来捕获周围像素的有价值的上下文信息。这些工作都证明了注意力机制有助于检测性能的提升,但是他们只关注了数据的空间维度信息,而忽略了对光谱信息的深度挖掘。合理利用高光谱图像的光谱通道,构建能够充分利用光谱特性的注意力网络,将有助于提高检测精度。

2 基于超像素注意力和孪生结构的半监督高光谱SOD方法

图2展示了本文提出的算法整体架构。本文基于U2Net[20]构建了具有双分支孪生结构的预测模块,用于预测输入图像的显著性结果图,并学习弱标签中的隐式约束条件。另外,本文还提出了由超像素级通道注意力网络和U2Net组成的注意力辅助模块,用于预测模块的优化。在训练过程中,本文首先在全监督数据集上对孪生预测模块进行预训练,以原始图像和孪生图像作为输入,输出预测结果。之后利用边界框弱标签为弱监督数据集生成边界图像并送入注意力辅助模块,其中U2Net加载预训练参数,生成对应掩码。最终在弱监督数据集上,利用掩码采用全监督策略对孪生预测模块进行优化训练,生成高质量显著性结果图。

图2 超像素注意力孪生半监督算法架构图

2.1 孪生预测模块

本文提出的算法通过小规模的全监督数据集和大规模的弱监督数据集进行半监督训练。弱监督数据和全监督数据之间的关键差异在于弱标签失去了对每个像素的约束[21]。当使用边界框作为弱标签时,每个像素上的约束被转换为区域级隐式约束。为了充分利用这种隐式约束,本文提出孪生预测模块,其详细结构如图2所示。该模块以原始图像和孪生图像作为输入,其中孪生图像是根据显著性边界框裁剪原始图像获得的同源图像。两幅图像被同时输入到孪生预测模块中,其中两个分支网络之间共享权重参数,最终分别生成预测结果。在训练过程中,通过最小化两个分支的预测结果之间的差异,孪生预测模块可以捕获弱标签和像素之间的隐式约束。本文通过计算均方误差来表示这一差异,其计算公式为

(1)

式中:LMSE为预测结果之间的差异;N为预测的显著性结果图的总像素数;Ap和Bp分别表示两个分支预测结果中的第p个像素。在训练过程中,本文使用U2Net作为特征提取网络,它以浅层UNet为基础块,使用卷积核为3×3的卷积层提取特征。构建了U型网络结构,利用池化层和空洞卷积层来捕获多尺度信息。最终生成预测结果,计算与像素级标签之间的混合损失函数。

2.2 注意力辅助模块

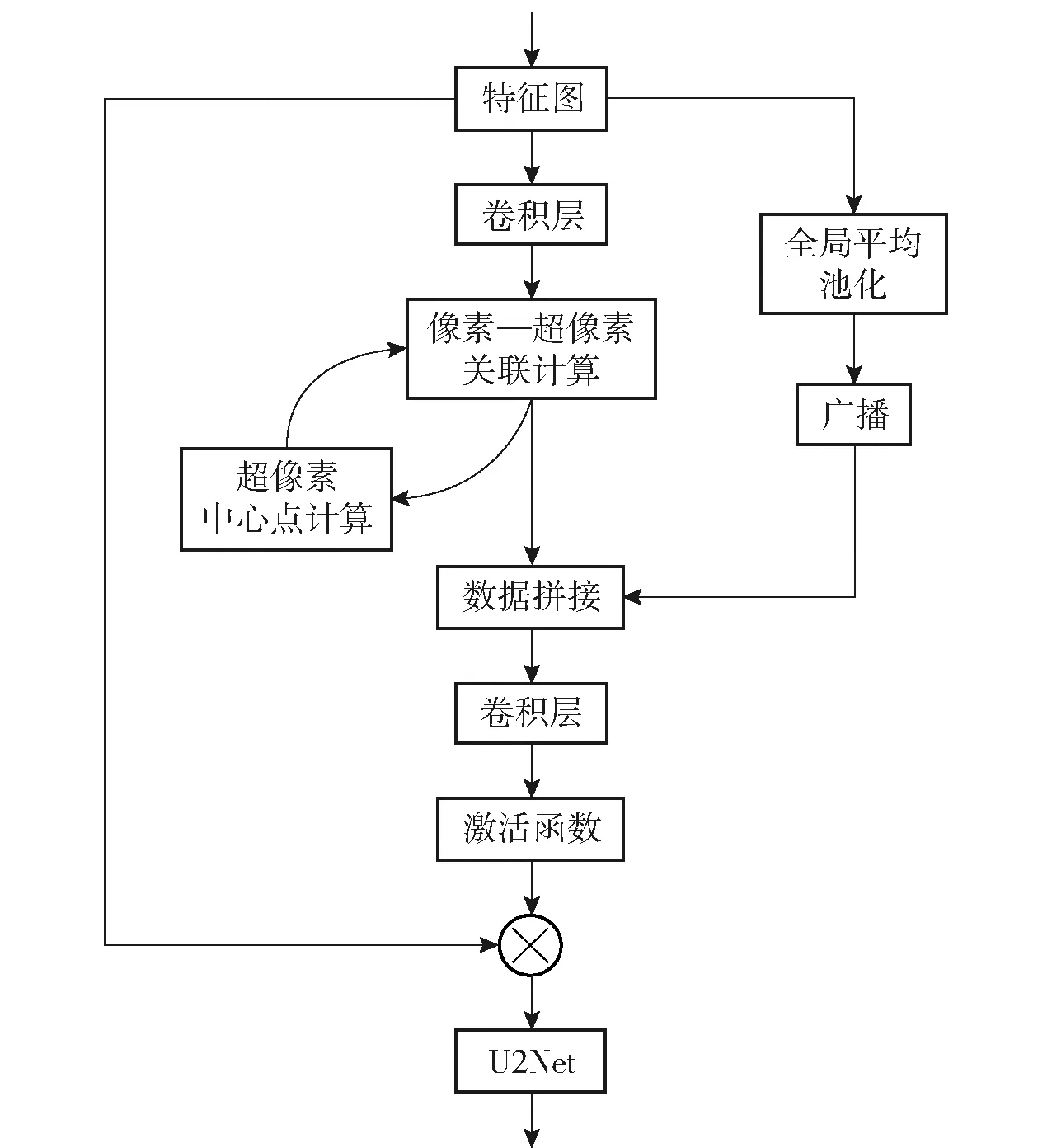

显著性边界框弱标签可以被视为带有噪声的像素级标签。框外的像素不包含噪声,被视为背景。在噪声的干扰下,框中的背景点被误认为前景点。这种误差会使网络在梯度反向传播过程中收敛到错误的方向。因此本文考虑利用每个像素的光谱曲线进行超像素聚类,来帮助算法准确区分背景和前景。此外,本文还充分利用了光谱通道之间的相互联系,以作为实现物体类型准确划分的可靠基础。综上,本文设计了一个超像素级通道注意力网络来抑制弱标签中隐含的噪声。传统的超像素分割算法在数学上是不可微分的,因此采用可以集成到神经网络中进行端到端训练的超像素采样网络[22]。此外,本文计算了空间全局权重,利用全局特征进行逐通道信息校正。超像素级通道注意力网络的详细流程如图3所示。

图3 超像素级通道注意力网络示意图

具体地,给定输入特征图F∈RH×W×C(H和W分别为输入特征图的高和宽,C为特征图的光谱通道数量)沿光谱通道执行全局平均池化操作从而生成每个通道的权重矩阵,其计算公式为

R1×1×1,c=1,…,C

(2)

式中:Mc为第c个光谱通道对应的权重矩阵;Fc为输入特征图的第c个光谱通道。之后沿空间维度对Mc进行广播,生成具有原始尺寸的全局通道权重P∈RH×W×C。

P={Pc∈RH×W×1|c=1,…,C}

(3)

Pc=φ(Mc)

(4)

式中:φ(·)表示沿空间维度的广播操作。

同时,利用超像素采样网络对输入特征图F进行迭代优化,生成超像素图S。之后将其与上述步骤生成的全局通道权重P沿光谱通道维度进行数据拼接,并经过卷积核为1×1的卷积层和Sigmoid激活函数来获取通道权重特征图E,其计算公式为

E=Sigmoid(Conv(Cat(S,P)))∈RH×W×C

(5)

S=ψ(F)∈RH×W×C

(6)

式中:ψ(·)为超像素采样操作。生成的通道权重与输入特征图具有相同尺寸,每个点的取值表示了对应像素在计算最终显著性结果图时的重要程度。因此,可以利用通道权重特征图E对输入特征图F进行逐点校正,其计算公式为

=F⊗E

(7)

2.3 混合损失函数

为了使预测模块更好地收敛,本文在训练过程中参考文献[23],使用混合损失函数,其计算公式为

LFUS=LBCE+LSSIM+LIOU

(8)

式中:LBCE表示二元交叉熵损失函数;LSSIM表示结构相似度损失函数;LIOU表示边界框损失函数。LBCE在所有像素点上约束算法收敛,而非关注某个特定区域,其计算公式为

(9)

式中:Gi∈{0,1}为像素i的真实标签;Si∈{0,1}为该像素预测为显著性目标的预测概率。LSSIM对局部结构变化敏感,有助于优化结果边界,其计算公式为

(10)

式中:x和y表示两张图像;μx和μy为图像中所有像素的平均值;σx和σy为像素对于均值的偏差;常数C1和C2用于保证分母不为零,通常C1=0.012,C1=0.032。LIOU把位置信息作为一个整体,使算法具有更强的多尺度处理能力,其计算公式为

(11)

综上,本文使用了混合损失函数LFUS使网络得到有效收敛。

3 实验与结果分析

3.1 实验设置

在开始训练之前,本文使用旋转和翻转操作进行数据增强,之后在RTX 3090 GPU上使用Adam优化器对算法进行训练。本文采用5种广泛使用的性能评价指标对提出的算法进行综合评估,包括平均绝对误差(MAE)、F-measure(Favg、Fmax)、曲线下面积(AUC)和归一化扫描路径显著性(NSS)。

本文在HSOD-C和HS-SOD两个高光谱SOD数据集上进行实验。在HSOD-C上,随机选取56张图像作为全监督数据集,120张图像作为弱监督数据集,24张图像作为测试集。设置初始学习率为0.001,每次训练8张图像。总计在全监督数据集上训练25轮,在弱监督数据集上训练35轮。考虑到数据集的规模,使用轻量化版本U2Net†作为特征提取骨干网络。对于HS-SOD数据集,选择15张图像作为全监督数据集,35张图作为弱监督数据集,10张为测试集。其余训练参数与HSOD-C保持一致。考虑到HS-SOD数据集规模很小,容易出现过拟合现象,因此先在HSOD-C上进行预训练,之后在HS-SOD数据集上加载预训练模型进行微调。

3.2 结果分析

本文将提出的算法与目前流行的6种高光谱显著性检测算法进行了对比。其中:GS[24]算法将光谱波段划分为4组,利用了各波段之间的对比度;SAD[24]和SED[24]算法分别利用光谱角距离和光谱欧式距离计算各像素点显著性得分,并生成显著性结果图;SED-GS[24]和SED-SAD[24]是上述算法的融合算法,结合了多项浅层手工特征。这些算法都属于传统高光谱SOD算法范畴。此外还有基于卷积神经网络的SUDF[14]算法。

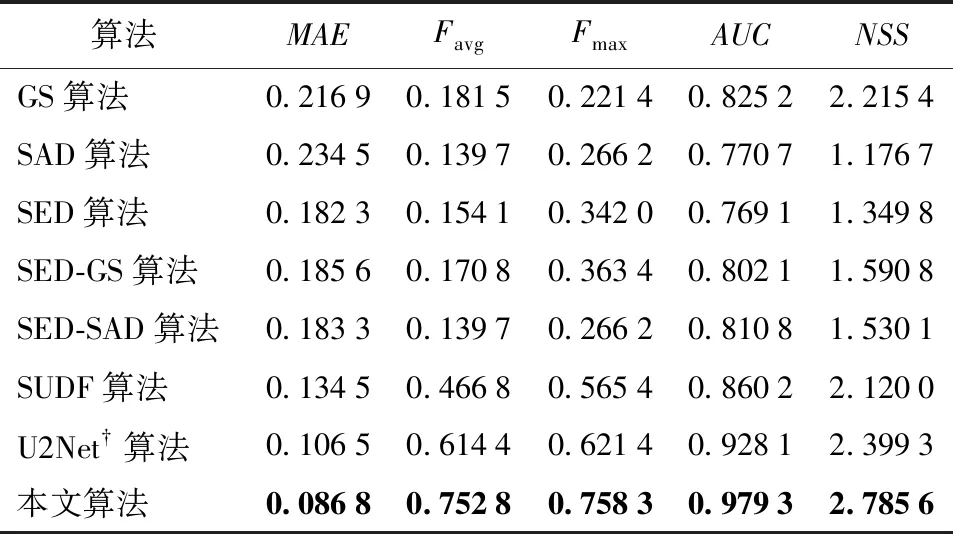

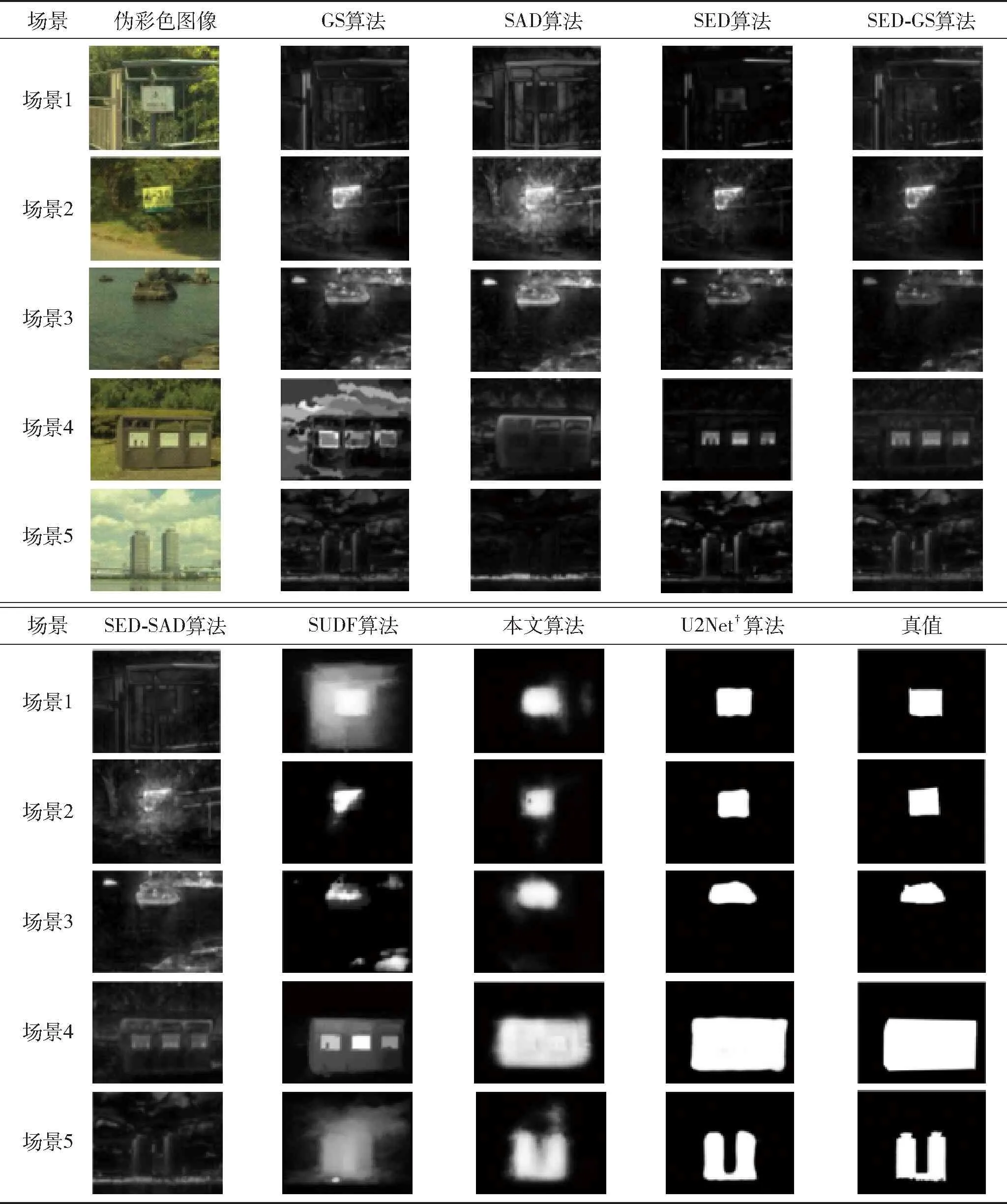

表1展示了各算法在HSOD-C数据集上的检测结果。由表1可以看到,与传统算法相比,基于神经网络的算法在检测精度上有着显著提升,表明了深度学习技术在该领域具有很高的发展潜力。与SUDF算法对比可见,本文提出的算法具有更优异的检测性能,其中F-measure提升了大约0.1,提升幅度最高。值得注意的是,与U2Net算法相比,本文算法已经达到了相近的检测精度。表2展示了不同场景下各算法在HSOD-C数据集上的可视化结果,从中可见本文的算法能够精确地定位显著性目标,并勾勒出了更准确的目标轮廓。这得益于网络中超像素通道注意力的应用,根据光谱信息生成的超像素使得算法具有更强的抗背景干扰能力。

表1 HSOD-C实验结果

表3和表4分别展示了各算法在HS-SOD数据集上的定量评估结果和可视化预测结果图。与6种流行的高光谱SOD算法相比,本文算法在各项性能评价指标上都有显著提升,并达到了最佳的检测精度。在基于预训练模型进行迁移学习的情况下,本文算法在半监督训练策略下,检测性能超过了基于全监督训练策略的U2Net算法。此外,在HS-SOD数据集上,本文算法也具有优异的可视化效果。与其他流行算法相比,预测结果受背景干扰较小,突出了显著性目标的位置和轮廓。上述结果表明,本文算法在降低标注成本的同时实现了先进的检测性能。

表3 HS-SOD实验结果

表4 HS-SOD的可视化结果

HSOD-C数据集收集了复杂环境条件下的高光谱数据,包括不均匀光照、相似背景、过曝光等。表5 展示了本文算法在这些复杂环境条件下的预测结果,并与基于RGB的流行算法BASNet进行了对比。由表5可见:在过曝光情况下,强烈的光照使得背景和目标呈现的颜色相近。此时只利用三基色信息的BASNet算法将无法分别背景和目标,预测结果出现严重偏差;在相似背景和不均匀光照情况下,BASNet算法受背景干扰严重,只能检测到部分目标,严重影响检测精度和性能;与之形成鲜明对比的是,本文算法在3种复杂环境条件下依旧展现出了稳定的检测性能。这是因为高光谱显著性检测关注的是光谱显著性,而不是传统的视觉显著性。在光照条件变化、颜色伪装等挑战下,目标的光谱特性例如光谱曲线、光谱梯度、红外热辐射等不会发生显著变化,基于高光谱图像的检测模型仍具有可靠的检测性能。另外,本文算法利用超像素模块保证了目标的完整性,抗背景干扰能力强,预测结果具有更精确的轮廓。综上,本文算法在复杂环境条件下仍可以得到高质量检测结果,具有可用于伪装识别任务的潜力。

表5 复杂环境条件下的预测结果

3.3 彩色数据集结果

将本文算法扩展到RGB图像并在ECSSD数据集上进行实验。选择其中200张图像作为全监督数据集,600张图像作为弱监督数据集,200张图像作为测试集。设置每批训练样本量为8,初始学习率为0.001。在完全监督数据集上训练200轮,在弱监督集上训练300轮。与8个流行算法进行对比,包括BL[25]、MS[26]、LPS[27]、GMR[28]、RBD[29]、MBD[30]、MST[31]和LFCS算法[32]。

表6展示了各算法在ECSSD数据集上的测试结果。由表6可见:在处理基于RGB图像的SOD任务时,本文算法与同类算法相比仍然显示出先进的性能,各项性能评价指标均达到最佳值;F-measure的提升最为显着,其余指标也有不同程度的提高。在ECSSD数据集上的可视化结果如表7所示,从中可见本文所提出的算法对边缘细节的处理效果较好,能够抵抗目标内部变化的干扰。实验结果表明,本文提出的算法具有出色的泛化能力,并在高光谱和RGB图像上都具有先进的检测性能。

表6 ECSSD实验结果

表7 ECSSD的可视化结果

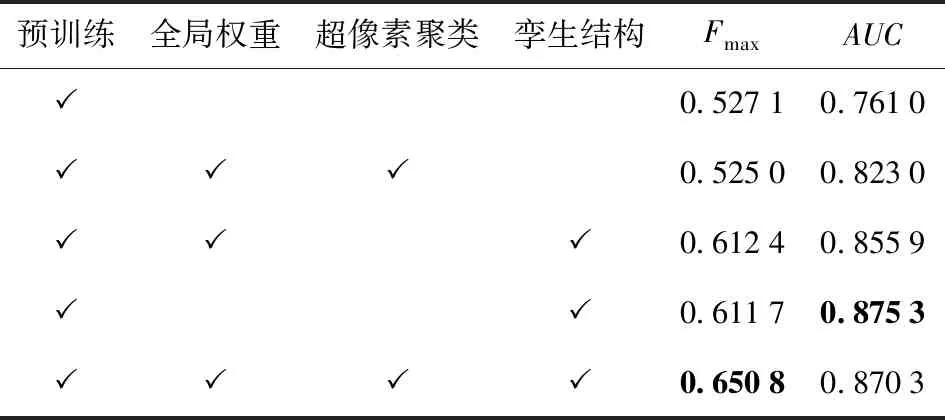

3.4 消融实验

本文在HSOD-C数据集上设计了多组消融实验以验证各模块的有效性,结果如表8所示。对加载预训练模型、使用全局通道权重、使用超像素光谱聚类和使用孪生结构四个部分进行消融研究。考虑到使用半监督训练策略,各组消融实验都启用了预训练,即在全监督数据集上对孪生预测模块进行预训练。

表8 各部分在HSOD-C上的性能评估

本文以未使用孪生预测模块和注意力辅助模块的网络结构作为基准模型,其结果展示在表8的第1行。本文提出的基于超像素注意力和孪生结构的半监督算法结果展示在表8的第5行,其启用了所有模块。

本文首先验证了注意力辅助模块的有效性。如表8第2行结果所示,当启用完整的注意力辅助模块时,Fmax小幅度下降了0.002,而AUC显著提升了0.06。这表明注意力辅助模块能够提升检测性能,但是缺失孪生结构会使得优化效果明显下降。为进一步分析注意力辅助模块的作用,本文评估了生成通道权重特征图的两个要素:全局通道权重和超像素聚类。具体地,表8的3~5行对应了3种网络结构下的检测结果,从中可以发现全局通道权重和超像素聚类都起到了增强检测性能的作用,当使用完整的注意力辅助模块时能够达到最佳状态。另外,通过对比基线模型和仅使用孪生结构的模型结果可以发现,孪生结构显著提升了检测精度。

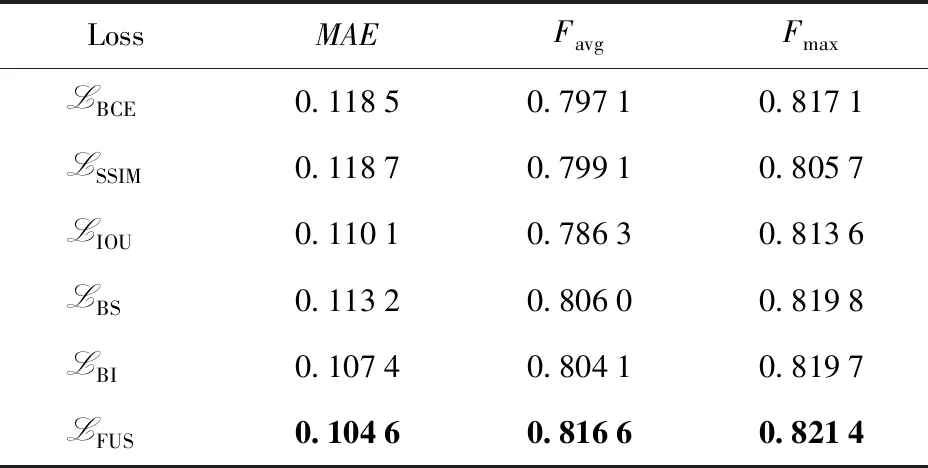

此外,本文测试了不同损失函数对算法收敛效果的影响,结果如表9所示。其中LBS=LBCE+LSSIM,LBI=LBCE+LIOU,LFUS=LBCE+LSSIM+LIOU。对比不同损失函数下的算法检测结果可以发现,当使用单一损失函数时,不同损失函数对算法的约束能力近似,检测精度差异不大。当使用两项及以上的混合损失函数时,对算法具有更强的约束能力,收敛效果更好,检测性能得到了显著提升。尤其是3种损失函数同时使用时,算法达到了最佳的收敛效果。

表9 不同损失函数的约束效果

本文对算法的训练过程进行可视化分析。图4中,第1行显示了算法在全监督数据集上进行预训练时的预测结果。第2行可视化了在算法在弱监督数据集上的优化过程。由图4可以发现,经过全监督数据集的预训练,算法只能确定显著性目标的大致位置,无法确定目标轮廓,受背景干扰严重。在优化过程中,算法更加收敛,逐步勾勒出目标轮廓,定位更准确。可视化结果表明了注意力辅助模块的有效性。

图4 训练期间结果的渐进可视化图

4 结论

本文提出了一种使用超像素级通道注意力和孪生结构的半监督高光谱SOD算法。该算法采用半监督训练策略,通过使用少量全监督数据和大量弱监督数据有效降低了进行像素级标注带来的高昂成本。所设计的孪生预测模块可以有效地学习弱标签的隐式约束,引入的超像素级通道注意力网络充分利用了高光谱图像的光谱特性。本文在高光谱和彩色数据集上进行了性能评估,广泛的实验结果表明,所提出的算法可以在高光谱和彩色SOD任务中发挥先进的性能。

本文提出的算法还存在一些局限性,使用部分全监督数据集和部分弱监督数据集进行训练,这与一般意义上的半监督学习略有不同。在未来的工作中,将在优化过程中删除弱标签的指导。