基于改进YOLOv5s的离线手写数学符号识别

2022-07-03方洪波陈忠辉黄以卫张文勇谢本亮

方洪波,万 广,2,陈忠辉,黄以卫,张文勇,谢本亮,2

基于改进YOLOv5s的离线手写数学符号识别

方洪波1,万 广1,2,陈忠辉1,黄以卫3,张文勇4,谢本亮1,2

(1. 贵州大学大数据与信息工程学院,贵州 贵阳 550025;2. 教育部半导体功率器件可靠性工程中心,贵州 贵阳 550025;3. 贵州财经大学西部现代化研究中心,贵州 贵阳 550025;4. 贵州大学计算机科学与技术学院,贵州 贵阳 550025)

离线数学符号识别是离线数学表达式识别的前提。针对现有离线符号识别方法只是单纯的对符号进行识别,对离线表达式识别的其他环节未有任何帮助,反而会限制表达式识别,提出一种改进YOLOv5s的离线符号识别方法。首先,根据符号图像小的特点,用生成对抗网络(GAN)进行数据增强;其次,从符号类别的角度分析,在YOLOv5s模型中引入空间注意力机制,利用全局最大值和全局平均值池化,扩大类别间的差异特征;最后,从符号自身角度分析,引入双向长短期记忆网络(BiLSTM)对符号特征矩阵进行处理,使符号特征具有上下相关联的信息。实验结果表明:改进后的YOLOv5s取得较好离线符号识别效果,有92.47%的识别率,与其他方法进行对比,证明了其有效性和稳健性。同时,能有效避免离线数学表达式识别中错误累积的问题,且能为表达式的结构分析提供有效依据。

离线手写数学符号识别;数据增强;生成对抗网络;空间注意力机制;双向长短期记忆网络

随着电子设备的广泛应用及人们学习习惯的改变,数学表达式识别(mathematical expression recognition,MER)成为人们关注的热门话题。MER可以分为符号分割、符号识别和结构分析3个环节[1]。符号识别是MER不可缺少的部分,研究始于几十年前,但当时提取图像特征的能力不强,以至MER发展受限。为推动MER的发展,国际文档分析与识别会议(International Conference on Document Analysis and Recognition,ICDAR)在2011年开始引入数学表达式识别竞赛(Competition on Recognition of Handwritten Mathematical Expressions and Typeset Formula Detection,CROHME),为MER和数学符识别提供了公共数据集。CROHME数据集以在线形式表示,可通过程序将在线数据转为离线数据,但会失去一些特征信息,如符号笔画时序特征,这是离线符号识别率低于在线的主要原因。

符号识别的关键是符号特征信息的提取,提取到的特征信息越丰富,识别率越高。MyScript[2]从在线符号的轨迹中提取动态信息,如方向和曲率,基于投影和直方图的方法提取静态特征,通过深度多层感知机(multilayer perceptron,MLP)和循环神经网络处理,识别率为92.81%。以上2种方法均通过人为设定的方式提取特征,其过程复杂,提取到的信息也有限。方定邦[3]提出基于卷积神经网络(convolutional neural networks,CNN)识别方法,用CNN自动提取符号在线和离线特征,符号特征提取更充分且简化了特征提取的过程,在CROHME2016上的识别率为92.92%。

现有离线符号识别已取得较高识别率,把现有方法应用到离线MER (offline MER,OMER)中效果并不好,根本原因是OMER存在错误累积的问题,即符号分割错误会导致符号识别和结构分析错误,最终导致表达式识别错误。现有离线符号识别方法仅仅停留在符号识别环节,忽视了离线符号识别最终目的是OMER,未对其另外2个环节起到改善和促进的作用。基于以上研究,本文提出一种能将OMER 3个环节联系起来的符号识别方法,可将符号识别结果反馈到符号分割,从而有效避免OMER错误累积,还能为结构分析提供依据。该方法以目标检测模型YOLOv5s为基础,用空间注意力机制将符号类别间的差异特征放大,最后用双向长短期记忆网络使符号自身的特征具有关联性。

1 相关工作

1.1 制定方案

解决错误累积最好的方法是解决错误源头,OMER错误累积的根源是符号分割错误,符号分割的目的是符号识别和结构分析,在不对表达式进行具体分割的情况下得到符号识别结果和结构分析依据就能避免错误累积。受行人检测的启发,对图像中目标进行识别不需要将其从背景中完美分割出来,只需通过变化和移动推荐框,对推荐框进行识别,根据识别结果及对应的置信度确定预测框,从而得到图像中的目标种类和空间位置信息。将该思想迁移到符号识别上,通过变化和移动推荐框,对其符号进行识别,识别结果对推荐框有反馈作用,同时建议寻找置信度更高的推荐框,直至遍历整个图像,选出置信度最高的推荐框。此外,最佳推荐框是以中心点、长和宽的形式表示,包含了符号大小和空间位置,为结构分析提供了依据。用寻找最佳推荐框的方式代替符号具体分割,能有效避免错误累积且能给出符号位置信息,这极大促进了OMER的发展,故本文采用目标检测效果较好的YOLOv5s模型进行离线符号识别研究。

1.2 获取离线符号数据集

目前公开的符号数据集有HASYv2和CROHME。HASYv2是在线数据集HWRT转化来的离线数据集,HWRT是由浏览器搜索界面收集而来,有369个种类,包含大部分CROHME类别,但没有由这些符号组成的数学表达式,且含有很多非数学表达式的符号,如“ü”“田”和“☆”等符号。CROHME符号数据集是从其表达式数据集中得来,对表达式识别更有意义,故本文采用CROHME符号数据集进行研究。

图1 左括号“ ( ”的inkml文件形式

图2 左括号“ ( ”的图像形式

通过inkml文件得到符号的类别,对保存的图像进行水平和垂直方向上的投影,并得到图像符号的长和宽,通过计算得到中心点坐标,即完成图像标签的制作。

1.3 数据增强

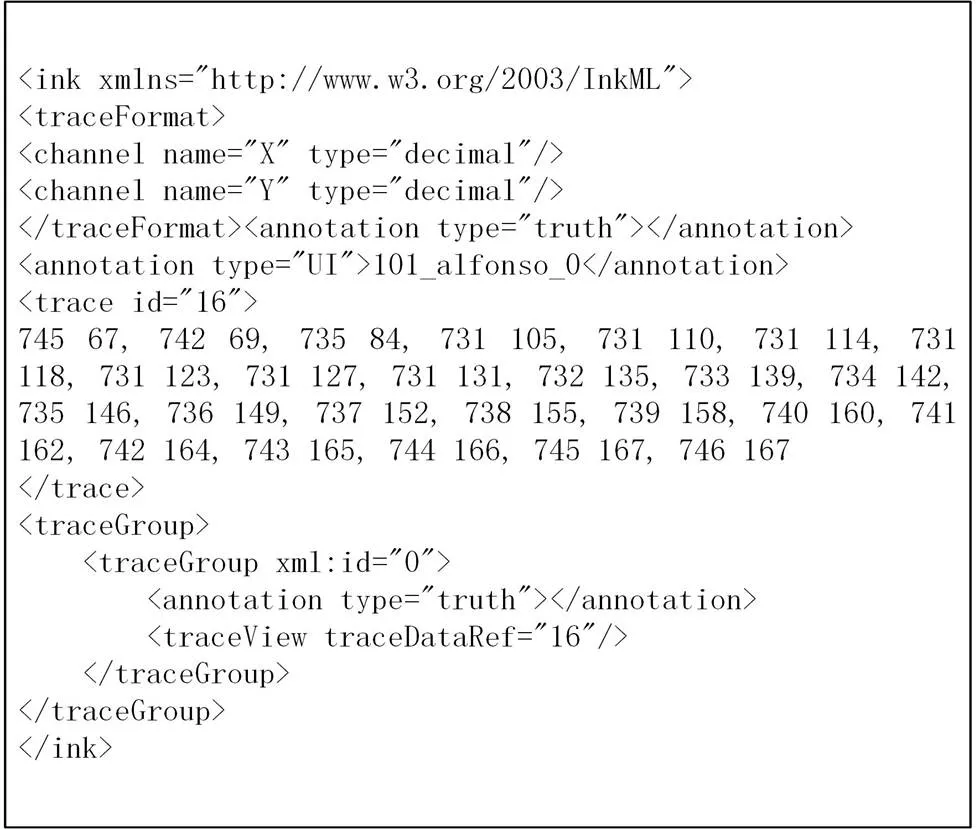

图3 CROHME的符号数目分布情况

由图3可知,CROHME符号数据集类别间的数量相差较大,直接使用Mosaic操作会扩大类别间数量差异,降低模型的泛化能力。本文对数量低于5 000的类别进行增强,对高于5 000的类别进行随机筛选,使各类别数量均为5 000。

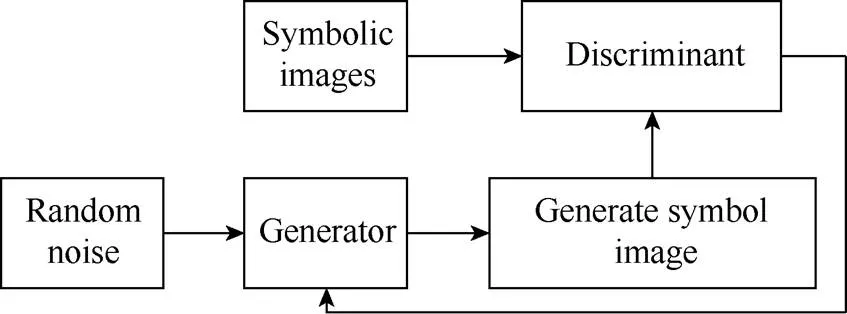

生成对抗网络(generative adversarial networks,GAN)在小图像数据增强方面有很好效果[8],能根据图像特征快速生成与原图像有相同特征却不等同于原图像的图像。GAN包含判别网络和生成网络,二者互为对抗目标,共同学习,最佳的结果就是达到纳什平衡状态,其结构如图4所示。

图4 GAN结构

图4中判别器(Discriminant,D)由卷积网络和softmax函数构成,用来判别是生成符号图像还是真实符号图像。生成器(Generator,G)由反卷积网络构成,从随机噪声(Random noise)中生成与真实符号图像相似的图像。本文用训练好的G增强符号数据集,经过随机筛选和数据增强后的符号数据集有505 000个符号。

2 方 法

为解决错误累积问题,本文用目标检测模型YOLOv5s对离线符号进行检测识别,为提升识别性能,从符号类别角度引入空间注意力,从符号自身角度引入双向长短期记忆网络,以下是相关方法的介绍。

2.1 YOLOv5s模型介绍

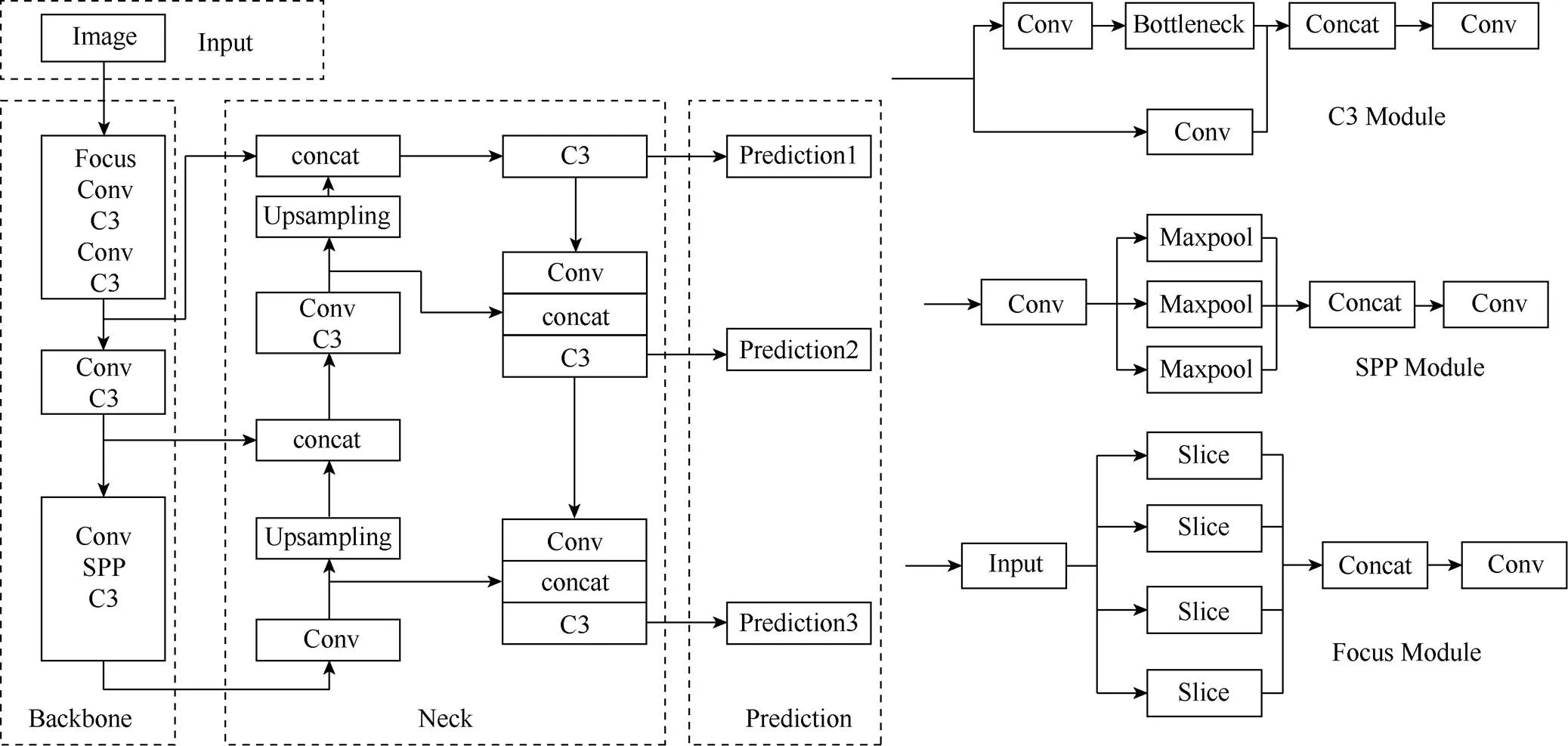

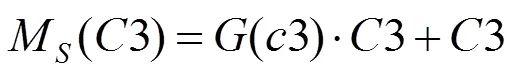

YOLOv5s由输入端(Input)、主干网络(Backbone)、检测颈(Neck)和预测层(Prediction) 4部分组成[9]。其网络结构设计很深,用残差缓解梯度消失或爆炸问题,融合多层特征图,通过上采样与浅层特征进行通道拼接,使浅层特征也具有深层特性信息,可以对不同尺度的目标进行检测,也可以实现对多个种类的预测,且精度较高。网络结构如图5所示,Conv是卷积;C3是借鉴CSPNet[10]的思路来设计的结构,其目的是为了加强网络特征融合的能力和减小计算量;SPP是空间金字塔池化,由Conv和Maxpool构成;Concat是通道拼接。

图5 YOLOv5s的网络结构

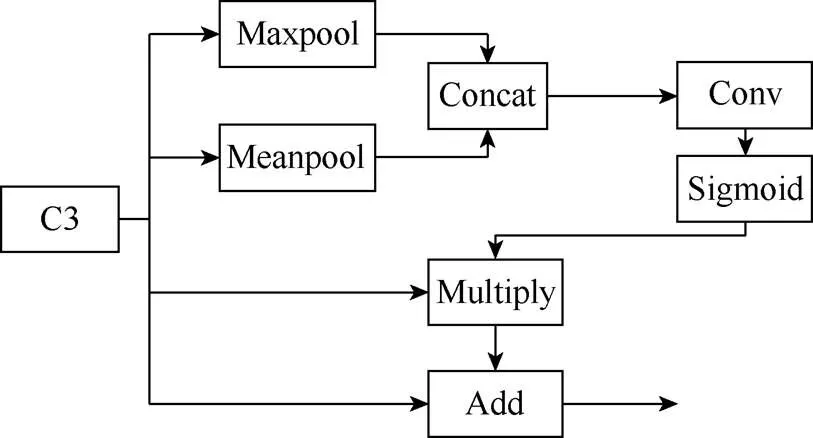

2.2 空间注意力机制

从符号类别的角度进行分析,可通过扩大类别间的差异特征来提升识别率,池化层具有过滤特征的作用,使用不同池化层可扩大差异特征。注意力机制[11]包含了不同的池化层,故引入注意力机制模块来增强关键信息提取,抑制不相关的信息。注意力机制有2种,分别是通道注意力机制(channel attention module,CAM)和空间注意力机制(spatial attention module,SAM)。本文所用图像数据均为白底黑字的符号,不存在颜色通道上的差异,只存在空间上的不同,SAM是通过关注图像中物体的位置及变化获取关键信息,故只引入了SAM,其结构如图6所示,引入SAM的YOLOv5s简记为YOLOv5s_S,对应3.2节中实验3的模型。

图6 SAM网络结构

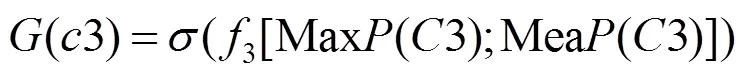

本文将图5中Backbone部分C3的输出作为SAM的输入,通过全局最大值和平均值池化对通道进行压缩,利用卷积得到单通道,用Sigmoid激活函数归一化权重信息,将权重与输入特征对应相乘后再相加,得到不同权重的特征信息,即过程为

2.3 双向长短期记忆网络

从符号自身角度进行分析,将符号的特征矩阵每一行(每一列)看成是不同的个体,则可将符号看成是一系列个体的排列组合,从整体来看,其存在上下(左右)相关联的信息,本文对这种信息能否提升识别率进行研究,从而引入具有记忆功能的网络进行实验。

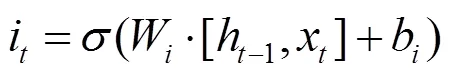

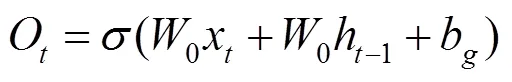

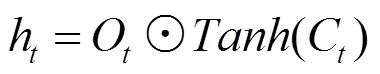

传统的循环神经网络(recurrent neural network,RNN)能实现信息的短期保存,长短记忆网络(long short-term memory,LSTM)是RNN的改良版,信息保存的时间更长。LSTM[12]包括输入门、遗忘门和输出门。输入门输入当前时刻的信息,遗忘门决定输入上一时刻的信息的多少,输出门决定是否将当前得到的综合信息作为输出信息,3个门通过递归的方式调整LSTM中各层的输入输出,以此来实现信息的长期保存。LSTM的传播过程为

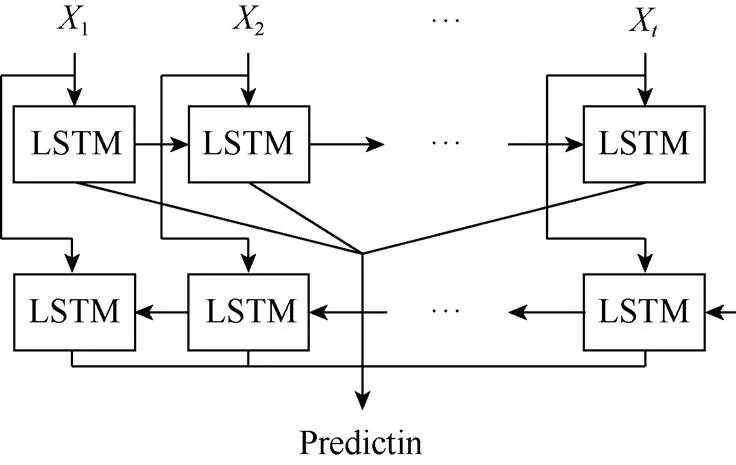

双向长短期记忆网络(Bi-directional long short-term memory,BiLSTM)在单层LSTM上增加了一层结构相同但方向相反的LSTM,如图7所示,将2层LSTM的输出融合,实现了特征信息的双向传播[13]。

图7 BiLSTM的构成

本文将Neck部分C3得到的特征图的每一行通过BiLSTM,利用特征之间上下相关联的信息,最后通过Prediction部分对符号进行预测分类,BiLSTM在模型中的具体位置见图8,引入BiLSTM的YOLOv5s简记为YOLOv5s_B,对应3.2节中实验4的模型。

2.4 YOLOv5s_SB网络结构

从符号类别和自身角度综合考虑,对同时引入SAM和BiLSTM能否提升识别率进行了实验,网络简记为YOLOv5s_SB,对应3.2节中实验5的模型,结构如图8所示,红色加粗字体的是引入的SAM的位置,蓝色加粗字体是引入BiLSTM的位置。

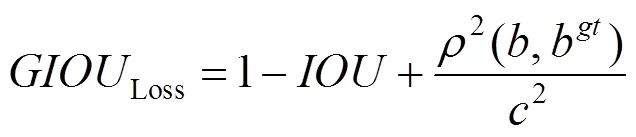

其中:r为标注框中心点与回归框中心点之间的欧几里得距离;b为标注中心点;bgt为回归中心点;c为标注框与回归框最小外接矩形的对角线长度;IOU是标注框、回归框的交集与标注框、回归框并集的比值。

3 实验设计与分析

3.1 实验参数与评价指标

本文实验采用的配置为Intel(R) Core(TM) i5-10400F@2.90 GHz;操作系统为Ubuntu18.0;GPU为tesla V100S 32 GB。网络模型基于Pytorch框架搭建,CUDA版本为11.0,python版本为3.8.8,pytorch版本为1.8.0,实验中batch size为120,epoch设置为100,动量为0.937,初始学习率为0.01,衰减系数为0.000 5。

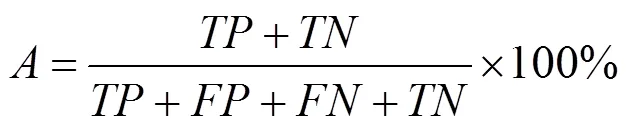

本文用4个评价指标对模型进行评估,分别是识别率(Accuracy)、精确率(Precision)、召回率(Recall)和各类别AP的平均值(mean Average Precision),简记为A,P,R和mAP[16]即

其中,为输入正样本且输出正样本的样本数量;为输入正样本且输出负样本的样本数量;为输入负样本输出正样本的样本数量;为输入正样本输出负样本的样本数量;为样本类别数;是曲线下方的面积。

3.2 消融实验

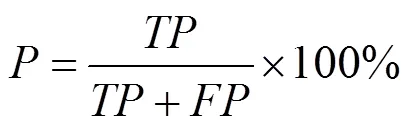

实验设置及结果见表1,每个实验将对应的数据集按8∶2的比例分成训练集和验证集进行训练,用CROHME2016test进行测试。直接反映研究情况的评价指标是识别率A和mAP,P和R起到辅助的作用,用来评估模型的稳定性,重点关注A和mAP的变化。

由表1中实验1和2的结果对比可知,通过GAN增强数据集后4个指标均有提升,其中A提高8.54%,说明GAN完善了数据集,从一定程度上消除了数据集对模型的影响;实验3的A比实验2提高2%,说明在YOLOv5s模型中加入SAM可以提升模型离线符号识别率;实验4比实验2的A提高4.21%,说明YOLOv5s模型中加入BiLSTM也能提升A;实验5是将改进点融合在一起,可以看到和实验1的A相比,实验5的A提高13.95%。实验1和实验5的A变化过程如图9所示。

表1 实验设置及结果

注释:“ü”表示使用与之对应的最左侧条件进行实验,“×”表示未使用,P,R,mAP及A表示实验的结果

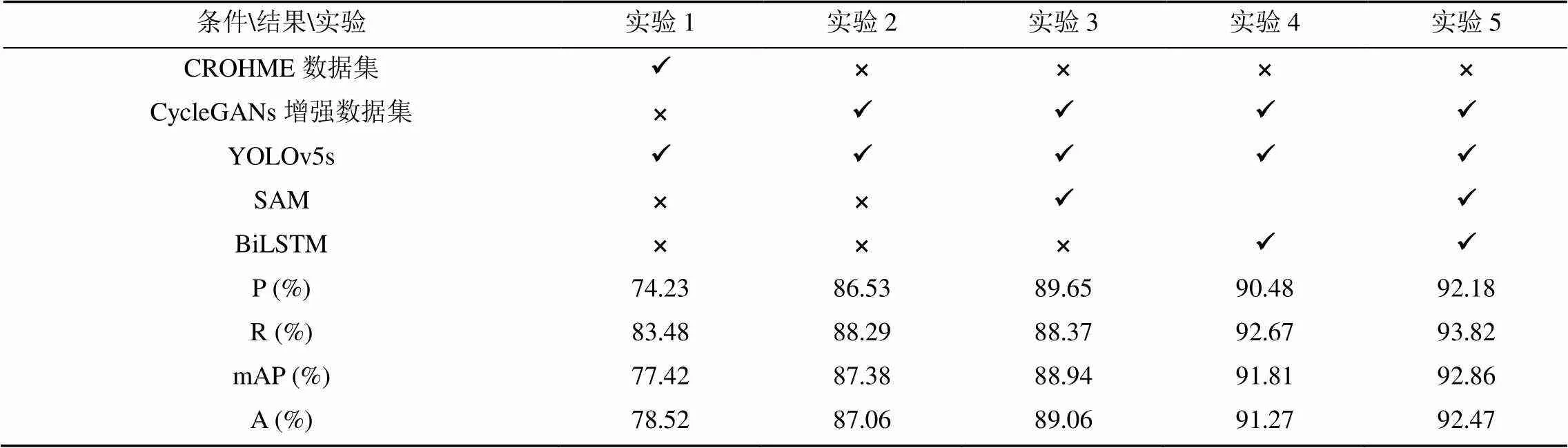

图9 实验1和实验5的识别率

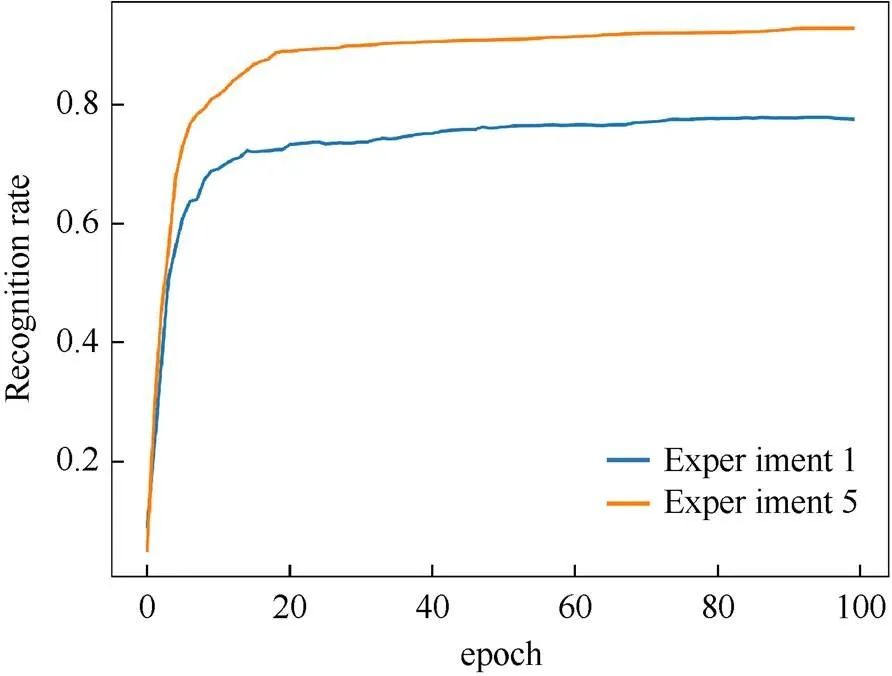

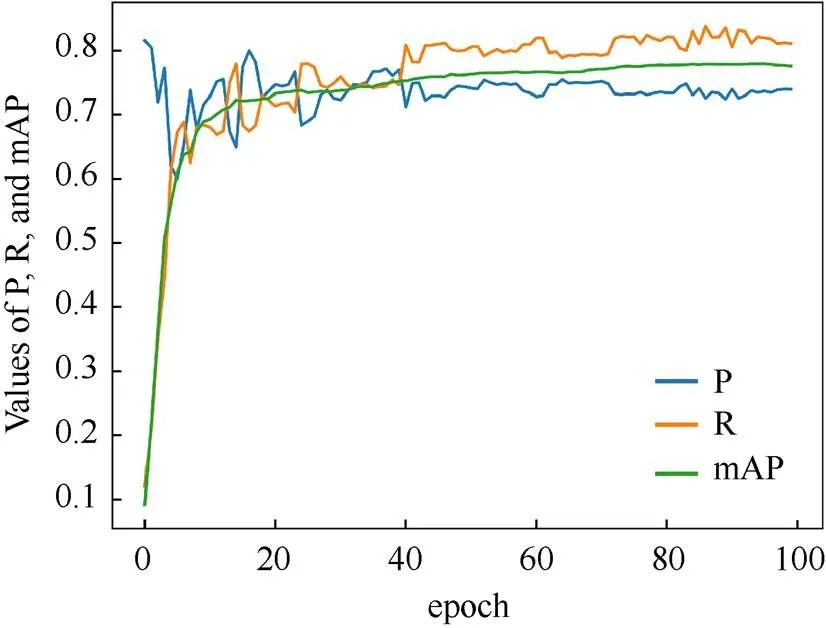

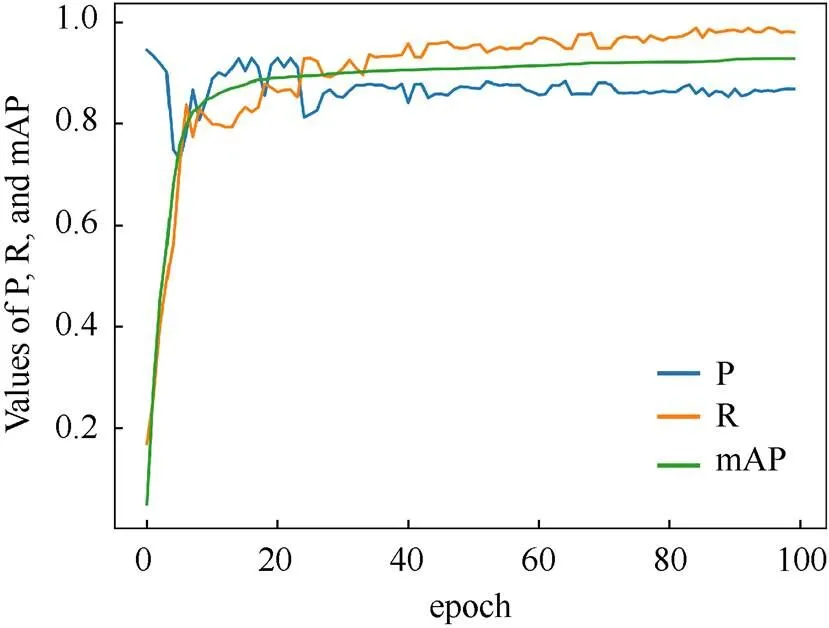

由图9可知,20个epoch之前,识别率上升较快,之后,上升较慢,最终趋于稳定。在第3个epoch时,实验5的识别率就开始高于实验1,之后也总是实验5高于实验1,说明实验5的模型性能优于实验1。同时,实验1和实验5训练中的P,R和mAP变化如图10和图11所示。

图10 实验1的P,R和mAP的变化

由图10和图11可知,随着迭代次数的增加,试验1和实验5的P和R2个指标总是一个相对较高另一个相对较低,最终趋于稳定后,实验5的P和R比实验1的高,mAP指标总是介于P和R之间且稳定,实验5的mAP高于实验1,说明实验5的模型性能优于实验1。综上所述,实验5的4个评价指标均高于实验1,所以实验5的模型更优,说明本文在YOLOv5s基础上针对符号识别的改进取得了较好效果。

图11 实验5的P,R和mAP的变化

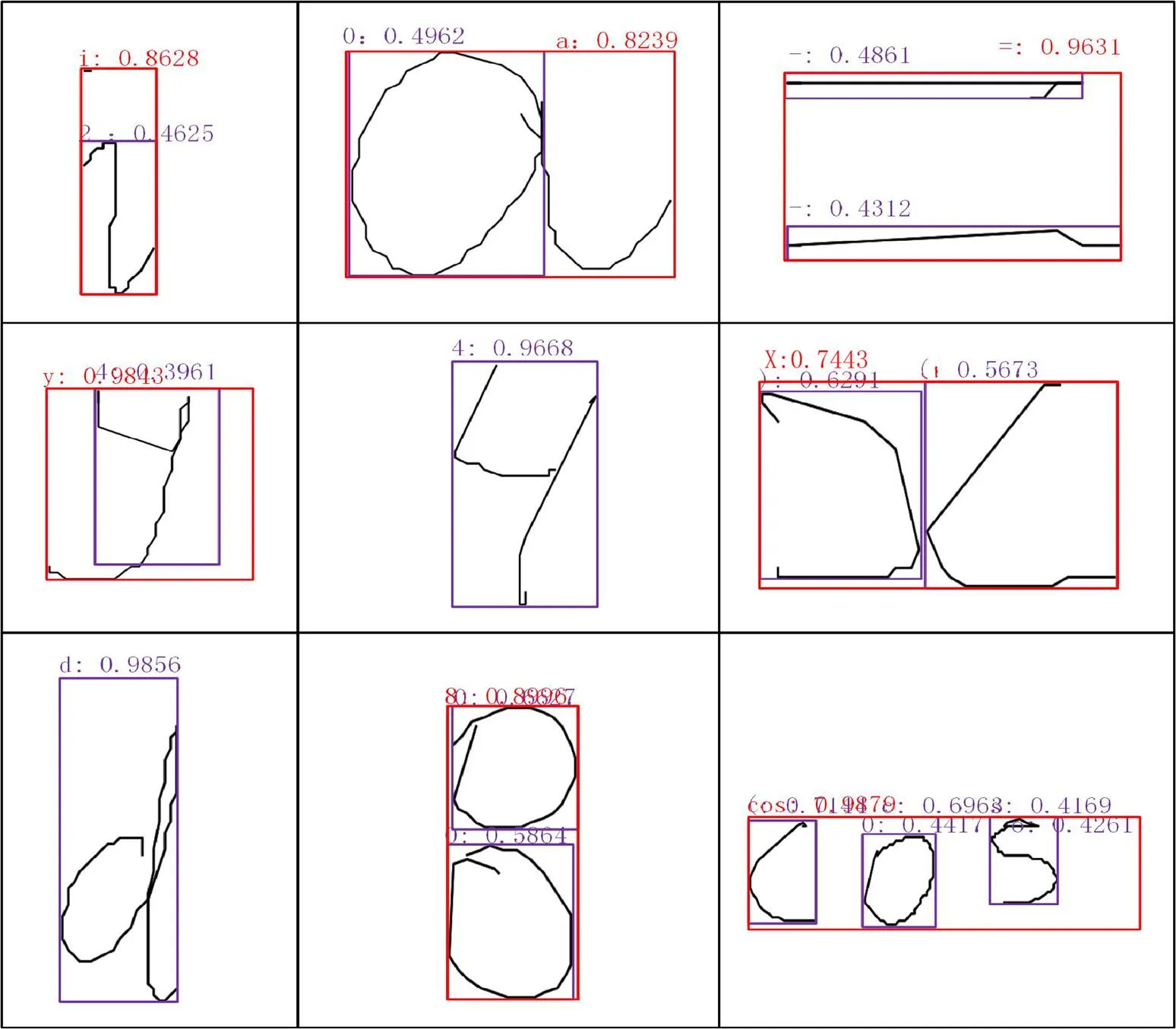

3.3 测试结果与分析

部分符号识别结果如图12所示,从图12中可以看到每个推荐框上方有识别结果及对应的置信度,有的符号会有多个推荐框从而有不同的结果,但可以根据置信度来选择最可能的结果。以图12中第一行第一列符号“i”为例,这个符号容易被分割成小数点和“2”,从而造成分割错误,被识别成“2”的置信度为0.462 5,识别成“i”的置信度为0.862 8,实际上还有一个识别成小数点的置信度,但结合点所在位置得到的置信度较低,根据置信度最终得到识别结果是“i”。本文方法不是对固定分割好的符号进行识别,是通过推荐框的灵活方式对符号识别,根据推荐框内目标特征得到识别结果,这对OMER来说具有重要意义。如图12中的“cos”符号,很容易分割成3个符号,且很容易引起歧义的符号,容易将“c”识别成“(”,将“o”识别成“O”或“0”,将“s”识别成“S”或“5”。本文方法对其识别可得到4个推荐框,选出置信度最大的推荐框,故可有效避免类似错误。此外,推荐框还包含了符号的位置信息,能为OMER的结构分析提供依据。

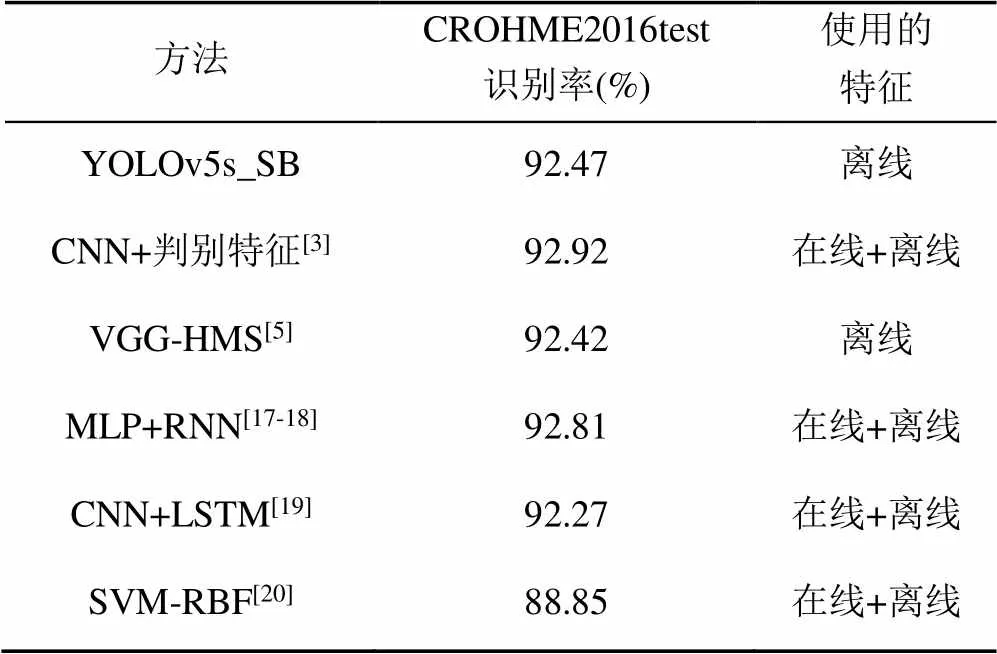

3.4 与其他方法对比

本文对符号识别方法进行了调研,列出了一些比较经典且具有较高识别率的模型,与其进行了对比,见表2。

图12 部分离线手写数学符号识别结果展示

表2 YOLOv5s_SB与其他模型的对比

从表2中可以看出,CNN+判别特征的识别率为92.92%,是非常优秀的在线符号识别方法,VGG-HMS是离线符号识别中的经典方法,在仅使用离线特征的情况下达到92.42%的识别率。表中本文方法高于VGG-HMS的识别率,证明了本文方法对于离线符号识别的有效性。此外,VGG-HMS在CROHME2014test上的识别率为91.82%,本文的识别率为92.44%,同样高于VGG-HMS,证明了本文方法的稳定性。

4 结束语

本文以离线手写数学符号为研究对象,从数学符号识别目的出发,用目标检测模型YOLOv5s来有效避免OMER错误累积问题,从符号类别和自身的角度分别引入SAM和BiLSTM提高符号识别率。实验结果表明,本文方法具有较高识别率,从符号识别角度来看提升有限,但具有较好前景,在OMER整个过程中,能有效避免错误累积问题,为OMER提供结构分析的依据。在未来研究中,本文框架结构也能用于OMER,将每个符号的最佳结果看成个体,这些个体具有前后相关联的特征,BiLSTM可以利用这些特征对符号识别结果进行更正,如图12中的“cos”符号一样。因此,本文方法对OMER的贡献度远远大于其他方法。

[1] 付鹏斌, 李建君, 杨惠荣. 基于粘连符号分割和多特征融合的手写公式识别[J]. 北京工业大学学报, 2021, 47(8): 842-853.

FU P B, LI J J, YANG H R. Handwritten formula recognition based on segmentation of adhesive symbols and multi-feature fusion[J]. Journal of Beijing University of Technology, 2021, 47(8): 842-853 (in Chinese).

[2] MOUCHÈRE H, VIARD-GAUDIN C, ZANIBBI R, et al. ICFHR2016 CROHME: competition on recognition of online handwritten mathematical expressions[C]//The 15th International Conference on Frontiers in Handwriting Recognition. New York: IEEE Press, 2016: 607-612.

[3] 方定邦. 基于卷积神经网络的手写数学公式字符识别的算法研究[D]. 泉州: 华侨大学, 2020.

FANG D B. Research on character Recognition algorithm of Handwriting Mathematical Formula Based on Convolutional Neural Network [D]. Quanzhou: Huaqiao University, 2020 (in Chinese).

[4] RAMADHAN I, PURNAMA B, FARABY S A. Convolutional neural networks applied to handwritten mathematical symbols classification[C]//The 4th International Conference on Information and Communication Technology. New York: IEEE Press, 2016: 1-4.

[5] DONG L F, LIU H C. Recognition of offline handwritten mathematical symbols using convolutional neural networks[C]//The 9th International Conference on Image and Graphics. Heidelberg: Springer, 2017: 149-161.

[6] MAHDAVI M, ZANIBBI R, MOUCHERE H, et al. ICDAR 2019 CROHME + TFD: competition on recognition of handwritten mathematical expressions and typeset formula detection[C]//2019 International Conference on Document Analysis and Recognition. New York: IEEE Press, 2019: 1533-1538.

[7] 张楷伟. 基于深度学习的Mosaic图像复原和识别方法研究[D]. 西安: 西安电子科技大学, 2019.

ZHANG K W. Mosaic image restoration and recognition research based on deep learning[D]. Xi’an: Xidian University, 2019 (in Chinese).

[8] 淦艳, 叶茂, 曾凡玉. 生成对抗网络及其应用研究综述[J]. 小型微型计算机系统, 2020, 41(6): 1133-1139.

GAN Y, YE M, ZENG F Y. Review of research on generative adversarial networks and its application[J]. Journal of Chinese Computer Systems, 2020, 41(6): 1133-1139 (in Chinese).

[9] 谈世磊, 别雄波, 卢功林, 等. 基于YOLOv5网络模型的人员口罩佩戴实时检测[J]. 激光杂志, 2021, 42(2): 147-150.

TAN S L, BIE X B, LU G L, et al. Real-time detection for mask-wearing of personnel based on YOLOv5 network model[J]. Laser Journal, 2021, 42(2): 147-150 (in Chinese).

[10] WANG C Y, MARK LIAO H Y, WU Y H, et al. CSPNet: a new backbone that can enhance learning capability of CNN[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. New York: IEEE Press, 2020: 1571-1580.

[11] WOO S, PARK J, LEE J Y, et al. CBAM: convolutional block attention module[C]//The 15th European Conference on Computer Vision. Cham: Springer, 2018: 3-19.

[12] 金乐. 基于双向长短期记忆网络的高压输电线路短路故障识别方法[J]. 内蒙古电力技术, 2021, 39(2): 66-72.

JIN L. Research on short circuit fault identification method of high-voltage transmission line based on Bi-directional long short-term memory[J]. Inner Mongolia Electric Power, 2021, 39(2): 66-72 (in Chinese).

[13] YUE W, ZHU C M, GAO Y S. BiLSTM Chinese Text Sentiment Analysis Based on Pre-attention[J]. World Scientific Research Journal, 2021, 7(6): 33-42.

[14] WU Y, JIANG J Y, HUANG Z M, et al. FPANet: Feature pyramid aggregation network for real-time semantic segmentation[J]. Applied Intelligence, 2022, 52: 3319-3336.

[15] 王书献, 张胜茂, 朱文斌, 等. 基于深度学习YOLOV5网络模型的金枪鱼延绳钓电子监控系统目标检测应用[J]. 大连海洋大学学报, 2021, 36(5): 842-850.

WANG S X, ZHANG S M, ZHU W B, et al. Application of an electronic monitoring system for video target detection in tuna longline fishing based on YOLOV5deep learning model[J]. Journal of Dalian Ocean University, 2021, 36(5): 842-850 (in Chinese).

[16] 王莉, 何牧天, 徐硕, 等. 基于YOLOv5s网络的垃圾分类和检测[J]. 包装工程, 2021, 42(8): 50-56.

WANG L, HE M T, XU S, et al. Garbage classification and detection based on YOLOv5s network[J]. Packaging Engineering, 2021, 42(8): 50-56 (in Chinese).

[17] MOUCHÈRE H, VIARD-GAUDIN C, ZANIBBI R, et al. ICFHR 2014 competition on recognition of on-line handwritten mathematical expressions (CROHME 2014)[EB/OL]. [2021-07-03]. https://hal.archives-ouvertes.fr/ file/index/docid/1070712/filename/CROHME_ICFHR_2014.pdf.

[18] MOUCHÈRE H, VIARD-GAUDIN C, ZANIBBI R, et al. ICFHR2016 CROHME: competition on recognition of online handwritten mathematical expressions[C]//The 15th International Conference on Frontiers in Handwriting Recognition. New York: IEEE Press, 2016: 607-612.

[19] DAI NGUYEN H, DUC LE A, NAKAGAWA M. Recognition of online handwritten math symbols using deep neural networks[J]. IEICE Transactions on Information and Systems, 2016, E99.D(12): 3110-3118.

[20] DAVILA K, LUDI S, ZANIBBI R. Using off-line features and synthetic data for on-line handwritten math symbol recognition[C]//The 14th International Conference on Frontiers in Handwriting Recognition. New York: IEEE Press, 2014: 323-328.

Offline handwriting mathematical symbol recognition based on improved YOLOv5s

FANG Hong-bo1, WAN Guang1,2, CHEN Zhong-hui1, HUANG Yi-wei3, ZHANG Wen-yong4, XIE Ben-liang1,2

(1. College of Big Data and Information Engineering, Guizhou University, Guiyang Guizhou 550025, China; 2. Semiconductor Power Device Reliability Engineering Center of Ministry of Education, Guiyang Guizhou 550025, China; 3. Western Modernization Research Center, Guizhou University of Finance and Economics, Guiyang Guizhou 550025, China; 4. College of Computer Science and Technology, Guizhou University, Guiyang Guizhou 550025, China)

Offline mathematical symbol recognition is the premise of offline mathematical expression recognition. The existing offline symbol recognition methods can only recognize symbols, but is of no help to other steps of offline expression recognition, even restricting expression recognition. Thus, an improved YOLOv5s offline symbol recognition method was proposed.Firstly, considering the small size of symbolic image, generative adversarial network (GAN) was employed to enhance the data. Secondly, from the point of view of symbolic categories, the spatial attention mechanism was introduced to YOLOv5s model, and the global maximum and global mean were pooled to enlarge the differences between categories. Finally, from the point of view of the symbol itself, the bidirectional long-short-term memory network (BiLSTM) was utilized to process the symbol feature matrix, so that the symbol feature could possess the upper and lower related information.Experimental results show that the improved YOLOv5s achieves better offline symbol recognition, with a recognition rate of 92.47%. Compared with other methods, the proposed method is effective and robust. At the same time, it can effectively avoid the problem of error accumulation in offline mathematical expression recognition and provide an effective basis for expression structure analysis.

offline handwriting mathematical symbol recognition; data enhancement; generative adversarial network; spatial attention mechanism; bidirectional long-short-term memory network

TP 391

10.11996/JG.j.2095-302X.2022030387

A

2095-302X(2022)03-0387-09

2021-09-27;

2021-12-17

27 September,2021;

17 December,2021

国家自然科学基金项目(61562009);国家重点研发计划课题(2016YFD0201305-07);贵州大学人才引进科研项目(贵大人基合字(2015)29号);半导体功率器件教育部工程研究中心开放基金项目(ERCMEKFJJ2019-(06))

National Natural Science Foundation of China (61562009); National Key Research and Development Program of China (2016YFD0201305-07); Guizhou University Introduced Talent Research Project (2015-29); Open Fund Project in Semiconductor Power Device Reliability Engineering Center of Ministry of Education (ERCMEKFJJ2019-(06))

方洪波(1997-),男,硕士研究生。主要研究方向为深度学习、模式识别。E-mail:1583616027@qq.com

FANG Hong-bo (1997-), master student. His main research interests cover deep learning and pattern recognition. E-mail:1583616027@qq.com

谢本亮(1978-),男,副教授,博士。主要研究方向为机器学习、计算机视觉。E-mail:blxie@gzu.edu.cn

XIE Ben-liang (1978-), associate professor, Ph.D. His main research interests cover machine learning and computer vision. E-mail:blxie@gzu.edu.cn