融合空时显著性的雪天运动目标检测方法∗

2018-04-26齐建文戴德辉

齐建文 戴德辉

(陆军军官学院 合肥 230031)

1 引言

当前,运动目标检测已经广泛运用在军事侦察,智能交通,视频监控,视频检索等领域。但在恶劣天气条件下,运动目标检测依然是一个难题,特别是在下雪天的情况下,运动目标检测面临着挑战。第一,雪花的飘动会在视场中形成不规律的动态背景噪声,会对运动目标的检测造成一定的干扰;第二,当运动目标长时间的暴露在室外时,目标表面可能会被雪覆盖,与背景颜色一致,难以区分,导致检测出的对象存在空洞,难以检测出完整的运动目标;第三,大雪天气情况下,雪花会形成较大的运动背景噪声,尤其是当场景中存在缓慢运动目标时,仅通过运动特征难以检测完整目标。因此,分析雪天对运动目标检测的干扰因素,并研究雪天中运动前景目标和背景的静态和动态特征,设计出可适用于雪天运动目标检测方法,具有十分重要的研究意义。

当前,主流的运动目标检测方法包括,帧间差分法[1],背景建模法[2]和光流法[3]。但上述方法都有或多或少的一些缺陷,光流法计算复杂,难以得到实际的应用;帧间差分法在检测缓慢运动目标时,难以检测出完整的运动目标,会产生内部空洞;背景建模法容易将背景与前景目标混淆。这些算法都主要依赖于运动特征进行运动目标检测,而下雪天由于存在雪花的动态背景噪声的干扰,仅依靠于运动特征难以检测出完整的运动目标。然而,雪天情况下大部分的背景区域都被雪花覆盖,背景相对单一,且空间中的颜色、纹理和对比度等特征较为明显,因而利用好空间特征,将空间信息引入到运动目标检测中,可以提高检测的精度。

针对上述特点,本文将视觉显著性检测方法引入到雪天运动目标检测中,提出了一种融合空时显著性的雪天运动目标检测方法。在空间上,采用基于视觉注意机制的显著性目标检测方法,对运动目标的空间静态特征进行提取,得到空间显著图;在时间上,通过对运动特征进行提取,得到时间显著图,最后采用动态融合方法对空时显著图进行融合,从而检测出运动目标。

2 融合空时的运动目标检测

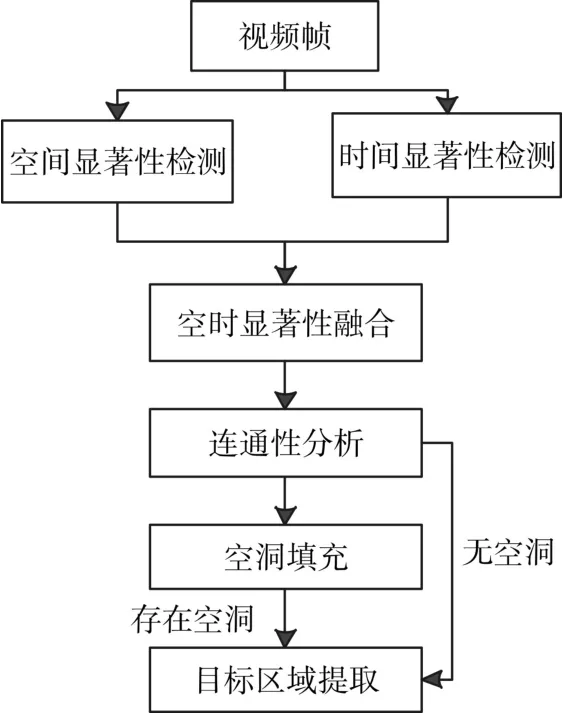

本文采用基于结构化矩阵分解的方法来对雪天运动目标进行空间显著性检测,得到空间显著图,经三帧差分法得到时间显著图,并通过空时动态融合得到运动目标的区域位置信息,最后,对空时融合后检测到的目标区域进行连通性检测分析,对内部存在空洞现象的目标进行空洞填充,从而提取出最终的运动目标区域,具体过程如图1所示。

图1 本方法的检测过程

2.1 空间显著性检测

近年来,视觉显著性检测成为了一个研究的热点,并在视频检索,目标检测,数据压缩等领域得到了广泛的应用。显著性检测是指通过模拟人眼的视觉注意机制,提取图像中的显著性区域,从而得到最符合人眼观测的感兴趣目标,显著性检测关键在于视觉注意模型,视觉注意模型主要分为两类:一类是自顶而下的慢速、任务驱动的视觉分析模型,通常是利用人类大脑中已有的先验信息,但该类方法缺少生物生理学依据,且建模实现复杂,因而研究较少;另一类是自底而上的快速、特征驱动的视觉分析模型,这类模型是当前显著性检测的一个重要基础。当前,显著性检测领域发展快速,研究成果明显,其发展主要是基于ITTI于1998年提出的视觉注意模型[4]。针对雪天背景相对单一的,前景特征对比明显的特点,并在经过大量的实验和方法分析的基础上,本文采用 SMD[5](Structured Matrix Decompositi-on)方法进行空间显著性检测。SMD方法主要基于低秩复原模型,低秩复原模型是指将一副图像的特征观测矩阵进行结构化分解得到一个低秩矩阵和稀疏矩阵,其中分解得到的低秩部分代表的是场景中非显著的部分,即空间的背景;稀疏部分代表的是显著部分,即前景的目标。最后对经结构化分解后的稀疏矩阵进行复原即可得到场景中的显著性目标。

SMD方法主要利用的是空间的静态特征如颜色,边缘,纹理等特征。若给定一副视频帧,先将其分割成N个图像块,每个图像块抽取D维特征组成一个特征矩阵F,可表示为:

其中L表示特征矩阵的低秩部分,S表示稀疏部分。结构化分解模型基本形式如下:

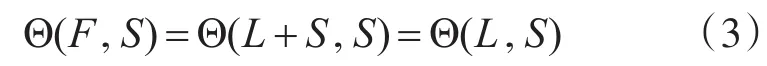

其中Ψ(L)是低秩约束,用来识别冗余的背景碎片的内在特征子空间,对背景区域进行约束;Ω(S)是结构化稀疏约束,采用树形结构稀疏诱导范数来约束前景矩阵S,从而将显著图像块空间上的联系和特征上的相似性考虑进矩阵问题中,用来解决了传统的低秩模型分离难、分离出来的前景不完整问题;Θ(L,S)是引入的拉普拉斯正则法则,具体表示如式(3)所示。

Θ(L,S)拉普拉斯正则化项根据特征矩阵(F)的局部不变性来平滑S中的向量从而增大稀疏矩阵和低秩矩阵之间的距离,降低低秩矩阵和结构化稀疏矩阵之间的相似性,使得在进行结构化分解时可以更好地将稀疏部分分解出来。通过上述模型,恢复出显著性目标,并得到空间显著图。

2.2 时间显著性检测

根据人眼的视觉特点,运动的物体往往更加容易引起人眼的注意力,对运动目标进行检测需要得到目标的运动特征。经过实验分析,针对雪天存在动态背景噪声干扰的情况,本文采用改进的相邻三帧差分法来提取运动特征,三帧差分[6]是基于两帧差分基础上的改进,计算简单,满足实时性要求,且可以避免两帧差分带来的“鬼影”现象,能减少雪花飘动对运动特征提取的干扰。具体原理如下:

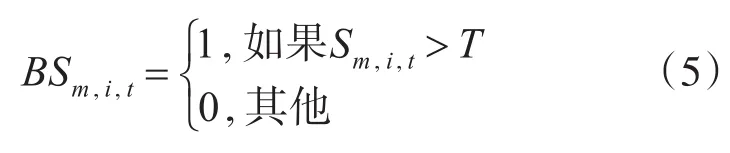

其中 Dm,i,t和 Dm,i,t+1分别为第 t帧和第 t-1帧的差分结果以及第t帧和第t+1帧的差分结果。 Sm,i,t代表两个差分结果进行与操作后得到的差分图像,再将 Sm,i,t经过阈值分割后得到二值图像 BSm,i,t:

其中T为进行二值化的阈值。当 BSm,i,t=1时,则表示为运动目标区域,BSm,i,t=0则表示为背景区域。

2.3 空时显著性融合

依据得到的空间显著图和时间显著图,采用动态融合的方法进行空时显著性融合,得到目标的位置区域信息,从而将运动目标检测处理。其原理如下:

其中ks和kt分别代表的是空间显著图和时间显著图的权重。St为时间显著图,Ss为空间显著图。

其中Const是一个常数。

动态融合方法的主要策略:

1)当视频序列中存在强烈的运动对比时,在进行空时显著性融合时,要给时间显著图较大的比重。

2)当视频序列中运动对比比较微弱时,在进行空时显著性融合时,要给空间显著图较大的比重。

2.4 后处理

在雪天情况下,由于目标可能被雪部分覆盖,导致目标的部分内部区域与雪天背景相似,采用上述方法提取出的运动目标的内部可能会存在空洞,出现漏检的情况。因此,本文对经空时融合后的检测目标区域进行进一步的空洞检测与填充,得到完整的运动目标区域。采用检测结果进行8连通检测方法对检测的目标区域进行连通性分析,判断是否需要进行空洞填充,当检测目标区域存在空洞现象,对上述检测的目标区域进行形态学处理,并进行空洞填充操作,最终提取出完整的运动目标。

3 实验与分析

3.1 实验仿真

本文的实验环境如下:CPU为Intel Core i5-6200U 2.30GHZ,内存4.00GB,操作系统为Win⁃dows 7(64位),编程开发环境为Matlab 2013。

针对引言中分析的下雪天对运动目标检测的影响,本文选取了几组下雪天视频进行实验,实验视频来源于公共视频集网站CDW[7]和优酷网。为验证本文方法的有效性,选择GMM算法[8]和帧间差分法来与本文算法进行了对比分析。

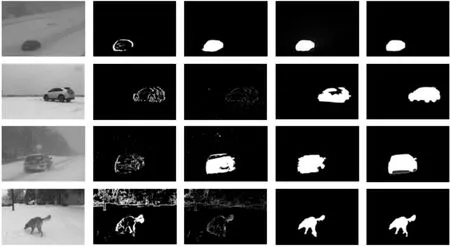

图2为几种方法在4种场景中的实验效果对比,其中(a)为几种不同场景的视频帧,由上至下分别为场景1~4,场景1为正常下雪天气,场景亮度较暗,背景相对简单,为常见的下雪天;场景2为在下雪天行驶的汽车,该场景中光照变化较为明显;场景3为大雪天气,目标存在阴影且车身被雪部分覆盖。前3种场景均为相机静止的情况,除此之外,本文还尝试了针对相机移动的情况进行实验,场景4是存在相机移动情况,且存在缓慢运动目标。(b),(c)分别为帧间差分法和GMM算法在4种场景中的检测结果,(d)为本文方法的检测结果,(e)为手工标定的真实目标区域。图中白色区域为各类方法检测的目标区域,黑色为背景区域。为客观对比各方法的性能,实验中采用的实验参数均与原文献相同,且都未经过形态学滤波处理。

由图2中实验结果可以看出,在场景1中,几类方法都可以较好排除雪花飘动的动态场景干扰,其中GMM算法和本文算法都能较为完整地检测出运动目标,帧间差分法可以得到目标的边缘轮廓,但检测出的结果存在空洞且边缘存在部分缺失,检测效果不佳;对于场景2存在光照变化明显情况时,GMM算法和帧间差分法都受到了背景噪声的干扰,将一部分的背景区域也视为了检测目标,且检测的目标内部存在大量的空洞。而本文方法对于此类光照变化明显的情况有着较好检测效果,可以准确定位到目标位置,受光照干扰程度相对较小;在场景3中,由于是大雪天气,背景噪声干扰较强,帧间差分法和GMM算法都将部分雪花背景噪声检测为运动目标,GMM算法对阴影部分的区分不明显,本文方法对大雪飘动的干扰影响较小,但同时也存在丢失车轮等不明显区域的现象。场景4由于相机发生了移动,帧间差分法和GMM算法由于其检测原理限制,检测结果中存在大量的背景区域,未能将目标与背景区域区分开来,而本文算法较好的利用了空间显著性检测的优势,在进行空时融合时,加大了空间的权重,得到了较好的检测结果。

图2 不同方法检测效果对比

3.2 定量分析

为全面分析本文方法的准确性,采用Precision(查准率)和Recall(召回率)[9~10]作为实验定量分析的评价标准。Precision反映的是算法检测的准确性,Recall反映的是算法检测目标的全面性,通常二者的数值越高表示算法的检测效果越好。其原理如下:

其中TP(true positives)是被正确检测的前景像素数量,FP(false positives)是背景误判为前景的像素数量,FN(false negatives)是前景误判为背景的像素数量。

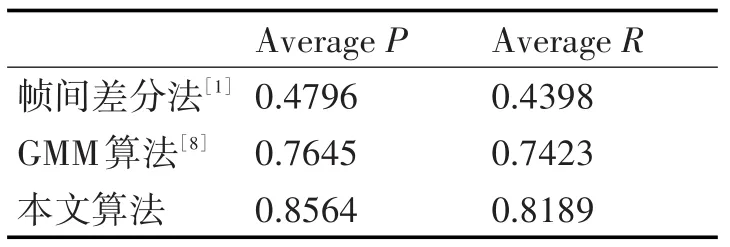

表1 定量对比结果

在进行定量分析时,由于场景4为相机移动的动态场景目标检测,帧间差分法和GMM算法本身不太适应于动态背景的检测,大量的背景区域被检测为目标区域,导致结果偏差较大。因而场景4的检测结果仅作为和本文算法的一个主观评价,不计入定量分析的计算。定量分析中仅对比在前3种场景下各算法的Precision和Recall值,计算结果如表1所示。

从表1中可以看出,依据各算法在三种场景下检测结果的Precision和Recall平均值,本算法在Precision和Recall值上均优于其他两种算法,表明本算法在对下雪天场景下运动目标检测的效果要好于其他两种算法。

4 结语

本文针对下雪天运动目标检测出现的难点问题,将视觉显著性检测方法融入到运动目标检测中来,分别对视频帧进行空间和时间显著性检测,并对其进行空时显著性的动态融合,较好实现了下雪天动态背景噪声干扰下的运动目标检测。并且在相机发生移动的情况下,表现出一定的检测潜力。

同时,由于本文利用了空间和时间特征,计算复杂度高,因而在检测速度上要慢于现有的一些运动目标检测算法,还无法实现实时性的检测处理;此外受限于空间显著性的检测特性,算法的鲁棒性还不高,对于背景复杂,多目标场景的检测表现还不好。在下一步的研究方向中,一方面需要提高算法的检测速度,达到实时性的检测要求;另一方面要提高算法的鲁棒性,提高适应复杂场景的能力。

[1]Archetti F,Manfredotti C E,Messina V,et al.Fore⁃ground-to-GhostDiscrimination in Single-Difference Pre-proc-essing[C]//Advanced Concepts for Intelligent Vision Systems,International Conference,Acivs 2006,Antwerp,Belgium,Proceedings.DBLP,2006(9):263-274.

[2]Barnich O,Van Droogenbroeck M.Vi-Be:a universal background subtraction algorithm for video sequences[J].IEEE Transactions on Image Processing,2011,20(6):1709-1724.

[3]Kim J,Ye G,Kim D.Moving object detection under free-moving camera[C]//International Conference on Im⁃age Processing,Hong Kong,China.DBLP,2010(9):4669-4672.

[4]Itti L,Koch C,Niebur E.A Model of Saliency-Based Vi⁃sual Attention for Rapid Scene Analysis[J].IEEE Trans⁃actions on Pattern Analysis& Machine Intelligence,1998,20(11):1254-1259.

[5]Peng H,Bing L,Ling H,et al.Salient Object Detection via Structured Matrix Decomposition[J].IEEE Transac⁃tions on Pattern Analysis&Machine Intelligence,2016,99:1-1.

[6]Liu G,Ning S,You Y,et al.An improved moving objects detection algorithm[C]//International Conference on Wavelet Analysis and Pattern Recognition.IEEE,2013:96-102.

[7]Wang Y,Jodoin P M,Porikli F,et al.CDnet 2014:An Expanded Change Detection Benchmark Dataset[C]//Computer Vision and Pattern Recognition Workshops.IEEE,2014:393-400.

[8]Zivkovic Z.Improved Adaptive Gaussian Mixture Model for Background Subtraction[C]//International Conference on Pattern Recognition.IEEE,2004:28-31 Vol.2.

[9]Estrada F J,Jepson A D.Benchmarking Image Segmenta⁃tion Algorithms[J].International Journal of Computer Vi⁃sion,2009,85(2):167-181.

[10]Borji A,Sihite D N,Itti L.Salient Object Detection:A Benchmark[M]//Computer Vision-ECCV,Springer Ber⁃lin Heidelberg,2012:5706-5722.