光流的镜头边界检测

2016-06-28汪荣贵胡健根薛丽霞

汪荣贵,胡健根,杨 娟,薛丽霞

(合肥工业大学 计算机与信息学院,合肥230009)

光流的镜头边界检测

汪荣贵,胡健根,杨 娟,薛丽霞

(合肥工业大学 计算机与信息学院,合肥230009)

针对现有镜头检测算法在处理运动信息时无法随着帧间差异不同而变化的问题,提出一种基于光流的镜头边界检测方法。依据光流算法对图像间熵计算进行校正,并提出一种光流量化方法。使用量化值与校正熵值判断图像连续性,保留存在镜头切换的候选边界;根据镜头构造的差异提取图像的光度信息与图像间互信息,并提出一种模型匹配的方式进行镜头类型识别。在互信息提取前对图像进行显著区域提取,来增加图像间的差异而保证模型匹配的准确性。实验表明,该检测算法能准确检测镜头边界且有效排除运动干扰。

镜头边界检测;光流;互信息;显著区域

0 引言

当今视频数据是人们获取信息的重要渠道,视频的结构化研究中镜头边界检测是主要内容,其为大型视频数据库的访问、检索和浏览提供保障。镜头是像机在单一时间和空间内捕获的帧序列[1],其切换类型包括突变和渐变类,渐变类细分为溶解、淡入、淡出类。镜头的检测多基于帧的不连续性,提取图像的基础视觉特征。例如,Lin[2]使用传统颜色和梯度直方图分别获取颜色和纹理特征,提出自适应阈值距离测量方法作为镜头变化识别的基础。

渐变镜头检测中因相机或物体运动的影响增加检测难度。Butz[3]提出基于互信息镜头边界检测方法。用互信息测算各帧间的统计差异,在局部最大互信息处应用仿射图像配准。依据镜头边界相邻帧存在较小互信息准则进行镜头边界的检测,而该方法仅限于检测突变镜头,Černeková[4]对此提出改进方法。通过分析互信息变化检测镜头突变,联合熵的变化检测渐变镜头。该方法没有将帧间信息结合至镜头的检测中,本文通过关注镜头本身的结构特征对其改进,进行初始边界的选取。

在镜头边界检测中相机平移和物体运动的干扰不容忽视。Treetasanatavorn[5]提出基于时空的分割方法,依据全局运动分析镜头时间子结构。离散曲线演化构造全局运动曲线,确保全局性检测。对时间曲线分割实现视频分段操作,该方法具有一定的效果,但局限于非压缩视频。张寅[6]针对溶解型镜头帧检测方面,提出依据图像不连续性的算法,基于图像不连续性特征衡量图像相邻块间相似度,再使用支持向量机进行预分类,并通过纠正错误分类帧和延伸溶解型镜头帧长度修正分类结果,完成溶解镜头的检测。该方法局限于分类结果的准确性且繁琐,本文注重图像特征间的关系简化识别过程,进行镜头类别的判断。

综上,本文提出一种镜头边界检测方法,将光流检测结合至镜头结构分析。在相邻图像间进行光流矢量检测并校正,排除相机的运动、目标移动等干扰;矢量量化值和图像熵用于图像连续性的判断,以获取所有候选镜头边界。利用镜头的结构特征,综合图像光度和互信息提出模板匹配的方法;结合多信息融合对亮度敏感类镜头进行识别,并依据模型匹配对非敏感镜头进行识别。同时与TRECVID中数据进行对比实验,结果表明本文方法更能有效地检测镜头边界。

1 基于光流校正的候选边界检测

视频由各镜头内的图像组成,而镜头边界是出现频率较低的部分,可先获取候选边界再识别。候选边界检测利用图像连续性,即图像熵值差来获取候选边界。然而视频内目标移动、相机运动等干扰,将影响图像熵值差(Entropy Difference,ED)计算。本文先通过图像间光流矢量并进行量化,对图像进行校正再计算相应ED值,依据校正值进行候选边界检测。

1.1 光流校正与量化

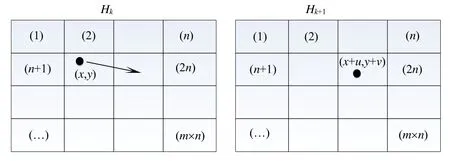

光流[7]是利用相邻图像间相关性计算其运动信息的方法。如图1假设Hk中像素点(x,y)在Hk+1中移至,据偏移量(u,v)对图像进行校正。对于前景与后景运动模式不一致和画面缩放等问题,采用图像分块减小干扰。

图1 图像的光流矢量及分块Fig.1Optical flow of image and block processing

图像进行分块后,块内像素点的运动表征目标的运动。若各边界具有扩展趋势外扩,表明镜头处于放大状态。若多个小块具有相同运动方向,表明目标运动趋势。在图像的边界处,可先扩宽边界再进行校正计算,提取的光流矢量,进一步使用直方图对其量化,图2(a)为图像Hk和Hk+1的光流矢量示意图。在360°分为8柱,每柱45°如图2(b)。每柱高度为该柱内所有光流矢量长度和。直方图峰值方向代表光流的主方向,该方向表征光流矢量的主运动趋势。获得的直方图来构造8维特征向量,如图2(c)所示。即使用8个区域的统计量表征光流矢量。

图2 光流的量化示意Fig.2Quantization of optical flow

由图2可知每柱有两个相邻区域,如g1柱两个相邻区域是g2和g8。八个区域首尾相邻包含360°。表明每柱与相邻两柱间存在联系,满足光流矢量在边界处可能更变区域的情况。相邻两帧图像Hk和Hk+1特征向量定义:

1.2 候选边界检测

图像熵为特征的一种统计形式,它反映图像中平均信息量的大小。图像熵表示图像灰度分布聚集特征所包含的信息量[8]。对于离散形式二维图像,其信息熵计算公式如下

在RGB色彩模型中对任意相邻两帧图像Hk、Hk+1,定义R通道的熵值差RD,通过光流分析图像分块处理后,图像DR值为所有小块的dR值之和。

同理G、B通道计算如R通道,所有通道的和为相邻图像D值。

采用滑动窗口模式检测整个视频段,其大小设为W,而保留有镜头切换的候选边界。单镜头内图像间具有较高相似性,不存在较大D值;相反的,在镜头切换处图像间差异明显,存在异常D值。图像连续性检测中需用阈值T进行判断。假定窗口当前帧的位置为C,满足。当窗口中D值满足:

保留该段并认定候选镜头边界。当不满足时认为该段是镜头内平滑过渡不存在镜头的切换,丢弃并判断下一段。直至整个视频处理完毕,获取所有候选镜头边界。这里a为常数,TC依据C自适应获取,取窗口首帧到当前帧的均值,即:

2 候选边界识别

通过候选边界的处理判断镜头切换及方式。根据各类镜头构造差异进行检测,淡入淡出镜头对亮度敏感,切换中存在亮度降低的过程;突变镜头连接过程未使用过渡效果,表现为图像亮度骤变。依据亮度特征识别淡入淡出和突变镜头。此外,图像往往只有显著区域引起人眼的重视,提取图像显著区域再依据其特征进行相似性判别,对此提出一种模板匹配方法识别溶解镜头。

2.1 特征提取

Retinex理论是一个简单有效的人类视觉模型[9]。一幅图像H(x,y)可以分解为反射图像R(x,y)和亮度图像L(x,y):

从原始图像中计算出有效亮度图像是一个奇异问题。McCann算法[10]用于进行图像亮度的提取,且对阴影遮挡和光照不均均有较好适应性,故采用该方法在原始输入图像中按照一定的规律选取一部分像素点,其方法是类似于在图像中画一条螺旋结构的路径。从信息论可知信息分为冗余和变化部分,人们的视觉对变化部分更敏感。Goferman等人[11]提出的基于上下文显著检测的方法综合考虑局部和全局特征有较好效果。对于图像块pi和pj,若颜色距离越大位置距离越小,则它们的差异值越大。颜色距离和空间距离是

两图像块在Lab空间的欧几里得距离。若任意pj得到的差异值都很大,则认为该块pi是显著的:

互信息是衡量图像间包含信息大小,渐变的切换正如镜头相互融合的过程,故用互信息度量图像间相似性。图像联合灰度概率分布,互信息的定义如下

2.2 模板构造

图3 (b)突变类镜头互信息Fig.3(b)Abrupt type shots mutual information

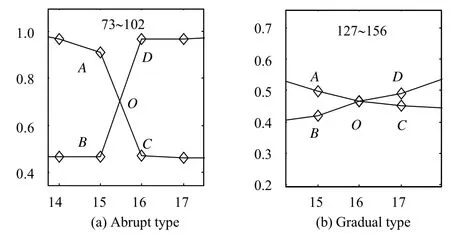

根据渐变和突变镜头内在差异来构造镜头匹配的模板。溶解类前后镜头相互融合,将候选边界的第一帧和最后一帧图像设为对比帧,提取对比帧显著区域分别构造首帧、尾帧的互信息曲线,该双曲线为模板基础。多组渐变和突变镜头的互信息曲线如图3所示。

如图4所示,分别为第一组突变镜头与第一组渐变镜头内五点局部图像。图4(a)所示,突变类互信息曲线切换前缓慢变化,切换后趋于平稳,曲线交点处水平方向夹角较大;图4(b)中渐变镜头互信息曲线的变化缓慢,两条曲线水平方向夹角较小符合镜头的缓慢融合。设首帧和尾帧曲线交点为O点,临近交点处的首帧曲线两点为A、C,尾帧曲线两点为B、D,其中AOB是水平向左的夹角,COD是水平向右的夹角。

五点A、B、C、D和O构成镜头检测模板的要素,通过计算模板中AOB与COD的度数来进行镜头识别。如果满足:

图4 交点处局部示意图Fig.4The local intersection of point

认为该模板匹配突变镜头,即检测段候选镜头边界存在突变类镜头切换。当不满足时认为该模板匹配渐变镜头,该候选镜头边界存在溶解类镜头切换。

3 实验结果分析

为了评估提出的镜头边界检测方法,本文使用开放数据集网站“www.open-video.org”中两个视频系列Anniversary和Winning,均为TRECVID采用的测试视频[12]。视频具有不同内容、帧率,时长1 min~20 min不等,具体描述如表1所示。本节包括候选边界实验和边界识别实验两个部分。

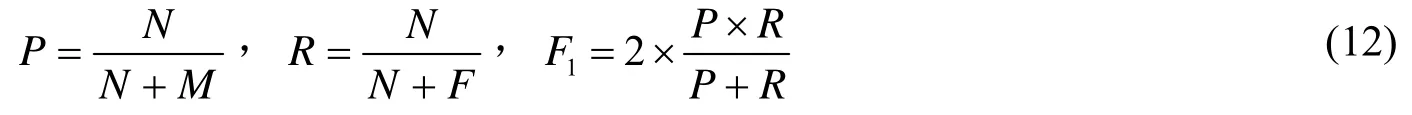

实验中设N代表正确检测镜头个数,M代表漏检镜头个数,F代表误检镜头个数。用正确检测数和总镜头数可获取查准率P和查全率R。查全率和查准率是相互关联的,可以改变参数获得更高查全率,但往往降低查准率。而调整参数获取更高查准率也会减小查全率。通过查全率与查准率调和平均值,采用相同权重来获取高性能检测值F1。

上述三个参数取值范围为[0,1],其数值被转换至百分比(%),值越大表明系统性能越好。

3.1 候选边界实验

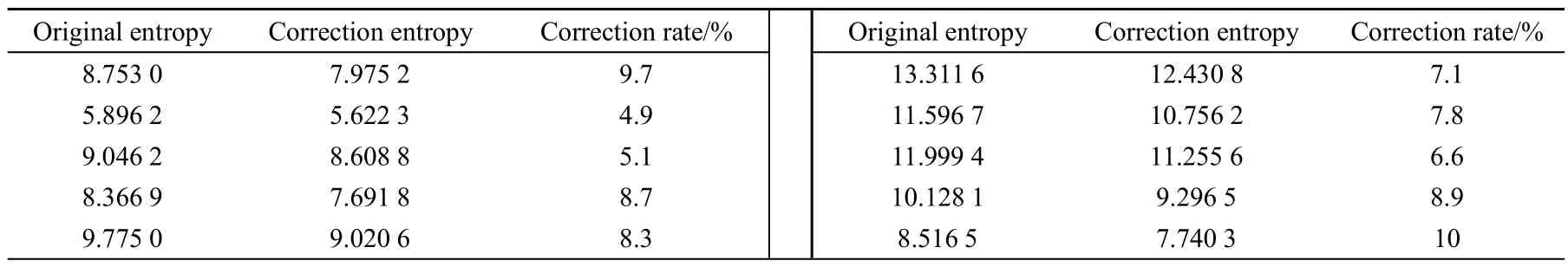

候选边界检测先提取图像间光流矢量并量化,由式(3)进行相识度的计算。若视频中相似度存在异常值,表明该段存在光流矢量剧烈变化即存在镜头的切换。通过相邻帧熵值差异值,用于判别镜头连续性。使用提取的矢量对相邻图像校正,以减小目标移动、相机运动等影响。采集多组原帧间差和校正帧间差对应数值如表2所示,实验中图像采用9´9分块进行校正。定义校正率为原熵值与校正熵值的差和校正熵值的比值,该值验证光流校正效果。表2中平均校正率为7.7%,表明光流校正的有效性。通过校正可降低图像熵值,利于图像连续性的检测。

表2 光流校正数据结果Table 2Optical flow correction data results

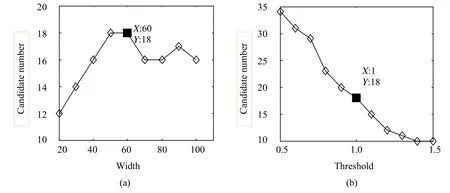

在候选边界检测过程中,滑动窗口大小W和式(6)中阈值影响边界数选取。通过实验测试W与候选边界块数关系,而获取最佳窗口大小。图5所示为实验关系图,图5(a)中窗口大小在20至50时检测块数对应增加,在50和60时块数达峰值,随后下降并趋于稳定。故实验采用窗口大小为60达到较好效果,同时保证处理速度。图5(b)所示为阈值与块数的关系图,阈值为1.0时选边界数达到最佳18,故选取阈值0.9至1.1以提高适应性。由式(7)知TC的定义,结合其取值知常数a范围为0.06至0.12。

图5 候选块数与影响因子Fig.5The candidate number with impact factor

图6 镜头亮度示例图Fig.6Shots brightness diagram

3.2 边界识别实验

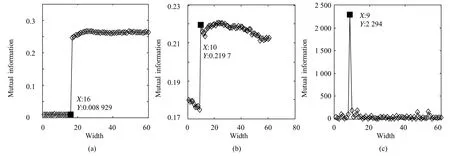

对于获取的候选镜头边界,依据图像亮度信息和互信息进行识别。亮度信息使用2.1小节中螺旋结构进行提取。每幅图像使用该结构不重叠提取亮度信息。一幅图像中像素点的亮度均值作为亮度信息。由实验及先验理论知,淡入淡出镜头对亮度值较为敏感。从数据发现亮度值0.05是合适的阈值,如图6(a)所示。多数突变镜头在切换处图像亮度值存在明显变化,如图6(b)所示,突变类使用相邻图像绝对差值进行判别,使用绝对差值中的最小值与各绝对差值的比值(商值)作为判断条件。图6(b)的商值结果对应图6(c),最大商值作为判断条件,实验用商值1 000作为阈值,图6(c)中最大是2 294。

通过亮度检测后未识别的候选边界,使用2.2小节中模板匹配进行识别。通过首帧(尾帧)与边界内图像的互信息量计算,构造首尾帧曲线并提取模板的五点。将式(11)中条件简化满足时该段认为存在突变镜头;否则存在溶解类镜头。如图7所示为两组镜头曲线图。

图7 模板匹配示意Fig.7Template matching example

其中图7(a)为溶解镜头互信息曲线,实验知其AOB夹角为7.97°,角度较小。图7(b)是突变镜头互信息曲线,实验知AOB夹角为78.72°。实验中多组AOB夹角度数如表3所示,通过大量实验可将阈值度数q设为18。

表3 AOB夹角度数Table 3 AOB angle degree

表4 本文方法实验结果Table 4The result of our method

表5 本文方法与TRECVID 2007中方法对比Table 5Our results compare with TRECVID 2007

表4所示检测结果表明提出的方法具有较好的效果。候选边界实验中采用最大边界数策略,有效避免漏检镜头发生,保障较高的查全率,使用光流量化与图像熵差进行连续性判断,保证准确而高效的获取边界。若两幅图像内容不同但熵差值较小影响连续性检测,结合相似度可有效判断不连续性。利用多特征从候选边界中识别镜头类别,避免误检镜头的发生。同时排除无镜头切换候选镜头边界,保障查准率。

表5为本文方法与TRECVID中镜头边界检测结果。TRECVID中查准率P均值为91.13%,本文均值达到96.76%;TRECVID中查全率R均值为84.55%,本文均值为91.17%;TRECVID中F1均值为87.54%,本文均值为93.76%。实验数据显示本文方法检测率显著提高,表明提出的检测方法的高效性。本文具有较好效果源于检测过程的分段分析和处理,即首先使用光流等特征选取候选镜头边界,其次再对其进行镜头类别识别。

4 结论

本文提出的基于光流的镜头边界检测方法,不仅消除多运动造成的干扰同时敏锐的捕捉视频序列中镜头的变化。首先通过视频内图像连续性判断,获取存在镜头切换的候选镜头边界。其次提出模板匹配方法,从候选镜头边界中识别出镜头类别。实验知本文方法具有较高查准率与查全率。然而在图像光流矢量检测过程较为耗时,同时光流对图像校正的流程时间也较长,造成提出的算法未能达到实时性。这是本文主要存在的问题也是接下来的工作重心。

[1]Smeaton A F,Over P,Doherty A R.Video shot boundary detection:Seven years of TRECVid activity[J].Computer Vision and Image Understanding(S1077-3142),2010,114(4):411–418.

[2]Lin Chuenhorng,Hsiao M D,FU Lijung.Analysis of Shot Boundary Based on Color and Texture Features of Frame[C]//IOP Conference Series:Materials Science and Engineering,Kuala Lumpur,Malaysia,July 2–4,2013,53(1):012004.

[3]Butz T,Thiran J P.Shot boundary detection with mutual information[C]//Proceedings of the 2001 International Conference on Image Processing,Thessaloniki,Greece,October 7-10,2001:422–425.

[4]Černeková Z,Pitas I,Nikou C.Information theory-based shot cut/fade detection and video summarization[J].IEEE Transactions on Circuits and Systems for Video Technology(S1051-8215),2006,16(1):82–91.

[5]Treetasanatavorn S,Heuer J,Rauschenbach U,et al.Temporal video segmentation using global motion estimation and discrete curve evolution[C]//Proceedings of the 2004 International Conference on Image Processing,Singapore,June 21-24,2004:385–388.

[6]张寅,宋永红,杨蕾.利用图像不连续特性的溶解型镜头检测算法[J].计算机辅助设计与图形学学报,2011,23(5):878–883. ZHANG Yin,SONG Yonghong,YANG Lei.Discontinuity-Driven Shot Detection Algorithm for Dissolving Shots[J].Journal of Computer-Aided Design&Computer Graphics,2011,23(5):878–883.

[7]SUN Deqing,Roth S,Black M J.A quantitative analysis of current practices in optical flow estimation and the principles behind them[J].International Journal of Computer Vision(S0920-5691),2014,106(2):115–137.

[8]CHEN Hong,JIANG Tie,ZHU Guibin.Image Mosaic based on Image Entropy and the Number of Feature Points Control[J]. Information Technology Journal(S1812-5638),2014,13(7):1381.

[9]JIANG Bo,Woodell G A,Jobson D J.Novel multi-scale retinex with color restoration on graphics processing unit[J].Journal of Real-Time Image Processing(S1861-8200),2015,10(2):239–253.

[10]杨中东,王鹏,李晓慧,等.基于LCoS像素级图像亮度调整方法研究[J].仪器仪表学报,2013,34(1):147–152. YANG Zhongdong,WANG Peng,LI Xiaohui,et al.Study on pixel-level image brightness adjustment method based on LCoS [J].Chinese Journal of Scientific Instrument(S0254-3087),2013,34(1):147–152.

[11]Goferman S,Zelnik-Manor L,Tal A.Context-aware saliency detection[J].IEEE Transactions on Pattern Analysis and Machine Intelligence(S0162-8828),2012,34(10):1915–1926.

[12]Amiri A,Fathy M.Video shot boundary detection using generalized eigenvalue decomposition and Gaussian transition detection [J].Computing and Informatics(S1335-9150),2011,30(3):595–619.

Shot Boundary Detection Based on Optical Flow

WANG Ronggui,HU Jiangen,YANG Juan,XUE Lixia

(School of Computer and Information,Hefei University of Technology,Hefei230009,China)

To solve the problem that motion information in the video is combined to the detection process of the shot boundary,which is to prevent the impact of target movement,camera movement for detection,a shot boundary detection method based on optical flow is proposed.Firstly,motion information in video using optical flow method was detected, which is used to calculate the entropy of adjacent image correction,and a method of optical flow quantization is proposed. The quantization value and corrected entropy is used to determine the continuity of the image,and candidate boundaries are reserved for the presence of a lens switch.Secondly,the image of the photometric information and mutual information between the images are extracted using the difference between the lens structure,and a model matching method is proposed to identify the type of shot.Significant areas of the image are extracted for computing mutual information, which increases the difference between the images and ensures the accuracy of the model matching.The results show that the algorithm can accurately detect the shot boundary,and effectively eliminate the interference of motion.

shot boundary detection;optical flow;mutual information;salient region

TP391

A

10.3969/j.issn.1003-501X.2016.11.007

1003-501X(2016)11-0038-08

2016-05-05;

2016-07-20

中国博士后基金项目(2014M561817);安徽省自然科学基金项目(J2014AKZR0055)

汪荣贵(1966-),男(汉族),安徽池州人。教授,主要研究视频处理与分析等。E-mail:wangrgui@126.com。