极限学习机在高光谱遥感图像分类中的应用

2016-06-28张新君

李 铁,张新君

(1.辽宁工程技术大学 电子与信息工程学院,辽宁 葫芦岛125105;2.大连理工大学 计算机科学与技术学院,辽宁 大连116024)

极限学习机在高光谱遥感图像分类中的应用

李 铁1,张新君2

(1.辽宁工程技术大学 电子与信息工程学院,辽宁 葫芦岛125105;2.大连理工大学 计算机科学与技术学院,辽宁 大连116024)

针对高光谱遥感图像的分类问题,本文引入极限学习的思想,提出了基于分层局部感受野的极限学习机的高光谱分类方法。该方法利用光谱特征的局部相关性,采用两层的分层结构提取高光谱图像中的抽象表示和不变特征,可以取得更好的分类性能。同时还分析了算法的不同参数对分类性能的影响。在两个广泛使用的真实高光谱数据集上进行实验,同当前一些典型的方法做比较,结果表明该方法具有更高的分类性能与较快的训练速度。

遥感;极限学习机;高光谱图像;分类

0 引言

随着高光谱成像技术的研究进展,高光谱遥感已经成为遥感领域的前沿技术之一。高光谱图像上百个连续的窄的光谱波段可以用一个光谱和空间信息的数据立方体来记录,它覆盖了一个从可见光到红外光范围内较大的光谱波长范围[1]。高光谱图像处理最重要的任务之一就是分类,把每个像素分为一个特定的土地覆盖类别。高光谱图像分类在很多应用上都发挥着重要的作用如物体识别、环境监测、精细农业、城市规划和侦察等[2]。但高光谱数据大量的波段与相对较小的训练样本数量给传统的遥感分类方法带来挑战。

为了应对挑战有效处理高光谱图像分类,现已提出了很多机器学习方法如支持向量机(SVM)、神经网络、流形学习、主动学习等。近年来出现了一些新的研究方法如稀疏表示分类器、高斯混合模型和形态学轮廓[3]。但对于参数化的有监督高光谱图像分类方法寻找最优参数通常很困难而且耗时。

极限学习机(ELM)是一种新的单隐藏层前馈神经网络(ELM),是模式分类中一种先进的学习算法[4]。大量的研究表明ELM具有快速和准确的模式分类的能力。现已有一些用ELM做遥感影像分类的研究。ELM用于处理高光谱数据的土地覆盖分类问题,可以取得与反向传播神经网络相似的性能。ELM也可以与差分进化算法[5]、集成学习[6]、核方法[7]等相结合用于高光谱图像分类。但已有的基于ELM的研究方法没有充分的利用高光谱数据光谱特征之间的相关性。

近年来受生物学研究的启发引入了神经科学中局部感受野(LRF)的概念[8]提出了一种基于LRF的ELM(L-ELM)架构。其主要思想是在输入层和隐藏层之间局部密集连接。考虑到光谱特征的局部连接可以进一步提高高光谱图像的分类性能。因此本文提出一种新的使用L-ELM模型的高光谱图像分类方法。

高光谱图像在分类之前通常要做特征表示和特征提取[9],其目的是使得到的特征能判别不同类别的像素而保持类内的差别不变。近年来比较热门的深度学习方法在很多领域都取得了最好的结果,如图像分类、目标检测、语音辨识、自然语言处理等[10]。深度学习获得成功的原因在于分层的深度结构能提取更抽象的表示和数据的不变特征,可以取得更好的分类性能[11]。最近已有一些研究采用深度学习模型用于高光谱图像分类[12]。为了提取高光谱数据的有效特征,采用分层结构更利于高光谱图像分类。本文扩展L-ELM模型为多层的L-ELM(ML-ELM)模型来提取高光谱数据的空谱特征。在两个真实的高光谱图像数据集上的实验表明所提出的方法可以取得更高的分类性能和较快的训练速度。

1 ELM简介

ELM是单隐藏层前馈神经网络,使用随机分配的输入权重。与BP算法不同的是它不需要调整输入权重。ELM是前馈神经网络,由三层结构组成分别是输入层,隐藏层,输出层。

其中wj和分别表示从第j个隐藏神经元到输入神经元和输出神经元的权重系数。bj是第j个隐藏神经元的偏置值。上述的N个方程式可以简化为

解式(2)的线性方程,能得到最优输出权重:

2 本文算法

2.1 ML-ELM

基于ML-ELM的高光谱图像分类方法的架构图如图1所示。ML-ELM层可以分成两部分即特征提取和ELM分类器。特征提取采用空间金字塔平方和根池化方法.分类器采用ELM极限学习机的方法。

近年来空间金字塔池化算法已经成为一个流行的学习有效的图像特征表示的模型。它共包含两部分。第一部分是空间金字塔模型,另一部分是池化算法。空间金字塔模型在不同的层上把一个像素块分成子块。在第一层上,块的表示是基于整个图像块的。在第二层,整个图像块分成四个金字塔块。在金字塔的第l层,整个图像块包含个子块。

在池化层中使用平方和根池化结构。在一个图像子块区域内通过计算编码的平方和根来得到有效的特征。平方和根池化将非线性修正和平移不变性引入网络,在计算机视觉领域已经证明是有效的。

假设L是金字塔的层数,Vl是第l层金字塔空间块的数量,基于空间金字塔平方和根池化的像素块P的特征表示为

其中n表示学习的稀疏编码的维度。

2.2 ML-ELM的训练和测试过程

首先高光谱图像中每个像素第一层稀疏编码通过正交匹配追踪(OMP)结合学到的字典D1通过类标一致性字典学习算法来得到。

对每个块Zi提取四个子块,分别为步长为m,遍历的顺序为从上到下,从左到右。在提取的四个子块上做空间金字塔平方和根池化来得到子块的池化特征,然后串联在一起形成Zi的第一层特征。在空间金字塔模型中采用两层金字塔(L=2),是维向量,表示为

将所有组合节点的值连接在一起构成一个向量,最后一层与输出层完全连接。矩阵的输出权重在式(3)中解析计算。

为了得到更好的泛化性能,使用正规化的ELM模型对输出权重增加约束条件。优化的目标函数为

其中I是单位矩阵。

3 实验

3.1 高光谱图像数据与实验设置

在机载可视/红外成像光谱仪(AVIRIS)的Indian Pines与Salinas数据集上做实验。Indian Pines图像由145 pixel×145 pixel组成空间分辨力为20 m/pixel。有220个光谱波段,波长范围为0.4mm~2.5mm。去除受大气水分吸收影响的20个噪声波段(104~108,150~163和220),使用剩余的200个波段做实验。地面实况图中共有16个土地覆盖类别。除背景外共有10 249个样本。每个类别及类别中的训练和测试样本数如表1。Indian Pines高光谱数据集如图2所示。

表1 Indian Pines类别,训练/测试集,不同方法的分类精度(百分比)Table 1Indian Pines classes,train/test set,and classification accuracy(in percent)for different methods

图2 Indian Pines高光谱数据集(a)原始图像;(b)地物类别真实分布图Fig.2Indian Pines hyperspectral dataset(a)Original image;(b)Ground truth map

Salinas图像的光谱分辨力为3.7 m/pixel,共包含了16类地物和512 pixel×217 pixel点,每个像素点包含了224个波段。去除水分吸收及信噪比较低的20个波段,保留剩下的204个波段。地面实况图中共有16个土地覆盖类别。在数据集中除背景外共有54 129个样本。每个类别及类别中的训练和测试样本数显示在表2中。Salinas高光谱数据集如图3所示。

表2 Salinas类别,训练/测试集,不同方法的分类精度(百分比)Table 2Salinas classes,train/test set,and classification accuracy(in percent)for different methods

图3 Salinas高光谱数据集(a)原始图像;(b)地物类别真实分布图Fig.3Salinas hyperspectral dataset(a)Original image;(b)Ground truth map

通过比较几个典型的和先进的分类方法来评价ML-ELM方法的分类性能,这些方法包括SVM,ELM,上下文SVM(CSVM),上下文ELM(CELM),L-ELM,CNN和空间感知字典学习(SADL)。SVM和ELM方法仅使用光谱信息,而其他的方法使用光谱信息与上下文信息。上下文方法的邻域窗口大小w从{3,5,7,9}中选择。对于SVM和CSVM分类,使用LIBSVM工具箱采用一对一方法。采用径向基函数(RBF)核;惩罚项和RBF核宽度分别在给定集内用格点搜索来选择。这些参数用五倍交叉验证方法来确定,也可以使用其他的方法。用于ELM和CELM的权衡参数从数据集中选择,隐藏的神经元数M从{400,...,3 200}中选择。对于L-ELM和ML-ELM,两个数据集的池化尺度设为3,特征映射数从{40,...,200}中得到。通过交叉验证,L-ELM的LRF大小在Indian Pines图像中设为经验值15,在Pavia University图像中设为经验值22。在ML-ELM中,取LRF为固定的邻域块大小,邻域块大小的选取在后面进行讨论。对于CNN方法,使用MatConvNet工具箱来运行。对于SADL使用文献中给定的设置。

3.2 分类结果

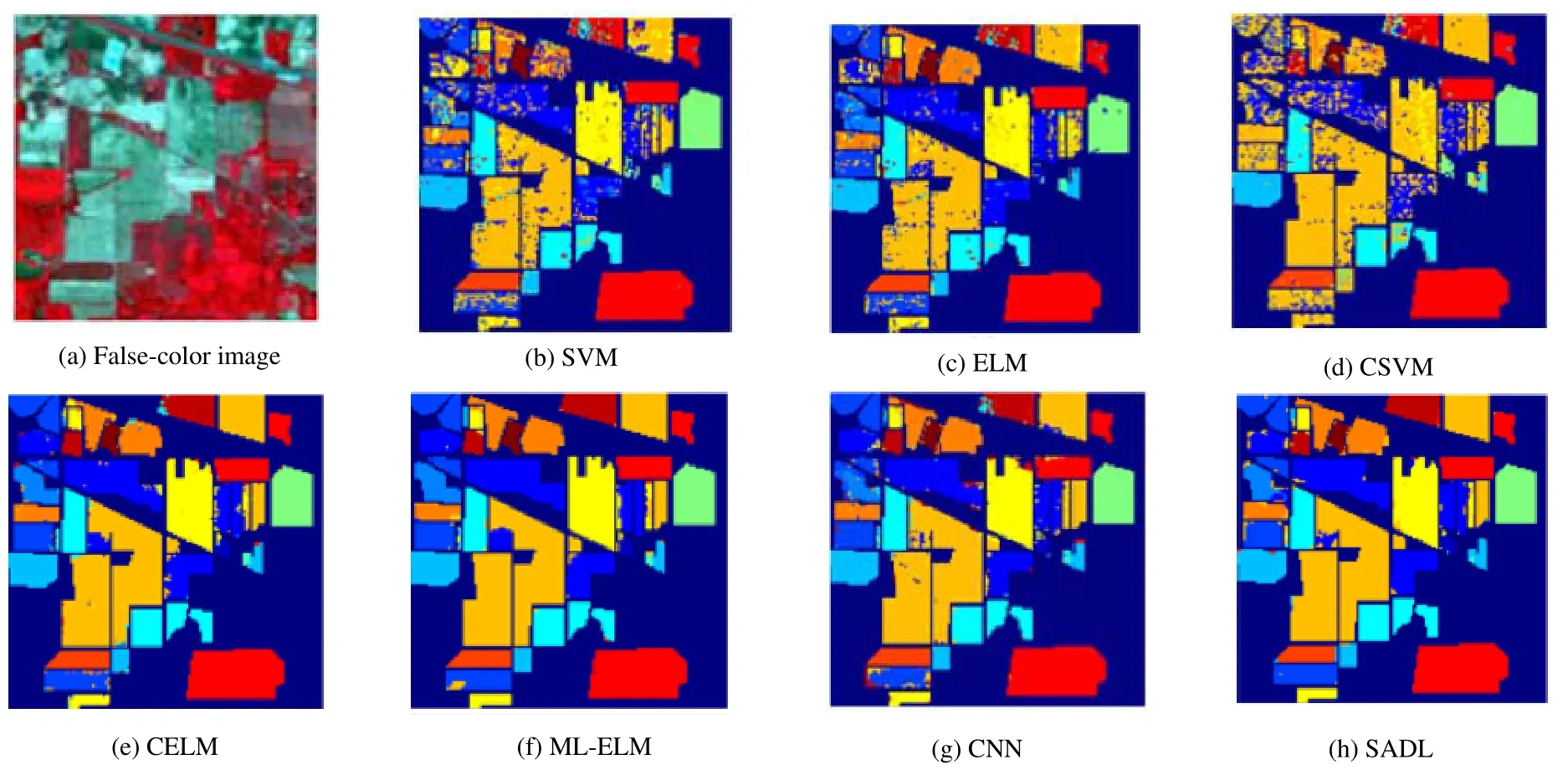

在Indian Pines数据集中对不同的方法做比较结果如表1中,其中包括各类别分类精度(CA),整体分类精度(OA),平均分类精度(AA)和Kappa系数()。结果取30次运行的平均值和标准差。从表中可以得出以下结论。第一,SVM和ELM相比其它的上下文方法性能较差,这表明上下文信息对于高光谱分类的重要性。第二,CNN的结果与L-ELM相似,高于CSVM和CELM方法,SADL比CNN大约提高1%。第三,ML-ELM方法在这些方法中得到最好的分类结果,OA为97.48%,AA为97.35%,为0.971 2。不同方法的分类图显示在图4中。

图4 Indian Pines图像的分类图Fig.4Classification maps for the Indian Pines image

用Salinas图像做实验,表2显示了不同方法的CA,OA,AA和的数值结果。这些方法中的最好结果用粗体来表示。结果显示在这个数据集上ML-ELM也优于其他的方法。

表1和表2的最后一行显示每种方法训练时间的比较,运行十次取平均值。所有程序在MATLAB R2014A下运行,实验所用计算机为Intel i7处理器,2.0 GHz CPU,64 GB内存。使用NVIDIA GTX 1070显卡来加快训练过程。结果表明从分类精度与训练时间的综合评价上来看本文所提出的分类方法具有可行性和有效性。

3.3 讨 论

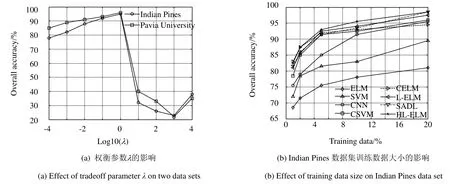

在ML-ELM中式(10)中的平衡参数和不同训练样本的大小对分类精度的影响。图5(a)显示了对OA的影响。可以看到当为0.2时在Indian Pines和Pavia University上OA都达到了最大值。基于此在ML-ELM实验中设=0.2。

在Indian Pines图像中比较各种方法在不同的训练样本下对分类精度的影响。图5(b)显示了对于1%,2%,5%,10%和20%的训练数据平均运行10次每种方法的OA。结果显示分类精度随着训练样本数量的增加而增加。SADL,L-ELM和ML-ELM方法在少量的训练样本下可以得到一个较高的分类精度,L-ELM稍微下降。还可以看到当训练样本的数量减少时CNN相对较低。

为了分析本文方法中邻域块大小对精度的影响,用不同的邻域块大小运行该特征学习算法,表3显示了在两个高光谱数据集上不同邻域块大小下的OA。

从结果中可以看到分类精度随着邻域块大小的增加而增加。当邻域块大小比较小的时候精度增加的趋势很快,当邻域块的大小为7×7时变得缓慢,最后保持相对稳定。当邻域块大小为3×3时,对于两个数据集来说性能较差,很可能是因为在很小的区域内捕捉的信息太有限。为了平衡计算的复杂度和性能之间的关系,在实验中使用的邻域块大小为7×7。

图5 ML-ELM中不同因素对OA的影响Fig.5Impacts on OA of ML-ELM by different factors

表3 本文方法在两个高光谱数据集上不同邻域块大小下的OA(百分比)Table 3OA(in percent)of our method on two hyperspectral data with different patch sizes

4 结论

本文提出一种新的ML-ELM模型用于高光谱图像分类。通过引入LRF可以充分利用高光谱图像数据光谱特征之间的相关性。使用分层结构可以学习多个层次的抽象和不变特征。在两个真实的高光谱数据集上的实验结果表明该方法具有更高的分类性能与较快的训练速度。

[1]李吉明,贾森,彭艳斌.基于光谱特征和纹理特征协同学习的高光谱图像数据分类[J].光电工程,2012,39(11):88-94. LI Jiming,JIA Sen,PENG Yanbin.Hyperspectral Data Classification with Spectral and Texture Features by Co-training Algorithm[J].Opto-Electronic Engineering,2012,39(11):88-94.

[2]KANG Xudong,LI Shutao,FANG Leyuan,et al.Intrinsic image decomposition for feature extraction of hyperspectral images [J].IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2015,53(4):2241–2253.

[3]Ghamisi P,Benediktsson J A.Feature selection based on hybridization of genetic algorithm and particle swarm optimization[J]. IEEE Geoscience and Remote Sensing Letters(S1545-598X),2015,12(2):309–313.

[4]ZHOU Yicong,PENG Jiangtao,CHEN C L.Philip.Dimension reduction using spatial and spectral regularized local discriminant embedding for hyperspectral image classification[J].IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2015,53(2):1082–1095.

[5]KANG Xudong,LI Shutao,FANG Leyuan,et al.Extended random walker-based classification of hyperspectral images[J]. IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2015,53(1):144–153.

[6]Romero A,Radeva P,Gatta C.Meta-parameter free unsupervised sparse feature learning[J].IEEE Transactions on Pattern Analysis and Machine Intelligence(S0162-8828),2015,37(8):1716–1722.

[7]Bazi Yakoub,Naif Alajlan,Farid Melgani.Differential evolution extreme learning machine for the classification of hyperspectral images[J].IEEE Geoscience and Remote Sensing Letters(S1545-598X),2014,11(6):1066–1070.

[8]ZHANG Lefei,ZHANG Qian,ZHANG Liangpei,et al.Ensemble manifold regularized sparse low-rank approximation for multiview feature embedding[J].Pattern Recognition(S0031-3203),2015,48(10):3102–3112.

[9]CHEN Chen,LI Wei,SU Hongjun,et al.Spectral-spatial classification of hyperspectral image based on kernel extreme learning machine[J].Remote Sensing(S2072-4292),2014,6(6):5795–5814.

[10]CHEN Yushi,ZHAO Xing,JIA Xiuping.Spectral-spatial classification of hyperspectral data based on deep belief network[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing(S1939-1404),2015,8(6):2381–2392.

[11]YUE Jun,ZHAO Wenzhi,MAO Shanjun,et al.Spectral-spatial classification of hyperspectral images using deep convolutional neural networks[J].Remote Sensing Letters(S2150-704X),2015,6(6):468–477.

[12]Soltani-Farani A,Rabiee H R,Hosseini S A.Spatial-aware dictionary learning for hyperspectral image classification[J].IEEE Transactions on Geoscience and Remote Sensing(S0196-2892),2015,53(1):527–541.

Research of Hyperspectral Remote Sensing Image Classification Based on Extreme Learning Machine

LI Tie1,ZHANG Xinjun2

(1.School of Electronic and Information Engineering,Liaoning Techinical University,Huludao125105,Liaoning Province,China;2.School of Computer Science and Technology,Dalian University of Technology,Dalian116024,Liaoning Province,China)

In view of hyperspectral remote sensing image classification,this paper introduces Limit learning theory and proposes a novel classification approach for a hyperspectral image(HSI)using a hierarchical local receptive field(LRF) based extreme learning machine(ELM).Considering the local correlations of spectral features,hierarchical architectures with two layers can potentially extract abstract representation and invariant features for better classification performance. Simultaneously,the influence of different parameters of the algorithm on classification performance is also analyzed. Experimental results on two widely used real hyperspectral data sets confirm that the comparison with the current some advanced methods,and the proposed HSI classification approach has faster training speed and better classification performance.

remote sensing;extreme learning machine(ELM);hyperspectral image(HSI);classification

TP751

A

10.3969/j.issn.1003-501X.2016.11.010

1003-501X(2016)11-0062-07

2016-04-22;

2016-07-04

李铁(1978-),男(汉族),辽宁阜新人。讲师,博士,主要研究工作是遥感影像、模式识别。E-mail:lthero@163.com。