局部搜索式的Lytro相机微透镜阵列中心标定

2016-06-28王丽娟张旭东

王丽娟,张 骏,张旭东,高 隽

(合肥工业大学 计算机与信息学院,合肥230009)

局部搜索式的Lytro相机微透镜阵列中心标定

王丽娟,张 骏,张旭东,高 隽

(合肥工业大学 计算机与信息学院,合肥230009)

针对Lytro相机微透镜阵列中心标定的精确性受主透镜安装误差、漫反射光一致性等不利因素的影响,本文提出由粗到细的局部搜索式微透镜阵列中心标定方法。在获取粗调中心的基础上,局部搜索其邻域像素的最大值作为候选中心,并计算二者间的欧氏距离,实现微调中心的精确定位。实验结果表明,与其他先进标定算法相比,本文方法的距离误差较小,精确性提升了3.88%。进一步,将标定结果用于色彩校正及重聚焦,结果表明本文方法色彩校正后的图像更加真实自然,信息熵值更高;重聚焦图像清晰度更高,并且对室内外复杂场景均适用。

Lytro;微透镜阵列中心;标定;色彩校正;重聚焦

0 引言

传统相机获取的二维图像,是光线强度在探测器像元上的累加,丢失了光线的分布信息。光场相机采用光场成像技术,通过一次曝光,能同时记录光辐射在空间中的强度和方向信息[1]。

按照光的获取方式,光场相机可分为微透镜阵列型[2]、相机阵列型[3]和掩膜型[4]。基于微透镜型的光场相机,结构紧凑,数据处理较为方便,是目前光场成像研究的热点之一,如Raytrix[5]和Lytro[6]。其中,Raytrix相机主要面向工业及科研应用,需要一条千兆比特以太网与个人电脑连接,不易携带;Lytro相机结构简单,易于携带,适用于实验室环境和日常生活。Lytro相机在显著性检测[1,7-9]、超分辨率重建[10]、重聚焦[11]等方面均取得成功应用。

然而,Lytro相机受制作工艺及装配精度的影响,微透镜阵列和传感器之间存在未知的偏移[12-13],导致像素和微透镜之间的所属关系难以精确确定。因此,国内外研究人员对微透镜阵列中心的标定方法展开深入研究[12-16]。例如,文献[12]、[13]均利用微透镜的渐晕效应完成标定。实际上,主透镜安装误差及漫反射光的不一致,将导致微透镜中心与白图像渐晕光峰值不一致,标定精度受到较大的影响。此外,还有基于多频相移的标定方法[14]及基于线特征的几何校准方法[15],前者实现过程较为复杂,并且标定精度受多频相移图像的影响;后者利用棋盘格图像黑白过渡区域的线特征完成标定,但是白图像的渐晕效应影响线特征的精确定位。另外,Cho等人[16]在频域内估计白图像旋转参数,并通过拟合来标定像素光场,但所使用的白图像在色彩均匀的白色场景下获取,易受传感器噪声影响。

针对上述问题,本文提出由粗到细的局部搜索式微透镜阵列中心标定方法,主要总结如下:1)在获取粗调中心的基础上,局部搜索其邻域像素的最大值作为候选中心,并引入欧氏距离,实现微调中心的精确定位。2)利用Lytro相机[17]采集室内、外场景的光场数据,构建新的光场数据集。该数据集与LytroDataset[18]相比,有以下两点优势:其一,该数据集可与更多的其他先进标定方法对比,原因在于除相机内部自带白图像外,该数据集中还包含相机采集的新的高曝光白图像;LytroDataset未提供此类图像,导致与其他先进标定方法的对比受限。其二,LytroDataset包含30幅室内外场景类型较为简单的图像,而该数据集包含室内、室外的复杂背景、前景背景颜色相近、运动模糊、遮挡、光照及阴影等多种不同场景的40幅室内外场景图像,为光场技术的深入研究提供一个更具挑战性的数据支撑。3)与其他先进方法对比,本文方法能够有效减轻主透镜安装误差及漫反射光一致性的影响,标定结果的距离误差更小,精确性提升3.88%。

1 Lytro相机的成像原理

Lytro相机由一个主透镜、一个微透镜阵列和一个成像传感器组成[17-19]。物体上一点发出的光线,将会在微透镜阵列所在像平面上聚集为一点,随后微透镜将光线按照不同的方向角,分散到传感器上的不同像素位置处成像。然而,Lytro相机与传统相机一样,也是通过在成像传感器上放置Bayer彩色滤镜阵列完成场景捕获的,因此捕获的图像并非全彩色图像[20-21]。同时,受显示器伽马参数的影响,捕获的图像存在色彩失真。此外,微透镜的渐晕效应,导致传感器处的成像透镜中心位置亮度较高,边缘位置亮度较低[11]。

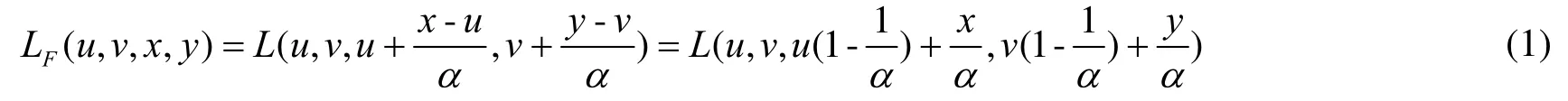

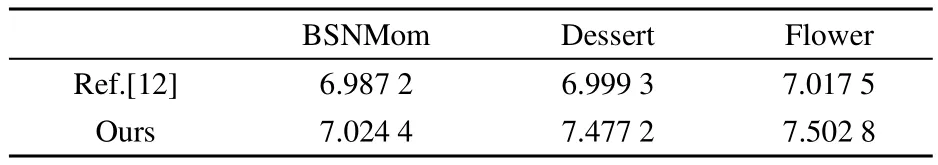

光场渲染理论指出,空间中任意光线都可以用两个平行平面进行参数化表示[11,19],如图1(a)所示。图1(b)中,光线沿直线传播至传感器平面时记为LF。根据三角形相似原理,LF的投影坐标为。其中F为透镜与传感器的距离,F'是透镜到重聚焦平面的距离,且F'=αF,a是一个调焦系数。根据光线在自由空间传播时能量不变,则:

然而,受制作工艺、装配精度以及对焦和变焦参数的影响,微透镜阵列中心的位置发生了改变[17],导致从主透镜同一子孔径进入的光线,经过微透镜阵列,不再投射到传感器同一位置像素处,而是投射到其相邻像素处,使成像传感器处产生像素偏移。

图1 光场的四维参数表示及其重聚焦原理Fig.1Parameter representation of light field and refocusing principle

2 本文方法

由前文可知,精确标定微透镜阵列的中心,能够精确确定像素和微透镜的所属关系,有效减轻像素偏移的影响。为此,本文提出局部搜索式的微透镜阵列中心标定方法,详细过程如下所述:

1)数据提取。利用LFP-reader[22]从Lytro相机中提取分辨力为3 280×3 280的白图像I。

2)滤波处理。先将圆形均值滤波器R及白图像I进行傅里叶变换,随后将二者在频率域卷积,再进行傅里叶反变换得到滤波处理的白图像I¢:

3)三角化。对白图像I¢进行峰值检测,得到每个微透镜图像的最亮点。进一步,本文通过Delaunay三角化[23],线性拟合峰值点间的相邻关系并对齐排列微透镜中心,校正微透镜之间的间隔。

4)粗调中心获取。利用Lytro相机的原始数据文件,初始化微透镜网络模型,将其与步骤3)得到的微透镜间隔结合,并通过邻近取样及线性插值,获取理想的微透镜阵列网格[12]。对理想网格与实际网格之间的差值进行中值计算,即可得到粗调中心,如图2黑点所示。

5)确定搜索范围。Lytro相机的微透镜呈六边形结构,本文为简化模型,将其抽象为以粗调中心为中心的矩形区域。同时,为便于描述标定方法,定义以下三个参数:

a)扫描范围S(x,y):指扫描窗口扫描一个微透镜时需要经过的所有像素,由以粗调中心为中心的m×m个像素组成,如图2虚线方格所示。

b)扫描窗口Wi(u,v):用于确定微调中心最终可能存在的区域,由扫描范围内相邻的n×n个像素组成,如图2实线矩形所示。

c)搜索范围C(s,t):以粗调中心为中心,半径为r的圆域内的若干个像素组成,是微调中心可能存在的区域,如图2实线圆圈所示。则对∀(s,t)∈C(s,t)有:

6)确定微调中心存在区域。为减轻主透镜安装误差及微透镜渐晕效应的影响,本文对粗调中心的邻域像素进行局部搜索。如图2所示,通过扫描窗口Wi(u,v)循环扫描微透镜阵列,利用扫描窗口覆盖的搜索范围C(s,t)区域,可将其有效缩小,得到微调中心可能存在的区域,如图中阴影区域所示:

其中i用于记录循环扫描的次数。由于微透镜的渐晕效应导致每个透镜中心位置处亮度较高,因此本文对微调中心可能存在的区域所包含的像素值进行求和排序,确定微透镜中心的最终存在区域R(p,q):

其中Ψ(Ri(h,l))表示对Ri(h,l)包含的所有像素求和排序。

图2 微透镜阵列局部搜索示意图Fig.2The schematics of local search micro-lens array

7)确定候选中心 根据微透镜的渐晕效应,取R(p,q)中像素值最亮的点作为微调后微透镜阵列的候选中心,即:

其中(h,)b表示候选中心的坐标。

8)确定微调中心。候选中心可能存在两种情况:(a)(h,)b取值唯一,此时R(p,q)中像素值最大的点唯一,即为微透镜的微调中心;(b)(h,b)取值不唯一,此时R(p,q)中至少有两个像素值最大的点。本文利用粗调中心和候选中心间的欧氏距离确定微调中心:

3 实验结果及分析

3.1 实验设置

本文实验使用的PC机配置为Core i7-3770k CPU 3.9 GHz,RAM 8 GB,Windows 7 64位操作系统,编译软件为MATLAB 2014b。本文实验设置m=10,n=7,r=3,并采用以下指标定量评价算法性能:

1)理想状态下,水平方向相邻两个微透镜中心之间的间距理论值为10 pixel。将不同方法的标定结果都与此标准值比较,计算得到距离误差[14],衡量不同标定方法的精确性,定义如下:

2)色彩校正能够使图像更加真实自然,本文利用图像信息熵定量评价色彩校正图像质量[24],定义如下:

其中:pT为图像中灰度值为T的像素所占的比例。

3)图像清晰度函数是衡量光场重聚焦的重要指标[16],本文利用梯度向量模平方函数评价重聚焦图像的清晰度[14],定义如下:

其中:f为重聚焦图像,W、H分别为图像的宽和高,(i,j)为重聚焦图像中像素点坐标。本文将清晰度E归一化到[0,1]。

3.2 实验结果

3.2.1 与其他先进的微透镜中心标定方法对比

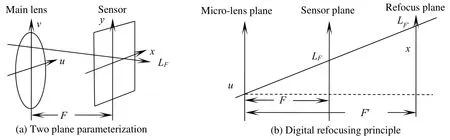

表1给出不同标定方法的距离误差。可见,对多数微透镜而言,不同方法标定的中心存在一定偏差。当D=0时,本文方法的微透镜中心个数可达99.79%,与文献[15]方法相比,提高了3.88%。原因在于本文方法对白图像进行两次检测,可有效减轻主透镜安装误差及微透镜渐晕效应的影响,提高标定结果的精确性。文献[12]通过检测白图像渐晕光峰值标定微透镜中心,实际上,主透镜安装误差及漫反射光的不一致,会导致微透镜中心与渐晕光峰值不一致[12]。文献[15]通过提取棋盘格图像黑白过渡区域的线特征完成标定,然而微透镜的渐晕效应影响线特征的精确定位。

表1 不同标定方法距离误差对比Table 1Distance error contrast on different methods

3.2.2 有效性和鲁棒性验证

a)色彩校正

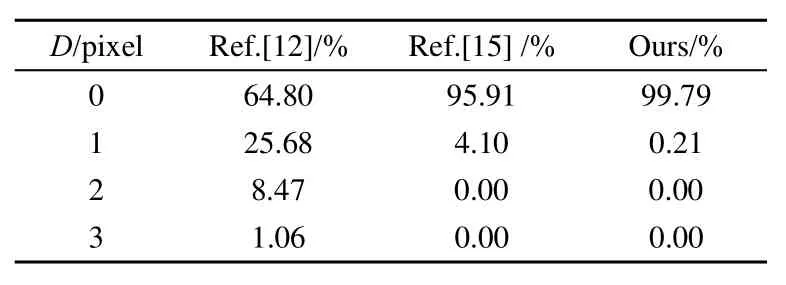

图3(a)为不同标定方法对LytroDataset[18]进行色彩校正的结果。表2给出其对应的图像信息熵值。可见,本文方法获取的色彩校正图像,信息熵值更高。原因在于,本文方法可更加精确的标定微透镜阵列中心,减轻像素偏移的影响,精确定位像素和微透镜的所属关系,使色彩校正更有效。文献[12]、[15]方法受微透镜渐晕效应影响,标定的微透镜阵列中心精确性较低,因而色彩校正后获取的图像信息熵值较低。

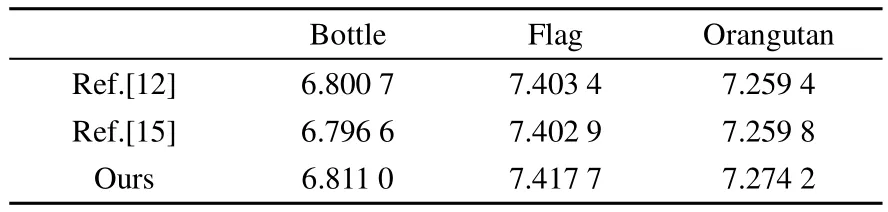

为了验证本文标定方法的鲁棒性,将标定结果在更复杂场景上用于色彩校正,图3(b)、表3为其定性及定量结果。其中,“Bottle”存在运动模糊,“Flag”背景复杂且存在严重遮挡,“Orangutan”有较强的光照及阴影。由表3可知,在室内外复杂场景下,本文方法的色彩校正图像信息熵值更高,具有较高的鲁棒性。

图3 中心视角图像色彩校正结果Fig.3Color correction for the center view

表2 LytroDataset色彩校正图像信息熵对比Table 2Image entropy contrast of color correction on LytroDataset

表3 本文采集数据色彩校正信息熵对比Table 3Image entropy contrast of color correction on our data

b)重聚焦图像清晰度度量

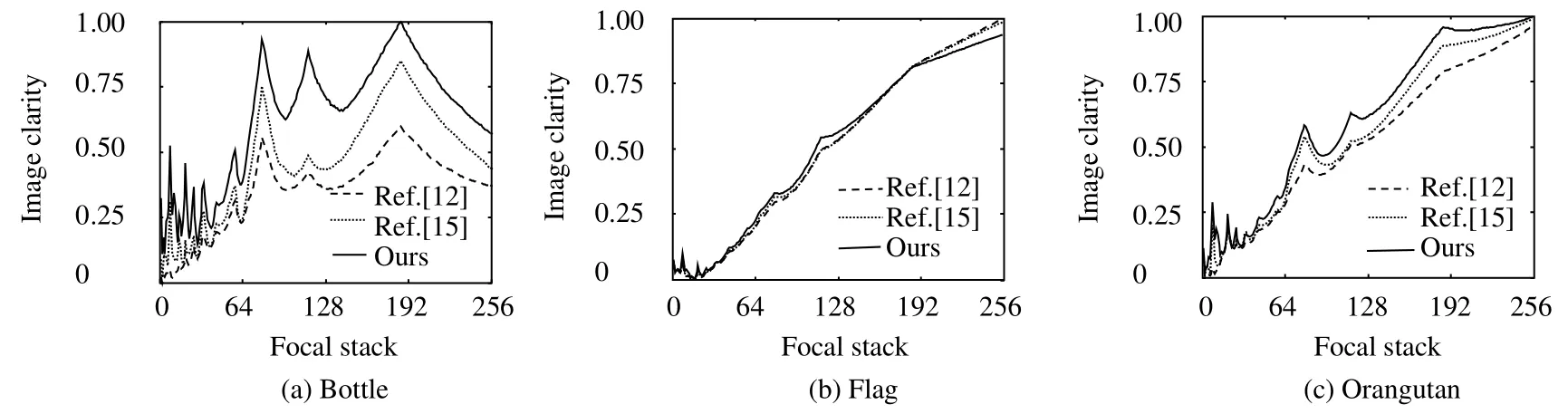

图4为LytroDataset[18]数据集获得的重聚焦图像的清晰度函数曲线,由图可见本文方法获取的重聚焦图像,清晰度更高。原因在于,本文方法有效减轻了主透镜安装误差及微透镜渐晕效应的影响。进一步,在本文采集数据上开展了重聚焦实验,图5为本文采集数据的部分定量实验结果,由图可知,对于遮挡、运动模糊、光照及阴影等更为复杂的场景,在提高重聚焦图像清晰度上,本文方法具有较高的鲁棒性。

图4 LytroDataset图像清晰度函数比较Fig.4Comparison of image clarity on LytroDataset

图5 本文采集数据图像清晰度函数比较Fig.5Comparison of image-clarity function of captured data

4 结论

由于目前Lytro相机标定方法精确性不高,且易受主透镜安装误差、漫反射光一致性等多种不利因素影响的问题,本文提出由粗到细的局部搜索式Lytro相机微透镜阵列中心标定方法。在获取微透镜阵列粗调中心的基础上,对其邻域像素进行局部搜索获取候选中心,有效减轻了主透镜安装误差及漫反射光一致性的影响,进一步引入欧氏距离选择定位微调中心,提高了标定结果的精确性。实验结果表明,相较于其他文献方法,在标定微透镜阵列中心精确性上,本文方法效果更佳;本文方法应用于色彩校正,图像更真实自然,信息熵值更高;获取的重聚焦图像,清晰度得到提高。然而,本文方法的精确性,在一定程度上受限于粗调中心的精确性。因此,可以构建微透镜阵列模板,利用模板匹配确定搜索范围,完成微透镜阵列中心的精确标定。此外,本文方法涉及多重循环扫描,数据计算量较大,因而时间复杂度较高,标定速度较慢。下一步需要研究优化算法减少计算复杂度,提升时间效率。

[1]ZHANG Xudong,WANG Yi,ZHANG Jun,et al.Light field saliency vs.2D saliency:a comparative study[J]. Neurocomputing(S0925-2312),2015,166:389-396.

[2]Schmidt H,Hawkins A R.The photonic integration of nonsolid media using optofluidics[J].Nature Photonics(S1749-4885),2011,5(10):598-604.

[3]Wilbum B,Joshi N,Vaish V.High performance imaging using large camera arrays[J].ACM Transactions on Graphics(S0730-0301),2005,24(3):765-776.

[4]LIANG Chiakai,LIU Gene,CHEN Homer H.Light field acquisition using programmable aperture camera[J].IEEE International Conference on Image Processing(S1522-4880),2007,5(5):V-233-V-236.

[5]Raytrix.The Raytrix Cameras[OL]//(2015-03-25),[2016-10-10].http://www.raytrix.de/

[6]Lytro.The lytro camera[OL]//(2011-10-20),[2016-10-10].https://www.lytro.com/.

[7]ZHANG Jun,WANG Meng,GAO Jun,et al.Saliency detection with a deeper investigation of light field[C]//International Joint Conference onArtificial Intelligence,BuenosAires,Argentina,July 25-31,2015:693-694.

[8]LI Nianyi,YE Jinwei,YU Ji,et al.Saliency detection on light field[C]//IEEE Conference on Computer Vision and Pattern Recognition,Columbus,OH,USA,June 23-28,2014:2806-2813.

[9]LI Nianyi,SUN Bilin,YU Jingyi.A weighted sparse coding framework for saliency detection[J].IEEE Conference on Computer Vision and Pattern Recognition(S1063-6919),2015,8(7):5216-5233.

[10]张旭东,李梦娜,张骏,等.边缘结构保持的加权BDTV全光场图像超分辨率重建[J].中国图象图形学报,2015,20(6):733-739. ZHANG Xudong,LI Mengna,ZHANG Jun,et al.Edge preserved light field image super-resolution based on weighted BDTV model[J].Journal of Image and Graphics,2015,20(6):733-739.

[11]Levoy M,Hanrahan P.Light field rendering[C]//Proc SIGGRAPH,New Orleans,August 4-9,1996.New York:ACM Press,1996:31-42.

[12]Dansereau D G,Pizarro O,Williams S B.Decoding,calibration and rectification for lenselet-based plenoptic cameras[J].IEEE Conference on Computer Vision and Pattern Recognition(S1063-6919),2013,9(4):1027-1034.

[13]周文晖,林丽莉.Lytro相机的光场图像校正与重对焦方法[J].中国图象图形学报,2014,19(7):1006-1011. ZHOU Wenhui,LIN Lili.Light field image rectification and refocus method for Lytro camera[J].Journal of Image and Graphics,2014,19(7):1006-1011.

[14]张旭,李晨.微透镜阵列式光场成像模型及其标定方法[J].光学学报,2014,34(12):1211005-1-1211005-13. ZHANG Xu,LI Chen.Calibration and imaging model of light field camera with microlens array[J].Acta Optica Sinica,2014,34(12):1211005-1-1211005-13.

[15]Bok Yunsu,Jeon Hae-Gon,Kweon In So.Geometric Calibration of Micro-Lens-Based Light-Field Cameras Using Line Features[C]//Computer Vision ECCV 2014,Zurich,September 6-12,2014.Springer International Publishing,2014:47-61.

[16]Cho Donghyeon,LEE Minhaeng,Kim Sunyeong,et al.Modeling the calibration pipeline of the Lytro camerafor high quality light-field image reconstruction[C]//IEEE International Conference on Computer Vision,Sydney Australia,December 2-8, 2013:3280-3287.

[17]Georgiev T,Yu Z,Goma S.Lytro camera technology:theory,algorithms,performance analysis[J].Proceedings of SPIE-The International Society for Optical Engineering(S0277-7860),2013,8667(15):86671J-86671J-10.

[18]Antoine M,Elif V,Christine G.Partial light field tomographic reconstruction from a fixed-camera focal stack[J].Computer Science(S1000-9000),2015,22(8):347-356.

[19]Ng R,Levoy M,Brédif M,et al.Light field photography with a hand-held plenoptic camera[J].Stanford University Computer Science Tech Report CSTR(S0877-1719),2005,2(11):1-11.

[20]HUANG Xiang,Cossairt O.Dictionary learning based color demosaicing for plenoptic cameras[C]//IEEE Conference on Computer Vision and Pattern Recognition Workshops,Columbus,June 23-28 2014.IEEE Computer Society,2014:455–460.

[21]MathWorks.Light field toolbox v0.4[OL]//(2015-12-12),[2016-10-10].http://www.matnworks.com/matlabcentral/ fileexchange/49683-light-field-toolbox-v0-2.

[22]Behnam Esfahbod.Light field photography file reader[OL]//(2016-02-16),[2016-10-10].https://pypi.python.org/pypi/ lfp-reader/2.0.0

[23]LEE D T,Schachter B J.Two Algorithms for Constructing a Delaunay Triangulation[J].International Journal of Computer and Information Science(S2161-5381),3(9),1980:403-418.

[24]TSAI D Y,LEE Y,Mastuyama E.Information Entropy Measure for Evaluation of Image Quality[J].Digit Imaging(S0897-1889),2008,21(3):338-347.

Micro-lens Array Center Calibration via Local Searching Using Lytro Cameras

WANG Lijuan,ZHANG Jun,ZHANG Xudong,GAO Jun

(School of Computer Science and Information Engineering,Hefei University of Technology,Hefei230009,China)

To reduce the effect of main lens installation error and diffuse consistency on the accuracy of micro-lens array center calibration,we present a micro-lens array center calibration method in a coarse-to-fine manner via local searching. It can determine the ownership of pixels and micro-lens precisely.On the basis of the coarse center,we acquire alternative centers by locally searching its neighbor pixels.To accurately locate the fined-tuning center,we calculate the Euclidean distance between the coarse center and alternative centers.The calibration result demonstrate that compared with other advanced calibration algorithms,the distance error of our approach is smaller,and the accuracy is improved by 3.88%. Further,we conduct color correction and refocusing experiments.Experimental results demonstrate that the colorful image by our method is more real and natural,and its information entropy is higher.Besides,the refocused image has higher image clarity for both indoor and outdoor complex natural scenes.

Lytro;micro-lens array center;calibration;color correction;refocusing

TP391

A

10.3969/j.issn.1003-501X.2016.11.004

1003-501X(2016)11-0019-07

2016-05-10;

2016-06-07

国家自然科学基金(61403116,61271121);中国博士后基金(2014M560507);中央高校基本科研业务专项资金资助

王丽娟(1990-),女(汉族),山西晋中人。硕士研究生,主要研究工作是机器视觉、光场技术。E-mail:lijuanwang@mail.hfut.edu.cn。

张骏(1984-),女(汉族),江苏徐州人。副研究员,硕士生导师,主要研究工作是计算机视觉、模式识别、认知科学。E-mail:zhangjun@hfut.edu.cn。