结合空间结构卷积和注意力机制的三维点云分类网络

2024-02-24武斌刘溢安赵洁

武斌,刘溢安,赵洁

天津城建大学计算机与信息工程学院,天津 300384

0 引言

三维点云分类作为计算机视觉最基本的任务之一,在自动驾驶、机器人等领域有着举足轻重的作用(Guo 等,2021b)。分类任务的核心内容是从点云数据中学习具有较高区分度的全局特征表示,但由于点云不规则、无序和非结构化等特点,设计准确且高效的神经网络模型来提取目标点云的特征信息仍具有一定挑战性。

为了实现三维点云目标的分类,早期学者提出通过投影的方式(Su 等,2015;Yu 等,2018;Yang 和Wang,2019;Wei 等,2020)将原始点云数据转换为一组二维图像以便进行点云特征信息的学习,但投影的方式不可避免地造成点云结构信息的丢失,且大量的投影数据造成了计算成本和存储消耗的增加。基于体素的方法(Riegler 等,2017;Lei 等,2019;Maturana和Scherer,2015)将原始点云转换为结构化的体素网格,并使用三维卷积神经网络进行特征提取,尽管取得了一定的分类效果,但此类方法无法保留点云细粒度几何特征,同时,点云的体素化过程应尽量提高体素网格的分辨率以保留更多特征信息,但高分辨率网格会带来额外的计算和存储开销。与上述方法不同,PointNet(Qi 等,2017a)直接使用原始点云作为网络模型的输入,实现了对点云逐点特征的学习和全局特征的聚合,取得了开创性的成果。为了加强局部感知能力,PointNet++(Qi 等,2017b)提出采样分组(sampling-grouping)抽象层,实现了对点云局部几何结构的抽象表示,但忽略了邻域内部点对之间的几何关系,且存在采样效率低的问题。

近年来,基于图卷积实现的点云分类模型取得了令人瞩目的成果。DGCNN(dynamic graph convo⁃lutional neural network)(Wang 等,2019)在特征空间内构造图结构,并进行逐层的动态更新,同时提出了用于局部特征编码的边卷积(edge convolution,EdgeConv)操作,实现了对细粒度局部特征的表征。但该网络仅在特征空间中学习局部特征,会不可避免地造成原始坐标信息的丢失。为了捕获点云潜在的几何信息,项学泳等人(2023)将邻域内的几何特征作为网络输入,并在图结构的基础上使用空洞卷积捕获局部信息,最大程度挖掘邻域内的几何特征。为充分挖掘邻域内点对间的关系,PointWeb(Zhao等,2019)通过构建邻域内各点的差异特征图,用于表征邻域内部任意点对之间的关联信息,同时提出自适应特征调整模块,挖掘点对之间的相互作用,但点对之间交互信息的学习导致较大的参数量,模型整体效率偏低。由于图卷积网络缺乏全局表征能力,有学者提出将边卷积操作强大的局部特征捕获能力和注意力机制(Vaswani 等,2017)的全局特征建模能力结合在一起。宋巍等人(2021)使用边卷积从动态图结构中提取局部特征,并使用注意力机制从邻域中聚合更具代表性的逐点特征。陈涵娟等人(2021)提出竞争注意力模块,学习多层级特征空间之间的内在联系,实现了对中间层特征的自适应调整,有效提高了模型对全局信息的捕获和表达能力。邓林涛和方志军(2022)在边卷积的基础上提出一种基于注意力机制的结构自适应邻域构建方法,同时提出特征负反馈模块从高维特征中分离更具代表性的局部特征。Yang 等人(2022)提出一种基于边卷积改进的几何关系卷积,用于获得更具辨识度的局部形状特征,同时设计了基于注意力机制的关系插值方法,用于表述邻域内几何信息与特征信息之间的联系。Point Transformer(Engel 等,2021)提出一种局部—全局注意力机制,用于关联两种特征表示。PointASNL(Yan 等,2020)提出一种用于自适应调整邻域采样点的重加权采样方法,同时提出局部—非局部模块,用于捕捉采样点间的长程和近邻依赖关系。GAPointNet(graph attention based point neural network)(Chen 等,2021)提出一种融合多头注意力的图注意力网络,通过嵌入注意力机制来学习局部几何表示。3DTCN(3D convolution-Transformer net⁃work)(Lu 等,2022)提出一种多尺度层次结构网络来进行全局特征表达,并对一系列现有的Trans⁃former模块进行了对比分析。

尽管基于边卷积操作和注意力机制的点云分类模型已经取得了良好的分类效果,但在点云几何结构相似时,边卷积原始输入特征之间的相似度过高,这可能导致网络模型无法捕获到具有较高区分度的特征信息,进而导致模型无法达到令人满意的分类效果。针对这一问题,提出一种结合空间结构卷积和注意力机制的点云分类网络,在边卷积的基础上引入邻接点的相对位置信息,并将邻域内的位置信息和结构信息分别编码,在增大局部特征差异性的同时,有效增强了模型的局部结构信息的表征能力。此外,设计了全局特征编码模块,从归一化的坐标信息中学习全局特征表示,并使用注意力机制对全局特征信息进行自适应调整。实验方面,在公开的ModelNet40数据集(Wu等,2015)上对模型的分类精度和效率进行评估,通过对比实验和消融实验验证了整体网络模型及各部分模块的有效性,结果表明所提出的网络模型具有良好的分类效果。

本文主要创新和贡献如下:1)提出一种空间结构卷积,从邻域位置信息和结构特征两个方面进行局部特征编码,有效提高了特征的差异性,增强了模型的空间结构表达能力。2)提出一种基于注意力机制的全局特征编码方法,通过加权操作对全局特征进行自适应的调整,实现了局部、全局特征信息间的关联。3)在局部特征编码和全局特征编码的基础上,设计了分支结构的点云分类网络模型,并在公开数据集上进行对比实验和消融实验。结果表明,所提出的网络框架具有较强的特征捕获和表征能力,针对点云分类任务具有良好的性能。

1 结合空间结构卷积和注意力机制的三维点云分类网络

1.1 整体网络结构

提出一种结合空间结构卷积和注意力机制的三维点云分类网络,网络结构如图1所示。

图1 网络结构Fig.1 Network architecture

为了更好地捕获全局特征表示和细粒度局部结构信息,设计了一种分支结构网络,将经过采样和归一化的点云原始坐标信息p作为网络输入,从不同的角度进行点云特征信息的提取。网络模型主要由两个部分组成:局部特征编码和全局特征编码。前者使用空间结构卷积从位置和结构两个角度对局部原始特征c进行特征编码,利用多层感知机(multilayer perceptron,MLP)提取细粒度局部特征L,图中m和n分别对应位置特征和结构特征;后者从归一化的原始坐标信息p中提取浅层全局特征v。为了实现局部和全局信息的互补,在全局特征提取分支中使用注意力机制从局部特征中学习注意力权重w,通过加权操作得到调整后的全局特征g,最后借助多层感知机得到高层全局特征G。同时,为了避免原始特征的丢失,使用跳连接补全低层次的原始特征信息。在将全局特征、局部特征以及补充的原始特征信息进行拼接后,使用最大池化操作保留最显著的高层次特征,并使用多层感知机进行各分支特征的融合和增强,而后将得到的高层次的融合特征信息进行最大池化,得到用于分类的特征信息。最后,使用3个串联的全连接(fully connected,FC)层进行特征信息的分类,最终输出分类结果。

1.2 采样与归一化

为了方便后续卷积运算,减少不必要的计算量,需要对输入数据进行适当的下采样操作。目前应用较为广泛的下采样方法包括最远点采样(farthest point sampling,FPS)和随机采样(random sampling,RS)。其中,最远点采样能够实现点云上的均匀采样,但有较高的计算成本。相比之下,随机采样消耗较少的存储空间,计算开销小,且可以带来更好的泛化性。对于任意输入点云X={X1,…,Xa},其包含a个坐标点,这里使用随机采样将坐标点下采样至n个(n<a),以保证输入数据对齐。

同时,为了避免因输入样本尺度不同而影响模型分类效果,需将输入点云样本归一化为单位球。归一化方法具体为

式中,o为归一化后的圆心,通过计算每个点的坐标的平均值求得,pi为归一化后Xi对应的坐标,n为采样后点云中坐标点的个数。

1.3 基于空间结构图卷积的局部特征编码

边卷积是目前应用最为广泛的局部特征提取方法,相对位置信息的引入使得边卷积具有更强的空间结构建模能力。使用边卷积进行局部特征提取包含以下两个操作:局部邻域构建和特征信息编码。

1.3.1 局部邻域构建

对于任意一个点云p={p1,…,pn},其包含n个采样点。每一个采样点pi包含自身坐标信息(x,y,z),用于描述该点的空间位置。首先将点云p转化为图结构,具体为

式中,V表示图中各个顶点,E表示图结构中的各条边。目前,图结构的构建大多使用K 近邻(K-nearest neighbor,KNN)算法,通过计算查询点pi与点云中其余各点的欧氏距离筛选K个邻接点{,…}组成pi的局部邻域。点云p的图结构表示由若干个局部邻域合并而成,邻域结构如图2 所示。图中,查询点pi对应图结构中的顶点,pi与之间的有向边对应图结构中的边。

图2 K近邻图Fig.2 K-nearest neighbour graph

1.3.2 特征信息编码

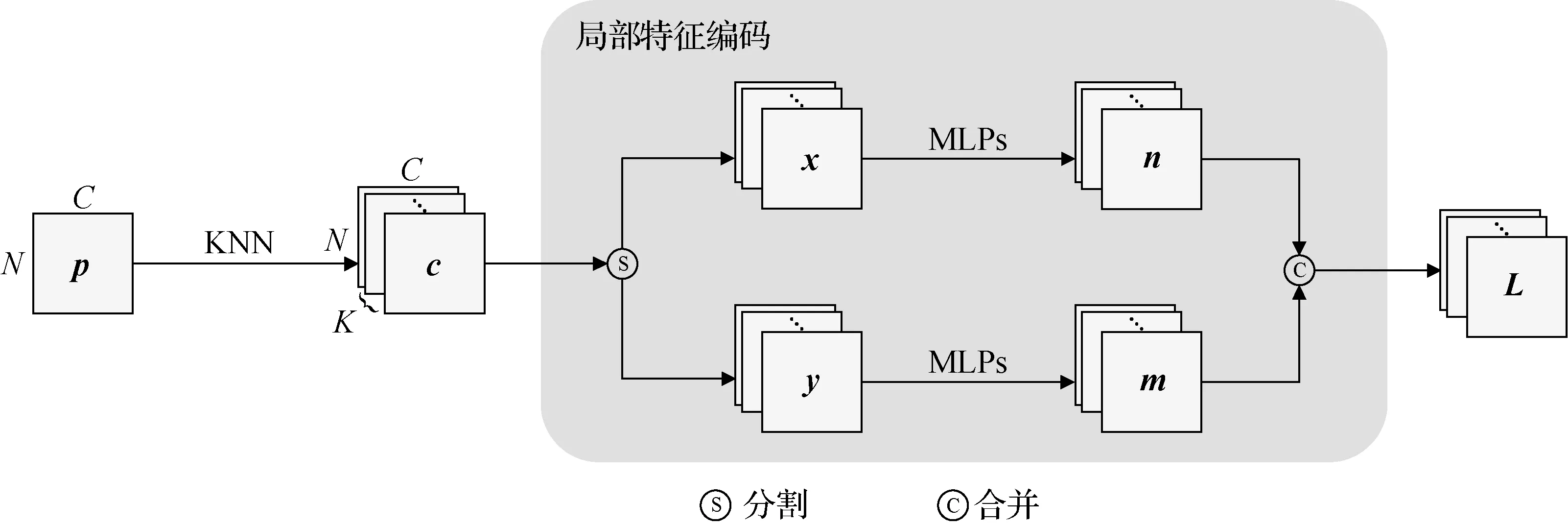

边卷积将查询点坐标信息、查询点与邻接点间相对位置向量拼接后作为原始输入特征,有效合并了全局和局部语义特征,增强了局域内几何结构的表达能力。然而在点云结构相似时,相对位置信息的引入可能会造成特征编码过程中原始输入信息的相似度过高、所提取的特征区分度低的问题。针对这一问题,提出一种空间结构卷积(spatial structure convolution,SSConv),首先在边卷积输入数据的基础上增加邻接点之间的相对位置向量,使得原始输入特征更具差异性。其次,从位置、结构两个方面分别进行特征编码,使得网络模型能够学习到更具区分度的特征表示,局部特征编码部分的网络结构如 图3所示。

图3 局部特征编码Fig.3 Local feature encoding

定义查询点pi对应的邻接点为,对应的局部特征信息为Li,则Li的特征提取过程为

式中,SSConv表示空间结构卷积操作,由若干多层感知机实现,Concat表示拼接操作。ci为点pi对应局部邻域的原始特征,由pi的坐标信息的坐标信息、pi与的相对位置信息以及与的相对位置信息拼接所得,且当j=1时取值为0。

在特征提取过程中,提出了与边卷积不同的编码方式,将特征编码过程划分为两个分支:位置编码分支和结构编码分支。位置编码分支使用多层感知机对坐标信息pi和进行单独编码,以获得更加丰富的位置特征信息ni,用于描述各点的空间位置;结构编码则单独对相对位置向量进行编码来学习局部邻域内的结构信息mi,用于描述局部邻域的整体几何结构。特征提取操作的定义为

式中,ni表示位置特征信息,mi表示结构信息,MLPs表示若干个串联的多层感知机。对于任意特征bi,多层感知机定义为

最后,通过拼接操作将位置特征信息ni与结构信息mi进行合并,作为pi对应的局部特征信息Li

图4 所示为原始特征的对比,图4(a)为边卷积使用的原始输入特征,图4(b)为空间结构卷积使用的原始输入特征。从图中可以看出,在点云结构相似时,边卷积的原始特征具有较高的相似度,可能会导致网络模型提取到相似特征,致使分类结果错误。

相比之下,空间结构卷积能够有效增大输入特征的差异性,能够包含更具多样性的位置和关系信息。同时在进行局部特征编码时,邻接点间相对位置信息的引入提供了更加丰富的局部结构信息,使得提取到的高层次语义信息具有更强的空间结构表达能力。本文将在后续实验中对两种原始特征的相关性做进一步的评估和分析。

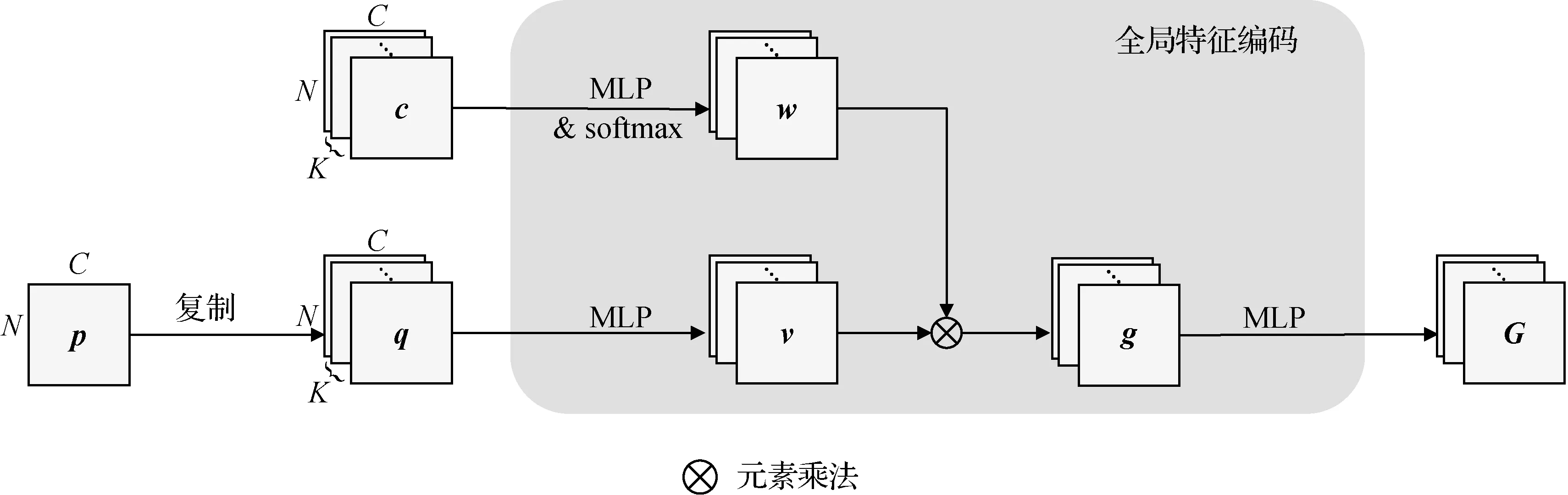

1.4 基于注意力机制的全局特征编码

经过局部特征提取模块,点云局部位置与结构特征被充分学习,但缺少全局范围内的上下文信息。对此,使用多层感知机从原始坐标信息中提取高层次的全局语义信息。为了使局部特征和全局特征具有相同的维度,方便后续加权操作,这里首先扩展pi的维度,得到全局编码部分的输入特征qi,而后使用多层感知机将其映射为浅层特征vi,作为点云中各点的全局特征信息。具体为

为了实现特征表示间的融合,在全局编码过程中引入注意力机制。现有方法通常从全局特征中学习注意力权重并在此基础上为局部特征加权,但这一操作可能会造成原始特征信息的丢失。与现有方法不同,为了实现全局特征与局部特征之间的信息融合,同时保留原始特征信息,提出一种使用局部特征信息指导全局特征信息学习的注意力加权方法。

首先使用多层感知机将局部特征整体映射为高维度特征并从中提取潜在的特征信息,而后使用softmax 函数计算相应特征的注意力得分,用于表示单个邻域内K个邻接点对中心点的影响程度。随后,将全局特征v={v1,…,vn}与注意力权重w={w1,…,wn}进行对应元素之间的相乘,得到由局部特征加权的全局特征信息gi,全局特征提取模块的网络结构如图5所示。

图5 全局特征编码Fig.5 Global feature encoding

假设点pi对应的局部邻域原始特征信息为ci,其对应的注意力权重wi的计算方式为

首先使用多层感知机将其映射为高维特征,并使用softmax 函数进行归一化处理,计算出对应特征的注意力权重系数w,第i个特征向量的注意力权重系数为wi。而后将求得的注意力权重与扩展后的全局特征进行对应元素相乘,得到自适应调整后的全局特征信息,具体为

式中,wi为注意力权重,vi为全局特征向量,∗表示矩阵对应元素相乘,gi为加权后的全局特征。

最后,使用一层多层感知机将gi映射为高维特征,作为全局特征提取模块的输出特征。具体为

2 实验与分析

2.1 实验环境与参数设置

实验在Ubuntu16.04 系统下进行,使用NVIDIA Tesla V100 显卡进行模型参数的训练。实验所用的网络模型均使用PaddlePaddle 深度学习框架实现,在训练过程中,使用Adam(adaptive moment estima⁃tion)优化器并设置权重衰减为0.000 1,初始学习率设置为0.001,且使用余弦退火策略在每轮训练后动态调整学习率,学习率最小值设置为0.000 1,批处理大小设置为32,每个实验网络模型均进行100轮的训练。

在网络结构方面,模型中使用的多层感知机由卷积层、批归一化层和激活层串联构成,其中激活层使用LeakyReLU(leaky rectified linear unit)作为激活函数,x负半轴斜率设置为0.01。局部特征编码部分使用的多层感知机均为3 层的串联结构,输出特征维度分别为16、64、128;全局特征编码部分使用的多层感知机为单层结构,其中作用于局部邻域原始特征信息c和全局坐标信息q的多层感知机输出特征维度为16,作用于加权特征v的多层感知机输出特征维度为32;特征信息分类部分使用的多层感知机为两层结构,输出特征维度分别为512 和1 024,使用的线性层输出特征维度分别为512、256和40,dropout层的丢弃概率设置为0.5。

2.2 数据集与评价指标

ModelNet40数据集是目前应用最为广泛的点云分类数据集,其包含40 类共12 311 个由CAD(com⁃puter aided design)模型转换的三维模型。其中,9 843 个模型划分为训练集,其余2 468 个模型为测试集,每个点云模型包含2 048个点。

在性能评估方面,使用总体准确率(overall accuracy,OA)和平均准确率(mean accuracy,mAcc)对分类效果进行评估,计算方式为

式中,T为正确预测的点云数量,Ti为第i类正确预测的点云数量,N为测试集中点云总数,Ni为第i类的点云数量,K为数据集中类别总数。

2.3 模型整体性能评估

为了评估分类性能,将提出的模型与4 种基于逐点多层感知机的方法、2 种基于卷积的方法、2 种基于图卷积的方法和4 种基于注意力机制的方法进行对比,结果如表1所示。

表1 ModelNet40数据集上进行分类的实验结果对比Table 1 Comparison of classification results on ModelNet40 dataset

表1 列出了本文模型和现有模型在ModelNet40数据集上进行分类的平均准确率和总体准确率。从表1 得知,所提模型在总体准确率为93.0%,达到最优性能,平均准确率则达到89.7%。在分类总体准确率方面,本文模型相比Point Transformer 高出0.2%,相比PointWeb 高出0.7%,相比PointCNN 高出0.8%,对比实验的结果表明,本文模型在点云分类任务上具有较强的性能。

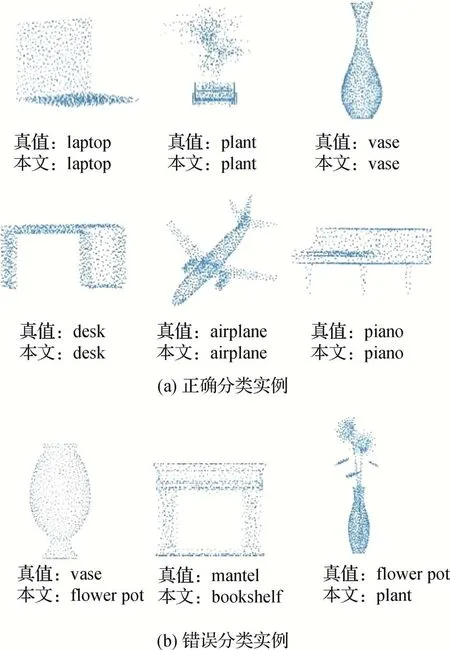

部分实例对应的真值和分类结果如图6 所示。部分实例的分类结果出现错误,如将花瓶(vase)识别为花盆(flower pot)、将壁炉(mantel)识别为书架(bookshelf),输入实例的几何形状较为相似可能是导致这一问题的主要原因。

图6 部分实例分类结果Fig.6 Partial instance classification results((a)examples of correct classification;(b)examples of misclassification)

为了进一步检验本文模型对各类实例的分类效果,将所提出模型的分类结果与PCT(point cloud Transformer)(Guo 等,2021a)、GBNet(geometric backprojection network)(Qiu 等,2022)的分类结果进行对比,并使用混淆矩阵对各类实例的分类结果进行可视化。在总体分类效果方面,PCT 模型和GBNet 模型的总体准确率分别为93.2%和93.4%,效果均略优于本文模型。

表2 所示为上述3 个模型对各类实例的分类结果。结果表明,本文模型与其他两个模型相比在识别床(bed,标签为2)、杯子(cup,标签为10)等类别时有更高的准确率。以杯子类为例,本文模型的分类准确率为80%,相比PCT 高出15%,相比GBNet 高出30%。然而,在识别梯子(stairs,标签为31)、壁炉(mantel,标签为21)等类别时准确率较差。此外,3 个模型在对花盆(flower pot,标签为15)进行识别时均存在较大的误差,模型通常会错误地将花盆识别为植物(plant,标签为26)或花瓶(vase,标签为37)。

表2 部分类别分类准确率对比Table 2 Comparison of classification results for some categories

除对比分类效果外,还对比了模型的参数量和每秒浮点运算次数(floating-point operations per sec⁃ond,FLOPs)。得益于简单的分支结构和由多层感知机组成的编码模块,整体网络模型与现有模型相比有更少的参数量和FLOPs,如表3 所示,本文模型与Point Transformer 相比降低了93.8%的参数量和79.2%的FLOPs 值。对比结果表明,本文模型有更高的分类效率。

表3 模型参数量和FLOPs值对比Table 3 Comparison of the number of parameters and FLOPs

2.4 消融实验

2.4.1 K近邻点个数设置

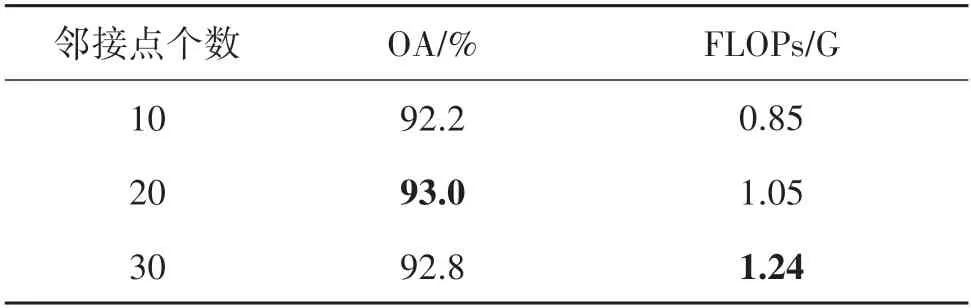

在使用K 近邻算法时,邻接点个数K的取值直接影响模型提取到的局部特征的质量,过小的取值将造成邻域感受野过小,使得结构特征的提取不够充分,直接影响到分类精度;过大的取值则会引入更多的噪声信息,同时也会导致模型参数过大,整体预测效率下降。对此,设计实验验证K的最优取值,结果如表4 所示。可以看出,在K取值为20 时能够更好地捕获局部几何特征,使得网络具有更好的分类效果。

表4 邻接点个数K对分类效率和效果的影响Table 4 Influence of the number of K on classification efficiency and effect

2.4.2 空间结构卷积有效性

为了验证使用空间结构卷积进行局部特征提取的实际效果,将本文模型中的空间结构卷积模块替换为边卷积模块,并进行分类效果的对比,实验结果如表5 所示。实验结果表明,模型使用空间结构卷积时的总体准确率提高了0.6%,平均准确率提高了0.7%,与使用边卷积相比有更好的性能,这主要得益于空间结构卷积的输入数据包含邻接点的坐标信息和相对位置信息。邻接点相对位置信息的引入一方面丰富了原始特征,使得局部邻域对物体几何信息的描述更加充分;另一方面,也增大了邻域间的特征差异性,使得网络能够学习到更具区分度的特征表示。

表5 空间结构卷积与边卷积的效果对比Table 5 Effect of SSConv and EdgeConv

2.4.3 注意力加权操作有效性

设计实验验证注意力加权方式对分类效果的影响,分类结果如表6 所示。其中模型A 不包含注意力加权操作,直接将全局坐标映射为高维特征并作为全局特征编码部分的输出,总体准确率为92.8%。模型B 为使用全局特征加权局部特征,由于缺少原始全局特征信息,总体准确率仅为87.1%。模型C使用局部特征为全局特征加权,总体准确率为93.0%,相比模型A 提高了0.2%,相比模型B 提高了5.9%。结果表明,所提出的注意力加权方式实现了局部与全局特征之间的交互和融合,保留了原始特征信息,有效关联了局部与全局特征表示。

表6 注意力加权操作有效性Table 6 Effect of attention weighting

2.4.4 特征差异性

设计实验对空间结构卷积与边卷积的原始特征相似性进行验证。分别使用特征间的欧氏距离(Euclidean distance)、余弦距离(cosine distance)及相关距离(correlation distance)对特征的相似度进行评价。特征间的相对距离越大,表明特征间的差异性越强。

在实验中,生成两组相似的二维点并分别使用边卷积和空间结构卷积计算原始特征信息,而后计算两组信息之间的距离并进行求和,计算结果如表7 所示。可以看到,在两组点的邻域结构相似时,二者空间结构卷积输入特征间的欧几里得距离、余弦距离和相关距离分别为74.309、2.179 和2.535,明显大于二者边卷积输入特征间的相对距离,表明空间结构卷积能够有效地增强原始输入特征间的差异性。

表7 空间卷积与边卷积输入特征差异性对比Table 7 Comparison of input feature differences between SSConv and EdgeConv

为进一步验证SSConv 在增大特征差异性方面的效果,设计实验提取SSConv和EdgeConv的输出特征,并在经过T-SNE 降维和归一化处理后对特征进行可视化,结果如图7所示。

图7 特征可视化Fig.7 Feature visualization((a)laptop;(b)plant;(c)glass box)

若图中所示实例中两个点的颜色相同,则表明两点的特征是相同的。具体来说,以笔记本电脑实例为例,使用EdgeConv 学习的特征在屏幕部分呈现相同颜色,表明这一区域坐标点对应的特征基本相同。相比之下,使用SSConv 学习到的特征在屏幕部分存在颜色变化,表明这一区域的特征间存在一定的差异性。综上,可视化结果表明,SSConv 的输出特征更具差异性。

2.4.5 分支有效性

为了验证模型各个分支的有效性,将模型拆分为结构编码、位置编码和全局特征编码3 部分,并通过不同的组合形式构建网络模型进行性能对比,结果如表8 所示。可以看出,模型A 仅使用邻接点与查询点、邻接点与邻接点之间的相对位置进行局部特征编码,导致点云原始坐标信息的丢失,分类的总体准确率为92.0%。模型B 使用查询点和邻接点的坐标信息进行局部特征编码,保留了原始点云特征,但缺乏局部结构信息的捕获能力,分类的总体准确率为92.7%。模型C 仅对局部特征进行编码,局部特征与全局特征缺少信息互补和融合,分类的总体准确率为92.9%。最后,模型D 充分提取了局部特征和全局特征信息,并通过注意力机制实现了特征间的信息互补,具有较强的局部结构特征捕获能力和全局特征表达能力,分类的总体准确率为93.0%。

表8 各分支结构有效性验证Table 8 Effect of each branch structure

2.5 鲁棒性验证

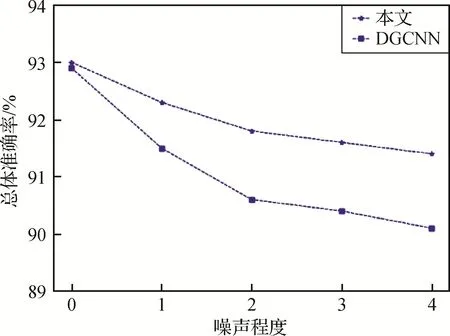

为验证噪声对模型的影响,在原始数据上增加不同幅度的高斯噪声,并在本文所提出网络模型和DGCNN 模型(Wang 等,2019)上进行分类效果验证和结果对比,实验结果如图8 所示。图中横轴所示为所添加噪声的程度,数值越大表明噪声幅度越大。纵轴表示分类总体准确率。当噪声程度为4 时,本文模型和DGCNN 模型的分类总体准确率分别下降1.6%和2.8%。结果表明,所提出的网络模型对噪声具有一定的鲁棒性。

图8 噪声对分类结果的影响Fig.8 The impact of noise on classification results

3 结论

本文针对特征编码过程输入数据相似度高、特征信息提取不充分等问题,提出一种结合空间结构卷积和注意力机制的点云分类网络,并通过实验验证网络性能,实验结果表明:1)提出的网络模型达到了较好的分类效果,在ModelNet40 数据集上的分类总体准确率为93.0%,平均准确率为89.7%,优于现有方法。2)提出的空间结构卷积能够有效增大输入特征差异性,使得模型能够学习到更具多样性的物体局部特征表示。与使用EdgeConv 方法相比,分类总体准确率提高了0.6%。3)提出的基于注意力机制的全局特征编码方法能够实现有效的特征适应性调整,能够充分挖掘局部与全局特征信息之间的联系,注意力机制的引入使得分类总体准确率提高0.2%。

综上所述,本文提出的模型具有良好的分类性能,但仍存在一定不足。在特征信息聚合部分,本文使用的最大池化操作仅保留最突出特征,容易造成细粒度几何结构信息的丢失。因此,如何在保证特征信息不丢失的情况下对邻域内的特征进行有效聚合将是后续工作的重点研究内容。