增强推荐系统可解释性的深度评论注意力神经网络模型

2023-11-29魏楚元王梦珂户传豪张桄齐

魏楚元,王梦珂,户传豪,张桄齐

增强推荐系统可解释性的深度评论注意力神经网络模型

魏楚元1*,王梦珂2,户传豪2,张桄齐2

(1.北京建筑大学 电气与信息工程学院, 北京 102616; 2.北京建筑大学 机电与车辆工程学院, 北京 102616)( ∗ 通信作者电子邮箱weichuyuan@bucea.edu.cn)

为了提高推荐系统(RS)的可解释性,打破推荐系统固有的局限性,提升用户对推荐系统的信任度和满意度,提出一种增强可解释性的深度评论注意力神经网络(DRANN)模型。该模型利用用户评论与商品评论中丰富的语义信息,基于文本评论学习用户、物品之间的潜在关系,预测用户兴趣偏好和情感倾向。首先,采用文本卷积神经网络(TextCNN)对词向量作浅层特征抽取;然后,使用注意力机制为评论数据分配权重,过滤无效评论信息,同时构建深度自编码器模块将高维稀疏数据降维,去除干扰信息,学习深层语义表征,增强推荐模型的可解释性;最后,通过预测层得到预测评分。在4个公开数据集(Patio、Automotive、Musical Instrument (M-I)和Beauty)上的实验结果表明,与概率矩阵分解(PMF)模型、奇异值分解++(SVD++)模型、深度协同神经网络(DeepCoNN)模型、树增强嵌入模型(TEM)、DeepCF(Deep Collaborative Filtering)、DER(Dynamic Explainable Recommender)相比,DRANN模型的均方根误差(RMSE)最小,验证了它在提升性能上的有效性以及所采用解释策略的可行性。

推荐系统;深度学习;可解释性推荐;注意力机制;自编码器

0 引言

互联网的迅猛发展使用户对数据的依赖越来越强,同时也带来了严重的“信息过载”问题,用户很难从大量数据中快速找到有效信息,信息使用效率反而下降。推荐系统(Recommender System, RS)[1]作为一种自动筛选信息的方式,是当前研究中解决信息过载问题的重要方法之一。它利用网络平台获取用户和物品的交互数据,再通过分析用户的历史行为对用户的兴趣偏好建模,然后根据模型计算得出候选物品评分并排序,主动为用户做出个性化推荐,满足用户需求并有效发掘长尾信息。

近年来,深度学习技术飞速发展,成了数据挖掘领域的重要研究方法,并用于推荐系统模型的构建,为提高推荐系统的性能发挥了重要作用[2]。然而,深度神经网络的“黑盒”问题也引起了广泛关注,用户在关心推荐系统准确度的同时也在关注推荐结果的可解释性。推荐系统涉及多个利益相关者,用户不仅希望能得到推荐,还希望获知推荐的理由。因此,推荐系统的可解释性尤为重要。尽管解释的需求方不同,但都具有相同的解释目的[3],即推荐的信任度、准确度和满意度。

随着电商平台功能的不断丰富和扩展,用户评论能够更加真实、准确地反映用户偏好。评论包含用户对产品使用的反馈、对产品性能的实际评价等信息,并包含用户的情感倾向,提高对评论信息的利用程度,能够提高推荐的准确性和用户的可信度。通过对同类商品评论信息的分析,用户对推荐结果的理解能够更直观,从而能提升用户对系统所具备解释性的认同感。

如图1所示是亚马逊平台上不同用户对同一产品的评价,评论A和评论B对同一物品给出了相反的使用感受,评论C提出了更多的选购需求。用户对同一物品的评价表明用户在产品选择中的侧重点、情感倾向以及附加需求。在面对没有历史行为的新用户时,也可以根据相关物品评价的优劣程度为用户推荐。

图1 亚马逊平台用户对商品的评论

由于传统方法只能捕捉用户与对象之间的线性关系,在评分预测的学习中忽略了深度学习强大的表示能力。同时,与仅隐式使用交叉特征的传统推荐相比,基于文本信息的推荐可以更直观地解释推荐原因。因此,利用丰富的评论文本信息可以有效缓解推荐系统固有的局限性,提高推荐的准确度以及帮助用户对推荐系统解释方式的进一步理解。基于这个思路,本文从用户的心理需求出发,提出一种深度评论注意力神经网络(Deep Review Attention Neural Network,DRANN)模型。该模型从用户的历史评论数据中挖掘用户偏好及商品属性,结合注意力机制筛选有效评论数据,刻画用户、商品画像,同时引入循环神经网络编码器-解码器(Recurrent Neural Network Encoder-Decoder,RNN Encoder-Decoder)学习深度语义特征,以此设计可解释的推荐算法。本文的主要工作为:

1)融入文本评论信息。加入辅助信息指导模型学习,打破评分数据稀疏的局限。采用文本卷积神经网络(Text Convolutional Neural Network,TextCNN)深度挖掘评论文本潜在特征,理解用户兴趣偏好,提升模型推荐准确度。

2)提出了DRANN模型。通过两部分并行的深度神经网络学习特征向量,不再是传统的单一模式。利用注意力机制为对应的评论数据特征向量分配权重,过滤无效的评论信息,结合语义特征获得预测向量。

3)设计了RNN Encoder-Decoder用于学习文本评论的深层语义特征。在推荐过程中提供隐式解释,通过有效评论和物品属性推断用户偏好,帮助用户理解模型所具备的可解释性如何体现。

1 相关工作

1.1 主流推荐算法

目前,推荐系统主要有以下几类:基于内容的推荐[4]、协同过滤(Collaborative Filtering,CF)推荐[5]、基于知识的推荐[6]、基于深度学习模型的推荐[7]等。CF算法是一种经典的推荐系统算法,主要利用属性信息,如用户ID、购买过的商品等挖掘用户偏好,从而为用户推荐预测分值较高的物品;但该方法还存在数据稀疏和泛化能力弱等问题。针对CF存在的缺陷,Yu等[8]提出了矩阵分解(Matrix Factorization, MF)算法,结合隐语义和机器学习的特性,提升了模型处理稀疏矩阵的能力;但MF模型训练时间较长,且MF采用将用户和物品隐射到隐因子空间的方式学习,缺乏对推荐系统的解释性,降低了模型的推荐性能[9]。区别于前面两类推荐方法,基于知识的推荐垂直领域本身,通过知识的交互,能增加项目之间的信息关联。

与传统模型相比,深度学习的方法能够更有效地捕获用户与候选物品之间的关系并提供最优选择。如Zhang等[10]针对隐因子模型(Latent Factor Model, LFM)提出了对应的显因子模型(Explicit Factor Model, EFM),利用用户评论抽取物品的显式特征提高算法的精度,在向用户进行推荐的同时为用户解释推荐的理由,从而更好地帮助用户作出决策,提高用户对系统的信任度。

历史的“点击”“浏览”等行为包含大量的冗杂数据,无法保证每次操作都代表用户的真实意图,也无法捕捉并更新用户实时变化的喜好。因此,受多方面因素影响,传统推荐模型所采用的方法使推荐系统不具备可解释性。

1.2 可解释性推荐系统

可解释性推荐概念最早是推荐过程可以通过用户熟悉的其他项目解释[11]。例如用户正在看的这个产品与他曾购入的商品相似,便可以做出推荐[12],这也奠定了CF的基本思想。

可解释性推荐的相关研究不断尝试深入挖掘文本数据的有效信息,如Xiao等[13]将EFM扩展到张量分解,提出了AFM (Attentional Factorization Machines)模型,可以学习和调整用户对不同项目特征的注意力分布,从文本评论中提取产品特征;Tao等[14]利用树结构解释推荐,该方法在选定的功能前添加预定义的修饰符,以构建基于模板的解释;Gao等[15]提出了一种可解释的深度多视图学习框架,用于建模并解释多层次特征,并且还采用了基于功能的模板提供解释;Costa等[16]利用长短期记忆(Long Short-Term Memory, LSTM)模型生成句子解释,通过训练大量的用户评论数据,使模型在提供推荐决策的同时生成合理的解释语句;Li等[17]利用门控循环单元(Gated Recurrent Unit, GRU)为Yelp中的推荐餐馆生成提示,根据预测的评分,该模型可以生成相应的提示以帮助用户了解推荐项目的关键特征;Lu等[18]提出了多任务推荐模型,该模型利用多个任务共同学习的方式得出评分预测和推荐解释,其中解释模块采用对抗性序列对序列学习技术编码,生成和区分用户和项目评论,并且在训练过程中生成器也可以生成句子解释。同时,用户的注意力分布也可以作为推荐的解释。如双重注意力机制(Dual Attention-based, D-Attn)[19]模型在卷积神经网络(Convolutional Neural Network, CNN)的基础上引入两种词级别的注意力机制:局部注意力机制(Local Attention)和全局注意力机制(Global Attention),为不同的词赋予不同权重,筛选更精确的语义表示,提高了模型的解释性能;NARRE(Neural Attentional Regression model with Review-level Explanations)[20]通过计算用户和商品的特征表示预测评分,同时在计算过程中采用分配注意力权重的方法筛选有效的评论信息。

2 模型设计

DRANN的结构如图2所示。该模型主要分为两大模块:左侧部分为文本评论处理模块,提取评论中的语义信息,并融入用户和物品特征,采用注意力机制过滤无效评论信息;右侧部分采用深度自编码器学习隐藏语义信息,利用RNN编码器-解码器重构高维稀疏数据,学习语义信息中的潜在特征之后融合两部分数据送入预测层,得到预测评分。

图2 DRANN模型结构

2.1 文本评论处理模块

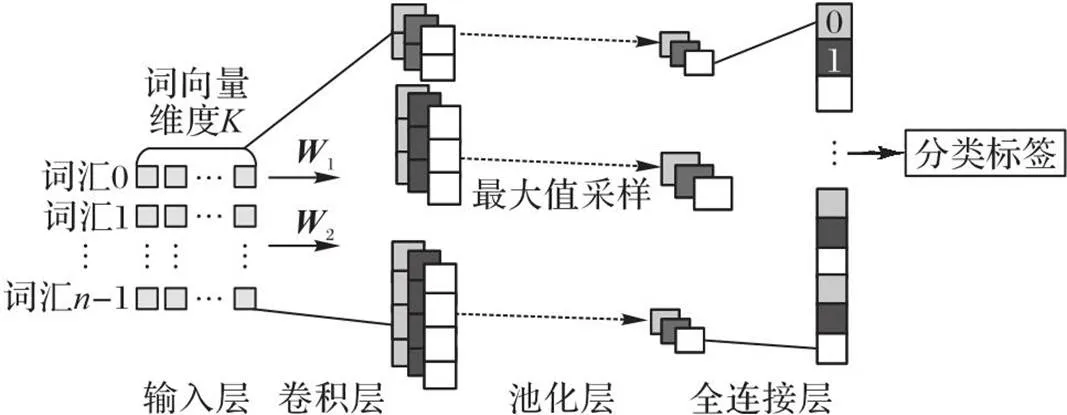

用户对物品的评论信息能最直接反映用户的喜好。给定固定长度为的原始文本评论集{R1,R2, …,R},经过嵌入层被映射为对应的词向量矩阵{1,2,…,}。本文采用TextCNN处理词向量矩阵,能够有效抽取文本浅层特征,抽取的局部特征可以看作是由多个词组成的滑动窗口,所以它的本质是一个-Gram[21]模型。

图3 TextCNN结构

用大小为的卷积滤波器提取上下文特征。如式(1)所示:

2.2 深度自编码器文本处理模块

深度自编码[23]是一种无监督学习技术,主要作用是特征降维,将文本评论中的高维稀疏数据转化为低维的潜在数据特征,同时去除了高维数据中的干扰部分。

在每次迭代过程中自编码器权重矩阵按式(9)更新:

近年来,各种网络业务发展快速,SNS已经成为推动经济社会发展的基础信息设施。各种新式功能层出不穷,高速发展的背后是日常使用中隐藏的危险漏洞,而更不容易发现的,是因为隐私悖论导致的信息泄露。本文重点分析了在SNS中基于共享性原则产生的隐私悖论,以及如何利用该问题发现社会工程学的可攻击点和具体利用方法。本文希望可以通过使用自动化工具snsmap,为研究此类问题以及进行抗社会工程学攻击测试提供便利,从而推动对隐私悖论的不断研究,保护个人隐私与网络环境的健康发展。

2.3 预测层

其中:、表示局部偏移量;表示全局偏移量。为使预测值和真实值的差值最小,本文采用的损失函数表达式如下:

图4 编码器-解码器流程

3 实验与结果分析

3.1 数据集

实验采用亚马逊开源数据集(http://jmcauley.ucsd.edu/data/amazon/),该数据库涉及从1996年5月到2014年7月的评级和评论数据,包含电子商务各个领域。该数据集被分为不同的子数据集,本文使用其中4个验证本文模型的性能,分别为:Patio、Automotive、Musical Instrument (M-I)和Beauty,这些数据集涵盖不同领域,具体交互数据记录如表1所示。

实验将所用数据集按8∶1∶1划分为训练集、验证集和测试集,用训练集数据训练模型,将模型在验证集上得到的数据作为反馈,调节参数,测试数据用于对训练好的模型测试。实验中,使用维度大小为300的Word2Vec向量初始化词嵌入。使用Adam 函数优化目标函数,初始化学习率设置为0.005,卷积核大小设置为3。为防止过拟合,在实验中设置了正则化部分,并将dropout值设为0.5。

表1 数据集信息

3.2 评价指标

实验使用推荐系统中广泛使用的均方根误差(Root Mean Square Error, RMSE)评估模型的性能。RMSE值计算的是预测数据与原始数据对应样本误差平方和的均值,能够衡量预测值和真实值之间的偏差,相比之下,均方根误差能够更好地反映测试的准确性。评价指标计算如下:

3.3 对比模型

为了评估模型性能,将本文模型与概率矩阵分解(Probabilistic Matrix Factorization, PMF)[26]模型、奇异值分解++(Single Value Decomposition++, SVD++)模型[27]、深度协同神经网络(Deep Cooperative Neural Network, DeepCoNN)模型[28]、树增强嵌入模型(Tree-enhanced Embedding Model, TEM)[29]、DeepCF(Deep Collaborative Filtering)[30]、DER(Dynamic Explainable Recommender)[31]等6种基准模型比较。

1)PMF:该模型是一种传统的矩阵分解模型,对用户和项目的隐藏向量建模以预测分数,反映预测的准确性。

2)SVD++:该模型基于SVD模型,引入隐式反馈向量,参考任意形式的用户历史数据帮助获取用户的兴趣偏好。

3)DeepCF:该模型结合了表示学习和匹配方程学习两种方法的优点,通过搭建深度学习网络预测用户-物品交互矩阵。

4)DeepCoNN:该模型使用神经网络对用户和项目联合建模,将文本数据表示成词向量,学习语义情感的同时提升评分预测的准确度。

5)TEM:该模型将传统的基于树的模型与神经网络相结合,通过探索用户和物品的属性特征生成推荐并提供解释。

6)DER:该模型使用深度学习方法联合建模用户和商品的评论信息,通过突出显示评论数据中最有效的评论信息对推荐结果作出解释。

3.4 实验结果及分析

不同模型的数据对比结果如表2所示。可以看出,PMF在相关数据集上的实验结果最差,因为PMF只对用户和物品建模,而没有添加任何有效的辅助信息丰富建模过程,这也验证了评论数据中确实包含能够指导推荐的信息。SVD++模型主要利用评分矩阵做出预测,在实际应用中性能下降,因而实验结果并不理想。与DeepCF模型相比,DeepCoNN模型除了在M-I数据集上的结果较差外,在其他数据集上性能均优于DeepCF模型,这是因为在DeepCoNN的建模过程中加入了文本信息,并使用文本注释联合建模用户行为和产品属性,而M-I数据集中的用户数和评论交互数相对较少,引起的“过拟合”问题导致了效果变差。TEM引入了基于树的模型挖掘用户项目和属性,提供可信的解释信息。而DER模型应用了最新的对评论信息联合建模的方式预测推荐结果,相较于其他模型得到了更好的实验结果。DRANN模型中引入的注意力机制和自编码器协同工作,利用注意力机制更好地过滤无效的文本评论信息,增大有用评论所占权重,为用户在推荐过程中提供了解释,通过自编码器学习隐藏的语义关系,充分发挥评论信息的作用,有效提高模型的推荐及解释性能,在实验中的RMSE最小。

表2 Amazon数据集上不同模型的RMSE对比

3.5 结果分析

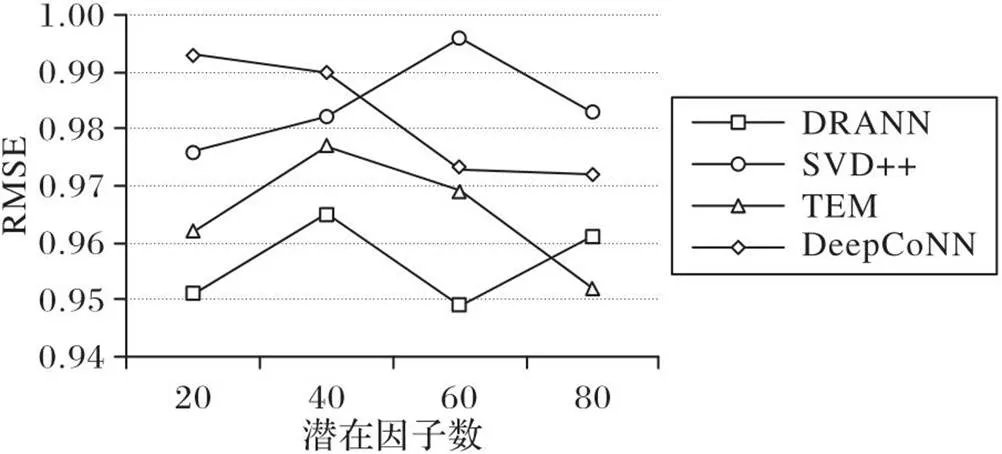

1)参数敏感性分析。本文在{5×10-5,5×10-4,5×10-3,5×10-2,5×10-1,5×100}的范围和{0.1,0.3,0.5,0.7,0.9}的范围中测试权重参数。对于TextCNN在卷积层中滤波器的窗口大小可以是3、4、5,其中每个窗口过滤器数量为100。此外,将预先训练的词向量维度设置为300,默认潜在因子数为64,同时正则化dropout值设置为0.5。图5选取了其中三个模型与DRANN在M-I数据集上的结果进行比较:在潜在因子数小于80时,DRANN模型都达到了较好的性能;潜在因子数大于80时,由于过拟合引起模型性能在合理范围内产生了波动。进一步观察到增加潜在因素的数量并不一定会提高准确性,因为太多的潜在因素会导致过度拟合。

图5 M-I数据集上的RMSE比较

2)消融实验。DRANN模型增加了RNN编码器-编码器学习隐藏的语义信息。为验证所加模块在学习文本评论信息隐藏语义特征上的有效性,进行消融实验,考虑了没有添加RNN编码器-编码器时的RMSE值,结果如表3所示。由表3可知,在3个不同的数据集上加入了RNN编码器-编码器后的RMSE明显小于未加入时的值,这说明加入RNN编码器-编码器学习有效提升了模型性能,表明了模型结构的可行性。

表3 深度编码器对模型RMSE的影响

4 结语

历史评论信息是用户偏好和购买兴趣的重要反映,了解预测背后的原因对于评估信任度也非常重要。本文提出的DRANN模型的主要思想是从用户评论信息和产品评论信息中提取特征,这在一定程度上为理解用户偏好和兴趣提供了解释。引入注意力机制聚合有效特征,可以过滤掉无用的评论信息;添加自编码器学习文本评论中的隐藏信息可以提高语义特征的丰富度并提高推荐过程的准确性。在不同数据集上的实验结果验证了本文模型的可行性。但是,在复杂的语义环境下,随着干扰因素的增加,模型对于语义信息的提取也会存在一些偏差。当前研究表明,增加神经网络的层数、扩大模型深度等方法都具备进一步提升模型性能的可能性,在后续的研究中还可以尝试更深层的神经网络结构优化模型以提升性能。

[1] 于蒙, 何文涛, 周绪川,等.推荐系统综述[J].计算机应用,2022,42(6):1898-1913.(YU M, HE W T, ZHOU X C, et al. Review of recommender system [J]. Journal of Computer Applications, 2022, 42(6): 1898-1913.)

[2] MU R H. A survey of recommender systems based on deep learning[J]. IEEE Access, 2018, 6: 69009-69022.

[3] 田添星.评论情感分析增强的深度推荐模型[J].计算机应用与软件,2022,39(8):258-264.(TIAN T X. Comment sentiment analysis enhanced deep recommendation model [J]. Computer Applications and Software, 2022, 39(8):258-264.)

[4] BOZANTA A, B KUTLU. HybRecSys: content-based contextual hybrid venue recommender system[J]. Journal of Information Science, 2019, 45(2): 212-226.

[5] LI X F, LI D. An improved collaborative filtering recommendation algorithm and recommendation strategy[J]. Mobile Information Systems, 2019, 2019(13): No.3560968.

[6] CENA F, CONSOLE L, VERNERO F. Logical foundations of knowledge-based recommender systems: a unifying spectrum of alternatives[J]. Information Sciences, 2021, 546(1): 60-73.

[7] YOO H, CHUNG K. Deep learning-based evolutionary recommendation model for heterogeneous big data integration[J]. KSII Transactions on Internet and Information Systems, 2020, 14(9): 3730-3744.

[8] YU H T, GAO R B, WANG K, et al. A novel robust recommendation method based on kernel matrix factorization[J]. Journal of Intelligent & Fuzzy Systems, 2017, 32(3): 2101-2109.

[9] 田震,潘腊梅,王睿,等.深度矩阵分解推荐算法[J].软件学报,2021,32(12):3917-3928.(TIAN Z, PAN L M, WANG R, et al. Deep matrix factorization recommendation algorithm [J]. Journal of Software, 2020.32 (12): 3917-3928.)

[10] ZHANG Y F, CHEN X. Explainable recommendation: a survey and new perspectives[J]. Foundations and Trends in Information Retrieval, 2020, 14(1): 1-101.

[11] RAWAT S, TYAGI U, SINGHAL S. Recommender systems in e-commerce and their challenges[C]// Proceedings of the 2021 3rd International Conference on Advances in Computing, Communication Control and Networking. Piscataway: IEEE, 2021: 1598-1601.

[12] ROY A, BANERJEE S, SARKAR M, et al. Exploring new vista of intelligent collaborative filtering: a restaurant recommendation paradigm[J]. Journal of Computational Science, 2018, 27(1): 168-182.

[13] XIAO J, YE H, HE X, et, al. Attentional factorization machines: learning the weight of feature interactions via attention networks [C]// Proceedings of the 26th International Joint Conference on Artificial Intelligence. Menlo Park, CA: AAAI Press, 2017: 3119-3125.

[14] TAO Y Y, JIA Y L, WANG N,et al. The FacT: taming latent factor models for explainability with factorization trees[C]// Proceedings of the 42nd International ACM SIGIR Conference on Research and Development in Infromation Retrieval. New York: ACM, 2019: 295-304.

[15] GAO J Y, WANG X T, WANG Y S, et al. Explainable recommendation through attentive multi-view learning[C]// Proceedings of the 33rd AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2019:3622-3629.

[16] COSTA F, OUYANG S, DOLOG P, et al. Automatic generation of natural language explanations [C]// Proceedings of the 23rd International Conference on Intelligent User Interfaces Companion. New York: ACM, 2018: No.57.

[17] LI P J, WANG Z H, REN Z C, et al. Neural rating regression with abstractive tips generation for recommendation[C]// Proceedings of the 40th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM, 2017: 345-354.

[18] LU Y C, DONG R H, SMYTH B. Why I like it: multi-task learning for recommendation and explanation[C]// Proceedings of the RecSys 12th ACM Conference on Recommender Systems. New York: ACM , 2018: 4-12.

[19] SEO S, HUANG J, YANG H, et al. Interpretable convolutional neural networks with dual local and global attention for review rating prediction[C]// Proceedings of the 11th ACM Conference on Recommender Systems. New York: ACM, 2017: 297-305.

[20] CHANG C, MIN Z, LIU Y Q, et al. Neural attentional rating regression with review-level explanations[C]// Proceedings of the 27th International World Wide Web Conference. New York: ACM, 2018: 1583-1592.

[21] LIU S, DEMIREL M F, LIANG Y. N-gram graph: simple unsupervised representation for graphs with applications to molecules[C]// Proceedings of the 33rd International Conference on Neural Information Processing Systerms. Red Hook, NY: Curran Associates Inc., 2019: 8466-8478.

[22] JI S, SATISH N, LI S, et al. Parallelizing Word2Vec in shared and distributed memory[J]. IEEE Transactions on Parallel and Distributed Systems, 2019, 30(6): 2090-2100.

[23] 陶文彬, 钱育蓉,张伊扬,等.基于自编码器的深度聚类算法综述[J].计算机工程与应用,2022,58(18):16-25.(TAO W B, QIAN Y R, ZHANG Y Y, et al. Survey of deep clustering algorithms based on autoencoder [J] Computer Engineering and Applications, 2022, 58(18): 16-25.)

[24] CHO K, VAN MERRIËNBOER B, GU̇LÇEHRE Ç, et al. Learning phrase representations using RNN encoder-decoder for statistical machine translation[C]// Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing. Stroudsburg: ACL, 2014: 1724-1734.

[25] 梁志贞,张磊.面向Kullback-Leibler散度不确定集的正则化线性判别分析[J].自动化学报,2022,48(4):1033-1047.(LIANG Z Z, ZHANG L. Regularized linear discriminant analysis based on uncertainty sets from Kullback-Leibler divergence[J]. Acta Automatica Sinica, 2022, 48(4): 1033-1047)

[26] SALAKHUTDINOV R, MNIH A. Probabilistic matrix factorization[C]// Proceedings of the 20th International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2007: 1257-1264.

[27] 陈佩武,束方兴.基于SVD++隐语义模型的信任网络推荐算法[J].大数据,2021,7(4):105-116.(CHEN P W, SHU F X. A recommender algorithm based on SVD++ model under trust network[J]. Big Data Research, 2021, 7(4): 105-116.)

[28] ZHENG L, NOROOZI V, YU P S. Joint deep modeling of users and items using reviews for recommendation[C]// Proceedings of the 10th ACM International Conference on Web Search and Data Mining. New York: ACM, 2017:425-434.

[29] WANG X, HE X N, FENG F L, et al. TEM: tree-enhanced embedding model for explainable recommendation[C]// Proceedings of the 2018 World Wide Web Conference. Republic and Canton of Geneva, Switzerland: International World Wide Web Conferences Steering Committee, 2018:1543-1552.

[30] DENG Z H, HUANG L, WANG C D,et al. DeepCF: a unified framework of representation learning and matching functionlearning in recommender system[C]// Proceedings of the 2019 33rd AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2019: 61-68.

[31] CHEN X, ZHANG Y F, QIN Z. Dynamic explainable recommendation based on neural attentive models[C]// Proceedings of the 33rd AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2019:53-60.

Deep review attention neural network model for enhancing explainability of recommendation system

WEI Chuyuan1*, WANG Mengke2, HU Chuanhao2, ZHANG Guangqi2

(1,,102616,;2,,102616,)

In order to improve the explainability of Recommendation System (RS), break the inherent limitations of recommendation system and enhance the user’s trust and satisfaction on recommender systems, a Deep Review Attention Neural Network (DRANN) model with enhanced explainability was proposed. Based on the potential relationships between users and items on text reviews, the rich semantic information in user reviews and item reviews was used to predict users’ interest preferences and sentiment tendencies by the proposed model. Firstly, a Text Convolutional Neural Network (TextCNN) was used to do shallow feature extraction for word vectors. Then, the attention mechanism was used to assign weights to comment data and filter invalid comment information. At the same time, the deep autoencoder module was constructed to reduce the dimension of high-dimensional sparse data, remove interference information, learn deep semantic representation, and enhance the explainability of recommendation model. Finally, the prediction score was obtained through the prediction layer. Experimental results on the four public data sets including Patio, Automotive, Musical Instrument (M‑I) and Beauty show that DRANN model has the smallest Root Mean Square Error (RMSE) compared with Probabilistic Matrix Factorization (PMF), Single Value Decomposition++ (SVD++), Deep Cooperative Neural Network (DeepCoNN), Tree-enhanced Embedding Model (TEM), DeepCF (Deep Collaborative Filtering) and DER(Dynamic Explainable Recommender), verifying its effectiveness in improving performance and the feasibility of the adopted explanation strategy.

Recommendation System (RS); deep learning; explainability recommendation; attention mechanism; autoencoder

1001-9081(2023)11-3443-06

10.11772/j.issn.1001-9081.2022101628

2022⁃10⁃31;

2023⁃03⁃17;

教育部人文社会科学研究一般项目(22YJAZH110)。

魏楚元(1977—),男,湖北武汉人,副教授,博士,CCF高级会员,主要研究方向:自然语言处理、数据挖掘; 王梦珂(1999—),女,陕西汉中人,硕士研究生,主要研究方向:深度学习、推荐系统; 户传豪(2000—),男,山东菏泽人,硕士研究生,主要研究方向:深度学习、推荐系统; 张桄齐(1996—),男,山西晋中人,硕士研究生,主要研究方向:深度学习、推荐系统。

TP389.1

A

2023⁃04⁃04。

This work is partially supported by General Program for Humanities and Social Sciences Research of Ministry of Education (22YJAZH110).

WEI Chuyuan, born in 1977, Ph. D., associate professor. His research interests include natural language processing, data mining.

WANG Mengke, born in 1999, M. S. candidate. Her research interests include deep learning, recommendation system.

HU Chuanhao, born in 2000, M. S. candidate. His research interests include deep learning, recommendation system.

ZHANG Guangqi, born in 1996, M. S. candidate. His research interests include deep learning, recommendation system.