以未成年人为中心的人工智能何以实现?*——基于“儿童人工智能”项目的思考

2023-11-28郭胜男吴永和

郭胜男 吴永和

以未成年人为中心的人工智能何以实现?*——基于“儿童人工智能”项目的思考

郭胜男 吴永和[通讯作者]

(华东师范大学 教育信息技术学系,上海 200062)

在AI技术促进数字化转型的时代,未成年人正面临着以ChatGPT为代表的生成式AI带来的风险和挑战。当前,AI治理战略中对未成年人的关注仅提及了教育资源和健康资源,而鲜少就未成年人的成长和数字权益展开讨论。基于此,文章首先分析了发展以未成年人为中心的AI驱动因素。之后,围绕联合国儿童基金会与其他国际组织合作展开的“儿童人工智能”项目,文章系统梳理了以未成年人为中心的AI国际行动和实践方向,以深度剖析AI技术如何保护、支持和赋能儿童。最后,文章基于人本主义理论,从技术、伦理、未成年人三个维度出发,提出了我国发展以未成年人为中心的AI新路径,包括鼓励参与式设计、坚持伦理化治理、优化数字教育环境等。文章旨在维护未成年人的数字权益,并培养未成年人适应未来数字世界的能力,以驱动教育数字化转型的持续推进。

人工智能;以未成年人为中心;AI治理;数字化转型;人本主义

引言

在数字化转型背景下,以人工智能(Artificial Intelligence,AI)为“头雁”的数字技术给社会大环境和人类的生产生活带来了重大变革。2022年底,美国OpenAI公司发布对话式大型语言模型ChatGPT(Chat Generative Pre-trained Transformer),引燃了新一轮AI革命[1]。事实上,以ChatGPT为代表的生成式AI,在一定程度上具备了语言理解、推理和自我学习的能力,AI技术由此进入“能思考会理解”的认知智能阶段[2]。学界对“未成年人”的界定各有不同,如《儿童权利公约》认为儿童是指十八岁以下的任何人[3],《中华人民共和国未成年人保护法》规定未成年人是指未满十八周岁的公民[4],世界经济论坛(World Economic Forum,WEF)则将儿童和青少年均归属为身体和大脑尚在发育中的未成年人[5]。而在现阶段,未成年人是在AI构筑的世界里成长起来的一代人,他们所获取的教育资源越来越多地由AI应用程序主导[6]。因此,当ChatGPT、Watsonx等AI技术对教育数字化转型产生冲击时,未成年人也不可避免地会卷入新一轮AI变革的浪潮中。

综合来看,现阶段AI治理策略研究虽围绕AI政策、伦理原则和问责制度达成了广泛的社会共识,却鲜少围绕未成年人的成长和数字权益展开研究。2020年1月,联合国儿童基金会(United Nations International Children’s Emergency Fund,UNICEF)在芬兰政府的支持下,与IEEE标准协会、伯克曼克莱因互联网与社会中心、世界经济论坛、五权基金会等国际组织合作,推出了“儿童人工智能”(AI for Children)项目(下文简称“儿童AI项目”)。该项目通过设置全球论坛、政策指南、试点测试等模块,致力于发展以儿童为中心的AI,了解AI如何保护、支持和赋能儿童。基于对此项目的思考,本研究以未满十八岁的未成年群体(包括儿童和青少年)为对象,从人本主义视角探索我国发展以未成年人为中心的AI新路径,以维护未成年人的数字权益,培养其适应数字社会的能力,进而为推进教育数字化转型提供新思路。

一 发展以未成年人为中心的AI驱动因素

1 AI技术给未成年人带来的挑战

AI技术的广泛应用,正潜移默化地过滤着未成年人所获得的信息和服务,给未成年人的成长和发展带来挑战:①“数字鸿沟”进一步扩大。“数字鸿沟”是社会不公平在数字时代的一种反映。由于信息本身具有离散性,这对未成年人获取、掌握、运用信息的相关能力提出了更高要求,使得未成年人在理解、适应、使用AI设备和培养自身素养与技能方面存在不足,沦为“数字弱势群体”。另外,发达地区与不发达地区的数字化基础设施建设存在地域差异,贫困地区的未成年人在数字世界中往往处于不利地位。“数字鸿沟”的进一步扩大,会导致不同区域的未成年人在获得AI服务方面的差异更加显著。②未成年人的隐私安全问题。随着数字技术的发展,隐私的概念和内涵不断迭代,其边界越来越模糊,正如哲学家Tavani所言:“隐私是一个既不清楚理解也不容易定义的概念。”[7]未成年人可能不理解隐私的概念,也不具备隐私保护意识,在与AI互动时容易过多地泄露个人信息,从而加大了隐私侵害的风险。此外,未成年人隐私信息的泄露不仅侵害隐私权,还可能带来人身安全、财产安全、被定位追踪等安全威胁。③自动化决策的偏见和歧视影响了AI服务的公平性。现有AI系统的设计未能充分考虑未成年人的需求与权益,倘若用于训练AI系统的数据不能充分反映未成年人的特征,那么其决策可能会对他们产生偏见。对未成年人来说,不具有代表性、有缺陷或有偏见的训练数据和盲目使用的决策结果,均会导致AI自动化决策结果出现偏差,无法让每位未成年人公平地获得并享有AI服务。

2 人本主义理论的内在价值驱动

“以人为中心”(Human-centered)是人本主义理论的内在价值体现。人本主义理论强调“人”是哲学的出发点和归宿,主张“以人为中心,保留本源问题”,要求尊重人的生命、情感、意志、本能的意义和价值。Rogers[8]提出“以学生为中心”的教学观,强调学生的主体性和发展的全面性,给学生以尊严和自尊。Li等[9]将AI设计与人本主义理念相结合,形成了“以人为中心的人工智能”(Human-centered AI,HCAI)——HCAI将人类置于AI的核心,这代表了“第二次哥白尼革命”[10]。祝智庭等[11]强调,“人性为王”是未来教育的时代主题,无论AI技术如何发展,都应该以学习者为中心。同理,当AI的使用对象聚焦于未成年人时,HCAI便自然过渡成了“以未成年人为中心”的AI,进行AI的设计与应用时也就理应重视未成年人在认知、情感、德性伦理等方面的需求,并以可靠、安全、可信赖的方式将这些需求放大,以提高未成年人的AI参与度,促进其全面且自由地发展。

3 面向未成年人的AI治理需求

随着AI技术对社会各领域的渗透,世界各国纷纷围绕隐私、问责制、安全和保障、透明度和可解释性、公平和非歧视、人类控制和责任等主题制定治理框架、监管策略、伦理原则[12][13][14]。大多数国家的AI战略和伦理原则在提及未成年人时限于教育、健康和隐私等方面,鲜少关注AI会如何影响他们的数字权益以及如何制定有针对性的治理策略。面向未成年人的AI治理需要充分考虑未成年人身体成长、心理认知和情感方面的需求,研制专门针对未成年人的AI伦理规范,为他们提供公平的教育环境,并保护他们免受歧视、获得信息和社会参与的权利。例如,倪琴等[15]尝试构建以未成年人为中心的AI监管原则与框架,以给未成年人提供安全、可信赖的AI系统;郭胜男等[16]分析了未成年人在生理、心理认知和情感、道德伦理方面的脆弱性,构建了面向未成年人的AI安全风险治理生态系统。如前所述,“以未成年人为中心”的AI将未成年人的发展诉求和权益表达放在首位,让每位未成年人都能享受到AI带来的社会福利,并赋予他们参与AI世界的能力。可见,“以未成年人为中心”满足针对未成年人的AI治理需求。

二 以未成年人为中心的AI国际行动

1 国际行动概况

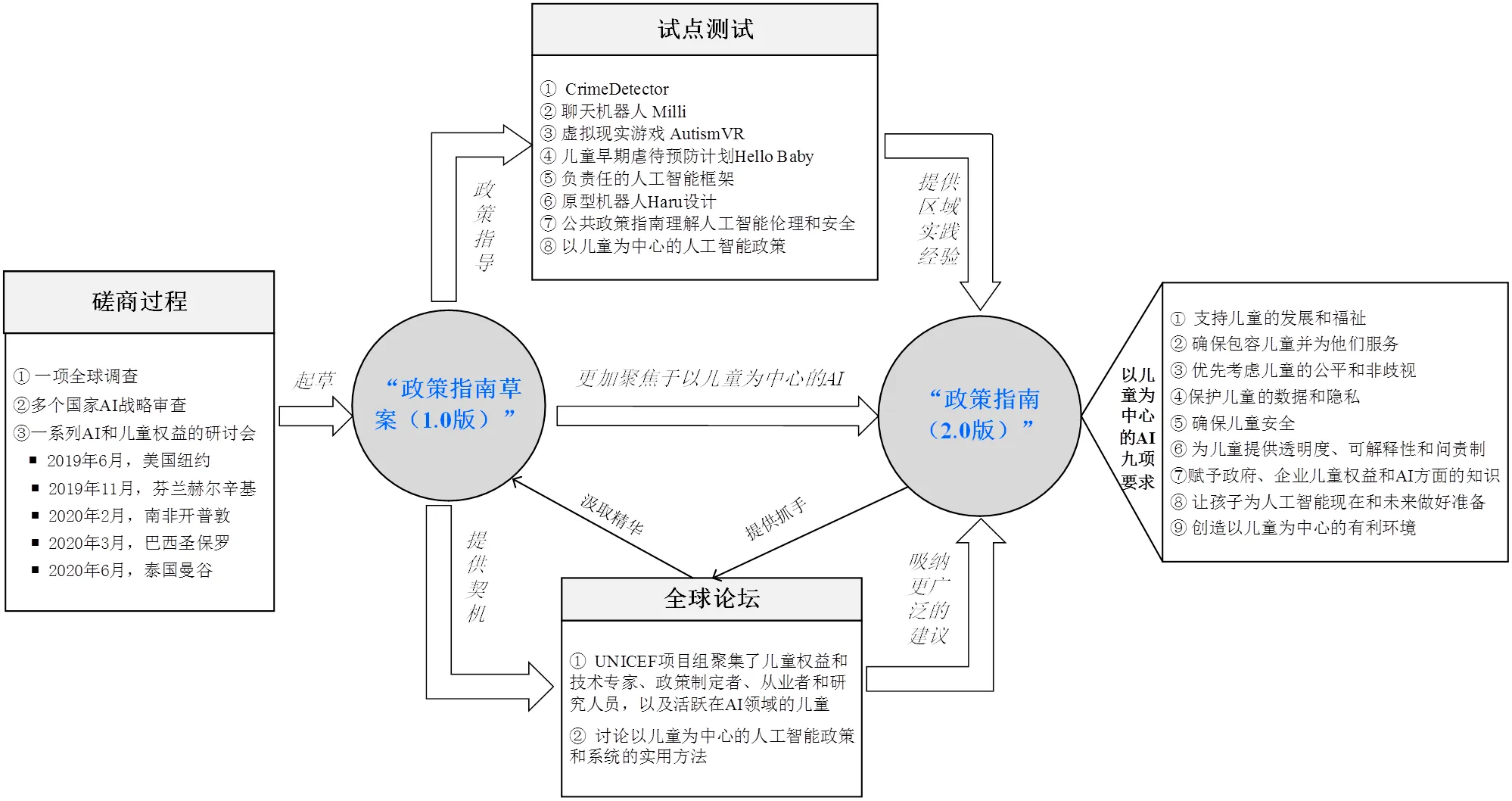

UNICEF项目组通过调研20个国家AI战略中对儿童的看法,将儿童权益纳入AI治理政策,以探索在不断发展的AI世界中保护和维护儿童权益的策略。本研究基于对儿童AI项目相关资料的梳理与分析,将其主要内容概括为全球论坛、磋商过程、政策指南、试点测试四个模块,如图1所示。具体来说,儿童AI项目首先围绕政策指南的制定与完善展开,通过一系列广泛的调查、磋商与研讨,起草“政策指南草案(1.0版)”,这被视作对以儿童为中心AI的初步贡献。随后,儿童AI项目不断汲取AI领域和儿童权益领域专家及利益相关者的意见,为“政策指南(2.0版)”的优化提供了更全面的建议,其中以儿童为中心的AI九项要求是“政策指南(2.0版)”的重点内容。为了验证政策指南的实践效果,UNICEF项目组与不同的政府和企业团体合作,在8个试点进行了测试,为“政策指南(2.0版)”提供了丰富的区域实践经验与教训。

图1 儿童AI项目概况

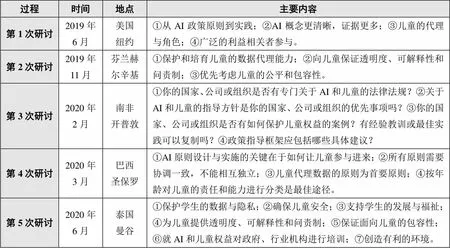

2 国际行动过程

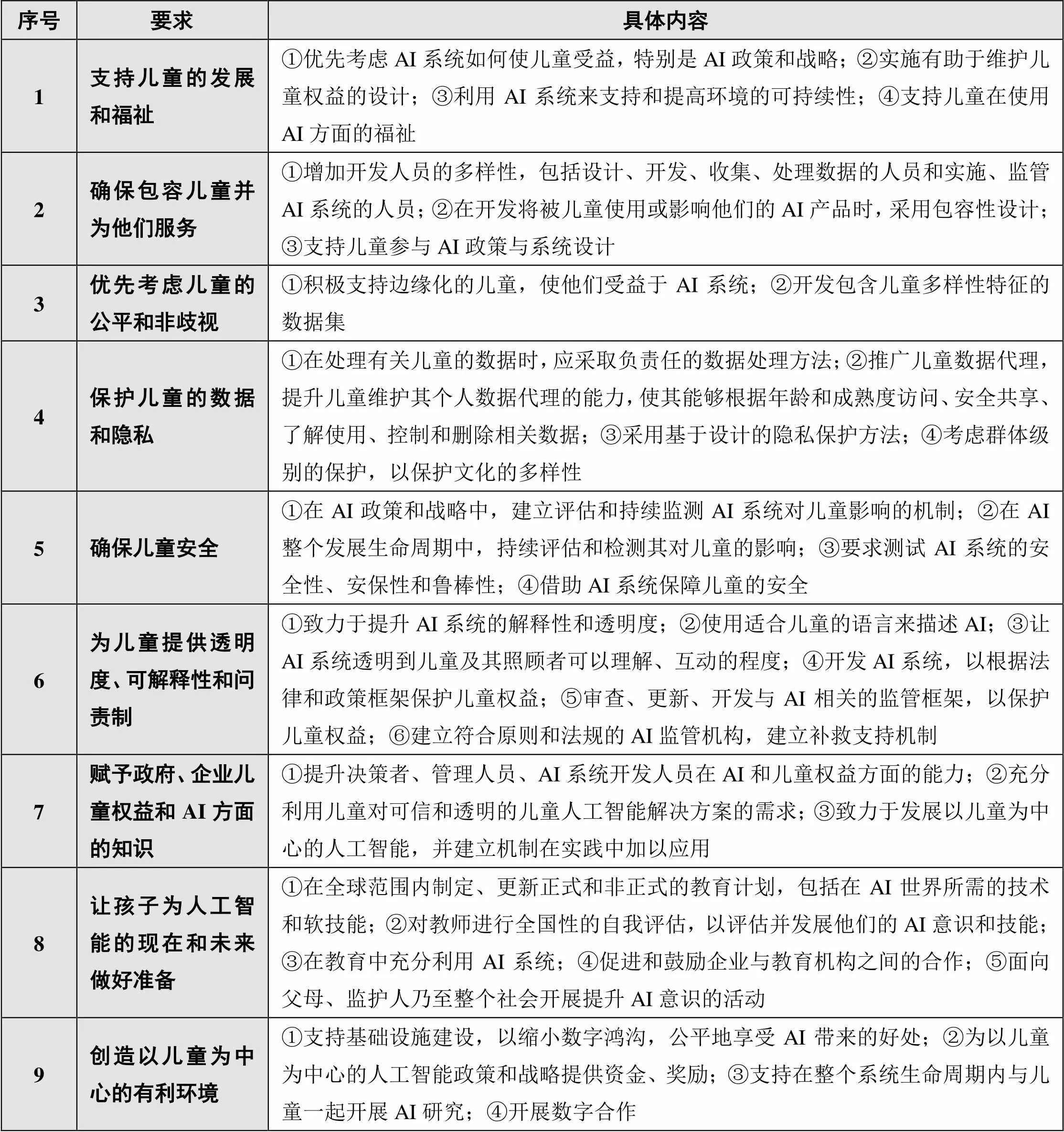

儿童AI项目的国际行动全程围绕政策指南的初步制定(草案1.0版)和优化(2.0版)进行,这一过程展现了发展以儿童为中心AI的关键。“政策指南草案(1.0版)”是通过广泛的磋商过程制定的,该过程包括一项全球调查、多个国家AI战略审查、一系列AI和儿童权益的研讨会:首先,UNICEF项目组面向全球调查AI系统如何影响儿童,之后对20多个国家的AI战略与原则进行审查,最后重点围绕以儿童为中心的政策指南草案展开研讨,不断协商并完善其内容,其中五次重要研讨的主要内容如表1所示。在广泛吸纳各方建议与丰富实践经验的基础上,“政策指南草案(1.0版)”不断优化、调整相关内容,最终修订成为“政策指南(2.0版)”。“政策指南(2.0版)”重在保障政府、私营部门AI政策和实践中的儿童权益,并深化人们对如何维护这些数字权益的认识,其中的重点内容是以儿童为中心的AI九项要求,如表2所示。

表1 五次重要研讨会的主要内容

三 以未成年人为中心的AI实践方向

随着AI技术在全球范围的深度应用,各国AI治理策略和原则出现了明显的“地域性”。为了验证政策指南的实际应用效果,引导各国AI治理工作朝着“以儿童为中心”发展,UNICEF项目组与各国政府和企业合作,依托以儿童为中心的AI九项要求,推行了“试点测试”计划。每个试点被整理成一个案例,其采取的方法、吸取的经验教训和收集的见解被用于丰富、完善政策指南。本研究通过对各案例的梳理和整合,将以未成年为中心的AI实践方向概括为:

1 促进儿童AI的包容性设计

UNICEF政策指南强调,无论年龄、性别认同、地域和文化的多样性如何,儿童都应该能够使用AI产品或服务。包容性设计让儿童、父母或监护人能够参与AI的设计过程,以最大程度地满足儿童的需求和权益,保证AI系统的公平性和非歧视性,这对发展负责任的AI至关重要。日本本田研究所和欧盟联合研究中心在合作设计原型机器人Haru时,先考虑的是儿童的观点和需求,通过让儿童参与讲故事的练习,了解他们如何看待AI伙伴的公平性,以指导将儿童权益融入到社交机器人中[17];尼日利亚的Imisi 3D公司设计了虚拟现实游戏AutismVR,其游戏设计过程采用包容性的优化方法,通过对自闭症患者儿童进行访谈和参与式测试,以父母为代理来征求儿童反馈,防止产生歧视和其他偏见[18]。可见,促进儿童AI的包容性设计可以最大化地保障儿童权益、满足他们的需求,保护他们免受歧视和不公平的伤害。

表2 以儿童为中心的AI九项要求

2 鼓励跨学科、跨领域合作与知识共享

AI技术创新给儿童带来了诸多复杂影响,涉及心理安全、情感感知、隐私安全等伦理问题,仅用单一学科的知识和方法应对这些挑战显得捉襟见肘。AI本身是一个跨学科的交叉领域,大多数试点的实践表明,只有开展跨学科、跨领域的知识共享,才能为发展以儿童为中心的AI提供更加广泛的支持。例如,芬兰的医学专家、心理学家、心理健康专家、护士和AI工程师经过多年跨学科合作,开发了一款聊天机器人Mili,将芬兰的年轻用户与有用的心理健康信息联系起来,为儿童群体提供量身定制的心理健康支持[19];瑞典AI协会、隆德大学与赫尔辛堡、隆德、马尔默三个城市展开跨领域和跨地域合作,协同评估如何将儿童AI项目的政策指南转化为具体的AI实践策略,以促进和发展以儿童为中心的AI[20]。

3 向儿童提供可解释性和问责制

AI技术的快速发展,尤其是以ChatGPT为代表的生成式AI的出现,给儿童的认知和理解带来了巨大冲击。事实上,儿童往往无法准确、全面地了解其数字权益,也不太理解何为负责任的AI。为此,芬兰的SomeBuddy公司开发了CrimeDetector系统,当儿童提交网络欺凌、网络成瘾等事件时,该系统会使用自然语言处理自动分析这些事件,并通过人机交互为受影响的儿童提供量身定制的法律和心理指导,以深化儿童对人-机协同工作的认识,落实AI系统的透明度和问责制[21];美国的“Hello Baby”倡议是一个AI驱动的儿童早期虐待预防计划,使用行政管理系统中的算法模型来确定家庭需求,每个家庭在被告知并了解该计划详情的情况下可以自主选择是否退出,这无疑提升了计划执行的透明度和可解释性。此外,“Hello Baby”团队发布了两项独立的伦理审查,以避免出现问责不清和被动同意的情况[22]。

4 参与式研究与前瞻性预测

不同国家的社会文化和语言背景不尽相同,政策指南在具体的实施过程中可能会面临“因地制宜”和“翻译中的迷失”等挑战。一方面,在文化背景不同和社会发展水平存在差异的地区,AI技术的发展及其给儿童带来的影响有所不同;另一方面,在不同的AI伦理背景下,如何理解以儿童为中心的要求并将其应用于AI系统的设计和应用也存在巨大差距。为此,各试点采用参与式研究与前瞻性预测的方法,将政策要求因地制宜地应用于实践。例如,艾伦·图灵研究所更新和扩展了英国政府于2019年发布的《理解人工智能伦理和安全指南》[23],通过探索儿童的兴趣、关注点和当前对AI的理解,指导如何将以儿童为中心的AI要求转化为可操作和负责任的保障措施;瑞典H&M集团的Responsible AI团队采用虚构场景、风险监控、道德红线等方法,以更好地预测并应对AI和数据驱动产品潜在的滥用问题[24]。

四 我国发展以未成年人为中心的AI新路径

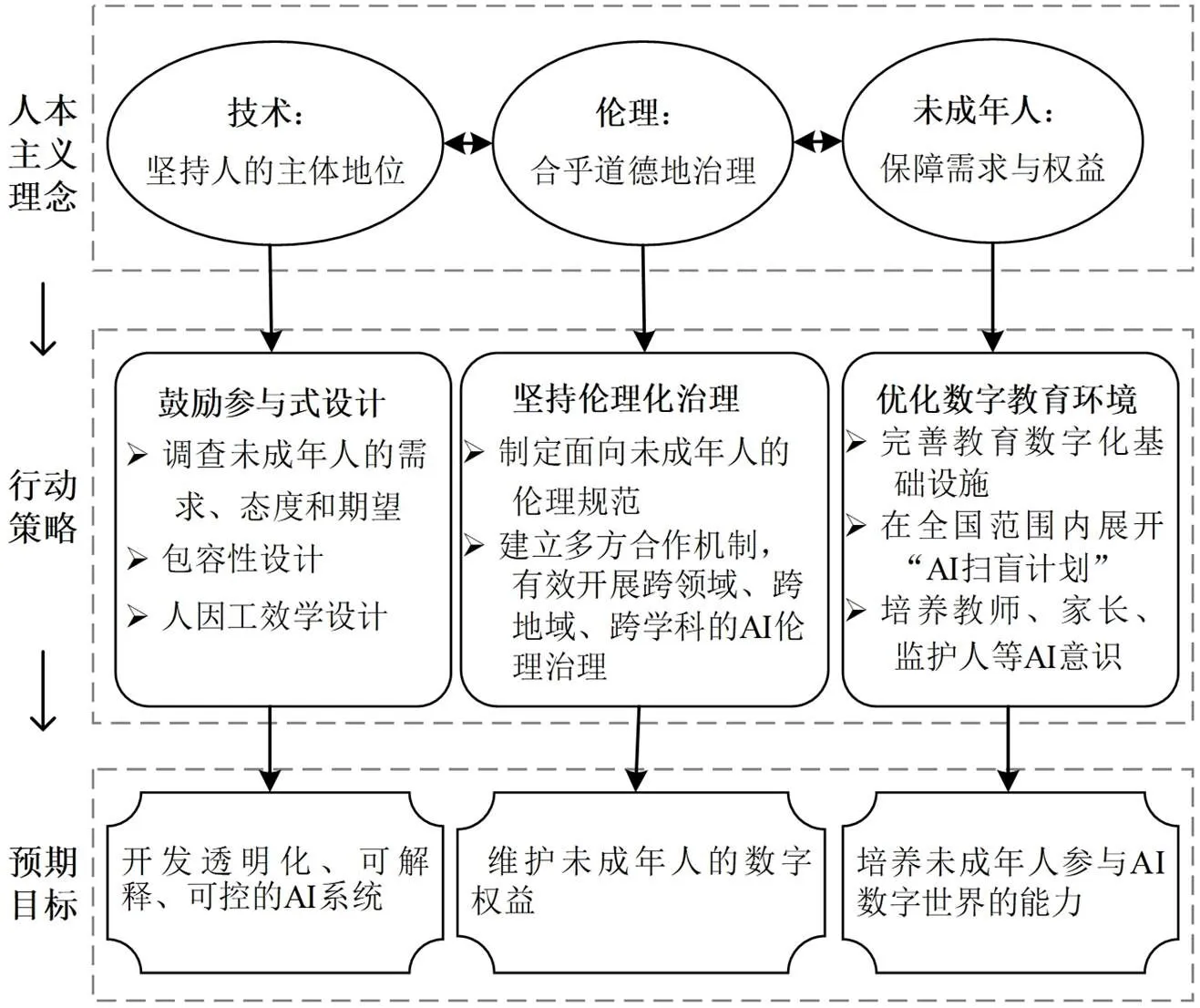

现阶段,我国针对未成年人的AI治理侧重于策略引导。例如,《面向儿童的人工智能北京共识》是我国首个针对儿童群体实施的AI细则,涵盖了以儿童为中心、保护儿童权利、承担责任、多方治理四大主题[25];《人工智能伦理安全风险防范指引》仅强调要特别关注儿童、青少年等弱势群体的个人基本权利,尚未提到具体的防范举措[26]。事实上,我国面向未成年人的AI治理仍然存在缺乏理论指导、对未成年人权益的重视不足、实践推进缓慢等问题。基于对前文AI驱动因素、AI国际行动和AI实践方向的分析,本研究提出发展以未成年人为中心的AI的关键在于如何利用技术保障未成年人的主体地位、如何使AI治理合乎道德和伦理、如何培养个人参与AI数字世界的能力。在此基础上,本研究以人本主义理念为指导,从技术、伦理、未成年人三个维度出发,提出了我国发展以未成年人为中心的AI新路径(如图2所示),以开发透明化、可解释、可控的AI系统,维护未成年人的数字权益,并培养他们参与AI数字世界的能力。

1 鼓励参与式设计,提升AI系统的可靠性

数字化转型背景下的AI世界由成年人构筑,容易产生以成年人为中心的偏见,大多数AI技术都没有考虑到未成年人。2021年,儿童AI项目组举办全球儿童论坛会,通过了解儿童对AI的不同看法和愿望,以及他们如何理解AI带来的风险和机遇,将“儿童声音”融入AI政策的制定过程[27]。可以说,未成年人参与AI系统的开发与设计,是保障未成年人主体地位的关键举措,具体包括:①在AI系统开发之前,以未成年人作为主要需求分析对象,着重考虑他们的需要、态度和期望,并将之融入设计过程;②在AI系统设计过程中,采用让所有未成年人受益的包容性设计,并通过应用更为广泛的无偏见训练数据集,使他们无论性别、年龄、能力如何均有获得AI产品或服务的机会;③引入人因工效学设计,将AI设计与用户体验设计相结合,精心设计“一目了然”的界面来减少未成年人的认知负荷。值得注意的是,未成年人的推理、推断和建立联系的认知能力仍处于发展中,需基于心智模型,根据不同年龄组的理解水平设计提示语言,从而开发适龄化、可解释和可理解的AI系统。可以说,确保未成年人参与AI系统的设计、开发和部署过程,不仅有助于开发透明化、可解释、可控的AI系统,而且能更大程度地满足他们的需求。

图2 我国发展以未成年人为中心的AI新路径

2 坚持伦理化治理,保障未成年人的数字权益

未成年人在生理、心理、情感、智力发展等方面相对弱势,AI带来的安全伦理、算法歧视、技术同化等问题在他们身上的表现尤为明显。本研究通过汲取儿童AI项目经验,坚持伦理化治理,保障未成年人的自主权、隐私权、享受非歧视等数字权益,具体的治理策略如下:①制度指导层面,全面调查我国AI系统在未成年群体中的应用现状及其潜在的伦理风险,制定面向未成年人的伦理规范(包括AI技术伦理规范和应用伦理规范),保证数据的规范化流动,进而保护他们的隐私;②实践层面,建立多方合作机制,整合AI工程师、心理和情感专家、家长及未成年人的观点,建立面向未成年人的AI治理合作平台,鼓励共享治理经验和方法,以有效开展跨领域、跨地域、跨学科的AI伦理治理。

3 优化数字教育环境,增进未成年人的AI社会参与

在AI时代,数字技术构筑的未来社会亟需高素质的AI人才。教育领域是人才培养的主要场域,而未成年人是被教育的主要对象。然而,当前的教育环境面临信息化发展水平不均衡、AI教育内容有限等难题,这与教育环境和内容的数字化建设有很大关系。为了有效发挥AI技术对教育领域的赋能作用,教育工作者需要做出以下努力:①继续完善教育数字化基础设施,消除发达地区和不发达地区在信息获取、技能学习、教育质量等方面存在的巨大差距,弥合“AI鸿沟”,使每位未成年人均能受益于AI技术,为他们提供公平的成长环境。②通过开展培养未成年人适应AI世界的教育计划,在全国范围内开展“AI扫盲计划”,一方面帮助未成年人以适合其年龄、文化背景的方式,获得AI概念和数据素养、基本的AI编程技能、理解AI伦理的态度和价值观等;另一方面,引导未成年人明晰其作为AI用户的权益,增强主动保护个人隐私与安全的意识,同时发展批判性思维、情商和技能。③通过提供免费的AI课程,培养教师、家长、监护人时刻关注未成年人生理、心理、情感、尊严、隐私等需求的AI意识。未成年人之“弱”,在于生理成长、心理认知、情感和伦理等方面的不完善,因此教师、家长、监护人有必要引导未成年人参与AI世界,并协助他们参与决策过程。可见,优化数字教育环境,弥合区域教育数字鸿沟,培养未成年人参与AI数字世界的能力,将成为推动以未成年人为中心的AI落地实践的有效策略。

[1]焦建利.ChatGPT:学校教育的朋友还是敌人?[J].现代教育技术,2023,(4):5-15.

[2]郭胜男,吴永和.社会角色理论视域下的人工智能时代教师:困厄、归因及澄明[J].电化教育研究,2022,(6):18-24、60.

[3]United Nations. Convention on the rights of the child[OL].

[4]新华社.中华人民共和国未成年人保护法[OL].

[5]World Economic Forum. Artificial intelligence for children: Parents and guardians[OL].

[6]UNICEF. AI for children[OL].

[7]Tavani H T. Privacy online[J]. SIGCAS Computers and Society, 1999,(4):11-19.

[8]Rogers C R. The foundations of the person-centered approach[OL].

[9]Li F-F, Etchemendy J. Introducing Stanford’s human-centered AI initiative[OL].

[10]Shneiderman B. Human-centered artificial intelligence: Three fresh ideas[J]. AIS Transactions on Human-Computer Interaction, 2020,(3):109-124.

[11]祝智庭,韩中美,黄昌勤.教育人工智能(eAI):人本人工智能的新范式[J].电化教育研究,2021,(1):5-15.

[12]Huq A Z. Racial equity in algorithmic criminal justice[J]. Duke Law Journal, 2019,(6):1043-1134.

[13]Leenes R, Palmerini E, Koops B J, et al. Regulatory challenges of robotics: Some guidelines for addressing legal and ethical issues[J]. Law, Innovation and Technology, 2017,(1):1-44.

[14]Taeihagh A. Governance of artificial intelligence[J]. Policy and Society, 2021,(2):137-157.

[15]倪琴,贺樑,王英英,等.人工智能向善:面向未成年人的人工智能应用监管探研——面向未成年人的人工智能技术规范研究(三)[J].电化教育研究,2023,(8):33-41.

[16]郭胜男,钱雨,吴慧娜,等.面向未成年人的AI安全风险:风险澄思、根源透析与治理进路[J].中国远程教育,2023,(7):39-46.

[17][18][19][20][21][22][23][24]UNICEF. Pilot testing ‘policy guidance on AI for children’[OL].

[25]华凌.我国首个儿童人工智能发展原则《面向儿童的人工智能北京共识》发布[OL].

[26]全国信息安全标准化技术委员会秘书处.网络安全标准实践指南——人工智能伦理安全风险防范指引[OL].

[27]UNICEF. Adolescent perspectives on artificial intelligence[OL].< https://www.ictworks.org/wp-content/uploads/2021/03/adolescent-perspectives-artificial-intelligence.pdf>

How to Achieve Minor-Centered AI?——Based on the Reflection on “AI for Children” Project

GUO Sheng-nan WU Yong-he[Corresponding Author]

In the era of AI(artificial intelligence) technology driving digital transformation, minors are facing risks and challenges brought by generative AI represented by ChatGPT. At present, the focus on minors in AI governance strategies only mentions educational resources and health resources, with little discussion on their growth and digital rights. Based on this, the paper first analyzed the driving factors for the development of minor-centered AI. Subsequently, focuing on the “AI for Children” project launched by UNICE in cooperation with other international organizations, this paper systematically combed the international action and practice direction of minor-centred AI, and deeply expounded how AI technology protected, supported, and empowered children. Finally, based on the theory of humanism, this paper proposed a new path for the development of minor-centred AI in China, including encouraging participatory design, adhering to ethical governance, and optimizing the digital education environment. This paper aimed to protect minors’ digital rights and cultivate their ability to adapt to the future digital world, thereby driving the continuous advancement of educational digital transformation.

artificial intelligence; minor-centered; AI goverence; digital transformation; humanism

G40-057

A

1009—8097(2023)11—0029—09

10.3969/j.issn.1009-8097.2023.11.003

本文为2021年度国家社会科学基金重大项目“面向未成年人的人工智能技术规范研究”(项目编号:21&ZD328)的阶段性研究成果。

郭胜男,在读博士,研究方向为智能教育与学习分析,邮箱为Shining_guo123@163.com。

2023年6月14日

编辑:小米