改进图卷积网络在复杂因素下的步态识别

2023-11-03吴冬梅赵梦琦宋婉莹

吴冬梅,赵梦琦,宋婉莹,王 静

(西安科技大学 通信与信息工程学院,陕西 西安 710600)

0 引 言

步态是一种复杂的行为生物特征,适用于远距离的人体识别[1]。在21世纪初,就有相关研究人员根据远距离步态,设计并开发了大规模的身份识别系统,系统可靠性高且稳定[2]。2017年,中国科学院自动化研究所介绍了一种新兴的生物特征识别技术——步态识别,只需要观察人的走路姿态,摄像头就可以准确识别出所属人物身份。

当前步态识别方法分为基于外观和基于模型两种方法。基于外观的方法即以步态轮廓图[1]或步态能量图[3]为输入,但二者都会受到衣着、携带物等因素的干扰,对最终的正确率产生影响。基于模型的方法分为基于人体结构建模[4]和采用姿态估计算法提取人体骨架[5],它们对携带物、视角等因素有较强的鲁棒性,但基于人体结构建模计算复杂,建立模型的准确性会有所误差;基于姿态估计算法,虽在同一视角下增强了对于衣着、携带物等因素的鲁棒性,但对于角度、衣着以及携带物等多重因素的影响,跨视角步态识别的准确率还需进一步提高。

综上所述,步态轮廓图受视角、衣着和携带物等因素的影响较大;步态能量图在压缩的过程中丢失时序信息;人体结构建模增加了计算复杂度,检测到的准确性存在一定的偏差。因此为了解决上述问题,本文采取姿态估计算法提取人体骨架,针对当前现有方法容易忽略掉骨架数据中时间与空间的联系,且对骨架的建模受到的关注较少的问题,本文提出对图卷积网络进行改进——加入了残差连接和注意力机制,通过充分挖掘骨架中的时间与空间特征,实现人体的步态识别。最终结果表明,该网络提高了衣着、携带物等因素的鲁棒性,并进一步提高了步态识别率。

1 方 法

1.1 步态识别框架

本文的改进图卷积网络的步态识别算法整体框架如图1所示,将步态数据集中的视频经过预处理提取视频帧,再利用姿态估计算法获得骨架序列,并将提取到的数据送入改进的图卷积网络中学习,最后根据所建模型对人体行走姿态进行身份识别。

图1 步态识别框架

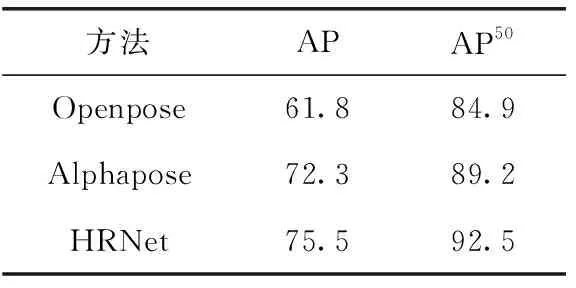

其中对于姿态估计算法,本文在对比当前流行的Alphapose[6]、Openpose[7]、HRNet[8]这3种算法的检测精度之后,比较结果见表1。为了减小后续步态识别中特征提取的失误,本文采用了精度较高的HRNet姿态估计算法,所获取的各个关节点如图2所示。

表1 姿态估计算法精度比较

图2 HRNet算法获取的人体关节点

1.2 图卷积网络

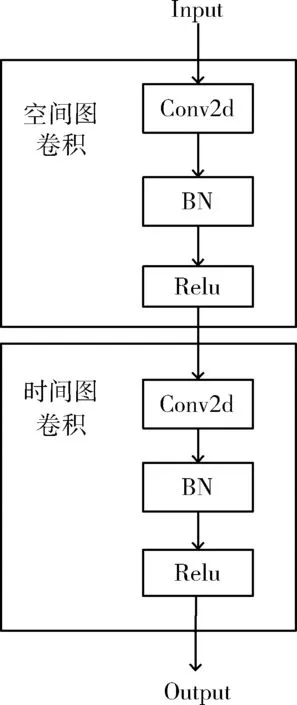

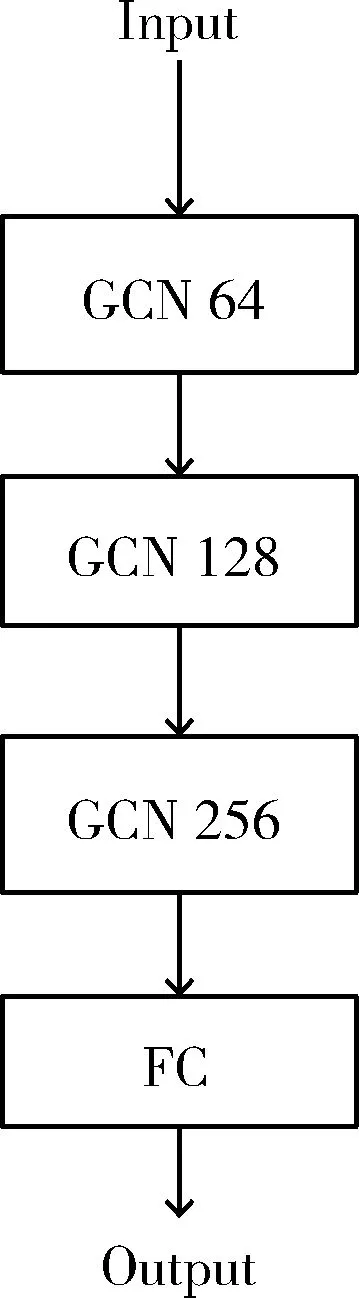

每帧中所有人体关节的二维坐标组成了步态骨架序列,由于人体骨架是一个拓扑结构,所以骨架序列中的关节点是使用时空图在时间和空间上建模的,图卷积网络基本单元和网络模型如图3和图4所示,该网络由3层基本单元组成,其中第一个图卷积单元的输出通道数为64,第二个输出通道数为128;最后一个输出通道数为256。最后由全连接层输出固定大小的特征向量。

图3 图卷积基本单元

图4 图卷积网络结构

在N帧步态骨架序列上,其中对于时空图的定义请参考文献[9]。根据文献[9]可得到骨架序列中每个帧的空间卷积计算公式

(1)

对于时间特征的提取,由于在相邻两个连续帧上的顶点对应的关节点是固定的,所以图卷积与经典的二维卷积操作相同。因此,对空间特征图进行普通的二维卷积即可提取时间特征,如图3所示。

但该网络不足的是,在步态识别中,虽然图卷积网络可以从骨架序列中提取空间和时间特征,但时间卷积是在空间域中对聚合后的图所执行的,并没有将两种特征所融合,从而削弱了在复杂因素下步态特征的丰富性,导致步态识别率下降。除此之外,网络结构层数较少,在复杂因素下很难学习到表征步态的特征。通常增加网络的深度可以学习到更加复杂的特征,但通过堆叠卷积层数加深网络又会产生过度平滑以及梯度消失的问题,据此文献[10]提出残差连接可以解决加深网络所带来的退化问题,同时也可以有效解决人体步态时空融合的问题。

2 改进的图卷积网络

所以针对上节的问题,本文提出在图卷积网络中加入残差连接。基于残差连接的图卷积网络的输入是图节点的联合坐标向量,经过多层有残差连接的图卷积生成时空特征融合的特征,然后进行步态身份识别。同时为了使模型能够找出在每个步态序列中特征较强的区域,本文还引入一个关节点注意网络,目的是为了在不受到其它关节信息的干扰下,加强关键的关节点信息,保证信息的丰富性以及完整性。

2.1 残差连接

在传统的卷积神经网络中,越复杂的特征越能表征数据的特征,通过加深网络深度能够提高特征的抽象化程度,使网络取得更好的效果。然而网络过深还引起梯度消失等问题,对此传统的卷积网络引入了残差连接,既实现了网络的加深,还有效解决了上述问题。其中,残差连接的基本公式为

H(x)=C(x)+x

(2)

其中,x为输入数据,H(x) 为输出,C(x) 为二者的差值。

图卷积网络由多层时间卷积层和空间卷积层构成,每层都经过卷积后来提取图的高级特征,仿照传统卷积网络引入残差连接的方法,本文在每层的空间卷积层和时间卷积层加入残差连接。图卷积网络结构的残差模块如图5所示。

图5 加入残差连接

其中,F、G分别为空间卷积层和时间卷积层的残差单元,T层中每个模块的空间卷积层和时间卷积层进行如下计算:

空间卷积层

(3)

时间卷积层

(4)

其中,在第T层,x1T-1表示输入,wT表示学习参数集,σ为激活函数,时间卷积层中的输入x2T-1是空间卷积层的输出。

2.2 关节点注意力机制

在以往基于外观的方法中,文献[11]提出人体不同部位在行走过程中具有明显不同的视觉外观和运动模式,因而提出了一种基于部位的模型GaitPart。在基于骨骼信息的动作识别研究中,同样也是根据身体部位的组成加入注意力机制,去发现不同身体部位在整个动作序列中的重要性[12],然而基于模型的步态识别,通过加入身体部位的注意力并不适合,因为该实验中每人的动作都是行走,实验最感兴趣的部分集中于人体的下肢,即在整个实验中,腿部的动作在整个行走过程中的重要性已一目了然,关键在于在腿部的动作中寻找每个人行走时腿部更细微的特征信息。如果只将注意力机制放在人体的两条腿上,则会忽略掉部分特征信息。所以本文提出在整个骨架序列中加入关节点注意力机制,使注意力更加集中在膝关节、踝关节以及臀部上,也会得到更加丰富的特征信息。

具体计算过程如下,在t帧时,给定一组k=17个关节点,Xt=(xt,1,…,xt,k)T, 其中xt,k∈i2, 则输出特征

Mj=α{gj2{gj1{Avgpool(xt)}}}

(5)

其中,输入数据xt表示每个步态序列中的关节点信息,gj1、gj2表示对输入数据的卷积操作,α表示激活函数。在关节中,激活越大,该关节对于确定作用类型越重要,因此激活值还称为注意权重,最后通过该权重的大小为每个关节分配不同的重要性。

加入关节点注意模型后网络结构如图6所示。

图6 加入关节点注意力

2.3 改进的图卷积网络模型

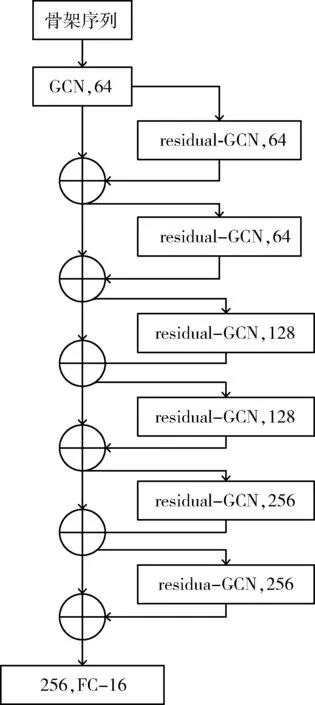

本文改进后的图卷积网络模型由7层图卷积单元构成,具体网络结构如图7所示,每一层的图卷积单元如图8所示,其中粗箭头部分为加入的残差连接,第三个模块是加入的关节点注意模型。

图7 改进的图卷积网络模型

图8 改进的图卷积单元

在该网络中,共有7个使用了残差连接的图卷积单元,每个图卷积单元的输出通道数如图7所示。经过7个图卷积单元后,输出的特征图被送到全连接层,得到一个固定大小的特征向量。

3 实 验

3.1 数据集

本文选用数据集为中科院自动化所提供的CASIA-B步态数据集,该数据集有15 004个视频,由124名受试者组成,每位受试者均从11个视角中捕获,视角范围为0°到180°,每次间隔18°。每个视角下有10个序列,包括6个正常行走(NM)、2个带包行走(BG)和2个穿着外套或夹克(CL)。总之,每个身份ID下包含11个×(6+2+2)=110个序列。图9为正常条件下行走的11个视角的序列。

图9 11个视角的行走序列

本文遵循文献[1]中流行的协议,前74个人(编号为001到074)为训练集,其余人(编号为075到124)为测试集。在测试集中,前4个正常行走的步态序列(NM01-NM04)作为注册集,其余的两个正常行走序列(NM05,NM06)、两个携带物品(BG01,BG02)以及两个穿着大衣(CL01,CL02)的步态序列作为验证集。

3.2 训练参数设置

本文所有的实验均基于pytorch框架,编程环境是Pycharm。实验共训练400个epoch,前300个epoch训练的初始学习率定为0.01,学习率衰减为0.1,权重衰减系数为0.000 01,batchsize为32;后100个epoch的学习率设定为0.000 01,学习率衰减系数、权重衰减系数与batchsize均不变。

3.3 实验结果及分析

3.3.1 无视角变化的步态识别结果

在不考虑视角变化的情况下,进行单视图步态识别的实验结果见表2~表4。

表2 NM-NM的识别率

3个表不同的是,表2的验证集为NM状态,表3是BG状态,表4是CL状态。以表2为例,表中首列是注册集中NM01-04的11个角度,首行是验证集NM05-06的11个角度,最后一列Avg是每个角度的平均识别率,每个表共有132个识别率,其中每个表的对角线上是没有视角变化的11个识别率。

表3 NM-BG的识别率

表4 NM-CL的识别率

在视角相同的条件下,分别对表2到表4对角线上的11个识别率进行求和并求均值,结果分别为95.28%、82.15%和71.9%,即为验证集NM、BG、CL下的平均识别率。将该实验结果与其它基于骨架(如LSTM与CNN相结合、Posegait、PTSN)的一些经典先进的方法进行比较,实验设置均根据文献[1]中协议所定。比较结果见表5。

表5 无视角变化时识别率比较

结果表明,在NM状态下,虽然识别率不是最高的,但是在BG、CL状态下,该平均识别率比其中最高的Posegait算法,分别高了10.89%和17.72%,足以表明该算法对于外套以及背包等遮挡物有一定的鲁棒性。

3.3.2 交叉视野下的步态识别结果

为了验证该算法对视角的鲁棒性,在第二个实验中,注册集包含了NM01-04所有的视角(0°~180°),验证集包含了NM05-06、BG01-02、CL01-02所有的视角,在该数据集的设定下,本节进行了交叉视野下的步态识别实验,实验结果见表6。

表6 交叉视野下的识别率

由表6可知,在验证集中NM、BG、CL状态下,11个视角交叉测试的平均识别率分别为84.5%、72.1%和63.3%。将该结果与当前基于外观和基于模型的一些经典先进方法(DeepCNN、SPAE、Posegait、GaitGANv2)进行比较,比较结果见表7。

表7 交叉视角下的识别率对比

表7结果对比表明,本文提出的方法在BG和CL状态下的平均识别率分别达到了72.1%和63.3%,其中在BG状态下与当前先进结果不相上下,CL状态下超过了17.85%的先进结果。该方法和Posegait方法都采用人体姿态估计对步态建模,但本文方法不仅考虑到了人体行走时的时间和空间特征,还加强了对关节动作局部特征的学习能力。但是当验证集为NM状态时,我们的实验结果虽优于Posegait和GaitGANv2,但是低于基于外观方法的DeepCNN和SPAE算法。分析原因可能是从2D视频中提取的关键点所携带的信息相较于步态能量图来说较少,且在有的视角下由于自遮挡或是视频分辨率的影响使关键点没有被全部完整检测出来,而导致步态信息的丢失。实验结果表明,该算法可有效应对携带物和衣着情况等复杂因素的变化,并且该方法在跨视角的场景中也具有较好的泛化能力,但后续仍需继续提高姿态关键点的提取精度以提高步态识别率。

3.3.3 消融实验

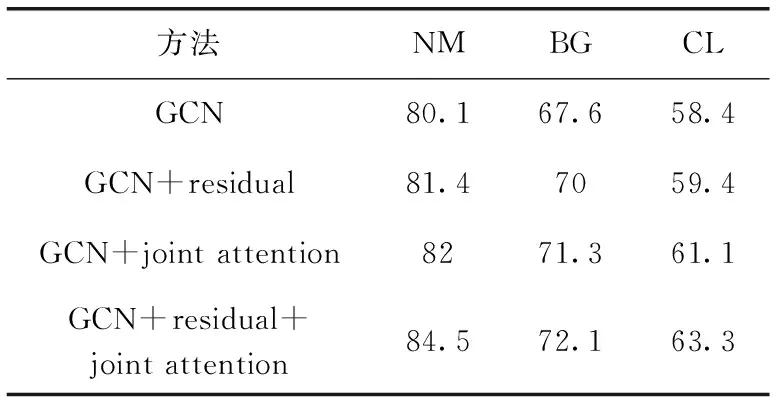

为了评估加入残差连接和关节点注意机制的有效性,本文在交叉视野下做了消融实验,分别去除残差连接和注意力机制,实验结果见表8。

表8 不同网络结构识别率对比

由表8中结果对比可知,本文提出的各部分方法对步态识别的结构都有一定的提升。在对GCN加了残差连接之后,NM、BG和CL状态下的识别率比原GCN提高了1.3%、2.4%和1.7%。可以看出通过加入残差连接加深网络的深度可有效提高步态识别的识别率,说明该方法有效;给原网络加入注意力机制后,NM、BG、CL条件下的识别率比GCN分别提高了1.9%、3.7%和2.7%,而且在加入残差连接的网络上又提高了0.6%、1.3%和0.7%。这说明该注意力机制通过增大关节点特征的权重,提升了步态特征的表现能力,从而提高了准确率。综上实验可得,本文算法在步态识别中有较强的识别效果,同时在复杂因素下鲁棒性较强。

3.3.4 仿真实验

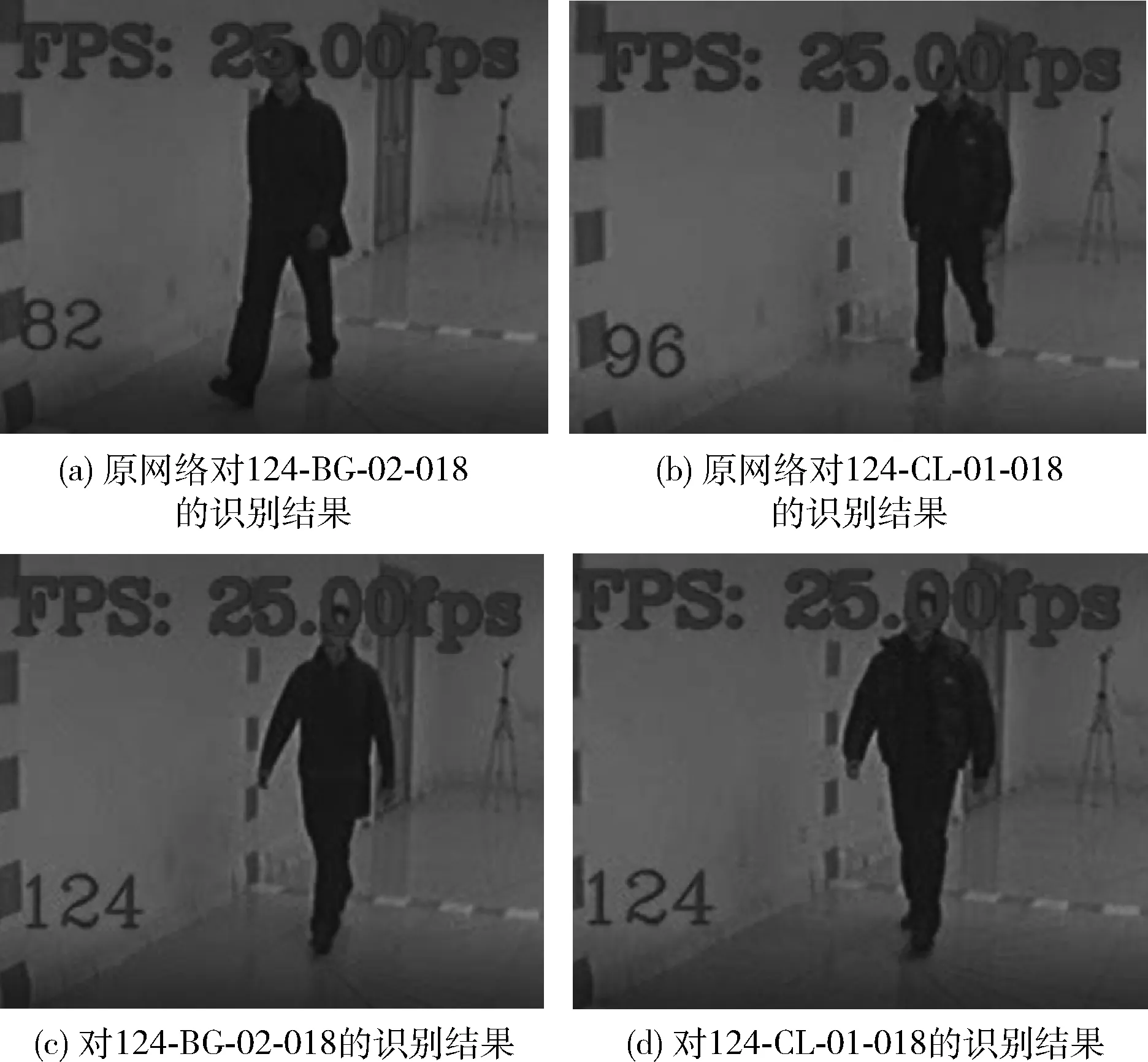

为了验证该算法在实际中的应用,在第3个实验中,从验证集(NM05-06、BG01-02、CL01-02)中随机选取一段行人视频,对视频中的行人进行身份识别,识别效果如图10所示。

图10 识别效果

图10(a)和图10(b)是改进图卷积网络前,对身份ID为124分别在BG和CL状态下18°视角下识别错误的结果;图10(c)和图10(d)是在改进网络后,对身份ID为124分别在BG和CL状态下18°视角下识别正确的结果。图中左下角的数字为模型所识别到的身份ID,左上角是身份识别的检测速率。对比仿真图可以看出,图卷积网络改进之后,在BG和CL状态下实际视频检测识别的结果均正确。

4 结束语

针对步态识别中衣着、携带物、视角等因素的影响,本文提出了一种改进图卷积网络的步态识别算法。首先以步态骨架数据作为输入,然后使用残差连接加深图卷积网络的深度,提高步态特征的表征能力,为了增强行走时局部关节点的特征,还在图卷积网络中加入了关节点注意模型。实验结果表明,改进后的图卷积网络在步态识别中识别率都有所提高,验证了本文方法具有较好的识别效果。但由于该网络在实际输入的行人视频中识别行人身份时,fps较低,今后将继续改进算法并尝试解决这一问题,提升步态识别身份的识别检测效果。