关节点连接历史图与卷积神经网络结合的双人交互动作识别

2021-01-27姬晓飞李晨宇王昱

姬晓飞,李晨宇,王昱

(沈阳航空航天大学 自动化学院,沈阳 110136)

双人交互动作识别在视频检索、智能监控、人机交互等方面都具有潜在的应用价值[1],因此在计算机视觉领域受到越来越多的关注。其中RGB视频数据是人类动作识别的主要数据源,但由于RGB数据只能提供人体运动的二维信息,且易受光照变化等影响,识别率难以提升。随着高性价比的深度传感器(如Microsoft Kinect)和实时姿态估计算法[2]的发展,能够表征人体三维信息的关节点序列成为了人体动作识别的主要数据源。

近年来,深度学习的方法在基于关节点序列的动作识别中取得了良好的识别效果。根据关节点序列表示并反馈给深度神经网络的不同方式,通常可以分为基于卷积神经网络(Convolutional Neural Network,CNN)和基于循环神经网络(Recurrent Neural Network,RNN)。基于CNN的方法是将关节点序列进行编码图像化,然后送入CNN进行深层次特征提取和识别。Wang[3]等对关节点轨迹的空间结构和动态表现进行颜色编码得到三种关节点轨迹图,然后送入CNN中进行识别。该类方法直接对原始数据进行编码,抗噪声的能力比较弱。Ke[4]等将整个身体分成5个部分,从关节点序列中提取每部分的余弦距离特征和归一化幅度特征,并将每部分的所有帧的两种特征按照时间顺序排列编码为灰度图,然后送入CNN进行识别。Yang[5]等提出一种树形结构骨架图(Tree Structure Skeleton Image,TSSI),将固定顺序连接的关节点按照TSSI模型重新连接并转化为灰度图,然后送入CNN进行识别。此类方法的网络结构简单,但对关节点序列的时间信息利用不充分。

基于RNN的方法是将关节点序列数据送到长短期记忆网络(Long Short-Term Memory,LSTM)中,对时空关系进行充分表示。Liu[6]等提出一个关节点序列的时空长短期记忆网络(Temporal and spatial-Long Short-Term Memory,ST-LSTM),将每个关节的相邻关节及前一帧信息编码为时空特征,并使用树状结构表示关节点之间的关系,之后将关节点数据的结果送入LSTM网络进行建模与识别。该框架为关节点数据在LSTM中的应用提供了创新性思维。 Zhang[7]等提出一种通用空间建模方法,并构建了8种类型的几何特征。然而,相比于单一类型特征,该方法使用三层LSTM模型,实时性不高。Wang[8]等提出双流RNN分别对关节点序列的时空关系进行建模,但是此方法采用多个RNN模型,结构更为复杂,导致模型的训练和识别复杂度较高。

基于深度学习的双人交互动作识别方法可以极大提高识别的准确性,但目前将关节点数据提取特征并编码图像化送入深度学习网络进行识别的方法多数没能很好地考虑关节点的时空关系,导致大量有用信息丢失。综上所述,本文提出一种新的基于关节点连接历史图的关节点特征提取及编码图像化方法,能够同时对人体关节点的时空关系进行充分表示,并与CNN结合,对复杂的双人交互动作识别具有较好的实用性。

1 算法整体框架

算法整体框架分为训练和识别两个过程。

(1)训练过程:在训练过程中,将训练集中关节点序列转化为关节点连接历史图,并将其送入卷积神经网络中;用于训练网络各层的权值。

(2)识别过程:将测试集中数据做上述相同的处理,并将其送入已训练好的网络模型中,最后利用soft-max分类器得到动作识别结果,本文整体算法框架如图1所示。

图1 算法整体框图

2 关节点连接历史图的构建

目前Kinect深度相机可以实时准确获取人体关节点数据,但需对其进行编码图像化之后才能与CNN结合进行交互动作识别。因此本文提出一种新的关节点编码图像化方法,即关节点连接历史图。首先将关节点按照人体关节点位置连接得到关节点连接图来保留其空间信息,再将每帧关节点连接图中的关节点连线,按照时间顺序谱编码得到关节点连接历史图体现其时间信息。

关节点连接历史图构建的具体步骤如下:

第一步,创建单帧关节点数据的关节点连接图。将X轴和Y轴的信息作为图像的位置信息;并将关节点按照人体骨架顺序连接得到单帧关节点连接图。那么动作个体之间的空间关系就可以通过关节点位置和关节点连线体现。

第二步,创建单帧关节点连接图的谱编码。引入HSV颜色空间将每一帧中关节点和关节点连线分别进行谱编码。相对于RGB空间,HSV空间能够更直观地表达色彩的色调、明暗以及鲜艳程度,方便进行颜色之间的对比。

HSV空间中的色调(H)表示色彩信息。关节点和关节点连线的色调对应关系为公式(2)。其中关节点连线色调的起始角度为0°,关节点色调的起始角度与其相位差为120°。

(2)

其中i是此单帧关节点连接图对应帧数,N是执行动作总帧数,i=[1,2,…,N]。

饱和度(S)表示颜色纯度的比率。关节点和关节点连线的饱和度用S表示,S均取1。

亮度(V)表示色彩的明亮程度,关节点的深度信息被映射到HSV模型中的V中。

使用HSV颜色空间模型对关节点连接图进行谱编码,可将关节点数据的时间关系和空间关系中的深度信息分别用H和V两个参数来表征,使关节点数据的时空信息均被充分利用。

第三步,创建关节点序列对应的关节点连接历史图。将整个关节点序列对应的单帧关节点连接图整合到一张图像中,可以得到关节点序列对应的关节点连接历史图。那么关节点的时间信息就可以通过不同帧中关节点和关节点连线的不同色彩来体现。关节点序列连接历史图示例如图2所示。

图2 关节点序列连接历史图示例

本文提出的关节点连接历史图充分考虑了关节点数据的时空关系,因此可以有效提取关节点数据的关键信息。

3 卷积神经网络识别

卷积神经网络(CNN)是一类特别设计用来处理二维数据的多层神经网络[9]。目前常使用的网络包括AlexNet[10]、VGG[11]、Inception[12]和ResNet[13]。其中VGG包含VGG16和VGG19两种结构,该网络证明了增加网络深度能够影响网络的最终性能。因此本文选用性能更好的VGG-19卷积神经网络。

VGG-19网络结构非常简洁,它由含有16个卷积层的5个卷积段、5个最大池化层和3个全连接层组成。VGG-19的网络结构如图3所示。

图3 VGG-19网络结构图

卷积神经网络VGG-19的训练是运用TensorFlow[14]平台下Keras框架完成的,首先将关节点连接历史图按照8:2分为训练集与测试集,之后将训练集数据使用VGG-19训练即可得到网络模型训练参数。

卷积神经网络VGG-19的测试使用测试集数据和训练好的VGG-19网络,测试结束即可得到双人交互动作识别结果。

4 实验结果分析

4.1 数据库介绍

本文采用国际标准的SBU Kinect[15]数据库来进行验证。它是一个双人交互动作数据库,共包含8个动作类别,分别为靠近、离开、踢、打、拥抱、握手和传递物品。其中关节点数据是将每个动作者用15个关节点进行表示。SBU Kinect数据库关节点动作示例图如图4所示。

图4 SBU Kinect 数据库示例图

4.2 SBU Kinect数据库测试实验结果

为了测试本文所提出算法的有效性,将数据库中的样本按照8∶2的比例分别进行训练和测试,进行100次迭代训练,得到训练和测试过程的准确率与模型损失值分别如图5所示。

图5 关节点数据的识别准确率和模型损失

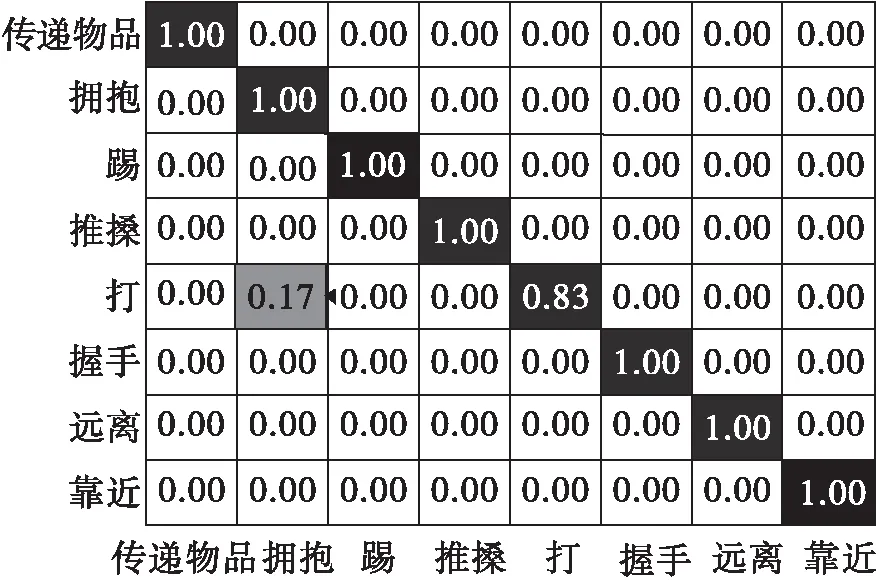

根据图5可知,随着训练次数增加识别结果趋于稳定,识别准确率最高为97.1%,最终稳定在94.12%,识别结果的归一化混淆矩阵表示为图6。

由图6可知,关节点连接历史图对7种动作类别均可以准确识别,错误识别主要发生在打和拥抱之间,原因是这两个动作在执行过程中空间结构相似,易造成识别结果不准确。

图6 关节点连接历史图识别结果混淆矩阵

4.3 实验结果与其他文献比较

本实验与其他方法在SBU Kinect数据库进行实验结果对比如表1所示。

表1 本文模型与其他模型算法结果对比

由表1可知,本文提出的算法取得了较好的识别结果,识别准确率高于文献[6]和[7],且本文选择的VGG-19网络模型结构较为简单,实时性较高。文献[9]比本文识别率高出0.68%,但其选用双流RNN作为网络模型,结构较为复杂,训练时间较长,而本文迭代一次时间仅3-4s。文献[8]的识别准确率较高,但其选用三层LSTM模型,结构更为复杂,且通过关节点与线之间距离JLD(joint-line distance)来构造特征的方式也较为繁琐。

5 结论

本文提出了一种基于关节点连接历史图与CNN结合的双人交互动作识别方法,首先将关节点序列按照人体关节点空间位置连接得到关节点连接图保留其空间信息,再将每帧关节点连接图中的关节点和关节点连线,按照时间顺序谱编码得到关节点连接历史图来体现其时间信息,之后使用卷积神经网络挖掘其深层次特征进行双人交互动作识别。本文提出的算法在SBU Kinect数据库进行实验,结果表明该算法具有良好的迁移性和实时性。