人工关节磨屑的显微单视图深度估计方法研究*

2022-07-14伍锐斌彭业萍曹广忠曹树鹏

伍锐斌 彭业萍 曹广忠 王 松 曹树鹏

(1.深圳大学机电与控制工程学院 广东深圳 518060;2.广东省电磁控制与智能机器人重点实验室 广东深圳 518060;3.深圳清华大学研究院生物医用材料及植入器械重点实验室 广东深圳 518057)

近年来,骨关节疾病发病率逐年上升,人工关节置换手术已成为治疗骨关节疾病的有效手段之一。但是,人工关节假体植入人体后,接触面每年承受数百万次的相对滑动和循环摩擦,过度磨损会造成关节疼痛和功能障碍。而磨损产生的磨屑会引起假体的无菌性松动,是人工关节置换失效的一个主要原因[1-3]。所以,人工关节材料及其磨屑的研究十分重要。

人工关节材料通常为金属材料、高分子材料、陶瓷材料和复合材料[4]。不锈钢是最早用于制作人工关节的金属材料,但临床研究表明,其生物相容性较差,在人体内生理环境下,易被腐蚀和破裂。钴合金及钛合金被广泛用于人工关节假体,但假体腐蚀、磨损的过程会产生游离的金属离子,进入体液循环,对人体有一定危害。超高分子聚乙烯是常用的人工关节高分子材料,它具有优异的生物相容性且耐化学腐蚀、抗摩擦能力强,可以较好地解决人工关节的摩擦磨损问题[5-7],但长期使用会发生严重磨损和氧化,进而产生磨屑,导致骨溶解产生无菌性松动,使人工关节失效[8-9]。陶瓷材料具有硬度大、耐磨性好、耐蚀性强、化学性质稳定和生物相容性好等优点,但弹性模量高、脆性大,在使用过程中常出现脆性断裂和骨损伤[4,10]。迄今为止,仍没有找到一种在生物相容性和生物摩擦学性能方面都十分优异的人工关节材料。最接近人体骨骼材质的以羟基磷灰石为基体的复合材料仍处于实验室研究阶段,没有广泛地应用于临床治疗上。虽然钛合金人工关节金属材料在使用过程中所产生的金属离子对人体有一定危害,但其具有丰富临床研究经验数据,仍是主流的人工关节材料。所以,文中以钛金属材料摩擦副产生的磨屑作为研究对象。

磨屑包含着人工关节微观状态下的磨损信息,其尺寸、数量和形貌特征可反映人工关节不同的磨损形式和机制[11]。因此,对人工关节磨屑进行研究、获取其携带的摩擦学信息,对于人工关节材料磨损机制的研究具有重要意义。传统人工关节磨屑分析利用显微设备拍摄二维显微图像,人工分析磨屑类型和推断其产生机制,其准确性很大程度依赖专业知识和个人经验且需要较高的人工成本,效率低下,这大大限制了人工关节磨屑分析技术的实际应用。

近年来,随着深度学习在计算机视觉领域的迅猛发展,深度学习被应用到了磨屑的智能分析。康剑莉等[12]利用改进的BP网络进行磨屑分类。吕纯等人[13]用基于改进的PSO算法的SVM模型对磨屑进行类型识别,效果明显优于 BP 神经网络。PENG等[14]将混合卷积神经网络和SVM结合使用,实现了磨屑的智能识别。安超等人[15]利用Mask-R-CNN网络对磨屑图像进行实例分割并实现了磨屑的分类识别。

上述磨屑研究均基于二维图像,但磨屑的三维信息中蕴含更加丰富的摩擦学信息,可以更好地研究人工关节磨屑产生机制。虽然利用原子力显微镜、激光共聚焦显微镜(LSCM)可以得到磨屑精确的三维形貌,但是硬件成本高昂且分析效率低下。于是,研究者将视觉三维重建的方法应用于磨屑三维信息捕捉。任国全等[16]用SFS算法实现了单张磨屑图像的形貌恢复,得到磨屑的相对深度图。潘岚等人[17]从视频序列中采集每帧焦平面上的清晰图像范围,再结合显微镜纵轴移动速率,构建磨屑的三维形貌。WU等[18]使用多视图轮廓的方法构建磨屑的三维模型。WANG等[19]利用SFM算法实现磨屑的稀疏重建,再通过SFS算法估算磨屑表面的相对高度,将SFS上的点转化到稀疏重建的坐标上,获得磨屑稠密重建的结果。在利用视觉三维重建获取磨屑三维信息的方法中,SFS算法进行磨屑单视图深度图估计,需要满足均匀平行光照和磨屑表面为理想散射表面的假设[16],最终仅能得到相对的深度,不能获取磨屑真实的三维信息。基于多视图的磨屑三维形貌恢复依赖特定的硬件设备和复杂的操作,需要拍摄多个合适视角的磨屑图片来进行三维重建,效率较低。为了实现低成本、高效率的磨屑三维信息获取,本文作者提出一种基于SA-UNet(Self Attention U-Net)网络的磨屑单视图深度估计方法,在采集数据、训练网络模型后,仅需要利用普通光学显微镜拍摄单张磨屑的二维图像就可预测对应的深度图,获得磨屑的三维信息。

1 方法

1.1 SA-UNet深度估计网络

1.1.1 网络架构

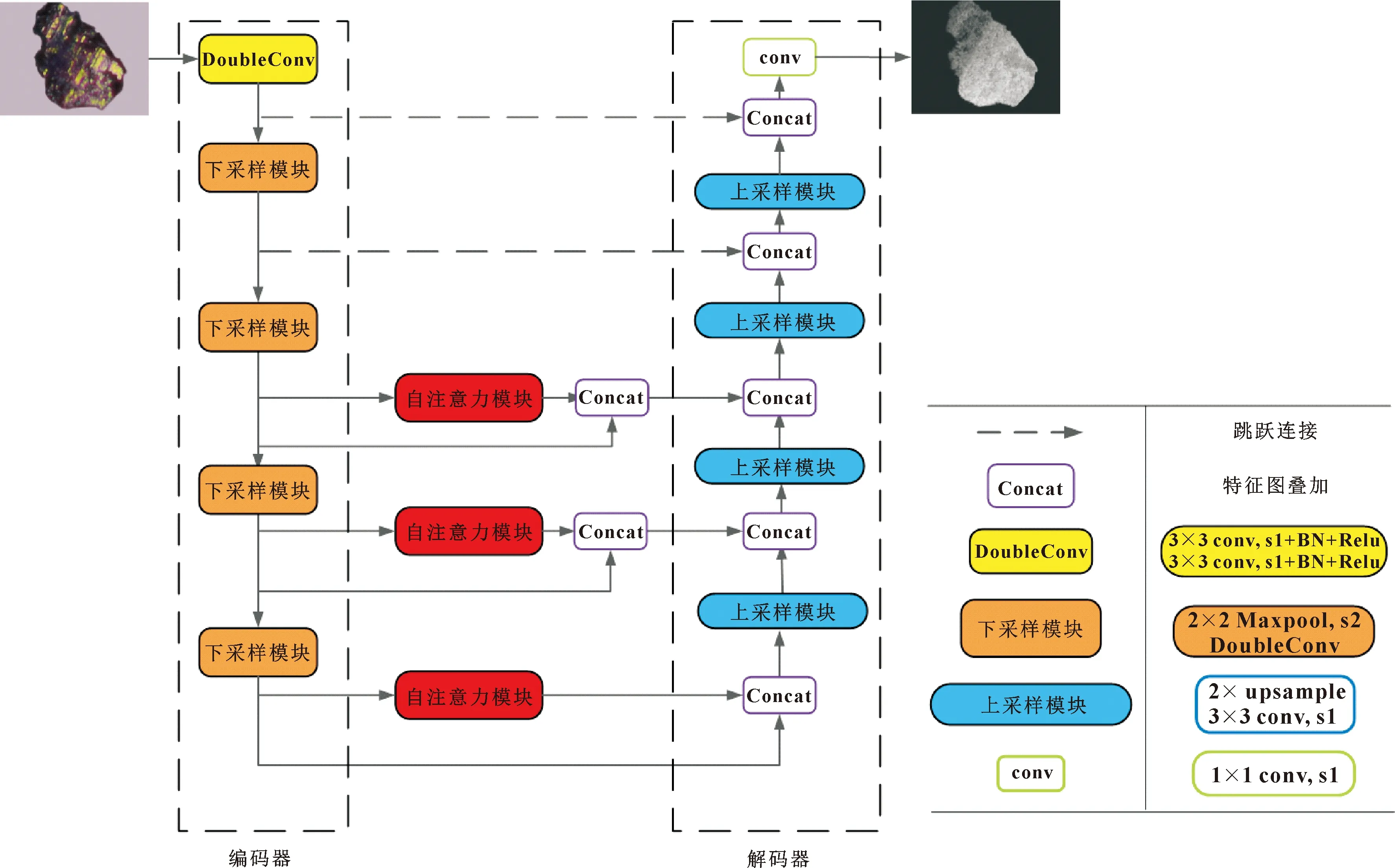

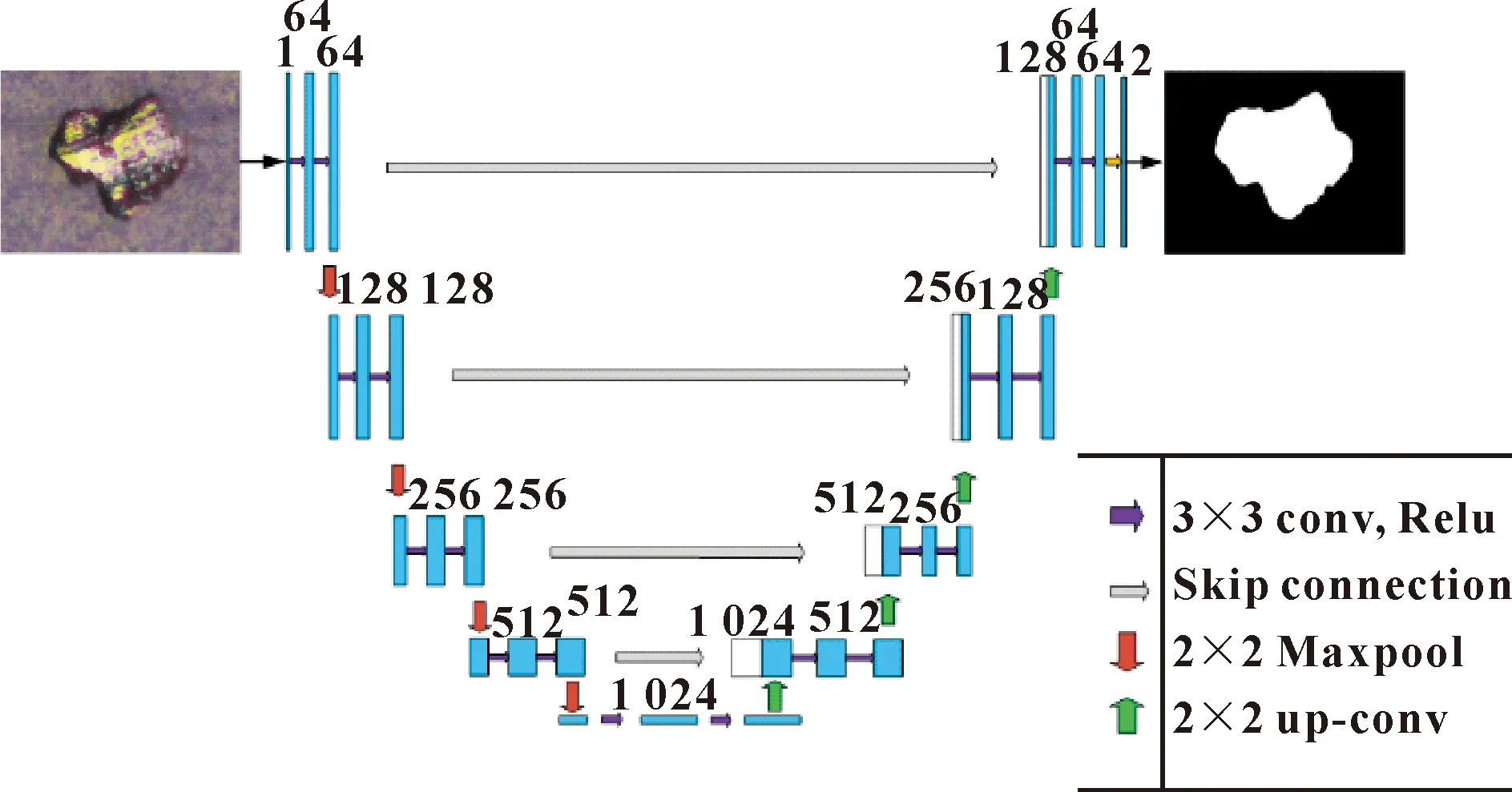

为解决磨屑单视图深度估计问题,提出一个深度学习网络架构SA-UNet,其整体结构是一个融合自注意力模块的U形网络,分为编码器和解码器两部分。编码器包含一系列的卷积操作和最大池化操作,每经过一次最大池化,特征图的大小变成原来的1/2,在卷积层后面嵌入批量归一化层,防止过拟合。解码器是一系列的卷积和上采样操作,通过上采样还原特征图大小。SA-UNet网络结构如图1所示。

图1 SA-UNet的网络结构

编码器可提取多尺度特征图,浅层特征图保留了丰富的底层特征信息,深层特征图包含更抽象的特征信息。在编码阶段,池化操作会使部分特征信息丢失,解码阶段进行上采样难以恢复丢失的信息。因此,在编码器和解码器间设置跳跃连接,将编码阶段的底层特征图与深层次的、更抽象的特征图融合,可以有效弥补池化操作丢失的细节信息。在磨屑图像的深度估计中,每个像素的输出值与全局像素的信息相关联,在跳跃连接处加入了自注意力模块,能自适应地学习像素级别的注意力图来捕获上下文信息。SA-UNet网络聚合全局的关联信息进行逐像素预测,能有效提高深度估计的精度。

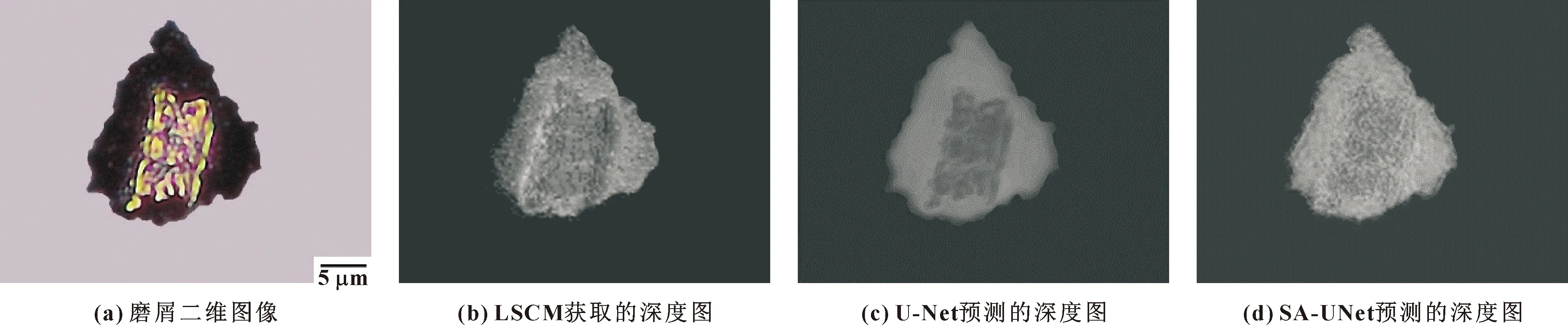

1.1.2 自注意力模块

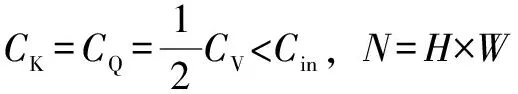

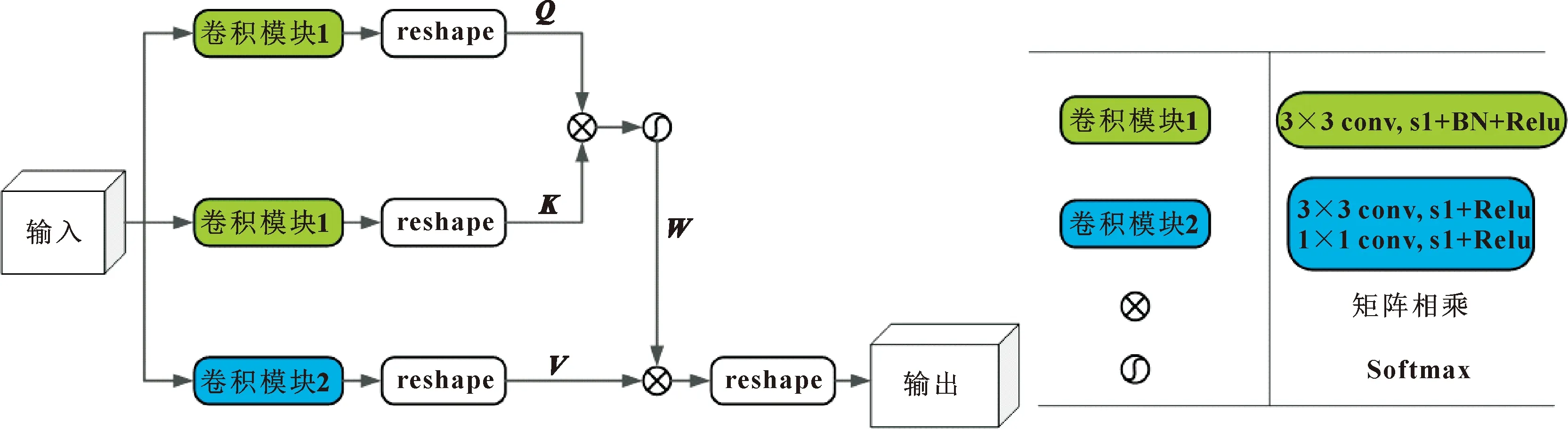

图2(a)、 (b)所示分别为磨屑的二维图像和LSCM获取的存储磨屑三维信息的深度图。原始U-Net网络没有结合像素的全局关联性预测深度值,不能准确预测局部的高低起伏,出现与真实深度不符的、大范围的深度值相同的情况,如图2(c)所示。

(1)

在注意力图中,任意位置的Wi,j表示特征图的第j个位置与第i个位置的相关联程度。借助注意力图,将自注意力模块的输出xout定义为式(2)。

xout=WV

(2)

通过注意力图获取每个位置与全局位置的相关联权重,可以增强特征提取的过程。SA-UNet通过注意力图可以结合全局位置信息预测每一个位置的深度值,其预测的深度图与激光共聚焦显微镜得到的深度图一致,不会出现大范围的深度值相同的情况,有效地提高了预测精度,其效果如图2(d)所示。

图2 磨屑二维图像、LSCM获取的深度及U-Net、SA-UNet估计深度

图3 自注意力模块架构

1.1.3 损失函数

LEE等[21]提出一种结合方差和加权平方误差定义的损失函数,该损失函数通过设置常系数λ值来控制训练中对误差平均值和方差的关注程度,具有稳定快速收敛的优点。文中提出的SA-UNet网络采用该损失函数训练,其定义如式(3)所示。

(3)

(4)

α值可以缩放损失值,影响反向传播时的梯度值;λ值越大,损失函数越注重方差的优化。参照文献[21]设置合理的参数值α=10,λ=0.85。

1.2 透视变换

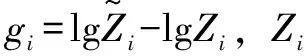

使用普通光学显微镜和激光共聚焦显微镜对同一颗磨屑进行拍摄,可得同一磨屑的两幅二维图像,如图4所示。

图4 LSCM和光学显微镜拍摄的同一磨屑的图像

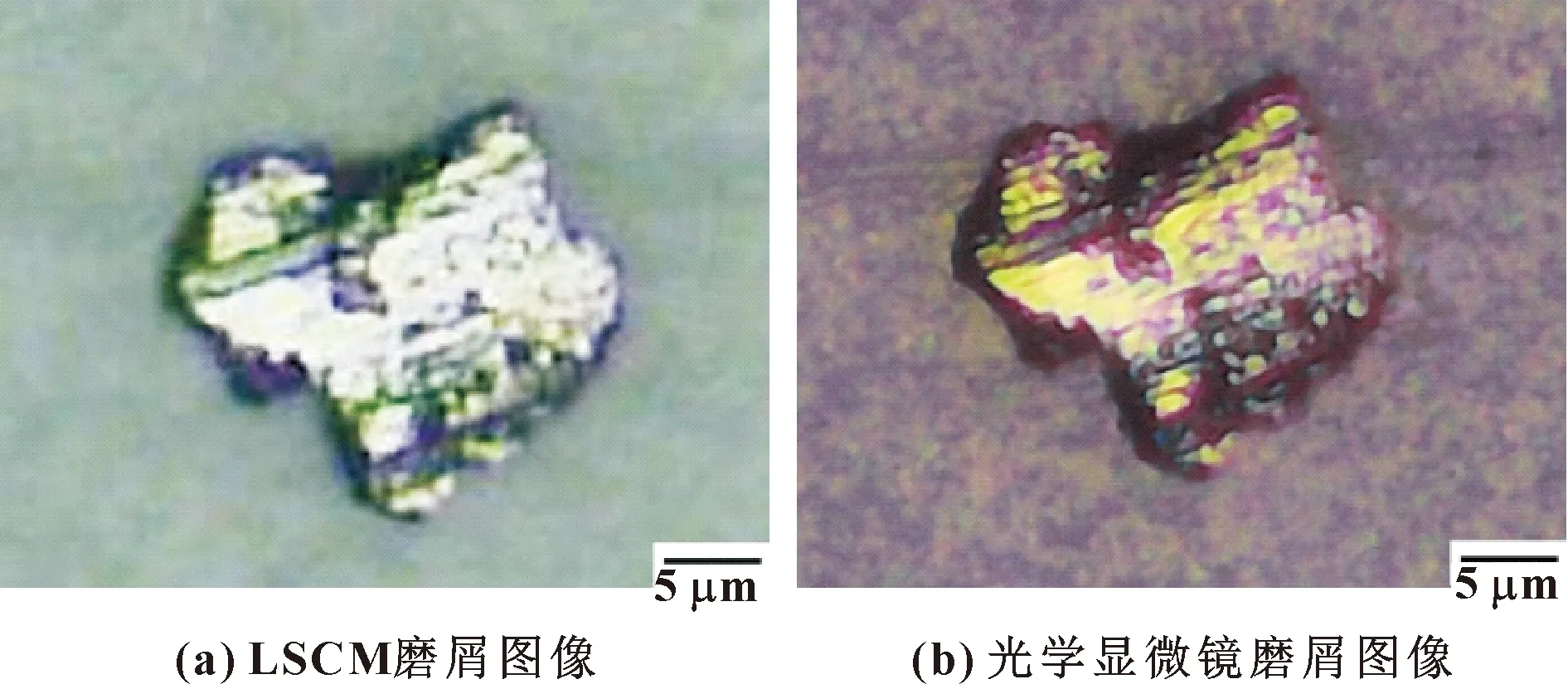

普通光学显微镜无法获取磨屑的三维信息,联合激光共聚焦显微镜可以获取训练所需的样本数据。激光共聚焦显微镜可以同时获取磨屑的二维图像和深度图。深度图是存储磨屑三维信息的一种方式,它采用灰度值表示相机与成像物体之间的距离,灰度值变化可以反映磨屑表面细节。为了数据展示的方便,文中所有深度图的值均放大了5倍。激光共聚焦显微镜采集的TC4磨屑图像和深度图如图5所示。

图5 激光共聚焦显微镜拍摄的磨屑二维图像和深度图

此时,普通光学显微镜的二维图像和激光共聚焦显微镜得到的深度图并不是逐像素对应的。通过对两幅图像进行特征点匹配,计算2个坐标系的透视变换矩阵,再对深度图做透视变换,可使深度图与普通显微镜的二维图像逐像素对应,从而获得普通光学显微镜的训练样本。

1.2.1 基于SIFT特征点匹配

SIFT(Scale-invariant feature transform)算法能寻找并描述图像的特征点,被广泛地使用在图像处理领域。基于SIFT的特征点匹配步骤[22]如下:

(1)对输入图像构造高斯差分金字塔;

(2)在高斯差分金字塔中检测极值,即为图像的特征点;

(3)通过统计特征点邻域的梯度生成特征点的描述子;

(4)计算两幅图像特征点的描述子的欧氏距离,当最近邻欧氏距离与次近邻欧氏距离的比值小于阈值时,判断为匹配点。

在判断特征点是否匹配时,为得到4对以上精确匹配的特征点,经实验测试最终设置阈值为0.4,得到激光共聚焦显微镜磨屑图像和普通光学显微镜磨屑图像相匹配的特征点对。

1.2.2 图像的透视变换

透视变换是将图像从自身坐标系变换到另一图像坐标系下的数学变换。其变换如式(5)—(7)所示。

(5)

(6)

(7)

(8)

(9)

通过两幅图中相匹配的特征点对可求得透视矩阵,利用透视矩阵对深度图进行坐标变换,得到与普通光学显微镜二维图像逐像素对应的深度图。

1.3 磨屑掩模的获取

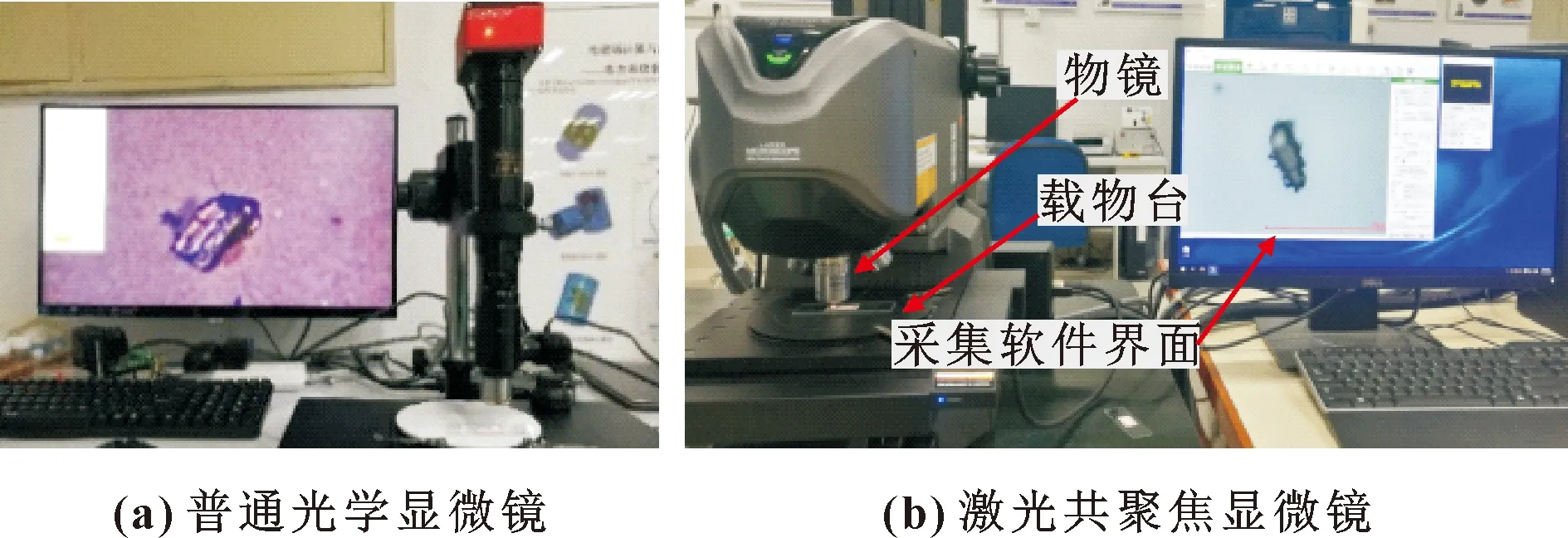

通过语义分割网络U-Net[23]初步得到磨屑掩模,经过图像开运算和孔洞填充得到更精准的掩模。利用磨屑掩模排除复杂多变的背景对模型学习的干扰。U-Net是常用于医学图像分割的语义分割网络,适合小样本的语义分割任务,它的结构框架如图6所示。

图6 U-Net架构

U-Net网络由编码器和解码器组成。编码器遵循卷积网络的典型架构,包含3×3卷积的重复使用,每个卷积操作后接Relu激活函数。编码器有4个最大池化,用于下采样。在每个下采样步骤后,特征图的大小减半、通道数量加倍。解码器包含卷积和上采样操作,一共包含4次上采样的操作。每次上采样,通过反卷积操作将特征图的大小扩大2倍、通道数量减半。在编码器和解码器间存在跳跃连接结构,用于补充解码过程中无法复原的细节信息。最终用1×1卷积将特征图映射到所需的类数。U-Net网络训练采用的是交叉熵损失函数,如式(10)所示。

(10)

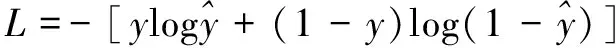

分割好的磨屑掩模会出现毛刺和掩模区域有孔洞的情况,如图7(a)所示。利用图像的开运算可以消除掩模的毛刺,通过图像的孔洞填充可以消除较大的孔洞。经过后处理,可得到准确的磨屑掩模。得到磨屑的掩模图后,可将磨屑图像的背景置为统一的颜色,从而消除磨屑图像背景变化带来的干扰。效果如图7(b)所示。

图7 磨屑二维图像及去背景后的磨屑图像

2 实验

2.1 样本数据集

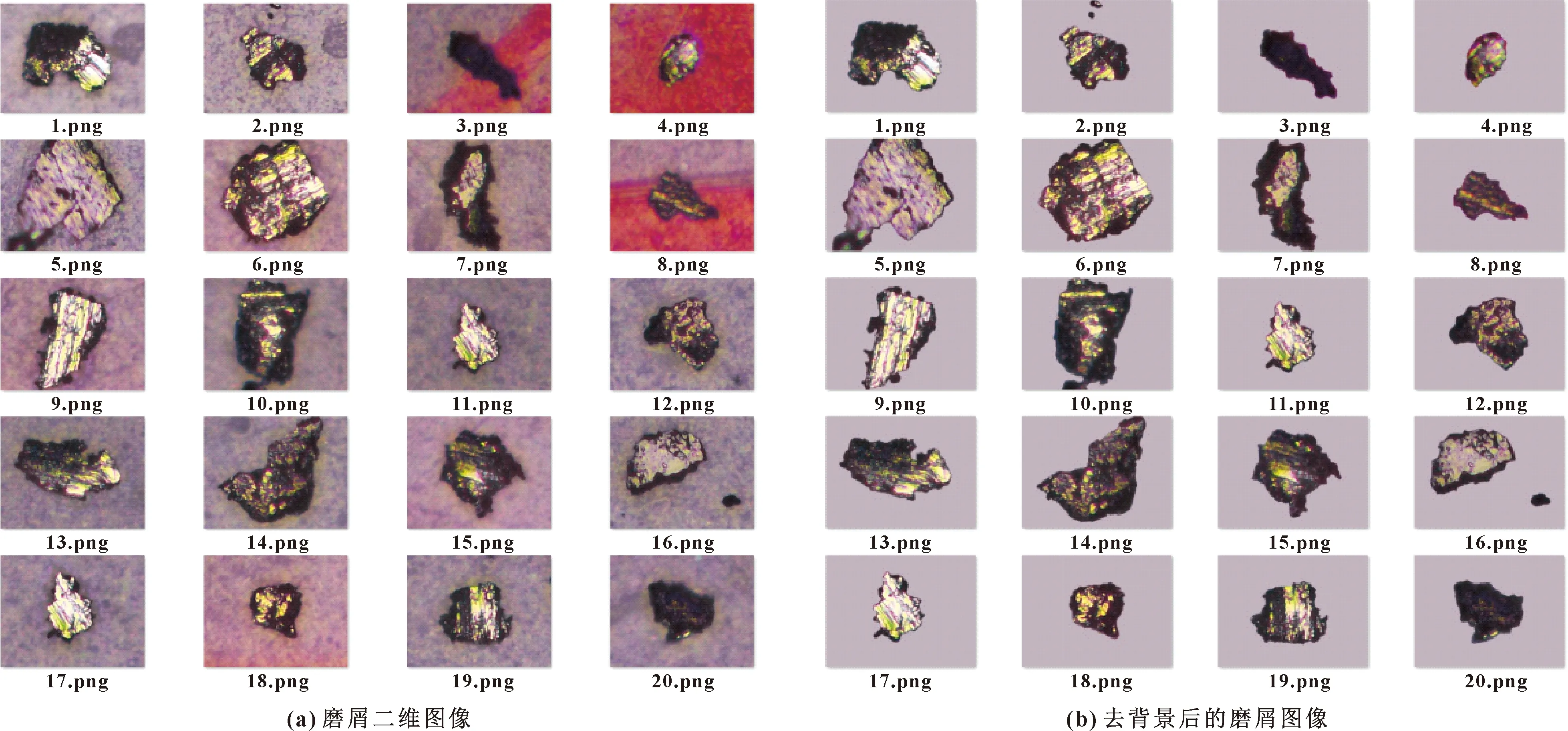

文中的样本数据集是通过普通光学显微镜和LSCM联合获取。首先利用普通光学显微镜获取TC4材料磨屑的显微二维图像;然后使用基恩士VK-X260激光共聚焦显微镜采集TC4材料磨屑的二维图像和对应的深度图。通过语义分割消除光学显微二维图像的背景干扰,再通过透视变换得到光学显微镜下包含二维图像和深度图的样本数据。普通光学显微镜如图8(a)所示,基恩士VK-X260激光共聚焦显微镜如图8(b)所示。

图8 采集图像的仪器

文中共采集了1 222个TC4磨屑样本,对采集到的数据进行随机裁剪、翻转、旋转和锐化、高斯模糊可增加图像对,提升样本的质量。利用数据扩充技术将1 122个磨屑样本扩充为7 854个图像对,用以训练SA-UNet网络。剩下的100个普通光学显微镜的磨屑样本作为测试集。

2.2 实验结果

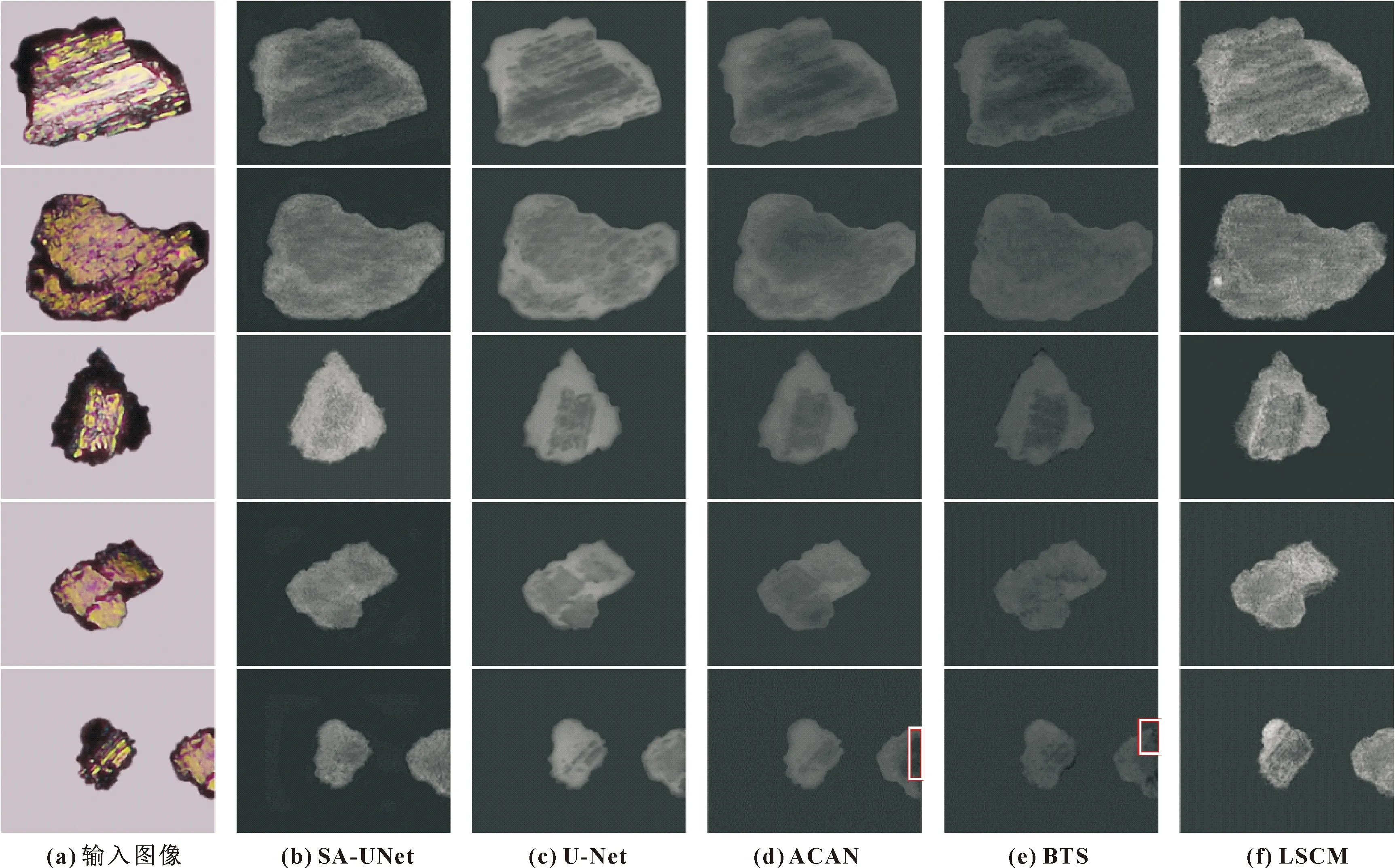

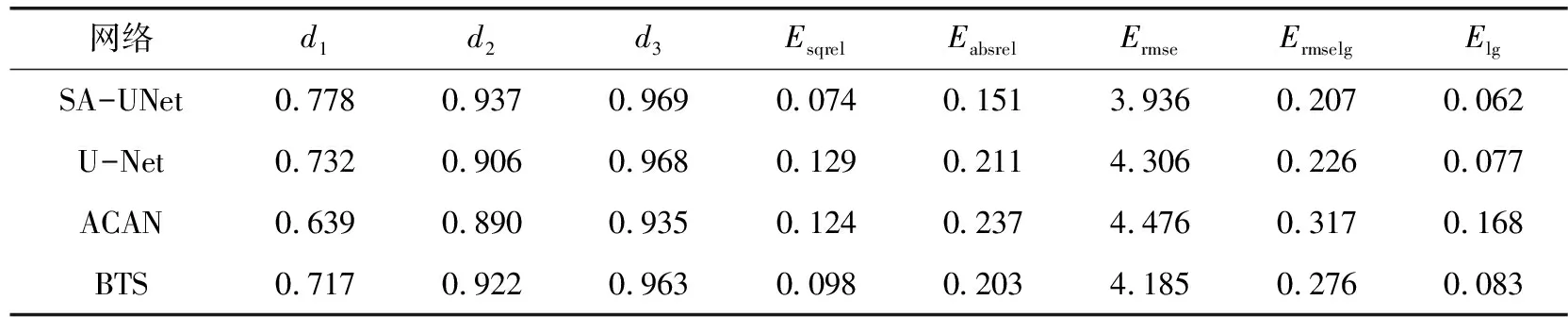

SA-UNet、U-Net、ACAN(Attention-based Context Aggregation Network)[24]和BTS(Big to Small)[21]对普通光学显微镜拍摄的磨屑图像的深度估计效果如图9所示。在单视图的深度估计中,使用精确度指标d1、d2和d3(详见式(11)—(13)),来衡量在给定误差范围内预测正确的像素点的占比,其值越接近1,说明预测的正确率越高。使用平均相对误差(Esqrel)和绝对相对误差(Eabsrel)来衡量预测值与真实值的偏差程度,其值越小说明预测值越接近真实值。使用均方根误差(Ermse)、均方根对数误差(Ermselg)和平均对数误差Elg来衡量预测值与真实值的偏差值,其值越小说明预测的偏差越小。

评价指标计算公式如下:

(1)精确度d1、d2、d3:

(11)

(12)

(13)

(2)平均相对误差Esqrel:

(14)

(3)绝对相对误差Eabsrel:

(15)

(4)均方根误差Ermse:

(16)

(5)均方根对数误差Ermselg:

(17)

(6)平均对数误差Elg

(18)

图9 输入的图像及SA-UNet、U-Net、ACAN、BTS网络预估的深度图和LSCM得到的磨屑深度图

式中:Zpred为预测的深度图;ZCLSM为激光共聚焦显微镜得到的磨屑的深度图;n为图片的像素点总数。

将网络预测的深度图Zpred和激光共聚焦显微镜得到的深度图ZCLSM代入式(11)—(18),即可计算得到深度估计的各项评价指标。SA-UNet、U-Net、ACAN和BTS在100个测试样本中的性能指标如表1所示。

表1 不同网络的实验结果

从预估的深度图看,SA-UNet网络明显优于U-Net、ACAN和BTS。U-Net出现大面积的深度值相近,与实际的深度图差别较大,ACAN将深度估计任务转化为分类任务,所预测的深度图常出现小面深度相同的情况。ACAN和BTS还会小概率地出现局部预测偏差较大的问题,如图9(d)、(e)中方框区域所示。SA-UNet利用U形网络作为特征提取器并融合自注意力机制,能够很好地提取特征信息和学习像素级别的全局依赖,准确预估出对应的深度图。SA-UNet所预估的深度图与LSCM所得到的深度图几乎一致。从表1中各项评价指标上看,SA-UNet在4个网络中均为最优。其中,SA-UNet网络的平均相对误差(Esqrel)为7.4%,绝对相对误差(Eabsrel)为15.1%,预测值与激光共聚焦显微镜所得深度图的偏差程度较小。绝对相对误差(Eabsrel)与原始的U-Net网络、ACAN网络和BTS网络相比,分别降低了6%、 8.6%和5.2%。SA-UNet均方根误差(Ermse)是3.936,优于其他对比方法。

在采集图像时显微镜可能出现细微抖动,且普通光学显微镜的景深较小,所以采集的磨屑图像存在局部的模糊。磨屑图像的模糊区域缺乏纹理或纹理不清晰,使得SA-Unet网络在模糊区域无法借助像素邻域的有效信息去预测深度值,从而引起预测误差。为提高SA-Unet网络预测的精度,在未来的工作中,应对采集到的磨屑图像进行模糊恢复,丰富磨屑的纹理信息,进一步减少深度估计的误差。

3 结论

(1)提出SA-UNet深度估计网络,实现了TC4材料磨屑单视图深度图估计,使普通光学显微镜也可轻易获取磨屑的三维信息,降低了磨屑三维信息获取的硬件成本。

(2)在TC4材料磨屑单视图深度估计任务中,SA-UNet网络各项评价指标均优于UNet、ACAN和BTS等网络,其中绝对相对误差比原始的U-Net网络降低了6%,比ACAN网络降低了8.6%,比BTS网络降低了5.2%。