基于双目立体视觉的3D物体颜色测量方法研究

2022-03-16圣延聪崔桂华吴自然

圣延聪,崔桂华,吴自然

基于双目立体视觉的3D物体颜色测量方法研究

圣延聪,崔桂华†,吴自然

(温州大学电气与电子工程学院,浙江温州 325035)

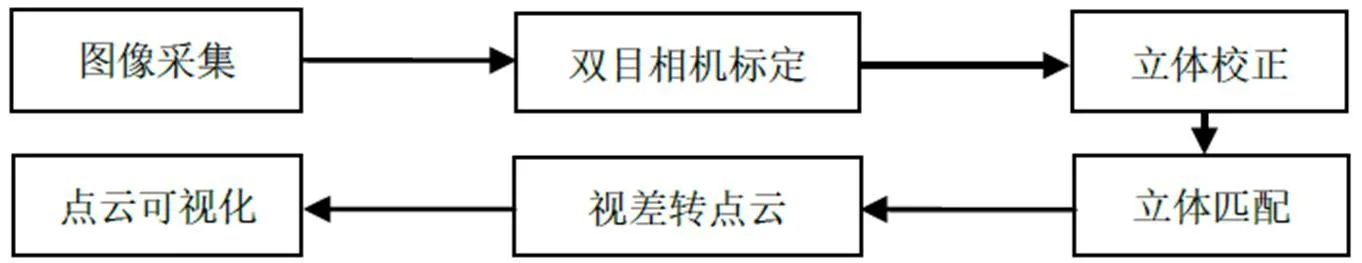

传统的物体颜色测量方法,均是针对平面物体而言的,不适用于3D物体尤其是表面不规则的3D物体表面的颜色测量.随着3D彩色打印技术的飞速发展,亟需一种快速的直接的3D物体颜色测量方法.鉴于此,提出了一种基于双目立体视觉的3D物体颜色测量方法.在标准LED灯箱中,首先使用双目相机采集标准棋盘格图像进行相机几何参数的标定,利用标定后的相机参数重建物体的3D图像,再采集标准色卡图像进行相机颜色特征化处理,建立3D图像RGB颜色值与CIE XYZ三刺激值之间的数学模型,然后采集被测物图像并从重建的3D图像中提取物体像素点的空间几何信息和颜色信息,实现3D物体的空间位置和颜色的测量.实验中,采用低端网络双目相机和DigiEye 240色卡,训练具有20项三阶多项式的相机特征化模型,模型训练误差为3.5 CIELAB色差单位,用ColorChecker 24色卡作为测试目标物,测试误差为5.7 CIELAB色差单位,略大于训练误差3.5.实验结果表明,该方法具有一定的测量精确度,可以测量传统颜色测量仪器无法测量的3D物体的颜色.

双目立体视觉;立体匹配;颜色测量

双目立体视觉通过模仿人眼视觉系统原理,用双摄像机从不同的角度,获取同一三维场景的两幅数字图像,通过立体匹配算法计算两幅图像像素间的视差来重建该场景的几何形状与空间位置[1].目前,双目立体视觉在工业测量领域已经发挥了巨大作用[2],但其在颜色测量领域的应用甚少.随着3D打印制造技术的快速发展,采用新的方法能及时准确地测量3D物体的颜色信息显得尤为重要.

在图像重建的过程中,主要问题是解决相机标定和立体匹配算法带来的误差.张氏平面标定法[3]既克服了需要高精度三维标定物的缺点,又解决了自标定法鲁棒性差的难题.根据优化的方法不同,双目立体视觉算法可分为:局部算法[4]、非局部算法[5]、全局算法[6]和半全局算法[7-8].半全局块匹配算法(Semi-Global Block Matching,SGBM)将文献[7-8]中基于互信息[9]的匹配代价计算法修改为基于BT[10]的匹配代价计算法,该算法的核心是通过选取每个像素点的视差,构成一张视差图,设置一个和视差图相关的全局能量函数,使这个能量函数最小化,以达到求解每个像素最优视差的目的.Mei[11]等人提出的AD-Census立体匹配算法,将局部算法和半全局算法相结合,构造每个像素的支持区域,视差图中弱纹理区域和非连续区域都得到了明显改善.

常用的颜色测量方法有目视评价法、接触式仪器测量法和数码测色法[12].传统的颜色测量方法多采用接触式测量方式,可以用来测量一定尺寸、平整的物体表面的颜色特性或光谱反射特性数据,测量3D物体时,曲率较大的物体表面会穿过测量仪器孔径切面,导致出现漏光、不规则漫反射以及阴影等现象,对精确测量颜色的信息产生较大的影响.现有的数码测色法只是采用单个相机捕获物体表面外观信息,无法获取更复杂的物体3D信息.

本文提出一种基于双目立体视觉的3D物体颜色测量方法,是对数码测色法的一种改进,解决了数码测色法无法测量3D物体的问题,可以有效地减少接触式和数码颜色测量带来的误差,既可以用于物体外形尺寸的测量,又可以用于物体表面颜色的测量.

1 双目3D图像重建

1.1 双目立体视觉概述

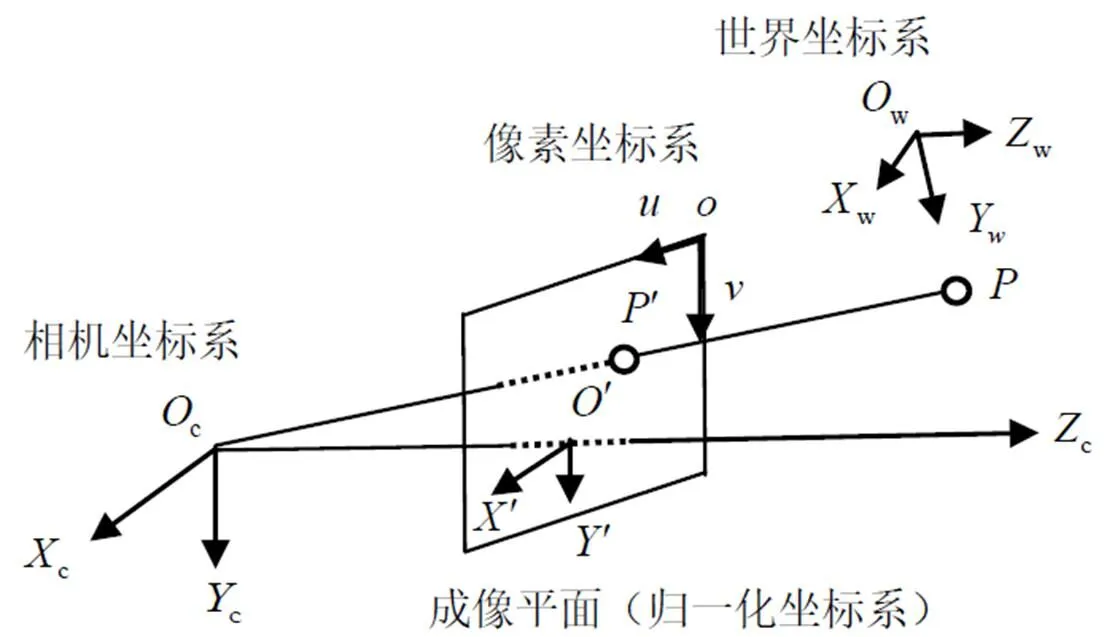

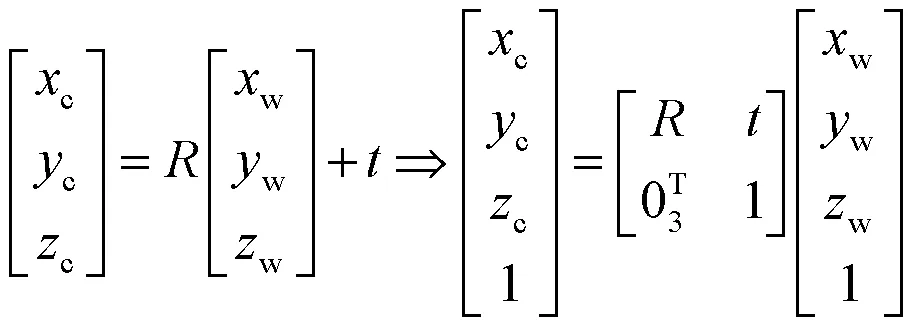

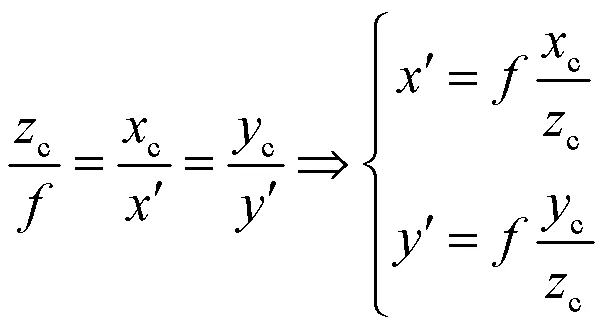

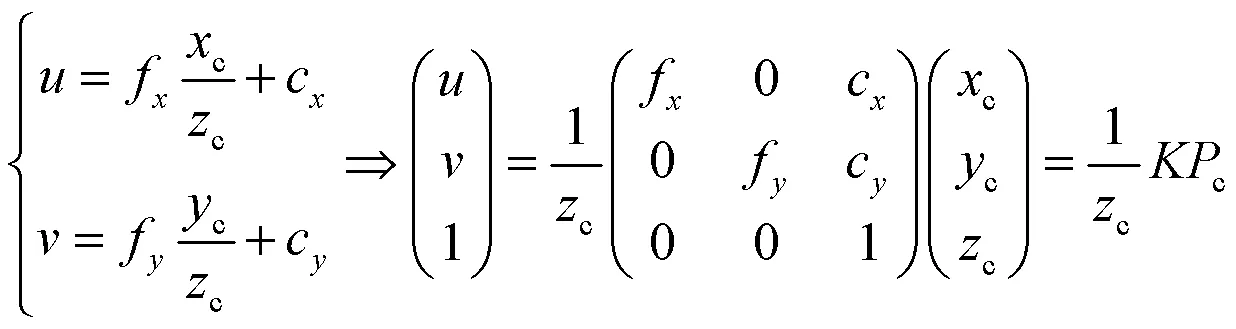

双目立体视觉系统由两个水平放置的数码相机组成,单个相机成像模型可以抽象为针孔相机模型,完成世界坐标系中点到像素坐标系中点的转换.

1.1.1 针孔相机模型

针孔相机模型描述的是单个相机拍摄物体的坐标变换过程,包括像素坐标系、归一化坐标系、相机坐标系和世界坐标系,建立坐标系的根本目的是建立三维空间点与二维图像像素点之间的联系.像素坐标系是以二维图像为基本建立的直角坐标系,描述了每一个像素点在图像中的位置;归一化坐标系并不是实际存在的坐标系,该坐标系是相机坐标系中Z轴归一化为1的投影平面;相机坐标系是以相机的视角去描述图像在三维空间中的坐标位置,通常以相机中心为原点;世界坐标系即真实世界中的绝对坐标系,描述了所有物体在实际空间中的坐标位置.

图1 4个坐标系关系图

1.1.2 双目立体匹配原理及方法

图2 双目立体视觉原理图(a)和极线约束图(b)

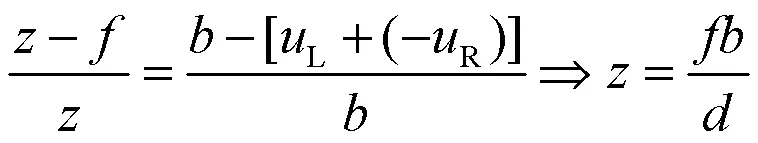

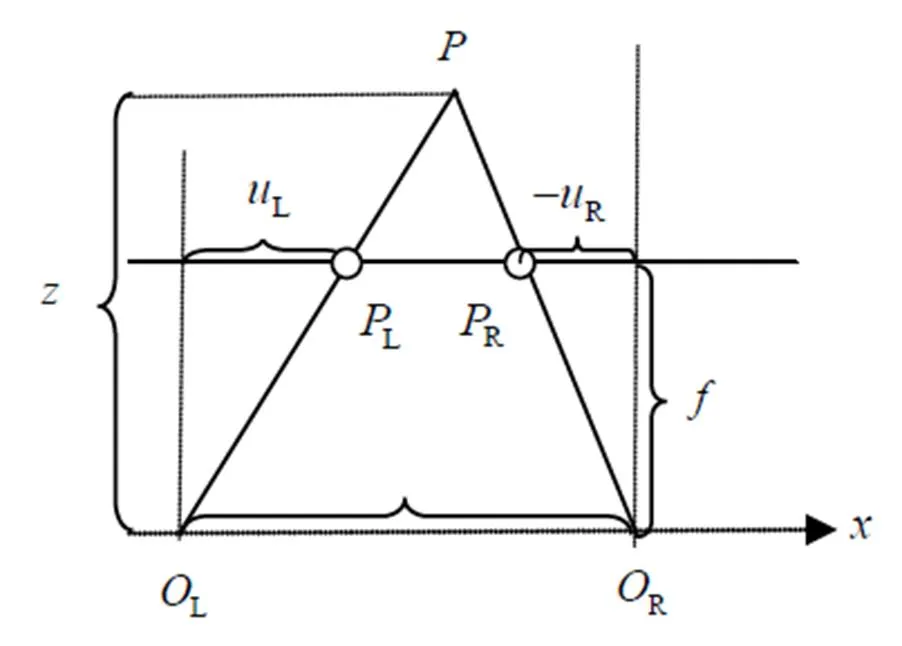

1.1.3双目模型

图4 双目相机几何模型图

1.2 3D图像重建

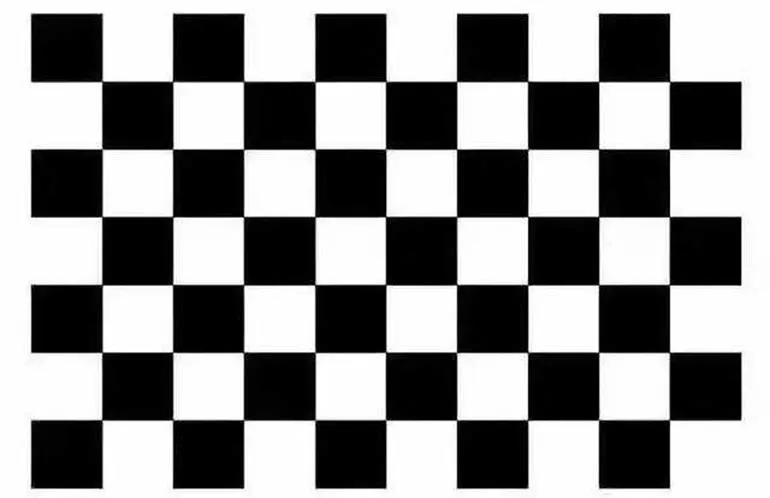

图5表示3D图像重建流程,所用的仪器设备如下:双目相机选用金乾象K4A418-D宽动态双目相机;摄像头选用4.3 mm无畸变镜头;灯箱选用的是标准LED灯箱;标准色卡为DigiEye 240色卡(如图6);验证色卡为ColorChecker 24色卡(如图7);标定板选用棋盘格大小为9 × 6、方格尺寸为25 mm × 25 mm的标准标定板(如图8).从相机参数可以看出,本实验采用的双目相机由两个普通的网络相机构成,其成像质量和相机曝光参数控制等均与高端相机有一定差距,但两个相机较好地固定在一个支架上,形成一个完整的双目相机,适合于本课题的探索性实验工作.

图5 3D图像重建流程

图6 DigiEye 240色卡

图7 ColorChecker 24色卡

1.2.1 图像采集

1)编写图像采集代码,代码中设置图像亮度、对比度、饱和度、色相、增益和曝光量,控制相机的拍照参数保持不变.

2)将标定板置于标准LED灯箱,如图9所示,光源设置为D65光源,双目相机位于灯箱外,调节双目相机基线,双目相机画面分割成左右大小为640 × 480像素的图像,保持镜头中心正对棋盘格,拍摄左右标定图片.

3)旋转标定板,改变标定板与双目相机之间距离,拍摄左右标定图片共16对.

4)在相同的位置,拍摄重建的DigiEye 240色色卡和ColorChecker 24色色卡.

图8 标准棋盘格(9 × 6)

图9 图像采集

1.2.2 双目相机标定

本文采用由张氏平面标定法改进的双目立体视觉标定方法,将16对棋盘格图像经过角点检测、单目标定、双目标定、相机校正、相机校正映射以及重映射等步骤,使左、右图像的同名点位于同一高度,计算出的均方根和平均对极线误差可以反映标定误差的大小.

1.2.3 立体校正

立体校正主要包括两方面:畸变校正和极线校正.通过去畸变、相机校正映射以及重映射等步骤,使左右校正图像的同名点位于同一高度,提高立体匹配算法精度.

1.2.4 立体匹配

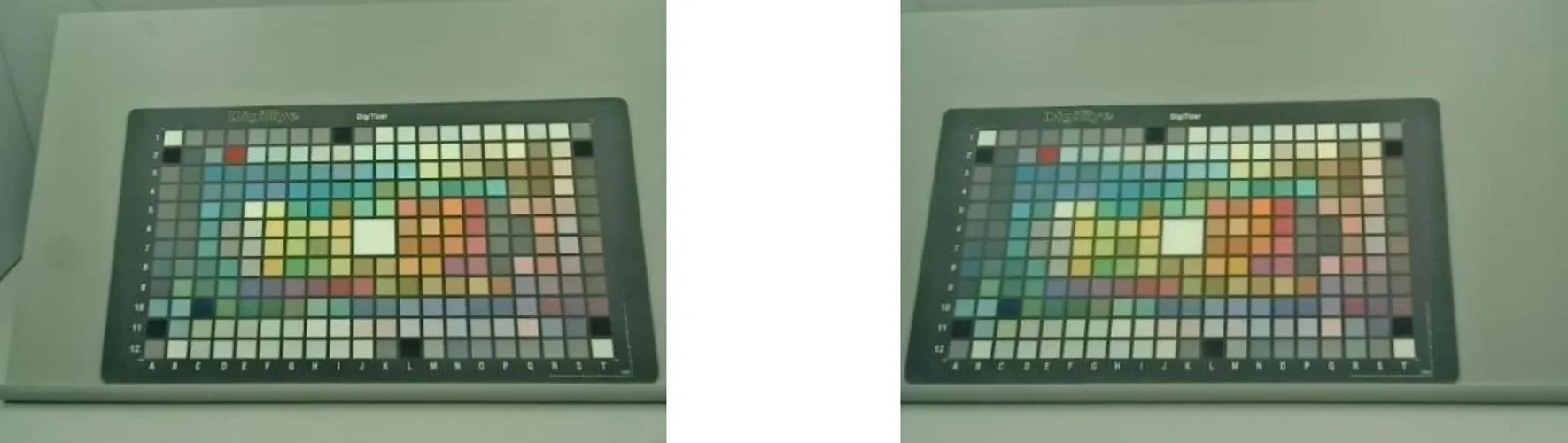

双目立体视觉中最为关键的技术是图像的匹配.本文采用的立体匹配算法包括SGBM和AD-Census,两种算法的输入均为立体校正后的DigiEye 240色卡左、右图像,如图10所示.

图10 输入的左图和右图

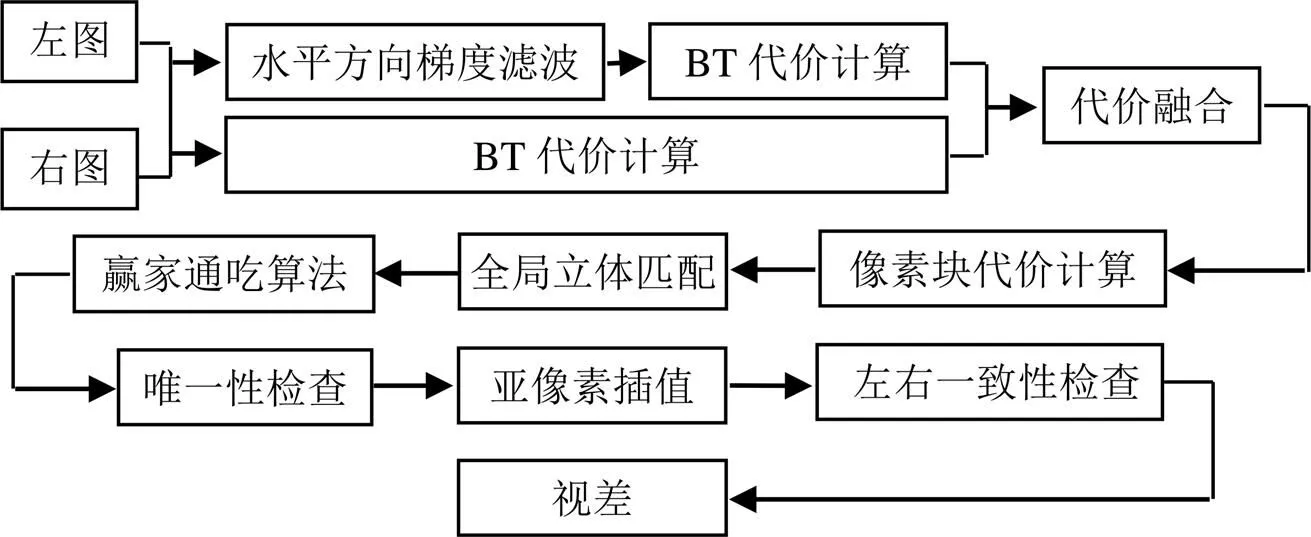

1)SGBM算法

SGBM算法流程如图11所示.匹配代价计算包括水平方向梯度滤波、BT代价计算、代价融合和像素块代价计算,代价聚合采用全局立体匹配,视差计算采用赢家通吃算法,视差优化包括唯一性检查、亚像素插值和左右一致性检查.

图11 SGBM算法流程图

I)匹配代价计算

SGBM算法的匹配代价计算主要包含以下步骤:输入图像经过水平方向的梯度滤波处理后,计算BT代价[10],输入图像直接计算BT代价;将上面两步的代价值进行融合(相加);对上述步骤得到的代价值进行成块计算.

II)代价聚合

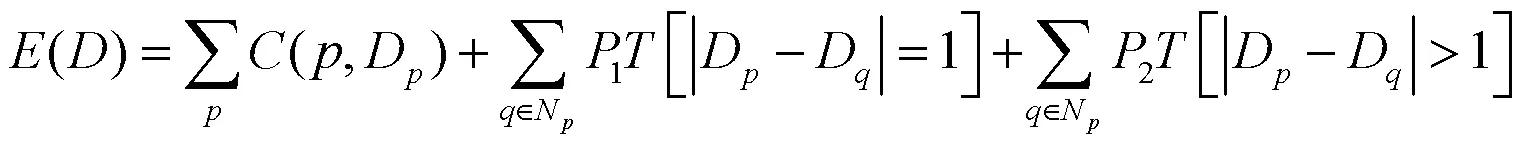

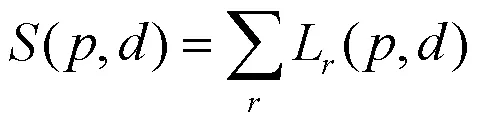

SGBM算法的能量函数为:

III)视差计算

在SGBM算法中,视差计算采用赢家通吃算法,每个像素选择最小聚合代价值所对应的视差值作为最终视差.

IV)视差优化

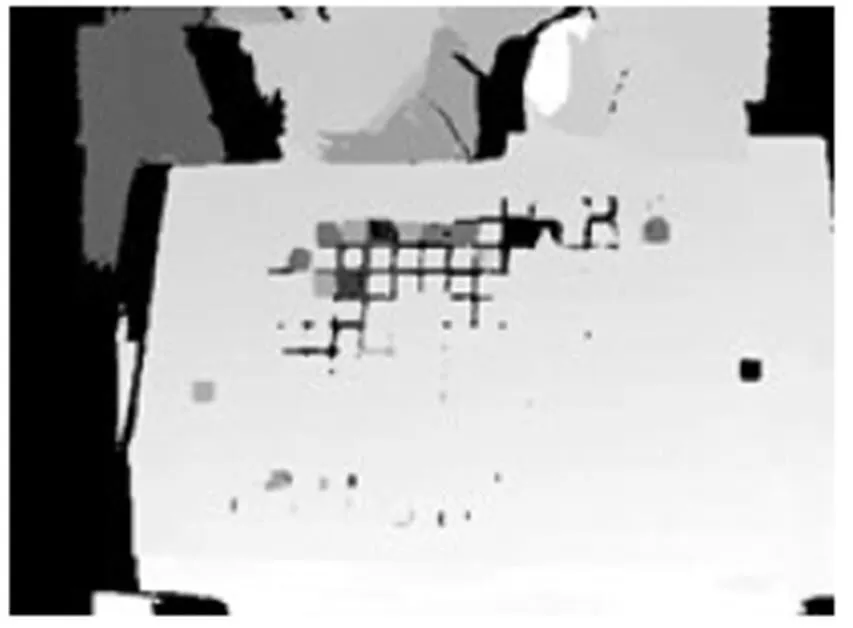

在文献[8]中,SGM算法作者Hirschmuller H提出了视差优化的概念,左右图像经过以上I)、II)、III)、IV)4个步骤,得到图12所示的SGBM算法视差图.图12中黑色部分表示无法匹配的区域,正上方表示匹配错误(由于弱纹理导致),没有实际意义,灰色部分(DigiEye 240色卡)表示视差连续区域,距双目相机越近的位置越亮,反之越暗.

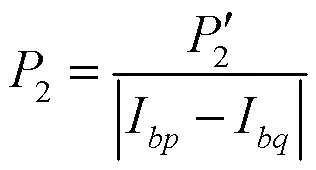

2)AD-Census算法

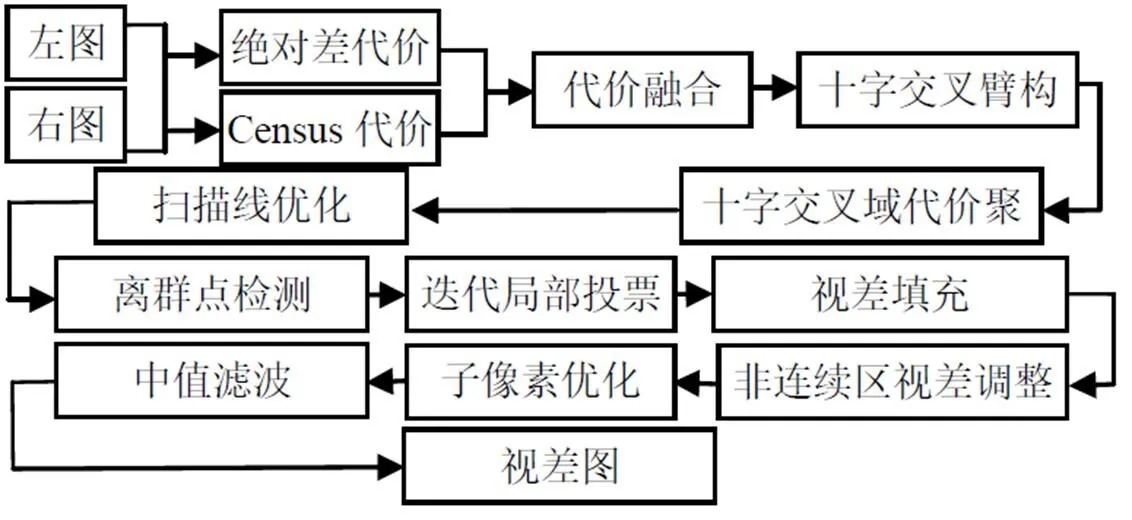

AD-Census算法流程如图13[11]所示,其中代价计算包括绝对差代价计算、Census代价计算和代价融合,代价聚合为十字交叉域代价聚合,视差优化包括离群点检测、迭代局部投票、视差填充、非连续区视差调整、子像素优化和中值滤波等.

I)代价计算

初始代价计算采用的是绝对差AD[13]和Census[14]变换结合的方法.AD法在重复纹理区域比Census法表现更好,Census法在弱纹理区域比AD法表现更好,而AD-Census法在两种场景下都是表现最好的.

II)代价聚合

AD-Census算法代价聚合采用的是十字交叉域代价聚合方法[15],主要分为两步.

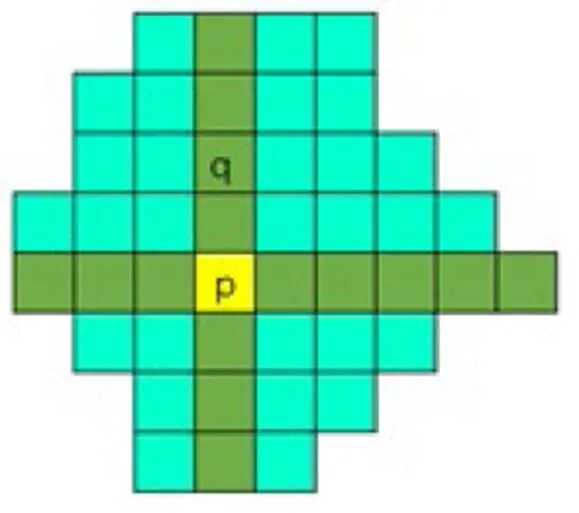

i)十字交叉域构造

图13 AD-Census算法流程图

图14 像素p的支持区域

ii)代价聚合

图15 两种支持区域的构造方法

iii)扫描线优化

iv)视差优化

在文献[13]中,视差优化分为多个后处理步骤,得到图16所示的AD-Census算法视差图.图16中不仅出现了弱纹理区域无法匹配的现象,灰色部分(DigiEye 240色卡)也出现了无法匹配的区域(黑色部分),该视差图误差较大.

本文采用了两种生成视差图方法,综合比较两种算法,最后采用SGBM算法生成了视差图(见图12).

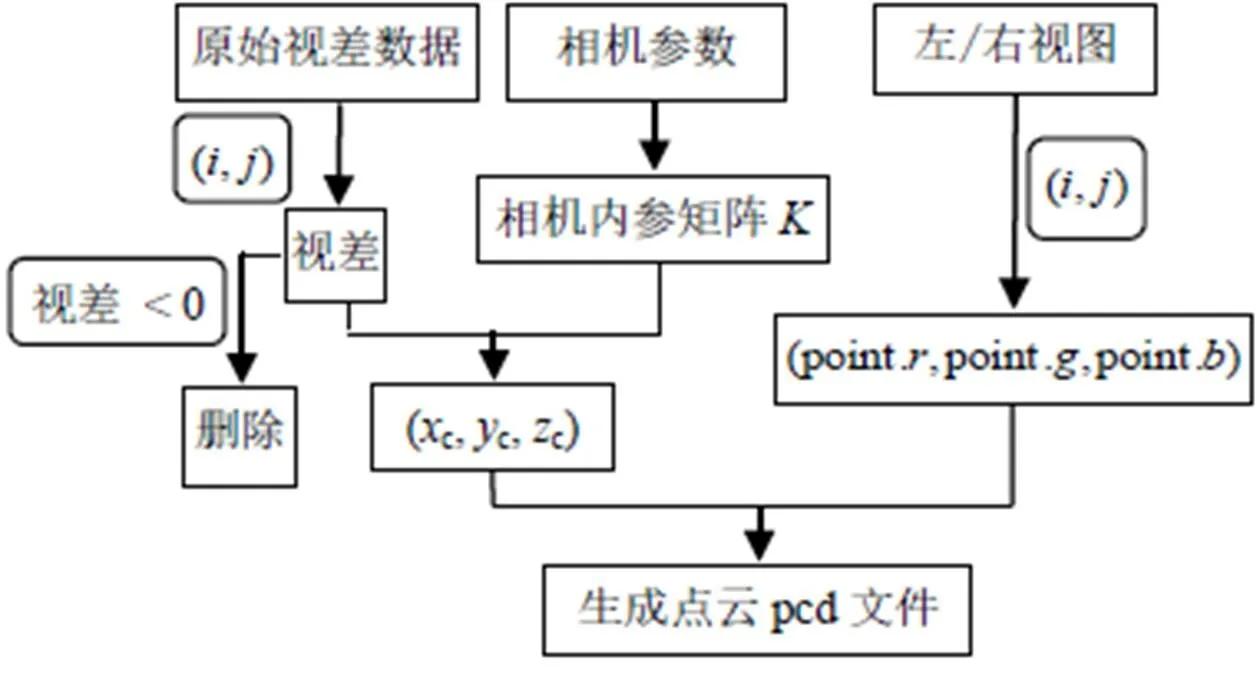

1.2.5 视差转点云

图16 AD-Census算法视差图

图17 视差转点云

1.2.6 点云可视化

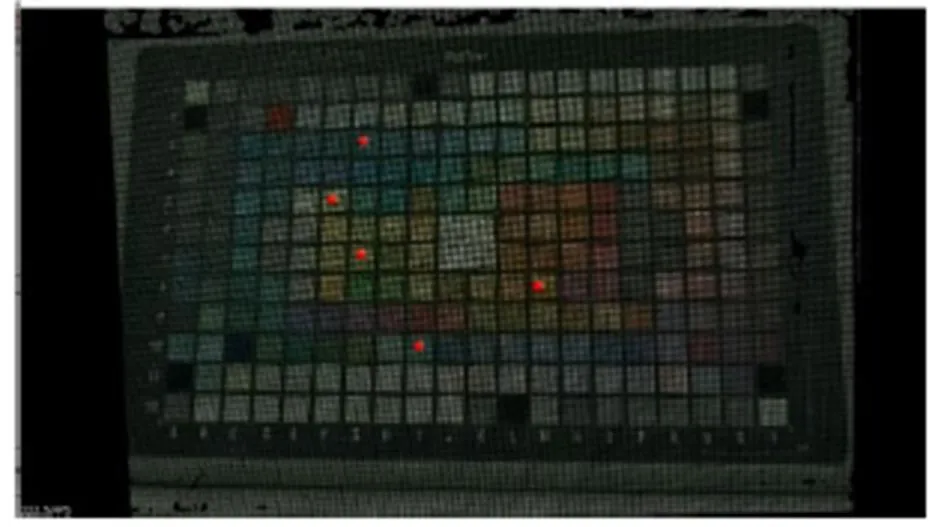

打开生成的pcd文件(如图18),点击色块点云,可得到240个色块不同的RGB值.

2 颜色测量

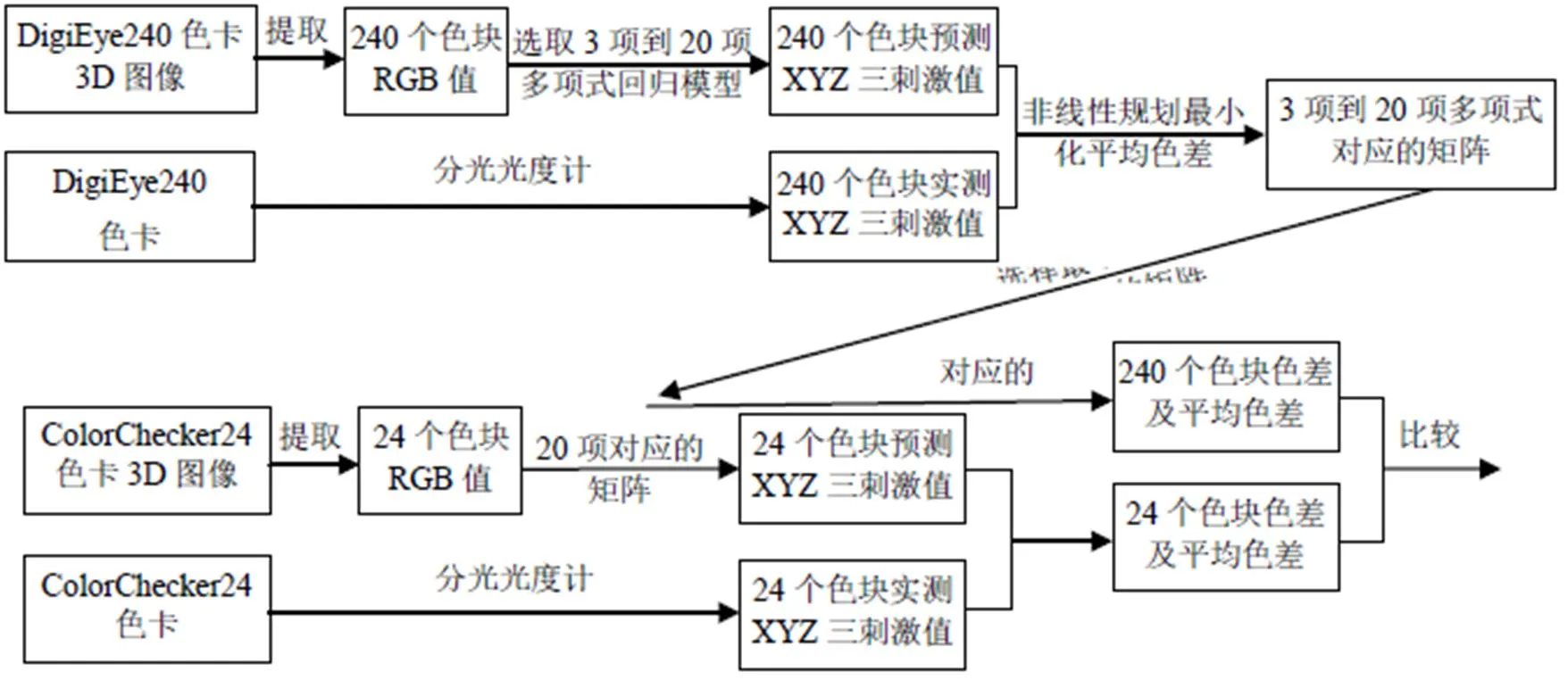

通过双目立体视觉重建出DigiEye 240色卡3D点云图(如图18)和ColorChecker 24色卡3D点云图(如图19),分别得到240个色块RGB值和24个色块RGB值,采用如图20所示的流程进行相机特征化和颜色测量.

图18 DigiEye 240色卡3D点云图

图19 ColorChecker 24色卡3D点云图

图20 相机特征化及颜色测量流程图

2.1 测量XYZ三刺激值

实验中采用X-Rite便携式分光光度计Ci64UV,测量DigiEye 240色卡和ColorChecker 24色卡每个色块在D65标准光源和CIE 1964标准色度观察者、包含镜面反射(SPIN)和去除镜面反射(SPEX)条件下的三刺激值XYZ[16].

2.2 3D相机颜色特征化

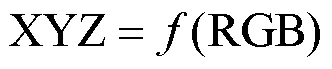

多项式回归模型的基本公式为:

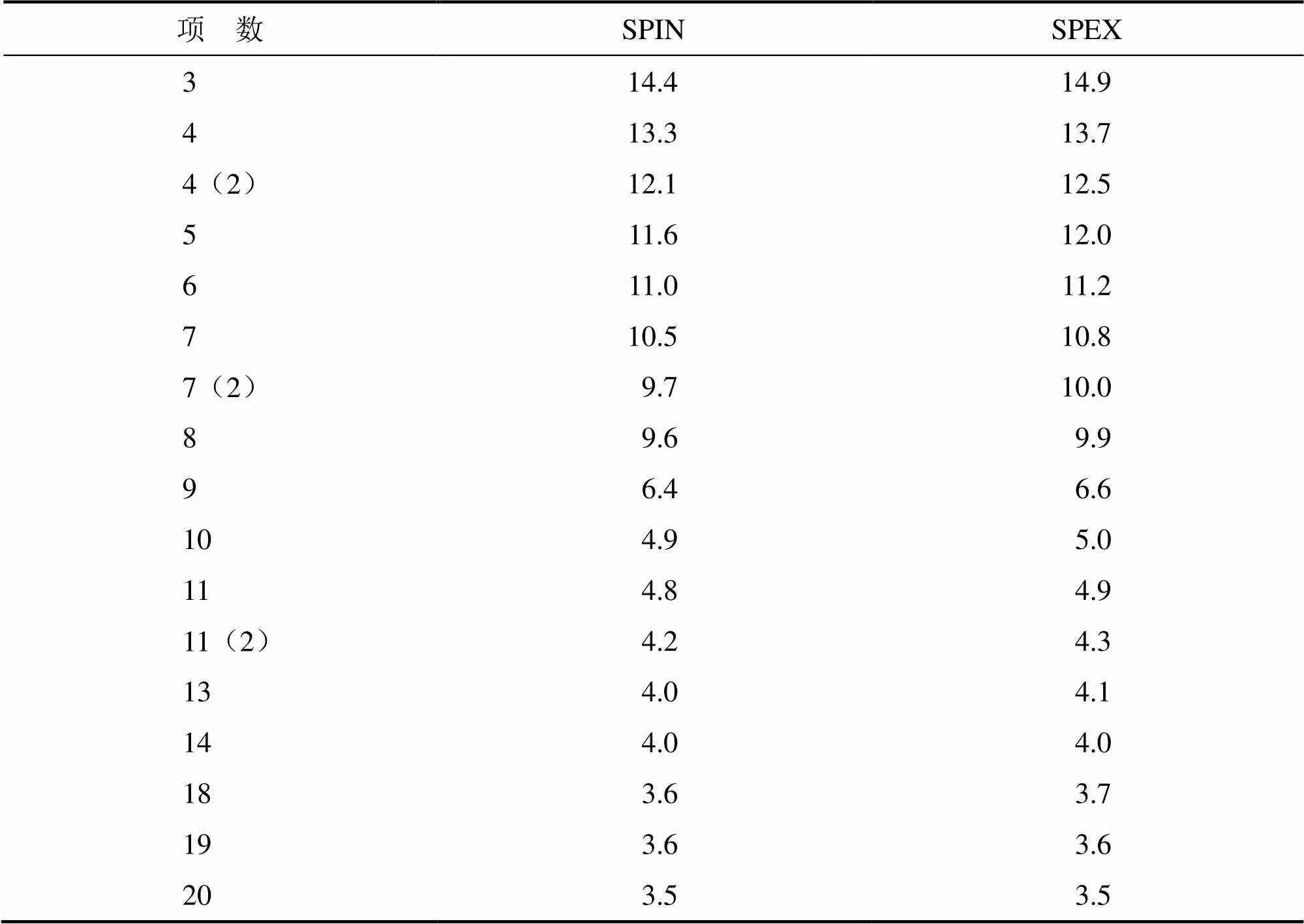

将测得的DigiEye 240色卡SPIN和SPEX三刺激值分别代入式(11),选定3至20项多项式,计算预测XYZ值与实测XYZ值之间的平均CIELAB[16]色差,利用非线性规划最小化平均色差,获取对应的多项式系数,结果如表1所示.

表1中4(2)、7(2)和11(2)分别表示项数是4、7和11,但是项数中参数发生变化.从表1中可以看出随着项数的递增,SPIN和SPEX的平均色差逐渐减小;当项数相同时,SPIN的平均色差小于或等于SPEX的平均色差;当项数为20时,SPIN和SPEX的平均色差达到最小,约为3.5.由此可得出包含镜面反射得到的模型要略优于排除镜面反射得到的模型的结论.

表1 平均色差

3 验证性实验

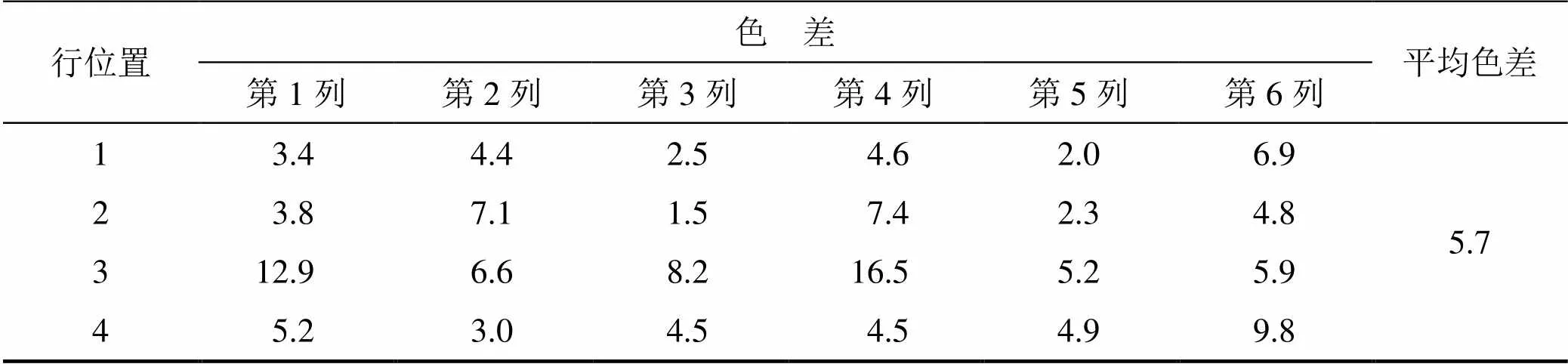

将ColorChecker 24色卡3D图像的24个色块RGB值代入20项SPIN训练模型,可以得到预测颜色XYZ,并与实测的XYZ计算CIELAB色差及平均色差值,结果如表2所示.

表2 ColorChecker 24色卡色差及平均色差

从表2可以看出,测量24色卡时平均色差为5.7,略大于3.5.造成平均色差过大的原因是第3行第1列、第3行第4列、第4行第6列等色块色差过大.这可能与双目相机传感器分辨率、镜头质量、位置、拍照参数以及光照不均匀等因素有关,更换高端相机有可能进一步改善测量精度,这需要进一步验证和改进.

4 结 语

本文提出了一种新的基于双目立体视觉的3D物体颜色测量方法.该方法利用经过参数标定和颜色特征化的双目相机采集被测物图像,并利用立体视觉理论重建被测物的3D图像,除了可提取物体表面像素点的空间几何信息外,还可以提取颜色信息,可以用于3D物体颜色的测量.实验中,对比了3项到20项的多项式回归模型的转换精度,确定了20项多项式为最佳且最稳定的相机特征化模型,模型训练误差约为3.5 CIELAB色差单位.以相同方法重建ColorChecker 24色卡3D图像,检验颜色测量模型的误差为5.7 CIELAB色差单位,略大于3.5.本文通过实验验证了该方法的可行性,后续将展开更深入的研究,以提高该方法测量像素点的空间坐标几何信息和颜色信息的精度.

[1] 黄鹏程, 江剑宇, 杨波. 双目立体视觉的研究现状及进展[J]. 光学仪器, 2018, 40(4): 81-86.

[2] 刘建伟, 梁晋, 梁新合, 等. 大尺寸工业视觉测量系统[J]. 光学精密工程, 2010, 18(1): 126-134.

[3] Zhang Z. A Flexible New Technique for Camera Calibration [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2000, 22(11): 1330-1334.

[4] Zhu S, Li Z. Local Stereo Matching Using Combined Matching Cost and Adaptive Cost Aggregation [J]. KSII Transactions on Internet & Information Systems, 2015, 9(1): 224-241.

[5] Yang Q. Stereo Matching Using Tree Filtering [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2014, 37(4): 834-846.

[6] Wang D, Lim K B. Obtaining Depth Map from Segment-based Stereo Matching Using Graph Cuts [J]. Journal of Visual Communication and Image Representation, 2011, 22(4): 325-331.

[7] Hirschmuller H. Accurate and Efficient Stereo Processing by Semi-global Matching and Mutual Information [EB/OL]. [2020-12-20]. https://ieeexplore.ieee.org/abstract/document/1467526.

[8] Hirschmuller H. Stereo Processing by Semiglobal Matching and Mutual Information [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2007, 30(2): 328-341.

[9] Kim J. Visual Correspondence Using Energy Minimization and Mutual Information [EB/OL]. [2020-12-20]. https://ieeexplore.ieee.org/abstract/document/1238463.

[10] Birchfield S, Tomasi C. A Pixel Dissimilarity Measure That Is Insensitive to Image Sampling [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1998, 20(4): 401-406.

[11] Mei X. On Building an Accurate Stereo Matching System on Graphics Hardware [EB/OL]. [2020-12-20]. https://ieeexplore.ieee.org/abstract/document/6130280.

[12]金肖克, 李启正, 张声诚, 等. 织物颜色测量方法的分类与发展[J]. 纺织导报, 2012(9): 103-105.

[13] Wang L. How Far Can We Go with Local Optimization in Real-time Stereo Matching [EB/OL]. [2020-12-20]. https://ieeexplore.ieee.org/abstract/document/4155719.

[14] Zabih R, Woodfill J. Non-parametric Local Transforms for Computing Visual Correspondence [EB/OL]. [2020- 12-20]. https://link.springer.com/chapter/10.1007/BFb0028345.

[15] Zhang K, Lu J, Lafruit G. Cross-based Local Stereo Matching Using Orthogonal Integral Images [J]. IEEE Transactions on Circuits and Systems for Video Technology, 2009, 19(7): 1073-1079.

[16] Commission Internationale de l’Éclairage. Colorimetry [M]. Vienna: Central Bureau of the CIE, 2004: 16-20.

[17] Hong G, Luo M R, Rhodes P. A Study of Digital Camera Colorimetric Characterization Based on Polynomial Modeling [J]. Color Research and Applications, 2001, 26(1): 76-84.

Study of Color Measurement Method Based on Binocular 3D Stereo Vision

SHENG Yancong, CUI Guihua, WU Ziran

(College of Electrical and Electronic Engineering, Wenzhou University, Wenzhou, China 325035)

Traditional color measurement methods are aimed at planar objects, and are not suitable for color measurement of 3D objects, especially those with irregular 3D surfaces. With the rapid development of 3D color printing technology, a fast and direct 3D object color measurement method is urgently needed. Therefore, a color measurement method based on binocular 3D stereo vision was proposed. In a standard LED lighting cabinet, a binocular camera was first used to collect a standard checkerboard images to compute the camera parameters for reconstructing 3D images of objects; then a standard color chart was used for the camera color characterization to establish a mathematical model between 3D image RGB values and CIE XYZ tristimulus values; finally, the spatial geometric and color information of an object pixel from the reconstructed 3D image was extracted for measuring the geometrical dimension and color of the 3D object. In the experiment, a third order polynomial with twenty terms was trained from a low-profile network binocular camera and a DigiEye 240 color chart, the training error being about 3.5 CIELAB units; then a ColorChecker 24 color chart was used as test target, the average color difference of testing being about 5.7 CIELAB units, slightly greater than 3.5. The experimental results show that the proposed method has certain measurement accuracy, and can measure 3D objects that cannot be measured by traditional color measuring instruments.

Binocular Stereo Vision; Stereo Matching; Color Measurement

TP3

A

1674-3563(2022)01-0051-12

10.3875/j.issn.1674-3563.2022.01.007

本文的PDF文件可以从www.wzu.edu.cn/wzdxxb.htm获得

2020-12-26

国家自然科学基金(61775170);温州市重大科技创新攻关工业项目(ZG2019017);温州市工业科技项目(ZG2020049)

圣延聪(1994― ),男,安徽芜湖人,硕士研究生,研究方向:计算机视觉.

通讯作者,gcui@wzu.edu.cn

(编辑:王一芳)

(英文审校:黄璐)