结构主导目标检测中的纹理随机化

2021-08-24毕道明周颉鑫孙晓亮于起峰

王 梓,毕道明,周颉鑫,孙晓亮,于起峰

(1. 国防科技大学 空天科学学院, 湖南 长沙 410073;2. 国防科技大学 图像测量与视觉导航湖南省重点实验室, 湖南 长沙 410073; 3. 沈阳飞机设计研究所, 辽宁 沈阳 110035)

目标检测是计算机视觉中的基础问题,在机器人抓取[1]、遥感图像处理[2]等领域具有广泛应用。基于卷积神经网络(Convolutional Neural Network, CNN) 的目标检测算法得益于大规模高质量标注的训练数据集,取得了当前最优的检测性能。本文关注变纹理目标的可靠检测。受工艺加工、应用需求、复杂光照等因素的影响,同一目标在纹理上可能存在巨大差异(如图1所示),已有基于 CNN 的目标检测算法倾向于提取目标纹理特征,而非目标的结构特征。因此,相关方法不能有效地实现图1所示变纹理目标的可靠检测。

图1 变纹理目标图像示例Fig.1 Sample images of a texture-varied object

目标结构特征是目标检测中的重要依据,表征目标结构特征的梯度方向直方图(Histogram of Gradient, HoG)特征[3]已被广泛应用于目标检测中[4-6]。Aubry等[4]采用HoG特征提取目标结构特征,并结合线性分析(Linear Discriminant Analysis, LDA)方法,在仿真图像数据集上完成目标检测器的训练,实现了仅基于目标结构特征的可靠目标检测,对光照变化、纹理差异等干扰表现出来较强的鲁棒性。在文献[5]的基础上,Lim等[6]引入目标局部结构区分度评价及可变形部件思想,进一步提升目标检测性能。Hariharan等[7]对HoG特征进行改进,提出白化方向直方图(Whitened Histograms of Orientations,WHO)特征,并应用于目标检测中。

深度特征表征方法在特征表示能力上优于传统特征表征方法。因此,基于CNN的目标检测算法[8-9]取得了明显优于传统方法的目标检测性能。但Geirhos等[10]指出,已有基于CNN的目标检测方法倾向于提取目标的纹理特征,而非目标的结构特征,限制了已有目标检测模型的泛化性能,尤其是针对本文关注的变纹理目标情况。Zaech等[11]通过生成式对抗网络(Generative Adversarial Network, GAN)[12]丰富训练数据中的纹理类型,有效降低了语义分割模型对纹理的拟合并成功应用于无人驾驶任务中。

相比于纹理特征,目标结构特征对干扰更具有鲁棒性,有益于实现可靠的目标检测。受文献[4, 10-11]的启发,本文针对变纹理目标的检测,提出一种新的基于纹理随机化的结构主导目标检测方法,依据目标三维模型,借助Blender渲染引擎,通过修改目标模型纹理贴图,构建纹理随机化仿真训练数据集,并训练目标检测器,降低模型对纹理特征的拟合程度,实现目标结构特征主导的目标检测。

1 相关工作

本文借助Blender渲染引擎构建纹理随机化仿真训练数据集,实现结构主导的变纹理目标检测。接下来,对与本文密切相关的已有工作进行简要梳理。

1.1 传统基于结构特征的目标检测方法

目标结构特征被广泛应用于目标检测,如被大家所熟知的HoG特征。Aubry等[4]以椅子为研究对象,采用HoG特征及LDA,在仿真图像数据集完成检测器训练,依据目标结构特征实现图像中椅子目标的可靠检测,并给出了粗略的位姿估计结果,方法对纹理差异、光照变化等干扰表现出了较强的鲁棒性。Lim等[5]同样采用HoG特征提取目标结构特征,引入区分度度量,筛选出目标模型上区分度高的结构特征用于分类器的训练,并依据目标不同部位结构特征的几何约束,剔除误匹配,提升算法的目标检测性能。在文献[6]中,作者进一步引入可变形部件处理思想,提升了算法目标检测的准确率及效率。为适应光照变化等干扰,Hariharan等[7]基于梯度方向信息提出WHO 特征,Choy等[13]进一步引入阈值处理,提出NZ(non-zero)-WHO特征,以消除仿真训练图像中背景区域带来的干扰,并采用共轭梯度算法高效求解线性分类器权值。

1.2 基于形状和纹理的特征描述

形状描述子抽取形状的特征参数以描述形状,以实现形状检测、配准以及目标识别、检测、跟踪等。基于形状边界或形状二值图像的形状描述子,将形状视为基函数的线性组合,例如Fourier描述子[14]、Chebyshev描述子[15]、Zernike矩[16]等。基于线性组合的形状描述子表达了目标的整体形状属性,缺少对目标空间关联属性的描述。基于空间关联关系的形状描述子充分利用了形状的局部细节信息,但是计算量较大,且难以重构出原始形状。

纹理是物体表面的内在属性,纹理特征也常被用于目标表示中。结构法、统计法和频谱分析法是纹理特征提取的主要方法。结构法将纹理视为一系列纹理基元的规律性排列,主要适用于周期性纹理的提取和分析;统计法以纹理图像灰度值空间分布的统计信息作为纹理特征,例如灰度共生矩阵[17]等;频谱分析法通过Gabor变换、小波变换等方法,分析纹理图像的频谱信息。

基于形状和纹理的特征描述方法具有一定的特征提取和表达能力,在手工视觉特征领域具有重要地位。近年来随着对深度卷积神经网络的研究的不断深入,研究人员发现卷积网络中较低层的卷积类似于边缘、纹理提取算子,随着网络层数的不断增加,捕捉到的语义特征更加抽象、复杂。因此,使用深度卷积网络可以获得比手工描述子更加丰富的目标特征。

1.3 纹理偏移及纹理随机化

Wohlhart等[18]针对基于目标三维模型的目标检测问题,对比分析了CNN模型提取的深度特征及HoG特征等传统特征。实验结果表明:深度特征的表征能力优于HoG特征,取得了更优的目标性能。基于CNN的目标检测算法取得了当前最优的目标检测性能,相关算法一般采用端到端的处理流程,内部特征提取部分无法获知,对于基于CNN的目标检测模型中特征提取的解释主要有外观和纹理两个假设[10]。Geirhos等[10]在ImageNet数据集[19]上针对目标检测任务进行测试。实验结果显示:CNN模型偏重于提取目标纹理特征,存在纹理偏移,甚至仅利用纹理特征即可完成目标识别任务。

纹理偏移严重限制了基于CNN的目标检测方法的泛化能力,研究人员尝试通过增加纹理的随机性降低模型对纹理特征的依赖。Tobin等[20]针对工业机器人抓取应用中的目标检测需求,利用目标三维模型,借助仿真引擎生成仿真图像训练数据集,在生成数据集的过程中,选用1 000种纹理,增加了纹理的随机性,显著提高了模型的泛化能力。Ren等[21]采用相似的处理策略,提升了模型的检测率及位姿估计的精度。Zaech等[11]将纹理随机化策略应用到无人驾驶场景语义分割中,并在真实图像数据上取得了满意的分割结果。文献[20-21]针对机器人抓取任务,在仿真图像生成过程中,采用的纹理贴图较为简单,尚不能满足复杂环境下变纹理目标检测的需求。本文在文献[20-21]的基础上,着眼于仅利用主要结构特征实现目标检测,以适应目标纹理变化的情况,提出更具针对性的纹理随机化方法。

2 方法

提出基于纹理随机化的结构主导目标检测方法,消除纹理偏移,使目标检测器基于目标结构特征实现变纹理目标的可靠检测。

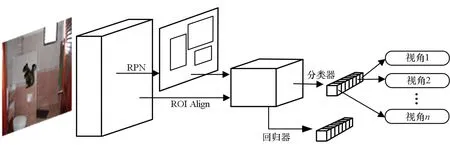

2.1 目标检测模型

采用 Faster RCNN 检测器[8-9]作为目标检测基本框架,如图2所示。Faster RCNN是第一个端到端的检测器,具有接近实时检测的性能。其主要组件包括用于提取特征的主干网络、用于生成锚框的锚框生成器、用于似物性检测的区域网络(Region Proposal Network, RPN)、用于提取特征图的ROI Align以及对proposal进行分类和回归的预测头。

在训练时将每个视角下的目标作为一个类别,并将视角标签编号作为分类分支监督信号,在测试时,完成输入图像中目标实例的检测,并输出对应的视角标签。

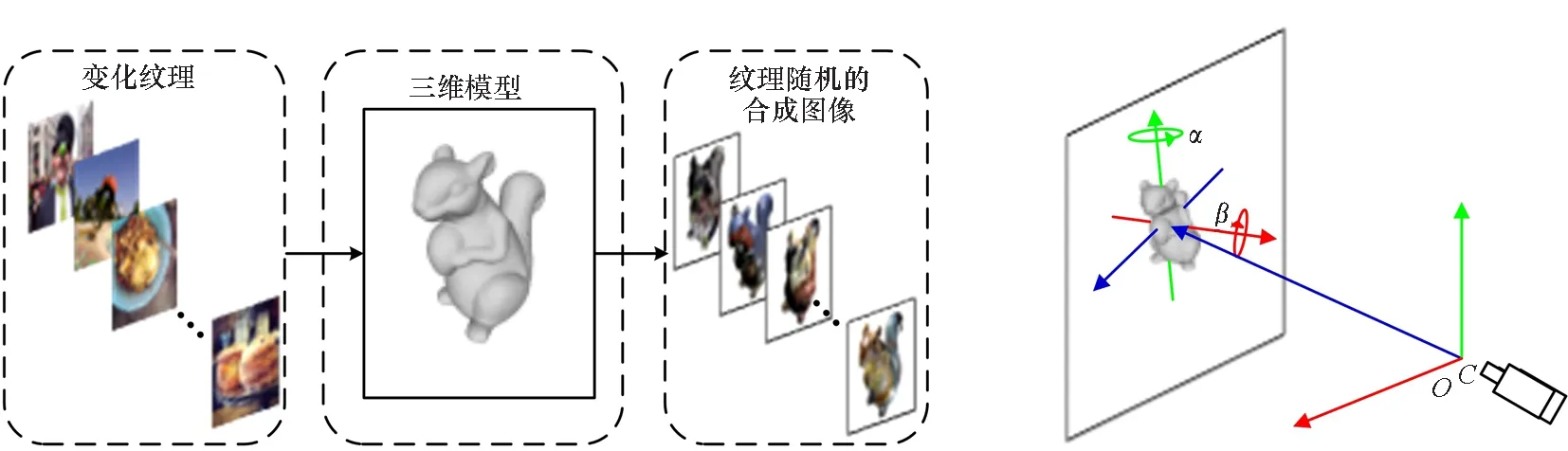

2.2 纹理随机化仿真数据集

为构建纹理随机化仿真图像训练数据集,利用目标的三维模型,借助Blender渲染引擎,通过改变目标模型纹理图像,生成变纹理仿真图像数据集,如图3所示。图3(a)中,纹理图像随机选取MS COCO数据集[22]中的自然图像。图3(b)中,虚拟相机指向目标中心,通过离散采样方位角α和高度角β得到不同视角下目标投影图像。

将每一视角下的目标作为一个类别,在构建仿真图像数据集时,采用如图3所示的视角采样方式,通过离散采样虚拟相机的方位角α和高度角β得到不同视角下的目标投影图像。为了仿真目标在图像平面内的运动,随机化目标模型在相机坐标系下的位置T=[Tx,Ty,Tz]T。除了保存采样视角作为仿真图像的类别标签,在仿真图像渲染过程中,同样保存每张仿真图片对应的深度图,用以生成精确的目标包络框与目标掩膜。

图2 Faster RCNN 检测器结构图Fig.2 Structure of Faster RCNN detecter

(a) 变纹理渲染(a) Texture-varied rendering (b) 纹理图像随机选自 COCO数据集(b) Viewpoint sampling图3 基于Blender的变纹理模型渲染及视角采样Fig.3 Blender based texture-varied 3D model rendering and viewpoint sampling

在仿真图像生成过程中,固定虚拟相机参数设置,每幅仿真图像中含一个目标。不同于文献[2, 4]仿真图像训练数据集生成中采用纯净背景的方式,本文对背景贴图和光照位置、能量进行了随机化处理。

3 实验结果与分析

3.1 实验设置

实验中目标模型为 RBOT 数据集[23]中的“squirrel”模型,如图3所示进行视角采样,方位角α和高度角β的采样范围分别为 [0°, 360°) 和[11.25°,78.75°],采样步长分别为22.5°及11.25°,共得到96个视角采样,对应96个目标类别。从 MS COCO数据集中随机选择K张不同的图片作为目标三维模型纹理,每个视角下得到K张包含不同纹理目标的仿真图像。背景图像从SUN 数据集[24]中随机选择,仿真图像尺寸为640像素×512像素。基于上述设置完成纹理随机化仿真图像数据集生成,记为SK。

为测试本文方法性能,在仿真及真实图像数据上进行测试,并给出定量衡量指标。在配备4块 1080Ti GPU 的电脑上完成模型训练,批量大小设置为12,优化器为随机梯度下降(Stochastic Gradient Descent, SGD)算法,基础学习率设为 0.01,迭代次数设置为50 000,在20 000和40 000时以比例因子0.1降低学习率,采用线性预热策略,其中预热长度为400步,优化器的权重衰减和冲量分别设为5×10-4和0.9。此外,在训练过程中采用以下数据增强方法:①几何变换包括尺度变换、旋转变换和透视变换;②图像变换包括高斯模糊、运动模糊、限制对比度自适应直方图均衡(Contrast Limited Adaptive Histogram Equalization, CLAHE)、对比度调整、RGB值偏移与通道调换、随机遮挡。

3.2 评价指标

采用平均准确率(Average Precision, AP)定量衡量检测器性能。AP被定义为不同召回率下的平均检测精度,通过计算P-R(precision-recall)曲线下的面积得到AP值越高代表检测性能越高。具体方法是,将检测器在测试数据集上的所有检测框按得分从高到低排序,根据设定的交并比(Intersection over Union, IoU)阈值判断每个检测结果是否正确,得到P-R曲线,然后计算P-R曲线下的面积。有多种P-R曲线下面积计算方法,VOC09[25]将召回率平均分为11等份,每个召回率下的准确率为该召回率下的最大值。IoU阈值越高,对检测框的定位要求越高,相应的AP值越低。

(1)

(2)

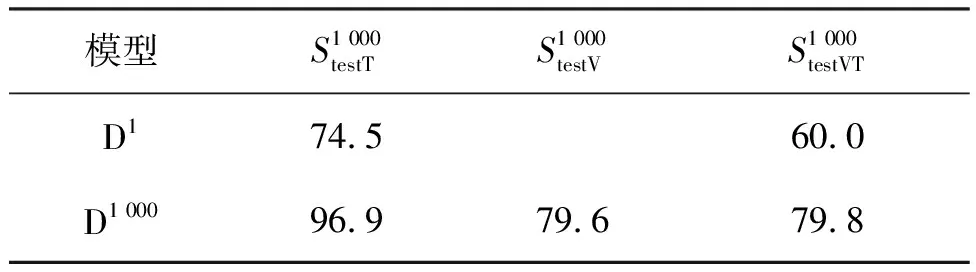

3.3 仿真图像数据实验

图4 D1 000模型在上的部分检测结果Fig.4 Partial detection results of D1 000 model on

表1 D1,D1 000在仿真数据集上的目标检测平均准确率

3.4 真实图像数据实验

采用真实图像数据对本文方法性能进行测试,目标检测模型完全基于纹理随机化仿真图像数据集训练得到,目标实物依据目标三维模型打印得到,并人工涂绘纹理,与训练数据集中纹理存在明显差异。在纹理随机化仿真图像数据集S1 000上完成目标检测模型的训练,在真实图像上进行目标检测。图6给出了部分目标检测结果示例,图中包含多目标、不同纹理、复杂光照等情况。本文方法实现了可靠检测,有效验证了方法性能。

图5 D1 000模型在数据集上的部分检测结果Fig.5 Partial detection results of D1 000model on

图6 真实图像数据目标检测部分结果Fig.6 Partial target detection results on real images data

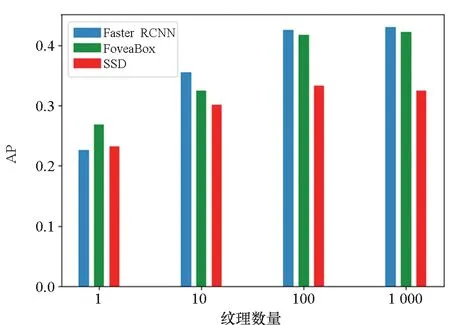

为定量分析纹理随机化程度对目标检测模型性能的影响,同前述S1及S1 000仿真数据集的生成设置,分别设置K=1,10,100,1 000,得到对应的仿真图像数据集,每个仿真图像数据集包含9.6×104张图像,并以此训练目标检测模型,对搜集的417张真实图像中的目标进行检测。选择了3种具有代表性的目标检测模型,Faster RCNN,SSD[26]和FoveaBox[27],分别代表两步检测器、一步检测器和无锚点检测器。在IoU>0.5的设置下,图7展示了3种目标检测模型在不同纹理数量下的AP得分。首先,随着纹理数量的增加,3种检测器的得分都得到了提高,说明本文方法可以作为一种有效的数据增强方法,提高不同类型的目标检测器对纹理随机目标的检测性能;然后,当纹理数量从100增加到1 000时,可以观察到3种目标检测器的AP得分几乎没有增长;最后,对比3种目标检测器的得分增幅,可知本文方法对基于锚点的两步检测器Faster RCNN的提升最大。

图7 纹理随机化程度对3种目标检测模型性能的影响Fig.7 Detectors performance increase with the number of unique texture.

仿真图像及真实图像上的测试结果验证了本文方法有效实现了变纹理目标的可靠检测。但在实验中也发现当输入图像中存在多个目标时可能会出现漏检。另外,在仿真图像上的检测结果优于真实图像,如表1及图7中所示,这是由于仿真图像与真实图像之间存在特性差异,仅使用仿真图像训练得到的目标检测模型推广到真实图像上依然存在不足。

4 结论

本文针对变纹理目标检测问题,提出一种新的基于纹理随机化的结构主导目标检测方法,利用目标三维模型,借助Blender渲染引擎,得到不同纹理的目标渲染,并随机化相机视角、光照等参数生成纹理随机化仿真数据集,并以此训练目标检测器,降低模型对纹理特征的偏移,实现结构主导的可靠变纹理目标检测。仿真及真实图像数据实验测试结果显示:本文方法可以有效地减弱网络模型对纹理的偏移,增强模型对目标结构特征的利用,实现变纹理目标的可靠检测。

本文方法仅使用纹理随机化的仿真图像数据完成目标检测模型的训练,依然受到仿真图像与真实图像之间差异的影响,在下一步工作中,可考虑引入域适应策略,提升该方法在真实图像上的性能。此外,可考虑将纹理随机化处理思路推广至基于单帧图像的目标6D位姿估计中,探索目标结构主导的单目6D位姿估计。