基于PINNs方法求解非定常Stokes方程

2021-06-07李峻屹

李峻屹

(陕西警官职业学院 信息技术系, 陕西 西安 710021)

0 引言

偏微分方程在物理化学、金融、工程等领域都有非常广泛的应用.但是针对实际应用问题,方程往往不存在解析解.因此对偏微分方程进行数值求解,传统的数值计算方法如有限差分方法[1,2]、有限体积方法[3,4]、有限元方法等[5,6],这类方法严格依赖于网格的属性.但在许多情况下生成网格非常耗时,特别是对于复杂区域.为了解决这一困难,学者们提出了各种无网格方法.如无网格局部Petrov-Galerkin,光滑粒子流体动力学方法[7]等,但是都伴随着耗时间、计算量大等棘手问题.

随着可用数据和计算资源的爆炸性增长,机器学习和数据分析的最新进展已经在不同的科学学科中产生了革命性的结果,包括图像识别、自然语言处理、认知科学和基因组学.然而,在分析复杂的物理、生物或工程系统的过程中,数据采集的成本往往过高,不可避免地面临着在部分信息下得出结论和做出决策的挑战.在这种小数据区域中,绝大多数最先进的机器学习技术(例如,深度/卷积/递归神经网络)缺乏鲁棒性,无法提供任何收敛保证.训练一个深度学习算法,从几个潜在的非常高维的输入和输出数据对中准确地识别非线性映射的任务看起来是不可行的.

为了使这一任务变得可处理,在许多与物理和生物系统建模有关的案例中,存在着大量的先验知识,可以将这种结构化的先验信息编码到学习算法中,即能够放大和充分利用所看到数据的信息内容,使算法能够快速地寻找到最优的解决方案,并且即使在只有少数先验信息的情况下,也能够很好地利用.结构化先验信息构建具有物理信息的高效的学习算法已经在[8-10]中有所体现.除此之外,也可使用高斯过程回归[11]设计适合于给定线性算子的函数表示,并且能够精确地推断解并提供不确定性估计.

在更新的研究中,Raissi等[12,13]在推理和系统辨识的背景下提出了对非线性问题的扩展.尽管高斯过程在编码先验信息方面具有灵活性,但非线性问题的处理引入了两个重要的局限性.

首先,在文献[12,13]中,必须在时间上局部线性化任何非线性项,从而限制了所提出的方法在离散时间域的适用性,并在强非线性区域中损害了其预测的准确性.

其次,高斯过程回归的贝叶斯性质需要某些先验假设,这些假设可能会限制模型的表示能力,并导致鲁棒性问题,尤其是对于非线性问题[14].而Stokes 问题的算法研究作为流体力学中十分活跃的一个研究方向。受文献[15]的启发,本文主要研究通过PINN结合先验物理知识求解Stokes问题,用数值算例验证本文所采用方法的有效性及高效性.

1 PINNs

众所周知,求解偏微分方程的数值方法有很多,如有限差分法、有限元法、谱法等,但这些方法都需要在偏微分方程的平面区域或者立体表面建立网格,这对于高维问题是复杂甚至不可能的.然而,除了传统的数值计算方法,无网格数值方法如径向基函数法,已经被证明是不稳定的[16].

随着神经网络的发展,卷积神经网络、DGM、生成式对抗网络等深度学习方法的应用越来越广泛,例如,在图像处理领域、工程仿真领域、卫星图像检测领域等.然而,在具体操作中,如文献[17]所示,正弦函数始终是最好的激活函数.在这种情况下,PINNs的输出可以理解为解的广义Fourier级数近似.训练过程实际上是求广义Fourier近似的最小二乘解.因此,最小二乘Fourier近似的稳定性和精度理论可以部分地解释PINNs的稳定性和精确性,这一点已经在的大量实验中得到了证明.

本文利用PINNs作为通用函数逼近器,其基本结构如图1所示.即可以在不进行局部线性化的情况下,直接处理非线性问题.根据神经网络的输入坐标和模型参数来区分以获得具有一定物理先验信息的神经网络.约束这类神经网络以遵守任何对称性、不变性或源自控制观测数据的物理定律,其一般由非定常非线性偏微分方程所描述.这种简单而强大的结构使我们能够解决计算科学中的一系列问题,如本文提出使用具有先验信息的PINNs求解非定常Stokes问题并在后面给出数值算例.

图1 神经网络示意图

2 数值算例

本文应用PINNs对二维非定常Stokes方程进行求解,进一步证明深度学习求解偏微分方程的可行性和有效性.通过将方程真解携带的先验信息作为神经网络的输入进行训练,在一定程度上避免了初始样本选择的盲目性.图2给出了本文所用算法的流程图.

图2 算法流程图

在流体力学中,由黏性不可压缩流体的动量守恒方程可以得到Navier-Stokes方程.但由于其中包含了非线性项,通常情况下很难求解.因此可根据实际情况,对模型进行简化.对于液滴在黏性流体中运动这一类问题,由于雷诺系数小,可以用Stokes方程来描述.设Ω是属于Rd(d=2,3,…)的有界子集,∂Ω为Dirichlet边界,ΩT表示[0,T]×Ω;考虑如下二维非定常Stokes问题:

ut-v2u+p=f,

(1)

(2)

u|∂ΩT=0,

(3)

u|t=0=0.

(4)

在本文中,d=2,u=u(t,x,y)=(u1,u2),p=p(t,x,y)分别表示速度和压力,f为右端项.其中式(2)称为不可压缩条件,式(3)和(4)分别表示边界条件和初始条件.T=(0,20],(x,y)=[1,8]×[-2,2].

(5)

式(5)中:N表示样本个数,U表示神经网络解,u表示真解.

本文使用每层具有20个神经元的PINNs网络对非定常Stokes问题进行求解,通过计算真解与逼近解之间的误差定义收敛函数.通过设置固定迭代次数或者满足收敛条件来终止训练.通过式(5)计算真解与逼近解之间的L2误差,本文只计算速度,压力类似,因此在本文中不多做赘述.

表1列出了不同网络层数及不同时间刻度下,真解速度u与神经网络解U的L2误差。本文将每个时间点中最优异的结果标黑.可以看出,随着层数的增加真解与逼近解之间的误差逐渐收敛到一个稳定的数量级上,并且能够在不同的时间上保持收敛.

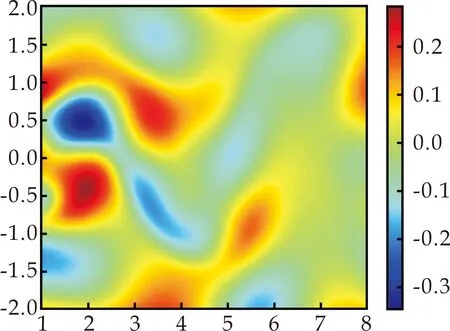

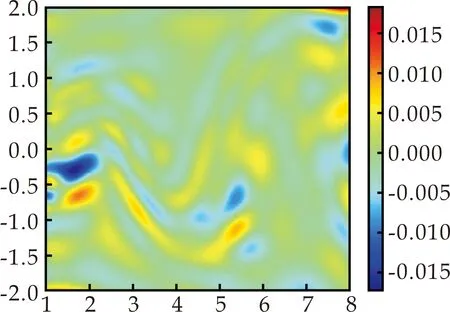

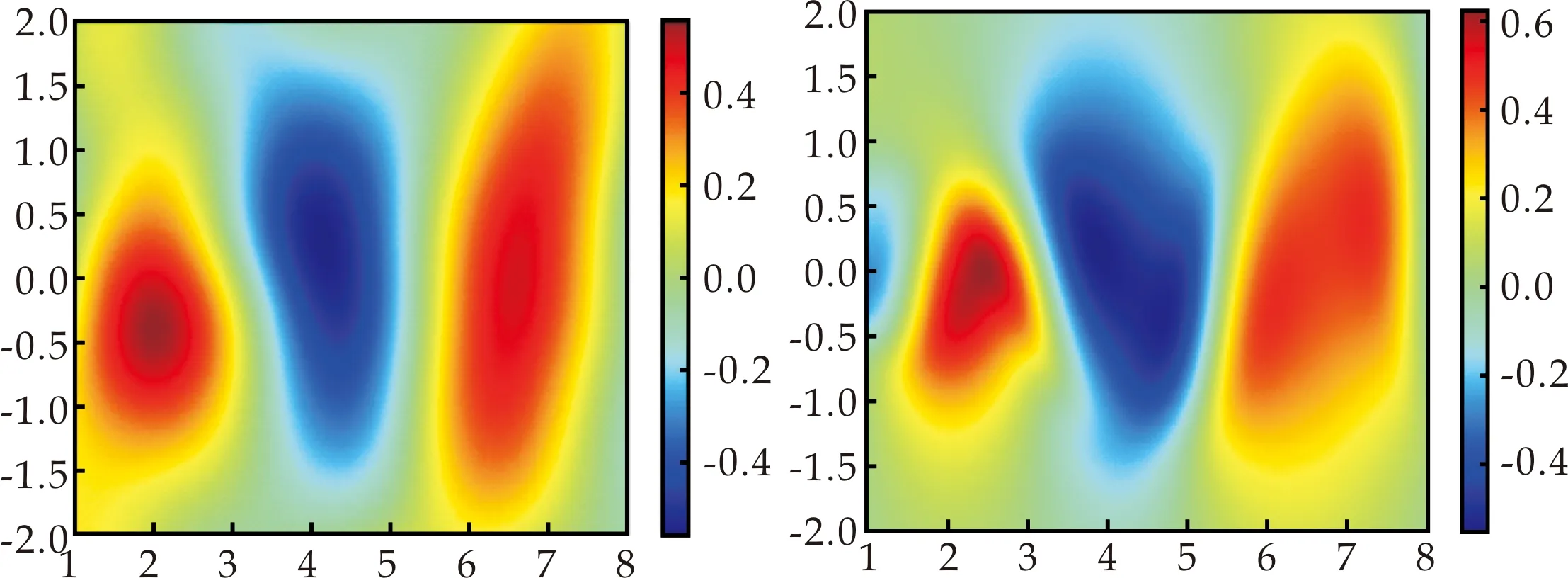

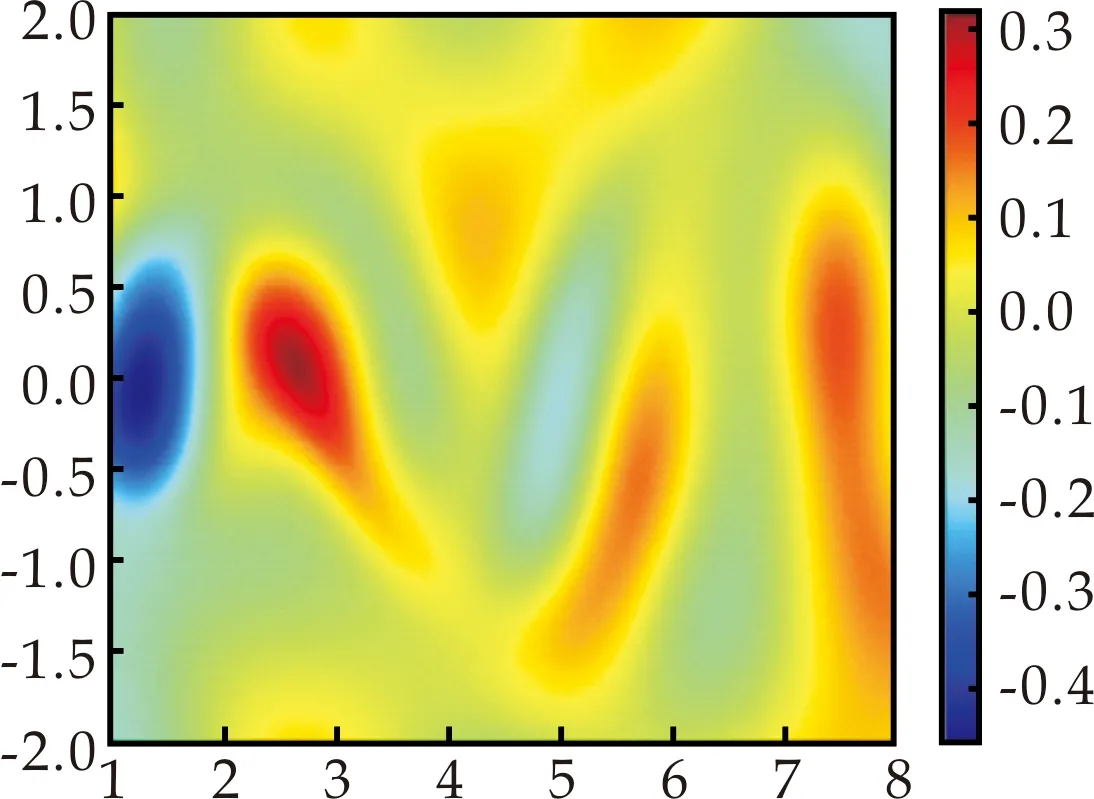

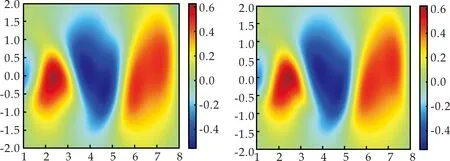

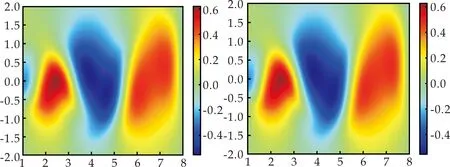

图3~8给出了在1个、3个和8个隐层下PINNs对速度u1和u2的逼近性能,更准确和生动地反映出了表1的信息.进一步说明了PINNs求解非定常Stokes问题的有效性和高效性.

表1 真解速度u与神经网络解U的L2误差

(a)u (b)U

(c)ERRL2图3 u1的L2误差图(1个隐层)

(a)u (b)U

(c)ERRL2图4 u1的L2误差图(3个隐层)

(a)u (b)U

(c)ERRL2图5 u1的L2误差图(8个隐层)

(a)u (b)U

(c)ERRL2图6 u2的L2误差图(1个隐层)

(a)u (b)U

(c)ERRL2图7 u2的L2误差图(3个隐层)

(a)u (b)U

(c)ERRL2图8 u2的L2误差图(8个隐层)

3 结论

本文利用 PINN求解Stokes问题,通过网络优化逼近真解与数值解之间的误差,并通过数值模拟证明理论的可行性,为之后高维问题的求解奠定了基础.