多相机非共视场的非合作圆特征位姿测量方法

2020-05-25宋代平

宋代平,陆 璐

〈测量技术〉

多相机非共视场的非合作圆特征位姿测量方法

宋代平,陆 璐

(重庆大学 机械工程学院,重庆 400030)

以大型光学模块转运时基于视觉的位姿测量为背景,利用目标底部同一平面的两个圆特征,针对大目标近距离对接时的环境限制,提出一种基于距离和角度约束的多相机非共视场位姿检测方法。对接时球头与锥孔正确对接,将两个相机分别固定于球头机构的内部后采集锥孔边缘的圆特征,利用非共视场成像的多相机标定获取两相机位置关系,融合多个相机的位姿信息,利用两圆共面和两相机位置关系约束剔除空间圆位姿解算时的虚假解。实验验证了该方法的精度,在1140mm的工作距离时,圆边缘特征的姿态角误差小于0.5°,圆心的计算误差小于1.0mm,实验结果表明该方法可准确计算位姿,结果可靠有效,在大目标近距离位姿测量时具有明显实用性。

机器视觉;位姿测量;多相机非公共视场;共面圆特征;距离约束;大目标近距离

0 引言

在激光实验中,光学模块的转运具有洁净度要求,大尺寸的光学模块在转运安装的过程中,从具有保持洁净功能的转运箱到安装模块的安装箱需精密对接,来保证模块所处环境的洁净度。转运箱与安装箱的对接为近距离自主式对接,而精确的位姿(两目标间的相对位置)测量是正确对接的关键技术。在近距离和超近距离的测量中,基于机器视觉的位姿测量是主要的高精度测量方法之一。现有的视觉位姿测量方法有基于合作目标和非合作目标两种。基于合作目标的测量法需要靶标上人为设置几何特征,而且标志器能在单相机或立体视觉相机中完整成像,人为设置的标志点能大大提高目标的检测精度[1-2]。安装箱的结构和洁净度要求,无法安装测量标志器,只能利用其上的现有特征来完成位姿检测。大量研究人员对单目非合作目标测量做了研究[3-6],而非合作目标在自然特征上往往分布不集中,在近距离的工况下更是无法完整成像。模块安装箱的底部两个用于对接的共面锥孔,可作为非合作目标提供空间圆特征和约束条件。单目视觉测量系统[7]结构简单,但单目在测量位姿时无法获得深度信息,目前的解决办法是进行多站测量或给被测目标几何约束。魏振忠等[8]通过在特征所在平面内的交叉线,根据欧氏空间中交叉线之间的角度不变性作为约束来剔除虚假解;陈至坤等[9]利用工业机器人做已知的平移运动从而有效剔除圆特征目标位姿的虚假解,并通过实验检测位姿但精度仍有限;苗锡奎等[10]对非共视场的测量进行了研究,结合手眼相机对不同特征检测和相机信息融合,提出基于点和直线特征的多相机测量方法,系统引入机械手应用范围有限,且与基于点特征和直线特征的位姿估计方法[11]相比,基于圆特征的测量在目标识别[12]、定位[13]等领域均有重要应用,圆定位不需要考虑复杂的对应问题,降低算法的难度。

虽然双目测量系统简单便捷[14],但对于很多近距离大目标而且目标特征无法在同一视场成像的场景,无法使用单目视觉给出几何约束进行测量位姿,也无法通过两个相机的公共视场立体测距。鉴于此,本文给出一种非共视场圆特征的多相机位姿测量方法。利用多个相机检测目标上更完整的视觉特征,融合多个相机的特征信息,给位姿检测提供几何约束,解出了近距离大目标的位姿参数。

1 多相机位姿解算原理

转运箱顶部的球头与安装箱底部锥孔近距离对接,两个锥孔的圆边缘特征始终处于同一平面且间距达1140mm,该方法是针对对接锥孔的圆边缘特征而设计。利用两个相机视野内的非合作圆特征完成安装箱的位姿测量是本方法要解决的问题。

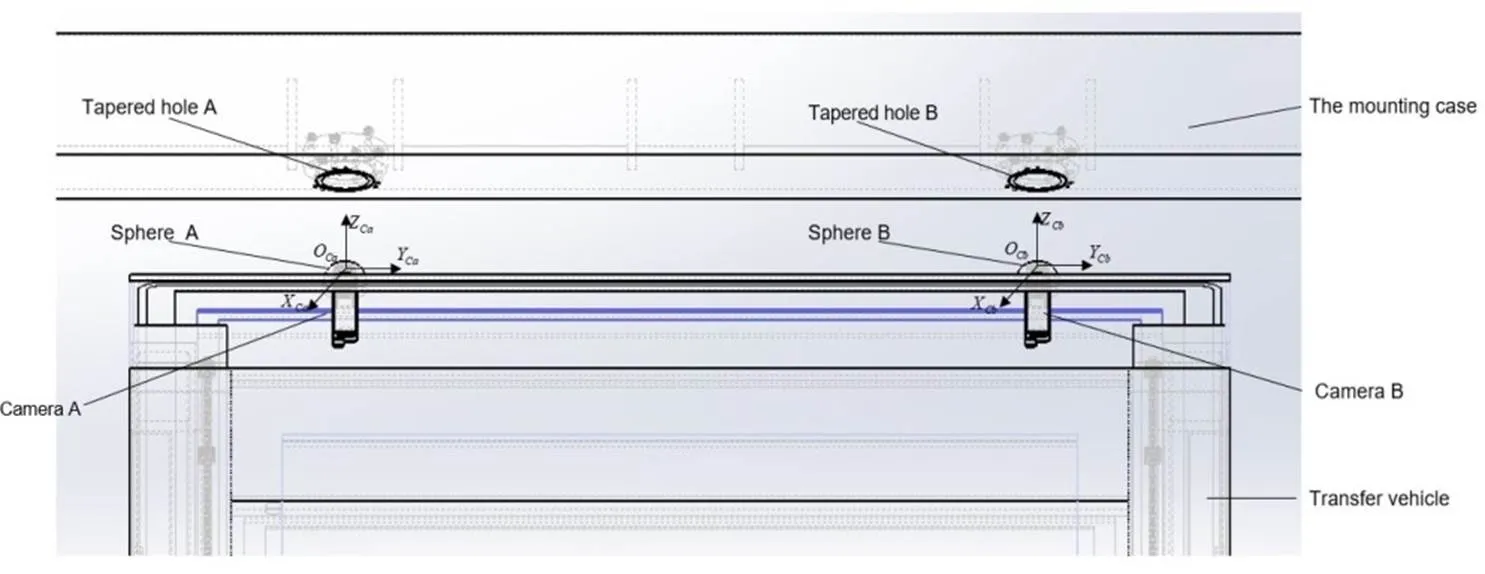

转运对接测量系统示意图如图1,其中包括多相机非共视场测量时的两相机固定安装配置方式。安装箱底部锥孔的边缘为检测标志圆和圆,锥孔圆心间距大小为1140mm,相机安装在球头内部,定义相机坐标系的、向如图1所示,原点为相机光心处,向为沿光心垂直圆平面的方向。初定位后满足圆特征在相机视场成像,本算法的解算结果为球头与锥孔正确对接时的调整量,实现与目标近距离精确对接。

1.1 坐标系定义及摄像机成像模型

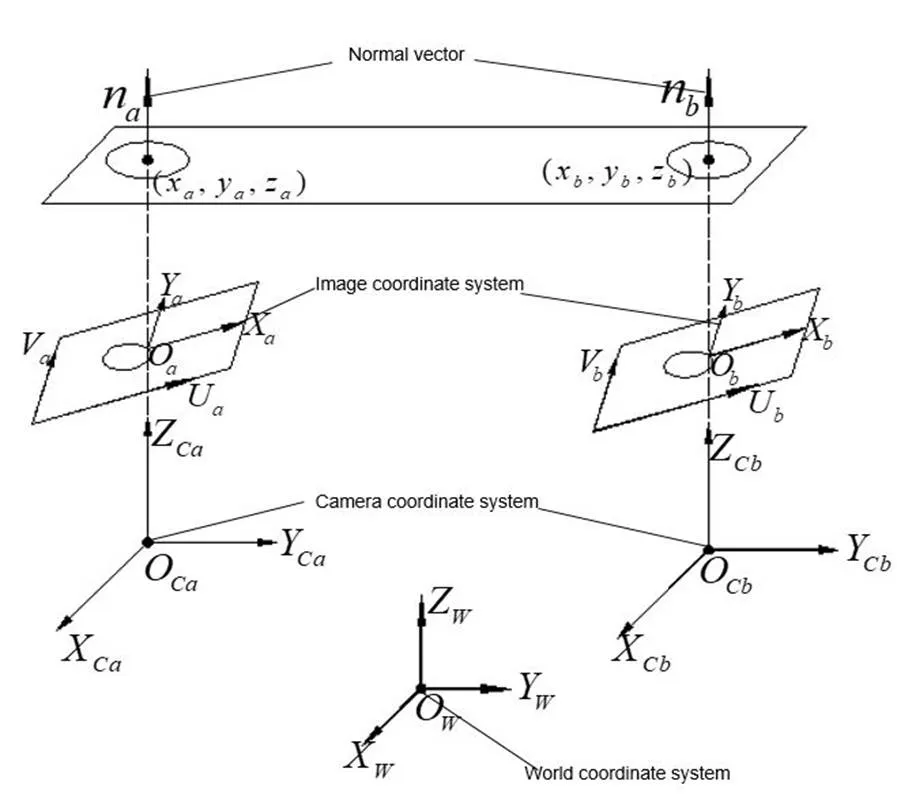

为便于分析,建立如图2的坐标系:其中A相机坐标系Ca-CaCaCa和像平面坐标系a-aa,B相机坐标系Cb-CbCbCb和像平面坐标系b-bb,世界坐标系W-WWW,单个相机标定之后与世界坐标系的关系确定,可分别在摄像机坐标系下求解出空间圆的支撑平面法向量和圆心坐标。

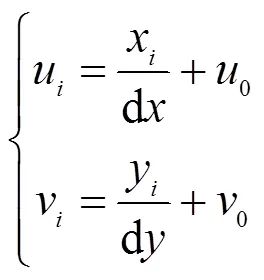

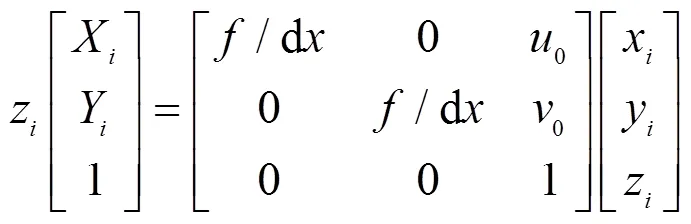

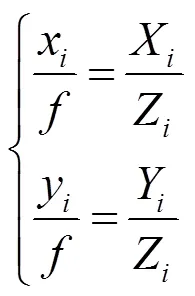

对于单个相机检测到的目标上的空间点P,在摄像机坐标系下的坐标表示为(X,Y,Z),点P通过摄像机镜头投影到图像物理坐标系的坐标为(x,y),图像物理坐标与图像像素坐标(u,v)之间的关系可以表示为:

图1 转运系统示意图

图2 坐标系定义

由针孔成像模型和公式(1),可将图像像素坐标系和摄像机坐标系间的关系表示为:

式中:为相机的焦距;(0,0)为摄像机成像平面的中心点坐标;d、d为单个像素在方向的尺寸;(0,0,, d, d)为需要通过标定得到的摄像机内参数。

1.2 空间圆参数求解

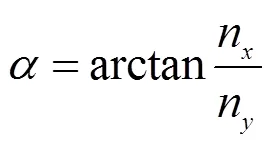

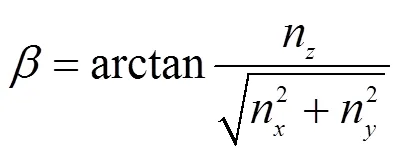

一般情况(除空间圆成像为直线)下,空间圆形特征投影到图像坐标系为椭圆,假设圆形特征半径为,光心与成像椭圆所形成椭圆锥面,若用一个平面去切割该圆锥且截线为半径的圆平面,此圆环面的中心包含圆特征的位置坐标信息,平面的法向量(n,n,n)包含了圆特征的姿态信息,能确定三维空间中的圆形姿态的2个自由度(圆形特征围绕着过其圆心的法向量旋转具有对称性),即俯仰角和偏转角。其中俯仰角定义为法向量与XOY平面的夹角,偏转角为法向量在XOY上的投影线与轴正方向的夹角。根据数学计算有

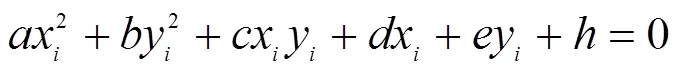

某位置的圆特征在图像物理坐标系投影成像为椭圆,通过图像处理可以获取该椭圆投影的方程:

而摄像机的针孔成像模型为:

联立公式(5)、(6)可获得光心与成像椭圆所形成的椭圆锥的方程:

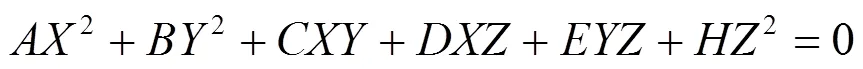

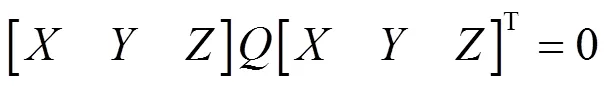

将式(7)用二次型表示为:

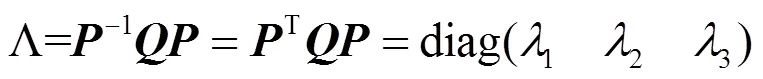

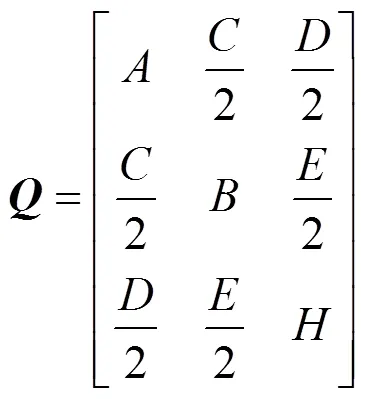

由矩阵知识可知必为实对称阵,必然可对角化,即存在矩阵,使得:

其中为:

为了避免在摄像机坐标系进行复杂计算,故将其变换到标准坐标空间进行描述和计算,便于清晰表达位姿参数,解算出结果后需再变换回摄像机坐标系。

故令[]T=[¢¢¢]T,并将此变换带入到式(8)可以得到标准二次型:

[¢¢¢]-1[¢¢¢]T=0 (11)

即把椭圆锥方程变换到以¢为旋转轴的标准坐标系中:

1¢2+2¢2+3¢2=0 (12)

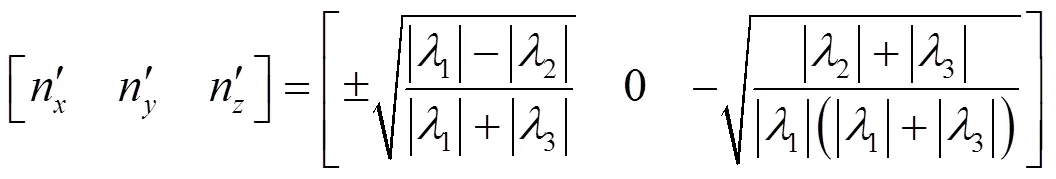

式中:由标准椭圆锥的性质,1、2、3中必有2个值符号一样且与另一个相反。因此可以求得圆特征在标准坐标系下圆的支撑平面过圆心的法向量(n¢,n¢,n¢)和圆心坐标[x¢,y¢,z¢]分别为:

最后变换到摄像机坐标系下:

[xo yo zo]T=P[xo¢yo¢zo¢]T (15)

[nxnynz]T=P[nx¢ny¢nz¢]T (16)

1.3 多相机位姿测量原理

由1.2节的分析可知,在没有约束的条件下,一个相机成像的圆在位姿解算时得到了两组解,在大目标近距离的工况下,单个相机很难同时采集有效的特征和约束信息,故本文提出用两个非共视场的相机分别采集两个圆特征,提供距离和角度约束消除虚假解。

在大目标近距离测量时,可供检测的非合作目标的特征距离远,两个相机无法形成公共视野,因此无法使用立体标定[15]得到两个相机的相对位置。非公共视场的双目标定方法较多[16-17],由于标定结果对最终的位姿测量结果影响较大,为尽量减小误差,本文选用特制标定板标定A、B相机的位置关系,以保证标定精度,如图3。本文采用的双目标定步骤为:

1)首先对A相机精确单目标定后,可以得到A相机外部参数的旋转矩阵a和平移矩阵a;然后对B相机精确单目标定,获得外部参数的旋转矩阵b和平移矩阵b。

2)选择满足同时在A、B相机上成像的标定板,同时采集图像,分别选取A、B相机图像上检测到的最左上角的角点,在标定板确定两个角点的实际位置。

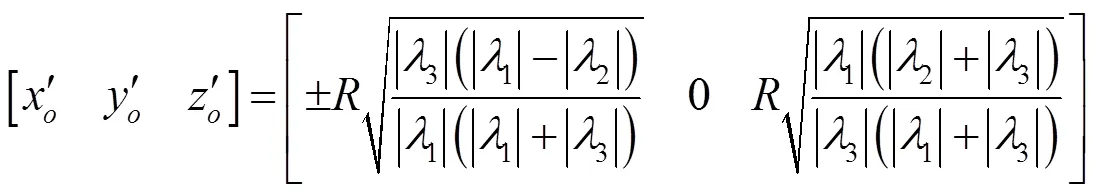

3)利用标定板上两个角点间已知的的平移向量,计算A相机和B相机之间固定的旋转矩阵AB和平移矩阵AB。

由公式(15)、(16)可分别求解出两个圆在A相机坐标系下的圆心坐标a¢和法向量a¢,在B相机坐标系下的圆心坐标b(b,b,b)和法向量b。通过ab和ab坐标转换,将A相机坐标系C1-C1C1C1转换到B坐标系C2-C2C2C2下后得圆A的圆心坐标a(a,a,a)和法向量a,由于两个系相机所拍摄圆边缘特征处于同一支撑平面,则两个圆特征的法向量平行,a、b同在坐标系C2-C2C2C2下时:

a=×b(其中为非零常数) (18)

由公式(3)、(4)、(13)可解算出两组相同的姿态角,即真实姿态角。由公式(14)可知,圆心a和b均有两组解,而两圆心构成的固定的空间向量ab为(000)T,假设a、b在坐标系C2-C2C2C2下的坐标分别为(a,a,a)、(b,b,b),可通过约束来剔除虚假解:

以上引入多相机约束,利用特殊标定和非合作标志的圆特征,解算出了大目标近距离条件下的非共视场多相机对接所需的移动量和姿态角。

2 实验验证与结果分析

2.1 实验与结果

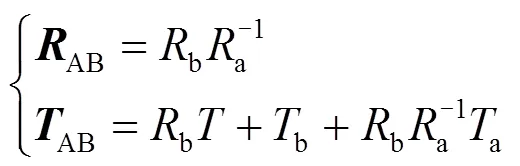

为了验证算法的有效性和可行性,建立了基于模拟圆边缘的位姿测量实验台。实验台主要包括模拟对接机构中的两个参数相同的圆特征,两个工业相机和相机支架,标定板和激光跟踪仪和计算机。采用Visual Studio2013作为编译器,编程语言为C/C++,标定板为1300mm×200mm的棋盘格(单格20mm×20mm),模拟的锥孔圆边缘的直径为60mm,尺寸精度为0.05mm,两个共面圆的平面度误差为0.1mm,两个圆边缘圆心的距离为1140mm。相机使用的Basler的acA1600-20GM,分辨率1626pixel×1236pixel,配Space Vision焦距4mm的定焦镜头,实验之前对两个相机分别精确标定,参数见表1。

表1 相机参数表

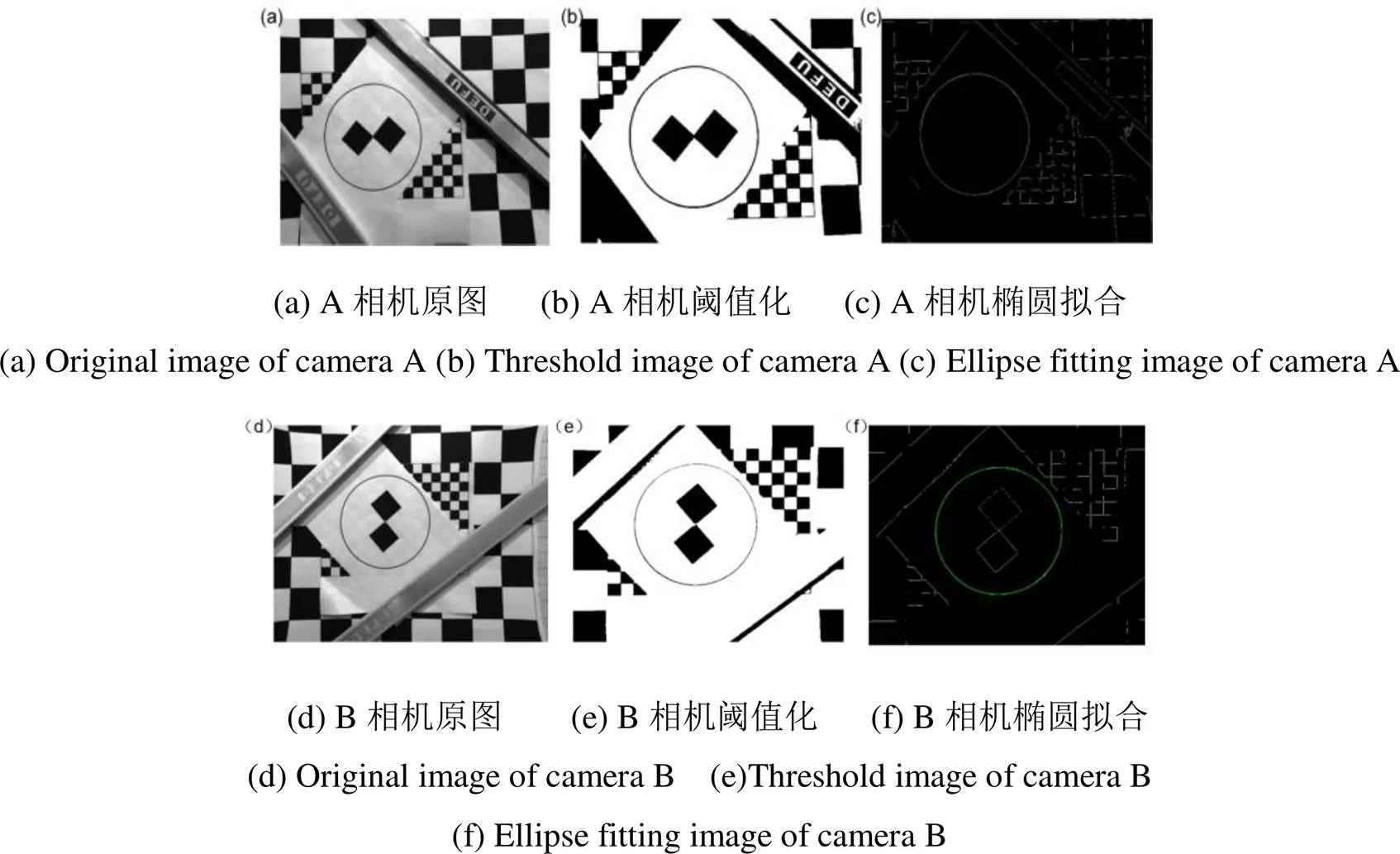

实验中,首先利用特制标定板对两个相机的位置标定。两个圆分别在两个相机的视场内完整成像时,检测各相机拍摄到的圆。对两个非共视场的相机拍摄的不同的圆特征图像,分别进行高斯平滑、降噪等预处理,然后通过阈值分割得到感兴趣区域、边缘检测,最后用椭圆拟合得到亚像素的椭圆点集。通过Opencv和数学计算可拟合出图像坐标系下的标准椭圆方程,最终拟合出摄像机坐标系下椭圆方程用于解算位姿。椭圆拟合实验如图4所示。

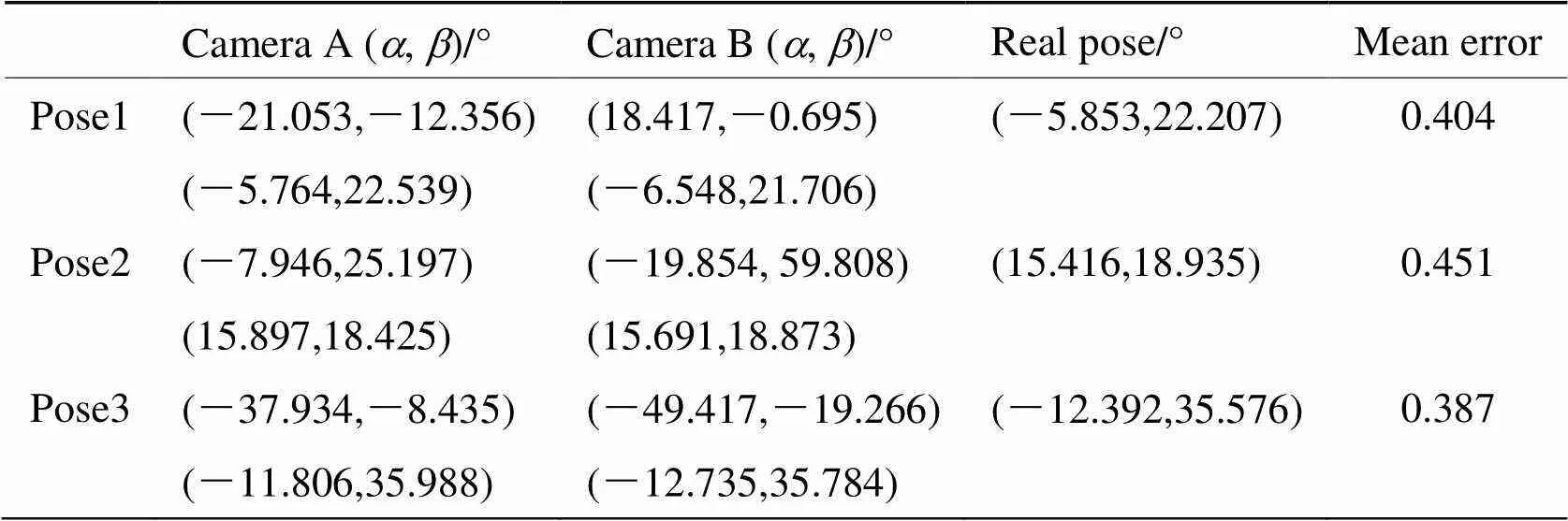

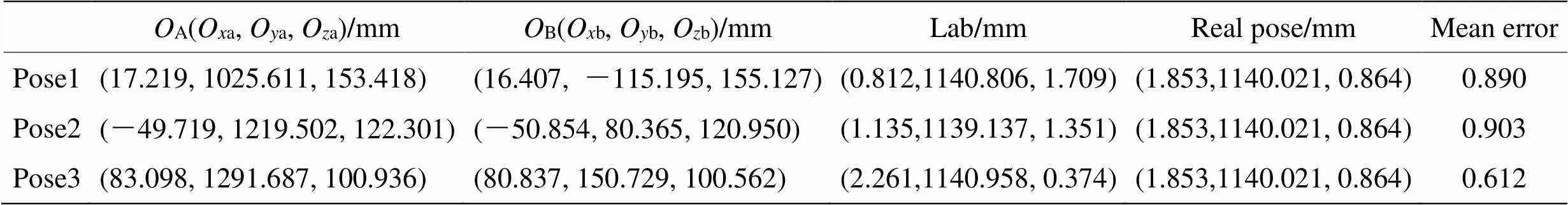

实验中用激光跟踪仪测量圆特征的位姿作为准确值,激光跟踪仪测量圆平面所在的白色矩形轮廓的位姿,矩形与圆边缘的位姿精确已知,所以利用激光跟踪仪可以间接求出两个圆的法向量和圆心位置。根据提取的椭圆和多相机约束求解位姿结果,将结果与激光跟踪仪的准确值对比。表2为3个不同位置时的姿态角的测量结果,姿态角分别为俯仰角和偏航角,单位为度;表3为3个不同位置时两个圆心的坐标测量结果,圆心坐标分别为A(Oa,Oa,Oa)和B(Ob,Ob,Ob),AB之间的差值为向量AB,单位为mm;实验中每个位置采集20组图,取计算结果的平均值作为位姿检测结果,求得计算检测结果相对于准确值的平均误差。

由表2可知,实验的3个不同位置中,同一位置时圆的两组姿态角测量结果中有一组姿态角近似相同且与接近精确值,可以成功剔除另一组虚假解。保留的正确的姿态角结果与精确值的平均误差在0.5°以内。由表3可知,两个圆心的两组平移量结果,有一组值两个圆心的空间距离与精确值基本相同,能正确筛选出真实解,其中真实的位移计算结果与精确值的平均误差在1.0mm以内,表明了本方法的真实有效性和检测精度,满足模块转运时对位姿的检测要求。

图4 实验图片处理过程图

2.2 误差分析

根据实验的测量值与精确值的差异分析,测量误差主要来源于:

表2 姿态角计算结果

表3 平移量计算结果

1)相机标定时的参数误差。A、B相机单目标定时的内参数和外参数无法避免地产生误差。内参数误差会影响特征圆和特征角点的成像精度,外参数不仅影响到图像坐标系转换到空间坐标系的位姿,也会影响到本文提出的双目标定方法的精度。

2)椭圆拟合精度产生的误差。准确地拟合出椭圆是精确获取椭圆在图像坐标的参数,椭圆参数的精度会直接影响位姿计算精度。

针对以上误差来源,在后续的研究过程中主要在以下方面进行改进:

3)提高相机标定的精度。研究高精度的非线性标定方法,对相机的畸变系数进行标会在一定程度上提高标定精度。

4)提高特征点的提取精度。椭圆上特征点直接影响到椭圆拟合,进而影响最终的位姿准确度。后续需要研究高精度的特征检测算法和优化椭圆拟合算法。

3 结论

本文提出了基于非共视场多相机的大目标近距离位姿检测方法,分别用两个相机检测对接目标上同一平面上无公共视野的一对圆特征,利用圆心的固定距离和同一平面相同的姿态角剔除虚假解。本方法充分利用球头机构的内部空间和锥孔的圆边缘特征,获取更多的目标信息,无需附加其他标志物,便于工程实施。实验结果验证了方法的正确性和实用性,并具有一定的稳定性。在1140mm的工作距离时,位移的计算误差在1.0mm内,姿态角误差在0.5°以内,满足大目标近距离对接时位姿检测的精度要求。

[1] Eberli D, Scaramuzza D, Weiss S, et al. Vision Based Position Control for MAVs Using One Single Circular Landmark[J]., 2011, 61(1-4):495-512

[2] 王天宇, 董文博, 王震宇. 基于单目视觉和固定靶标的位姿测量系统[J]. 红外与激光工程, 2017, 46(3): 146-153. WANG Tianyu, DONG Wenbo, WANG Zhenyu. Position and attitude measurement system based on monocular vision and fixed target[J]., 2017, 46(3): 146-153.

[3] 苗锡奎, 朱枫, 丁庆海,等. 基于星箭对接环部件的飞行器单目视觉位姿测量方法[J]. 光学学报, 2013, 33(4):123-131. MIAO Xikui, ZHU Feng, DING Qinghai, et al. Measurement method of aircraft monocular visual pose based on star-arrow docking ring component[J]., 2013, 33(4): 123-131.

[4] 张丽敏, 朱枫, 郝颖明,等. 基于圆特征和异面点特征的位姿测量[J]. 光子学报, 2015, 44(11):83-88. ZHANG Limin, ZHU Feng, HAO Yingming, et al. Posture measurement based on circular and non-planar features[J]., 2015, 44(11): 83-88.

[5] 孙增玉, 高越. 基于视觉技术的非合作航天器相对位姿测量方法[J]. 宇航计测技术, 2017. 37(4): 1-6. SUN Zengyu, GAO Yue. Measurement method of relative position and attitude of non-cooperative spacecraft based on vision technology[J]., 2017, 37(4): 1-6.

[6] ZHENG Yinqiang, MA Wenjuan, LIU Yuncai. Another way of looking at monocular circle pose estimation[C]//, 2008: 861-864.

[7] 赵连军, 刘恩海, 张文明, 等. 单目三点位置测量精度分析[J]. 光学精密工程, 2014, 22(5): 1190-1197. ZHAO Lianjun, LIU Enhai, ZHANG Wenming, et al. Accuracy analysis of single-eye three-point position measurement[J]., 2014, 22(5): 1190-1197.

[8] 魏振忠, 赵征, 张广军. 空间圆姿态识别二义性的角度约束消除[J]. 光学精密工程, 2010, 18(3):685-691. WEI Zhenzhong, ZHAO Zheng, ZHANG Guangjun. Elimination of angle constraints on ambiguity of space circular attitude recognition[J]., 2010, 18(3): 685-691.

[9] 陈至坤, 胡连军, 王一, 等. 基于角度约束的目标位姿测量二义性剔除方法[J].应用光学, 2018(1): 107-111.CHEN Zhikun, HU Lianjun, WANG Yi. A method of eliminating ambiguity in target pose measurement based on angle constraint[J]., 2018(1): 107-111.

[10] 苗锡奎, 朱枫, 郝颖明. 多像机非共视场的非合作飞行器位姿测量方法[J]. 红外与激光工程, 2013, 42(3):709-715.MIAO Xikui, ZHU Feng, HAO Yingming. Pose measurement method for non-cooperative space vehicleusing multiple non-overlapping cameras[J]., 2013, 42(3): 709-715.

[11] 尚洋, 孙晓亮, 张跃强, 等. 三维目标位姿跟踪与模型修正[J]. 测绘学报, 2018, 47(6): 113-122.SHANG Yang, SUN Xiaoliang, ZHANG Yueqiang, et al. 3-D target pose tracking and model modification[J]., 2018, 47(6): 113-122..

[12] 宋文杰, 付梦印, 杨毅. 一种面向无人驾驶汽车的高效交通标志识别方法[J]. 机器人, 2015, 37(1): 102-111. SONG Wenjie, FU Mengyin, YANG Yi. An efficient traffic sign recognition method for driverless vehicles[J]., 2015, 37(1): 102-111.

[13] 王宪, 赵前程, 谭建平. 应用区域估计的复杂背景多圆快速定位方法[J]. 中南大学学报: 自然科学版, 2016, 47(7): 2266-2272. WANG Xian, ZHAO Qianjin, TAN Jianping. Fast multi-circle location method using complex background of regional estimation[J]., 2016, 47(7): 2266-2272.

[14] 付朋, 陈新度, 吴磊. 基于角点的双目视觉绝对定位研究[J]. 电子测量与仪器学报, 2018, 32(3): 1-8 FU Peng, CHEN Xindu, WU Lei. Research on absolute positioning of binocular vision based on corner[J]., 2018, 32(3): 1-8.

[15] 郭清达, 全燕鸣, 于广平, 等. 基ICP算法的双目标定改进方法研究[J]. 光学学报, 2016(12): 198-205. GUO Qingda, QUAN Yanming, YU Guangping, et al. Base ICP algorithm for double target determination[J]., 2016(12): 198-205.

[16] TANG Yiping, ZHOU Jingkai, XU Haitao, et al. A novel laser vision sensor for omnidirectional 3D measurement[J]., 2013, 45: 1-12.

[17] XIE Meng, WEI Zhenzhong, ZHANG Guangjun, et al. A flexible technique for calibrating relative position and orientationof two cameras with no-overlapping FOV[J]., 2013, 46: 34-44.

Non-cooperative Circle Characteristic Pose Measurement Using Multiple Cameras without Public Field of View

SONG Daiping,LU Lu

(College of Mechanical Engineering, Chongqing University, Chongqing 400030, China)

Based on vision-based pose measurement during the trans-shipment of large optical modules, a non-public field of view(FOV) pose detection method for multi-cameras based on distance and angle constraints is proposed in this study.The method is developed by using two circular edges of the same plane at the bottom of the target of the installation module to eliminate the environmental constraints of close-range docking of large objects. While docking, the sphere of the transfer vehicle was correctly docked with the target cone hole. The two cameras were fixed in the hole of the sphere, and the circular features of the edge of the cone hole were collected. The position relationship between two cameras was obtained by multi-camera calibration in non-public FOV study on non-cooperative circle characteristic pose measurement using multiple cameras without public FOV imaging and the position and altitude information of multiple cameras were confluent. Finally, the false solutions in the pose calculation were eliminated using the constraints of two coplanar circles and two cameras' position relations. The experimental results show that the method can accurately calculate the pose. The calculation process is concise, and the results are reliable and effective. The error of the attitude angle of the circular edge feature is less than 0.5 degrees, and the calculation error of the center of the circle is less than 1.0mm at a working distance of 1140mm. The proposed method has practical applications in measuring the position and altitude of large targets within close range.

machine vision, pose measurement, multi-camera non-public FOV, coplanar circle feature, distance constraint, close large target

TN209;TP242

A

1001-8891(2020)01-0093-06

2019-07-01;

2019-12-31.

宋代平(1978-),男,四川绵阳人,副教授,博导,博士,主要从事机械设计、机器视觉及应用等研究方向。E-mail: songdp@cqu.edu.cn。

国家自然科学基金联合基金项目(U1530138)。