算法推荐新闻的技术创新与伦理困境:一个综述

2019-09-10王仕勇

王仕勇

摘 要:“算法主导下信息传播的社会影响与挑战”成为2018年度“中国十大学术热点”,算法推荐新闻也是学界关注的重要话题。大数据时代,新闻分发正在进行变革,对于算法推荐新闻的模式及其实践,从一开始就伴隨是好是坏的争论。一方面认为,算法推荐新闻实现了信息超载时代用户需求信息的精准推荐,凸显了受众的主动地位;提高了内容分发效率,实现了对信息和人的精准与高效匹配,有利于增强用户黏性;为社会民意搭建了一个前所未有的社会基础平台。另一方面认为,算法推荐导致隐私侵犯、算法偏见和算法歧视;导致新闻娱乐化、低俗化与同质性;导致信息茧房和群体极化;导致价值观分化与社群区隔,不利于社会整合。对于算法推荐新闻,要深入思考数据的所有权和信息的选择权、对什么负责与对谁负责、工具理性和价值理性等几个问题,秉持宽容审慎和科学的态度进行研究。

关键词:算法推荐;新闻分发;人工智能;伦理;技术

基金项目:重庆市教育委员会人文社会科学研究重点项目“政府社会舆情治理视角的网络质疑现象研究”(18SKGH060);重庆市社会科学规划重大委托项目“强化互联网思维推进政府社会治理精准化对策研究”(2016ZDWT25)。

[中图分类号] G210 [文章编号] 1673-0186(2019)09-0123-010

[文献标识码] A [DOI编码] 10.19631/j.cnki.css.2019.09.012

人工智能是影响未来新闻业发展趋势的重要技术。智能算法进入新闻生产和新闻分发环节,正在对新闻业和新闻学研究产生革命性的影响。人工智能在新闻业界实践的速度和影响出乎人们的意料,“算法主导下信息传播的社会影响与挑战”成为2018年度“中国十大学术热点”。人工智能与新闻分发结合产生的算法推荐新闻,引起了其“是‘好东西’、‘坏东西’、还是有待验证的‘新东西’”[1]的讨论。

大数据是人工智能的基础。大数据在改变身份概念的含义,同时也在改变我们与这个概念的所指之间的伦理关系[2]。基于大数据技术和神经网络算法的算法推荐新闻,改变了编辑、记者、用户等身份概念,也改变了媒体和用户的伦理关系。

一、大数据时代的新闻分发变革

美国学者比尔·科瓦奇(Bill Kovach)和汤姆·罗森斯蒂尔(Tom Rosenstiel)在《真相:信息超载时代如何知道该相信什么》一书中提出,我们处在一个用户主导的新媒体时代,“我们会比以往获得更多信息,同时也更容易困惑;我们会更容易看见真相,同时真相也更难获得”,这是我们面临的信息超载的现实。在过剩的信息海洋里,阅读由享受变为负担。大数据为解决信息超载的困惑找到了一把科学的钥匙,实现了信息的精准获取。

(一)信息过载与算法推荐新闻的出现

在报纸、电视等传媒主导内容传播的时代,内容行业的竞争多属于业内竞争,其内容分发是一种点对面的方式,传媒从业者几乎承担着全部传播责任。随着互联网进入人们的日常生活,内容传播的时间和空间概念均发生了变化。从空间上讲,理论上每一个连接互联网的用户都可以接收到分发的信息,但内容分发范围的变化仍然没有从根本上改变传播的主体,只不过是网站、论坛、视频网站等和报社、电视台等内容生产的专业机构一道实现内容分发。

随着社交媒体、新闻客户端等的出现与发展,我们进入了一个信息过载的时代。国外研究机构的数据显示,互联网每天生产的内容可以刻满1.68亿张DVD;社区论坛发布的帖子接近《时代》杂志770年的文字量;在Facebook上有1.72亿人登录,上传2.5亿张图片,如打印出来相当于80座埃菲尔铁塔的高度;在YouTube上传86.4万小时视频,如果不间断全部播完要98年……来源于互联网交易、移动终端、各种网络设备和传感器、社交媒体等的数字数据,海量内容,已经远远超过所能接受、处理或有效利用信息的范围,用户对信息反应的速度也远远低于信息传播的速度。强大的内容生产能力,要求传统的内容分发必须变革,以解决用户对有用信息的分辨及选择能力不足的问题。于是,出现了以微信为代表的个性化“订阅分发”方式,以知乎为代表的“社群分发”方式,以今日头条为代表的“算法分发”方式等。

算法推荐新闻作为新闻分发的一种方式,是基于内容资源、大数据技术和用户三者统一的一种信息精准分发,属于用户新闻的“私人订制”。它的出现与挖掘海量数据的大数据技术分不开。大数据技术把文字、图片、音频、视频等海量信息数据化;把不同类型媒体上的同类数据整合;借由标准的标记体系和收集记录的工具,实现地理信息的标准化和量化;把能体现个性化特征的人与人之间的网络信息沟通与交流行为数据化;把现实社会与虚拟社会联系起来并实现意义交换。算法推荐新闻,可以说是一个“业务数据化—数据业务化”的闭环反馈过程[3]。

(二)算法推荐新闻模式

算法推荐新闻的基本逻辑是通过大数据技术,从互联网上采集新闻内容信息、用户个人网络行为及社交关系等,根据“信息与人”的匹配原则向用户推送符合其兴趣偏好的特定信息。关于算法推荐新闻的模式,学界根据业界的实践进行了分析。

目前,算法推荐在新闻中的应用还处于初级阶段。周勇、赵璇认为,算法新闻的本质是努力实现“信息与人”的匹配[4]。目前的内容分发根据算法使用程度,可分为三类:一是与内容生产方合作,根据用户信息推荐内容并由用户发现和选择订阅的“人工推荐为主”模式;二是通过记录用户搜索信息推荐新闻的“人工+算法”模式;三是基于用户行为数据和社交媒体数据,运用机器学习推荐新闻的“完全算法”模式。

刘存地、徐炜根据算法推荐原理把推荐算法分为五类:一是协同过滤推荐算法,包括根据相似用户预测相似偏好的基于用户(User-Based)的协同过滤、根据用户对信息的评价及信息之间的相似度进行推荐的基于项目 (Item-based)的协同过滤;二是基于内容的推荐算法,包括凭借经验与实际情况拟合度的启发式算法,以用户浏览行为为基础通过机器学习的预测模型法;三是基于关联规则凭借大数据相关性发现能力以实现预测用户需求的推荐算法;四是结合用户偏好变化和满足程度的基于效用的推荐算法;五是以用户资料中能够支持推理的知识结构为基础进行预测的基于知识的推荐算法[5]。

彭兰从新闻分发渠道的角度,提出把新闻分发平台沉淀为一个连接用户社交关系、物和环境的用户平台是未来趋势[6]。她把互联网进入大众传播领域以来新闻分发平台划分为六大类:以“多源聚合 + 人工分发”为特征的整合类平台,以“多源搜索 + 算法调度”为特征的搜索引擎平台,以“人际网络 + 大众传播”为特征的社会化媒体平台,以“个性分析 + 算法匹配”为特征的个性化推荐平台,以“临场体验 + 社交传播”为特征的视频和 VR /AR 平台,以“生活场景 + 新闻推送”为特征的服务类平台。并认为,未来新闻分发平台将以集聚维护用户、汇聚多元化内容生产者、匹配内容生产与消费、营造多重新闻体验环境、关联内容与其他互联网服务为实现目标。

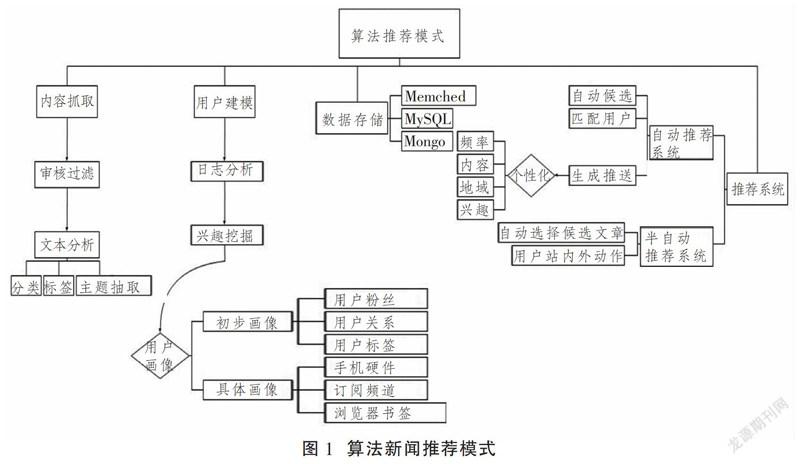

为了进一步了解算法新闻推荐的模式,我们根据今日头条的核心架构分析,制作出推荐模式图(图1)[7]。

由此可见,对内容的分类和标签化、对用户日志的分析和用户兴趣的挖掘学习、对用户的社交画像是算法推荐新闻的基础。

二、“好东西”:算法推荐新闻的技术创新

对于算法推荐新闻的模式及其实践,从一开始就伴随是好是坏的争论。算法推荐新闻,其基石是大数据技术。这就意味着争论的根本是对科技价值的评判。价值是反映客体满足主体需要的关系范畴,如果能满足个体需要我们说有个人价值,如果能符合社会整体利益并促进社会进步我们说有社会价值。关于科技价值观,西方有乐观主义和悲观主义两种思潮。马克思主义肯定科技的巨大社会作用,对科技带来的社会后果总体上也持积极乐观的态度,认为“科技是推动社会进步的革命力量”。在当前的研究中,肯定算法推荐新闻的个人价值和社会价值的观点,主要集中在以下几个方面。

从个人价值来讲,算法推荐新闻实现了信息超载时代用户需求信息的精准推荐,凸显了受众的主动地位。当前算法推荐内容在我国资讯信息分发市场占比已经超过一半,这是一种主动选择的结果。算法推荐新闻是信息技术在传播领域的创新型运用,是新闻分发的巨大变革,它根据用户画像、用户社交关系、关联内容、地理位置等信息消费行为,挖掘用户的媒介消费兴趣、习惯及特点,并对用户未来的媒介消费内容进行预测,继而为用户推荐“量身定制”的新闻产品,实现精准推送和有效供给,最大程度满足了用户的个性化信息需求[8]。“意义建构理论”提出者布伦达·德尔文(Brenda Dervin)提出,个体的信息行为过程是对信息主动搜索、主动发现,并主动建构信息意义的过程。算法推荐新闻改变了传统的信息行为模式,它通过对用户媒介消费兴趣和社交图谱的建构,实现对用户需求内容的个性化精准化推荐[9]。传统分发模式,受众始终无法摆脱“木偶”这一角色,算法推荐新闻对用户赋能和赋权,赋予用户主体身份[10],这样既节省了用户的时间成本,又提高了信息的阅读效率,还把用户的主动地位凸显出来。

从媒介需要来讲,算法推荐新闻提高了内容分发效率,实现了对信息和人的精准与高效匹配,有利于增强用户黏性,为高效实现内容产品的商业变现提供了技术支持。从传统媒体时代到互联网时代,新闻分发变革是媒介技术发展的必然要求。算法推荐新闻以智能推荐工具替代传统物流分发流程,实现自动化发行与营销[11],有利于增强用户与新闻产品之间的黏性,提升新闻价值,提高用户兴趣和参与意识,扩大用户影响和范围。

从社会价值来讲,算法推荐新闻实现了为社会民意搭建一个前所未有的社会基础平台。算法推荐新闻通过“模型泛化”挖掘和洞察与用户相似的社群特征和需求,然后针对性发送,由于其“对流量的分配独立于社交关系而不受 ‘大号’垄断的影响”[12],可以有效解决社交过滤存在的不足。同时,由于算法可以自我学习自我训练,人们“可通过大数据将个体的诉求随时随地表达、记录及价值挖掘,并且对这些数据进行连接、分析,算法实现了为社会民意搭建一个前所未有的社会基础平台” [10]。

三、“坏东西”:算法推荐新闻的伦理困境

企鹅智酷发布的《未来地图:中国新媒体趋势报告(2017)》显示,在2017年,算法推荐新闻首次在用户感知上面已经超过新闻和社交推荐。51.5%的被调查者最看重新闻资讯中的新闻推送功能,新闻推送功能跃升新闻产品功能第一位[13]。今天,智能推荐算法在信息分发市场中的运用占比越来越高,其地位已呈现出超越人工推荐的趋势。温特、良太小野(Jenifer Winter,Ryota Ono)在《未来互联网》一书中提出,按照技术乐观主义的观点,人工智能在未来几十年内将超过人类大脑,能够无限度地使人类与机器并存和融合[14]。但人们在拥抱算法这一趋势的同时,也体现出了很多担忧。这种担忧更多的是对其带来的伦理问题的担忧。

(一)隐私侵犯、算法偏见和算法歧视

信息技术与个人隐私共存正在变得越来越模糊。随着公共和私人信息之间界限不断移动,关于如何划分信息密级的辩论也越来越激烈。侵犯隐私是算法推荐新闻被质疑的一个热点问题。专家认为,个别 App在协同过滤的算法推荐过程中,会窃取用户的手机通信录、短信等信息,导致用户行为数据和隐私泄露等安全风险增大[8]。有学者提出,“对于信息的细化过程都不是道德中立的”,即使算法程序是中立的,但数据本身是带有偏向性的,在这种机制中存在的偏见令人更加难以察觉[15]。同时,掌握数据的技术平台基于商业利益的考量,他们在用户无意识状态下收集、获取和使用用户信息,把用户在平台上的数字痕迹可能以某种无法知晓的方式销售给广告客户,从而侵犯用户个人隐私。

与隐私侵犯相关联的担忧还有“算法偏见”(algorithmic bias)和“算法歧視”(algorithm discrimination)。国外社会学专家认为,算法推荐根据自己的运算规则为每个用户预设了一个身份,给每个个体划定了边界,算法不断增加的复杂性可能使底层永远成为底层,导致算法偏见[16]。弗里德曼(Friedman)和尼森鲍姆(Nissenbaum)研究发现,计算系统(主要指机器学习)存在偏见,由人编写的算法必然包含着人自身的偏见。算法推荐不但不能阻止技术偏见,还会在看似中立的算法规则中,由于数据源、版权、监管等问题和设计者的主观因素产生新的偏见[15]。关于算法歧视,学界多次提到美国弗格森案件,由于存在种族歧视,Facebook采用机器算法和利用人们对社交媒体的依赖,干预用户观看有关弗格森枪击案的信息,向用户推荐与此案不相关的内容。

(二)娱乐化、低俗化与同质性

算法推荐的一个重要指标是资讯内容的点击量,其目标是获取更多用户的注意力。在信息超载时代,移动化、碎片化、浅表化是用户阅读的基本特征。为了满足用户接受轻松省力信息的需求,在算法推荐中会特意推荐那些耸人听闻的标题、离奇夸张的故事情节和低俗浅表的内容吸引受众,用户点击越多,算法推荐的权重越大,造成恶性循环,这样使得娱乐化、低俗化的信息湮没了理性、深度、高质量的信息[8]。

与娱乐化、低俗化相伴随的必然是同质性。由于把迎合用户需求、追求最大点击量作为算法推荐最重要的目标,因此,算法推荐以所谓的“中立性”“技术主导”,将含有“腥”“星”“性”等低俗化、娱乐化因子的信息以公式算法和系数加权的方式,实现了“标准化”“同一化”推送,导致新闻娱乐化。李彪、喻国明称之为“茧房内的同质性”。算法新闻的个性化推荐,不仅强化了信息传播的闭环,而且使标题党、低俗甚至是别有用心的议题轻松便捷找到其用户,从而消解传统媒体坚守的情怀与专业主义[9]。今天,“奶头乐”新闻、公共议题泛娱乐、自媒体新闻世俗化等传播乱象,使得浅薄化、娱乐化以及“三俗”的资讯内容充斥网络,新闻生态逐渐污浊,算法推荐无视人类行为背后的认知、情感和意识,以“形式合理性掩盖了实质合理性”,人们甚至开始怀疑真正的新闻是否正在死去。

(三)信息茧房和群体极化

娱乐化、低俗化导致的“茧房内的同质性”是信息茧房的一种表现。针对算法推荐新闻,学者非常关注由于信息消费的窄化、固化导致的“信息茧房”效应,以及由于用户长期接受同质化信息导致的群体意见极化现象。

多数研究算法推荐新闻局限性的论文,都会使用到“信息茧房”这一概念。由于算法推荐新闻是根据个人偏好定向推送的,这很容易导致用户接触不到自由市场中开放多元的意见,也很难与代表不同价值观念、取向的意见和观点进行交流交锋,长此以往用户会沉浸于自己的“舒适地带”之中,沉浸在自主选择的“满足感”里,逐渐把自己封闭和隔离起来,脱离本来丰富多彩、文化多元的大千世界,产生自我重复、自我固化的“孤岛效应”,形成信息茧房[17]。这正如《人民日报》评论所言,“技术为用户量身打造信息,开启了符合读者口味的一扇窗,却关上了多元化的一道道门”[18]。

千人千面的个性化算法技术推荐模式,除了使人的视野变得狭窄,还会塑造人的认知,使人的认知出现局限性,导致态度和观点的极化[19]。姜红、鲁曼认为,算法推荐新闻为用户营造的“过滤气泡”式的阅读环境,既建构了用户对社会的想象,又通过新闻信息的传递潜移默化地影响用户的情感和态度。克雷默( Kramer) 等三名学者通过对 689 003人的实验证实, Facebook 消息推送可显著影响人们的情感和态度[20]。布赫( Bucher) 的研究也发现,算法机制通过对用户的阅读行为和社会网络的分析,不断向用户发送信息,并记录下用户阅读信息的情绪,有相似新闻出现就会连续不断地发送类似信息,不断刺激用户的神经,影响和规制着用户[21]。关于这一点,桑斯坦(Cass R.Sunstein)也认为:“如果互联网上的人们主要是同自己志趣相投的人进行讨论,他们的观点就会仅仅得到加强,因而朝着更为极端的方向转移。”[22]这些被茧化的用户因信息的不断感染,很容易把信息暗示的观念变成自身的行动倾向,产生极化行为。如果是被相同的情绪极化的,如仇官仇富的被茧化用户,可能会因为与某些污名化官员或富人的信息长期接触,强化仇官仇富情绪,形成群体极化。

(四)价值观分化与社群区隔

社群区隔与价值观分化是与信息茧房、群体极化紧密关联的两个概念。信息茧房多指茧房内的同质化,茧房与茧房之间因为彼此不同质,不能产生沟通交流行为,这种茧房之间的异质性就造成社群区隔。社群区隔的主要原因是价值观分化。

美国传播学者博奇科夫斯基把90后一代在社交媒体中偶遇新闻的现象称为“不期而遇的新闻”,认为这种现象不仅改变了他们的新闻获取与阅读方式,还决定了他们看到的政治观点和社会意见[23]。算法推荐新闻针对不同价值观的人群,传递分发不同价值观的内容信息,算法替代了传统媒体中的“把关人”。算法技术“为每个人量身定制过滤器,使每个人都成了一座信息孤岛,人与人之间形成了区隔”[24],从而可能导致社会分层的固化。算法作为技术尽管是中立的,但发明和掌控算法的个人或企业,如果唯利是图,只把算法推荐作为谋取利益的新工具,那么被操纵的算法可能会成为推荐偏离社会真实图景的信息的“隐形独裁者”,算法推荐系统可能成为“扭曲的棱镜”,导致公众的社会认知偏差,“可能给公共生活造成难以弥合的分裂”[25]。

社会是需要共识的,而思想的活跃与繁荣是社会共识形成的基础和条件。正是在不同思想观点的交流和碰撞中,人们去寻找最大多数的认同群体,形成思想和观点的“最大公约数”,促进社会共识。而算法推荐造就了高度分众化的群体和社群区隔,导致社会共识的形成变得困难,给社会凝聚力的增强带来了新挑战[5]。

四、“新东西”:算法推荐新闻的未来及规制

科技乐观主义认为,科技是社会发展的一个决定性因素,其带来的一切问题都能依靠科技本身解决。科技悲观主义认为科技将使人类沦为奴仆,甚至毁灭人类的本性,导致人类的生存危机。“任何技术都倾向于创造一个新的人类环境”,算法推薦新闻作为一种新生科技事物,作为一种知识性的存在,正在改变着我们认知世界的方式,也在改变着我们所处的环境。因此,对算法推荐新闻这种技术分发新闻方式,我们需要进行审慎细致的反思。

(一)数据的所有权和信息的选择权

算法推荐新闻的一个重要特征,就是搜集挖掘用户的信息喜好、社交关系和网络行为痕迹,并据此进行信息匹配,有针对性地推荐新闻。在关于“好东西”与“坏东西”的讨论中,问题的焦点是算法搜集挖掘信息尤其是使用信息的合法性、科学性问题(涉及隐私侵犯、算法歧视和算法偏见等),以及用户的选择权问题(涉及信息茧房等)。也就是用户在网络上的信息痕迹到底归谁所有?算法是绝对中立的吗?用户的信息选择权该归谁来掌握?

隐私是作为法定权利基础的天赋权利,是人格的根本。人格的根本是我们能够掌控自己的信息。每一个用户都乐意让人们把他们的个人信息当作是保密的而不是可以随意买卖的商品。隐私权的目标是确保个人拥有一个能成为个人的而不是集体成员的空间。在这个空间内,他能进行自己的思考,拥有自己的秘密,过自己的生活,只让外部世界看到他愿意公开的东西[26]。由此看来,用户不愿意公开的网络行为信息自然属于隐私。但在互联网时代隐私的边界发生变化了吗?如果算法是中立的、科学的,用户的信息可以让渡给机器吗?霍奇斯(Hodges)认为,保护隐私是一种道德的善,作为个体存在的我们需要隐私,作为社会存在的我们需要彼此的公开信息。“因为我们是个体存在,所以消灭隐私就消灭了我们所理解的人来存在;因为我们是社会性的,所以把隐私提升到绝对高度同样会使人类社会不复存在”,这说明问题的焦点在于隐私的边界。对于隐私,戴维斯、帕特森认为,用户线上预期同线下预期之间的差别, 涉及个人对与他们自身相关的私人数据的公开使用权所具有的控制程度,是一个深刻的伦理探索课题[2]。

在算法推荐新闻过程中,算法技术看似居于核心地位,但对问题的理解、数据的选取、变量的选择、算法的评价等都贯穿着人为因素[27],如何认识算法的中介本质,在算法中规避有意识或无意识的认知偏见,给予用户更多的信息选择权和知情权才是问题的核心所在。真正把信息選择权让渡给用户,让用户明白自己的需要和选择,增强算法的透明性,而不是让用户“被算法喂食”,倡导以间性“算法集”为视角、以“数据主体”的规范理念为出发点来推进落实“可理解的透明度”是算法要努力解决的问题[16]。

(二)对什么负责与对谁负责

上一个问题回答了对什么负责和对谁负责的问题,那就是对隐私负责和对用户负责。但关于算法推荐的担忧无论是在西方语境还是中国语境中,都不是一个简单问题。算法推荐被指将用户置于随时被监控的“圆形监狱”,造成价值观分化与社群区隔,这无疑是从社会责任的视角来观照算法技术的。

有研究者在《算法机制对媒体社会责任的影响》中提出,围绕算法机制的优劣有坚守派和破除派两种观点,坚守派希望媒体通过对特定价值观的坚持和引导达成社会共识实现社会和谐,破除派则认为不应坚持特定价值观,而应通过多元价值的相互博弈促成社会和谐进步[28]。不管是坚守派还是破除派,其实都在肯定媒体在算法推荐中的社会责任。算法新闻除了满足受众的信息需求,还应通过有意义、有价值的信息传播,促使社会形成一个能相互协调与配合的统一有机体,履行舆论引导功能。无论算法新闻如何变革,必须确保人文情怀、责任担当等新闻业的核心价值观不因技术的变革而消亡,确保技术变革有利于社会和人类的可持续发展[11]。

从社会责任的视角,我们可以用行动者网络理论(ANT)来探究算法技术与社会责任的关系问题。行动者网络理论认为,“任何通过制造差别而改变了事物状态的东西都可以被称为行动者”,行动者可以是人,也可以是技术、观念等力量。算法技术根据用户偏好和接触信息的变化而变化,根据用户标签推送内容,为用户塑造一种自己的媒介环境。算法不是一成不变的,算法总是根据用户的行为不断调整和改进,用户在改变算法,算法也在改变用户。因此,算法是一个非人类的“行动者”。人与算法构成一个网络,在这个网络里,用户与算法技术是既相互依存又相互影响的主体间性的相与关系,非人的“行动者”(算法技术)通过有资格的“代言人”(agent)来获得主体的地位、资格和权利,与用户一道共同营造相互协调的行动之网。显然,这个有资格的“代言人”的社会责任就会特别重要。

社会责任理论的心理学基础是:人并不是完全理性的动物,本性也并非全然的“善良”。因此,传媒应该对社会承担责任,与社会“分享共同价值”。对什么负责和对谁负责,归根结底就是传媒除了发挥娱乐功能外,更应发挥其雷达功能、控制功能、教育功能。算法技术作为与人相互影响的“行动者”,应对人的自由全面发展负责,对社会健康有序运行负责,算法的设计者在整个行动网络中处于枢纽和关键地位。

(三)工具理性和价值理性

算法是一种技术工具,算法推荐中产生的低俗、浅薄内容甚至算法偏见与歧视,将算法对用户的“控制”形容为“信息茧房”“个性化圈套”“信息孤岛”,从技术反思的角度看,需要我们去追溯技术与人的关系、技术与社会的关系。对于算法技术对人与社会的影响,需要科学严谨的长期的实验方法进行研究。

工具理性强调把技术的效用发挥到最大,价值理性强调伦理的重要性。对算法推荐的价值考量,主要围绕着工具理性和价值理性的博弈。对技术保持怀疑批评,对价值保持敬畏尊重,找到工具理性和价值理性的黄金结合点,是算法推荐要努力解决的问题。我们要肯定算法技术对社会的推动作用,也要对其价值关怀格外重视。技术与社会是互动的,良性的互动才能给人类带来福祉。过度强调价值会阻碍技术创新,过度强调算法技术会导致“创新性破坏”。对新兴事物的立法与规制,应当兼顾社会公平、个人权利,使其不至于扼杀创新[29]。

对于算法推荐新闻,不能沿用老办法管制,应秉持“宽容审慎”的态度。比如,有学者提出,互联网时代,隐私权的边界发生了变化,“隐私权不能仅仅理解成独处不被打扰或不被不希望出现的意见和刺激扰乱心神的权利等静态的隐私”;“‘信息茧房’并不是算法时代独有的产物,‘信息茧房’存在的根源是‘选择性心理’”等[30]。因此,对于算法推荐新闻的研究,还需要以一种审慎的心态进行。

参考文献

[1] 祝建华:算法推荐新闻是“好东西”、“坏东西”、还是有待验证的“新东西”?[EB/OL].[2017-11-22].https://www.jfdaily.com/news/detail?id=71705.

[2] 科德·戴维斯,道格·帕特森.大数据伦理: 平衡风险与创新[M].赵亮,王健,译.沈阳: 东北大学出版社,2016:17.

[3] 傅丕毅,陈毅华.M G C机器生产内容+AI人工智能的化学反应——“媒体大脑”在新闻智能生产领域的迭代探索[J].中国记者,2018(7):30-32.

[4] 周勇,赵璇.大数据新闻生产的实践与反思[J].新闻与写作,2016(06) :44-48.

[5] 刘存地,徐炜.能否让算法定义社会——传媒社会学视角下的新闻算法推荐系统[J].学术论坛.2018(4):28-37.

[6] 彭兰.未来传媒生态: 消失的边界与重构的版图[J].现代传播,2017(1):8-14+29.

[7] 今日头条的核心架构解析[EB/OL].[2017-05-19].https://www.aliyun.com/jiaocheng/154571.html.

[8] 吴卫华.算法推荐在公共传播中的理性问题[J].当代传播,2017(3):79-81.

[9] 张潇潇.算法新闻个性化推荐的理念、意义及伦理风险[J].传媒,2017(6上):82-84.

[10] 喻国明,杨莹莹,闫巧妹.算法即权力:算法范式在新闻传播中的权力革命[J].编辑之友,2018(5):5-12.

[11] 吴锋.发达国家“算法新闻”的理论缘起、最新进展及行业影响[J].编辑之友,2018(5):48-54.

[12] 张志安,汤敏.论算法推荐对主流意识形态传播的影响[J].社会科学战线,2018(10):174-182.

[13] 企鹅智酷:2017中国新媒体趋势报告[EB/OL].[2016-11-16].http://www.199it.com/archives/654084.html.

[14] 珍妮弗·温特,良太小野.未来互联网[M].郑常青,译.北京:电子工业出版社.2018:155.

[15] 常江.生成新闻:自动化新闻时代编辑群体心态考察[J].编辑之友,2018(4):76-82.

[16] 仇筠茜,陈昌凤.黑箱:人工智能技术与新闻生产格局嬗变[J].新闻界,2018(1):28-34.

[17] 吴献举.聚合媒体的新闻生产:方式变革、社会影响与优化路径[J].编辑之友,2018(6):63-67.

[18] 人民网.民日报评论部:算法盛行更需“总编辑”[EB/OL].[2016-12-13]. http://opinion.people.com.cn/n1/2016/1223/c1003-28970666.html.

[19] 刘凯.“千人千面”技术模式下政策类新闻传播的优化策略[J].中国记者,2018(03):64-66.

[20] Kramer,A. D. .Guillory,J. E. ,& Hancock ,J. T. Experimental Evidence of Massive- Scale Emotional Contagion Through Social Networks[J]. Proceedings of the National Academy of Sciences of the United States of America,111( 24) ,8788,2014.

[21] Bucher,T.. The Algorithmic Imaginary: Exploring the Ordinary Affects of Facebook Algorithms[J]. Information,Communication & Society,2017(1), 30-44.

[22] 凱斯·R.桑斯坦.极端的人群:群体行为的心理学[M].尹弘毅,郭彬彬,译.北京:新华出版社,2010:103.

[23] 李彪,喻国明.新闻2.0时代硅谷如何驯化美国新闻业[J].江淮论坛,2018(3):166-170.

[24] 姜红,鲁曼.重塑“媒介”: 行动者网络中的新闻“算法”[J].新闻记者,2017(4):26-32.

[25] 胡凌.人工智能的法律想象[J].文化纵横,2017(2):108-116.

[26] Thomas I.Emerson.The System of Free Expression (New York:Vintage Books).Louis Hodges(2009)[M]."Privacy and the press,"in The Handbook of Mass Media Ethics,eds.Lee Wilkins and Clifford Christians(New York:Routledge),1970:545.

[27] 张超.作为中介的算法 :新闻生产中的算法偏见与应对[J].中国出版,2018(1):29-33.

[28] 董小菲.算法机制对媒体社会责任的影响[J].网络传播,2017(9):94-96.

[29] 马思源,姜文琪.推荐算法规制的他山之石[J].新闻战线,218(3):106-108.

[30] 林小勇,张苗苗.未来媒体蓝皮书:中国未来媒体研究报告[M].北京: 社会科学文献出版社,2018:186.

(责任编辑:易晓艳)