结合词性信息的基于注意力机制的双向LSTM的中文文本分类

2018-05-14高成亮徐华高凯

高成亮 徐华 高凯

摘 要:基于LSTM的中文文本分类方法能够正确地识别文本所属类别,但是其主要关注于学习与主题相关的文本片段,往往缺乏利用词语其他方面的信息,特别是词性之间的隐含的特征信息。为了有效地利用词语的词性信息以便学习大量的上下文依赖特征信息并提升文本分类效果,提出了一种结合词性信息的中文文本分类方法,其能够方便地从词语及其词性中学习隐式特征信息。利用开源数据并设计一系列对比实验用于验证方法的有效性。实验结果表明,结合词性信息的基于注意力机制的双向LSTM模型,在中文文本分类方面的分类效果优于常见的一些算法。因此识别文本的类别不仅与词语语义信息高度相关,而且与词语的词性信息有很大关系。

关键词:自然语言处理;中文文本分类;注意力机制;LSTM;词性

中图分类号:TP319 文献标志码:A

文章编号:1008-1542(2018)05-0447-08

文本分类是自然语言处理和人工智能的基础任务,日益受到研究人员的关注。目前主流的研究方法有基于词典的文本分类方法[1-3]、基于早期机器学习的文本分类方法[4]和基于神经网络的文本分类方法(例如,基于卷积神经网络模型的文本分类方法[5-7]和基于LSTM的文本分类方法[8-10]等)。基于词典或基于早期机器学习的文本分类方法主要是结合先验知识从文本中抽取、生成、構建特征集,然后将这些特征信息作为输入数据用于训练一个分类器(例如朴素贝叶斯分类器[11]、支持向量机分类器[12])用于文本分类。虽然该方法在文本分类方面取得了较好效果,但仍存在一些问题,例如,很难从非结构化数据语料库中挖掘隐式特征,并且需要花费大量的人力来构建一个适合特定文本分类任务的特征词库。随着深度学习技术的发展,基于神经网络的文本分类方法可利用网络结构从大量的语料库中自动学习任务特征。目前,研究人员设计了许多有效的基于神经网络的文本分类方法,该方法能够将文本转换成低维度的文本,而无需人工从文本中提取特征[13-14]。其中,卷积神经网络模型[5]擅长学习文本的局部特征信息。由于卷积神经网络模型的学习能力很大程度上取决于其卷积窗口的大小,所以它在学习远距离词语之间相互依赖特征方面能力很差。LSTM[15]和双向LSTM[16]是典型的序列模型,它能够学习词语之间的依赖信息但是不能区分不同词语对文本分类任务的贡献程度。文献[8]提出了一个树形LSTM模型。该模型需要依赖解析树结构以及繁琐的段落层面的标注工作。文献[14]面向句子层面的标注数据集上使用现有的语言资源(例如,情感词典,否定词,强度词),结合LSTM模型用于情感分类。目前,注意力机制已成为一种有效的策略用于动态学习不同特征对特定任务的贡献程度,已经在自然语言处理中获得优异的效果。文献[17]在文本分类任务中引入注意力机制,提高了文本分类性能。

词性通常被用作为一种辅助特征,用于特征选择,而上述方法往往忽略了词性之间的依赖信息。词性是词语信息的关键部分。如名词类词语对文本主题的识别非常有用,动词类、形容词类的词语有助于挖掘用户在文本中的情感(或情绪)表达,但大多数工作并没有考虑每个词性对文本分类的贡献程度,

如一个经过分词的句子“她 是 一个 漂亮的 女孩”和它对应的词性序列(代词 动词 量词 形容词 名词)之间是有关的,形容词和名词之间的搭配能够增强词语“漂亮的”与“女孩”之间的相关性。分别对词语和词性进行独立建模能够保留词语间的依赖关系信息,还能加强词性间的依赖关系。因此,以注意力机制和LSTM网络模型为基础,设计一个基于注意力机制的LSTM网络模型,将词性信息加入到此方法中,来预测文本的类别。首先利用该模型的双向LSTM层对基于词语的上下文和基于词性的上下文进行独立建模,分别生成对应的隐藏层状态特征信息;然后利用该模型的注意力机制层使用上述隐含层状态特征来学习文本中不同位置的状态权重;最后将经过加权求和之后的隐含状态表示作为文本的表示,之后将其放入模型的分类层用以预测文本类别。为了评估模型的有效性,对来自NLPCC&2014和NLPCC&2017的2个开源的中文数据集(即,包含7种情绪的数据集和包含18个类别的新闻标题数据集)进行了实验。实验结果表明,将词性信息加入到此方法中可以提高文本分类的性能,并优于基准算法。

1 结合词性信息的基于注意力机制的双向LSTM的文本分类方法

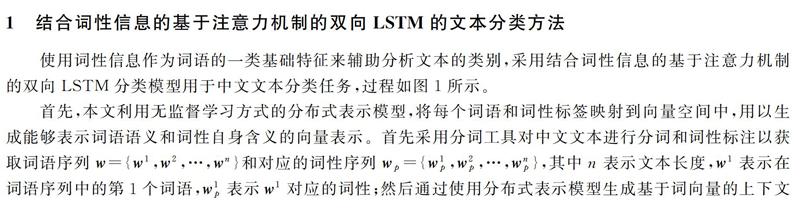

使用词性信息作为词语的一类基础特征来辅助分析文本的类别,采用结合词性信息的基于注意力机制的双向LSTM分类模型用于中文文本分类任务,过程如图1所示。

首先,本文利用无监督学习方式的分布式表示模型,将每个词语和词性标签映射到向量空间中,用以生成能够表示词语语义和词性自身含义的向量表示。首先采用分词工具对中文文本进行分词和词性标注以获取词语序列

2 实验结果与分析

2.1 实验数据集

为了验证方法的有效性,用其在2个基于中文的开源文本分类数据集上进行验证。

数据集1是来自NLPCC&2014官网上的面向中文文本的情绪分类数据集,其中情绪分类是情绪分析中的一个子任务[19],是为了帮助人们自动识别用户在文本中流露出的情绪[20]。本文的主要工作是从句子层面和博文层面分析用户在文本中表达的情绪类别。该数据集包含7个情感类别,即:喜欢、快乐、厌恶、愤怒、悲伤、恐惧和惊喜。值得注意的是,本文主要研究是预测最适合文本的情绪类别,所以原数据集中的所有无情绪标签的文本数据都删除,这样也避免了不同情绪类别的数据分布不均衡。各种情绪类别数据又被分为训练集(用于训练模型的数据集)和测试集(用来评估方法有效性的数据集),数据统计见表2。数据集2来自NLPCC&2017官网上的基于中文的新闻标题分类数据集。该工作主要是评估结合词性特征的基于注意力机制的双向LSTM针对短文本的分类性能。该数据集包含18个新闻类类别的标签,在实验过程中该数据集被划分为3个子数据集,即训练数据集(train),开发数据集(dev)和测试数据集(test),数据集的统计图(水平轴表示文本的长度,纵轴则表示对应的数量),见图2。

2.2 评测指标

使用准确率(Accuracy)评估基于注意力机制的LSTM的文本分类方法的性能。计算方式如式(10)所示:

2.3 实验结果展示与分析

首先针对数据集1进行实验。从表3可以观察到,基于LSTM的文本分类方法在句子层面的数据集1和在博文层面的数据集1分別获得56.5%和56.7%的分类效果,该方法所获得的分类效果是所有效果中最差的。对比基于注意力机制的LSTM的文本分类方法和基于LSTM的文本分类方法的分类效果,可以看出注意力机制能够明显提升中文情绪分类效果,暗示注意力机制具有学习上下文隐式特征的能力。在基于注意力机制的双向LSTM的文本分类方法的基础上增加词性特征信息后,其在句子层面的数据集1条件下优化了0.8%,在博文层面的数据集1条件下优化了0.3%。从实验结果上看,通过增加词性信息能够明显的提升中文情绪分类效果。

准确率能够评估文本分类方法在整体数据集条件下的分类效果,但是并不能详细展示出分类方法针对每个类别的预测效果。从数据集1中的各类情绪类别出发,计算文本分类方法在各类别情况下的F值。其中,图3和图4(水平轴表示类别标签,纵轴则表示对应的F值,不同颜色深浅代表不同的文本分类方法)分别展示了文本分类方法在句子层面的数据集1环境下和在博文层面的数据集1环境下的F值分布。实验结果表明,结合词性特征信息的文本分类方法能够在恐惧、厌恶、愤怒和喜欢的情绪分类标签下优于其他对比模型的效果,但是在悲伤、快乐和惊喜的情绪分类类别上的F值略低于基准模型,这表明在针对句子层面的数据集中,在数据分布不平衡的类别条件下,该分类方法的性能并没有明显提升。通过同时分析图3和图4实验结果可以发现,结合词性信息的基于注意力机制的双向LSTM在句子层面和在博文层面所取得的F值基本一致,表明该分类方法对输入文本的长度并不敏感。

其次,为了评估结合词性信息的基于注意力机制的双向LSTM的文本分类方法在其他类型数据集上的分类性能,在由18个新闻标题类别的短文本数据集(即数据集2)上进行实验。对比基于LSTM的文本分类方法和基于注意力机制的LSTM的文本分类方法,从表4能够看出后者的分类效果优于前者的分类效果,表明了基于注意力机制的文本分类方法对短文本进行分类是有效的。结合词性信息的基于注意力机制的双向LSTM能够结合词性上下文之间的依赖特征信息作为词语上下文的一个辅助信息并有效地进行建模。它的分类性能要略好于基于注意力机制的LSTM的文本分类方法。从图5中能够看出结合词性信息的基于注意力机制的双向LSTM的文本分类方法在大多数新闻标签数据集下略微提升了分类效果,而在其他新闻标签数据集2条件下基本一致,可能的原因是所有新闻标签的数据分布较为平衡。

3 结 语

利用词语的词性信息,提出了一个简单的文本分类方法,通过LSTM从文本中提取并学习上下文中的隐式特征信息,通过注意力机制动态地学习不同隐式特征信息在文本分类任务中的贡献程度,通过分类函数预测文本的类别标签。该分类方法能够从词性信息中学习有效的特征,并提供足够的信息来识别文本的类别。分析在数据集1和数据集2的实验结果可以得出本文所提出的文本分类方法获得了优越的分类性能。

本文给出的基于词性信息的文本分类算法,虽然达到了预期的目标,但是在上下文隐式特征学习方法上仍有改进的空间,尤其是在情绪分析方面可能存在部分片面性,如未将博主的基本信息、性格特征与博文结合起来进行分析。未来的工作中,将完善本方法,对中文情绪分类任务展开进一步的研究,以实现最优的情绪分类效果,并计算出不同的隐式特征对情绪分类的贡献程度。

参考文献/References:

[1] MOHAMMAD S M, TURNEY P D. Emotions evoked by common words and phrases: Using mechanical turk to create an emotion lexicon[C]//Proceedings of the NAACL HLT 2010 Workshop on Computational Approaches to Analysis and Generation of Emotion in Text. Los Angeles: Association for Computational Linguistics, 2010:26-34.

[2] LI Weiyuan, XU Hua. Text-based emotion classification using emotion cause extraction[J]. Expert Systems with Applications, 2014, 41(4): 1742-1749.

[3] GAO Kai, XU Hua, WANG Jiushuo. Emotion classification based on structured information[C]//International Conference on Multisensor Fusion and Information Integration for Intelligent Systems.Beijing: IEEE, 2014:1-6.

[4] ZHANG Dongwen, XU Hua, SU Zengcai, et al. Chinese comments sentiment classification based on word2vec and SVM perf[J]. Expert Systems with Applications, 2015, 42(4):1857-1863.

[5] KIM Y. Convolutional neural networks for sentence classification[C]// Conference on Empirical Methods in Natural Language Processing.Doha:Association for Computational Linguistics, 2014:1746-1751.

[6] KAICHBRENNER N, GREFENSTETTE E, BLUNSOM P. A convolutional neural network for modelling sentences[C]// 52nd Annual Meeting of the Association for Computational Linguistics.Baltimore: Association for Computational Linguistics, 2014:655-665.

[7] TAO Lei, BARZILAY R, JAAKKOLA T. Molding CNNs for text: Non-linear, non-consecutive convolutions[J]. Indiana University Mathematics Journal, 2015, 58(3) :1151-1186.

[8] TAI K S, SOCHER R, MANNING C D. Improved semantic representations from tree-structured long short-term memory networks[C]// 53rd Annual Meeting of the Association for Computational Linguistics and the 7th International Joint Conference on Natural Language Processing of the Asian Federation of Natural Language Processing. Beijing:Association for Computational Linguistics, 2015: 1556-1566.

[9] WANG Yequan, HUANG Minlie, ZHU Xiaoyan, et al. Attention-based LSTM for aspect-level sentiment classification[C]//Conference on Empirical Methods in Natural Language Processing.Austin: Association for Computational Linguistics, 2016: 606-615.

[10] MA Dehong, LI Sujian, ZHANG Xiaodong, et al. Interactive attention networks for aspect-level sentiment classification[C]//Twenty-Sixth International Joint Conference on Artificial Intelligence. Melbourne: International Joint Conferences on Artificial Intelligence, 2017:4068-4074.

[11]GHORPADE T, RAGHA L. Featured based sentiment classification for hotel reviews using NLP and Bayesian classification[C]// International Conference on Communication, Information and Computing Technology. Mumbai: IEEE Computer Society, 2012:1-5.

[12]MORAES R, VALIATI J F, NETO W P G. Document-level sentiment classification: An empirical comparison between SVM and ANN[J]. Expert Systems with Applications, 2013, 40(2):621-633.

[13]ZHANG Ye, LEASE M, WALLACE B C. Active discriminative text representation learning[C]// 31st AAAI Conference on Artificial Intelligence. San Francisco:AAAI, 2017: 3386-3392.

[14]QIAN Qiao, HUANG Minlie, LEI Jinhao, et al. Linguistically regularized lstms for sentiment classification[C]// 55th Annual Meeting of the Association for Computational Linguistics. Vancouver: Association for Computational Linguistics, 2017:1679-1689.

[15]HOCHREITER S, SCHMIDHUBER J. Long short-term memory[J]. Neural Computation, 1997, 9(8): 1735-1780.

[16]GRAVES A, JAITLY N, MOHAMED A. Hybrid speech recognition with deep bidirectional LSTM[C]//IEEE Workshop on Automatic Speech Recognition and Understanding.Olomouc: IEEE Computer Society, 2013: 273-278.

[17]YANG Zichao, YANG Diyi, DYER C, et al. Hierarchical attention networks for document classification[C]// Proceedings of the 2016 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies.San Diego: Association for Computational Linguistics, 2016:1480-1489.

[18]MIKOLOV T, SUTSKEVER I, CHEN Kai, et al. Distributed representations of words and phrases and their compositionality[J]. Advances in Neural Information Processing Systems, 2013, 26:3111-3119.

[19]ZHANG Lei, WANG Shuai, LIU Bing. Deep learning for sentiment analysis: A survey[J]. Wiley Interdisciplinary Reviews Data Mining & Knowledge Discovery, 2018: 8(4):10.1002/widm.1253.

[20]ZHAI Zhongwu, XU Hua, KANG B, et al. Exploiting effective features for chinese sentiment classification[J]. Expert Systems with Applications, 2011, 38(8):9139-9146.