智能三坐标测量机的零件位姿识别

2017-08-02韩振华刘书桂高礼圳

韩振华 刘书桂 高礼圳 余 飞

天津大学精密测试技术及仪器国家重点实验室,天津,300072

智能三坐标测量机的零件位姿识别

韩振华 刘书桂 高礼圳 余 飞

天津大学精密测试技术及仪器国家重点实验室,天津,300072

提高三坐标测量机对零件检测的智能化,实现零件的位姿识别是非常必要的。提出了一种新的视觉识别零件及位姿的方法,该方法首先比较全面地提取实际零件的三维特征信息,然后根据零件三维特征在虚拟空间中寻找匹配组合,并根据匹配组合计算旋转平移矩阵,最后根据实际和虚拟的零件成像轮廓的相似度进行位姿识别。实验表明新方法能够对零件及位姿进行识别,并且最大误差不超过1 mm。

智能的;三坐标测量机;视觉;位姿;识别

0 引言

随着科技的发展,制造业对数控检测等设备的智能化提出了越来越高的要求,某些应用场合需要在无人的条件下对有毒、易爆和强辐射零部件进行检测[1],数控检测设备的智能化及防碰撞能力[2]成为其发展的技术瓶颈[3]。因此提高数控检测设备的智能化对制造业发展具有重要的意义。

为了提高包括三坐标测量机(CMM)在内的数控机器设备的安全性和智能化,早期的研究工作主要是针对二维场景中的问题。AHMAD等[4]应用软件Matrox inspector对零件进行检测和定位,但没有提到相关识别零件及位姿的技术细节。TIAN等[5]利用摄像机在虚拟空间和实际空间中,用同样的方位对零件拍照并进行图像识别,提出了一种基于图像识别的标定方法。现有的零件位姿识别方法大多限于零件被平放在检测平台上,例如马新辉等[6]假定零件是通过表平面和数控检测平台充分接触摆放的,利用零件所有可能表平面和检测平台接触时位姿的虚拟成像和单个相机实际成像进行一一识别,将相似度最大的虚拟成像所对应的零件姿态作为实际零件姿态,总体实现精度比较高,但无法对零件非表平面和检测平台接触的情况进行准确识别,比如由于夹具等导致零件放置姿态倾斜等情况。黄风山等[7]利用角点进行零件位姿判定,但是相机在2个位置提取的特征信息容易产生匹配错误,且只是利用角点特征信息,过于单一。

本文针对智能三坐标测量机提出了一种新的视觉识别零件各种位姿的方法:利用三坐标测量机高精度地移动单个相机在3个不同位置对零件进行特征定位,能够最大限度地对零件三维特征信息进行准确定位,避免出现误匹配。该方法不仅能对零件表平面和测量平台接触时的位姿进行识别,而且能够对零件非表平面和测量平台接触的位姿进行识别。

1 系统构成

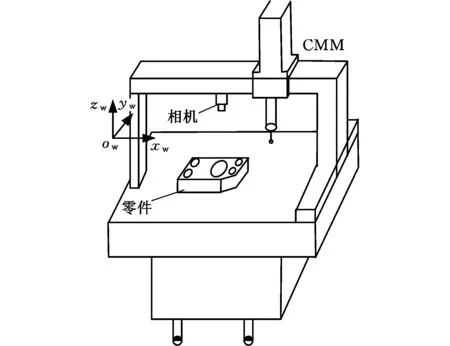

本文中系统的结构如图1所示,三坐标测量机的坐标系为owxwywzw,相机固定在三坐标测量机横梁上,朝向测量平台,相机的内部参数已提前经过标定。摄像机坐标系ocxcyczc和三坐标测量机坐标系owxwywzw的转换关系为

(1)

si=sinici=cosii=α,β,γ

旋转矩阵R、平移矩阵T是通过标准球标定得到的[8]。三坐标测量机坐标系向摄像机坐标系旋转的变换如下:首先围绕xw轴旋转角度α,然后围绕yw轴旋转角度β,最后围绕zw轴旋转角度γ。相应的平移矩阵T=[txtytz]T。

图1 视觉系统分布示意图Fig.1 Vision system distribution diagram

2 零件特征信息的定位

零件特征信息的定位步骤:首先根据零件的实际成像提取二维特征信息;然后根据视觉系统和匹配的二维特征信息进行三维特征信息的定位,部分实现方法见文献[9]。

视觉系统定位的零件特征信息包括角点坐标、圆心坐标、半径以及棱边所在的直线方程。图1中,摄像机固定在三坐标测量机的横梁上,通过移动三坐标测量机使得yw坐标发生变化,带动相机移动到不同位置。由于三坐标测量机具有较高的定位精度,因此不同位置的摄像机坐标系之间的转换关系就可以根据三坐标测量机在yw轴方向移动的距离求解得到。为了避免不同位置相机提取的图像特征匹配出现多解,提出了三坐标测量机带动相机分别移动3个不同位置的方法。为减小特征信息的定位精度受相机移动距离大小的影响,本系统根据相机在不同位置时零件成像位置的变化以及相机成像面大小,确定三坐标测量机在yw轴方向相距最远的两个位置的坐标,然后取上述两个坐标的中点为第三个位置。

零件的特征信息包括角点、圆、直线等,为了充分利用各类有效特征信息,本文对零件的特征信息分三类介绍:

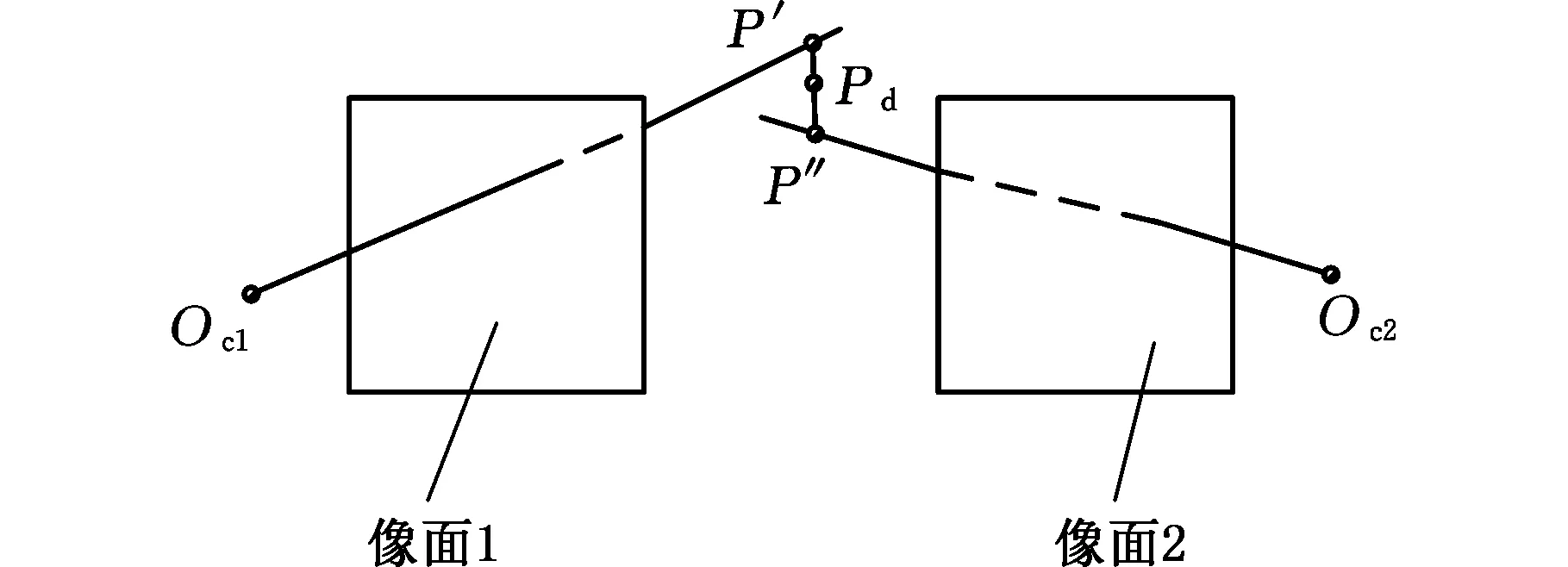

(1)空间点(包括角点、圆心)的坐标计算。具体的计算原理如图2所示,每两个不同位置的相机提取的信息为一组,设相机坐标系的原点分别为Oc1、Oc2,空间点Pd在两个相机中的成像分别为P′、P″。 线段P′P″为射线Oc1P′、Oc2P″的公垂线段,取线段P′P″的中点为空间点Pi,i为相机组的编号。将按照

(2)

求得的平均坐标作为空间点Pd的坐标。

图2 空间点计算Fig. 2 Space point calculation

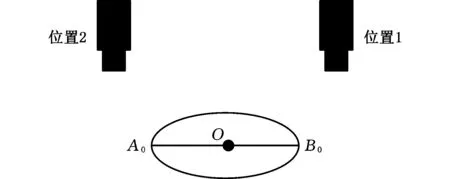

(2)圆的特征信息的提取。图3中,特征圆的圆心为点O,在特征圆所在的范围内有无数个直径,所有的直径都经过圆心O且所在直线的方向都不相同,只有经过圆心O直径A0B0所在的直线且和相机的成像面平行时,直径的成像最长。特征圆成像一般为椭圆,圆的直径成像长度约等于特征圆成像椭圆的长轴长度。由于位姿识别系统允许有一定的误差,在系统允许的误差范围之内,本文设定成像椭圆的长轴即为经过圆心O的直径成像。不妨设特征圆的直径为2r。每两个相机为一组,首先按照式(1)确定圆心点的空间位置坐标。假设圆心点在其中一个相机坐标系中zc轴方向的坐标为zi,圆的直径为2ri, 成像椭圆长轴长度为li, 根据小孔成像原理有

2ri=lizi/f

(3)

图3 提取圆特征Fig.3 Extracting the circle feature

(3)求解空间直线方程。当相机从3个不同的位置看到同一条直线时,每两个位置的相机为一组,按图4所示原理求解,最后把所有结果相加并求平均值,由平均值即可得到空间直线方程各项系数。相机只在一条空间直线上移动,为减小提取误差,本系统只定位和三坐标测量机移动方向夹角比较大的直线。相机坐标系的原点为Oc1、Oc2,空间直线段A1B1在两个相机上的成像分别为线段a1b1、a2b2。平面Oc1a1b1和平面Oc2a2b2求交即可确定直线A1B1的方程。

图4 提取空间直线Fig.4 Extracting space line

3 零件位姿识别方法

基于视觉的零件位姿识别方法步骤:首先利用视觉系统提取零件的三维特征信息,然后根据三维特征信息在零件模型数据库里搜索匹配,计算所有匹配的结果,最后根据零件的轮廓特征确定出最优的零件位姿。虚拟空间中,由所有零件虚拟模型信息组成的数据库称为零件模型数据库。

识别零件的位姿实际就是计算正确的零件坐标系和三坐标测量机坐标系之间的转换关系,计算方法见文献[10]。Open CASCADE几何造型库读入的零件CAD文件以零件设计坐标系为基准,文中的零件坐标系就是零件设计坐标系,因此需要结合视觉系统提取的零件特征信息在三坐标测量机坐标系和零件坐标系下的坐标一起计算两个坐标系之间的转换关系。由文献[10]可知,根据3个公共的非共线点,可以求解2个坐标系之间的转换关系。

实际提取特征信息向量xs=(xs1,xs2,xs3,xs4,xs5,xs6,xs7,xs8),零件三维特征信息可以分为以下4类组合,N2为每类特征组合中匹配组合个数。

(1)3个非共线的空间点特征组合,空间点包括圆心和角点。对每一种3个非共线点的组合进行如下处理:以3个非共线点之间相互距离xs1、xs2、xs3为搜索特征,圆心以该圆半径xs4为搜索特征,在零件模型数据库中搜索所有此类组合,特征信息向量xs中的其他特征值为0,N2=1。

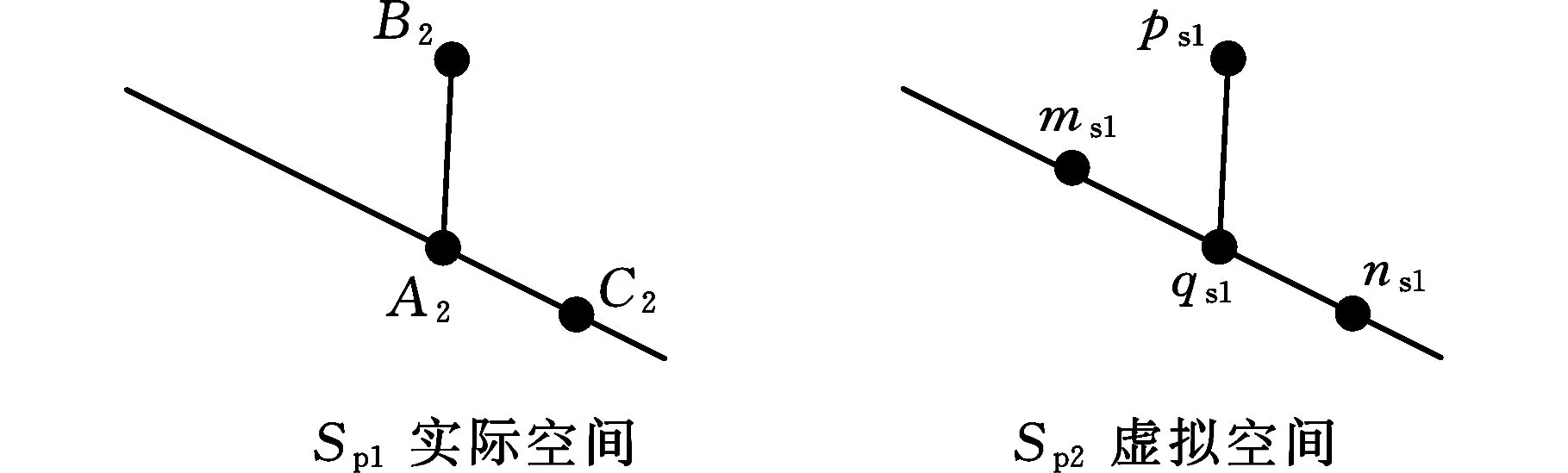

(2)空间点(包括角点和圆心)和直线的特征组合,且该空间点不在这条直线上。所有此类组合按照图5中Sp1所示进行处理,点B2为空间点,直线A2C2为一空间直线,点A2为点B2在直线上的垂足,点C2和点A2具有固定的距离。以A2B2的长度xs5及圆半径xs4为特征,在零件模型数据库中搜索点线组合,特征信息向量xs中的其他特征值为零。每种匹配点线组合都按照图5中的Sp2所示进行处理,做点ps1在直线上的垂足qs1,在点qs1两边的直线上取距离点qs1具有相同长度的点ms1、ns1。虚拟空间中,每个点线组合又可以分为两种不同的匹配组合,N2=2。

图5 点和直线组合Fig.5 Point and straight combination

(3)两条相离的直线特征组合。对于所有此类组合,按照图6中Sp3所示进行处理。首先求取两条相离直线距离最近的点A3、B3以及两条直线的夹角。在其中一条直线上取一点,如在点A3所在的直线上取点C3,使点C3和点A3具有固定的距离。然后以两条相离直线的距离xs6和夹角大小xs7为特征,在零件模型数据库中寻找相离直线组合,特征信息向量xs中的其他特征值为0。每一种匹配组合都按照图6中Sp4所示进行处理,即首先求取两条相离直线上距离最近的点ps2、qs2,然后分别在两条直线及点ps2、qs2两边取两个点满足:

|ps2es2|=|ps2fs2|=|ms2qs2|=|ns2qs2|=|A3C3|

(4)

图6 相离直线Fig.6 Disjoint straight lines

虚拟空间中,每个相离直线组合就可以分为4种和实际空间对应的匹配组合,N2=4。

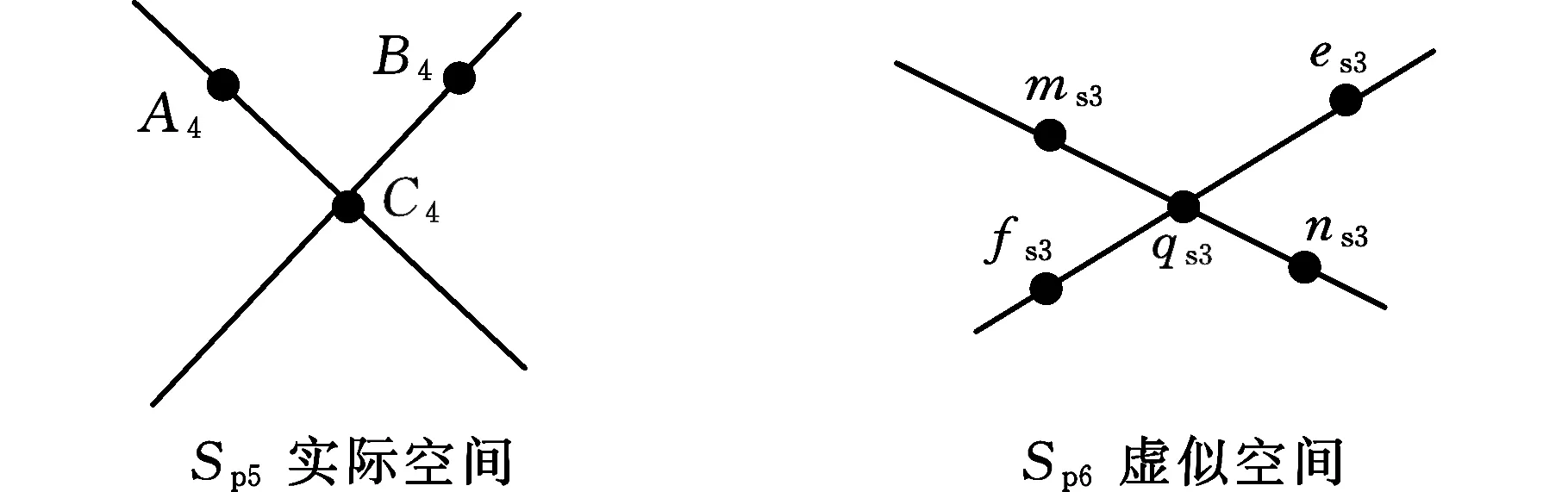

(4)两条相交直线特征组合。所有此类组合按照图7中Sp5进行处理,交点为C4,在两条直线上取点A4、B4,使|A4C4|=|B4C4|,再求取两条直线的夹角。以夹角大小xs8为特征,在零件的三维虚拟模型中寻找相交直线的匹配组合,特征信息向量xs中的其他特征值为零。每一种匹配组合都按照图7中的Sp6所示进行处理,即求取角点qs3,分别在每条直线及点qs3两边取两个点满足:

|qs3es3|=|qs3fs3|=|ms3qs3|=|ns3qs3|=|A4C4|

(5)

虚拟空间中,每个相交直线组合又可以分为8种与实际空间对应的匹配组合,N2=8。

图7 相交的直线Fig.7 Intersecting straight lines

综合以上可得4种类别总的匹配判别函数:

g(xjk)=wT(xs-xjk)

(6)

j=1,2,…,N1k=1,2,…,N2

零件模型数据库中,匹配特征向量xjk=(xjk1,xjk2,xjk3,xjk4,xjk5,xjk6,xjk7,xjk8), 权向量w=(w1,w2,w3,w4,w5,w6,w7,w8),N1为每类特征组合个数,如果|g(xjk)|≤δ,则成功搜索到匹配组合,δ为判别阈值。每类特征组合可能有多种合适匹配组合,因此需要对每一种组合计算位姿并虚拟成像,然后综合文献[6]方法,对零件实际轮廓和虚拟成像轮廓进行识别,如果所有组合计算的轮廓相似度都小于设定阈值,则判定此类特征信息组合无法识别零件位姿,具体原因是零件模型数据库中没有此零件。整个零件位姿识别方法实施具体过程为:首先视觉系统提取零件的特征信息;判断是否符合组合(1)即3个非共线空间点特征组合,如果是就按照组合(1)原理进行计算,然后通过轮廓识别确定零件位姿;如果不是组合(1)就进行组合(2)即空间点和特征直线的组合判断,如果符合组合(2),就按照其相应的原理进行计算,然后轮廓识别确定零件位姿;如果不是组合(2)就进行组合(3)即两条相离直线的特征组合判断,如果符合组合(3),就按照其相应的原理进行计算,然后轮廓识别确定零件位姿;如果不是组合(3)就进行组合(4)即两条相交直线的特征组合判断,如果符合组合(4),就按照其相应的原理进行计算,然后轮廓识别确定零件位姿。

新的位姿识别方法能有效利用零件的三维几何特征,不仅能够对零件表平面和检测平台接触时的位姿实现识别,而且能够对夹具等设备造成零件倾斜放置在检测平台上时的位姿进行准确识别。

4 位姿识别实验

实验所用三坐标测量机为海克斯康制造的Global classic SR 07.10.07。相机型号为MQ013MG-E2,分辨率为1280像素×1024像素;镜头型号为VTS0614-M2,焦距标注值为6 mm。

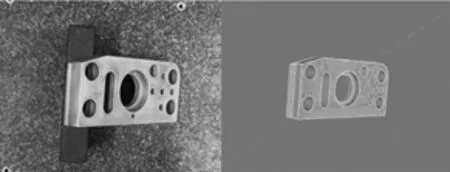

从图8可以看出,本文方法不仅能对零件平放在测量平台上的位姿进行识别,而且能对零件倾斜放置在平台接触上的位姿进行识别。

(a)零件的一个表平面和测量平台充分接触

(b)物体的位姿成像图8 识别结果Fig.8 The result of recognition

由于视觉系统对零件特征信息提取精度直接影响着最后位姿识别的精度,本实验通过视觉系统对零件特征信息提取及定位的精度来验证位姿识别的精度。首先将零件在检测的空间内放置多个位姿,分别提取每个位姿的角点、圆心及半径、直线。如图9所示,标记点是零件的角点a、c,圆心为b、零件棱边为直线L,圆心b所在圆的半径为r。

图9 零件特征信息Fig.9 The feature information of part

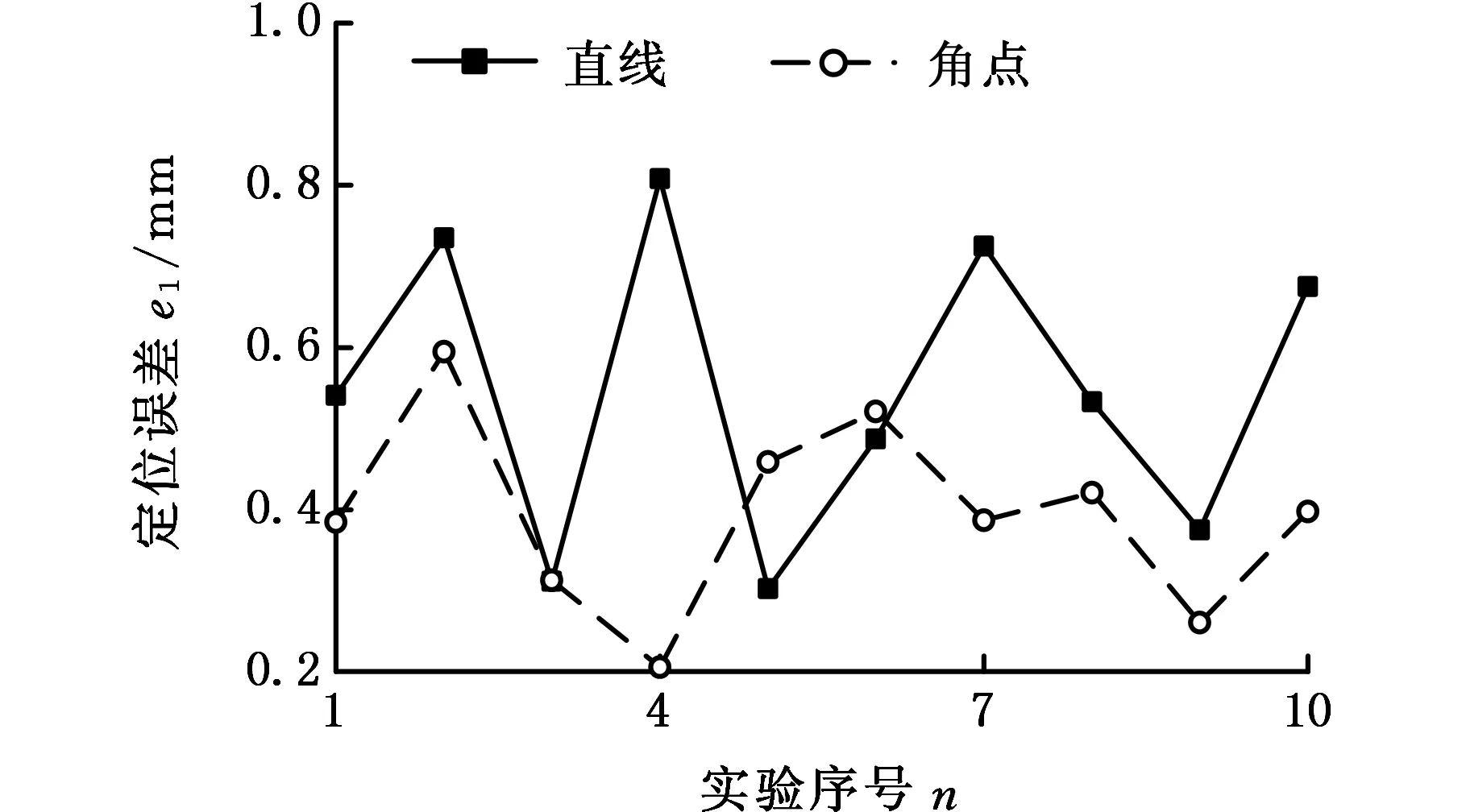

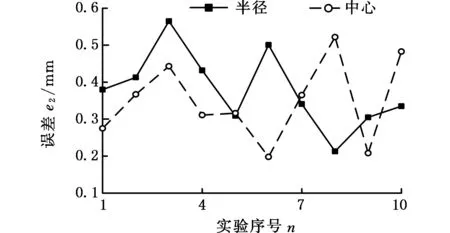

以视觉系统提取的角点a和三坐标测量机检测的同一角点的距离为视觉系统角点提取的误差。同样,以视觉系统提取的圆心b及所在圆半径和三坐标测量机检测的同一圆心的距离及半径的差值为视觉系统提取圆心和半径的误差。以三坐标测量机检测角点c到视觉系统提取的直线L的距离为判定提取直线的误差。多次实验误差如图10所示,图10a中e1表示角点、直线定位误差,图10b中e2表示圆心坐标及半径的误差。

(a)定位误差

(b)圆心坐标及半径的误差图10 提取特征误差Fig.10 The error of extracting feature

从图10中可以看出,角点、直线、圆心及半径的提取误差都在0.8 mm以内。直线的提取误差相对较大,提取直线的精度受图像中直线和相机移动方向夹角的影响,为了减小此类误差,本系统设置只提取夹角大于45°的直线。所有零件特征的提取精度受相机的分辨率、光照等条件影响。此外,理论上圆特征信息的提取精度受圆大小、位置等多个因素影响,多次实验表明,本文中零件位姿识别的最大误差在1 mm以内。图10所示的提取误差表明,本文方法能满足智能三坐标测量机的应用需求。

5 结论

(1)本文方法利用三坐标测量机高精度移动的特点实现了单个相机在3个不同位置对零件进行特征定位,能够最大限度地对零件三维特征信息进行定位,提高了定位精度,节省了硬件设备,避免了不同位置相机提取特征出现误匹配的问题。

(2)该识别方法能够较大限度利用零件的三维几何特征,实现了零件及位姿在实际空间和虚拟空间内的统一,不仅能对零件表平面和检测平台接触时的位姿实现识别,而且能对由夹具等设备造成零件非表平面和检测平台接触时的位姿进行准确识别。 实验结果表明,本文方法具有较好的实用性、适用性。

[1] ZHANG G X, LIU S G. Towards the Intelligent CMM[J]. CIRP Annal—Manufacturing Technology, 2002, 51(1): 437-442.

[2] STOJADINOVIC S M, MAJSTOROVIC V D, DURAKBASA N M, et al. Towards an Intelligent Approach for CMM Inspection Planning of Prismatic Parts[J]. Measurement, 2016, 92:326-339.

[3] CHO M W, LEE H, YOON G S, et al. A Feature-based Inspection Planning System for Coordinate Measuring Machines[J]. International Journal of Advanced Manufacturing Technology, 2005, 26(9):1078-1087.

[4] AHMAD R, TICHADOU S, HASCOET J Y. Integration of Vision Based Image Processing for Multi-axis CNC Machine Tool Safe and Efficient Trajectory Generation and Collision Avoidance[J]. Journal of Machine Engineering, 2010, 10(4): 53-65.

[5] TIAN X, ZHANG X, YAMAZAKI K, et al. A Study on Three-dimensional Vision System for Machining Setup Verification[J]. Robotics and Computer-Integrated Manufacturing, 2010, 26(1):46-55.

[6] 马新辉, 张国雄, 王建利, 等. 智能三坐标测量机中零件位置自动识别系统[J]. 仪器仪表学报, 2003, 24(2): 165-170. MA Xinhui, ZHANG Guoxiong, WANG Jianli, et al. Automatic Recognition for the Position and Orientation of Parts in Intelligent CMMs[J]. Chinese Journal of Scientific Instrument, 2003,24(2):165-170.

[7] 黄风山, 刘恩福, 方忆湘,等. 基于智能三坐标测量机的零件位姿单目立体视觉识别[J]. 光学精密工程, 2013, 21(5):1326-1332. HUANG Fengshan, LIU Enfu, FANG Yixiang, et al. Single Camera Stereo Vision Recognition for Parts’pose Based on Intelligent Three Coordinate Measuring Machine[J]. Optics & Precision Engineering, 2013, 21(5):1326-1332.

[8] 刘书桂, 宋宣晓, 韩振华. 球形靶标中心成像点的高精度定位[J]. 光学 精密工程, 2016, 8(24): 1862-1869. LIU Shugui, SONG Xuanxiao, HAN Zhenhua. High-precision Positioning of Projected Point of Spherical Target Center[J]. Optical and Precision Engineering, 2016, 8(24): 1862-1869.

[9] 高礼圳, 刘书桂, 韩振华. 零件的角点提取及匹配定位[J]. 中国光学, 2016, 9(4):398-403. GAO Lizhen, LIU Shugui, HAN Zhenhua. Corner Extraction and Matching Location of Parts[J]. Chinese Optics, 2016,9(4):398-403.

[10] 陈宇, 白征东, 罗腾. 基于改进的布尔沙模型的坐标转换方法[J]. 大地测量与地球动力学, 2010, 30(3):71-73. CHEN Yu, BAI Zhengdong, LUO Teng. An Improved Bursa Model for Coordinate Transformation[J]. Journal of Geodesy and Geodynamics, 2010, 30(3):71-73.

(编辑 张 洋)

Part Position and Orientation Recognitions on Intelligent CMM

HAN Zhenhua LIU Shugui GAO Lizhen YU Fei

State Key Laboratory of Precision Measuring Technology & Instruments,Tianjin University,Tianjin,300072

In order to improve the intelligence of CMM for part detection, it was necessary to recognize positions and orientations of parts. A new visual recognition method for positions and orientations of parts was proposed. The new method firstly extracted actual 3D feature informations of parts more comprehensively, and then matched combinations of the 3D features were found in virtual space. Rotation matrix and translation matrix were computed by matched combinations. Finally, the positions and orientations were determined according to part contour matching similarity between real and virtual imaging. Experiments show that the positions and orientations may be recognized by the new method.

intelligent; coordinate measuring machine(CMM); vision; position and orientation; recognition

2016-07-19

天津市自然科学基金资助重点项目(13JCZDJC34500)

TP391

10.3969/j.issn.1004-132X.2017.14.016

韩振华,男,1986年生。天津大学精密仪器与光电子工程学院博士研究生。主要研究方向为视觉检测、智能控制、三维虚拟现实、模式识别。E-mail:hanzhenhua@tju.edu.cn。刘书桂,男,1954年生。天津大学精密仪器与光电子工程学院教授、博士研究生导师。髙礼圳,男,1991年生。天津大学精密仪器与光电子工程学院硕士研究生。余 飞,男,1989年生。天津大学精密仪器与光电子工程学院硕士研究生。