图灵的预言

2017-06-22安德鲁·霍奇斯

安德鲁·霍奇斯【英】

对ACE(自动计算机)的广泛宣传,引起了英国工业界的好奇心。1946年11月7日,《工业化学》的编辑向图灵约稿,图灵回复说,ACE确实可以自动处理固体或液体在无涡动情形下的热量转移问题,但只有在ACE开发完成并实际解决几个这类问题之后,他才能了解具体的细节,并写出准确的文章。11月11日,无线电工程协会邀请图灵写一篇论文,但图灵还是回复说:

非常抱歉,我不能发表这样的论文,我需要获得我们主任的许可,建议你直接写信跟他谈。

然而,领导们此时的想法是,需要将图灵的曝光率降到最低,报纸上的尴尬已经太多了。因此,沃默斯利建议达尔文(国家物理实验室领导者),与其让图灵到处给人讲解他的机器,还不如让他给那些对此有兴趣的人员开设一个讲座。于是,讲座被安排在12月和1月的每周四下午,地点在军需部的办公室。他们一共发了不到25封邀请函,给相关的电子工程师、器件制造商、军方代表等。这场讲座可以看成英国版的莫尔学院讲座,尽管他们的背景并不相同。根据一份国家物理实验室的备忘录,图灵的讲座遭到了大量的批评。出席讲座的这些人,不同意图灵讲的东西,他们都有自己的想法,而且不想因为图灵而改变。

另一方面,关于基础电子学的讲座也不太顺利,因为那些来自电子通信研究所的人,对于ACE的延迟线存储器也有很多自己的想法。但是,尽管这些讨论不太客气,但却清楚地明确了ACE还有哪些工作需要电子通信研究所的帮助。事实上,他们真的提供了帮助,尽管不是以达尔文希望的方式。

哈佛座谈会

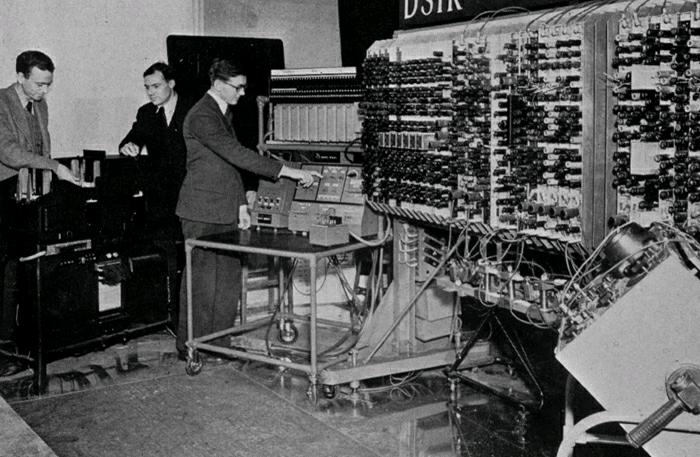

12月13日,这个讲座计划突然被一封来自美国的信打断了。沃默斯利得到邀请,参加一场1月7日到10日在哈佛举行的大型电子计算机座谈会,这同时也是艾肯的马克Ⅱ号延迟计算机的竣工仪式。但是达尔文当即决定,让图灵去向美国的专家们敬个酒,顺便去拜访一下ENIAC团队和冯·诺依曼团队。

这场座谈会集合了几乎所有与计算机相关的美国人,图灵则是唯一的英国人。他在这场座谈中,扮演了很重要的角色,他评论了J.W.弗莱斯特和J.A.拉奇曼关于阴极射线管存储器的提议,后者正在美国无线电公司负责开发光线摄像管。图灵的评论具有他一贯的风格,也就是用抽象的理论来讨论工程问题:

图灵博士说:弗莱斯特博士提到了通过低速电子来刷新电荷的可能性,并且说拉奇曼博士将会在他的论文中对此给出详细的解释。弗莱斯特博士认为该方法对于他的存储器来说是可行的,但我认为这里面似乎存在着一个根本性的困难。除非这种存储介质具有颗粒状结构,否则这种方法將不可行,因为对于任何一个稳定的状态来说,如果它是稳定的,那么将它改变一个任意微小量而得到的状态就同样是稳定的。因此,你无法给出一个有限的稳定状态数,相反,这个数将是无限的。

图灵还将他的ACE计划与威尔克斯和冯·诺依曼划清了界线:

我们试着充分利用目前可用的设备,通过编程来使该机器得以处理各种不同的工作,而不是通过增加额外的硬件设备……

这是一个普适的原则,物理设备能执行的任何操作,都可以被解构,并在类EDVAC的机器内部执行。因此,我们通过增加更多的编程工作量,就可以避免增加更多的硬件设备。

然后,图灵到普林斯顿待了两个星期。在电子计算机领域,美国现在已经不比英国领先了,而且他们也遇到了一些障碍。数学与工程之间的鸿沟是其中之一,还有埃克特与莫切利分道扬镳,各自去搞自己的公司了,EDVAC也发生了专利纠纷,正在进行诉讼。与图灵一样,冯·诺依曼和戈尔斯坦现在也在思考矩阵求逆的数值算法,以及水银延迟线的物理性质等问题。不过,戈尔斯坦误认为图灵不支持延迟线,这可能是因为图灵谈到了一些延迟线的困难。

图灵没有从美国带回来任何新想法,他现在已经不需要这样的交流了。1947年初,当图灵从大西洋彼岸回来时,一个更加艰苦的冬天正在等着他。

合作的问题还在谈,但是也仅限于谈。1月21日,国家物理实验室的秘书长E.S.希斯考克报告:“邮政实验室已经成功地保持一个数值在延迟线上循环了半个小时。这个消息令人振奋。威廉姆斯教授在电子存储方面的工作还有待继续。”但是就在两天后,威廉姆斯拒绝了国家物理实验室的合同,他为ACE工作的假象,就此彻底破灭了。1月2日,威尔克斯写信给沃默斯利,尽管与现有设计不太协调,但他仍然希望合作(“我很愿意在原型设计方面听听图灵的想法”)。这封信又一次在沃默斯利的办公室里造成了尴尬。哈特里还有另一个想法,相比之下更为现实,他邀请了ENIAC团队的成员H.D.哈斯基,作为休假在国家物理实验室度过1947年。当图灵回国时,哈斯基已经安顿好了。他将带来一些美国技术,尤其是在硬件方面。1946年就这么过去了,在这一年中,巨人机得以从设计草稿直到建造完成,但是他们的ACE却没有取得任何实质性进展。图灵利用他的美国之行,总结了国家物理实验室目前的局面:

我的美国之行,没有看到任何重要的新技术,我认为这主要是因为,我们去年已经得到了很多美国方面的信息。然而,我却获得了许多新的想法,关于项目多元化的价值,以及他们的组织规模。他们开展了各种不同的计算机项目,数量之多甚至无法一一列举。我认为这是个错误,他们的网撒得太广了,这会造成资源的浪费。我们现在把所有的努力都集中在一个项目上,应该比他们做得更好,因为这个项目得到的支持,应该比美国的任何一个项目都更加有力。但是目前来看,情况却不是这样,相比于美国的任何一个大型项目,我们得到的支持都很微不足道。如果说到美国在这项工作上投入的人力,我要说至少有200~300人出席了哈佛的座谈会,而且开设了大约40场专题讲座。我们完全做不到这些。

“学习”的模仿

尽管图灵的进度一再延误,但他的信心似乎丝毫未受影响。2月20日,图灵在伦敦数学学会发表演说,他煞费苦心地演示了想象中的ACE操作,好像它几乎就要完成了,用不了多久,终端就要开始运转了,大量的编程人员就可以投入工作了。

然而,图灵的这番想象,其实是基于他长期在布莱切利的环境中看到的场面。他展望的这种围绕ACE的“老大”和“跟班”的工作关系,非常像密码专家和女勤人员的关系,专家负责逻辑编程,助手负责操作机器。但是图灵还进一步说:“随着时间发展,计算机本身将具有专家和助手的功能,助手将会被机器的电子四肢和电子感官取代。比如说,可以通过曲线识别器,从曲线中直接读取数据,不需要助手们人工读数再制成打孔卡片。”这并不是新思想,威廉姆斯已经为曼彻斯特差分机制造了这么一个东西。但是这件事意味着:

专家有被取代的趋势,因为任何技术一旦有了成熟方法,那么就可以设计一套指令表,由电子计算机自动完成。虽然这在技术上是有可能的,但是专家们可能不希望这样的事情发生,他们不愿意被这样抢走饭碗。在这种情况下,他们就会故意为他们的工作制造一种神秘感,精心编造一些谎言,我认为这种反应才是真正的危险。这个话题自然地引出一个问题,即原则上计算机应该模仿人类活动到什么程度。

这是一个更具争议性的话题。哈特里在11月给《时代》投稿,再次强调了他在《自然》中的声明:“机器的应用并不能取代人类,因为机器需要由人类来制造。”达尔文的说法则更加清楚:

通常所说的“大脑”这个词,是与高等智力联系在一起的,但是实际上,大脑的很大一部分,可以看成是无意识的自动机器,产生着一些可以被模仿的复杂反应。但是,这仅仅是一部分大脑,新机器无论如何都不会完全代替人类思考,它们只会促进更高层次的思考……

达尔文和哈特里,实际上回应了阿达的评论,也就是洛甫雷斯伯爵夫人,她在1842年写了一份关于巴贝奇分析引擎的评论。她认为:“这种分析引擎没有能力做任何创造性工作,它只能做那些我们已经知道明确步骤的事情。”这个论断推翻了一些天真的想法,即机器能做复杂的算术就说明机器有智能。作为第一位给通用机编程序的人,洛甫雷斯夫人非常清楚,智能在她自己的脑子里,而不在机器里。就目前而言,图灵还无法争论这一点。很显然,根据规则做出决策,这不能称为智能,智慧仍然属于规则的制定者。但是他又想不出来,机器为什么就不能取代编程人员的工作,或者说那些能够体现“智能”的工作。

圖灵脑中的想法,比“机器取代编程人员”更为深远。对于未来的发展,他在ACE报告中已经清楚地提到了一些。

事实上,一个人可以用任何语言与这些机器交流(我们假定语言是精确的)。比如,我们把识别一种符号系统的指令表输入机器,理论上讲,我们就可以用这种符号系统与机器交流。这表明,符号系统将会产生比过去更加广泛的实用价值。如果有人想让机器直接解算普通的数学方程,那么他只需要为此开发一套专门的符号系统,这种符号系统与普通的数学方程非常相似,但同时要尽可能地避免歧义。

在计算机模仿人类活动这方面,图灵思考的是对于“学习”的模仿,在这个前提下,机器不只会执行洛甫雷斯夫人说的“我们已经知道明确步骤的事”:

有人说,计算机只能按照指令执行程序。在某种意义上,这种说法是正确的,这种意义就是如果它们不按指令工作,那就说明它们出错了。我们刚开始建造这些机器时,确实是把它们视为奴隶,只让它们做一些步骤完全清晰的工作,理论上说,机器的操作者在任何时候都对机器的运行状态完全清楚。迄今为止,所有的机器都是这样工作的。但是,它们是否只能在这样的方式下工作?我们假设我们建造了这样一种机器,它有初始的指令表,并且能在满足一定的条件时,自动地修改这个指令表。可以想见,这种机器运行一段时间之后,指令表就会改得令我们无法理解,但是我们必须承认,机器仍然是在有意义地运行着。

这一段文字表明,图灵第一次意识到了存储程序式通用计算机的真正潜力。但他同时也意识到,严格来说,修改指令的能力并没有增加机器的能力,他写道:

一台机器的规则怎么能自动改变?规则从一开始就应该完整地描述机器在任何情况下、在发生任何改变时,会有什么样的反应,因此这套规则本身是不会改变的……对这个悖论的解释是,规则在自动学习过程中发生的改变,相对来说是动态的,它们不断地修改,而且只是暂时有效。对于这一点,读者可以类比美国的宪法。

但是从严格的逻辑角度看,图灵认为改变指令的过程与人类的学习过程具有值得注意的相似性,这一点应该要强调。他把机器在运行过程中改变自己的指令的过程,看成是小学生学习新知识的过程。这是图灵典型的跳跃式类比,就像从“指令便条”跳到“思维状态”。他继续解释他的学习机器:

也许这个机器得到的结果,仍然取决于我们一开始设置的指令,但其执行过程却是以一种更加高效的方式。在这样的例子中,我们必须承认,机器运行时的很多中间状态,是我们在设计初始指令时无法预见的。机器就像一个小学生,他会从老师那里学到一些东西,但是他自己也会感悟出很多知识。在这种情况下,我认为我们有必要将机器视为智能的。如果我们能建造一台具有大容量存储器的计算机,那么就可以进行这样的实验。人类大脑的存储容量大约是100亿个二进制位,但是其中的大部分可能都是用于记忆视觉图像,以及其他一些相对冗余的信息。我们有理由相信,几百万个二进制位就能体现出明显的进展,尤其是我们可以将其限制在某个特定的领域内进行研究,比如下棋。

然而按照计划,ACE的存储容量顶多只有20万位。图灵把ACE的存储能力比喻成“一条鲦鱼的脑容量”。然而即便如此,他仍然相信,学习式编程在很短的时间内就将变成可能,这并不是个假想,而是一条非常具体的实践道路。1946年11月20日,图灵回信给W.罗斯·阿什比,这是一位神经学家,他十分急切地希望推动脑功能的机械模型的发展。图灵在信中如是写道:

正如你提到的,ACE先会以完全确定的方式运行,就像人类大脑的某些低级行为,尽管它们很复杂,但却具有确定的关系。这些行为不具有纠错性,如你所说,只要出现任何差错,它就不知道该怎么反馈。这些行为也不具有任何所谓的创造性。然而,没有理由表明机器只能以这种方式工作,我们在建造的过程中,并没有把它限制在这里。机器同样有可能尝试行为的多样性,并按照你说的方式,接受或排斥某个行为的结果,这也是我希望机器能够做到的。这是可以尝试的,不需要改变机器的设计,因为从理论上说,这种机器可以作为任何机器来使用,只要给它输入相应的指令表。ACE实际上与我在《可计算数》中描述的“通用机”很相似,这种理论上的可能性,在实践中也是同样可行的,通常情况下,最坏的代价也只是比专用设备稍微慢一点。因此,虽然大脑的运行机制实际上是通过树突和轴突来改变神经回路,但是我们同样可以在ACE中模拟这个模型,并不需要改变ACE的硬件设备,只需要存储相关的数据,并描述这个模型在各种情况下的行为。我想你会接受这个原理,并在ACE上进行实验,而不是建造一种专用的机器。

说到他最喜欢的机器对弈问题,图灵说:

编写一份指令表使ACE战胜普通人类棋手也许并不难,贝尔实验室的香农告诉我,他已经用这样的方法战胜了人类,但他没说清楚,对手是个什么水平的人。

实际上这可能是个误解。大约在1945年之后,香农确实在思考机器对弈问题,他的想法也是基于“最大值最小化”原理,对搜索树进行“回溯”,这与图灵和杰克·古德在1941年时的基本思想是一致的。但是香农并没有说,他已经做出了这样的对弈程序。不管怎样,图灵继续说:

这场胜利的结果本身并不重要,重要的是机器的自动学习能力。机器可以改变自己的指令,这是一个基础性的机制,但我们仍然还有很长的路要走。

机器的智能

接下来,图灵从他的核心问题上移开,考虑了一个反对机器智能的理由。根据《可计算数》得到的结论,一定存在某些问题,是机械过程无法解决的。在序数逻辑学中,图灵已经看到了不可证明的命题,也认识到了直觉的重要性。但这并不是他现在要说的。实际上,他的观点倾向于,这样的问题与“智能”无关。图灵并没有深入考虑哥德尔定理和他自己的结论,他快刀斩乱麻地给出了一个解释:

我们必须公平地对待机器。如果机器遇到无法解决的问题,我们完全可以让它给出一个错误答案。人类数学家在研究新问题的时候也会出错,显然我们并没在乎,反而会继续给他机会。但是,机器却没有得到这样的宽容,人们不允许机器出错。然而,如果我们要求机器是绝对正确的,那么它就不可能是智能的,有很多理论可以支持这一点。但是这些理论没有说明,如果机器不故意掩饰其正确性,那么到底可以表现出何等程度的智能。

这个想法非常正确。哥德尔定理和图灵的结论,是关于机器的正确性,而不是机器智能。图灵的观点仍然围绕着模仿原则,他从“公平对待机器”,想到“测试机器的智商”,最终又回到他的机器学习:

人类数学家通常经历过大量的训练,这些训练的过程,就相当于把各种指令表输入给机器。因此,我们不能要求机器完全独立地为自己编写大量的指令表,正如没有人能够独立地思考出大量的知识。人类都做不到的事,我们为什么要苛求机器?机器必须与人类保持交流,这样才能接受人类对它们的训练。机器对弈就是一个很好的例子,人类走棋的过程,就是在与机器交流,在为它们提供训练。

图灵每当说完这番话,听者总是突然打个冷战,并带着怀疑的目光,环视一遍四周。这也许是因为图灵在谈到这一问题时的兴奋情绪。图灵自己心里非常清楚,他搞乱了科学与宗教的传统界线,这也正是“无意识的机器”和“高等人类智能”之间的界线。按照他的想法,这条界线根本就不存在。

这个问题的本质,是思想与物质的关系,爱丁顿曾经试图用海森伯不确定性定理来拯救自由意识论。但是这里有所不同。爱丁顿的着眼点,是塞缪尔·勃特勒在《埃万共和国》里描绘的维多利亚式科学图景:

如果說运动是化学的、机械的,那么感觉是否也是化学的、机械的?……意识是否也有作用?我们能不能推导一套动力学理论,来解释人的激情?我们是否应该无视人的性情,而去关心他是一个什么样的杠杆?他有多么平衡?如何才能让他不平衡?

这番质问反映了19世纪的物理、化学和生物学面临的挑战。但是图灵的挑战,是在决定论的另一个层面上,一个抽象的逻辑机器的层面。另外还有一个不同,维多利亚时代的人,比如勃特勒、萧伯纳和卡本特,他们讨论的是人的灵魂和精神,而图灵现在要讨论的是“智能”。

图灵没有直接讨论“智能”这个词,他会用机器对弈的例子,来说明如何训练机器达到目标,或者用智商测试作为这种能力的一个可操作的测试标准。从布莱切利的经历来看,这种“智能”太重要了,他们正是依靠这一点,才赢得了那场战争。他们参与了无数次“智能”的对弈,并在其中战胜了德国人。更广泛地说,图灵这一代的科学家,他们的人生就是一场“智能”的对弈,对手是愚蠢的教育体制、愚蠢的经济体制。