基于Gabor特征融合与LBP直方图的人脸表情特征提取方法*

2016-09-14牛连强赵子天张胜男

牛连强, 赵子天, 张胜男

(沈阳工业大学 a. 软件学院, b. 信息科学与工程学院, 沈阳 110870)

基于Gabor特征融合与LBP直方图的人脸表情特征提取方法*

牛连强a,b, 赵子天b, 张胜男b

(沈阳工业大学 a. 软件学院, b. 信息科学与工程学院, 沈阳 110870)

针对Gabor特征全局表征能力弱以及特征数据维数存在冗余的问题,提出了一种采用Gabor多方向特征融合与分块直方图相结合的方法以有效提取表情特征.通过对不同表情的重要特征部位进行细化,采用Gabor滤波器有针对性地提取相关区域的多尺度和多方向特征,并对同尺度的特征进行融合,利用各区域内融合特征的直方图分布来表征图像.该方法可以提高特征提取的准确性,有效突出重要特征的辨识作用,大幅度降低特征的维数,在JAFFE表情库可以达到100%的识别率.

表情识别; Gabor变换; 特征融合; 局部二进制模式; 分块直方图; 多尺度; 多方向; 维数

人脸表情是人机交互、情感计算、智能控制、机器视觉和图像处理与模式识别等领域的重要研究课题,而静态人脸表情图像特征提取的目的是依据静态图像对人脸表情特征进行归类.目前,研究者主要将人类的基本表情定义为7类:高兴(Happy)、愤怒(Angry)、惊讶(Surprise)、恐惧(Fear)、厌恶(Disgust)、悲伤(Sad)和正常(Neutral),主要的表情分类方法则包括基于主元分析(principal component analysis,PCA)[1]、独立分量分析(independent component analysis,ICA)[2]和线性判别分析(linear discriminate analysis,LDA)[3]的整体法和基于Gabor小波变换和LBP(local binary pattern)算子的局部法[4].

Donato等[5]比较了几种方法在识别人脸动作单元(action unit,AU)时的性能,说明Gabor变换和ICA优于其他方法;Zhang等[6]采用多层感知器比较了Gabor特征和几何特征,发现Gabor特征具有更好的识别性能,但Gabor变换的计算量和内存需求很大,且特征维数较高.近年来,研究人员提出了很多改进方案,使Gabor特征提取方法能够在特征维数、实时性和准确性上有所突破.Wen等[7]在局部区域提取平均Gabor小波系数作为纹理特征,同时引入一种在人脸合成中使用的基于比例图的方法来对纹理提取区域进行预处理,以降低不同人脸差异和光照变化的影响;Liao等[8]提出了一种基于两组特征的表情识别方法,其一为强度、梯度图的局部二元模式特征和Gabor滤波器的Tsallis能量,其二为通过对训练图像的LDA获得的特征.LDA降低了特征向量的维数,但有可能造成有效决策信息的丢失.邓洪波等[9]提出了一种局部Gabor滤波器组,有效地提高了特征的提取速度,并减少存储量,再用PCA+LDA方法选择特征和降维,得到了较好的识别结果.上述方法将Gabor特征与其他特征选择算法相结合以构成新的低维特征向量时,会损失一些具有高区分度的纹理信息而保留了部分冗余信息,从而造成对一些细微表情的区分度下降,影响表情分类.

本文以Gabor参数和LBP算子为基础,先对人脸表情进行重要特征区域和有效变化方向的划分,以减少特征数据的冗余并防止特征淹没;利用Gabor变换对重要特征区域进行有效方向和尺度的滤波和融合,以有效地提取特征并降低其维数;再利用LBP对融合滤波特征图计算其直方图分布,得到描述纹理图像的全局特征.该方法能够在保留Gabor特征的图像纹理变化表征能力基础上,增强其全局特征表征能力,并有效降低特征冗余,具有良好的分类效果.

1 重要特征区域与有效检测方向划分

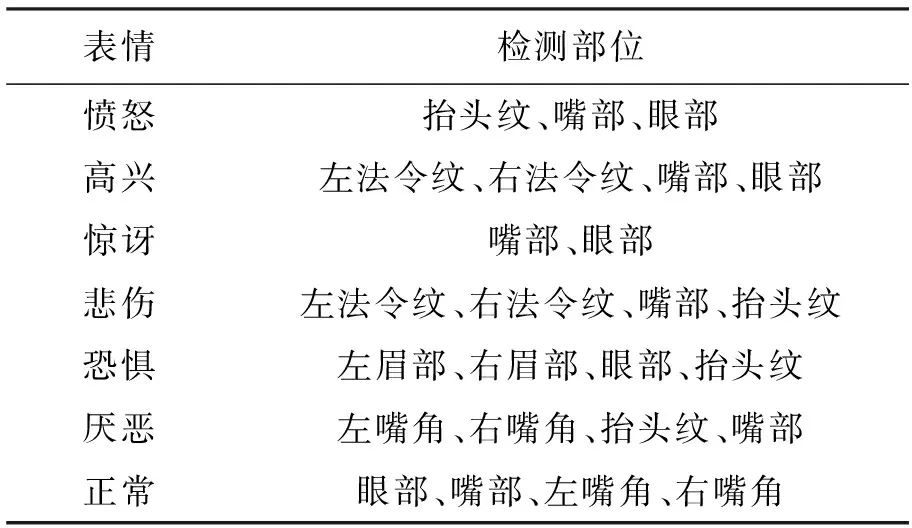

通常在特征提取之前需进行人脸图像的预处理,以找到有效的人脸区域.即便如此,人的表情变化通常仅引起小的局部变化,且这些变化具有较强的方向特征.由于不同人的上述变化较类似且可事先确定,因此,首先对人脸区域进行划分,目的是确定不同表情需要检测的重要特征子块和有效的检测方向,以进行Gabor特征图的LBP计算.

将人脸区域划分为42=7×6个互不重叠且大小相等的矩形子块,对这些子块由(1,1)到(7,6)编码,如图1所示.在人脸选取10个部位构成重要特征部位,如表1所示.

图1 面部子块划分

表1 重要特征变化子块

重要区域对应不同的表情在方向变化上的差异较大,构成了对应表情的突出特征.依据分析和实验,并结合Gabor变换的角度特性,确定了表2所示的有效检测方向.其中,○和×分别表示有效和无效,角度单位为度.

对不同子块进行多种角度检测,其结果将因对应表情的不同而存在差异,反映了该子块和角度所产生的特征对相应表情的重要性.

2 Gabor特征提取与融合

Gabor滤波器是一个由二维高斯函数衍生而来的复数域正弦曲线函数[10],相当于一组带通滤波器,其方向、基频带宽及中心频率均可调节.不同参数的Gabor滤波器组能够捕捉图像中对应于不同空间频率、空间位置以及方向选择性等局部结构信息,且对于亮度和人脸姿态的变化不敏感.

表2 有效的检测方向

不同的表情行为特征具有不同的尺度.例如,惊讶表情行为会使人脸器官在较大范围移动,需要对其进行大尺度分析,而微笑表情行为造成的人脸器官变化较小,应用小尺度分析.本文先进行多尺度的Gabor变换以提取局部特征,再对其进行融合.

2.1表情图像的Gabor特征提取

Gabor小波核函数具有与人类大脑皮层简单细胞的二维反射区相同的特性,其二维滤波器定义为

(1)

式中:kj=kv(cosμ,sinμ)T,kv=2(-v+2)/2π,μ∈(0,1,…,7),v∈(0,1,…,4)分别表示Gabor滤波器的方向尺度;z=(x,y)代表像素的位置;σ为滤波器带宽;i为复数单位.图像的Gabor特征由图像和Gabor滤波器的卷积得到.令f(x,y)为图像的灰度分布,则卷积定义为

G(x,y,v,μ)=f(x,y)*ψv,μ(z)

(2)

式中,*表示卷积算子.

为了获得多尺度Gabor特征,采用5尺度、8方向的Gabor滤波器组,对预处理后得到的256×256灰度图像做由0°到180°的8个方向的特征提取.

2.2Gabor多方向特征融合

直接Gabor变换所得到的结果维数很高,且包含大量的微弱信号.因此,本文对Gabor变换在同一尺度上的多个方向特征进行融合,通过对Gabor滤波后的信号与原始信号强度的比较,保留强信号作为表情特征,从而达到降维和突出有效信号的目的.本文中信号强度由幅值来体现,融合规则如下:

1) 将人脸图像每个像素点的各尺度上的8个Gabor方向特征转化为二进制编码,即

(3)

式中:G(z,μ,v)为像素点z=(x,y)在8个方向的Gabor特征的幅值;f(z)为原始图像的灰度.当Gabor幅值大于原图像灰度时,说明Gabor放大了此方向的表情特征.因此,式(3)对此二进制位置1使其得以保留,相反,置0以丢弃此信息.

2) 将8方向的二进制编码融合为一个十进制的尺度编码,即

(4)

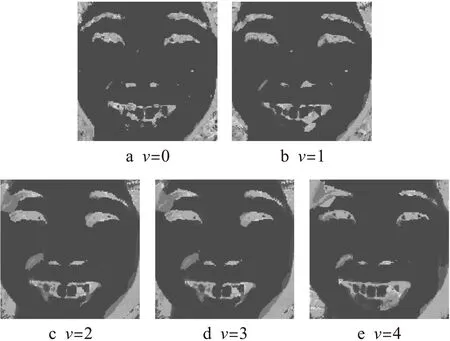

每个Tv(z)∈[0,255]的编码值表征一种局部方向,所有Tv构成了该尺度上的全部特征集.因此,可以将每个人脸图像转化为5个尺度上的多方向特征的融合图像.图2为图1中人脸图像所对应v=0,1,…,4的融合特征图.

图2 5个尺度的融合特征图

3 融合特征图的LBP滤波与分类

3.1融合特征图的LBP滤波

LBP能有效地描述纹理特征,因此,对融合特征图进行LBP滤波,以凸显信号的纹理.对于每个像素,将其灰度值对邻域点取阈值,得到二进制的局部图像描述器.通常取3×3邻域,描述器可表示为

(5)

图3 LBP滤波图

3.2分块直方图特征提取

尽管直方图能够有效地描述纹理图像的全局特征,但直接对整个融合特征图像计算直方图分布会丢失很多结构上的细节,因此按图1所示的划分分别计算直方图分布,再将其联合起来作为图像表征.

对于融合图像Xv(z),v∈(0,1,…,4),记R(i,j)为区域(i,j)的所有像素集合,其元素z的值为g(z),则每个子块(i,j)所对应的直方图定义为

(6)

令B为表1所描述的所有子块集合,则得到由滤波后的融合特征图像在5尺度、18个子块所对应直方图组成的集合S,即

(7)

由此得到用于分类的256×5×18=23 040维人脸特征.

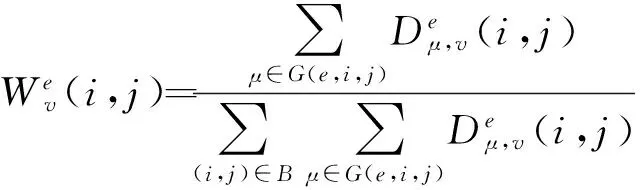

3.3子块权重的确定

(8)

根据检测结果定义相应的子块权重,即

(9)

3.4分类

在样本库中选择一定数量的训练样本,计算其相应的直方图S,并以其平均数值为模板M.由于当前待识别样本与模板均为直方图表示,样本与模板的差值为256(灰度g∈[0,255])个相互独立的随机变量,假定其符合正态分布,则256个差值的平方和服从卡方分布.为了减少人与人之间固有直方图差异的影响,将差值平方和除以样本与模板直方图的和作为差异度,即

(10)

4 数值实验与结果分析

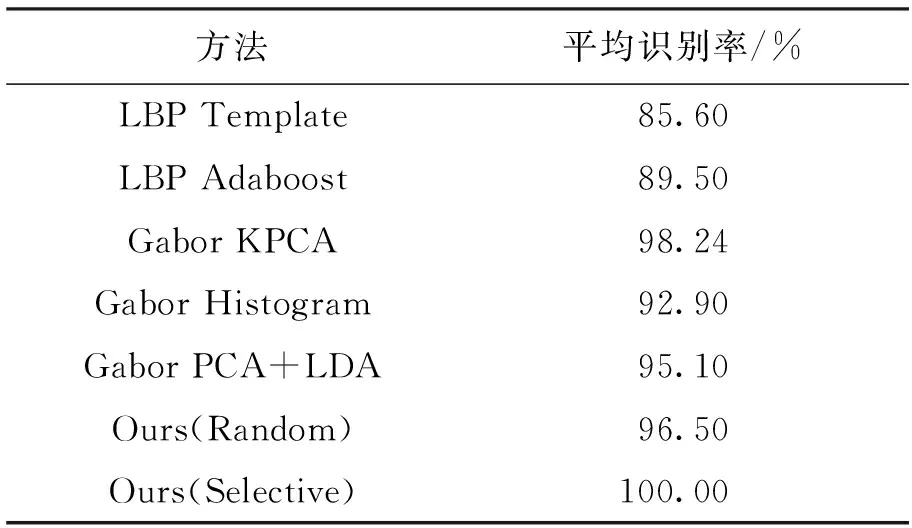

采用OpenCV和C++语言设计程序,对本文及现存的几种主要方法进行实验和比较.对比的方法包括LBPTemplate、LBPAdaboost、Gabor直方图特征法[11]、GaborKPCA[12]和GaborPCA+LDA,实验采用JAFFE女性表情数据库进行测试(http://www.atr.co.jp/).该数据库包括10个人的表情,每人有表2中的7种表情样本,各3或4个,共213个.实验时选取每人7种表情样本的3或4个样本中的1或2个样本作为训练样本,共137个训练样本,其他76个作为测试样本.在训练和识别前对所有图像进行预处理,对人脸部位做定位和分割.

两种训练样本的选择方式为:

1) 随机选取(Random).

(11)

式中,Fe为表情e的重点部位子块集合.检测权重越大说明样本表情特征越明显,因此,选择具有最大测度的指定数量的样本即可构成训练集.

表3 表情特征的重点部位

表4显示了各种算法的平均识别结果,图4为各种表情的识别样本数量.

表4 几种方法的平均识别率

图4 各方法的识别样本数

实验结果说明,LBP Template在表情特征较明显(如快乐和惊讶)时可获得90%的识别率,LBP Adaboost在降低特征维数的同时,增加了人脸表情的区分度,但依赖LBP算子不能有效提取恐惧和悲伤表情中嘴部和眉部等重要特征.Gabor频域能放大表情的局部信息,提取出法令纹、嘴部和眉部等LBP算子失效的特征,但直接对频域提取LBP直方图(Gabor histogram)不仅维数高(96 000),也会因特征混淆而影响识别率.Gabor频域结合PCA+LDA能够在一定程度上提高识别率,而结合KPCA能够降低特征维数(84 000),且增加人脸表情的区分度,达到更高的识别率(98.24%).不过,此方法易将恐惧表情误识为高兴.本文仅在特定部位、Gabor方向尺度和频域上提取特征,并对特征进行融合,不仅大幅度降低了维数(23 040),主要是通过有效方向的区分,避免了特征混淆,突出了恐惧等不易于识别表情的嘴角和眉部等细微特征,从而达到了较高的识别率.

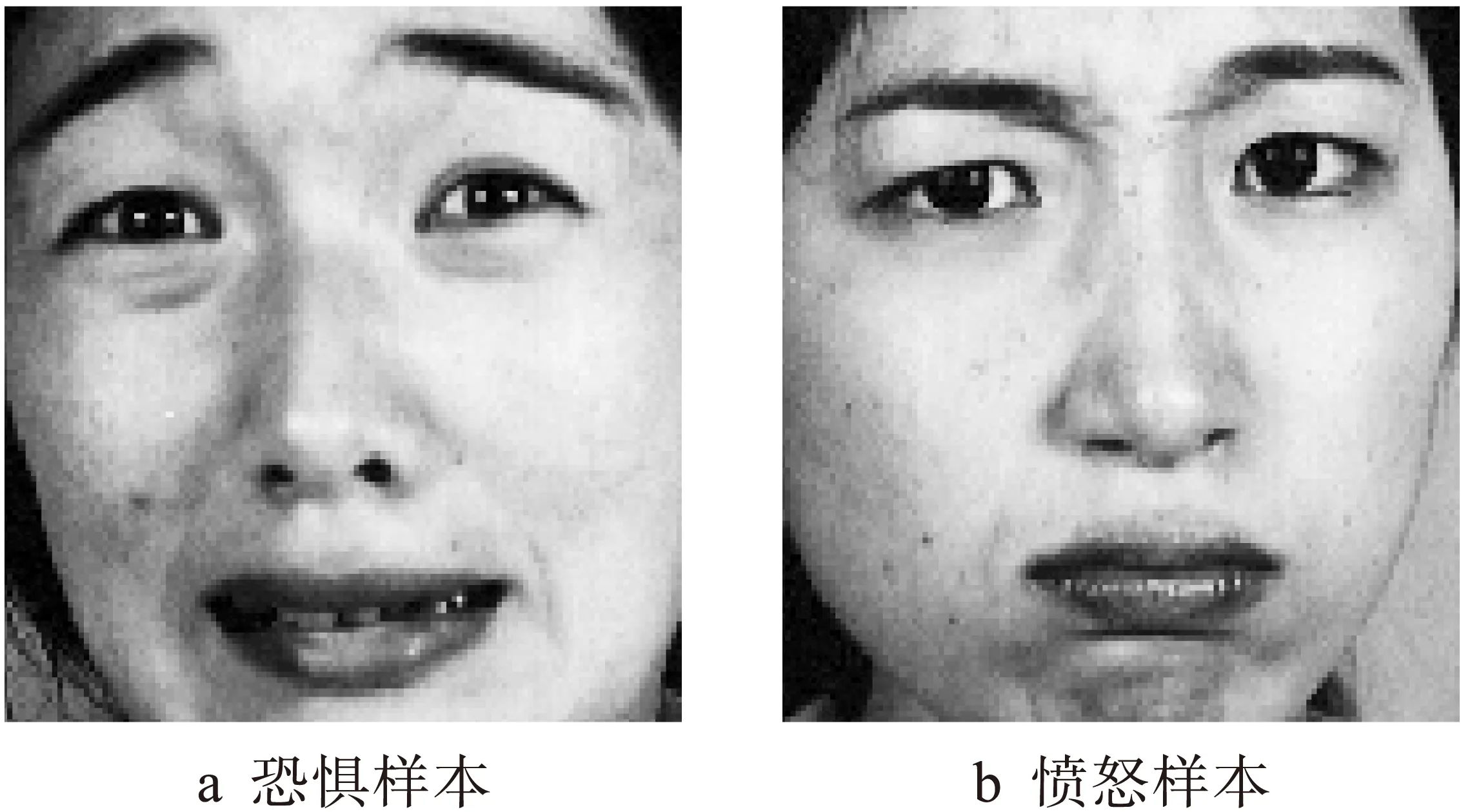

图5a是被Gabor KPCA算法误识为高兴的恐惧样本,图5b是被Gabor KPCA算法误识为厌恶的愤怒样本.尽管这两个样本分别与高兴、厌恶表情的一般特征比较近似,但眉部和抬头纹特征与快乐相差明显,而本文通过对眉部和抬头纹特征检测计算相应子块权重突出了这些特征,正确地将图5a样本划分为恐惧.类似地,对抬头纹和眼部特征的突出使图5b样本被正确地划分为愤怒.

图5 Gabor KPCA误识的表情样本

实验发现,在训练样本中没有明显的法令纹特征时,会影响快乐与恐惧表情的正确识别;缺少嘴角上翘样本特征则影响伤心表情的正确识别;缺少眉部翘起的样本特征会对伤心与恐惧表情识别产生影响;缺少双眉紧锁、抬头纹褶皱和撇嘴样本会影响愤怒和厌恶表情的识别.本文采取的自动预选训练样本很好地解决了此类问题.

5 结 论

针对Gabor特征表征全局特征能力弱、特征维数高等问题,提出了一种基于Gabor局部方向特征融合与分块直方图相结合的表情识别方法.该方法尝试通过对不同表情的重点特征部位和方向进行筛选,仅在对应部位、方向上提取多尺度Gabor特征,并对同一尺度不同方向的Gabor特征进行融合,不仅大幅度降低了特征维数,也提高了特征选取的准确性.同时,将融合后的Gabor特征与LBP分块直方图相结合,突出了Gabor变换在分析局部纹理变化方面的能力和LBP的全局特征表征优势.此外,本文提出的通过自动预选训练样本方法能够有效克服在较少训练样本情况下的特征提取缺失问题,从而使本文算法达到了较高的人脸表情识别率.

[1]Chen J J,Zhao Z.Facial expression recognition based on PCA reconstruction [C]//The 5th International Conference of CS and Education.Hefei,China,2010:195-200.

[2]周书仁,梁昔明.基于ICA与HMM的表情识别 [J].中国图像图形学报,2008,13(12):2321-2328.

(ZHOU Shu-ren,LIANG Xi-ming.Facial expression recognition based on independent component analysis and hidden Markov model [J].Journal of Image and Graphics,2008,13(12):2321-2328.)

[3]陈好刚,王运琼,冯乔生.一种基于2DPCA和LDA的人脸表情识别算法 [J].微计算机信息,2010,26(9):198-201.

(CHEN Hao-gang,WANG Yun-qiong,FENG Qiao-sheng.Facial expression recognition based on 2DPCA and LDA [J].Microcomputer Information,2010,26(9):198-201.)

[4]Shan C F,Gong S G,Peter W M.Facial expression recognition based on local binary patterns:a compressive study [J].Image Vision Computing,2009,27(8):803-816.

[5]Donato G,Bartlett M S,Hager J C.Classifying facial actions [J].IEEE Transactions on Pattern Analysis and Machine Intelligence,1999,21(10):947-989.

[6]Zhang Z Y,Lyons M,Schuster M,et al.Comparison between geometry-based and Gabor-wavelets-based facial expression recognition using multi-layer perceptron [C]//Proceedings of the 3rd IEEE International Conference on Automatic Face and Gesture Recognition.Nara,Japan,1998:454-459.

[7]Wen Z,Huang T S.Capturing subtle facial motions in 3D face tracking [C]//Proceedings of the 9th IEEE International Conference on Computer Vision.Nice,France,2003:1343-1350.

[8]Liao S,Fan W,Chung A C,et al.Facial expression recognition using advanced local binary patterns,Tsallis entropies and global appearance features [C]//Proceedings of the 6th IEEE International Conference on Image Processing.Atlanta,USA,2006:665-668.

[9]邓洪波,金连文.一种基于局部Gabor滤波器组及PCA+LDA的人脸表情识别方法 [J].中国图像图形学报,2007,12(2):322-329.

(DENG Hong-bo,JIN Lian-wen.Facial expression recognition based on local Gabor filter bank and PCA+LDA [J].Journal of Image and Graphics,2007,12(2):322-329.)

[10]范媛媛,桑英军,胡光.基于小波变换的电能质量监测 [J].沈阳工业大学学报,2014,36(6):681-687.

(FAN Yuan-yuan,SANG Ying-jun,HU Guang.Po-wer quality monitoring base on wavelet transform [J].Journal of Shenyang University of Technology,2014,36(6):681-687.)

[11]宋伟,赵清杰,宋红,等.基于关键块空间分布与Gabor滤波的人脸表情识别算法 [J].中南大学学报(自然科学版),2013,44(2):239-243.

(SONG Wei,ZHAO Qing-jie,SONG Hong,et al.Facial expression recognition algorithm based on key block space distribution and based on Gabor filter [J].Journal of Central South University(Science and Technology),2013,44(2):239-243.)

[12]刘帅帅,田彦涛,万川.基于Gabor多方向特征融合与分块直方图的人脸表情识别方法 [J].自动化学报,2011,37(12):1455-1460.

(LIU Shuai-shuai,TIAN Yan-tao,WAN Chuan.Facial expression recognition method based on Gabor multi-orientation features fusion and block histogram [J].Acta Automatic Sinica,2011,37(12):1455-1460.)

(责任编辑:钟媛英文审校:尹淑英)

Extraction method for facial expression features based on Gabor feature fusion and LBP histogram

NIU Lian-qianga,b, ZHAO Zi-tianb, ZHANG Sheng-nanb

(a. School of Software, b. School of Information Science and Engineering, Shenyang University of Technology, Shenyang 110870, China)

In order to solve the problem that the Gabor features exhiblt weak global expression ability and redundant feature data dimensionalities, a method in combination with both Gabor multi-direction feature fusion and block histogram was proposed to effectively extract the facial expression features. Through refining the important featute parts in different expressions, the multi-scale and multi-direction features in relevant areas were purposefully extracted with Gabor filters, and the features with the same scale were fused. In addition, the images were characterized with the histogram distribution for the fused features in various areas. The proposed method can improve the accuracy of feature extraction, effectively highlight the identification effect of important features, and greatly reduce the feature dimensionalities. Furthermore, the proposed method can reach 100% recognition rate in the JAFFE expression dataset.

expression recognition; Gabor transform; feature fusion; local binary pattern (LBP); block histogram; multi-scale; multi-direction; dimensionality

2014-12-05.

沈阳市科技计划项目(F12-168-9-00).

牛连强(1965-),男,辽宁盖县人,教授,主要从事CAD&CG、图像处理、可视化及仿真技术等方面的研究.

信息科学与工程

10.7688/j.issn.1000-1646.2016.01.11

TP 391.41

A

1000-1646(2016)01-0063-06

*本文已于2015-09-15 09∶09在中国知网优先数字出版. 网络出版地址: http:∥www.cnki.net/kcms/detail/21.1189.T.20150915.0909.036.html