基于改进YOLOv8的百合地杂草分类识别

2025-02-15段淳耀赵霞程鸿

摘 要:为了提高农业自动化杂草检测的效率和准确性,提出了一种基于改进YOLOv8(YouOnlyLookOnceversion8)的百合地杂草分类识别方法。针对百合地杂草形态多样、颜色特征复杂且区分度低的难题,引入了TransNext聚合注意力模块和DCNv2(DeformableConvNetV2)注意力机制,优化了YOLOv8-n模型的特征提取和目标识别性能。通过实施数据增强策略,显著地提升了模型的泛化能力和识别准确性。实验结果表明,改进后的模型在自建数据集上的准确率达到90.1%,相比于原始YOLOv8模型的准确率提高了6百分点,充分展现了其在复杂非结构化背景下进行杂草分类的潜力和应用价值。

关键词:YOLOv8;杂草识别;深度学习;目标分类

中图分类号:TP391 文献标志码:A

0 引言(Introduction)

本研究主要关注兰州百合[1]种植地的杂草种类研究。随着百合种植面积的不断扩大,杂草问题[2]日益突出。近年来,随着科技的飞速发展,基于深度学习的目标识别技术被广泛应用于农业领域,特别是在自动化杂草识别[3]方面展现出巨大的潜力。这些系统能够通过图像识别技术精确地识别出杂草,从而显著地提高了除草的效率和准确性。目前,众多学者致力于改进深度学习算法模型,并尝试将其应用于杂草分类与识别研究中。例如,何全令等[4]提出了一种GBC-YOLOv5s(GhostBottleneckConvolution-YouOnlyLookOnceversion5small)实时目标检测算法,在单独类别测试任务中的平均精度达到了96.3%。李兆旭等[5]提出一种基于MobileNet-SSD的杂草识别模型,该模型的精度比原模型的精度提高了3.23百分点。

尽管已有的针对杂草分类的研究已经取得了一些进展,但是仍存在一些问题,因此本研究采用改进的YOLOv8算法对百合地的杂草进行分类研究。改进的YOLOv8算法的优势在于它采用了先进的训练方法和技巧,使得模型的训练时间更短、收敛速度更快,并且具备更强的泛化能力;此外,改进的YOLOv8算法支持自定义构建的数据集训练,适合特定场景的目标分类。

1 材料与方法(Materialsandmethods)

1.1 数据集

1.1.1 数据来源

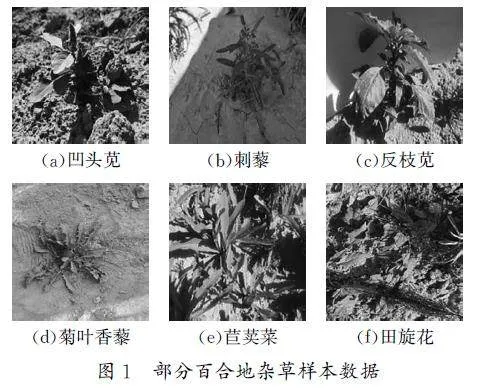

在本研究中,构建一个高质量且具有代表性的数据集是提高百合地杂草识别模型性能的关键。为此,研究人员特地在甘肃省农业科学院植物保护研究所七里河西果园村试验基地开展了广泛的杂草图像采集工作。来源于该基地的观测和统计数据显示,对百合生长的早期、中期和后期构成严重威胁的田间杂草主要归属于苋科、菊科和旋花科。实验采集的杂草图像如图1所示,属于苋科的杂草主要如图1(a)中的凹头苋、图1(b)中的刺藜、图1(c)中的反枝苋、图1(d)中的菊叶香藜;属于菊科的杂草主要如图1(e)中的苣荬菜;属于旋花科的杂草主要如图1(f)中的田旋花。

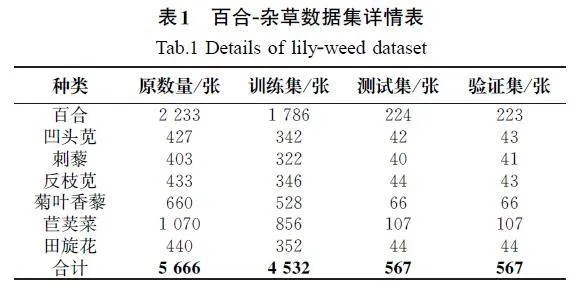

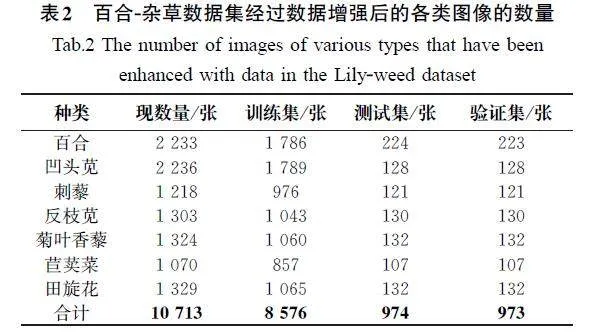

实验采集的杂草图像涵盖了杂草的不同生长阶段和多种生长环境,经过精心筛选,得到了总计5666张图像,其中包括2233张百合图像、427张凹头苋图像等。每张图像都经过了严格的质量控制,确保图像清晰、杂草特征明显,并且无过多的背景干扰,为后续的模型训练和评估提供了坚实且可靠的基础。百合-杂草数据集详情表如表1所示。

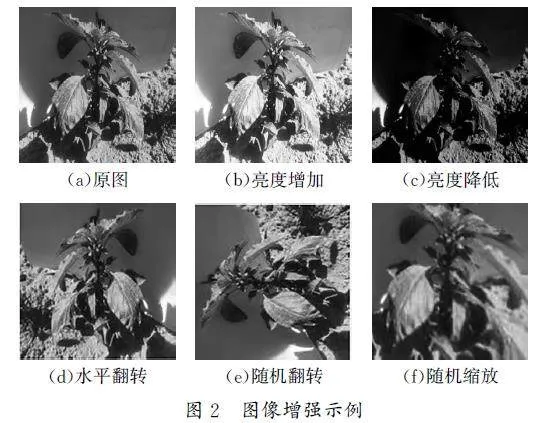

1.1.2 数据增强策略

针对百合地杂草识别任务,研究人员采用了多种数据增强策略,旨在提升改进YOLOv8模型对杂草的识别准确性。部分杂草图像增强后数据如图2所示,其中图2(a)为原图。首先,通过调整图像的亮度和对比度,模拟不同光照条件下的杂草图像,从而增强了模型对光照变化的适应性,图2(b)为亮度增加后的图像,图2(c)为亮度降低后的图像。其次,通过对图像进行水平翻转,提高了模型对物体左右位置对称性的识别能力,图2(d)为水平翻转后的图像。此外,还采用随机旋转和缩放操作模拟了自然环境中杂草因风力等因素而呈现出的不同朝向,增强了模型对尺度变化的鲁棒性。图2(e)为随机翻转,图2(f)为随机缩放。在实施数据增强操作时,应注重保持增强后图像的真实性和一致性,避免引入不真实的视觉效果。图像增强示例如图2所示。

通过实施上述数据增强策略,成功地扩充了训练集的规模,并提高了模型对不同条件下杂草的识别能力,为后续的模型优化奠定了坚实的基础。百合-杂草数据集经过数据增强后的各类图像的数量如表2所示。

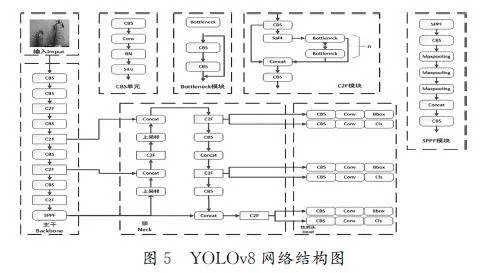

1.2 Yolov8网络

YOLOv8是目标检测领域的一项先进技术[6],是YOLO系列的最新成果,在多个方面进行了优化和改进。其中,YOLOv8包含多个版本,如YOLOv8n(YouOnlyLookOnceversion8nano)、YOLOv8s(YouOnlyLookOnceversion8small)等,本研究选用的是YOLOv8n模型,该模型具有较快的检测速度,并且提供了最小的深度和特征图宽度,适合资源受限或要求高效的场景。

YOLOv8的核心特点包括Mosaic图像增强、自适应锚框计算及自适应图片缩放。Mosaic方法通过随机拼接4张图像,提高了模型对多样化场景的适应能力。自适应锚框计算和图片缩放则确保了模型对不同尺寸目标的有效检测。此外,YOLOv8在训练后期关闭了图像混叠增强技术,以优化训练效果。

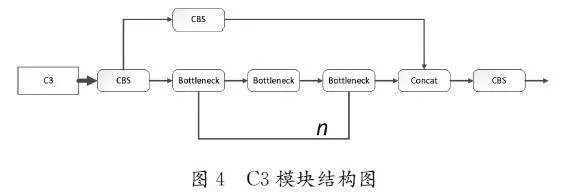

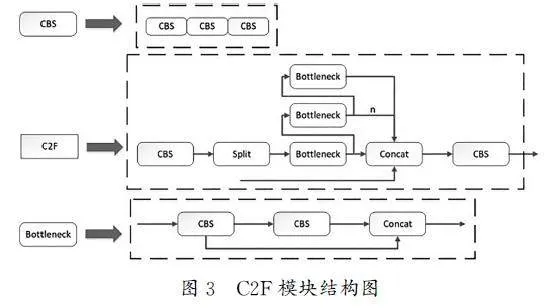

YOLOv8的结构分为输入层、Backbone网络、Neck网络和Head网络4个主要部分。Backbone[7]网络由CBS(ContextBasedSpatialAttention)、C2F(ConvolutionaltoFeature)和SPPF(SpatialPyramidPoolingFast)模块组成,负责从输入图像中提取特征。C2F模块是YOLOv8中的一项创新设计,其结构图如图3所示,它基于YOLOv7(YouOnlyLookOnceversion7)的ELAN(EfficientLongRangeAttentionNetwork)和YOLOv5(YouOnlyLookOnceversion5)的C3(3convolutions)模块设计,其中C3模块结构图如图4所示。通过增加分支,C2F模块提高了特征提取的效率。此外,YOLOv8 还沿用了YOLOv5中的SPPF 模块,以进一步优化特征提取过程。SPPF模块在YOLOv8中保持了其在YOLOv5中的功能和结构。Bottleneck作为一种特殊的残差结构,也在YOLOv8中发挥了重要作用。

Neck网络采用FPN(FeaturePyramidNetwork)和PAN(PathAggregationNetwork)结构,它们负责融合不同层级的特征信息。FPN 增强了模型的感知能力和尺度不变性,而PAN则提升了多尺度特征的融合效果。这些结构的结合使得YOLOv8在理解图像上下文信息方面的表现更为出色。

Head网络负责最终的目标检测任务,包括分类和边界框回归。YOLOv8采用了解耦头结构,将分类和检测头分离,提高了检测的准确性,同时它引入了Anchor-Free机制,使得模型能够更准确地预测目标的位置和大小。YOLOv8网络结构图如图5所示。

本研究选取了YOLOv8系列中的YOLOv8n模型作为基础框架,并对其进行了针对性的优化,优化后的模型因为具有较小的网络深度和特征图尺寸,所以展现出了检测快速和稳定的特点,非常适合应用于百合地杂草识别任务。

2 改进的YOLOv8 算法(ImprovedYOLOv8algorithm)

为了提升百合田间杂草辨识的准确性与处理速度,并减少遗漏的检出情况,本研究对YOLOv8n模型实施了以下两项优化措施。

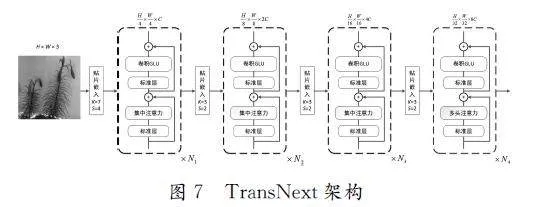

2.1TransNext聚合注意力

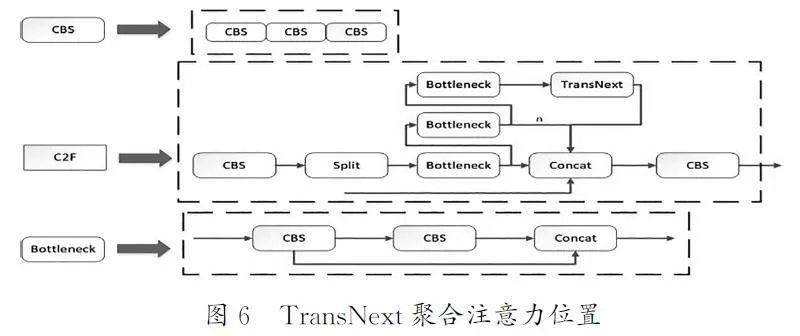

本研究在针对YOLOv8n模型中引入了TransNext聚合注意力模块[8],旨在进一步提升百合地杂草识别的精度和效率。将此注意力融合至C2F模块,通过增强特征提取的针对性和有效性,从而优化了模型的整体性能。TransNext聚合注意力位置如图6所示。

TransNext的设计灵感来源于生物视觉系统,它采用了双路径设计,结合了滑动窗口注意力和集中注意力,以模拟人眼对细节的聚焦和对全局场景的理解。TransNext通过像素集中注意力PFA(Pixel-FocussedAttention)对输入特征图的单个像素进行操作,使用自适应平均池化和单层神经网络提高信息压缩率。同时,引入激活池机制能保证信息压缩过程中的方差一致性,减少信息丢失。TransNext 还融入了可学习的键值LKV(Learnable-Key-Value)注意机制,这一机制与传统QKV(Query-Key-ValueAttentionMechanism)机制不同,它通过学习定义的查询来执行交叉注意,有效地提升了信息聚合效果,并降低了计算开销。此外,TransNext采用的长度尺度余弦注意机制,增强了模型对多尺度图像输入的处理能力。同时,TransNext还设计了卷积GLU(GatedLinearUnit)作为通道混频器,不仅能捕捉位置信息,而且还提供门控信号,解决了传统SE(Squeeze-and-Excitation)机制问题,满足ViT(VisionTransformer)模型对位置信息的需求。这些改进显著提升了模型在复杂视觉任务中的识别准确性。TransNext架构如图7所示。

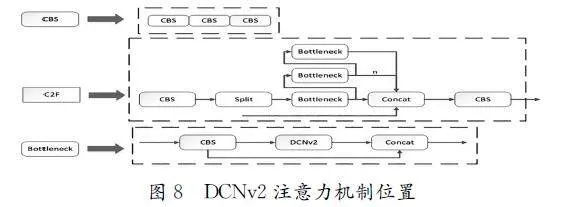

2.2 DCNv2注意力机制

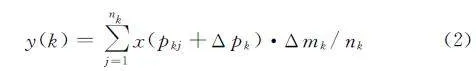

本研究中引入了DCNv2注意力机制来增强模型对空间特征的敏感度,特别是在百合地杂草识别任务中。DCNv2通过调制可变形卷积网络[9],允许模型调整输入特征的偏移量和特征幅度,从而优化了特征提取的过程[10]。将此注意机制与Bottleneck中的CBS进行替换,DCNv2注意力机制位置如图8所示。

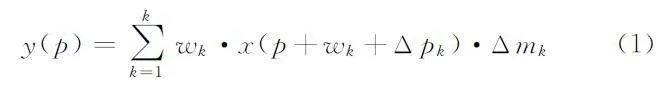

DCNv2注意力机制的核心在于其可学习的偏移量和调制标量,它们均通过一个单独的卷积层获得,为了确保初始时具有均匀的感受野,该卷积层的核权值被初始化为0。给定k 个采样位置的卷积核[11],令wk 表示权重,pk 表示预先指定的偏移量,它们分别处于第k 个位置。设x(p)和y(p)分别表示输入特征映射x 和输出特征映射y 中位置p 处的特征,调制的可变形卷积则可以表示为

其中,Δpk 和Δmk 分别是第k 个位置的可学习偏移量和调制标量[12]。调制标量由sigmoid层归一化,控制特定空间位置的特征对输出的影响,增强模型对不同区域特征的适应性。此外,DCNv2还包括调制可变形RoIpooling,给定一个输入RoI,RoIpooling将其划分为k 个空间箱(例如7×7)。在每个bin中,应用偶数空间间隔的采样网格(例如2×2)。对网格上的采样值取平均值以计算bin输出。设Δpk 和Δmk 为第k 个bin的可学习偏移量和调制标量,输出的分箱特征y(k)计算公式为

其中:pkj 为第k 个bin中第j个网络单元的采样位置;nk 为采样的网格单元个数,它在每个空间箱内应用采样网格,并对网格上的采样值取平均,以进一步提升模型对目标形状的适应性。

3 实验与分析(Experimentandanalysis)

3.1 实验环境与参数配置

本实验模型训练使用Windows系统、图形处理器(GPU)为NVIDIAGeForceGTX1050Ti、中央处理器(CPU)为英特尔Corei5-8300HCPU @2.30GHz、运行内存为40GB、内存为80GB、操作系统为Ubuntu20.01、深度学习框架为PyTorch1.11.0、Epoch学习率设置为100、BatchSize设置为16。损失函数在模型训练的超参数上,初始学习率设置为0.001且采用动态学习率策略。每30个Epoch缩小10倍,有利于模型更快地收敛,避免局部最优解的误导。利用交叉墒损失函数计算模型的损失值,使用SCD优化器迭代训练参数。

3.2 评价指标

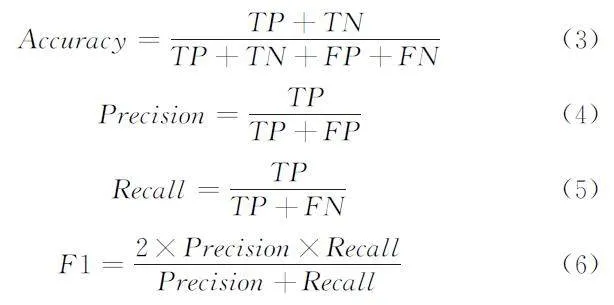

为了能够量化模型的识别性能,本实验采用准确率(Accuracy)、精确度(Precision)、召回率(Recall)和F1分数作为评价指标,用于定量比较模型的识别性能;具体计算公式如公式(3)至公式(6)所示:

其中:TP 代表真阳性,FP 代表假阳性,TN 代表真阴性,FN代表假阴性。

3.3 实验过程结果与分析

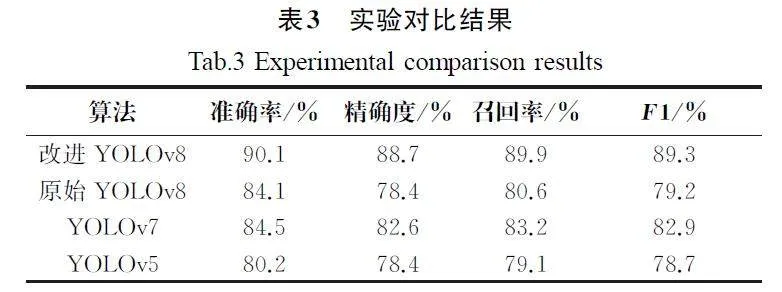

3.3.1 不同算法对比实验分析

为了全面评估改进后的YOLOv8算法模型在百合地杂草识别任务中的性能表现,本研究设计了一系列对比实验。这些实验旨在比较改进的YOLOv8 模型与原始YOLOv8、YOLOv7以及YOLOv5模型在相同数据集上的表现差异。通过这种方法,我们可以直观地观察到改进模型在准确率、精确度、召回率和F1分数等关键性能指标上的优势。在实验设计中,确保所有模型在相同的数据集上进行训练和测试,以保证结果的公平性和可比性。此外,所有模型都在相同的硬件和软件环境下运行,以排除外部因素对实验结果的影响。本研究采用了交叉验证的方法,确保每个模型都有充分且均等的机会在训练集和测试集上展示其性能。实验对比结果如表3所示。

根据表3的实验结果,改进后的YOLOv8模型在所有评价指标上均显著优于原始的YOLOv8、YOLOv7和YOLOv5模型的对应指标。具体来说,改进YOLOv8模型的准确率达到了90.1%,比原始YOLOv8模型的准确率提高了6百分点。在精确度方面,改进模型达到了88.7%,比原始模型的精确度提高了10.3百分点。在召回率上,改进模型同样表现出色,达到了89.9%,比原始模型的召回率提高了9.3百分点。在综合考虑精确度和召回率的F1分数指标上,改进模型达到了89.3%,比原始模型的F1提高了10.1百分点。这些数据表明,改进模型的特征提取能力和对小目标的识别精度有了显著的提升。此外,改进模型在保持高识别精度的同时,还实现了存储空间的更少占用,使得其在实际应用中更具可行性和高效性。

3.3.2 消融实验

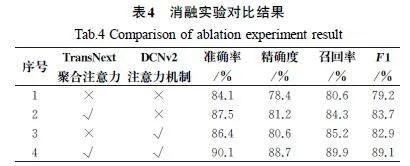

为了深入理解改进的YOLOv8模型中各个组件的贡献,本研究进行了一系列的消融实验。这些实验通过逐步移除模型中的某些关键部分,细致观察这些变动对模型性能所产生的影响。通过这种方法能够揭示TransNext聚合注意力模块和DCNv2注意力机制等组件对模型识别能力的具体贡献。

在消融实验中,本研究先训练了一个包含所有优化和增强组件的改进YOLOv8模型。随后,逐一移除了TransNext聚合注意力模块和DCNv2注意力机制模块,并记录每次模块被移除后模型的性能变化。这样的实验设计,使得我们能够独立地评估每个模块对模型整体性能的贡献。为确保对比结果的合理性,所有模型均使用相同的数据集,并在相同的参数环境下进行训练,消融实验对比结果如表4所示。

分析表4中的实验结果可知,当本研究从改进的YOLOv8模型中移除TransNext聚合注意力模块时,模型的识别准确率和F1分数分别下降了3.4百分点和4.5百分点。进一步移除DCNv2注意力机制模块后,模型的识别准确率和F1分数再次下降,分别降低了2.3百分点和3.7百分点。添加TransNext聚合注意力模块和DCNv2注意力机制模块的YOLOv8-n,其识别精确率是90.1%,F1分数是89.1%,与原YOLOv8相比,分别提高6百分点和9.9百分点。这表明,TransNext聚合注意力模块对于提升模型在复杂背景中识别杂草的能力起到了重要的作用,而DCNv2注意力机制则在优化特征提取过程及增强模型对多尺度目标识别能力方面发挥了重要作用。

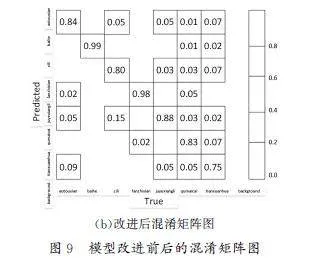

3.3.3 混淆矩阵分析

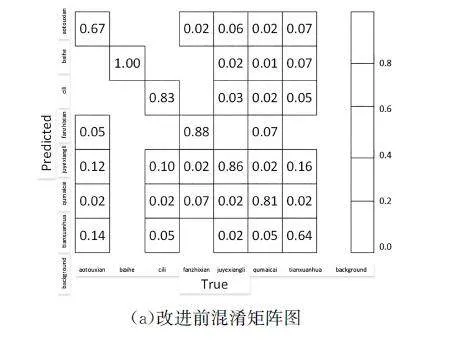

模型改进前后的混淆矩阵图如图9所示。其中,图9(a)为模型改进前混淆矩阵图,图中显示某些类别间存在较为严重的误分类现象,这可能是由于这些类别视觉相似度高或模型在相应类别的特征学习上存在欠缺。图9(b)为模型改进后混淆矩阵图,可以看出混淆情况有了显著改善,特别是在那些原本难以区分的类别上,模型的识别准确率实现了显著提升,这表明改进后的模型在特征提取和分类决策方面表现得更为精准。

具体来说,改进模型在主要类别上的预测准确率得到了提高,这反映在混淆矩阵对角线上值的增加。同时,非对角线区域的值减小,意味着误分类的情况得到了有效控制。这些变化不仅证明了改进模型的有效性,而且提供了进一步优化模型的方向,即通过增强模型对类别间细微差别的识别能力来减少误分类。混淆矩阵分析还揭示了模型在某些特定类别上的性能瓶颈。对于那些频繁发生误分类的类别对,本研究可以有针对性地采取数据增强或模型调整措施,以进一步提升模型的泛化能力和鲁棒性,这与实验预期相符。

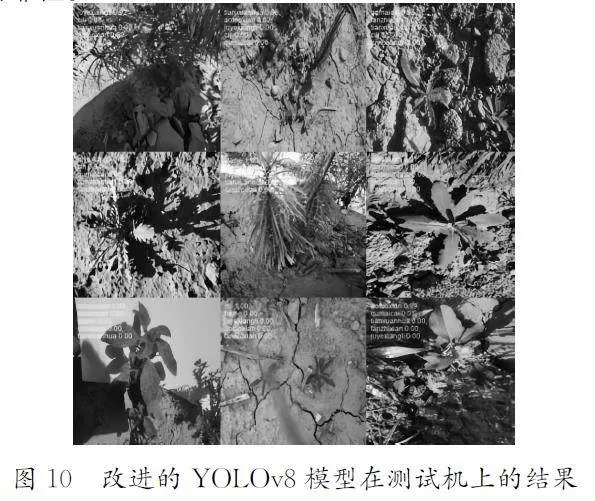

3.3.4 改进的YOLOv8模型检测结果

本研究对改进的YOLOv8模型进行了全面的测试,以评估其在实际应用场景中的性能表现。改进的YOLOv8模型在测试机上的结果如图10所示,测试结果表明,该模型在百合地杂草识别任务中表现出色,特别是在处理具有复杂特征和类间差异较小的杂草图像时,展现了出色的识别能力。通过对比测试图像及其预测结果可以看到,改进的YOLOv8模型不仅能够准确地识别出百合植株和各类杂草,而且能够在多变的自然环境中稳定地进行分类。这一优势在模型检测结果的可视化展示中得到了直观的呈现,即便在杂草与百合植株交织错落的复杂背景下,模型也能准确地将目标杂草定位并识别出来,特别是在面对难以区分的杂草种类时,改进的YOLOv8模型显示出了更高的识别准确率,充分证明了其在实际应用中的优越性和可靠性。

4 结论(Conclusion)

本研究针对百合地杂草形态多样、颜色特征复杂、区分度低的问题,提出了一种基于改进YOLOv8的杂草分类识别方法。通过构建高质量且具有代表性的百合地杂草图像数据集,使用数据增强策略,以及引入TransNext聚合注意力模块和DCNv2注意力机制,显著地提升了模型的特征提取能力和对小目标的识别精度。实验结果表明,改进的YOLOv8模型在自建数据集上的准确率达到90.1%,比原始YOLOv8模型的准确率提高了6百分点,展现了其在复杂非结构化背景下执行杂草分类任务的潜力和广阔的应用价值。

参考文献(References)

[1]陈应娥,梁巧兰,魏列新,等.两种铜制剂与化学农药混配对兰州百合贮存期鳞茎腐烂病防治作用[J].西北农业学报,2024,33(2):292-302.

[2]牛树君,赵峰,王玉灵,等.几种除草剂对兰州百合田杂草的防除效果及其安全性评价[J].植物保护,2021,47(6):296-301,317.

[3]王建翠,惠巧娟,吴立国.基于多尺度注意力和深度可分离卷积的农田杂草检测[J].中国农机化学报,2023,44(5):182-187.

[4]何全令,杨静文,梁晋欣,等.面向嵌入式除草机器人的玉米田间杂草识别方法[J].计算机工程与应用,2024,60 (2):304-313.

[5]李兆旭,蒋红海,杨肖,等.基于轻量化深度学习模型的豆角苗-杂草检测方法[J].农业装备与车辆工程,2022,60 (9):98-102,107.

[6]PAYGHODEV,GOYALA,BHANA,etal.Objectdetectionandactivityrecognitioninvideosurveillanceusingneuralnetworks[J].Internationaljournalofwebinformationsystems,2023,19(3/4):123-138.

[7]何颖,陈丁号,彭琳.基于改进YOLOv5模型的经济林木虫害目标检测算法研究[J].中国农机化学报,2022,43 (4):106-115.

[8]代季峰.通用目标检测技术新进展:可变形卷积网络再升级[J].人工智能,2019,6(2):28-39.

[9]高昂,梁兴柱,夏晨星,等.一种改进YOLOv8的密集行人检测算法[J].图学学报,2023,44(5):890-898.

[10]SURESH H R,SHANMUGANATHAN M,SENTHILKUMART,etal.Deeplearning-basedimageforgerydetectionsystem[J].Internationaljournalofelectronicsecurityanddigitalforensics,2024,16(2):160-172.

[11]HUYNHN,NGUYENDK.Real-timedropletdetectionforagriculturalsprayingsystems,adeeplearningapproach[J].Machinelearningandknowledgeextraction,2024,6(1):259-282.

[12]陈亚芳,廖飞,黄新宇,等.多尺度YOLOv5的太阳能电池缺陷检测[J].光学精密工程,2023,31(12):1804-1815.

作者简介:

段淳耀(2000-),男(汉族),酒泉,硕士生。研究领域:智慧农业,数据挖掘。

赵 霞(1979-),女(汉族),常州,副教授,硕士。研究领域:智慧农业,数据挖掘。

程 鸿(1972-),男(汉族),白银,研究员,博士。研究领域:智慧农业,瓜菜选育。

基金项目:自然科学基金-甘肃省科技计划资助(24JRRA656);2022年横向课题:农产品物资销售模式的数据统计分析(loonG20220201)