基于网络重构的改进GhostNet一维信号辨识研究

2025-02-15余航陈烨烨李捍东

摘 要:触觉传感器采集的一维触觉数据能够用于识别并区分物体的特征,进而实现对物体类别的分类。文章以轻量级卷积神经网络GhostNet为基础框架,提出了一种改进的复合损失函数,以提升模型的分类性能。为进一步适应一维触觉数据的特性,研究对GhostNet模型进行了结构上的改进,使其能够高效处理一维数据。同时,研究将改进后的GhostNet与GRU(GatedRecurrentUnit)网络相结合,构建了GhostNet-GRU (GhostNetwork-GatedRecurrentUnit)网络结构。实验结果表明,采用复合损失函数后,网络精度提高了1.85%,并且与残差网络ResNet相比,网络精度提高了3.42%,证明了所提出改进网络结构的有效性和实用价值。

关键词:一维触觉数据;损失函数;GhostNet;GRU;网络融合

中图分类号:TP391 文献标志码:A

0 引言(Introduction)

触觉识别[1]作为人机交互的重要组成部分,近年来在智能系统领域受到了广泛关注。尽管深度学习技术在图像和语音识别领域已取得显著进展,但是触觉感知仍面临着诸多挑战,这些挑战主要源于触觉数据的高维性和时间序列的复杂性。本文针对一维的时间序列触觉数据进行算法改进,旨在为触觉识别技术的进步注入新的活力并产生积极影响。

我国在触觉识别技术方面的研究和应用正在稳步推进,其中基于嵌入式AI的主动激励式触觉信号辨识技术[2]的表现尤为突出。该技术将轻量级神经网络部署到嵌入式系统中,在运算资源有限的情况下,实现对4种物体共9种状态的分类辨识。

本研究采用GhostNet[3]作为核心的轻量级卷积神经网络,对复合损失函数进行了改进,并通过融合门控循环单元(GRU)以优化时间序列数据处理。该方法不仅精简了网络参数,而且在物体分类识别任务中提高了准确率,为触觉识别技术的迭代升级开辟了新途径。

1 理论介绍(Theoryintroduction)

1.1 GhostNet网络模型

GhostNet是一种轻量级卷积神经网络,其核心思想是使用Ghost模块生成更多的特征图,但不会增加额外的计算成本;通过应用一系列线性变换(比如普通的卷积操作),并对这些变换进行一些微小的修改来“生成”更多的特征图。这种设计旨在提供与标准卷积神经网络相似的表现,同时减少计算的复杂度和模型规模。本文以GhostNet网络模型为核心,将其应用于一维触觉数据的特征提取,并探索其在物体分类任务中的应用潜力。

1.2 GhostNet网络结构

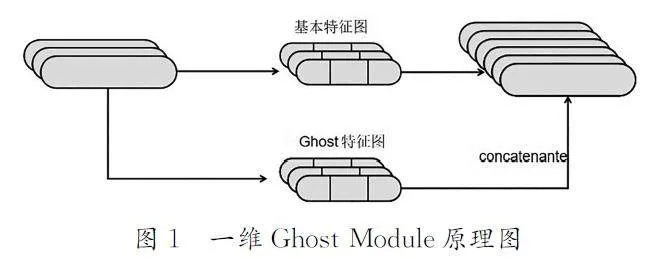

Ghost模块的核心思想是分成两步生成所需要的特征图,第一步是使用较少的卷积核进行标准卷积操作,生成一组基本的特征图。这一步的操作可以确保捕获输入数据的基本特征,其公式表示如下:

G =X*W +b (1)

其中:G 是生成的基本特征图,X 是输入数据,W 是卷积核的权重,b 是卷积操作的偏置项,* 表示卷积操作。

第二步是利用Ghost模块执行一系列计算成本较低的操作,如线性变换、平均池化、深度卷积等,从而生成额外的特征图。这些额外增加的特征图并不会带来计算量的增加,因此被称为Ghost特征图,其公式表示如下:

Oi =O(Gi;θi ) , i=1,…,m-g (2)

其中:Oi 是通过廉价操作生成的第i 个额外特征图;Gi 是第i个基本特征图;O 是廉价操作,如使用深度卷积、线性变换、平均池化等;θi 是廉价操作的参数;m -g 表示需要额外生成的特征图的数量。

将G 个基本特征图和m -g 个通过廉价操作生成的特征图合并起来,则形成最终的特征图输出,其公式表示如下:

F=[G1,…,Gg ,O1,…,Om-g] (3)

1.3 GRU网络结构

GRU是一种被广泛使用的循环神经网络[4](RNN)架构,通常被用来处理时间序列数据。GRU 结构通过引入更新门(UpdateGate)和重置门(ResetGate)来调节信息流,能够解决循环神经网络梯度消失的问题,从而增强模型在处理长序列数据时的能力。其中,更新门可以决定有多少过去的信息需要被保留到当前时刻,并通过一个sigmoid激活函数确保输出值为0~1,其公式表示如下:

zt=σ(Wz·[ht-1,xt]+bz ) (4)

其中:zt 是时间步t的更新门的向量,σ 是sigmoid激活函数,Wz 是更新门的权重矩阵,ht-1 是前一时间步的隐藏状态,xt是当前时间步的输入,bz 是更新门的偏置向量。

重置门控制允许多少过去的信息被遗忘,以便更专注于当前更重要的信息,其公式表示如下:

rt=σ(Wr· [ht-1,xt ]+br ) (5)

GRU通过这些门控机制有效地平衡了新输入信息与过去信息的更新,极大地提高了模型的信息利用效率,从而显著提升了模型处理时间序列数据的能力。

1.4Softmaxloss

Softmaxloss也称为交叉熵损失或对数损失,是用于分类问题的常见损失函数,在神经网络中扮演着重要的角色[5]。然而,其基于每个样本仅归属一个类别的假设,在某些情况下可能区分不出来,特别是当类别中由于类间相似性而出现局部重叠时,Softmaxloss无法很好地处理多标签的分类任务问题,很难区分不同类别之间的深度特征图。

1.5Centerloss

Centerloss被称为中心损失函数,旨在提高特征表示的判别性,与Softmaxloss不同的是,它缩短了类样本之间的距离,能更好地区分样本的特征。这使得同一类别的样本在特征空间更加密集。然而,即便采用了Centerloss,也可能会出现样本在特征之间局部重合的问题。

1.6 复合损失函数

在使用触觉传感器采集数据时,环境的变化和受传感器噪声的影响,会导致数据本身存在一定的差异。为了提升模型对触觉行为的识别能力,可以通过增强类内的紧凑性来聚集相似的触觉行为。同时,不同的触觉行为和物体表面特征存在细微但关键的区别,通过拉大这些类别间的距离,可以使分类边界更加明确,进而提高模型的分类辨识能力。因此,本研究在模型中引入了复合损失函数,以实现对触觉数据更准确的分类和识别。

1.6.1 前向传播改进

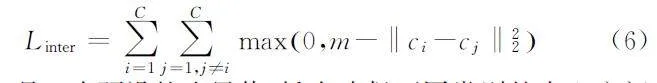

在一个一维触觉数据集 {(xi,yi ) }Ni=1 中,xi 是特征向量,yi 是对应的类别标签,共有C 个类别。对于每个类别j,定义一个类中心cj,中心损失函数(CenterLoss)针对每个样本xi 最小化它与它的类中心cj之间的距离。通过增加一个类间距离项Linter ,增大不同类别的中心距离,其公式表示如下:

其中:m 是一个预设的边界值,旨在确保不同类别的中心之间的距离至少为m。复合损失函数可以描述为

L =Lsoftmax +λ1Lcenter+λ2Linter (7)

其中:Lsoftmax 是传统的SoftmaxLoss,Lcenter是相应的中心损失函数,λ1 和λ2 是用于平衡不同损失项贡献的权重系数。

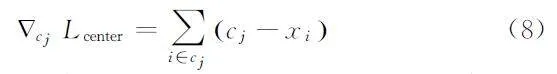

1.6.2 反向传播改进

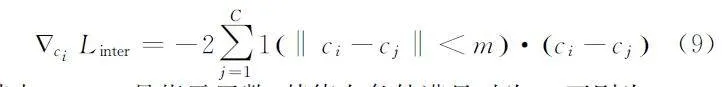

在使用SDG(随机梯度下降)时,类中心的更新是对每个类别中心梯度的计算,对于包含了类间距离的复合损失函数来说,类中心的更新不仅需要考虑最小化类间距离,而且需要考虑最大化类间距离,对于类别为j 的类中心cj,由中心损失函数Lcenter 计算得到梯度,其公式表示如下:

对于类间距离增加项Lcenter 的梯度,可以表示为对每一对类中心(ci,cj)之间的距离,当距离小于预设的边界m 时,对梯度调整为

其中,1(· ) 是指示函数,其值在条件满足时为1,否则为0。

在SDG的更新规则下,对于类中心cj的更新公式表示为

c(new) j =cj-η(λ1 ÑcjLcenter+λ2 ÑcjLinter) (10)

其中:η 是学习率,在模型与复合损失函数结合后,训练过程中通过前向和反向传播不断更新损失参数和网络参数,确保模型能够有效学习和适应数据特性。

2 模型介绍(Modelintroduction)

2.1 算法结构

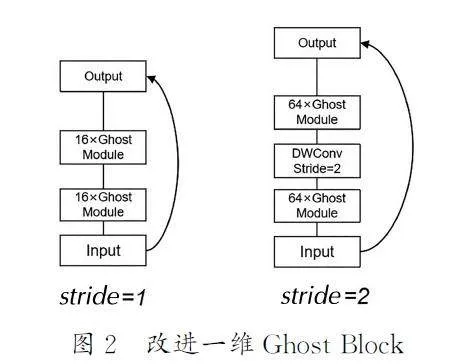

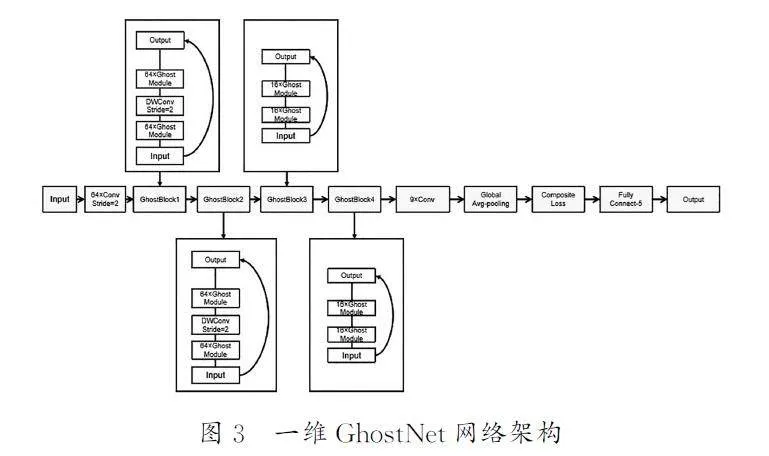

本文基于GhostNet提出了一种一维信号的辨识算法,通过触觉传感器采集的数据特性在“1.6”小节中已有描述。基于数据特性,本研究对损失函数进行了改进,使用复合损失函数提高模型对不同物体的辨识能力。GhostNet模型的一维GhostModule原理图如图1所示。针对触觉数据的一维结构特性,在模型设计时,将所有二维卷积替换为一维卷积,当stride=1和stride=2时,得到的改进一维GhostBlock如图2所示。ULLAH等[6]通过对比一维信号在卷积核逐层递增和递减两种情况下的表现,发现卷积核逐层递减的神经网络的参数远小于卷积核逐层递增的神经网络的参数,但在精度上,卷积核逐层递减的神经网络与卷积核逐层递增的神经网络并没有明显的区别。

因此,本文在设计卷积核时采取了逐层递减的方式,即64—64—32—16。一维GhostNet网络架构如图3所示。

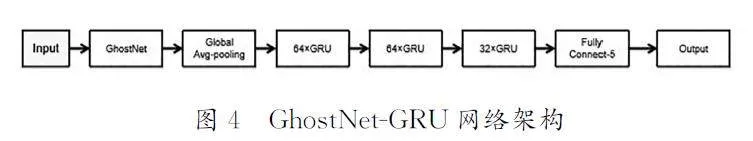

2.2 网络融合

首先,使用GhostNet的结构对输入的一维时间序列数据进行特征提取。其次,将GhostNet处理后的特征传递给GRU网络,这是因为GRU能够有效地处理时间序列数据。最终,我们构建了融合模型GhostNet-GRU,其网络架构如图4所示。

3 数据采集与处理(Datacollectionandprocessing)

本次实验选取的物体都是日常生活中常见的物品,使用加速度传感器作为触觉传感器来提高触觉反馈。具体选取的物体包括番茄、苹果、木块、泡沫和鸡蛋。其中,番茄的表面光滑,内部含水量高,质地较软,在触觉实验中易受压力而变形;苹果的外表比较光滑,内部脆弱且含有较多的水分,相较于番茄硬度较高,提供了与番茄不同的触觉反馈;木块的质地坚硬,结构稳定,表面略带粗糙,其坚硬的特性和不同的纹理差异为触觉实验提供了不同触觉反馈;泡沫质地轻盈、多孔,压缩性高,在被压变形后可以迅速恢复原样;鸡蛋的外壳坚硬,但承受一定压力后会破碎,其内部的流动性也为触觉实验提供了独特的反馈。

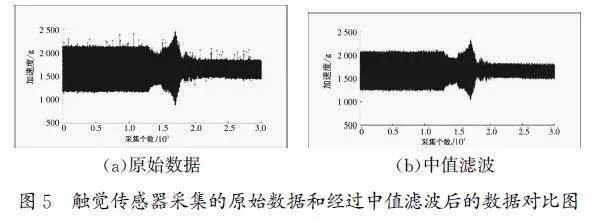

采集完数据后,由于环境变化和存在传感器噪声,因此需要对采集的数据进行滤波处理,本次实验采用的是中值滤波。中值滤波是一种典型的非线性滤波技术,特别适合去除噪声干扰,而且还能保持数据的边缘信息不被模糊。在中值滤波过程中,先设定一个滤波窗口,窗口中包含的数据数量设置为N 。对于每一个新的数据点,滤波器都会考虑当前点及其前后的共N 个数据点。滤波器的任务是将这N 个数据点按数值大小进行排序,然后选取中间的值作为输出,以此减少随机噪声的影响。触觉传感器采集的原始数据和经过中值滤波后的数据对比图如图5所示。从图5中可以发现噪声点明显减少,这种中值滤波处理数据的方法可以帮助模型学习和提取有用的特征而不被噪声干扰。

4 实验分析(Experimentalanalysis)

4.1 改进损失函数分析

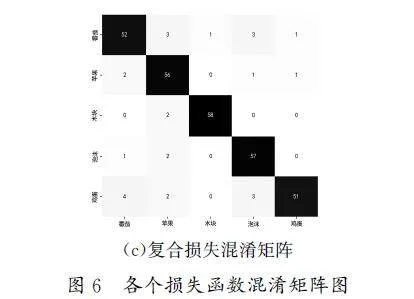

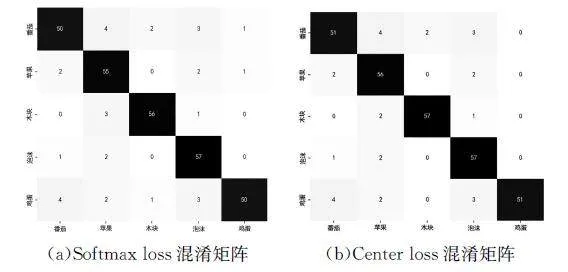

本次实验通过触觉传感采集了5种常见的物体,分别为番茄、苹果、木块、泡沫、鸡蛋。每种物体采集了200个数据,共计1000个数据,随机抽取70%的数据作为训练集,剩余的30%作为测试集。分别将Softmaxloss、Centerloss和复合损失函数引入改进模型,并通过混淆矩阵对3种损失函数下的模型性能进行对比(图6)。

分析图6中的混淆矩阵,我们发现在测试集中,相较于使用Softmaxloss和Centerloss,使用复合损失函数时出现的误判次数最少,并且在物体识别率上表现出了最高的准确率,特别是在对木块和泡沫的识别上表现尤为突出。因此可以得出结论,使用改进后的复合损失函数后,模型的辨识准确率有所提高。

4.2 模型对比分析

4.2.1 实验评价标准

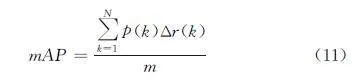

平均精度均值(meanAveragePrecision,mAP)是一个评估分类模型性能的指标,它计算了模型在所有类别上的平均分类检测性能,其计算如下:

其中:N 表示类别的总数,p(k)表示样本分类的精度,k 表示样本个数,Δr(k)是相应的召回率增量,m 是类别的数量。mAP可以直观地评价模型的分类检测性能。

4.2.2 改进模型对比

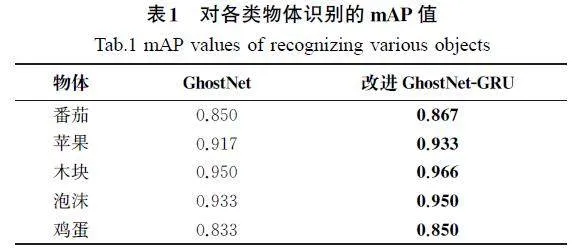

基于采集的数据,改进后的模型能够更好地处理时间序列数据,对各类物体识别的mAP值如表1所示。

实验结果表明,改进后的模型对各类物体的识别准确率都有提升,特别是木块和泡沫的mAP值最高,分别达到了0.966与0.950。

4.2.3 与其他模型对比

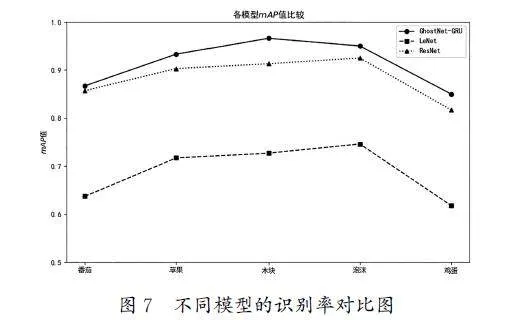

常见的数据特征提取方法有LeNet(LeNet-5)[7] 和ResNet[8],不同模型的识别率对比图如图7所示。

从图7中可以清晰地观察到,改进后的GhostNet-GRU模型在处理一维时间序列数据方面表现出显著的优势,特别是在识别木块、苹果和泡沫时,展现了较高的识别准确率。实验结果有效地证明了本研究构建网络结构的有效性和实用价值。

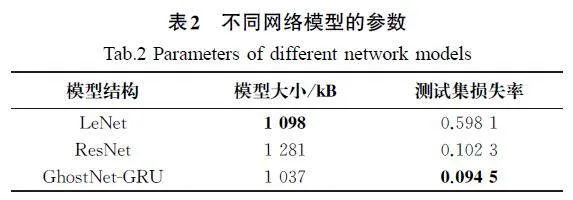

不同网络模型的参数如表2所示。由表2可知,在与LeNet模型大小相近的情况下,改进的GhostNet-GRU展现出更低的损失率;与ResNet相比,在模型参数更少的情况下,GhostNet-GRU表现出更高的效率和性能。这一实验结果表明了GhostNet-GRU结构在效率和性能上的双重优势。在拥有较少模型参数的同时,其在测试集上也展现了更优的损失表现。

5 结论(Conclusion)

本文以轻量级神经网络GhostNet模型为核心,通过将其与复合损失函数和GRU 结构相结合,提出了一种GhostNet-GRU模型架构。该模型适用于处理一维时间序列数据,对于识别和分类各种物体有更高的效率,并且能够在运算资源有限的情况下,快速且准确地对物体进行分类识别。为了进一步验证模型的效果并优化其性能,我们计划将模型应用于嵌入式系统,继续对识别算法进行深入研究,并对系统进行持续改进,旨在实现更高的操作效率和更低的能耗,最终将先进的人工智能技术更广泛地应用于日常生活和工业实践,发挥其巨大的潜力与价值。

参考文献(References)

[1]PATELRV,ATASHZARSF,TAVAKOLIM.Hapticfeedbackandforce-basedteleoperationinsurgicalrobotics [J].ProceedingsoftheIEEE,2022,110(7):1012-1027.

[2]刘聂天和.基于嵌入式AI的主动激励触觉瞬态信号特征辨识研究[D].贵阳:贵州大学,2023.

[3]HANK,WANGYH,XUC,etal.GhostNetsonheterogeneousdevicesviacheapoperations[J].Internationaljournalofcomputervision,2022,130(4):1050-1069.

[4]ZHUTL,LIAOYX,TAOZ.Predictinggoogle’sstockpricewithLSTMmodel[J].Proceedingsofbusinessandeconomicstudies,2022,5(5):82-87.

[5]HUG,SHENGGL,WANGXF,etal.CCNNet:anovellightweightconvolutionalneuralnetworkanditsapplicationintraditionalChinesemedicinerecognition[J].Journalofbigdata,2023,10(1):114.

[6]ULLAHI,HUSSAINM,QAZIEUH,etal.AnautomatedsystemforepilepsydetectionusingEEGbrainsignalsbasedondeeplearningapproach[J].Expertsystemswithapplications,2018,107:61-71.

[7]LECUNY,BOTTOUL,BENGIOY,etal.Gradient-basedlearningappliedtodocumentrecognition[J].ProceedingsoftheIEEE,1998,86(11):2278-2324.

[8]HEK M,ZHANGX Y,RENSQ,etal.Deepresiduallearningforimagerecognition[C]∥IEEE.ProceedingsoftheIEEE:2016IEEEConferenceonComputerVisionandPatternRecognition.Piscataway:IEEE,2016:770-778.

作者简介:

余 航(1998-),男(汉族),贵州,硕士生。研究领域:电子信息。

陈烨烨(2000-),女(汉族),贵州,硕士生。研究领域:电子信息。

李捍东(1966-),男(汉族),贵州,教授,博士。研究领域:电子信息,计算机控制,嵌入式。本文通信作者。