基于仿生机器人的狭小空间裂纹检测技术

2024-11-09王文娟张梦杰刘元博孙介薛景锋段晋军刘中

摘 要:飞机裂纹的检查贯穿飞机的整个生命周期,若不及时发现可能会带来严重的后果,尤其是飞机盒段等狭小空间部位,人不可达,微小裂纹难以快速检查,给飞机服役、地面强度及疲劳试验等带来重大安全隐患。本文研究了可自由进入狭小空间的仿生机器人平台,涉及仿生机器人机构、运动行为及步态规划、环境感知和避障等。开展了大量图像文本的数字增强、图像预处理、基于深度学习的图像裂纹算法等研究,在具有狭小空间特征的飞机盒段样件上开展了试验验证,通过盒段内部预设裂纹,有效地集成图像采集模块和仿生机器人平台,并结合图像采集环境调试,机器人路径规划、裂纹算法优化研究等,成功实现了对狭小空间内部的裂纹长度和位置的识别,为后续开展飞机裂纹全覆盖快速检查和维修策略提供技术支撑。

关键词:狭小空间; 仿生机器人; 图像处理; 深度机器学习; 裂纹识别

中图分类号:V224 文献标识码:A DOI:10.19452/j.issn1007-5453.2024.07.011

飞行器服役过程中,其结构处于复杂交变载荷的作用下,经过长期运转之后,结构可能会在表面产生微观裂纹,并逐渐扩展到临界尺寸,然后导致低应力的脆断,这种破坏叫作疲劳破坏。疲劳裂纹作为机械结构破坏形式的一种,占失效总数的 50%~90%。由于疲劳破坏发生前,结构的塑性变形并不明显,极难发现,因此疲劳裂纹具备潜藏性与突发性,当疲劳破坏发生时,轻则导致停机整修,影响飞行器的服役,重则引发重大事故,造成机毁人亡的灾难性后果。同样,在飞机地面强度及疲劳试验中,如果不及时快速检查结构的微小裂纹萌生情况,可能s129dqThUJYokT8uSVGy0g==会发生结构提前破坏,影响试验安全,难以保障试验进度,浪费经费。因此开展对飞机结构全覆盖的裂纹快速检查至关重要。

当前飞机的裂纹检查过程主要是对飞机表面进行目视及超声无损检查,对进气道、中央盒段内部等狭小空间单靠传统的检查手段难以快速发现。如新型飞机进气道需要在每一起降做目视检测,空间狭小,且需长时间等待发动机冷却,检测人员很难进入;各类飞机中的盒段内部状态的检测,目前多依赖于身材瘦小的专业人员着防护服进入油箱内检测,对人员体型和素质要求较高,甚至有一些新型飞机的关键狭小空间,人不可达,很难进行探测,存在安全隐患。怎样实现飞机狭小空间内部裂纹的快速检查是迫切需要解决的一个问题。

本文提出研制适用于狭小空间行走的仿生机器人代替人进入狭小空间进行图像采集。在仿生机器人研究方面,国外发展起步较早,可以适应不同的地面环境以及障碍物情况[1-5],如2017年波士顿动力研制的液压机器人Spot mini具有更加灵活的运动能力,并在许多实际工业场景中开始推广应用;2019年美国MOOG公司合作开发了模块化紧凑型液压关节驱动单元,推出了最新一代基于ISA搭建的模块化液压四足机器人HyQReal,它实现了完全能量自给以及更高的坚固可靠性和关节输出能力。国内仿生机器人具备成熟的理论体系和试验研究[6-10],如浙江大学研发的“赤兔”四足机器人,采用大功率转矩电机来驱动腿部关节;2020年,南京航空航天设计的四足机器人,对足端脱附力进行优化,实现足端层面的运动稳定,并设计了一种使用爬壁机器人的竖直表面全向移动的自主避障;小米在2021年推出的仿生四足机器人产品CyberDog,不仅拥有仿生的运动步态,还拥有仿生的视觉和听觉交互体验,可以听从指令,识别主人甚至自动跟随主人运动。但是现有的仿生机器人一般适用在比较宽阔的环境,如平坦的室内试验场景和宽阔的山地场景等,都是基于机器人和接触平面的平面约束,对于机器人的空间约束较少。针对狭小的检测环境,环境的约束需要机器人具备更加丰富的传感器来识别环境信息,并根据环境约束选择合适的运动形态[11],涉及机器人结构设计、步态规划和稳定运动控制、自主导航和定点停顿等关键技术,以便更好地开展高质量的图像采集和裂纹识别研究。

在图像裂纹识别方面,利用计算机算法实现对图像中裂纹的自动识别与分析[12-13],如针对玻璃裂纹设计的一种基于数字图像处理技术的检测算法,通过对裂纹图像平滑处理后进行阈值分割,实现对裂纹特征的提取;利用滤波器的方向特性与人类视觉原理相结合的方法,检测到沿不同方向排列的裂纹等。计算机算法相比于人工检测的方式,更加快速、准确和可靠,相比于红外、超声等无损检测技术则具有成本低、易实现、适用性强等优点。目前图像裂纹识别主要有图像处理和机器学习两种。基于卷积神经网络(CNN)的深度机器学习方法是当前最有发展潜力的裂纹识别方法之一,由此衍生出来的区域-卷积神经网络(R-CNN)[14]算法通过预先提出候选框,并在后续处理中进行线性回归获取目标的边界框,实现对目标的定位,因此具备了确定裂纹位置的能力,后续经多次改进,产生了快速区域-卷积神经网络(Faster R- CNN)和掩膜区域-卷积神经网络(Mask R-CNN)等性能更佳的检测算法,在识别精度、速度等方面有了很大提高[15-16]。该算法是一种在有效检测目标的同时输出高质量的实例分割算法,在实例分割、目标检测、姿态识别三个任务方面都取得了目前最好的效果。本文采用基于Mask R-CNN的方法开展图像裂纹识别技术研究,同时采用数据增强等方法改善模型的鲁棒性和泛化能力。

1 狭小空间裂纹识别总体方案

选用某型中央翼盒狭小空间,开展适用于狭小空间的仿生机器人平台研究、适用于狭小空间的图像采集和裂纹识别技术研究。首先开展仿生机器人平台研发,将中央翼盒结构、材料、环境、可靠性等作为设计边界,设计仿生机器人机构、脚掌、控制和传感等硬件系统;利用双目视觉传感器和微型激光测距传感器,设计环境识别算法,根据环境特征和狭小空间的先验知识,规划机器人路径、步态和行为策略。其次开展裂纹图像识别研究,采用深度机器学习方法,对拍摄和寻找的大量图像进行滤波、灰度处理、数字增强等预处理,研究适用于微小裂纹检测的Mask R-CNN裂纹识别算法,制定算法流程框架,进行多次模型训练和优化迭代,得到裂纹长度。最后将基于仿生机器人平台的裂纹识别技术在某型机翼中央翼盒舱道模型中开展试验验证。

2 适用于狭小空间的仿生机器人平台研究

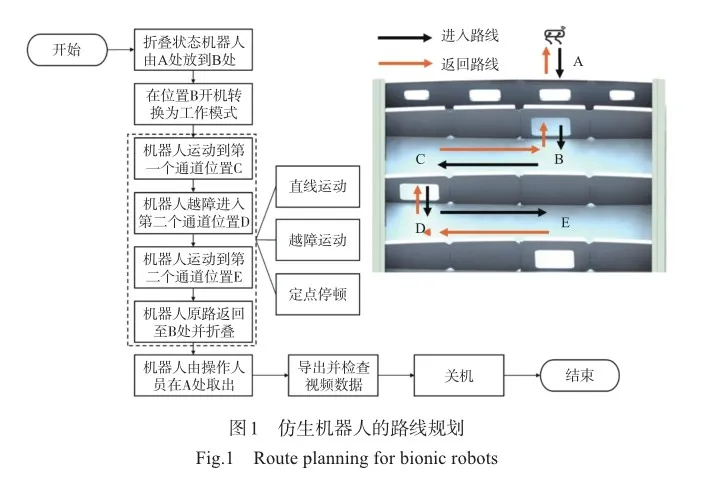

仿生机器人在舱段中的的路线规划如图1所示。狭小空间选用某型机翼油箱盒段密闭空间,环境空间较为狭小,地面状况复杂,采用站立式机构并采用柔性仿生材料可更好地实现在任务环境中的稳定行走及避障越障,实现机器人平台携带图像采集器行走的任务。从A口处进入,沿着B、C、D、E行走并原路返回,运动形式包括直线运动、越障运动、定点停顿等。

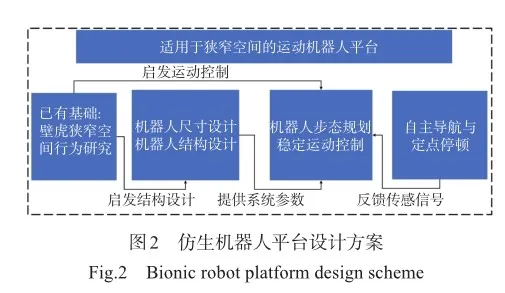

适用于狭窄空间的仿生机器人平台设计方案如图2所示,作者团队在已有壁虎狭窄空间行为研究的基础上,对仿生机器人尺寸、结构进行了设计,采用能适应复杂结构环境的仿生机器人运动机构,足端采用柔性仿生材料来增强机器人地形适应能力和黏附稳定能力;根据仿生机器人的结构系统参数,采用机身动态平衡算法,配合上层感知系统完成步态规划、稳定运动控制及避障越障;同时按照裂纹图片采集的位置需求,开展自主导航及设定定点停顿位置和时间等研究,以便图像采集器根据预设位置和拍摄角度采集狭小空间内部裂纹图像,根据运动准确率和任务完成时间等性能指标,对仿生机器人进行多次迭代优化。

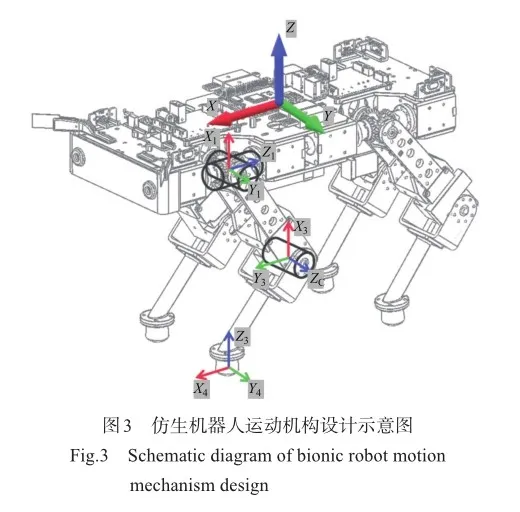

机器人运动机构设计如图3所示,机器人整体具备12个主动自由度,以此建立D-H坐标,可得到机器人运动学模型。首先建立腿部各个连杆坐标系,进而推导各个连杆之间的变换矩阵,机器人的单腿正运动学方程由变换矩阵依次相乘得到,经过一系列的数学变换得到逆运动学方程。坐标系定义及实物参数确定:各旋转关节坐标系的Z轴与关节旋转轴重合,坐标系的X轴沿相邻两关节Z轴的公法线方向,坐标轴的Y轴遵从右手定则。

仿生机器人平台采用了大量的传感器,实现步态规划和自主导航控制,其中感知模块主要采用触觉传感器LDT0-028K,可以在机器人与环境发生轻微接触时产生信号,并经过放大电路传输至感知信号处理板。激光单元采用传感器VL53L0x可以准确快速测量机器人各关键位置与环境间的距离,可以达到20Hz的采集频率以及10mm以内的测量误差。足端力传感器采用RP-C18.5-ST,能够准确测得机器人足端所处的状态信息,通过触地信息分辨机器人的仿生腿在支撑相还是摆动状态,提高机器人的环境适应性。IMU姿态传感器913fdb3230c19787b729755cca5c094dc89664ed9a65c0ec3cd4c6b1c15fde84选择的是九轴高精度角度传感器JY901L。足端柔性仿生材料如图4(a)所示,是一种自制的高温硫化模压成形的有机硅混炼胶,将其制作成半圆球形粘连在机器人足端底部,在保证机器人和地面的接触面积的同时,大大降低了接触冲击对足端力传感器的影响。仿生机器人平台实物如图4(b)所示。

3 裂纹识别算法研究

3.1 图像预处理

一般情况下采集到的原始图像受当时拍摄环境的影响会有各种缺陷,如噪声,有些用肉眼无法分辨出来,如果不及时把这噪声滤掉,将会影响到后续的裂纹识别。图像预处理方面,首先采用滤波处理把图像上的噪声去除,得到平滑图像,通过图像增强得到梯度图像,可以使图像变得清晰。边缘检测是根据灰度级别的不同来识别出裂纹,得到边界点图像,利用再次滤波处理来去除边缘检测带来的附加噪声,再次图像增强处理使图像边缘变得更清晰,方便后期进行阈值处理。二值化处理如图5所示,使裂纹与背景进一步有效分离,保存形成可用于进行深度机器学习模型训练和识别的图像库。

3.2 基于Mask R-CNN(Region-CNN)的裂纹识别算法

Mask R-CNN算法的网络架构主要由基本骨架、区域候选网络、对齐映射、边界框检测和掩膜分割组成。其中,基本骨架实现底层到高层的特征图的融合,从而充分利用了提取到的各阶段的特征。区域候选网络在输入图像的特征图上提出可能包含目标的候选区域,这些候选框被用作后续步骤的对齐映射,为后续的目标检测和实例分割提供了基础。边界框检测用于确定目标对象的位置和大小。

经过图像预处理后,得到图像库,通过Mask R-CNN算法实现裂纹的有效识别。通过骨干网络提取可能含有裂纹对象的特征图,生成候选区域,在特征图上使用区域候选网络(RPN)提取候选区域。对候选区域进行感兴趣区域对齐映射操作,将不同大小和比例的候选区域映射到固定大小的特征图上,并提取出对应的特征。将提取的特征送入分类器和边界框回归器中,进行目标类别分类和边界框调整。采用的全卷积网络(FCN)可以通过有效的学习,对每像素任务进行密集预测,可以对图片中的目标进行准确的分割,负责生成像素级别的掩码,实现了对检测到的对象进行精确的实例分割,为模型提供了对图像中对象的精细理解和分割能力。

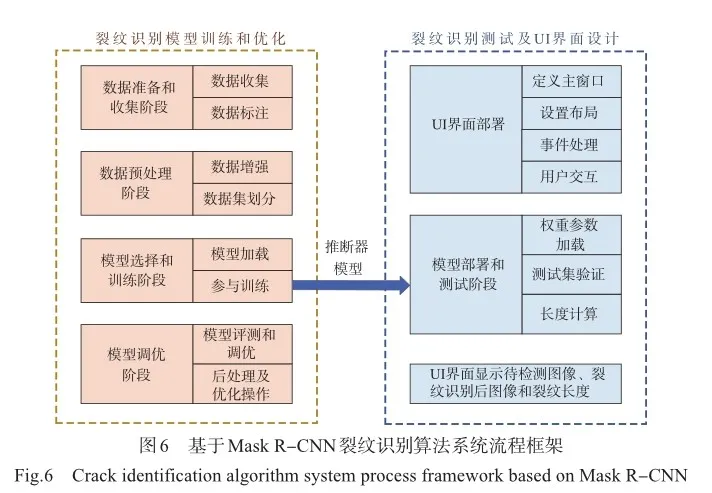

基于Mask R-CNN裂纹识别算法的流程框架如图6所示。主要分模型训练优化和结合测试及UI界面设计两大模块。前半模块主要负责完成模型的训练,其中数据准备和收集阶段包含数据集准备、数据格式转换、生成config配置文件、修改训练图片大小和学习率、模型训练等,由于采用的是监督学习算法,对裂纹图像进行人工标记并生成与之匹配的标签文件,才能实现模型训练。而数据增强策略主要采用图像水平旋转、改变亮度、平移和裁剪和混合4种有效的数据增强方法,扩充训练样本,增强模型的泛化能力和鲁棒性能,减小过拟合发生的现象。经过训练和优化的模型可以作为推断器用于检测和识别图像中的裂纹。模型可以给出裂纹的位置、大小和类型等信息。本文设计了一套用户界面(UI),用户可通过该界面选择被测图像,经过模型的处理计算后显示裂纹检测结果,包括图像中裂纹的位置和实际长度。

模型的训练和优化采用MM Detection工具。该工具是基于Pytorch的目标检测算法,包括经典的单阶段和双阶段检测器,以及一些图像分割等任务的模型。在具体的训练过程中,数据集的标注需要使用图像标注工具进行人工标注。对裂纹的标注需要用鼠标将图像中的裂纹精确框选出来,标注的精度直接关系到模型裂纹长度检测的精度。标注完成后,标注信息会保存在相应的标注文件中,以供算法训练和测试使用。不同的算法框架对标注数据的格式要求不同,通过转换可以确保标注信息在不同框架之间的兼容性和一致性。

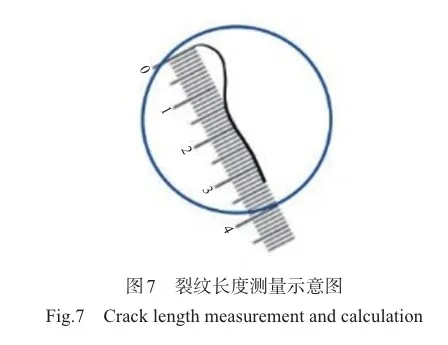

为保证裂纹长度测量具有一致性,本文将裂纹近似为一条线段,其长度统一定义为两端点连线的长度。由于标注图像中的裂纹时,裂纹的两端点与矩形边界框对角线上两顶点重合,因此边界框的对角线长度也可视为裂纹的长度。裂纹样本的实际长度测量方式如图7所示。裂纹检测算法能够将图像中的裂纹标记出来,但还需进行尺度标定才能推断出裂纹的实际长度。基于参考标尺测量法的原理进行尺度标定:在拍摄裂纹图像时保证相机与目标表面的距离固定且相机的光轴垂直于该平面,则根据图像成像原理可以将每个像素点代表的实际距离视为一致。对标尺测量获得其像素点个数为a个,而标尺代表的距离为b,计算得b/a =0.077l,即为像素和实际距离的比例关系。使用所得的比例尺将裂纹区域的像素长度转换为实际长度:裂纹识别矩形框区域对角线长度乘以建立的比例尺,可以得到实际的裂纹长度。

4 狭小空间裂纹识别试验验证

将仿生机器人平台和图像采集模块在飞机机翼舱道结构中进行裂纹识别系统的测试与验证。

对于舱段侧壁裂纹图片,裂纹识别算法能够确定裂纹在图像中的位置,但无法判断裂纹在舱段中的位置,因此要实现对裂纹的精确定位,还需将图片与其拍摄位置相关联。机器人按照预设的路线对舱道进行检查,检查过程如图8所示,分别在不同点位停靠并拍摄样本图像。由于裂纹长度测量过程中尺度标定的前提是相机光轴与目标平面垂直并且两者的距离保持不变,需要利用距离传感器控制机器人在每次拍摄时相机与侧壁的距离均保持在200mm。

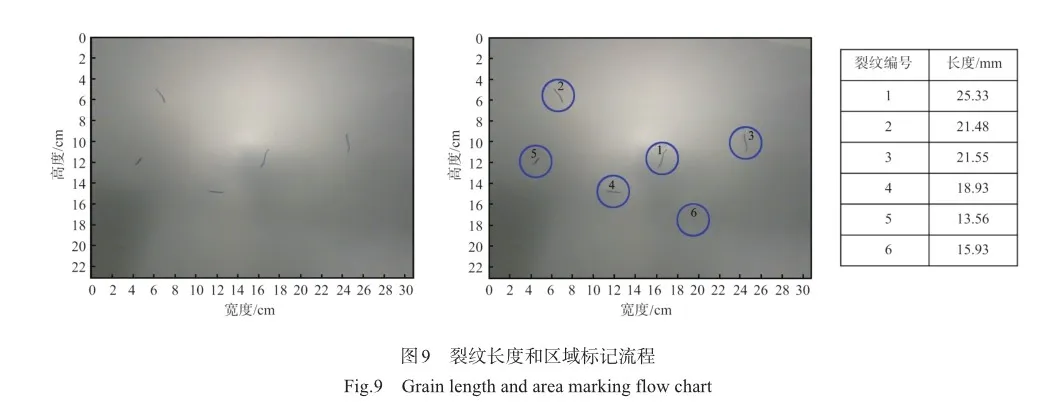

完成图像拍摄和位置信息整合后,选出6张图片用以测试算法的性能。图像中包含的所有裂纹的实际长度已经过人工测量并记录。软件对图像进行裂纹定位和长度测量,部分流程如图9所示。经过测试,样本图像中裂纹的检出率为100%;裂纹的实际长度分布在8~150mm范围内,算法测量的误差最大值为3.73mm,平均值为1.39mm。

5 结论及展望

通过对适用于狭小空间的仿生机器人平台及图像裂纹识别算法研究,实现了对裂纹长度和位置的快速检测,构建了裂纹识别模型,评估了模型在不同数据集上的裂纹识别性能,具有较高的识别精度,使模型具备一定的泛化能力,并在典型盒段内部空间进行了试验验证,实现了对裂纹长度的快速识别和标注,为后续的嵌入式部署和界面开发等提供一种可行性的指导方案。

根据本文的研究进展,对后续的研究展望如下:(1)现有模型在某些特定场景下存在一定的局限性,如光照变化较大、裂纹形态复杂的情况。未来的工作方向将包括进一步改进模型的鲁棒性,优化数据增强策略,并探索更适用于复杂场景的新型模型架构。(2)目前为采集图像后统一输入实现算法识别,下一步可考虑研究机器人边走边识别边传数据,实现实时的裂纹检测,优化工作流程,提高算法效率。(3)裂纹识别技术在工业领域和安全检测中具有重要应用价值。未来的研究方向可能包括深入挖掘跨领域合作的可能性,结合其他领域的技术手段,进一步提升裂纹识别技术的实用性和普适性。

参考文献

[1]Wooden D, Malchano M, Blankespoor K, et al. Autonomous navigation for BigDog[C]. IEEE International Conference on Robotics & Automation. IEEE, 2010: 4736-4741.

[2]Hutter M, Gehring C, Bloesch M, et al. StarlETH: A compliant quadrupedal robot for fast, efficient, and versatile loco-motion[C]. Adaptive Mobile Robotics Conference, 2012: 483-490.

[3]Rebula J R, Neuhaus P D, Bonnlander B V, et al. A controller for the littledog quadruped walking on rough terrain[C]// Proceedings 2007 IEEE International Conference on Robotics and Automation. IEEE, 2007: 1467-1473.

[4]Biswal P, Mohanty P K. Development of quadruped walking robots: A review[J]. Ain Shams Engineering Journal, 2021, 12(2): 2017-2031.

[5]Hutter M, Gehring C, Jud D, et al. Anymal-a highly mobile and dynamic quadrupedal robot[C]. 2016 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). IEEE, 2016: 38-44.

[6]王鹏飞.四足机器人稳定行走规划及控制技术研究[D]. 哈尔滨:哈尔滨工业大学, 2007. Wang Pengfei. Research on quadruped robot steadily walking planning and controlling technology[D]. Harbin: Harbin Institute of Technology, 2007.(in Chinese)

[7]王立鹏.液压四足机器人驱动控制与步态规划研究[D]. 北京:北京理工大学, 2014. Wang Lipeng. Research on actuator control and gait planning of hydraulic quadruped robots[D]. Beijing: Beijing Institute of Technology, 2014. (in Chinese)

[8]谢惠祥.四足机器人对角小跑步态虚拟模型直觉控制方法研究[D]. 长沙:国防科技大学, 2015. Xie Huixiang. Research on intuitive control method of virtual model for diagonal sprint gait of quadruped robot[D]. Changsha: National University of Defense Technology, 2015.(in Chinese)

[9]Wang Zhongyuan, Dai Zhendong, Yu Zhiwei, et al. Optimal attaching and detaching trajectory for bio-inspired climbing robot using dry adhesive[C]. 2014 IEEE/ASME International Conference on Advanced Intelligent Mechatronics.IEEE, 2014: 990-993.

[10]Zhang Houxiang, Zhang Jianwei, Zong Guanghua, et al. Sky cleaner 3: A real pneumatic climbing robot for glass-wall cleaning[J]. IEEE Robotics & Automation Magazine, 2006, 13(1): 32-41.

[11]姜延欢,杨永军,李新良,等.智能无人系统环境感知计量评价研究[J].航空科学技术,2020,31(12):80-85.Jiang Yanhuan, Yang Yongjun, Li Xinliang, et al. Research on environmental perception metrology and evaluation technology of intelligent unmanned system[J]. Aeronautical Science & Technology,2020,31(12): 80-85. (in Chinese)

[12]张文东,卓轶,董登科,等.一种裂纹识别方法的研究及试验验证[J].航空科学技术,2020,31(5):81-88. Zhang Wendong, Zhuo Yi, Dong Dengke, et al. Research on the method of crack identification and experimental verification[J].Aeronautical Science & Technology,2020, 31(5): 81-88. (in Chinese)

[13]于翀,宋昊.航空结构件孔边裂纹监测技术研究综述[J].航空科学技术,2021,32(12):1-17. Yu Chong,Song Hao. Summary of research on hole edge crack monitoring of aviation structures[J]. Aeronautical Science & Technology, 2021, 32(12): 1-17. (in Chinese)

[14]Girshick R, Donahue J, Darrell T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2014: 580-587.

[15]Ren Shaoqing, He Kaiming, Girshick R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2017, 39(6):1137-1149.

[16]He Kaiming, Gkioxari G, Dollár P, et al. Mask r-cnn[C]// Proceedings of the IEEE International Conference on Computer Vision, 2017: 2961-2969.

Narrow Space Crack Detection Technology Based on Bionic Robot

Wang Wenjuan1, Zhang Mengjie1, Liu Yuanbo1, Sun Jie1, Xue Jingfeng1, Duan Jinjun2, Liu Zhong3

1. Chinese Aeronautical Establishment,Beijing 100012,China

2. Nanjing University of Aeronautics and Astronautics, Nanjing 210016, China

3. Beijing University of Aeronautics and Astronautics, Beijing 100191, China

Abstract: The inspection of cracks runs tGgF+YvBKPMTddgoxGQygWfQpeBmMN/TwJ4ykIIwxuaw=hrough the entire life cycle of aircraft, and it may bring serious consequences with crack not found in time, especially in narrow space parts such as aircraft box segment, inaccessible to person, small cracks are difficult to be inspected quickly, which brings major safety risks to the aircraft service, ground strength and fatigue tests. A bionic robot platform that can freely enter a narrow space is studied, involving bionic robot mechanism, motion behavior and gait planning, environment perception and obstacle avoidance. Digital enhancement on a large number of images, image processing and image crack algorithm based on deep machine learning have been carried out. The sample of aircraft box segment with narrow space characteristics has been experimented. By means of presetting cracks inside the box segment, effectively integrating image acquisition module and the bionic robot platform, combining with the image acquisition environment regulation, robot path planning and crack algorithm optimization, the crack length and location in a narrow space is successfully detected, which provides technical support for the follow-up rapid inspection of full crack coverage of aircraft and maintenance strategy.

Key Words: narrow space; bionic robot; image processing; deep machine learning; crack detection