基于视觉扫描生成巡检任务的机器人巡检方法

2024-03-14孟浩安福旺吉力特

孟浩,安福旺,吉力特

(内蒙古京能盛乐热电有限公司,内蒙古呼和浩特 011518)

0 前言

智能巡检机器人改变了电力、石化、交通、隧道、冶金、煤矿等领域的传统运维与巡检方式,已经在配电站、变电站、管廊、交隧、冶金焦炉、油气化工、矿山地下变电所、巷道场景、厂用电气、风电机舱等场景取得了广泛的应用。

巡检机器人在大型机械设备的运行现场,比如轨交车辆、矿用或者码头皮带输送机等得到了日益普及的应用,以保障机械设备的安全可靠运行。

科技部“关于加快场景创新以人工智能高水平应用促进经济高质量发展的指导意见”,为巡检机器人的深入、广泛应用创造了广阔的前景,不断涌现的应用场景,将巡检机器人由研究应用迅速转入产业化、规模化,市场容量达到上千亿规模,极大地提升各个行业的智能化、数智化水平。

与此同时,目前工业场景巡检机器人的巡检点设置是人员手动设置的。考虑到工业现场的复杂环境下,通常巡检点的数量庞大,设置巡检点的任务耗费大量人力和时间,且一旦巡检点的设备改变,还得人工增加或删除巡检点。典型情况下,一台巡检机器人的巡检点数量从几十个到上百个。一个项目多台机器人的巡检点数量从上百个到上千个。手工方式设置巡检点已经成为规模应用的一个瓶颈,降低了劳动效率,且也有违于自动巡检机器人的初衷。

本文作者提出基于自动视觉扫描生成巡检任务的机器人巡检方法,利用机器人扫描环境的视频流,将所有图片送入到YOLOv4目标检测网络进行解析和筛选,并运用SIFT匹配方式去掉重复目标,可以自动生成复杂现场设备的巡检点。在隧道电缆的机器人巡检项目中应用,相比于人工设置方式,提高效率90%。

1 系统架构与方案

1.1 管廊巡检机器人简介

管廊巡检机器人的核心部件主要由云台模块、主控模块、通信模块、避障和电源模块组成。其中:

(1)云台模块主要包括可见光相机和红外热像仪;

(2)主控模块主要是控制机器人的行走以及云台的转动;

(3)通信模块主要完成机器人相关参数信息与远程服务器之间的信号传输,根据现场的通信条件和要求,可以采用WiFi、4G、5G的方式;

(4)避障模块包括机器人的前后安装有超声波雷达,具有前后运行方向检测障碍物后停车的防碰撞保护功能;

(5)电源模块通常采用磷酸铁锂电池。

电缆隧道巡检机器人见图1,可实现对地下管廊环境与设备的不间断监控及火灾应急处置。机器人采用轨道移动方式,搭载高清摄像机及红外热成像仪,实现隧道实时监控与测温诊断;机器人集成有害气体、烟雾、光照度、温湿度等传感器以及定位装置和语音对讲系统,实时监测隧道环境信息,管理员通过监控后台实现对巡检机器人的实时控制、数据接入、统计分析以及多维度展示。

图1 电缆隧道巡检机器人

此外,巡检器人设有存储器、处理器以及搭载有可见光摄像头的云台;存储器存储计算机程序;启动巡检机器人,使其进入设备探索状态,巡检机器人开启仪表设备巡查模式,并开启搭载有可见光摄像头的云台,同时,处理器执行计算机程序以实现自动视觉扫描生成巡检任务。

1.2 自动视觉扫描生成巡检任务的架构

图2是巡检机器人自动视觉扫描生成巡检任务的架构,也就是巡检点的工作流程。

图2 自动视觉扫描生成巡检目标流程

说明如下:

(1)可见光视频云台针对当前待巡检的行进道路方向,以180°广角进行不间断连续旋转扫描,并在扫描过程中录像保存视频流;

(2)当视频流传回时进行等间隔抽帧采样,设采样间隔时间为t(例如t取0.5 s,设置的时间间隔t能够保证视频清晰以及两图仪表重叠率不过高),并与当前时间进行同步记录设为Tn,同时每隔时间t记录机器人以及云台当前的位置坐标,即机器人可根据抽帧图像的当前时刻返回真实时刻的空间位置信息,因此可在该帧对应的时间记录当前机器人位置坐标与云台坐标集合,由此得出当前视频帧图像的时空坐标集:

Pn={xn,yn,zn,hn,θn,γn,Tn}

(1)

其中:xn、yn、zn表示机器人在整个场景中的位置坐标,取值范围根据机器人地图范围而定;hn为云台当前的上升高度,取值范围为[0,hmax],hmax表示云台最大上升高度;θn表示当前云台摄像头摄影方向的水平旋转角度,取值范围为[0°,360°],此处0°为云台摄影正方向,即默认方向;γn表示云台摄像头的俯仰视角度,取值范围为[-45°,45°],此处0°表示水平方向,-45°为以地平面向下拍摄,45°为以地平面向上拍摄。

(3) 将每一视频帧的图像In与其时空坐标集Pn建立对应关系,然后在机器人扫描完整个区间后将所有图像送入目标检测网络进行解析与筛选。目标检测器如图3所示[1-4]。

图3 目标检测器

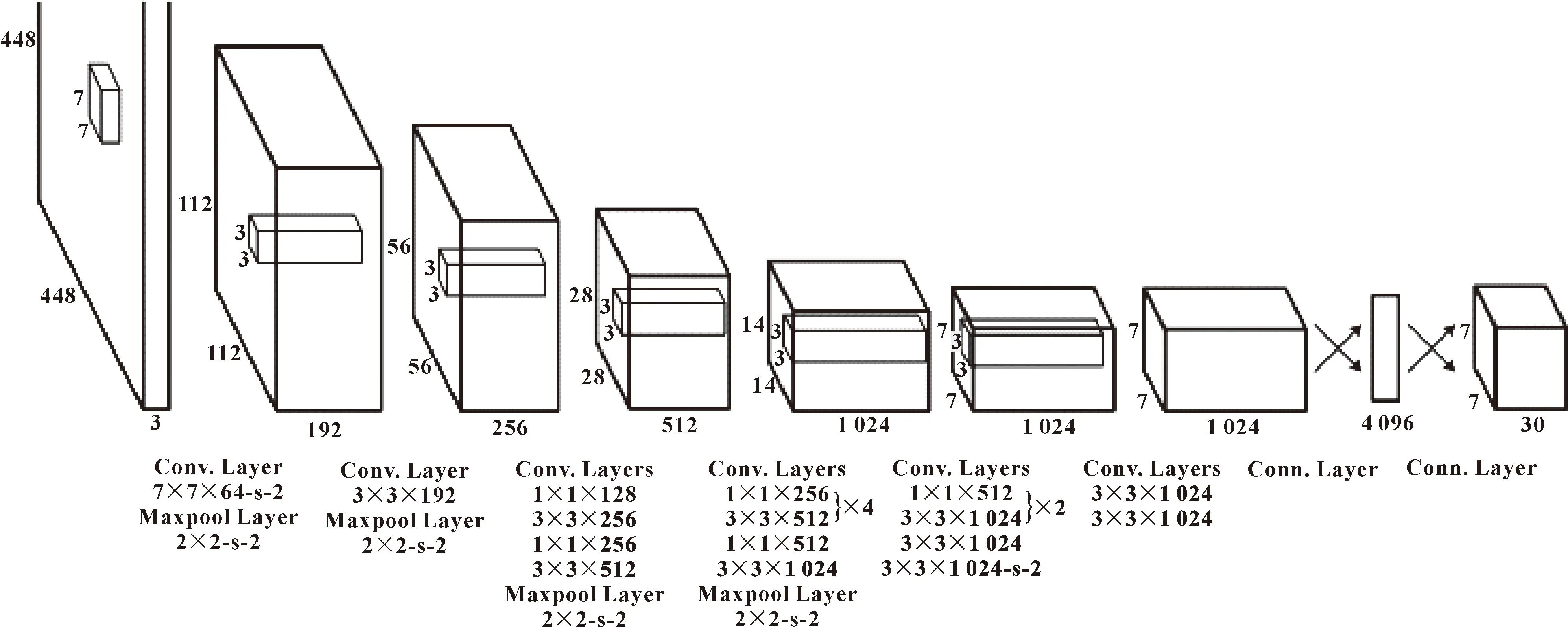

目标检测器包括24个卷积层和2个全连接层,其中卷积层使用1×1卷积来做通道缩减,然后紧跟3×3卷积,且卷积层和全连接层中均采用Leaky ReLU激活函数,最后一层采用线性激活函数。

图像输入YOLOv4目标检测网络[5-11](见图4)后,首先调整为416×416,进入CNN卷积层,主干网络采用CSPDarkNet53,其组成为CSPNet与DarkNet53,Darknet53共有5个大残差块,通过残差网络将输入层与输出层的结果相加;卷积后的池化层采用SPP实现,即空间金字塔池化,然后采用PANet进行实例分割,生成目标box,并通过YOLO head进行最后的特征拼接,输出 box完成目标检测与分割提取。通过CSPNet可增强CNN的学习能力,能够在轻量化的同时保持准确性、降低计算瓶颈、降低内存成本。

图4 YOLOv4目标检测网络

首先,详细记录下每张图像中检测到的仪表数量、种类以及它们的置信度。如果一张图像中没有检测到仪表,将其排除。然后,如果一张图像中仪表的数量少于预设的阈值,会进一步考察这些仪表的置信度。如果这些仪表的平均置信度低于另一个预设值,也会将这张图像排除。对于剩下的图像,会再次记录其中仪表的数量、种类以及它们的平均置信度。这些未被排除的图像将作为预选图像,进行下一步的相似度判断。这种流程旨在筛选出那些包含有效且可识别的仪表图像,确保它们的数量和质量都满足预设的要求。

(4)解析时记录对应图像中检出仪表的个数N、类别数C、全部检测目标的平均置信度B;若图像中无仪表则删除该图像,当仪表数量存在但数量少于预设阈值,则继续判断这些目标检测框的置信度,若太低则删除;其余未删除的图像记录有仪表上述3类数据,将未删除的图像作为预选图像进入步骤(5)。

通过目标检测网络对原图进行检测,首先仪表个数N依据获取检出的目标长度获得,类别数C则根据检出类别进行去重累加,平均置信度B则通过计算所有检出目标除以检出数量来获得。

(5)筛选后的图像进行场景相似度判定,以图像拍摄时的原始时间先后顺序排列,并设置相似度比对梯度S,即每隔S张分为另一梯度,并在该S张图像内进行相似度判定。在该梯度内以检出仪表数N和平均置信度B依次为参考依据,选择其值最高的图像作为比对参考图像,依次对下一张目标图像进行SIFT[12]匹配,即将目标图像与基准图像进行SIFT匹配,若能够匹配则认为这两个图像在该SIFT匹配下相似,然后将SIFT匹配相似且图像中仪表类别数C均相同的图像归为新的一组,若匹配不上则归为另一组,并进行该组内的判断,直至对该梯度内的所有图像进行迭代判定;在新的这一组图像中,选择检出仪表数N、平均置信度B依次为参考,选择值最高的图像作为预置巡检点图像,将该梯度中其他图像作为参考巡检点;然后依次针对每一梯度进行同样操作,若到最后分割不均,则剩余图像单成一组,直至遍历所有筛选后的图像,生成预置巡检任务表。

(6)管理员查看所有预选图像与预置巡检点图像,并根据实际需求进行筛选、替换、增删,并生成人工修正后的最后巡检点集以及对应的巡检任务,同时其他参考巡检点信息依旧保存,需要时可以采用。

2 测试案例与测试结果

2.1 巡检点自动获取流程

(1) 启动图1所示的电缆巡检机器人,并从前端控制机器人进入设备巡查模式,将其初始位置遥控至场景的起始点,并在地图页面规划好固定线路。机器人开始沿规划好的线路行进,并慢速匀速水平转动搭载有可见光摄像机的云台。自动旋转的范围为水平方向[-90°,90°],即以两侧为主;垂直方向为[-45°,45°],主要辅助巡查可能在某些低处或高处漏掉的设备。同时进行视频录制,录制视频时每0.5 s记录一次机器人以及云台的位置信息。

(2) 根据不同现场的仪表设备个数、场地大小,录制视频的时长可能不一致。此实施例中录制时长为3 min,录制完成后保存录制的视频流并获取录制的起始与结束时间。

(3) 以视频起始的第一帧图像作为抽帧的起始图像,并以录制起始时间为首帧图像的时间坐标,之后以0.5 s为间隔进行抽帧。由于在录制视频时已经对每0.5 s间隔的位置信息进行记录,因此抽帧后的图像位置坐标即可认定为同等时间视频中的位置信息,此时便可以对每一帧的图像打上一个时空信息的标签。

(4) 打上标签后的每一帧图像即与现场位置建立了动态的关联,方便在后续筛选出巡检点后直接获得机器人与云台的位置关系。现在将所有抽帧图像依次送入仪表目标检测网络进行第一次筛选,若网络未检测到目标仪表则直接删除该帧图像,若存在目标仪表,在此实施例中作者严格控制仪表个数阈值,即认为只要存在仪表(N≥1)即为有效样本,暂不判定置信度,实际使用时若仪表数量太多,可根据情况修改阈值,再进行置信度判定进行筛选。

(5) 通过第一次筛选去除了没有目标仪表的无效帧,对剩余的图像根据数量进行梯度划分,默认梯度为7(可根据实际数量设置)。在该梯度内以检出仪表数、平均置信度依次为参考依据,选择其值最高的图像作为比对参考图像,依次对组内其他图像进行判定迭代。若能够进行匹配,则将其与参考图像归为新的一组,若匹配失败则将比对图像归为新的一组,再重复以上操作迭代判断新一组的相似度。

(6) 在新的一组图像中以检出仪表数、平均置信度依次为参考,选择值最高的图像作为预置巡检点图像,其余为参考巡检点。如此操作遍历所有第一次筛选后的图像,完成所有图像的预置巡检点筛选并生成预置巡检任务表。如图5—7所示,为实施此方法所得巡检任务列表、巡检点集和巡检点平面位置。

图5 巡检任务列表

图6 巡检点集示例

图7 巡检点平面位置

(7) 根据图5所得列表,管理员可以查看所有的自动分组并调节图像,或增删、替换巡检点,生成最终的巡检任务。

2.2 测试案例

上述巡检点自动获取流程应用于案例1-4的4个工程项目,具体测试数据见表1。

表1 自动巡检点/手工巡检点测试数据

其中:机器人的巡检速度按照现场的机器人机型不同、轨道链接不同以及用户使用要求,可以通过机器人运行参数设置。

巡检点的数量主要是根据机器人巡检路径上设备数量、环境检测的要求来确定的。

人工配置巡检点的速度与现场工程师的技术水平、熟练程度相关,但通常都是经过培训的工程师,技能水平相差不太大。

自动配置巡检点时间是指机器人通过视频检测自动解析出巡检点的时间,需要人工来给这些自动配置的巡检点按照现场的设备或者环境来命名。

2.3 测试结果分析

从上述测试案例的数据看,巡检点数量越多,自动巡检点算法的优势越明显。上述案例中自动巡检相比手工巡检耗时效率提高平均值为90.54%。

3 结论

文中的主要工作总结如下:

(1)设计了YOLOv4目标检测网络(图3)用于现场设备的检测与分割提取。

(2)目标图像与基准图像进行SIFT匹配作为相似度判断的依据,来消除重复的识别目标。

(3)对筛选后的图像进行场景相似度判定,以图像拍摄时的原始时间先后顺序排列,并设置相似度比对梯度S,即每隔S张分为一梯度,并在该S张图像内进行相似度判定。在该梯度内以检出仪表数N和平均置信度B依次为参考依据,选择其值最高的图像作为比对参考图像,依次对下一张目标图像进行SIFT匹配,即将目标图像与基准图像进行SIFT匹配。若能够匹配则认为这两张图像在该SIFT匹配下相似,然后将SIFT匹配相似且图像中仪表类别数C均相同的图像归为新的一组,若匹配不上则归为另一组,并进行该组内的判断,直至该梯度内所有图像完成迭代判定。

(4)结合目标检测与图像评估算法,在流程上一步到位解决了设备添加与巡检点添加,且均为自动生成,同时可以采用其他备选点位,相对人工拍摄减少了大量时间。

该算法已经在隧道电缆的机器人巡检项目中应用,相比于人工设置方式,即自动巡检相比人工巡检提高效率90%以上。