基于深度特征正射匹配的无人机视觉定位方法

2024-02-16尚克军张伟建刘崇亮

尚克军,赵 亮,张伟建,明 丽,刘崇亮

(1.北京自动化控制设备研究所,北京 100074;2.北京理工大学 自动化学院,北京 100081)

匹配导航定位指采用机载传感器采集的实时数据与预存储的地图进行匹配,得到飞行器位置的一种导航方式[1]。在卫星拒止条件下,基于商业卫星地图的匹配导航技术不存在累积误差、自主性强,逐渐成为无人机导航领域研究热点[2]。

图像匹配导航技术的关键在于图像匹配,图像的特征提取与匹配直接决定着系统的导航精度。传统的特征提取与匹配方法受光照、季节、载荷姿态的影响[3],特别是在大视角和多尺度变化的情况下挑战更大[4,5],导致提取的特征判别性和唯一性较差。针对上述挑战,国内外研究学者做了大量工作,文献[6]提出一种归一化互相关(Normalized Cross Correlation,NCC)技术估计无人机的绝对位置,利用图像相似区域的相关程度进行匹配导航,但是该算法对噪声敏感,且在弱纹理区域容易产生误匹配。文献[7]使用互信息(Mutual Information,MI)的稠密特征技术进行图像配准,并在低空完成了试验验证。文献[8]提出使用方向梯度直方图(Histogram of Oriented Gradient,HOG)特征来完成图像配准,再基于粒子滤波从粗到精地确定无人机地理坐标。这些传统方法在航拍图像正射后取得了一些进展,但对正射的姿态和高度信息要求高、且多场景的适应性和鲁棒性方面还存在明显的不足。

随着人工智能技术的发展,基于深度学习网络的图像特征提取与匹配方法具有强大的潜力。在众多网络中,SuperPoint[9]是一种自监督训练的特征提取网络,无需手工标注,且提取的关键点在图像中分布均匀、抗干扰性强、重复性高、对应的描述子鲁棒性强、可适应光照的显著变化和一定范围内的视角变化;SuperGlue[10]是一种基于注意力机制的图神经网络,将图像中特征的拓扑结构关系编码为图结构,可显著提高特征匹配的鲁棒性和可靠性。SuperPoint+SuperGlue二者结合的网络虽然无法直接用于匹配导航,但为无人机视觉定位提供了一种有效的解决途径。

基于此,本文提出了一种基于深度特征正射匹配的无人机视觉定位方法。该方法利用低精度的惯性航向角信息对航拍图像进行粗正射(航向误差角最大允许30 °),将粗正射后的图像和商业地图分别输入SuperPoint 网络提取相应的特征点,然后通过SuperGlue 网络对特征点进行匹配,获取高置信度的同名特征点,采用RANSAC 进行野值剔除后计算单应矩阵,进而获得图像载荷与地面交点的经纬度。最后通过空间位置反算完成无人机的视觉定位。本文方法可有效提高视角、尺度变化剧烈下的图像匹配精度,实现低精度惯导约束下的中空无人机高精度视觉导航定位,具有一定的工程应用价值。

1 定位原理及算法方案

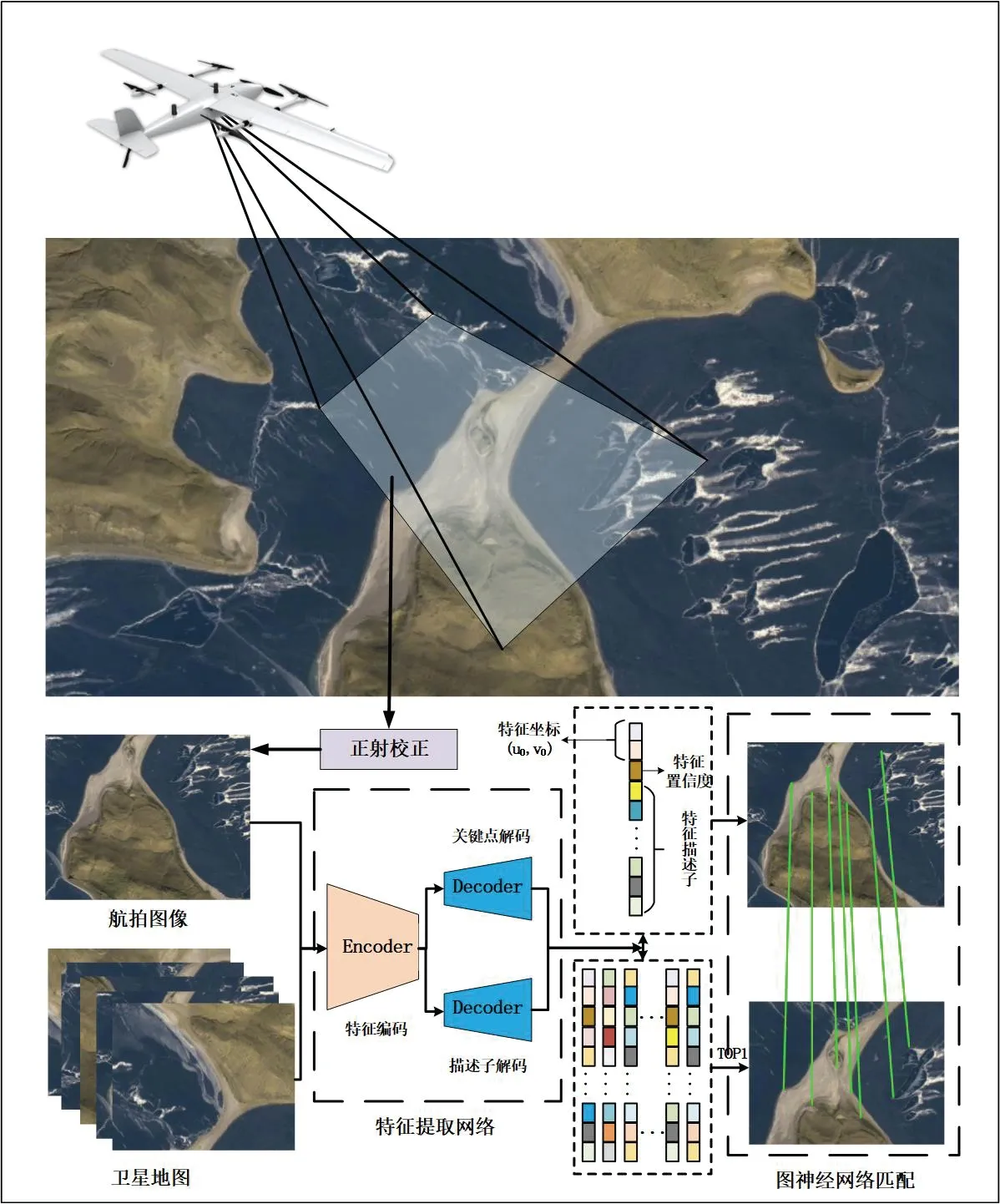

本文方法通过图像预处理、深度特征提取及匹配、无人机定位解算三部分获得无人机高精度的视觉定位信息。算法定位原理及总体流程如图1 所示。

图1 算法框架Fig.1 Algorithm framework

图像预处理:由于无人机姿态和高度剧烈变化导致航拍图像与商业地图间视角和尺度差异显著,为提高匹配成功率和实时性,利用低精度的惯性航向角信息对航拍图像进行粗正射,降低航拍图像与商业地图间视角和尺度差异;同时基于商业地图不同投影方式对图像匹配导航的影响,选择经纬度投影方式对商业地图完成预处理。

深度特征提取及匹配:通过SP+SG 网络不仅能够提取图像中的边缘、颜色、梯度等像素级特征,且可提取图像中深度特征及其相互关系,具有对图像一定范围的视角和尺度变化不敏感的特性,因此将粗正射后的图像和商业地图分别输入SP+SG 网络进行特征提取与匹配,获取特征匹配关系,采用RANSAC 进行野值剔除后计算单应矩阵。

无人机定位解算:基于深度特征获取的单应矩阵将主点像素坐标转换为定位坐标,完成匹配位置解算,再根据空间位置反算方法将定位坐标转换为无人机的导航坐标。

通过航拍图像和商业地图的匹配可实现无人机视觉定位,影响匹配导航效果和精度的两个关键因素是视角和尺度差异。本文方法通过航向粗正射预处理航拍图像和商业地图间的视觉差异,基于无人机气压高和相机焦距统一航拍图像和商业地图的尺度差异。

2 深度特征提取及匹配

深度特征提取和匹配算法框架如图2 所示。无人机通过安装在腹部的相机拍摄地理图像,然后采用粗正射校正方法将航拍图像转换为正射图,商业地图通过存储介质预先存储到无人机上。在执行任务过程中,航拍正射图与商业地图库中的图像共同作为网络的输入,通过SuperPoint 网络完成对图像的关键点和描述子解码,解码的特征向量包含关键点、置信度以及描述子,根据余弦距离对商业地图生成的特征向量进行重排序,将TOP1 的商业地图特征向量与航拍图像特征向量一同作为SuperGlue 网络的输入,该网络对特征向量进行位置编码并生成对应的图结构,通过自注意力机制和互注意力机制让网络迭代学习拓扑结构,给出较鲁棒的匹配关系。

图2 特征提取及匹配算法框架Fig.2 Feature extraction and matching algorithm framework

2.1 特征提取网络

航拍图像和商业地图实现匹配的关键特征之一是显著特征。网络应更加关注图像中的角点、边缘、梯度等显著变化的结构特征,而非缓慢变化的表面纹理特征。SuperPoint 网络专注于提取图像中的角点特征,且采用单应自适应的策略提高特征描述子的旋转不变性和尺度不变性。

SuperPoint 网络由三个模块组成:特征编码模块、特征点提取模块、描述子解码模块。该网络的整体结构如图3 所示:

图3 SuperPoint 网络结构Fig.3 SuperPoint network architecture

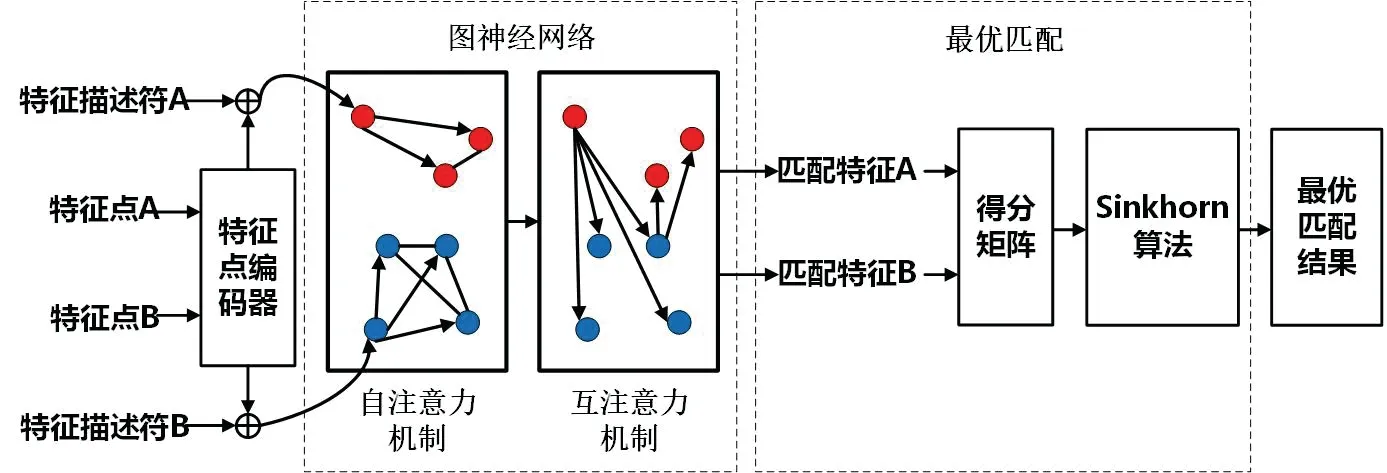

2.2 特征匹配网络

航拍图像和商业地图中利于匹配的另一个关键特征是拓扑结构,特征间的分布和相对关系可促进特征匹配的准确性。针对匹配导航任务,除了依赖提取的显著特征外,还可利用显著特征间的拓扑结构提高匹配正确率和匹配效果。SuperGlue 网络通过注意力机制迭代学习特征间的拓扑结构关系,给出较鲁棒的特征匹配结果。

SuperGlue 网络框架分为注意力图神经网络模块和最优匹配模块。网络结构如图4 所示。

图4 SuperGlue 网络结构Fig.4 SuperGlue network architecture

3 无人机定位解算模型

3.1 匹配位置解算

基于航拍正射图像与TOP1 商业地图的匹配关系通过RANSAC 算法计算得出两幅图像间的单应矩阵通过式(1)计算航拍图像主点在商业地图上的映射坐标ps:

由于已知商业地图左上角的经纬度坐标(Lon0,Lat0)和右下角的经纬度坐标 (Lon1,Lat1),通过式(2)计算得到航拍图像主点对应的导航坐标(导航坐标系是n系,定义为“东北天”坐标系,符合右手定则):

其中,ws和hs是商业地图的宽和高,hA是无人机航拍图像拍摄时刻的气压高。

3.2 空间位置反算

匹配位置解算可以确定航拍图像主点在商业地图上对应的导航坐标,在理想正下视的情况下,该坐标与无人机当前时刻的导航坐标一致。但是由于无人机姿态和高度变化,所得到的航拍图像主点的导航坐标并非无人机导航坐标,需通过空间位置反算获得无人机的导航坐标,空间位置反算示意图如图5 所示。

图5 空间位置反算示意图Fig.5 Spatial position inverse calculation diagram

载体坐标系(b系)定义为“前上右”坐标系,符合右手定则;摄像机坐标系定义为“东南地”坐标系,符合右手定则。通过式(3)计算导航坐标系n系下变化量

通过式(4)计算A1点在导航坐标系中的坐标:

其中,RM、RN为地球子午圈、卯酉圈的曲率半径,为A2点处的经度,为A2点处的纬度。

综上,可得出无人机质心A点处的导航坐标。

4 实验验证与分析

4.1 数据集制作

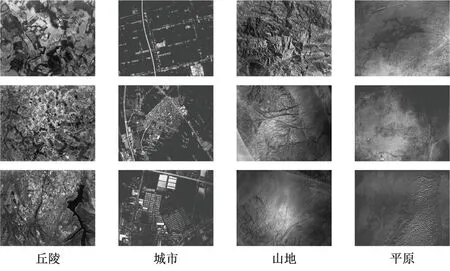

本文通过某型号固定翼无人机采集多种地理场景(包括丘陵、城市、山地、平原)下的飞行数据,将其梳理并制作成一个中空无人机真实飞行的数据集,命名为UAV-Dataset,该数据集包含119,388 对航拍图像和商业地图以及真值标签(航拍图像与商业地图对应关系[11]、航拍图像主点在商业地图上的像素坐标和无人机各时刻的状态参数),使用差分卫星接收机和惯导的组合导航结果作为无人机的定位基准,下视红外相机用于采集图像,相机焦距为10 mm,像元尺寸为12 μm,惯导是高精度的激光惯导。表1 是UAV-Dataset数据组成的简要说明:

表1 UAV-Dataset 数据集组成Tab.1 Composition of the UAV-Dataset

数据集中含有多种地理场景下的中空无人机航拍图像,可全面测试匹配算法的泛化性能和鲁棒性;且航拍图像拍摄时的飞行高度从1000 m~7000 m 不等,涵盖了中空无人机的绝大多数飞行高度,利于从尺度层面测试匹配算法提取特征的尺度不变性;无人机在采集图像过程中,姿态角在时刻变化,其中航向角变化尤为剧烈,可测试匹配算法提取特征的旋转不变性。

不同地理场景下中空无人机航拍图像如图6 所示。

图6 不同地理场景航拍图像Fig.6 Aerial images of different geographic scenes

4.2 正射校正对视觉定位的影响

航拍图像和商业地图之间的视角差异过大,如果不对航拍图像进行航向角粗正射校正,则会极大程度降低匹配精度和TOP1 正确率。正射校正过程中主要有四个参数:航向角、俯仰角、横滚角、相机焦距。其中,相机焦距误差会作用在尺度误差上,后续章节会分析尺度误差,因此这里不分析焦距误差对视觉定位的影响。以序号3 的数据为例,其中特征点置信度阈值设为0.2、匹配阈值设为0.8、尺度默认是理想值,实验研究不同姿态角误差对视觉定位的影响如表2 所示。

表2 姿态角参数对视觉定位的影响Tab.2 Influence of attitude angle parameters on visual localization

其中,第一组实验为对照组,实验组1、2、3 分别在正射时不使用俯仰角、横滚角和航向角;实验组4和实验组5 正射时三个参数均使用,但航向角分别存在标准差为10 °和30 °的噪声。从表2 中分析得出:不使用航向角进行正射时对TOP1 正确率影响最大,但是航向角误差对TOP1 影响较小、对东向、北向位置均方根误差(RMSE)基本没有影响,说明可降低对惯导等提供航向角仪表的精度要求。

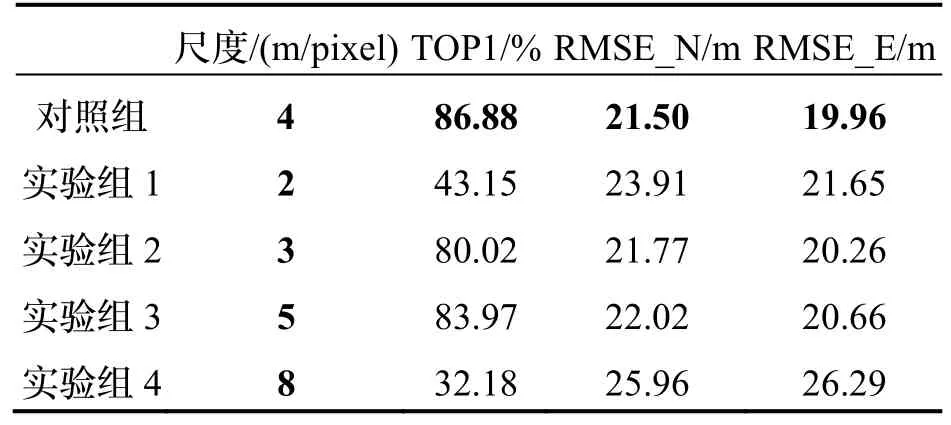

4.3 尺度误差对视觉定位的影响

由于中空无人机的高度时刻变化,导致正射图尺度与商业地图相差较大,商业地图的尺度在获取时即可确定,正射图的尺度系数定义如下:

其中,d为像元尺寸,f为相机焦距,h为无人机相对于地面的相对高度,scale表示正射图预设尺度,单位为m/pixel。

为了定性分析尺度对视觉定位的影响程度,基于序号1 的数据进行尺度误差分析试验,假设正射过程不存在误差,初始条件:基准图尺度为4 m/pixel,特征点置信度阈值为0.2,匹配阈值为0.8,正射图尺度误差对视觉定位的影响如表3 所示。

表3 尺度对视觉定位的影响Tab.3 Influence of scale on visual localization

分析表3 可知:当正射图的尺度与商业地图尺度相差小于2 倍时,TOP1 正确率小幅降低,匹配精度基本不受影响,说明本文方法具有良好的尺度不变性。

4.4 对比测试分析

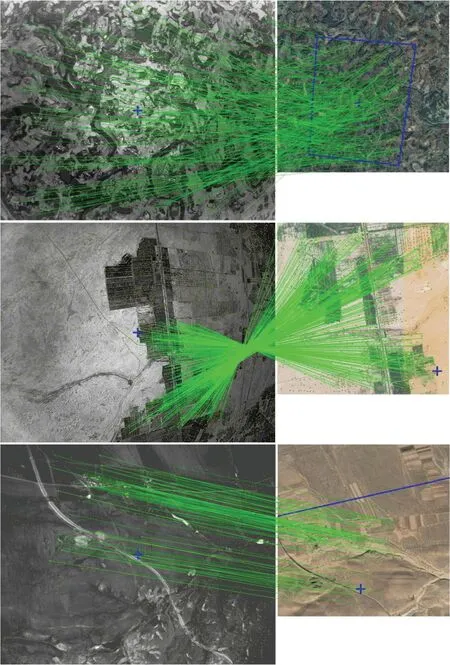

为验证本文方法的有效性,与传统基于HOG 特征的模板匹配算法进行对比测试。图7 是本文方法得到的匹配结果,其中左边大图为中空无人机航拍图像,右边小图为商业地图。

图7 本文方法匹配导航示意图Fig.7 Illustration of navigation matching using the proposed method

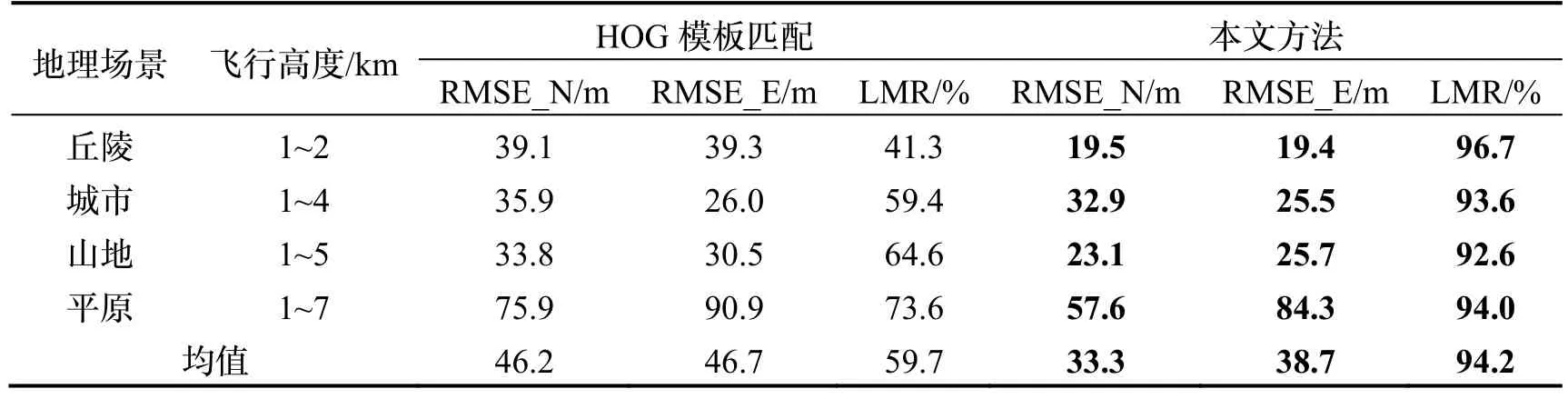

基于自制的中空无人机真实飞行数据集UAV-Dataset,从RMSE 定位误差和稳定定位匹配率(Located Match Rate,LMR)两个角度出发对比分析二者效果。野点阈值设置为80 m,本文方法和传统基于HOG 特征的模板匹配方法的误差对比结果如表4所示。

表4 HOG 模板匹配与本文方法对比Tab.4 Comparison between template matching of HOG and the method in this article

从对比结果来看,在1000 m~5000 m 高度范围内,HOG 方法的RMSE 约为20 m+0.5%H,LMR 低于65%;本文方法的RMSE 优于15 m+0.5%H,LMR 在92%以上。本文方法的定位精度和LMR 均优于HOG 方法,分别提高了25%和40%。

LMR 定义如下:

其中,n为定位距离小于某一阈值的定位点个数,dis为定位误差(单位m),thresh为定位距离野点阈值(单位m),NLocated为匹配成功总数。

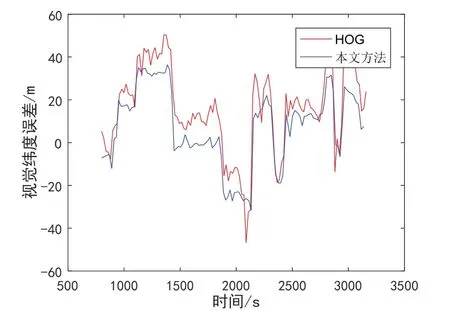

基于序号3 数据,本文方法与基于HOG 特征的模板匹配方法的位置误差对比结果如图8 和图9 所示。

图8 北向位置误差对比Fig.8 Comparison of north position error

图9 东向位置误差对比Fig.9 Comparison of east position error

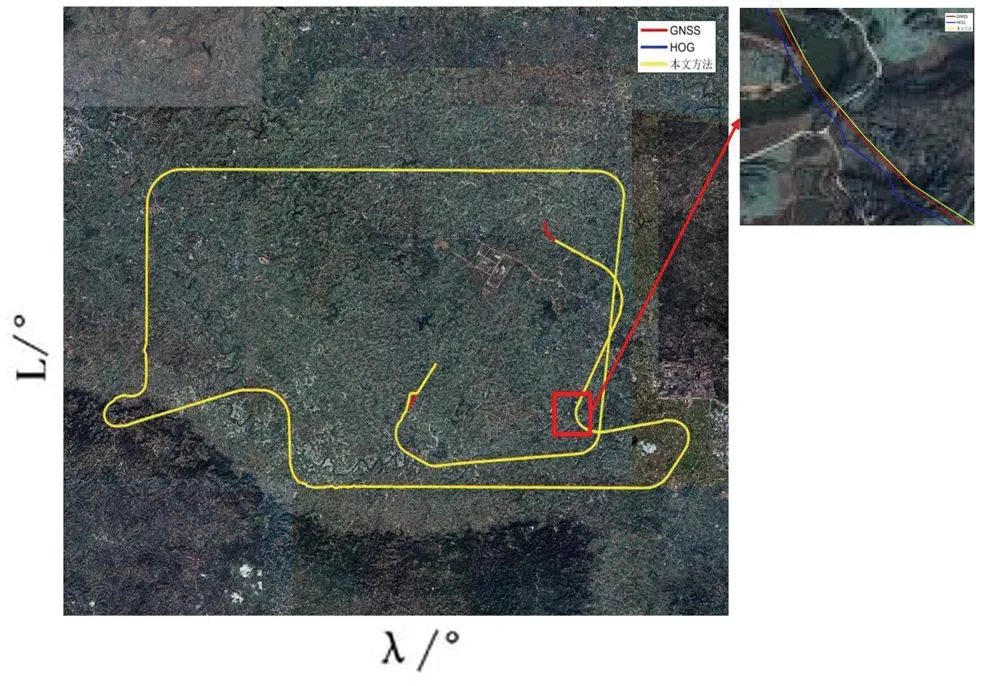

基于序号3 数据,本文方法与基于HOG 特征的模板匹配方法、GNSS 的二维轨迹对比如图10 所示。

图10 二维轨迹对比图Fig.10 2D Trajectory comparison

相比HOG 模板匹配方法,本文提出方法的二维轨迹曲线与GNSS 轨迹曲线高度吻合。

5 结论

本文针对卫星拒止条件下无人机视觉定位存在大视角、多尺度、定位精度差等问题,提出了一种基于深度特征正射匹配的无人机视觉定位方法。主要贡献如下:提出了一种结合SuperPoint+SuperGlue 网络的正射匹配导航算法,并分析了航拍图像的不同预处理方法对TOP1 正确率和无人机视觉定位误差的影响;采集并整理了中空无人机在多种地理场景(城市、丘陵、山地、平原等)下真实航拍数据和对应的商业地图数据,采用自动标注的方式计算航拍图像在商业地图上的像素坐标,将其制作为数据集,命名为UAV-Dataset;与传统基于HOG 特征的模板匹配方法进行对比测试,本文方法的定位误差优于15 m+0.5%H(5000 m 以下),稳定定位匹配率优于92%,验证了本文方法的有效性。