基于PigsTrack 跟踪器的群养生猪多目标跟踪

2023-11-26张丽雯朱启兵

张丽雯,周 昊,朱启兵

(江南大学物联网工程学院,无锡 214122)

0 引言

规模化养殖环境下,基于视频的群养生猪个体检测和跟踪可以方便实现生猪个体行为的识别与统计分析,从而有助于生猪的精细化管理[1-2],并最终实现福利化养殖的目标[3-4]。

基于视频的多目标跟踪方法可分为基于检测的跟踪(tracking by detection,TBD)算法[5]和联合检测跟踪(joint detection and embedding,JDE)算法[6-7]两大类。TBD 算法首先利用目标检测器检测单帧视频图像中的目标,再基于卡尔曼滤波和匈牙利算法对多帧图像的目标进行关联,以实现目标跟踪;JDE 算法通过修改检测器组件以同时完成视频图像中的目标检测与身份重识别任务,从而实现目标跟踪。然而身份重识别数据集和目标检测数据集之间通常存在较大的差异性,易影响外观特征信息的准确性,导致目标跟踪精度降低。因此,相较于JDE 算法,TBD 算法拥有更高的精度。

检测器选择和跟踪策略设计是TBD 算法的两个关键环节。随着深度神经网络的发展,Faster R-CNN[8]以及YOLO 系列是目前TBD 算法中常用的检测器。其中,YOLO 系列具有更快的检测速度,能满足目标跟踪这类对实时性要求较高的场景需求。在跟踪策略方面,DeepSORT[9-11]和ByteTrack[12-13]两种策略得到了较为广泛的应用。DeepSORT 算法在SORT[10](simple online and realtime tracking)的基础上利用身份重识别(Re-ID)网络将目标的外观信息加入到匹配计算之中,以减少遮挡目标身份在跟踪过程中的频繁跳变。不同于DeepSORT所引入的外观特征匹配策略,ByteTrack 算法利用低分检测框进行二次匹配,以减少由于遮挡所导致低分框的丢弃,从而避免漏检和轨迹中断。最近提出的以观察为中心的SORT(OC-SORT[14]),针对具有相似外观和复杂运动特征的DanceTrack 数据集[15],采用自适应Kerman滤波器和遮挡恢复匹配方案,提高了对遮挡和非线性运动的鲁棒性。

生猪养殖实际场景下,群养生猪之间相互遮挡且伴随着不规则的运动[16]。在当前的主流优化跟踪算法中,ByteTrack 算法的低分框匹配机制能够有效减少由于遮挡导致的漏检问题,然而该机制会增加误检次数。OCSORT 算法的遮挡恢复匹配方案可以显著减少遮挡带来的身份跳变。但这两种算法均无外观特征匹配,在视频低帧率或卡顿的情况下容易导致目标丢失。近期研究[17]指出,外观特征匹配是解决遮挡和不规则运动问题的重要手段。然而,由于生猪的外观具有高度的相似性,现有的基于卷积的身份重识别网络往往难以获得具有良好区分特性的目标外观特征。

为进一步优化实际场景下针对群养生猪的多目标跟踪方法,本文提出了PigsTrack 跟踪器。该跟踪器从检测,嵌入和关联三个方面进行改进,首先利用高性能检测器YOLOX 减少遮挡场景下的猪只误检与漏检率;其次构建基于Transformer 模型的身份重识别(Re-ID)网络以提取具有良好区分特性的目标外观特征;接着基于OCSORT 的思想,通过集成外观特征匹配、IoU 匹配和遮挡恢复匹配策略实现群养生猪的准确跟踪;最后利用双流3D 卷积网络(SlowFast[18])对PigsTrack 跟踪器获得的跟踪结果进行了典型行为统计,表明基于PigsTrack 跟踪器群养生猪个体行为统计更为准确。

1 PigsTrack 跟踪器框架

图1 为PigsTrack 跟踪器的整体架构。首先,在检测阶段,将视频中的每一帧输入到YOLOX 目标检测器中生成检测框;在跟踪阶段,利用特征提取网络提取当前检测框和轨迹预测框的外观信息,实现特征匹配;为了实现更加稳健的跟踪,在IoU 匹配的基础上,增加了利用未匹配轨迹最后检测框的遮挡恢复匹配;在利用跟踪的三步匹配获得连续帧图像的轨迹框后,输出视频序列结果。

1.1 YOLOX 目标检测

检测器YOLOX 以YOLOv3-SPP 结合Darknet53(即CSPDarknet53)为基线,集成了无锚检测器,SimOTA(简化OTA)标签分配策略和解耦头等特性。具体结构如图1 所示。

在YOLOX 中,采用 CSPDarknet53 作为骨干特征提取网络,PAnet 结构用于特征的上采样和下采样,以实现特征融合。从中获得3 个不同尺度的特征输出层,每个层在分类器和回归器中获得3 个预测,预测特征层中每个特征点是否存在1 个目标、目标的类别和目标的位置参数。输入图片经过预处理之后,通过主干网络与特征金字塔提取特征,通过检测头进行检测与分类。将3个分支的预测结果堆叠后,经过NMS 后处理输出最终结果。为了防止检测到指定猪圈外的猪只,原始视频中的每帧图像进行掩码处理;掩码处理后的图片尺寸调整为800×1 440 像素,并采用Mosaic 和 Mixup 数据增强操作。

1.2 外观特征提取

当检测器确定目标的位置和大小之后,将从原始输入图像中截取目标图片,并将其输入到外观特征提取模块中,以获得物体在图像中的外观特征信息。

此前,基于卷积的身份重识别网络OSNet(Omni-Scale Network)常被用于多目标跟踪的外观特征提取任务[19]。然而,基于卷积的特征提取方法存在两个局限性:首先,由于卷积核的限制,不能学习大范围的空间结构特征;其次,CNN 的降采样会导致细节特征丢失,使得相似目标匹配失败。而Vision Transformer (ViT)[20]引入了多个注意力机制,使模型能够关注试验对象的不同部位,此外,通过去除降采样和卷积,ViT 能够保留更详细的信息,有利于获取具有良好区分特性的目标外观特征,有效弥补了卷积方法存在的缺陷。

本文基于Transformer 模型的身份重识别网络来提取外观特征,网络结构如图2 所示,将输入图片(224×224 像素)切片分成196 个16×16 像素大小的图像块,再将图像块序列利用线性投影映射到D维。在D维向量之前加入一个向量Xclass,对应的输出表示全局特征。通过添加可学习的位置嵌入P来表示图像块序列的空间信息,通过使用L个变换器层来学习外观特征。

监督学习部分利用表征学习与度量学习结合的方式,即结合分类损失和三元组损失(triplet loss)来共同优化特征[21]。在训练过程中,对变换器层后提取的特征使用基于难样本挖掘的三元组损失作监督训练,再对全连接层整合后的特征采用基于标签平滑的交叉熵损失函数进行监督训练。

1.3 数据关联方法

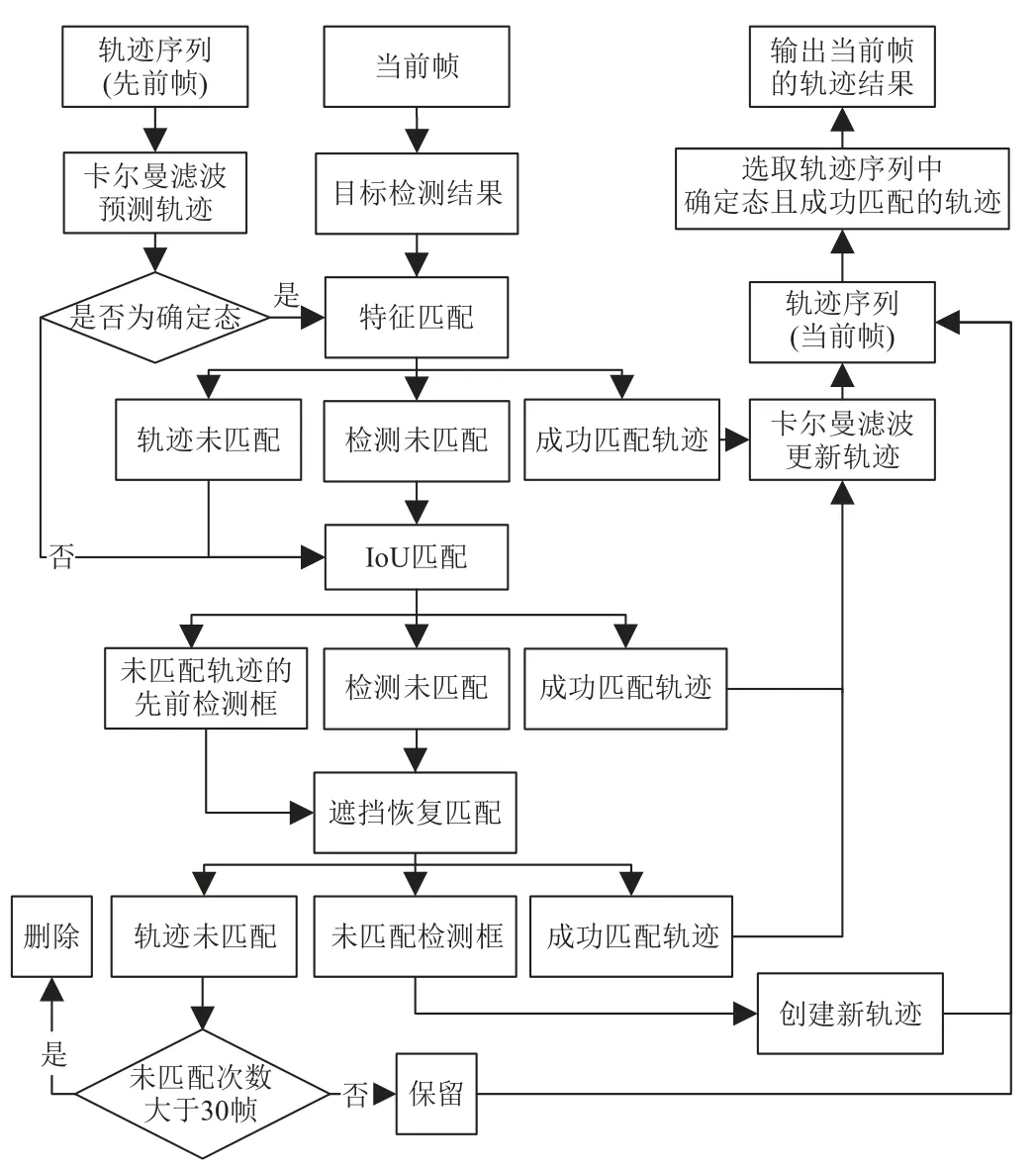

PigsTrack 跟踪器采用三步匹配的稳健跟踪策略,流程图如图3 所示。

图3 PigsTrack 的三步匹配算法流程图Fig.3 Flow chart of PigsTrack's three-step matching algorithm

通过先前帧的轨迹序列,进行卡尔曼滤波预测当前帧的轨迹。再对轨迹预测框与检测框依次进行跟踪的三步匹配,具体步骤如下:

首先,轨迹初始化为未确认态,满足连续3 帧都成功匹配,将未确认态转化为确认态,第一次匹配在确定轨迹和检测结果之间进行,通过特征提取网络提取预测轨迹框和检测框的外观特征计算得的余弦距离作为相似度;第二次匹配在不确定轨迹加上第一次未匹配轨迹和未匹配检测框之间进行,通过框与框之间的交并比(intersection over union,IoU)计算相似度;第三次匹配是遮挡恢复匹配,在未匹配轨迹的最后检测框与未匹配检测框之间进行,利用IoU 计算相似度。当检测丢失(检测器漏检或遮挡)或非线性运动时轨迹中断,轨迹预测随着时间增加而逐渐偏离轨迹框,第二次匹配将会失效。于是第三次匹配的作用在于一旦一个轨迹在第一次匹配(外观相似导致匹配失效)和第二次匹配阶段后仍未被跟踪时,就将这个轨迹的最后一次检测框关联到新的时间步长上的检测框。这个过程是局部的,自发式的,可以处理对象在合理的时间间隔内漏检或被遮挡的情况。

三次匹配均采用匈牙利算法完成基于相似度的匹配。在遮挡恢复匹配中,经历第二次IoU 匹配之后,如果仍有轨迹未被跟踪,尝试将该轨迹的最后一个检测值与新的下一个时间步长上的检测值相关联。通过将轨迹的最后检测值与新检测值关联来恢复对象,这个过程可以处理对象在合理的时间间隔内停止或被遮挡的情况。

三次成功匹配的轨迹,都进行卡尔曼滤波更新,并对轨迹的状态和特征进行更新。使用指数移动平均(exponential moving average,EMA)的方式来对成功匹配轨迹的外观特征进行更新,使用前一次EMA 特征与当前的检测特征做融合操作[22]:

最后,对3 次仍未匹配轨迹判断其距离上次更新的间隔帧,当间隔帧小于30 帧时则对轨迹保留,否则将在轨迹序列中删除该轨迹。利用成功匹配并且是激活态的轨迹的边界框和标识输出当前帧的轨迹结果。

2 数据与评价指标

2.1 数据集

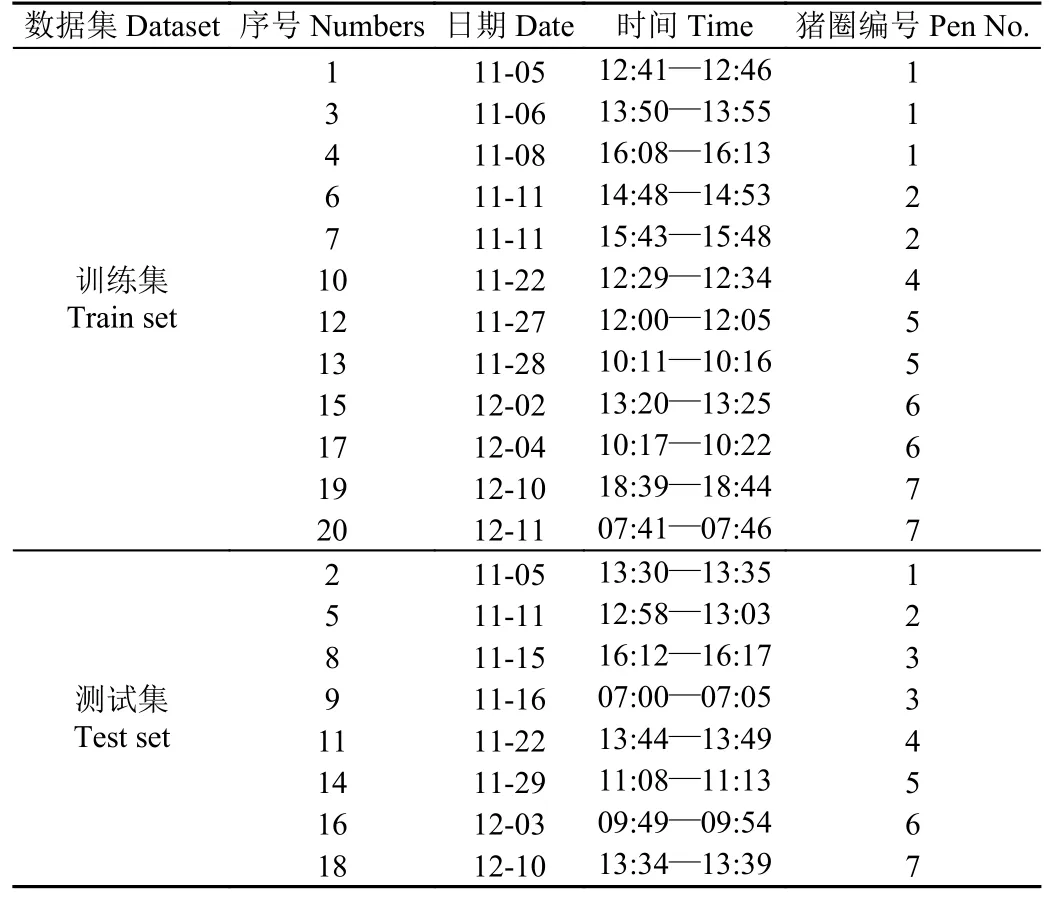

本文利用PBVD(pigs behaviours video)数据集[23]来验证所提方法的性能。PBVD 数据集收集了8 个猪圈(每个猪圈8 头猪)的视频数据,数据涵盖了6 周(2019 年的11 月5 日至12 月11 日),采集时间为7:00—19:00。每个视频固定拍摄一个猪圈,视频图像分辨率为1 280×720,采集帧率 6 帧/s,每个视频的采样长度为5 min。本文从原始PBVD 数据集中选择20 个视频(共36 000 帧)组成数据集,数据集中挑选了涵盖不同时间段、饲养猪圈的12 个视频数据用于训练,8 个视频用于测试。训练样本和测试样本的数据描述详见表1。本文使用DarkLabel 工具进行标注并整理了目标检测数据集和猪身份重识别数据集。

表1 视频数据集Table 1 Video datasets

2.2 试验环境

本文试验的硬件配置为Intel(R)Core(TM)i9-10900X CPU;64.0 GB 内存;2 个NVIDA GeForce RTX 3 090 GPU;Python-3.8,PyTorch-1.8.1,CUDA-11.3。

检测器YOLOX,以 YOLOX-M 作为主干网络,COCO 预训练模型作为初始化权重。利用随机梯度下降法(Stochastic Gradient,SGD)进行优化,动量为 0.9,权重衰减为5×10-4。初始学习率为10-4,批处理大小为64,迭代次数(Epochs)为30。特征提取器以DeiTsmall 作为主干网络,并加载预训练权重。图像统一调整为224×224(像素)。采用 SGD 进行优化,动量为 0.9,权重衰减为10-4。初始学习率为0.005,批处理大小为64,迭代次数(Epochs)为30。训练完成后,在数据匹配时将利用网络输出一个 768 维的向量用于代表对象的外观特征。

本文模型的默认检测分数阈值为 0.3,对置信度超过阈值的检测框进行三步匹配。在特征匹配阶段,若检测框和轨迹框之间的特征相似度小于0.5,则放弃匹配。在第二与第三次匹配阶段,若IoU 小于 0.5,则不予匹配。

2.3 评价指标

本试验主要使用HOTA[24](higher order tracking accuracy),MOTA(multiple object tracking accuracy)和IDF1 得分(identification F1 score)来评估跟踪算法的质量。HOTA 能够综合检测、关联和定位三个子指标,并且均衡展现三个子指标效果。MOTA 综合考虑漏检,误检和ID 切换次数,衡量检测与跟踪的性能。IDF1 是ID准确率和ID 召回率的调和均值,相较于MOTA 更关心跟踪目标的时间长短。除了上述指标之外,一些辅助指标也被用于反映模型跟踪性能,包括:主要跟踪到的目标(mostly tracked trajectories,MT)、主要丢失的目标(mostly lost trajectories,ML)、误检的总数量FP(false positive)、漏检的总数量FN(false negative)、ID 改变的总数量IDSW(ID switches)、帧率(frames per second,FPS)。其中,HOTA、MOTA、DF1、MT和FPS 数值越高模型性能越好,FP、FN、FM、IDSW和 ML 数值越低模型性能越好。

3 结果与分析

3.1 检测跟踪模型的试验结果

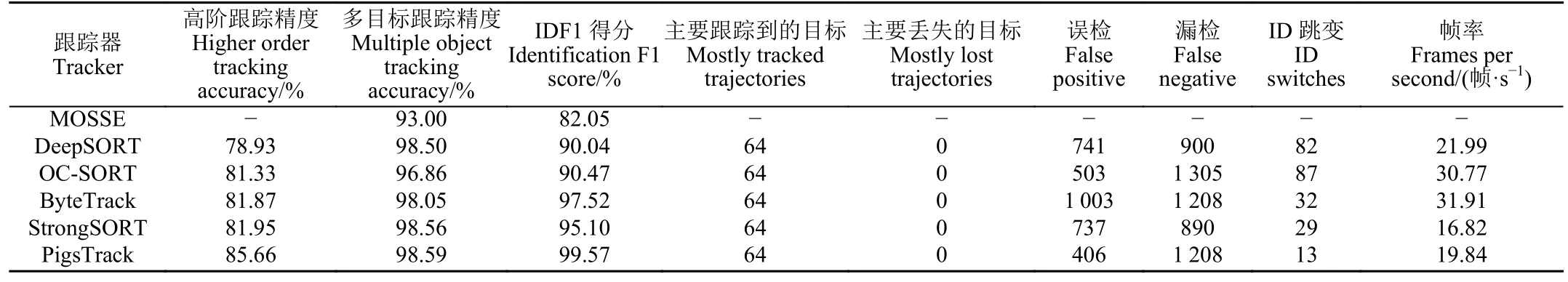

本文将PigsTrack 与其他跟踪方法进行了比较,首先是原文利用YOLOv3+MOSSE 跟踪法,测试得到结果MOTA 为93.00%,IDF1 为82.05%。其次是近期备受关注的跟踪方法:DeepSORT、OC-SORT、ByteTrack 和StrongSORT 跟踪器。其中StrongSORT 是近期基于经典DeepSORT,从检测,嵌入和关联三个方面进行了升级的跟踪器。为保证跟踪方法对比的有效性,5 种跟踪方法均利用YOLOX 进行检测。由表2 可知:DeepSORT、OC-SORT、ByteTrack 和StrongSORT 的HOTA 分别为78.93%、81.33%、81.87%和81.95%,MOTA 分别为98.50%、96.86%、98.05%和98.56%,IDF1 得分分别为90.04%、90.47%、97.52%和95.10%,而PigsTrack 跟踪器的HOTA 为85.66%,MOTA 为98.59%,IDF 得分为99.57%,较于现有算法的最高精度,提高了3.71,0.03和2.05 个百分点,为最优跟踪结果;PigsTrack 跟踪器的误检数量为406,少于其他跟踪器;PigsTrack 跟踪器的ID 改变总数量为 13,而 DeepSORT、OC-SORT、ByteTrack 和StrongSORT 的ID 改变总数量分别为82、87、32 和29 次,结果表明PigsTrack 跟踪性能稳定,跟踪对象不易跟丢,突出了三步匹配的重要性。综上所述,PigsTrack 跟踪器的跟踪性能指标优于其他跟踪算法模型,更加适用于群养生猪多目标跟踪。

表2 跟踪器的跟踪结果对比Table 2 Comparison of tracking results of trackers

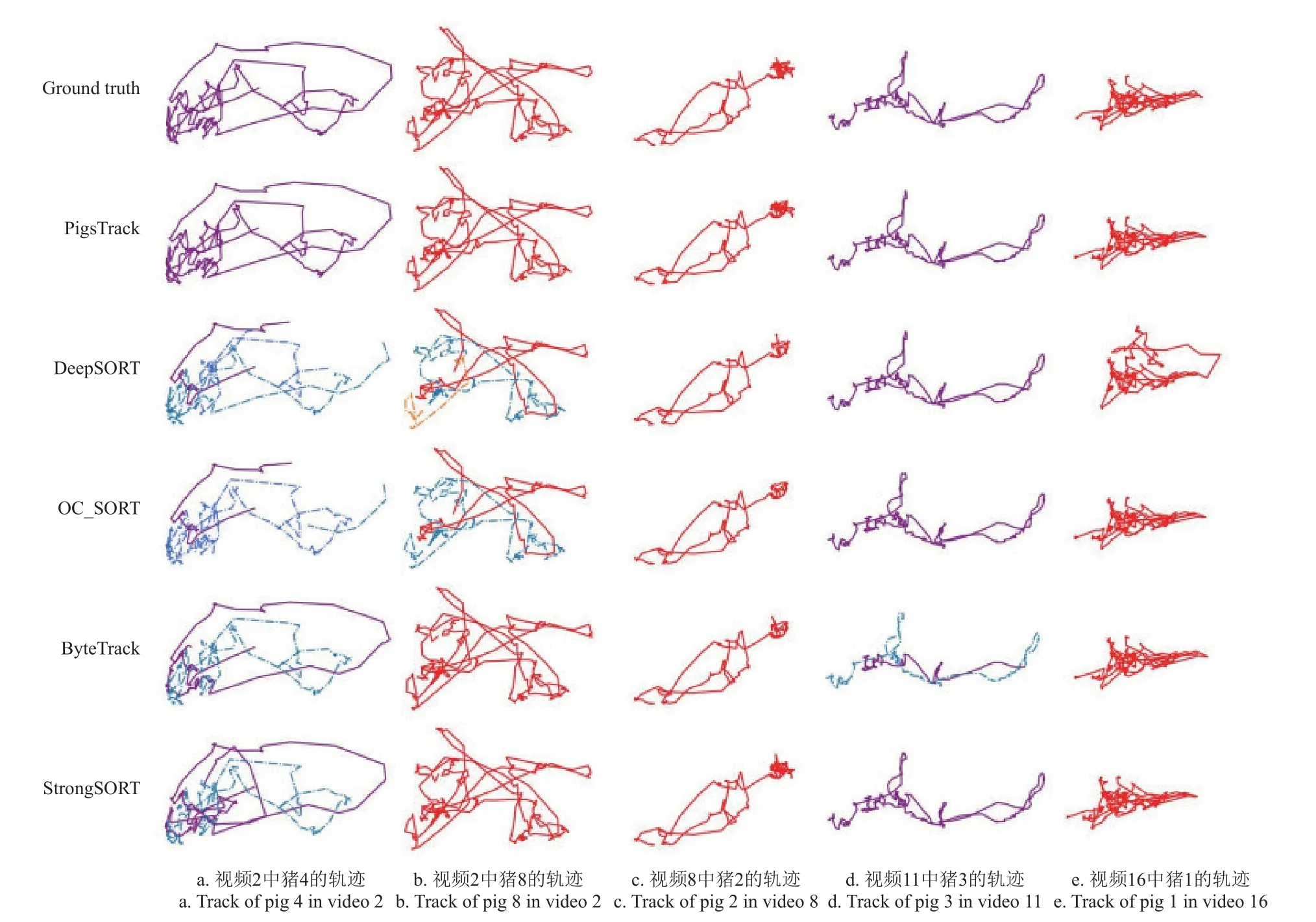

为比较本文跟踪器与其他跟踪器在实际应用时的性能差异,图4 展示了视频2、8、11 和16 中猪只的跟踪轨迹。从原始视频观察到,视频2 和8 中猪只体型较小,表现出活跃的行为;视频11 猪只体型稍大,猪只部分活动,部分静卧;视频16 中猪只体型较大,表现出较少的活动行为。图4 从左到右分别为视频2 中猪4 和猪8、视频8 中猪2、视频11 中猪3 和视频16 中猪1 的活动轨迹(真实值用实线表示,当身份跳变时轨迹用虚线表示)。

图4 跟踪轨迹图Fig.4 Diagram of the trajectory

从上到下分别为真实轨迹图、PigsTrack、DeepSORT、OC_SORT、ByteTrack 和StrongSORT 得出的轨迹图。通过观察图4a、图4c 和图4 d 可以发现,其他跟踪器跟踪的单个猪的活动轨迹部分有虚线,即ID 产生了跳变,跟踪不稳定。只有PigsTrack 能够完整跟踪单个猪的活动轨迹。此外,观察图4c 和图4e 可以发现PigsTrack 所跟踪的猪只轨迹与真实值更加吻合。综上,本文提出的PigsTrack 跟踪器准确度高,跟踪稳定,可以准确反映实际的运动轨迹。通过对运动轨迹准确绘制,可以直观展现单只猪的活力程度和健康情况,对实现猪场智能化养殖具有重要意义。

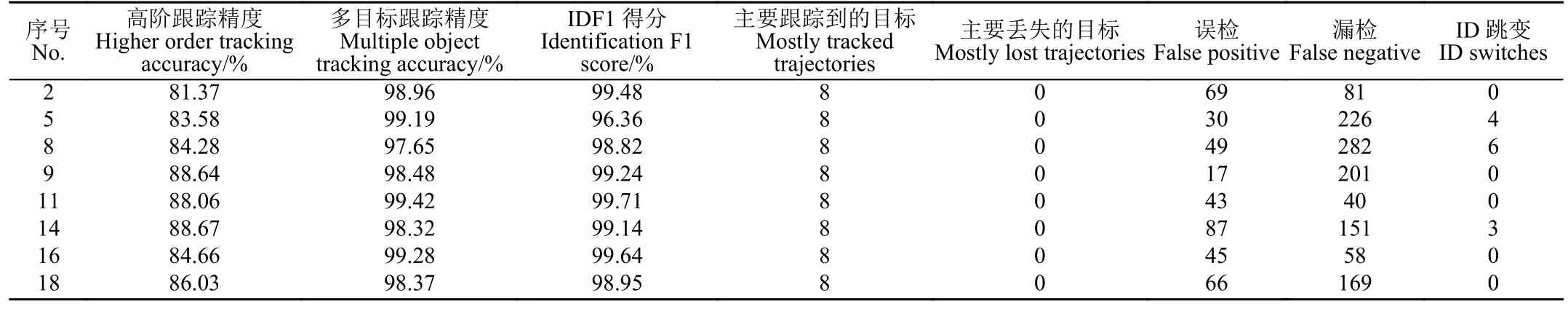

基于PigsTrack 跟踪器的测试集视频跟踪结果如表3所示。从表中可以观察到,本文使用的跟踪器在视频2、5、8、9、11、14 和18 的HOTA 均在81%以上,MOTA均在97%以上,IDF1 均在96%以上。此外,本文跟踪器的跟踪速度在单个 GPU 上测量完成。PigsTrack 的检测跟踪速度平均为19.84 帧/s,较数据集1 采集的视频帧率(6 帧/s)更快。因此当智能养殖场的物联网搭载GPU 时,PigsTrack 跟踪器可以在视频低帧率的条件下拍摄来实现在线跟踪。

表3 PigsTrack 模型的多目标跟踪试验结果Table 3 Results of a multi-objective tracking experiment with the PigsTrack model

3.2 消融试验

3.2.1 外观特征提取网络

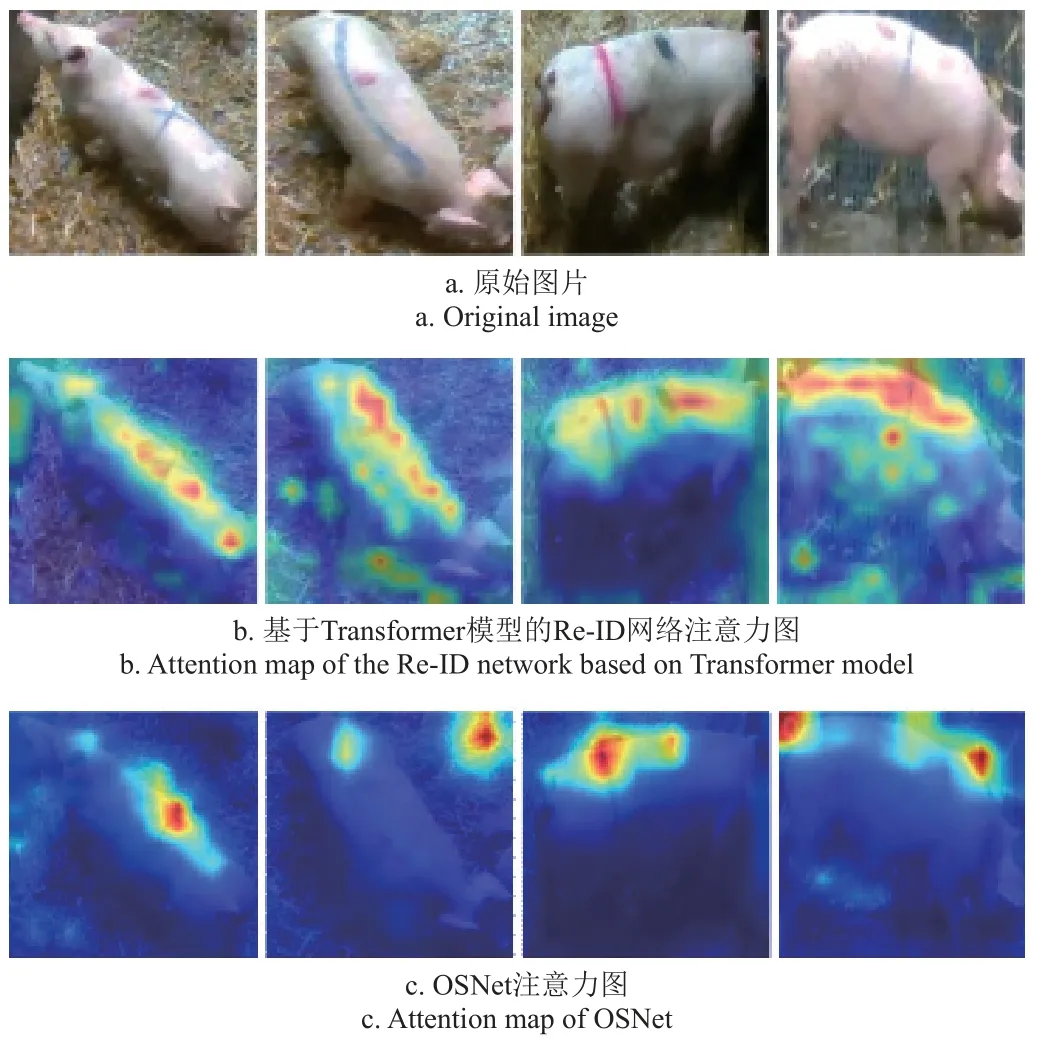

为了验证基于Transformer 模型的特征提取器对不同猪只的精准辨别优势,将其与OSNet 行人重识别网络在猪身份重识别数据集上进行了对比。

图5 展示了两个网络的注意力图可视化结果,相较于OSNet 网络。本文采用的网络可以观察到饲养猪的不同部位,保留更多的细节信息,来轻松区分对象。为了进一步验证Transformer 模型作为猪只特征提取器的优势,在PigsTrack 跟踪器中,仅将特征提取器修改为OSNet网络,此时测试集视频跟踪结果的HOTA 为81.82%,低于原跟踪器的结果,即基于Transformer 模型的特征提取器能更精准的辨别不同猪只,以此来实现准确的群养生猪的多目标跟踪。

图5 注意力图可视化结果对比Fig.5 Visual comparison of attention maps

由于PBVD 数据集中视频的帧率较低,且每个视频有2 min 的间隔时间,导致猪只的位置变化较大。为了验证PigsTrack 跟踪器能够基于外观信息长时间地跟踪猪只,选择PBVD 数据集中2019 年11 月28 日从7:00 到08:40 拍摄长达100 min 的视频进行试验。图6a~6 d 分别是PigsTrack 跟踪结果视频的第1 帧、第6 305 帧、第6 373 帧和第25 157 帧。

图6 利用PigsTrack 跟踪器实现长视频跟踪Fig.6 Long video tracking with the PigsTrack tracker

可以看出从第1 帧到第6 305 帧中的8 个跟踪框准确且稳定,虽然在07:37:07(第6 373 帧)时猪6 的身份ID 跳变为578,但是其余7 头猪的身份准确追踪一直到视频最后,时间为08:40:11(第25 157 帧)。结果表明,基于Transformer 模型的特征提取器使得PigsTrack跟踪器鲁棒性强、适应性好,能够实现实际饲养环境的长时跟踪。

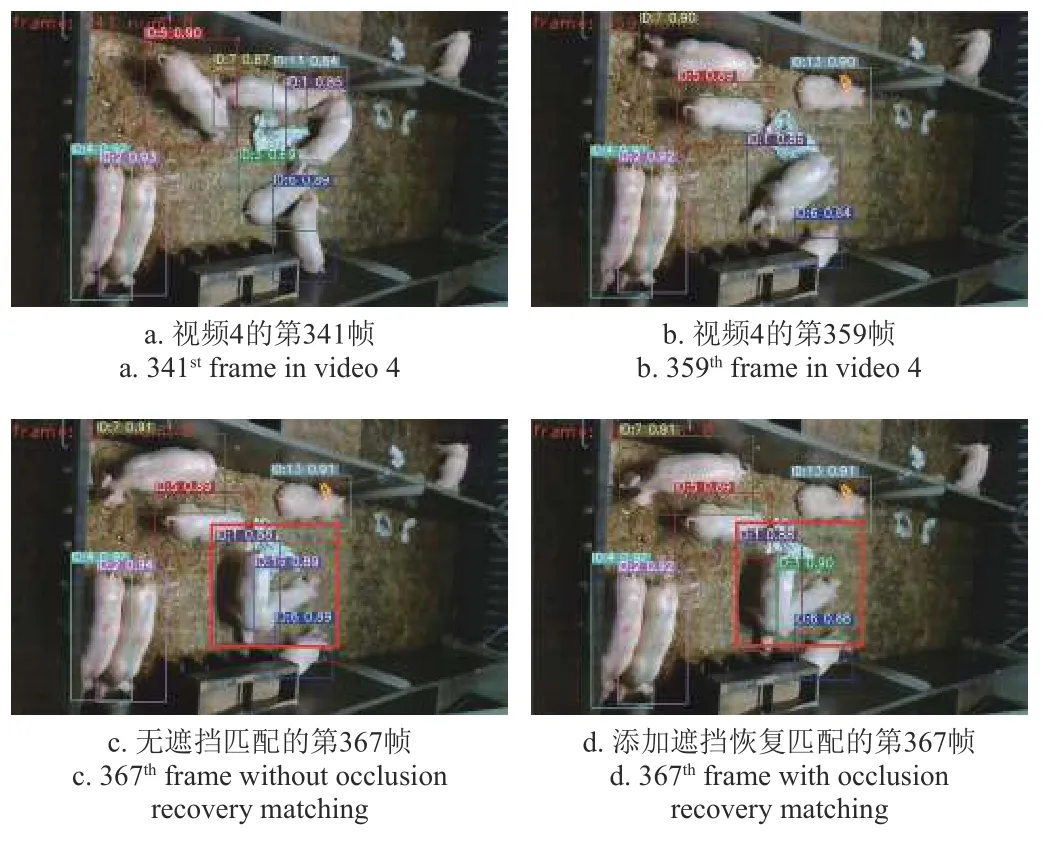

3.2.2 遮挡恢复匹配

当轨迹预测值与新检测值匹配不成功时,遮挡恢复匹配利用未匹配轨迹的最后检测值与新检测值关联来恢复对象,这个过程可以处理对象在合理的时间间隔内停止或被遮挡的情况。在测试集中,将PigsTrack 跟踪器中的遮挡恢复匹配阶段删除,其 HOTA 为84.68%,而原跟踪器的HOTA 为85.66%,因此在跟踪器中增加遮挡恢复匹配模块可以增加0.98%的跟踪效率。为了进一步验证遮挡恢复匹配的必要性,选择视频4 作为演示。由于猪只标记随时间变淡,此时视频4 中猪只的外观几乎一致,特征匹配的优势减弱。面对拥挤、遮挡环境中的猪只跟踪任务,遮挡恢复匹配发挥作用。图7a 是第341 帧,猪3 呈躺卧未被遮挡姿态,图7b 是第359 帧,猪3 被猪1遮挡消失,图7c 和图7 d 分别是无遮挡恢复匹配和有遮挡恢复匹配的猪3 在第367 帧的身份ID 展示。可以看出无遮挡恢复匹配的猪只跟踪会产生身份跳变,而添加遮挡恢复匹配的猪3 保持了身份ID。由于猪3 处于静止状态,框的位置几乎不变,这使得恢复的检测框位置能与遮挡之前的框位置保持几乎一致。因此OC-SORT 中的遮挡恢复匹配在跟踪猪圈中的猪只时具有较大优势。

图7 视频4 中猪3 被遮挡前、遮挡中与遮挡后的身份ID 展示Fig.7 Display of the identity of pig 3 before,during,and after occlusion

3.3 利用SlowFast 对生猪个体行为统计

为验证基于跟踪结果的生猪个体行为识别与统计分析的准确性,本文利用第2.1 节的数据集,标注了4 种不同行为标签:站立(猪的四只脚接触地面以支撑身体的静立行为)[25],躺卧(猪一侧肩膀直接与地面接触的侧躺,或以胸骨连同乳房接触地面的姿势卧地)[26],吃食(嘴接触料槽或饲料)[27]与饮水(嘴部接触水嘴或是水槽吸水)[28],以此来训练双流3D 卷积(SlowFast)网络。利用PigsTrack 跟踪器呈现视频17 的猪只日常行为跟踪结果如图8 所示,每一帧中的框包含猪的ID 与行为信息,图中展现了猪只的站立,躺卧,吃食与饮水行为。

图8 利用PigsTrack 跟踪器的日常行为跟踪结果展示Fig.8 Display of daily behavior tracking results with PigsTrack tracker

通过依次将PigsTrack、StrongSORT、ByteTrack 和OC-SORT 跟踪器与SlowFast 网络结合,实现猪只的跟踪与行为识别。图9a~9d 分别对测试集中个体猪的站立、躺卧、吃食和饮水行为的时间统计图,横轴代表猪只身份,纵轴代表行为的时长统计。从整体来看,PigsTrack的行为时间统计与真实值相近,优于StrongSORT、ByteTrack 和OC-SORT 跟踪器。说明PigsTrack 跟踪器的稳健跟踪将对实现生猪个体行为地准确识别更加有利。

虽然与其他跟踪器相比,PigsTrack 跟踪器能够更加准确、有效且连续地对群养生猪的日常行为进行跟踪与分析,但是通过量化结果分析,吃食与饮水行为的真实统计值为121 和55 s,而PigsTrack 跟踪器的统计结果为88 和22 s,准确率仅为72.7%和40.0%。通过结果视频分析发现吃食与饮水行为在猪只日常行为视频中样本占有量少等原因,常被行为识别网络漏检或被误检(站立行为),使得吃食与饮水行为的统计时间与真实统计时间差距较大。于是提升时空行为检测模型对猪只日常行为识别的精度这一任务将会在本研究的后续工作中实现。

4 模型泛化性验证

为了验证模型的泛化性能,本文增加ABVD(aggressive-behavior video)数据集[29]作为补充试验,此数据集记录了哈尔滨鸿福养猪场中某猪圈大白猪和长白猪混群后72 h 内的视频数据(图10),原始视频图像分辨率为2 560×1 440。考虑到ABVD 数据集视频的采样长度较短(采样长度3 s),不利于验证模型的跟踪性能,本文将原始的ABVD 视频序列根据其时间戳进行拼接,形成连续、较长时间的视频序列(长度约为30~36 s),以用于后续的研究。利用4 个视频序列(共3 658 帧)组成数据集2。数据集2 中选择2 个视频用于训练、剩余2 个视频用于测试,跟踪结果见表4。

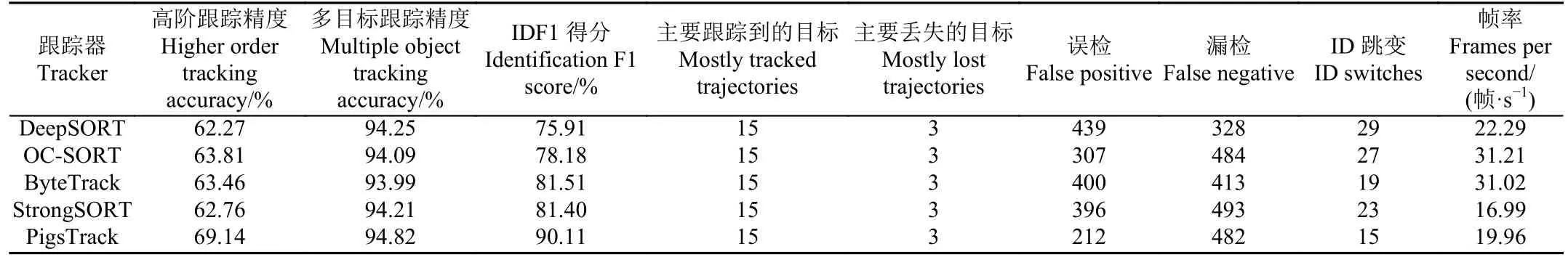

表4 跟踪器的跟踪结果对比Table 4 Comparison of tracking results of trackers

图10 ABVD 数据集的画面展示Fig.10 Display of the picture of ABVD dataset

将PigsTrack 与DeepSORT、OC_SORT、ByteTrack 和StrongSORT 跟踪方法做比较。PigsTrack 跟踪器在数据集2 中HOTA、MOTA 和IDF1 分别为69.14%、94.82%和90.11%,相对于现有算法的最高精度,提高了5.33、0.57 和8.60 个百分点。虽然均优于其他4 个跟踪器的跟踪效果,但与PigsTrack 跟踪器在PBVD 数据集中的表现相比存在一定的差距。观察结果视频得出原因:首先数据集2 中的视频拥有具有剧烈争斗行为的猪只,猪只在争斗过程中运动速度过快导致运动模糊,扭打时伴随遮挡现象[30],并且运动模式复杂;其次猪只背部无标记外观提取更加困难,最后猪圈拍摄画面不全,当猪处于边缘位置时存在漏检。最终跟踪器在跟踪时容易出现错误结果。于是若需要跟踪争斗行为的猪只,还需要将试验环境与跟踪器做进一步的优化。

5 结论

本文提出PigsTrack 跟踪器,利用YOLOX 实现对猪只的检测,并使用基于Transformer 模型的身份重识别网络提取具有区分度的外观特征,同时,还引入了遮挡恢复匹配的方法,以实现对猪只的跟踪。主要结论如下:

1)基于PBVD 数据集选择视频自制数据集来训练与测试猪场视频的跟踪效果。试验显示,PigsTrack 跟踪器在数据集上的HOTA(higher order tracking accuracy)为85.66%,MOTA(multiple object tracking accuracy)为98.59%,IDF1(identification F1 score)得分为99.57%,高于DeepSORT、OC-SORT、ByteTrack 和StrongSORT方法。PigsTrack 跟踪器的所有跟踪性能指标均优于其他跟踪算法模型。

2)通过注意力图可视化结果,验证了基于Transformer模型的特征提取器可以保留更多的细节信息,有利于提取更有区分度的外观特征,从而实现对长视频中猪只的精准跟踪。并且通过有遮挡和无遮挡恢复匹配的跟踪结果对比,进一步验证了在跟踪密集环境中的猪只时,添加遮挡恢复匹配可以带来更稳定的跟踪。

3)将PigsTrack 跟踪器与Slowfast 网络相结合,用于对视频中猪只的站立、躺卧、吃食和饮水行为进行识别。试验对比结果表明,相较于其他跟踪器,该方法能够更准确、有效且连续地识别、统计群养生猪的日常行为。

4)使用ABVD 数据集制作了数据集2 进行了补充试验,验证模型在群养生猪多目标跟踪任务中的泛化性能。PigsTrack 跟踪器的HOTA、MOTA 和IDF1 得分分别为69.14%、94.82%和90.11%,仍优于其他方法,但与PBVD 数据集相比略有差距。

因此,针对争斗行为的猪只,需要进一步优化试验环境和跟踪器。本文模型能够有效应对外观相似和遮挡交互等挑战,在跟踪稳定性、准确性和行为统计方面表现出色,为生猪养殖领域的研究和实际应用提供了有价值的指导。