面向分类网络的视觉语义解释模型

2023-11-18吕学强赵兴强贾智彬

吕学强,赵兴强,贾智彬,韩 晶

(1.北京信息科技大学 网络文化与数字传播北京市重点实验室,北京 100101;2.北京信息科技大学 机电系统测控北京市重点实验室,北京 100192)

0 概述

近年来,随着以卷积神经网络(Convolutional Neural Network,CNN)为代表的深度学习的发展,显著提高了计算机视觉相关任务的执行能力。然而,由于卷积神经网络内在的黑盒特性,解释深层CNN仍存在巨大的挑战。即使模型能产生正确的输出,也需要合理推理以防止人们对结果不信任。因此,除了性能之外,神经网络的可解释性至关重要,尤其在高风险的军事领域[1-2]。

目前,国内外研究人员提出了几种不同的深层神经网络理论和解释方法,一些综述性论文对此进行了总结[3-4]。为了理解网络学习到的特征,越来越多的研究利用可视化的方式探索神经网络。文献[5]提出的类别激活映射(Class Activation Mapping,CAM)方法,通过提取特征图与目标类别全连接层之间的权重,直接加权求和并通过归一化获得类激活图,但该方法需要调整模型结构、插入全局平均池化层以及重新训练网络,灵活性较差;文献[6]提出了Score-CAM,将每个特征图作为掩码干扰原始输入图像来获得权重并加权,以便获得最终的解释图像。但上述方法只探索了最后一层特征的感兴趣区域,对于网络如何根据这个区域进行分类并没有给出明确的解释。

在判断一张图片是哪一类的过程中,并不是所有神经元都起到了正面的作用,通过CGNIS 算法,尝试针对某一类别进行实验,找出对判断这一类别起到重要作用的神经元,进一步挖掘神经元关注区域,更加细化可视化区域的关注点。

通过观察重要神经元的关注区域,发现这些区域多为某个物体关键部位,但该部位的概念具有一定的主观性。神经网络只是对图像背后像素点数值特征进行学习,把拥有相似特征的图片归为一类,此过程并不能使人理解,人类则是通过图像中表达的各种信息理解图像,倾向于用文字描述图像[7]。因此,尝试模拟人对物体的分类过程,将这些部位的视觉特征转换成语义特征,使解释网络的判断过程更符合人的思维。为了让转换过程更加客观,设计一个新的网络,将各个重要神经元关注的区域进行标注训练,使网络可以得到语言化的结论。该网络融合目前较为主流的残差思想和多尺度思想,提出简化Inception 残差模块(Simplified Inception Residual Module,SIRM),将网络中间层的3×3 卷积替换掉,使网络可以获得更多的特征。同时该算法在网络中采用有效通道注意力机制(Efficient Channel Attention,ECA)[8],提高了算法性能,并在重要神经元类激活图分类的任务中表现出良好的泛化能力。在得到重要神经元的语义特征后,结合其视觉特征以及CGNIS 获得的对应权重,可以生成解释性语句,对分类网络的判定过程进行更好的诠释。

综上所述,本文提出一种面向分类网络的视觉语义解释模型。综合考虑前向与反向传播,提出CGNIS 算法获取分类过程对结果重要的神经元。在得到重要神经元的基础上,采用类激活图映射的方式生成重要神经元关注区域,完成从抽象的数学特征到视觉特征的转换。随后尝试将得到的视觉特征转换成语义特征。为了保证转换过程的客观性,设计一种图像分类网络——IRENet,在VGG16 网络中间层添加简化Inception 残差模块与有效通道注意力机制,将分类结果视为重要神经元的语义特征,并将各个重要神经元的权重信息、视觉特征、语义特征相结合生成解释性语句。

1 相关工作

1.1 基于反向传播的视觉解释方法

基于反向传播的视觉解释方法通过计算特定类别相对于输入梯度的预测得分,将可视化的解释结果作为每个像素对预测结果的重要程度,文献[9]提出的可视化和理解卷积网络方法是这种思路的代表方法,由于反向传播产生的误差,使得上述方法效果不佳;文献[10]通过积累落在图像距离向量上图像梯度的方式来克服由于不连续梯度的存在以及梯度弥散消失产生的误导作用;文献[11]在输入图像上进行多次加噪处理,再对多个噪声样本的解释结果图像进行平均,降低解释结果图像的噪声;文献[12]引入导向系数,使其在计算反向传播时只保留正梯度;文献[13]提出全梯度的概念,将中间层偏差梯度和输入梯度结合,得到最终的解释结果。基于反向传播的解释方法计算速度相对较快,且可以获得高分辨率的解释结果图,但其结果通常存在噪声,很难确定哪些像素在预测时发挥了重要作用。

1.2 基于类激活图映射的解释方法

基于类激活图映射的解释方法通过特定方式计算出特征图对应的权重信息,并对特征图进行加权求和获得最终的解释信息。CAM[5]方法通过提取特征图与目标类别全连接的权重,直接加权求和并归一化获得类激活图,但该方法需要调整模型结构、插入全局平均池化层和重新训练网络,灵活性较差;文献[6]提出的Score-CAM 方法将每个特征图作为掩码干扰原始输入图像获得其权重并加权,以便获得最终的解释结果图像;此外,Ablation-CAM[14]以及Salience-CAM[15]也取得了不错的效果。文献[16]提出权重向量的二步优化方式,第一步尽量缩短原始图像与干扰图像的特征间距,第二步提高对干扰图像的估计得分。此外,类激活映射的方式还可以与反向传播方法(如Guided back propagation)相结合,获得效果更好的解释性图像。上述方法获得权重的方式不同,其计算速度和解释图噪声也不尽相同,且方法倾向于激活图像中某一个重要区域[17],往往忽略其他可能存在的重要区域。

本文提出的模型利用类激活图首先获取网络关注的整体视觉特征,然后结合前向与反向传播寻找重要神经元,获取重要神经元的关注区域,将整体视觉特征细化为局部视觉特征,最后将局部视觉特征转换成语义特征。

2 视觉语义解释模型

本文首先提出CGNIS 算法,综合考虑前向与反向传播获取对分类结果起重要作用的神经元,并利用CAM 将重要神经元的关注区域映射到原图,获取更加细化的视觉特征。然后提出IRENet 网络,更加客观地将视觉特征转换成语义特征。最终结合重要神经元权重、视觉、语义等信息生成解释性语句。具体结构如图1 所示。首先将图片送入训练好的分类网络,获取分类网络在分类过程中的数据,然后经过CGNIS 算法计算最后一层特征图中对分类过程起到重要作用的神经元,并保留权重信息,利用CAM 提取视觉特征,随后将特征送入IRENet 中,提取机头、机身等语义信息,最后将权重信息、视觉信息、语义信息生成解释性语句。下文将详细介绍重要神经元视觉特征和语义特征提取。

图1 视觉语义解释模型Fig.1 Visual semantic interpretation model

2.1 重要神经元视觉特征提取

2.1.1 基于前向与反向传播的重要神经元获取方法

图像分类是将输入图像经过卷积和池化操作,提取特征向量并将特征向量传入全连接层中得到分类结果的过程。在前向传播中,每个神经元都或多或少地对分类结果造成影响,神经元提取的特征越重要,该神经元对网络的影响越大。同时,反向传播也体现出神经元存在一定依赖程度:即第l+1 层的每个神经元误差和第l层每个神经元相关,如误差的20%由导致,50%由导致,30%由导致,这些值是连接的权重值,在反向计算误差时,第l层每个神经元将对应的误差值成比例地推向前一层,且比例越大,对应的神经元对当前神经元的影响越大。基于此观点,提出一种基于前向传播与反向传播的重要神经元获取方法,首先采用置信度思想,利用前向传播获取高层卷积的重要神经元信息,然后利用链式求导法反向推导出高层卷积层每个神经元的重要程度,将两者按位相乘得到最终的分数。

此方法对分类网络普遍适用,本文仅以VGG16网络为例进行分析。文献[18-19]的研究表明,最后一层卷积识别特征最多且此卷积对最后的分类也最重要,所以CGNIS 算法主要挖掘高层卷积的重要神经元。

给定一个训练好的VGG16 网络,利用CAM 算法得到最后一层卷积的置信度,其结果是一个512 维的向量,分别对应最后一层每个神经元在前向传播过程中的重要程度。

本文从结果出发,反推输出层对结果的影响,综合评判置信度分数。VGG16 网络具体计算公式的推导过程如图2 所示。

图2 VGG16 CGNIS 网络推导过程Fig.2 VGG16 CGNIS network derivation process

经过VGG16 第18 层的卷积核池化操作后可获得7×7×512 的特征图,将其转化为25 088 维的向量以便作为全连接层的输入,该过程输出为a18:

其中:w、a、b分别表示权重、输入值、偏置。

最后输出层采用Softmax 激活函数,如式(3)所示:

得到分类结果后,利用反向传播推导出高层卷积层每个神经元的重要程度。

首先该网络采用交叉熵损失函数,如式(4)所示:

其中:aL是输出层的激活向量;y是样本标签向量;i为神经元数。

其中:zL表示当前层的输入值。

然后根据链式求导法则,计算出第l个隐含层第j个节点的反向传播误差,得到第l个全连接层的反向传播误差公式如式(6)所示:

当反向传播传到第19 层时,会存在由全连接层到池化层的反向传播误差,如式(7)所示:

其中:F-1表示全连接的逆运算;δ18为第18 层的池化层。

由δ18推导第18 层的反向传播误差时,对于最大池化,需要上采样将δ18中每个通道的元素放在之前前向传播最大值处,其他元素值设置为0。反向传播公式如式(8)所示:

算法1 描述了实现整个算法的全部细节。

算法1CGNIS 算法

2.1.2 重要神经元视觉特征区域裁剪

第2.1.1 节获得对分类结果起重要作用的神经元,本节将可视化神经元的关注区域,通过借鉴类激活图的方式将神经元映射到原图,实现细化关注点的目的。具体来说,利用全局平均池化层将输出层中某个类别标签所对应的权值映射到前一层卷积特征图上并重复多次,得到每个通道卷积特征图对输出结果的重要性,并将每个卷积特征图线性相加得到整体类激活图。该图大小与原始图像相同,且像素取值从0 到1,其取值越大表示原始图片对应区域对网络的响应越高,贡献越大。而在本节中主要提取最后一层卷积特征图的类激活映射图,以获得某个重要神经元的视觉特征,不需要进行最后线性相加操作。

为了提取更具判别性的局部视觉特征,对映射区域进行裁剪,首先设置超参数阈值θ1,然后对神经元计算其所需的掩码,如式(10)所示:

其中:A表示上采样后的神经元类激活图;(i,j)代表像素点的位置;M代表处理后的特征图。

令xmin和xmax分别表示M中值为1 的横坐标的最小值和最大值,ymin和ymax分别表示M中值为1 的纵坐标的最小值和最大值。根据这4 个坐标即可定位出当前神经元的关注区域。若X为原始输入图像,高和宽分别为h和w,p为填充尺寸,则所需裁剪的区域边界框坐标的计算公式如式(11)所示:

在确定出裁剪区域后,将处理好的卷积特征图与原图相乘并裁剪对应区域,如式(12)所示:

最后将裁剪后的图像上采样到原始图像尺寸。对于卷积神经网络来说,图像的分辨率越大,提取的特征越丰富,模型效果的上限也就越高;将裁剪后的图像上采样为原始图像尺寸,可以作为统一输入图像,添加对比实验证明提出网络的可行性与优越性。图3 所示反映了针对某张飞机图像生成整体类激活图,某个神经元的掩码、裁剪并上采样生成扩充图像的过程和结果。

图3 神经元映射区域裁剪和生成流程Fig.3 Procedure of neuron mapping region cropping and generation

裁剪并上采样的图像代表该神经元的视觉特征,下一步尝试将此特征转换为语义特征。

2.2 隐含层重要神经元语义信息生成

采用第2.1.2 节的神经元映射方式,可以将神经元抽象的数学特征转换为关键区域的视觉特征,本节在此基础上,将这些视觉特征转换为便于人类理解的语义特征,并生成描述分类过程的可解释性语句。观察第2.1.2 节获得的神经元映射图可以发现,这些图像包含的特征较少,四周存在大量黑边,仅凭这些图像得到对应的语义特征无异于盲人摸象。针对这一问题,设计分类网络IRENet 将这些图像识别出来,从而使语义特征的生成更加客观。

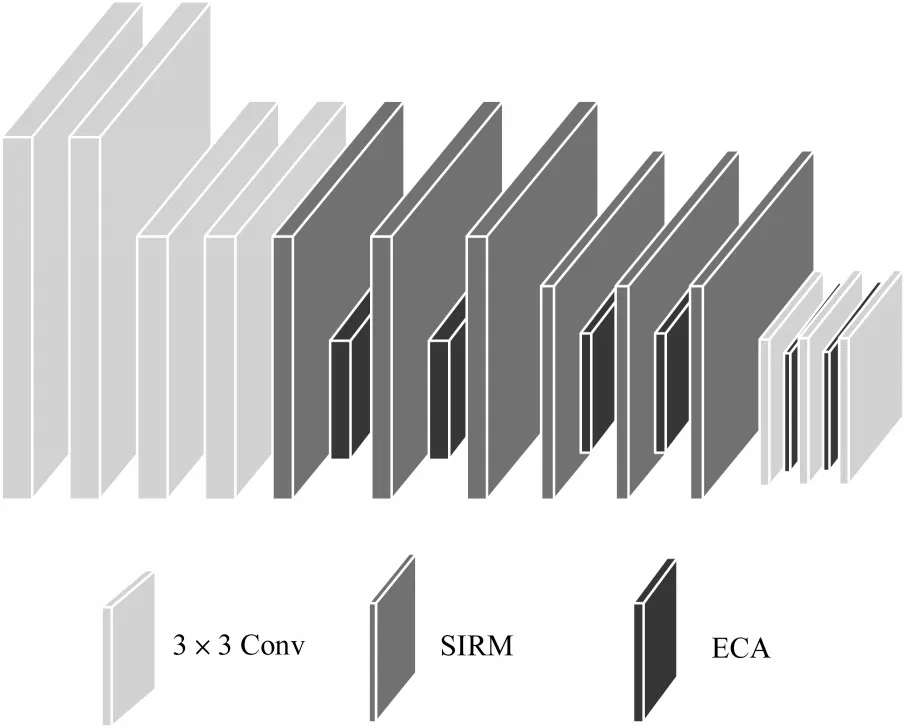

本文设计的网络基于VGG16 网络,在此基础上,融 合ResNet 和Inception 的优点,结 合VGG 网络自身易解释和可塑性强的特点,对VGG 网络进行优化。具体的网络特征提取部分结构如图4所示。

图4 IRENet 特征提取网络Fig.4 IRENet feature extraction network

网络特征提取部分将VGG16 中间层3×3 卷积替换为SIRM 模块。卷积神经网络浅层主要学习简单的特征,比如颜色、形状等[20-22]。网络在中间几层关注的特征逐渐抽象,这些复杂的特征需要较深的神经网络进行拟合,若只使用简单的3×3 卷积提取特征,可能导致关键特征丢失,对分类结果产生巨大影响。在网络的最后几层,由于感受野的降低,无须再使用多尺度特征提取,过多提取反而会降低分类准确性。所以,本文尝试改变中间层卷积模块,提高网络分类准确率。此外,本文网络还使用了有效通道注意力机制ECA,ECA 克服注意力模块为了获得较好性能忽略其复杂程度和计算量的问题,实现超轻量级注意模块,该模块可以灵活地整合到现有的CNN 架构中。

图5 所示为SIRM 模块,在理想状态下,通常假设输入图片为x,f(x) ∊Rn表示网络中某一个特定中间层的特征,网络的输出为y=D(f(x))∊Rc,c指代分类任务中类别的数量,D表示在f(x)之上的网络模块。而在真实情况下,网络中某一层特征应表示如下:

图5 SIRM 模块Fig.5 SIRM module

其中:f′表示某一层实际特征;Δf表示卷积提取时网络未关注的特征,此特征因图像信息位置存在巨大差异,难以选择合适卷积核大小而产生。信息分布分散的图像适合大的卷积核,反之则适合小的卷积核,若只是简单串联各种尺度的卷积,不仅会加深网络深度使网络更容易过拟合,还会使梯度更新变得困难,SIRM 模块采用1×1 卷积和3×3 卷积进行多尺度组合,代替原始的3×3 卷积,并且减少了多尺度分支,提高了推理速度。除此之外,该模块采用ResNet的残差思想,如图5 所示,该模块中存在两种残差结构,一种在1×1 卷积和3×3 卷积处添加残差结构,另一种在各分支融合处添加残差结构,使深层网络能够获得更鲁棒的特征表示。

IRENet 获取到重要神经元的语义特征之后,通过模板将CGNIS 得到的重要神经元权重、视觉特征、语义特征相结合,生成解释性语句,相对于CAM,更加便于理解,且语义特征可以在NLP 领域作为先验知识组成知识库,为后续的研究和应用提供便利。

3 实验结果与分析

3.1 数据集

CGNIS 算法获取重要神经元实验采用PyTorch框架提供的VGG16 模型,数据集为ImageNet2012 数据集,分类准确率为88.6%。实验在ImageNet2012 数据集中随机抽取10类图像,数据集样例如图6所示。

图6 ImageNet2012 数据集样例Fig.6 Sample of ImageNet2012 dataset

针对IRENet 进行的实验可以提取指定类别语义特征,本文只以飞机与坦克为例,从fgvc-aircraft-2013b和ImageNet2012 数据集中分别抽取10 000 张图片进行网络的二分类训练。

在二分类网络训练结束后,使用第2.1 节的方法获取重要神经元,找出神经元的关注区域,映射到原图并遮盖不重要的区域。最后将获取到的神经元类激活图对应原图信息进行人工标注,并对训练好飞机、坦克二分类的VGG16 网络中的重要神经元类激活图进行分类,类激活图样例如图7 所示。

图7 数据集划分样例Fig.7 Sample of dataset partition

3.2 评价指标

本文提出的IRENet 网络的有效性主要通过网络分类效果进行评估。对于分类算法的效果评估,本节使用以下4 项评价指标:即精确率(P)、F1 值(F1)、召回率(R)、准确率(ACC)。

3.3 实验环境配置

本节实验使用PyTorch 框架,在具体实验中使用随机梯度下降优化器进行模型优化,其动量设置为0.9,学习率设置为0.001。IRENet 网络模型与对比实验模型的迭代次数均为100 次。实验相关具体配置如表1 所示。

表1 实验环境配置Table 1 Experimental environment configuration

3.4 基于前向传播与反向传播的重要神经元获取方法结果分析

3.4.1 重要神经元在分类过程中的作用

实验在VGG16 网络进行特征提取的最后一层卷积使用CGNIS 算法获得神经元的重要程度,以此为基础进行探索。在神经元可视化方面,本实验将每个神经元对应的特征图与原图相乘,获得神经元的对应区域。

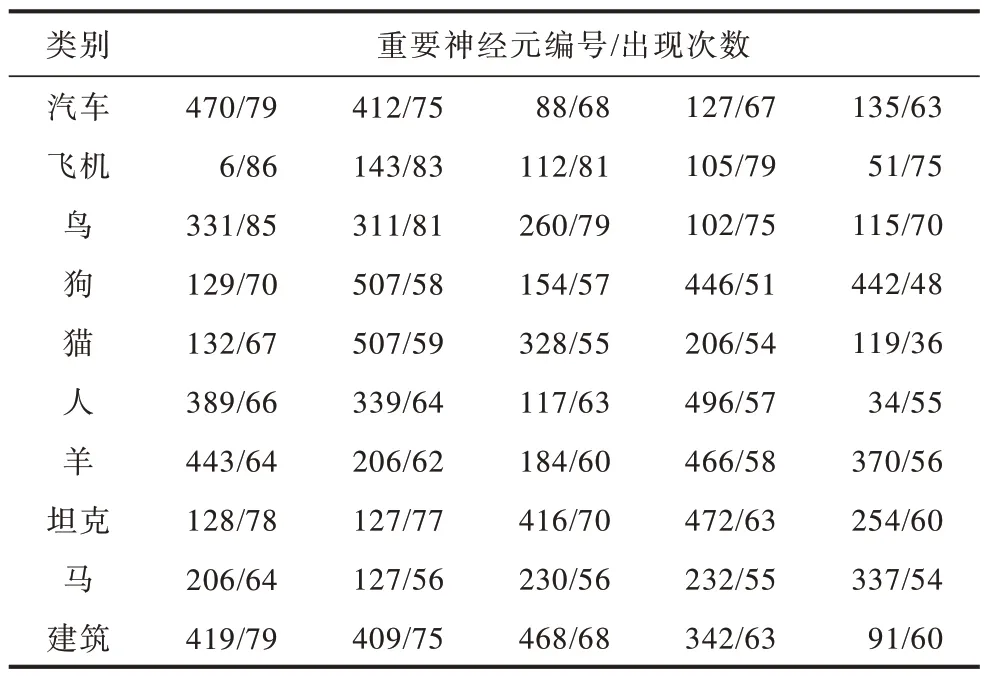

CGNIS 计算结果表明,每个类别的重要神经元会在此类图片分类过程中重复出现,本文猜测这些神经元就是对分类起到作用的重要神经元,并尝试进一步证实这个猜想。表2 展示的是“飞机”、“汽车”、“猫”等类别重要神经元出现的次数,神经元按所在层数从上到下依次编号,实验对每个类别均随机选取100 张图片,对每个图片均计算CGNIS 分数,并统计重要神经元出现的频率。

表2 重要神经元出现的次数Table 2 Number of important neuron occurrences

从表2 可以看出:对“飞机”而言,重要神经元出现次数最多的是6 号神经元;对“狗”而言,重要神经元出现次数最多的是129 号神经元。

图8 展示了每个类别重要神经元主要关注的特征。“飞机”最重要的6 号神经元,将其可视化,发现此神经元对“飞机”这个类而言,关注的特征是“机舱”。本实验还发现,对于同一类型的特征,不同种类的重要神经元也不同,比如“人”的“头部”和“鸟头”。

图8 多类别重要神经元关注区域可视化展示Fig.8 Visualization of important neuronal regions of interest in multiple categories

为了了解这些神经元是对每个类别都重要还是针对特定类别才会有较高的贡献度,本节尝试对多个类别进行实验。实验采用100 张图像,其中50 张同一类别,另外50 张不同于上一类别,每张图像获取某个特定神经元的重要程度。

图9 分别展示对飞机和坦克重要的神经元是否对其他类别也重要的实验结果,其中重要程度数值越高影响程度越大。实验结果表明,对某个特定类别最重要的神经元,在其他类别中不一定会起到关键作用。

图9 神经元对各类别的重要程度Fig.9 Importance of neurons for each category

3.4.2 重要神经元影响程度

为了深入了解这些重要神经元对网络准确率的影响,本节测试移除一些神经元对网络分类的影响。将需要测试的神经元权重设置为0,且保持其他神经元输出,实现删除神经元的效果,并不对网络重新训练,直接测试这些神经元对当前类别和整体网络的影响。

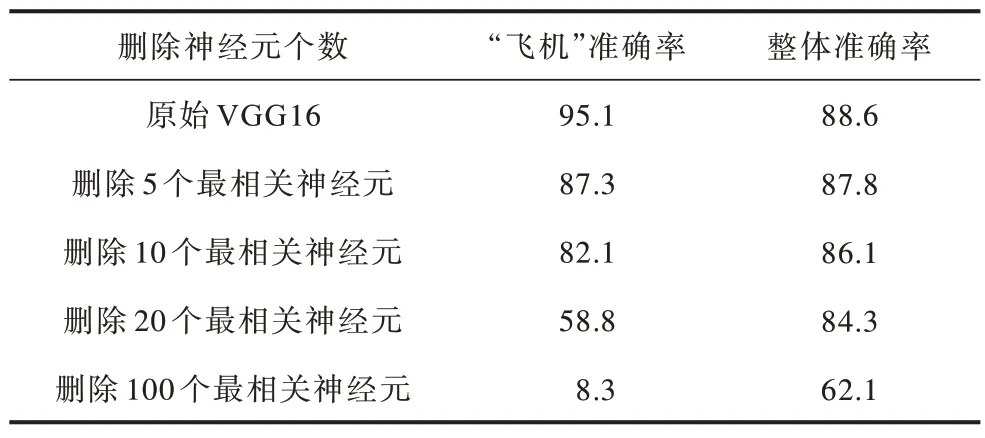

网络分类准确率的高低由神经元提取的特征是否重要决定。例如,对“飞机”这一类别,最后一层卷积的6 号神经元主要检测到的目标是“机舱”,而将该神经元删除后,网络在训练集和验证集上对该类别的图像识别准确率均有所下降,如表3所示。

表3 删除神经元后准确率的变化Table 3 Change in accuracy after deleting neurons %

在表3 中,神经元分别对应各个类别的重要神经元,当这些神经元被删除时,均会造成对应类别的准确率下降。

本节还对某个具体类别尝试去掉一些重要和不重要的神经元进行实验,观察该类别分类准确率变化。首先,将CGNIS 得分按递增和递减进行排序,前者表示重要神经元,后者表示不重要神经元,然后每次按顺序选择一定数量的神经元进行删除来判断对分类准确率造成的影响。实验结果如图10 所示,该图展示了在“飞机”和“坦克”两个类别中去掉重要和不重要神经元准确率发生的变化。从图10 可以看到,当删除一些重要神经元时,对应类别的准确率均会下降,删除的越多准确率下降的越大。然而,在删除不重要的神经元时,准确率变化不大,有时反而有所提升,说明网络在分类时受到不重要神经元的干扰。从该实验可以得出,网络仅从最重要的神经元中获得了分类的大部分性能,甚至可以通过删除最不重要的神经元达到提高单类别精度的效果。

图10 删除重要与不重要神经元对两类别准确率的影响Fig.10 The effect of removing significant and insignificant neurons on the accuracy of two categories

为了测试网络对某一类别进行分类的能力是否可以归因于这些重要神经元,删除选定的神经元集合来验证这些神经元对当前类别和整体的影响程度,如表4 所示。

表4 删除相关神经元后多类别准确率的变化Table 4 Change in multi category accuracy after removing related neurons %

从表4 可以看出,删除少量相关神经元对自身类别准确率影响较大,对整个数据集影响不大,说明CGNIS 算法确实提取到单类重要神经元。但当删掉100 个神经元时,对“飞机”的影响达到了86.8%,对整体的影响也达到了26.5%,分析得出此次整体准确率下降主要原因是移除的神经元过多,包含了其他类别中的重要神经元,从而损害网络对其他类别进行分类的能力。

从上述实验可以发现,CGNIS 算法提取到的重要神经元删除后确实对相关类的分类准确率有影响。可视化重要神经元关注区域发现,在网络分类过程中,主要依靠重要神经元对物体关键部位的学习。某个类别对应的重要神经元对其他类的贡献度很小,且删除后减少了噪声,准确率有时不降反升。当删除少量某个类别的重要神经元时,对整个数据集的分类准确率影响不大。

3.5 隐含层语义信息生成实验分析

3.5.1 语义特征识别网络IRENET 消融实验

本节采用消融实验来验证对网络中间层卷积的改进以及在高层添加通道注意力机制是否有助于提升分类准确度。首先本节在RESNET18 网络上进行消融实验,实验结果如表5 所示,对于未采用任何模块的RESNET18 来讲,无论采用SIRM 和ECA 中的任何一个模块,其实验得到的评价指标均有一定的提升,这说明这两个模块均可以作为单独方法使用。而在两个模块一起使用的情况下,网络分类的精度和单独使用相比又有了进一步的提升,这也说明了本节算法能够更加准确地学习和获取到图像的重要特征,使分类结果更准确。

表5 消融实验1 结果Table 5 Results of ablation experiment 1

同时,在IRENet 模型上做了相同的消融实验,该实验将本文提出的SIRM 模块和使用的ECA 模块单独使用,探讨这两个模块的有效性。实验结果表明,在单独使用时,两模块对神经元的类激活映射图的分类也能达到不错的效果,结果如表6 所示。实验结果表明,较单独使用其中模块的情况下,同时使用两者会使网络效果更好,这也进一步证实了提出的IRENet 网络的有效性。

3.5.2 语义特征识别网络IRENet 分类对比实验

为了进一步验证本文提出的网络对当前神经元映射区域图像分类任务的有效性与优越性,利用现有经典卷积网络算法进行对比实验。其中,使用的主流卷 积网络 框架包 括VGG16[23]、RESNET[24]、INCEPTIONNETV3[25]、MOBILENETV3[26]和EFFIC IENTNET[27]网络。分类结果如表7 所示。

表7 分类实验结果Table 7 Classification experimental results

从表7 可以看出,本文提出的IRENET 与目前已有且比较主流的分类网络相比,在相同的训练环境和参数设置下,在神经元类激活图的数据集上各项指标均有提升。IRENET 在网络中间层将3×3 卷积替换成由1×1 卷积和3×3 卷积构成的轻量化模块,使网络更加关注中间层特征并更好地获取特征,同时融入残差连接思想,使IRENET 与VGG16 和RESNET101 两个网络相比均有不错的提升。在网络分类时,IRENET 在网络高层的语义获取层以及全局平均池化层中添加通道注意力机制,使网络更加关注重要神经元的贡献,进一步提升性能。

同时,选取VGG16、RESNET101、IRENET 分别对“飞机”类别生成解释性语句进行比较,结果如图11 所示,VGG16 将机头错误分类为机尾,将机尾错误分成机身,将机翼错误分成机头,RESNET101把机头错误分成机身,IRENET 则准确地提取各个重要神经元视觉特征对应的语义特征,使生成的解释性语句更加客观。

图11 各模型生成的解释性语句对比Fig.11 Comparison of explanatory statements generated by each model

4 结束语

本文提出的视觉语义解释模型首先综合考虑前向传播与反向传播,然后给出CGNIS 算法,得到分类过程中起重要作用的神经元,利用类激活图的方式可视化并裁剪出重要神经元的视觉特征,最后提出IRENet,在VGG16 的基础上添加SIRM 和ECA,利用IRENet 识别视觉特征对应的语义特征。实验结果表明,删除CGNIS 算法得到的某一类别的重要神经元后,对应类别的分类准确率下降3%以上,在语义特征提取任务上,IRENet 的F1 值、准确率、精确率和召回率4 项指标较ResNet101 等分类网络提升2%以上。下一步将对语义提取部分进一步优化,尝试将原始数据进行更细粒度的标注,通过计算IoU达到获取语义特征的目的。