基于机器视觉的改进线束导线排序检测系统设计

2023-06-15张良安刘同鑫谢胜龙陈洋

张良安,刘同鑫,谢胜龙,陈洋

(1.安徽工业大学 机械工程学院,安徽 马鞍山 243000;2.中国计量大学 机电工程学院,杭州 310018;3.安徽省工业互联网智能应用与安全工程实验室,安徽 马鞍山 243023)

线束是电气设备中各种部件的连接元件,为电气设备的正常运转提供重要保障[1]。由于导线具有材质柔软的特性,线束的装配主要采用人工方式,将不同颜色的导线按照规定的颜色排序,并插入连接器的孔位中。在生产过程中会出现一些排序错误的不合格线束,如果未及时发现并剔除,将严重影响电路连接的可靠性和电信号传输的稳定性,导致线路出现故障[2]。由此可见,展开线束导线排序的快速检测研究具有十分重要的意义。

目前,线束产品的排序检测方法主要分为人工检测和机器视觉检测2 类。线束中的导线排列紧密,人工检测效率较低,且长时间专注检测极易引起视觉疲劳,导致漏检、错检。机器视觉检测通过对采集到的图像进行相应的图像处理,以提取所需的视觉特征,并输出检测结果[3],在缺陷检测[4]、尺寸测量[5]和识别定位[6]等领域中应用广泛。为了区分导线的特定功能,会在线束中使用混色导线,即绝缘表面为几种不同颜色占比的导线。这种导线颜色不固定的特征,为基于机器视觉的检测带来了极大的挑战。近年来,随着机器视觉技术和深度学习卷积神经网 CNN(Convolutional Neural Networks)的迅速发展,机器视觉检测方法的效率和精度得到大幅度提升[7-8]。传统的机器学习采用手动提取的复杂操作。卷积神经网络具有强大的非线性映射和特征提取能力[9-10],可主动学习图像中的特征,这为线束中的导线识别检测提供了新的解决路径,引起了许多学者的关注。文献[11]将电线图像中提取到的颜色直方图与颜色矩的特征数据结合,并用BP(Back Propagation)神经网络对电线颜色进行分类。文献[12]通过对Yolov3 主干网络结构重新进行优化,使网络的性能更加均衡,满足了工业现场对圆形电连接器缺陷的检测需求。文献[13]提出了一种基于深度学习的绝缘子定向识别算法,通过加入旋转角度的定向检测框,有效解决了绝缘子目标检测中无法精确定位的问题。文献[14]基于卷积神经网络提出了一种PCB(Printed Circuit Board)板色环电阻自动检测定位方法,较好地解决了复杂情况下PCB 板色环电阻的图像分割问题。总体而言,机器视觉检测相较于人工检测,具有检测速度快、识别精度高等优势。现有的线束导线排序视觉检测方法对相近颜色导线的区分,以及线束中黄绿混色的“地线”PE(Protecting Earthing)导线识别检测的效果不太理想。

鉴于此,文中基于机器视觉技术设计一种线束导线排序检测装置,并结合图像处理方法和深度学习理论提出一种线束导线排序检测算法。通过与数据库中的模板图像进行匹配搜索,完成对线束连接器正反面的识别和单色导线的颜色定位,并采用 Faster R−CNN、SSD、YOLOv3 和YOLOv5m 等4 种目标检测算法在创建的PE 混色导线数据集中进行检测精度和检测速度的对比,对线束中检测不佳的PE 导线颜色特征识别展开研究。

1 检测系统方案设计

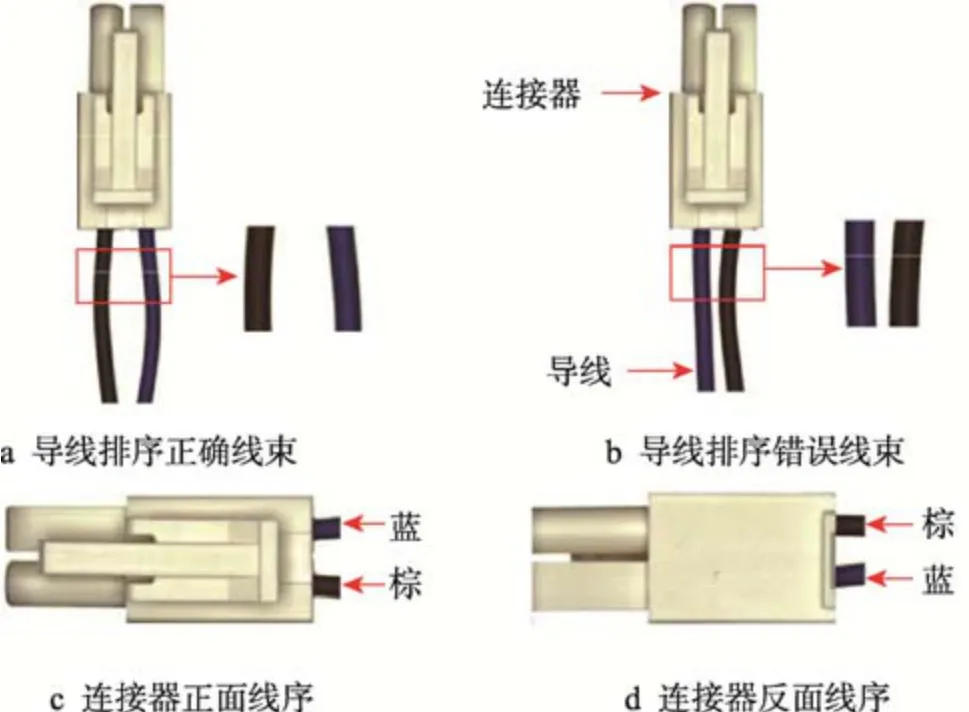

1.1 线束检测特征

线束主要由不同颜色的导线和形状各异的连接器组成,如图1 所示。图1a、b 分别为导线线束排序正确和错误情况下的实物示意图。相较于其他视觉特征,导线的颜色特征对检测对象的大小、摆放位置和视角的依赖性较小,能够较好地突出导线之间的表面差异,是线束导线排序检测中常用的识别特征。此外,由于连接器正反面对应的导线颜色排序相反,如图1c、d 所示,连接器正面对应的导线颜色排序为“蓝”“棕”,而连接器反面对应的则为“棕”“蓝”,因此在线束检测过程中,还需对连接器的正反面进行区分。

图1 待检测线束实物Fig.1 Wire to be detected

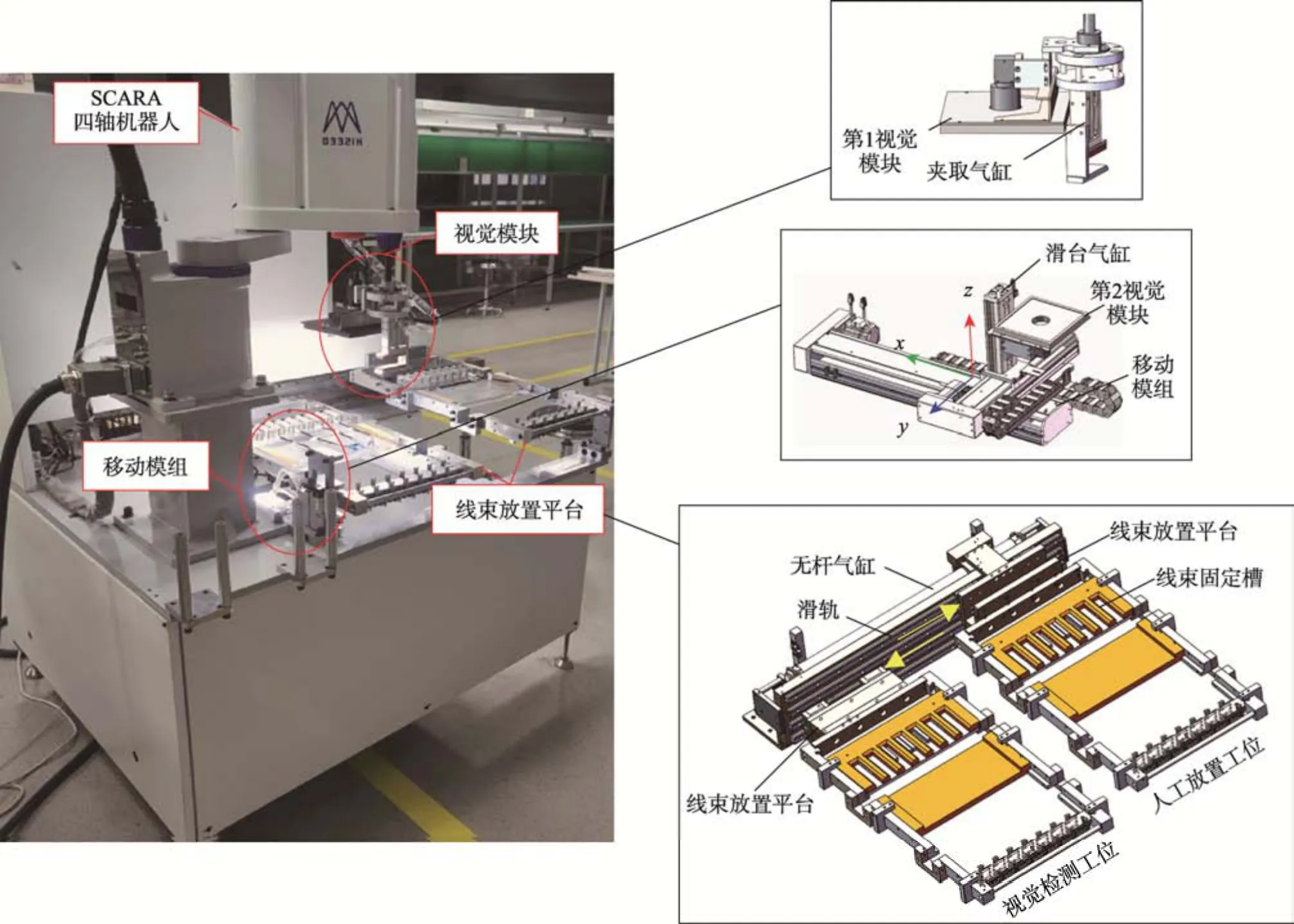

1.2 线束检测装置改进

由于线束导线排序检测的工作量较大,因此人眼长时间工作后极易引起视觉疲劳,容易发生漏检和误检。通常采用相机检测识别导线排序,如图2 所示。检测装置主要由相机和图像检测系统组成,在检测前需要区分连接器的正反面,然后再逐一将线束摆放到相机拍照下方的检测区域进行检测,最后根据检测系统的提示结果,剔除不合格线束。该检测过程易受到放置位置的影响,且检测速度主要取决于人工操作速度。

图2 改进前检测装置Fig.2 Detection device before improvement

针对现有检测装置存在的自动化程度不足及检测结果易受人工干涉影响等问题,对现有的线束导线排序检测装置进行了改进,改进后的整体结构如图3所示。该装置由动作执行单元和检测识别单元组成。动作执行单元主要包含SCARA 四轴机器人(简称机器人)、移动模组和线束放置平台等部分。机器人和移动模组分别带动第1 视觉模块和第2 视觉模块进行线束正反面图像的采集,机器人根据上位机检测平台的反馈结果,使用夹取气缸将线束放置到不同分拣区域。移动模组通过与滑台气缸配合,带动第2 视觉模块沿着x、y、z3 个方向移动。线束放置平台由无杆气缸和滑轨带动,可进行人工放置工位与视觉检测工位的切换,并且放置平台的线束固定槽间距可根据不同尺寸的连接器进行人工调整。

图3 检测装置Fig.3 Detection device

检测识别单元包括视觉模块和上位机检测平台等部分。视觉模块采用2 000 万像素彩色工业相机搭配白色开孔背光源,通过2 组光源上下对射,突出线束连接器的形状特征和导线颜色特征。上位机检测平台识别图像后,将结果通过TCP/IP 通信发送给机器人。

在设备使用过程中,人工放置工位的料槽放满后,即可将线束放置平台送入视觉检测工位,随后机器人和移动模组带动视觉模块进行图像采集,上位机检测平台对采集的图像进行识别检测,并将检测结果反馈给机器人,最后机器人再根据视觉检测结果将线束分区放置,完成线束导线排序的识别检测,系统检测流程如图4 所示。相较于改进前的线束检测装置,改进后检测系统无须配备专门的检测人员,在线束装配人员完成线束插装后,可直接放入检测平台,系统自动进行线束正反两面的导线排序检测。在减少用工成本的同时,进一步提升了检测效率。

图4 系统检测流程Fig.4 System inspection process

2 线束导线排序检测算法原理

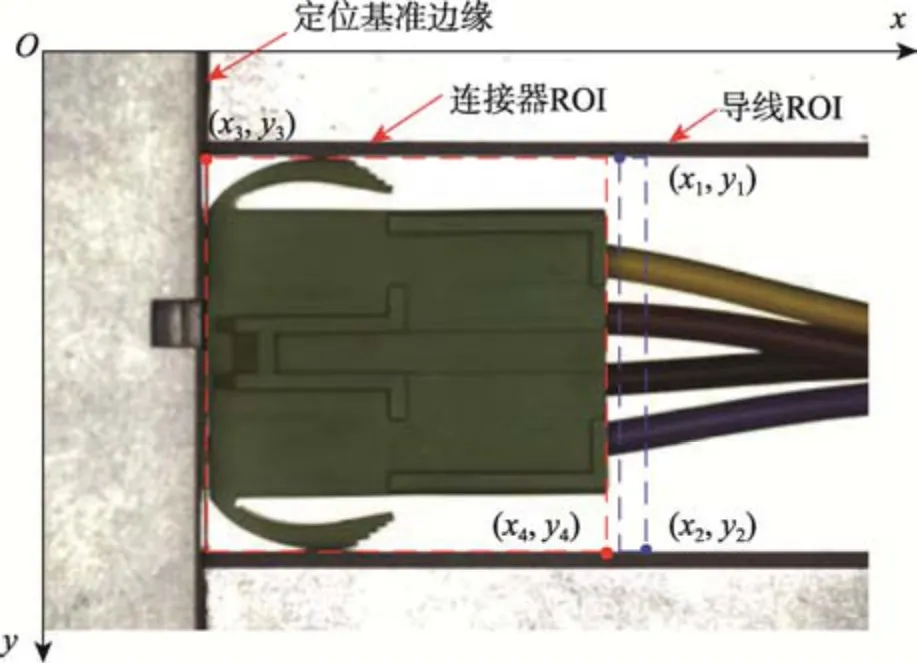

2.1 图像分割预处理及检测算法流程

视觉模块采集的线束正面图像如图5 所示。为了分割出线束的连接器部分和导线部分,应去除无效的背景信息。参照文献[15]介绍的基于感兴趣区域(region of interest,ROI)的图像检索方法,通过对比大量导线图片发现,越靠近连接器的尾部,导线的位置排列越清晰,导线相互遮挡的现象越少。人工选取距离线束连接器尾部20~30 像素作为导线ROI 区域,该区域两对角点坐标分别为(x1,y1)、(x2,y2)。连接器ROI 区域的坐标可根据导线ROI 坐标向图像坐标原点偏移,自动生成连接器ROI 区域(x3,y3)、(x4,y4)。后续的图像处理方法将先通过ROI 区域分割出连接器图像和线束导线图像后,再分别进行检测。

图5 ROI 选取Fig.5 ROI selection

设计的基于机器视觉和深度学习的线束导线排序自动检测算法流程如图6 所示。首先将分割的连接器图像进行灰度化处理,再通过模板匹配完成连接器正反面的识别。然后对导线图像进行单色导线的识别定位,并使用自制的PE 混色导线数据集训练生成检测模型,完成PE 混色导线的识别定位。最后,将识别定位结果根据坐标信息进行排序组合,与数据库中的标准线束排序信息进行对比,从而完成检测。

图6 检测算法流程Fig.6 Detection algorithm flow

2.2 连接器正反面匹配识别

由于连接器正反面对应的导线颜色排序相反,因此在检测过程中,线束连接器正反面的正确匹配是系统能够识别线束导线颜色排序的首要条件。这里采用灰度化处理后的连接器图像来构造相应的模板,图像灰度化后可以去除连接器的颜色信息,突出连接器的表面特征,缩短图像匹配时间。匹配过程如图7所示,将尺寸为K×L的模板图像(图7a)放在M×N待检测图像(图7b)上平移,被模板覆盖的区域称为子图。计算模板图像与子图的相似度,当相似度大于设定阈值时,则认为在待检测图像的当前位置找到了匹配目标。考虑到开放式检测环境变化对检测效果的影响,参照文献[16]中的归一化相关系数匹配算法 (Normalized Cross Correlation,NCC)来计算模板图像和待检测图像中覆盖区域之间的相似度,见式(1)。

外卖是大多数年青上班族的午餐首选,因为午休时间短,又懒得下楼买,只得叫外卖。可是现在外卖的质量情况堪忧,如何才能健康吃外卖呢?

图7 正反面特征匹配Fig.7 Front and back feature matching

式中:T(x,y)为模板图像中各像素点的灰度值;f(x+i,y+j)为模板图像移动到待检测图像当前位置时的灰度值;T和f(i,j)分别为模板图像和它在子图像中点(i,j)对应区域的像素平均值。

R(i,j)=[−1,1],其值越靠近−1 或1,说明模板图像与其所覆盖的待检测图像区域越相似。

2.3 单色导线识别定位

单色导线的识别定位过程如图8 所示。为了从导线图像中获取单色导线在图像中的位置信息和对应的颜色类别,首先需对创建的颜色模板中的色谱信息进行学习,并记录到模板数据库中。在导线颜色定位匹配阶段,通过在分割到的导线图像中搜索与模板颜色相匹配的区域,返回相似度最高区域的位置信息,完成单色导线的识别定位。

图8 单色导线定位过程Fig.8 Monochromatic wire positioning process

从左到右、从上到下逐像素的图像搜索方式的计算量较大,且非常耗时。为此,这里采用从粗到细(Coarse-to-Fine)[17]的方法对搜索过程进行优化。通过下采样方式,仅用模板图像覆盖区域中的部分像素颜色信息与模板色谱信息进行比较,根据设定的步长进行跳像素的步进搜索,快速定位到可能的候选匹配位置,然后再对各个候选区域进行精细匹配,最终确定导线的最佳色彩匹配位置。

为了补偿彩色图像量化过程中产生的误差,使用色谱间的曼哈顿距离[18](各元素间差异的绝对值求和)计算色谱之间的差异,最终生成一个0~1 000 的表示差异度的值,见式(2)。其中,0 表示色谱之间无相似性,1 000 表示完美匹配。

式中:n=26;x1i、x2i分别对应模板图像中色谱向量和待测图像色谱向量中包含的元素。

2.4 PE 混色导线识别定位

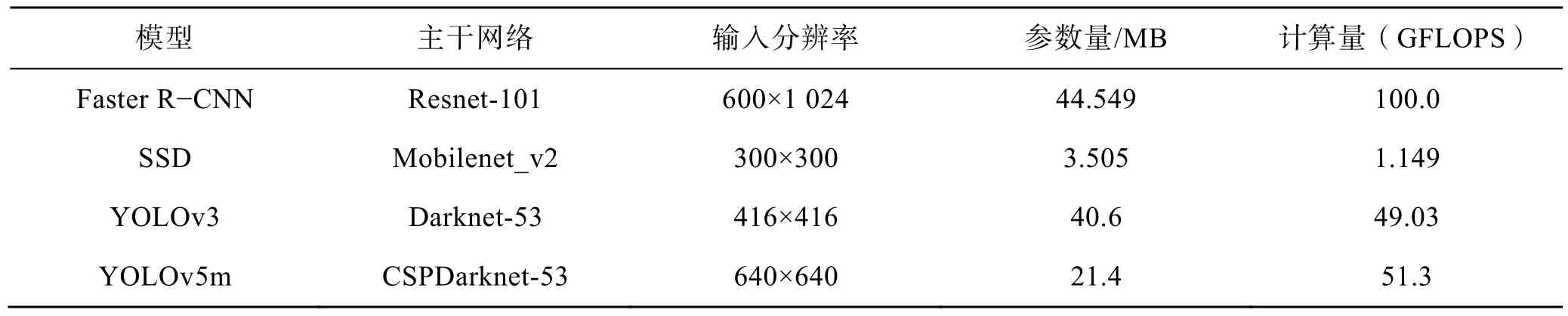

卷积神经网络具有丰富的网络结构,可自动提取目标中的颜色特征进行训练,无须人工干涉颜色特征的学习。目前,针对物体颜色识别的深度学习算法大多对颜色进行分类,将其应用于线束中识别PE 导线颜色的研究较少。这里选取Faster R−CNN、SSD、YOLOv3 和YOLOv5 等4 种主流目标检测算法,研究了不同目标检测算法在自制PE 混色导线数据集中的检测效果,并从中选出兼顾检测速度和准确性的检测模型,用于PE 混色导线的识别定位。

4 种目标检测算法的参数如表1 所示。其中,Faster R−CNN(Resnet−101)的输入分辨率、参数量(Params)和计算量(FLOPs)最大,在时间和空间上的复杂度最高;SSD(Mobilenet_v2)是一种基于深度可分离卷积的轻量化神经网络结构,模型的参数量最小,在低硬件条件下仍可保持良好的性能;YOLOv3(Darknet−53)借鉴了Resnet 网络中的跳跃连接思想,只采用3×3 和1×1 的卷积层构建基准网络,计算量相较于Faster R−CNN(Resnet−101)减少了 50%,有较高的计算速度和检测实时性;YOLOv5 是在YOLOv3 的基础上,将Mosaic 数据增强、自适应锚框计算、Focus 结构、SSP 模块和CSP结构等优良方法结合在一起,其性能更强大,并且可通过在每个跨阶段局部网络 CSPN(Cross Stage Partial Networks)中调节深度倍数(depth multiple)和宽度倍数(width multiple),实现了4 种网络结构的灵活变换[19]。

表1 目标检测模型参数对比Tab.1 Parameter comparison of object detection model

3 实验与分析

3.1 PE 混色导线数据集制作

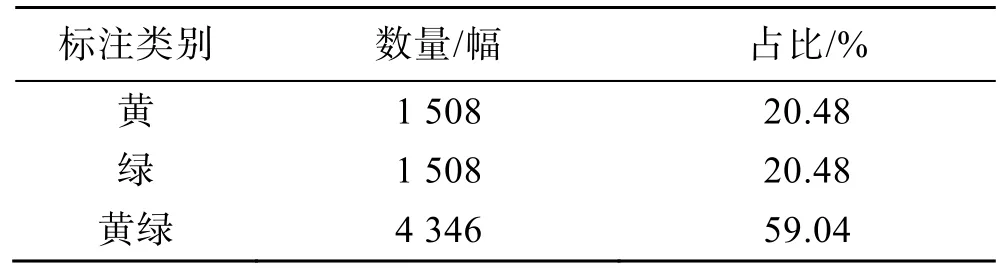

利用检测系统采集2 680 幅图像,并通过旋转、平移、镜像等方式将数据集扩充至7 362 幅含有PE混色导线的图片,选取各类样本数量的20%作为测试样本,进行目标检测模型的对比。在采集过程中,PE混色导线在视野内会呈现黄、绿和黄绿3 种状态,如图9 所示。在进行数据标注时,将数据集划分为黄绿、黄、绿3 种标签。数据集格式使用PASCAL VOC 格式,并用labelImg 开源工具进行手工标注。数据标注情况见表2。

表2 数据集标注情况统计Tab.2 Statistics of dataset labeling

图9 PE 导线颜色特征呈现情况Fig.9 Presentation of PE wire color characteristics

3.2 模型评价指标

为了全面评估模型的性能,选取各种类别的平均准确率(mean average precision,PMAP)和平均图像处理时间为模型评价指标。其中,PMAP是先计算各个标签类别的精度,再计算所有类别精度的平均值,见式(3)—(4)。

式中:C为样本的种类;Ap为样本的平均精度;N为召回率的数量;r为召回率;P(r)为最大准确率;p为准确率,p=TP/(TP+FP);r为召回率,r=TP/(TP+FN);TP为样本分为正样本且分类正确的数量;FP、FN分别为样本被分为正样本和负样本,但分类错误的数量。

3.3 训练结果对比分析

将4 种算法在相同的数据集中进行训练。在验证集中,选取各自训练过程中模型收敛后损失值最小的检测模型进行对比。4 种算法对PE 导线的检测速度/准确率的对比结果如图10 所示。从图10 可以看出,Faster R−CNN 目标检测模型的平均精度最高,但其检测耗时相对较长;排在第2 位的YOLOv5m检测模型,相较于前者在平均检测精度方面降低了3.4%,但检测速度是前者的7.7 倍;YOLOv3 检测模型和YOLOv5m 在检测耗时方面差异不明显,但相较于YOLOv5m,其平均检测精度降低了7.2%;SSD检测模型在检测精度和速度等方面均比YOLOv5m模型差。

图10 检测算法的速度/准确率对比Fig.10 Comparison of detection algorithm speed/accuracy

综合考虑检测精度和检测速度的影响,最终选择兼顾检测速度和精度的YOLOv5m 目标检测模型进行PE 导线的识别。根据物体识别的边界框信息计算PE 导线在图片中的坐标,与单色导线识别定位结果组合,完成线束导线颜色排序的检测。YOLOv5m目标检测算法在复杂情况下的检测效果如图11 所示。从图11 可以看出,模型可准确检测到PE 导线的位置,且在不同粗细导线场景下都具有良好的检测效果。

图11 YOLOv5m 检测效果Fig.11 YOLO v5m detection effect

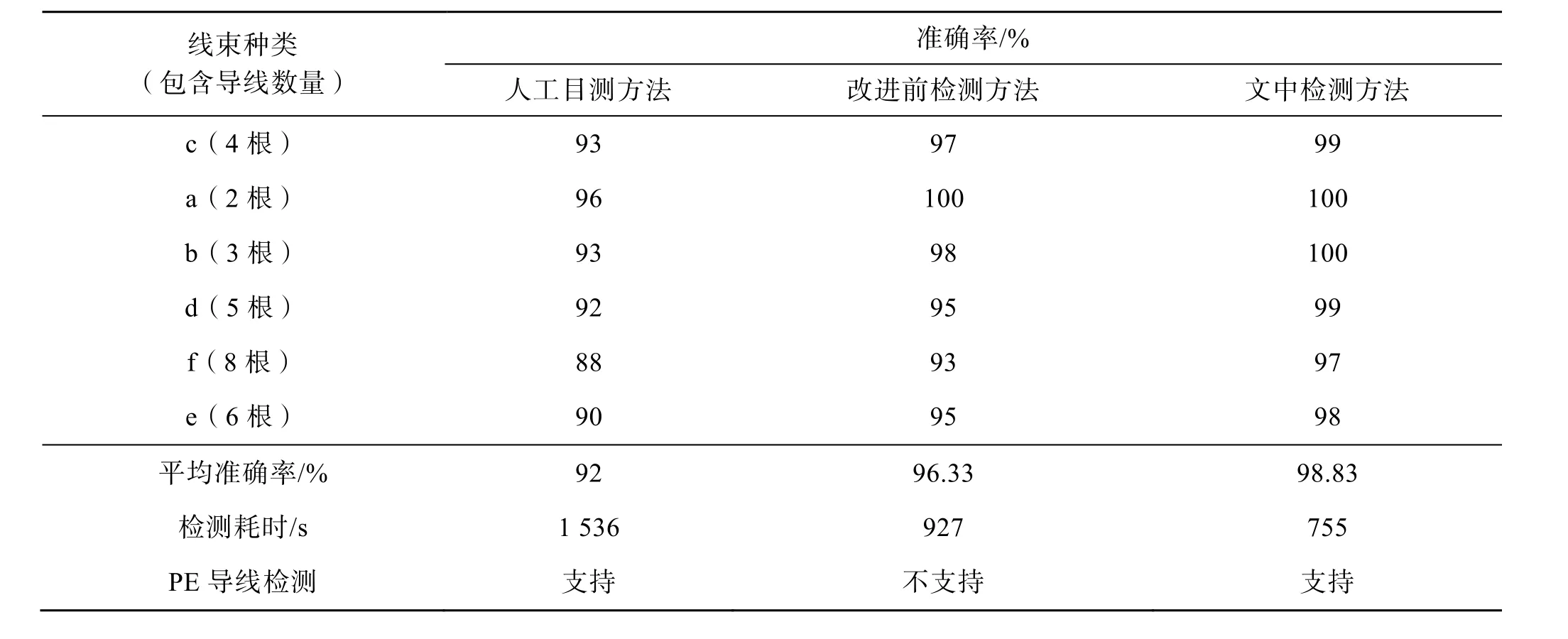

为了进一步验证文中提出的线束导线排序检测方法的有效性和可靠性,设计了不同检测方法的对比实验,选取6 种不同种类的线束产品,每种线束各100 个。对比人工检测方法、改进前机器视觉检测方法和文中检测方法,检测效果如表3 所示。

表3 不同检测方法检测耗时/准确率Tab.3 Speed/accuracy of different detection methods

从表3 中可以看出,在检测耗时方面人工检测的检测耗时远高于其他2 种检测方法,并且在检测导线数量较多的线束产品时,人工检测的准确率明显较低。在含有PE 导线的线束检测过程中,改进前的机器视觉检测方法需要规避PE 混色导线不固定颜色特征造成的影响,对线束检测过程中的放置手法有一定要求,其检测效率和准确率不理想。文中提出的检测方法只需将待检测线束置于检测平台中,即可自动完成检测,相较于改进前的机器视觉检测方法,其检测时间缩短了18.55%,平均准确率达到98.83%,具有更好的检测效率和检测精度。

4 结语

针对现有工业线束导线排序检测方法存在的检测效率低和PE 混色导线检测效果差等问题,基于机器视觉技术设计了一种便捷高效的线束导线排序检测系统,可同时进行线束正反两面的检测。根据ROI信息,自动计算分割出线束的连接器图像和线束导线图像,通过图像灰度化处理提升了正反面特征匹配速度,并使用由粗到细的匹配方法对单色导线颜色识别定位过程进行了优化。在制作的PE 混色导线数据集中,使用Faster R−CNN、SSD、YOLOv3 和YOLOv5 等4 种不同深度学习目标检测算法进行了检测速度/准确率对比分析。实验结果表明,4 种深度学习目标检测算法对PE 导线的检测精度均达到75%以上,其中YOLOv5m 的检测精度和检测速度兼顾性最好,检测效果最佳。相较于改进前的机器视觉检测方法,文中提出的检测方法的检测时间缩短了18.55%,平均识别准确率为98.83%,在检测精度、速度、检测种类多样性方面满足线束生产检测需求。