光学定位技术辅助的手术场景全景拼接算法

2022-06-29杨巧玲叶灿梁楠武博张楠

杨巧玲 叶灿 梁楠 武博 张楠

0 引言

远程医疗可以建立临床专家与患者之间或不同医疗单位之间的关系,以实现远程治疗、信息交换和远程监控[1],并为医学生提供临床教学[2]。传统的外科手术过程录制不够直观,不能使临床专家和学生身临其境。在VR中呈现全景手术场景可以提供直观的、逼真的、沉浸式的远程医疗环境。它可以建立具有高度现实意义的标准人体组织器官模型和疾病模型[2],以确保不同区域进行及时有效的沟通,提供逼真的沉浸式VR环境基于图像拼接技术,产生高质量的全景场景。

图像拼接方法起源于摄影测绘领域[3],创建无缝自然的照片拼接[4]。在20世纪八九十年代,越来越多的学者探索一种自动配准照片或视频摄像机获得的图像生成全局一致的宽视场地图的方法[5]。近年来基于特征点的图像拼接算法是研究热点。为了获得更好的拼接质量,根据尺度不变特征变换(scale invariant feature transform,SIFT)[6]特征点对应关系,基于区域划分的拼接方法[7-14]不断被提出,其中以尽可能自适应的图像拼接算法(as-natural-as-possible,AANAP)[12]为代表。除了上述基于区域划分的拼接算法外,特征结合缝合线优化的图像拼接算法也不断被提出,用于处理大视差图像的拼接,并获得满意的结果[15-17]。但是以上研究均未对手术室特定场景进行研究,本文在手术场景高关注度区域引入光学定位点,提高拼接精度,提升拼接质量。

手术导航系统可以提高手术成功率,使手术创伤尽可能小,减少出血、疼痛和恢复时间[18]。光学定位相比于其他定位技术更加精确[19-20],因此大多数手术导航采用光学定位技术。对于手术场景来说,高关注度区域的手术器械和白色手套易反光,且低纹理,SIFT特征点很难被检测出来。基于SIFT的手术场景全景拼接算法特征点匹配精度较低,拼接结果容易出现重影。因此,在已建立的光学定位平台下,通过运动跟踪的光学定位算法(optical positioning algorithm with motion tracking,OPAMT)[21-22]在手术场景高关注区域采集严格匹配的光学定位点对,结合改进的AANAP算法,本文提出了一种针对手术场景光学定位技术辅助的全景拼接算法PSAOP,高关注区域的拼接结果获得了良好的视觉质量,几乎没有出现重影和未对齐现象。

1 方法

本文提出了针对手术场景的拼接算法,如图1所示。

1.1 SIFT特征点的获取

SIFT特征点是一种对旋转、尺度缩放、亮度变化保持不变,对视角变换、仿射变换、噪声也有一定程度的鲁棒性的特征向量。首先在DoG(difference-of-Gaussian)尺度空间寻找关键点,利用关键点领域像素的梯度和方向统计其邻域像素的梯度直方图,为关键点确定基准方向。得到关键点的位置、尺度和方向后,用128维向量进行描述。最后基于欧式距离对获得的特征向量进行匹配,并采用RANSAC[23]算法来消除误匹配。

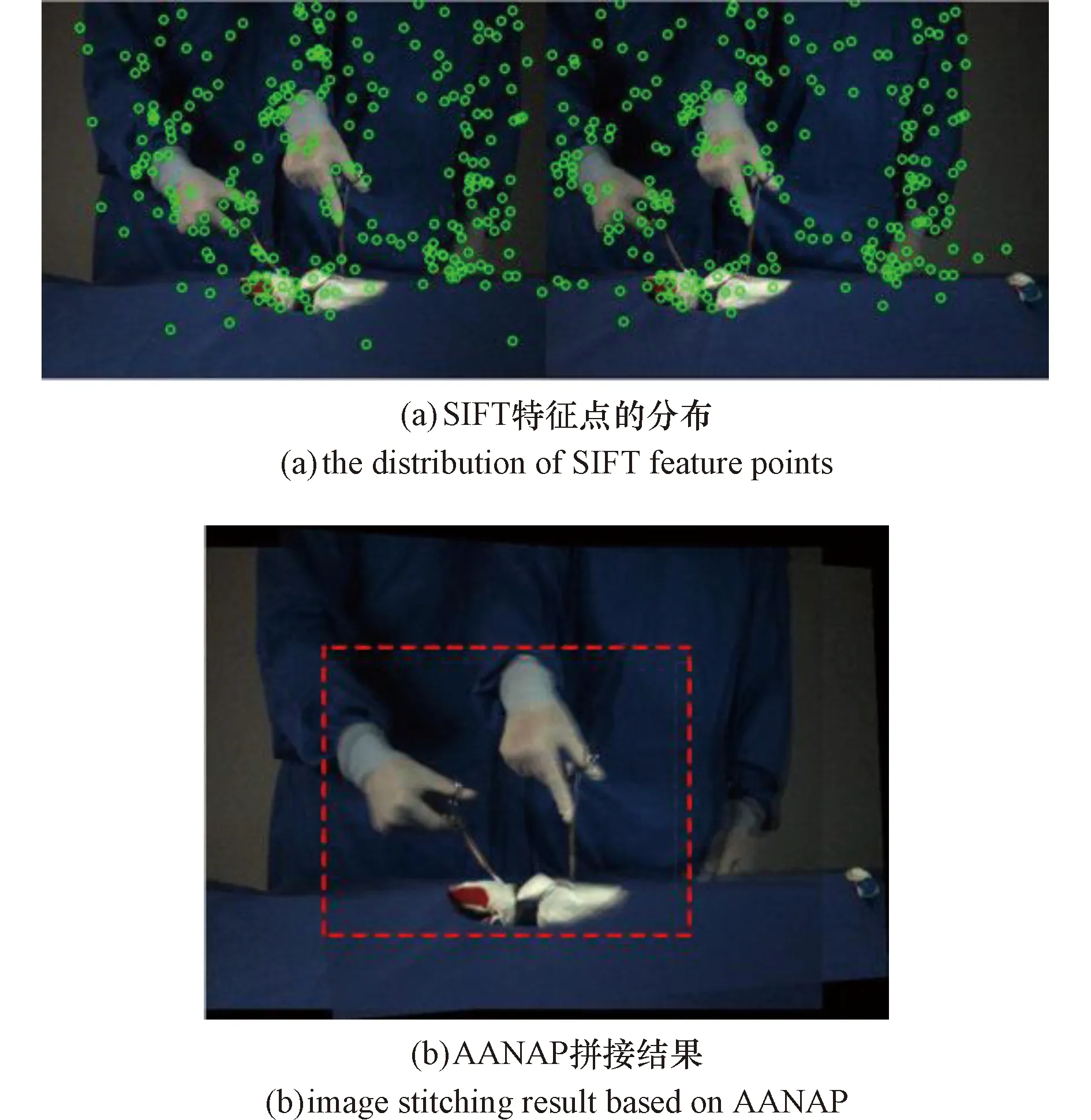

SIFT特征点的分布和基于SIFT的AANAP拼接算法的结果如图2所示。从图2(a)可以看出,SIFT特征点主要集中在手术场景的背景区域。背景区域远离相机,纹理丰富,可以轻松提取SIFT点。但是手术器械和白手套在高关注区域很容易反光,低纹理,此处的SIFT特征点分布不够均匀和密集。因此,高关注度区域(虚线框)中,手、骨骼处出现严重的重影,手术器械未对齐,如图2(b)所示。拼接结果的主观质量太差,无法为临床专家和医学生提供足够的临床参考信息。

图2 基于SIFT特征匹配点的AANAP算法手术场景拼接结果Figure 2 Image stitching results of AANAP algorithmbased on the SIFT matching points

1.2 光学定位点的获取

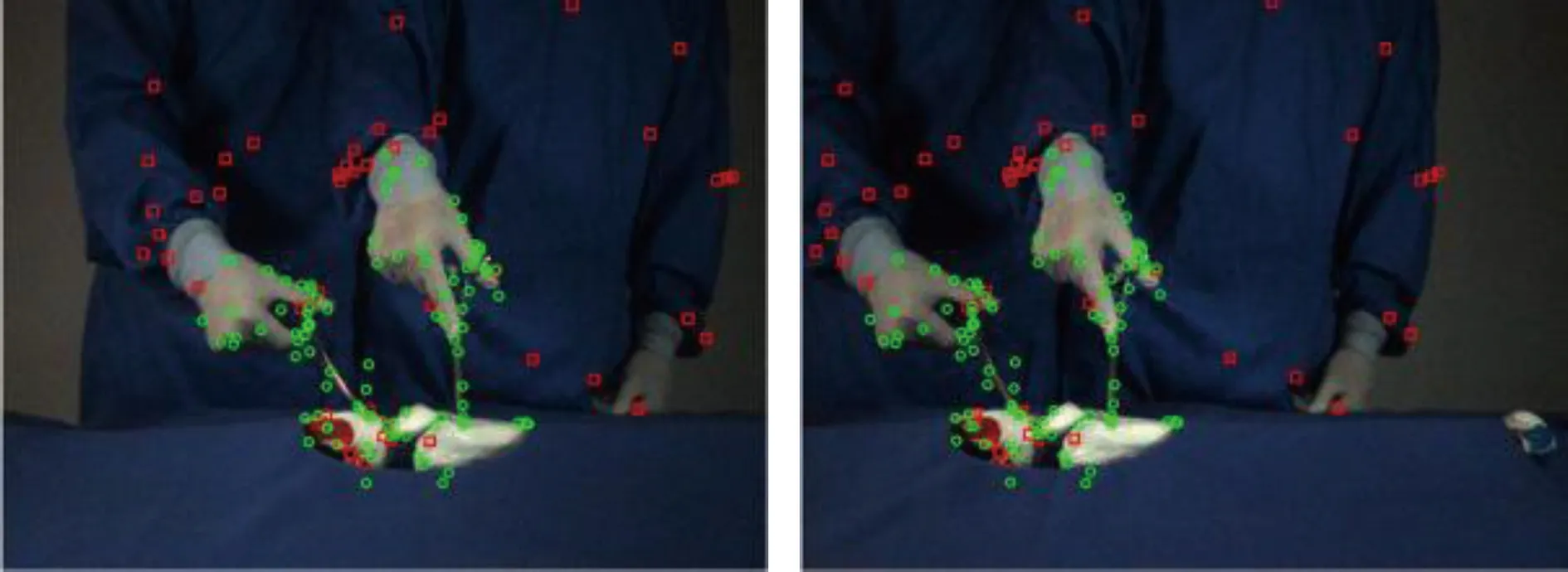

在已建立的光学定位平台下,采用光学运动跟踪算法OPAMT在手术场景高关注度区域连续采集光学定位点。利用摄像机标定得到的左右摄像机内部参数,通过器械旋转标定法得到光学定位器械尖端点的三维世界坐标。然后得到光学定位点在左右视图严格一一匹配的像素坐标。SIFT特征点和光学定位点的分布如图3所示。可以看出,光学定位点主要在手术场景高关注度区域采集。

‘□’(红色)表示SIFT特征点,‘○’(绿色)表示光学定位点;左图为左视图,右图为右视图图3 SIFT特征点和光学定位点的分布Figure 3 Distribution of the SIFT feature points and the optical positioning points

2 改进的AANAP算法

获得SIFT特征点和光学定位点以后,对AANAP算法进行以下改进:一是基于SIFT点和光学定位点建立局部单应性模型;二是基于深度信息优化的全局相似变换算法DOGST。

I和I′分别表示目标图像和参考图像,p=[x,y]T和p′=[x′,y′]T是目标图像和参考图像的特征点对,将图像划分成多个网格,基于特征点与参考图像网格中心点之间的距离,引入权重因子,对所有特征点分配相应的权重,权重是根据特征点和网格中心点之间的距离决定的,距离越小权重越大,随后基于移动直接线性变换(moving direct linear transformation,MDLT)[9]算法建立两图像之间的映射关系:

(1)

(2)

式中:ai是式(2)左侧矩阵线性无关的前两行;i代表第i对特征匹配点对;A是由ai组成的2N×9的矩阵;p*是参考图像I′的坐标。

在文献[9]中,估算局部单应矩阵以后,根据式 (3)将其线性化外推到非重叠区域,以减少极端和不自然的尺度效应。

(3)

式中:q是网格中心点;JH(pi)处雅克比矩阵,最后线性化单应矩阵Hl可由hL(q)得到。

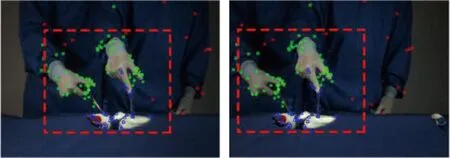

由于存在多个场景平面和相机平面,每个场景平面和相机成像平面呈一定角度,大角度会导致拼接结果的透视失真。利用与投影平面最平行(最小交角点)的场景平面估算全局最优相似变换。为了得到该变换,AANAP使用小阈值的RANSAC对匹配点进行分类,以获得与投影平面呈最小交角的平面。但是对于手术场景来说,场景多为近景物体,形变大,匹配点分类准确率不高。因此,本文提出基于深度信息优化的全局相似变换算法DOGST。首先,根据式(1)计算SIFT特征点的深度,光学定位点的深度信息即为器械尖端点在世界坐标系中的z轴方向上的值。基于深度,采用K-means算法将这些点分为前中后三类。通过DOGST获得的深度聚类结果如图4所示。“△”(蓝色)、“*”(绿色)和“ +”(红色)分别代表深度信息的前、中和后。计算参考图像和目标图像中每一类对应点对的旋转相似矩阵,选取旋转角度最小的相似矩阵作为全局最优相似矩阵S,图中“*”(绿色)表示的点生成具有最小旋转角度的全局最优相似变换。通过计算, RANSAC获得全局最优相似矩阵最小旋转角度为0.0492°,而DOGST获得的全局最优相似矩阵的旋转角度为0.0043°,能够减少因大角度导致的透视失真,提高拼接自然度。

表示前景中的SIFT特征点,表示前景中的光学定位点,表示中部的SIFT特征点,表示中部的光学定位点,表示背景中的SIFT特征点;左图为左视图,右图为右视图图4 基于深度信息的SIFT特征点和光学定位点的分类Figure 4 Classification of the SIFT feature points andthe optical positioning points based on depth

基于AANAP算法结合单应性矩阵和全局相似矩阵,估算目标图像变换矩阵Ht为:

Ht=ηHI+(1-η)S

(4)

式中:η为目标图像非重叠区域中心点和参考图像中心点形成的向量在参考图像和目标图像中心点形成的向量上的投影值。全局相似变换更新目标图像会导致参考图像与目标图像重叠区域的错位[12]。因此,根据式(5)对参考图像进行变换补偿:

Hr=HI/Ht

(5)

3 结果

在课题组建立的光学定位平台下,通过运动跟踪的光学定位算法OPAMT 在手术场景高关注度区域采集光学定位点。光学定位系统中的Pointgrey Bumblebee2 FireWire双目摄像机主要用于捕获手术场景。PSAOP算法和其他先进算法均在MATLAB 2014b中实现。数据集主要由模拟的手术场景、世界坐标系中的光学定位点数据集以及摄像机的内部、外部校准参数组成。为了获得模拟的手术场景,实验室人员担任医生并模拟膝关节手术。

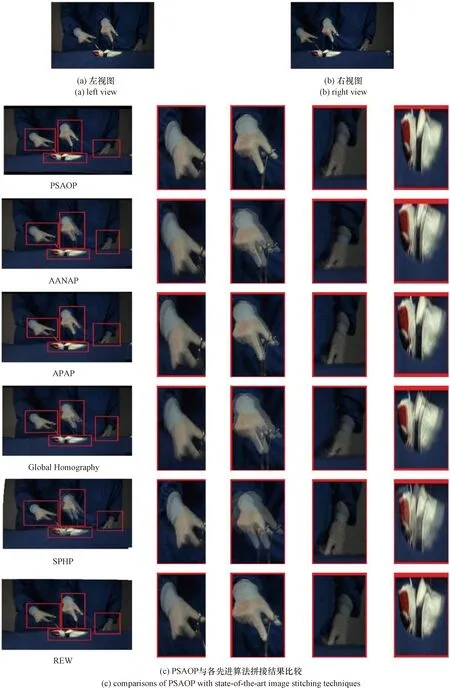

在相机捕获手术场景时,通过跟踪定位高关注区域中的光学定位仪器采集光学定位点。与最先进的拼接算法进行比较实验,以验证PSAOP的性能,包括Global Homography、APAP算法[9]、SPHP算法[11]、ANAP算法[12]和REW算法[13]。除PSAOP外,其他算法不包含光学定位点。图5是模拟手术场景Scene #1的拼接结果比较。红色框显示拼接视差。如图所示,本文提出的PSAOP结果在重叠区域显示出更好的拼接效果,高关注区域的重影现象可以忽略不计,不会影响全景手术场景应用的质量。由于基于贝叶斯细化模型自适应地去除了局部离群值,REW算法在高关注区域的拼接结果获得了较小的视差。但是与PSAOP相比,高关注区域中手的轮廓更为粗糙。另外,对于除PSAOP算法以外的其他算法,拼缝都很明显,影响整体视觉质量。

图5 PSAOP在Scene #1上与最先进图像拼接技术的结果比较Figure 5 Comparisons of PSAOP with state-of-the-art image stitching techniques on surgical simulation Scene #1

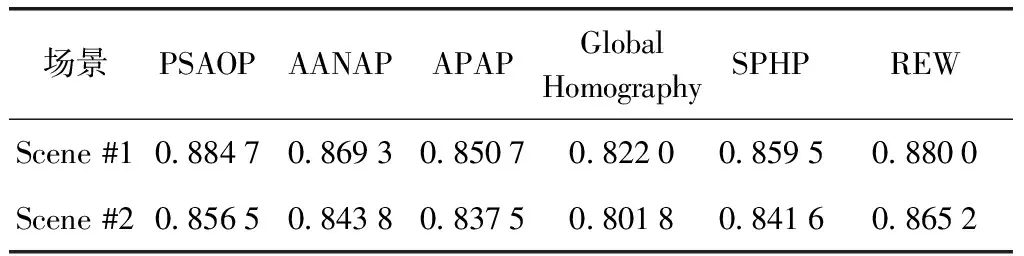

SSIM[24]在本文中用于定量评估不同算法的对齐质量。对齐后,提取左右视图的重叠区域,计算相应的SSIM。表1显示了实验数据集中Scene #1和 Scene #2两种场景下6种算法的计算得分。PSAOP算法和REW算法的SSIM得分相对较高,即都实现了良好的对齐效果。但是, REW在高关注区域中的一些细小区域的拼接结果仍比PSAOP稍差。微小部分的错位对SSIM评分的影响极小。此外,与PSAOP相比,REW的拼缝更加明显,导致总体主观质量低于PSAOP。

表1 基于两个场景的6种算法的SSIM得分比较Table 1 Comparison of SSIM score of six algorithms based on two scenes

4 结论

本文提出了一种新颖的用于手术场景全景拼接的算法PSAOP。首先,基于OPAMT在手术场景高关注度区域采集得到的严格匹配光学定位能够提高拼接精度,准确对齐图像。并且结合SIFT特征点,优化背景区域拼接效果。此外,提出一种基于深度信息优化的DOGST算法获取全局最优相似度矩阵,补偿摄像机的运动,减少大角度畸变。与RANSAC相比,DOGST可以获得具有更小的旋转角度的全局最优相似度变换,以进一步减少透视失真,提高拼接自然度。实验结果表明,在高关注区域引入光学定位点可以提高拼接精度,并获得良好的拼接效果。与其他仅基于SIFT的最先进拼接算法相比,PSAOP更适用于手术场景的拼接。未来还将尝试自适应地调整SIFT特征点和光学定位点在不同区域的权重,使手术场景全景拼接结果更加自然,从而生成高质量的全景。结合VR(virtual reality),它将为远程医疗提供更直观、沉浸式的临床医疗环境。