基于改进R-FCN的SAR图像识别

2022-04-07周晓玲张朝霞王琨琨

周晓玲, 张朝霞, 鲁 雅, 王 倩, 王琨琨

(太原理工大学物理与光电工程学院, 山西 太原 030024)

0 引 言

合成孔径雷达(synthetic aperture radar,SAR)成像是通过雷达与成像目标之间相对位移产生等效的合成天线阵列,再通过发射端发射宽带信号与合成阵列的相干获取距离像和方位向的高分辨实现的成像技术。因其受到外界天气的影响相对较小,还具有一定的地表穿透能力,所以在军事领域、国土资源、农林业、重大灾害等方面应用广泛。传统的SAR图像识别技术在数据量巨大且数据愈发复杂的情况下,会导致最终的识别精度和识别效率低下,而深度学习是通过将获得的低层次特征进行非线性组合,由此来得到数据的抽象表达。深度学习在图像识别领域的成功,为其在SAR目标识别方面的应用提供了依据。

在传统卷积神经网络(convolutional neural network, CNN)的基础上,Girshick等提出了一种基于区域特征提取的卷积神经网络(region CNN, R-CNN)模型用来实现目标检测,R-CNN模型可以获得比CNN更快的识别速度和更好的识别精度。但R-CNN网络在提取大量候选区域时会占用很大磁盘空间以及巨大的计算浪费。另外,由于传统CNN需要输入图像为固定尺寸(227×227),所以会进行归一化处理,使图像被截断或拉伸,导致图像信息丢失。文献[11]提出的快速区域卷积神经网络(Fast R-CNN)模型不需要进行图像预处理和生成候选区域,解决了R-CNN中图像信息丢失、计算速度慢和占用存储空间大的问题。为了加快提取候选区域的速度,Ren等提出更快的区域卷积神经网络(Faster R-CNN)模型,用区域建议网络(region proposal networks, RPN)来提取候选区域(region of interest, ROI),然后利用Fast R-CNN实现目标检测功能。由于RPN获得建议区域只需要做一次完全卷积,能和整个检测网络共享全图的卷积特征,减少了大量冗余数据的计算,加快了目标检测速度。同时,Faster R-CNN还具有较高的检测精度。Dai等提出一种基于区域特征的全卷积网络(region-based fully convolutional networks, R-FCN),用于实现精确并且有效的目标检测。为解决图像分类中平移不可变性与目标检测过程中平移方差的矛盾,提出了位置敏感得分图。

在数据集中数据较少的情况下,本文提出了将迁移学习应用于改进R-FCN中实现SAR图像目标识别的方法。

1 SAR图像数据集

1.1 数据集介绍

本文数据源于美国国防高级研究计划局支持的MSTAR计划所公布的实测SAR地面静止目标数据。与光学图像识别不同,雷达图像识别更加困难,SAR的分辨率远低于光学图像。方位角的变化对SAR图像识别的影响是巨大的,此外,不同背景下的SAR图像对目标识别会产生很大的影响。

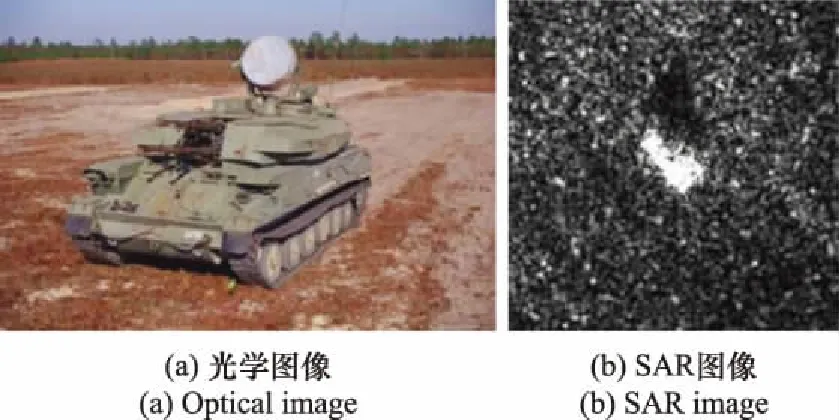

本文用于训练的数据集是雷达俯仰角为17°时所获得的SAR图像,用于测试的数据集是雷达俯仰角为15°时所获得的SAR图像。图1是MSTAR数据集中坦克的光学图像和SAR图像。

图1 目标图像Fig.1 Target image

对比可以看出这两者之间存在很大的区别,光学图像肉眼可区分出不同型号的战车,而通过人眼观察SAR图像无法区分出战车的不同型号,因而需要借助于计算机来区分。实验采用的训练集和测试集中分别包含五种类别的战车,分别为ZSU_23_4、ZIL131、2S1、T62、D7。每类中包含299个训练样本和274个测试样本。

1.2 图像数据集扩展

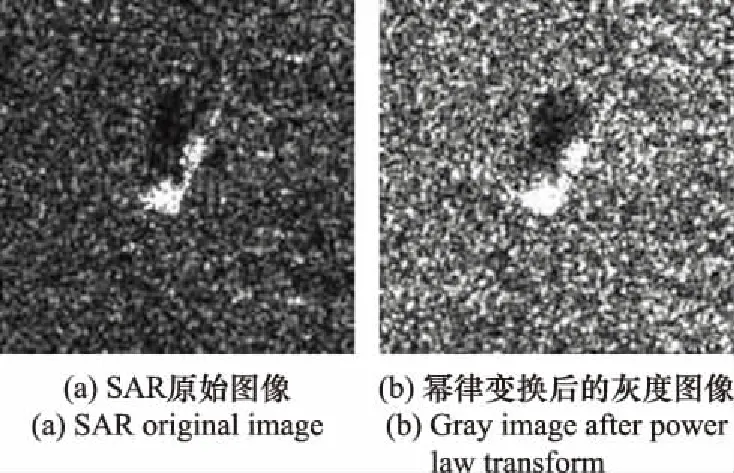

由于用于训练的数据集数量相对较少,使训练参数不能达到最优,不能得到很好的识别效果,需要通过图像增强中的灰度变换对训练集数据进行扩充,本文利用了幂律变换、对数变换与Imadjust函数,使原始训练集数据量扩充到原来的4倍。其中,利用幂律变换得到的灰度图像和原始图像如图2所示。

图2 灰度变换Fig.2 Gray scale transformation

2 R-FCN结构模型

人们对于图像检测的速度和精度的需求在逐步提高,在Faster R-CNN的基础上提出了R-FCN模型。R-FCN网络的主体部分可以适应不同的全卷积网络架构,无论是ResNet101还是ResNet152都能满足R-FCN的需求,从而提取出高质量的图像特征,本文采用ResNet101结构。

2.1 R-FCN网络结构

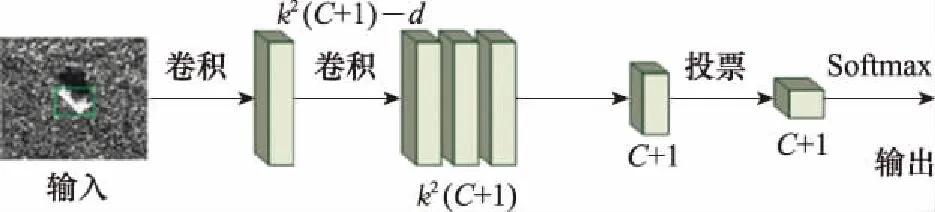

R-FCN网络结构如图3所示,包括了输入层、100层卷积层、感兴趣池化层以及千级全连接层。

图3 R-FCN网络架构图Fig.3 R-FCN network architecture diagram

R-FCN网络结构由完全共享、完全卷积的体系构成,针对共享网络检测精度不佳的缺陷,加入了位置敏感得分图,该部分负责对目标进行准确识别。假设最终要完成类目标的分类,对于一个待测物体,首先要对其ROI区域完成划分,使其分为×个子网格,每一个子网格中包含了待测物体的不同部分。经过各自对应后,判断每一个子网格内是否含有对应部分,如果符合要求,则识别成功属于该类别,否则归于其他类别。所以对于R-FCN来说,加上图中背景共有+1类,每一类又要经过次处理,所以需要(+1)个通道用来输出。

2.2 R-FCN工作原理

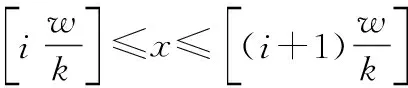

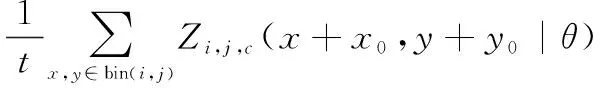

R-FCN网络在识别时,首先由RPN提取出候选区域ROI,每一类ROI都有高、宽和横、纵坐标4个参数,记为、、、。由于这些ROI都会被划分为×个子网格,故每个子网格的尺寸为(×)。之后,在第101层卷积层引入位置敏感得分图,将个子网格都与得分图上的相应区域进行位置敏感的评比,可以通过平均池化实现。给定区域(0≤,≤-1),假设坐标为(,)的子网格需要在得分图上寻找坐标同为(,)的位置完成池化操作,共进行+1次。平均池化原理如下:

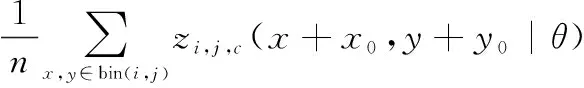

(,|)=

(1)

式中:(,)是第个类别的第(,)个子网格中的汇集响应,所以一个ROI可以得到(+1)个分数图;bin(,)代表ROI中个分块中第(,)个分块对应在特征图中的位置集合,,,是第(,)个子网格为类的分数值;+是ROI的左上角坐标;是子网格中的像素数;表示网络所有可学习参数。第(,)个子网格的范围如下:

(2)

(3)

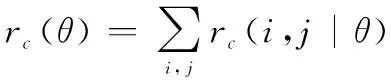

根据每一个子网格的得分图进行相应的筛选,利用每一类ROI的平均分数来完成目标判别。每个ROI产生一个+1维的向量

(4)

计算跨类别的最大响应如下:

(5)

式(5)用于评估训练过程中的交叉熵损失,随后对不同的ROI进行分类。

由于每类ROI都有4个坐标,在计算出位置敏感得分后还需要对其完成回归操作,故还需要4个卷积层用于包络框回归。对其进行位置敏感池化,为每一类ROI都产生4个矢量,然后平均得分可以将其聚合成4维矢量。这个4维矢量会将包络框参数化为=[,,,]。由于包络框回归后没有别的层级,所以网络的运算速度相应加快。

在试验中,R-FCN可以轻易完成端到端的训练,所以把损失函数定义为交叉熵和包络框回归的损失。在此过程中,若ROI的交并比(intersection-over-union, IOU)所代表的候选框与原标记框的重叠程度大于05,则将其判定为本类列,否则为其他类别。

3 基于改进R-FCN的SAR图像目标识别

3.1 改进残差网络的R-FCN

R-FCN的最初提出是对光学图像的目标检测,由于光学图像的灰度变化平滑并且目标特征明显,因此R-FCN的特征提取网络能够有效提取目标特征。SAR成像原理与光学成像原理不同,SAR图像带有很多相干斑噪声,严重影响特征的提取。卷积核的大小决定着卷积神经网络最终输出特征向量所包含的原图特征信息量的多少。卷积核越大,所取得的特征图的信息量越多。此外,卷积核越大越能够有效抑制SAR图像中的相干斑噪声对识别结果的影响。

残差网络中特殊的残差块可以极大提高目标图像分类的准确率。图4给出了本文中用到的残差块结构,其中残差结构是恒等映射和残差映射()两部分之和,ReLU为线性整流函数。

图4 残差网络结构图Fig.4 Residual network structure diagram

R-FCN的残差网络中每个残差块均包含着一个卷积核大小为3×3的卷积层,为了使特征图包含的信息量越大,使用5×5的卷积层替换原来的3×3的卷积层,残差网络能够有效提取出不同型号目标之间的差异。

3.2 改进位置敏感区域池化层的R-FCN

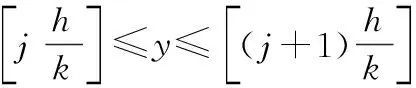

3.2.1 改进的位置敏感区域池化层

由于原始R-FCN网络中的位置区域池化层具有一定的特殊性,原始R-FCN网络结构的设计适用于目标检测数据集PASCAL VOC,此数据集中目标加背景一共有21类。位置敏感区域池化层(position-sensitive ROI pooling layer, PS ROI pooling)决定着R-FCN特征提取网络的特征图的个数。当检测目标类别越多时,网络提取的特征图个数越多,当数据集中目标加背景的类型远小于PASCAL VOC的类别时,会导致R-FCN网络畸形。

为了得到更好的识别率,对位置敏感区域池化层作出了更适合小类数据集的改进。首先通过RPN获得位置敏感区域的位置,将其与特征图结合生成位置敏感分数图,然后对位置敏感分数图做全局最大值池化,得到长度为(+1)的特征向量,最后对特征向量做全连接操作并放入Softmax中进行分类。将ROI pooling层改为ROI Align后采用双线性内插的方法获得像素点上的图像数值,从而使特征聚集过程连续操作。

改进的位置敏感区域池化层具体步骤:将大小为×的ROI分割成个矩形小方块,其中宽为,高为,公式如下:

(,|)=

(6)

式中:(,)表示ROI和位置敏感分数图的每个分块位置,(,)的取值范围为0≤≤-1, 0≤≤-1;(,│)为位置敏感分数图第个通道中个分块中的第(,)个分块;,,为特征图中第通道的数据,的取值范围为0≤≤(+1);(,)表示ROI的左上角坐标;(,)表示ROI中以(,)为原点时每个元素的坐标值,且(,)的取值范围为×≤≤(+1)×,表示第(,)个块里的像素总数,且表示网络参数。

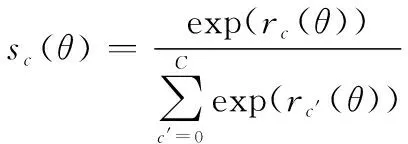

322 损失函数

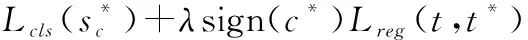

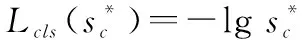

为了使改进的R-FCN能够准确地识别SAR图像型号,需要依据最小化损失函数的原则训练卷积网络模型。损失函数由分类损失函数和定位损失函数组成,公式如下:

(7)

式中:是调节系数;是感兴趣区域所属的SAR图像型号类别,分类损失函数由交叉熵函数表示,即

(8)

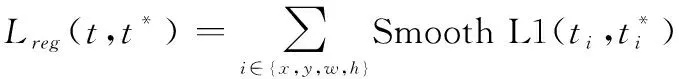

定义损失函数是Smooth L1损失函数,即

(9)

其中,Smooth L1函数为

(10)

3.3 迁移学习的R-FCN

迁移学习可以将学到的对图像分类的理解分享到新模型中,神经网络从数据中获取信息并将其换成相应的权重。这些权重被提取出来迁移到其他神经网络中,加快并优化了模型的收敛速度。

在基于迁移学习的改进R-FCN网络的训练过程中,利用预训练模型进行特征提取。去掉输出层后将剩下的网络当做已经训练好的特征提取机应用到新的数据集中。这个过程中,需要对特定层进行训练得到新的权重,冻结其他层保持其权重不变,因此加快了图像识别的速度。

4 SAR图像目标识别结果及分析

4.1 Faster R-CNN模型实验结果及分析

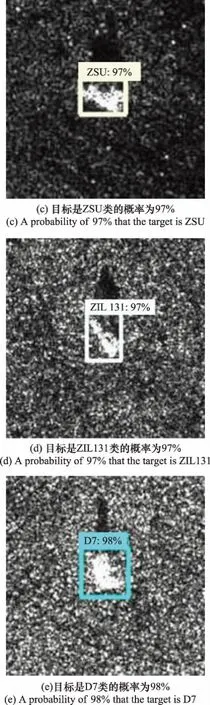

本节实验采用Faster R-CNN网络对SAR图像进行识别分类。数据集上预训练VGG16模型用来提取网络特征图,学习率为0.002,动量为0.9,权重衰减设置为0.000 5,最大迭代次数为45 000。

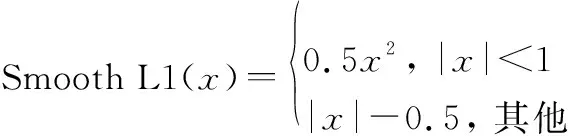

通过训练集对Faster R-CNN模型进行训练优化后,利用测试集检测该模型,得到识别结果,部分识别结果如图5所示。在实验中每种类别分别进行测试,若识别出的类别与目标类别不一致,则认为识别错误,若没有标注出识别框,则认为漏识别。各种类别的所有测试数据集,通过Faster R-CNN网络模型对SAR图像进行目标识别,得到的目标识别率基本在80%以上,最高可达到95%,识别效果较好。

图5 Faster R-CNN模型识别目标结果图Fig.5 Target recognition results obtained by using the Faster R-CNN model

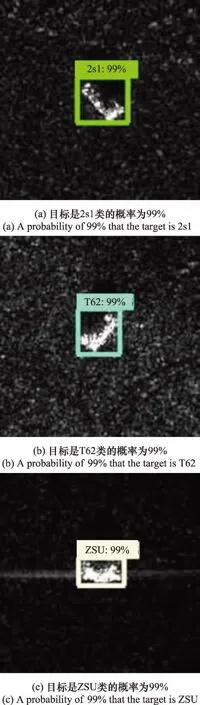

4.2 R-FCN模型实验结果及分析

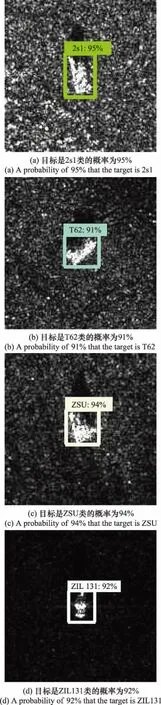

本节实验采用R-FCN网络对SAR图像进行识别分类。用同样的数据集对R-FCN网络模型进行训练与检测,为了与Faster R-CNN的识别结果进行比较,实验中的参数设置与Faster R-CNN网络的参数设置一致。实验得到的部分识别结果如图6所示。利用训练集数据对原始R-FCN网络模型进行训练及优化,再将测试集数据应用到优化后的R-FCN网络模型。结果显示,R-FCN网络模型对SAR图像识别率基本在95%以上,最高可达到97%。识别结果与Faster R-CNN的识别结果相比较,识别率得到提高,说明R-FCN对SAR图像目标识别方法较Faster R-CNN优越。

图6 R-FCN模型识别目标结果图Fig.6 Target recognition results obtained by using the R-FCN model

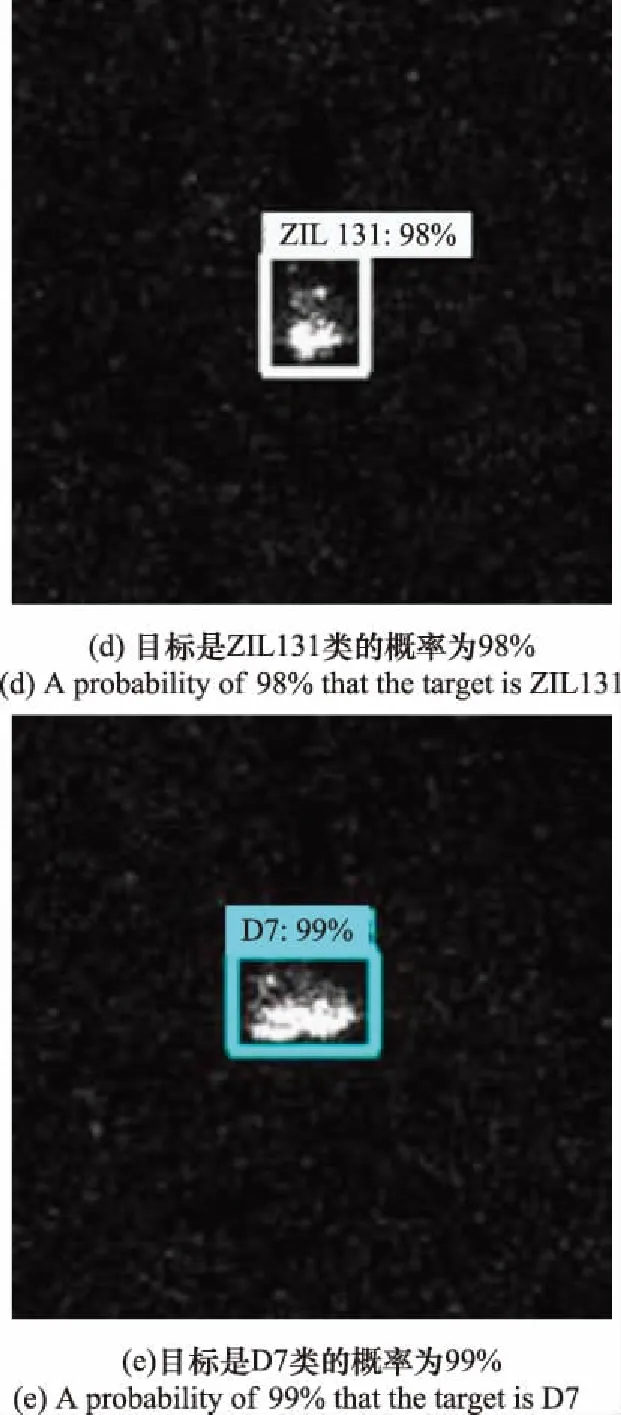

4.3 基于迁移学习的R-FCN的SAR图像识别

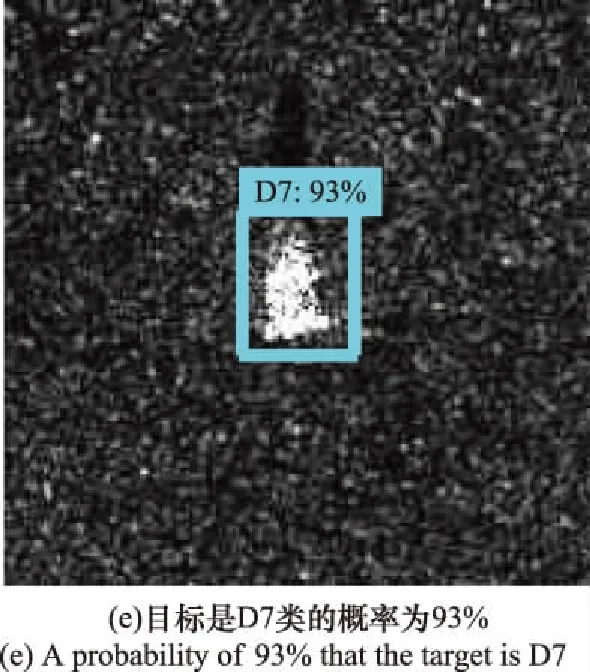

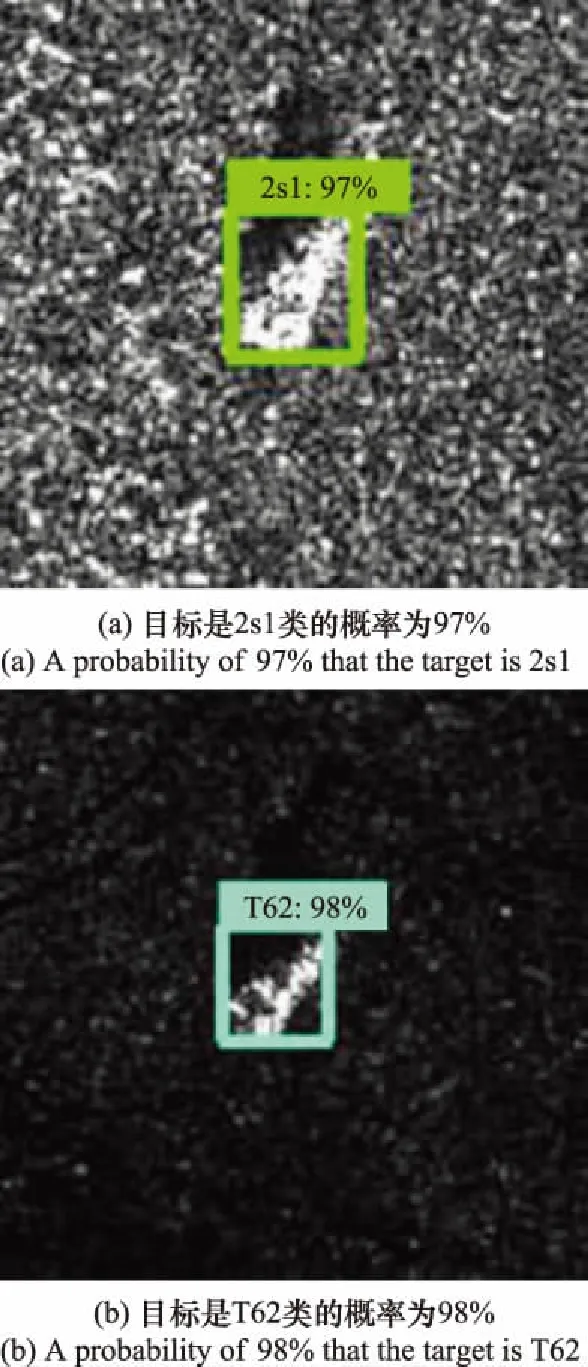

本节基于迁移学习的R-FCN网络对SAR图像识别分类,利用构建好的数据集对训练好的模型进行仿真实验,得到识别结果如图7所示。通过分析实验结果可看出,基于迁移学习的R-FCN网络模型对SAR图像的识别率均在98%以上,最高可达到99%,具有很好的识别结果。

图7 迁移学习的R-FCN模型识别目标结果图Fig.7 Target recognition results of R-FCN model based on transfer learning

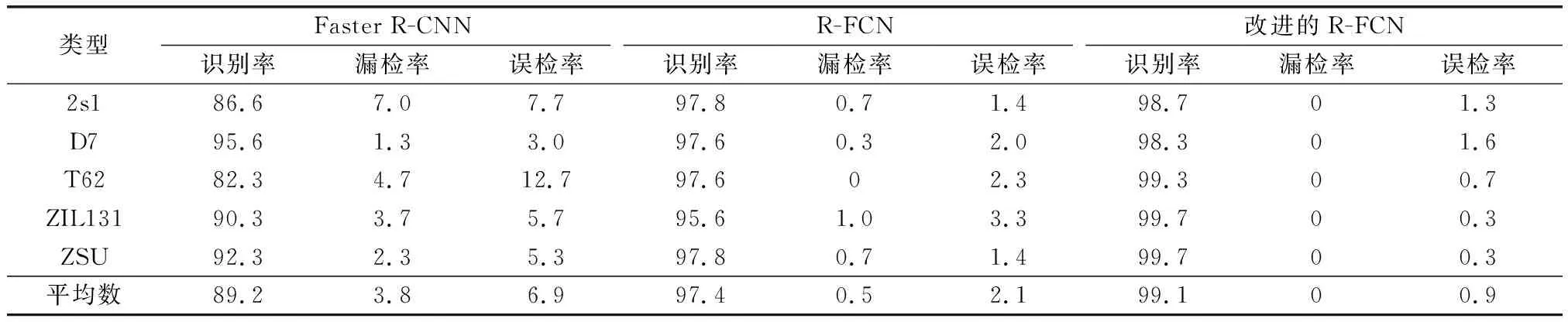

4.4 Faster R-CNN、R-FCN和改进的R-FCN模型SAR图像识别结果对比

将文中提到的3种方法识别结果进行统计,得到的结果如表1所示。表1是在整体测试集中利用3种模型进行测试,得到的图像正确识别率、漏检率和误检率。通过表1对比分析可得,在常用的目标识别算法中,本文提出的基于迁移学习的R-FCN网络模型对SAR图像的识别率已经超过传统的识别算法,对R-FCN网络中网络结构以及各层参数的优化,使得R-FCN对SAR图像的识别能够得到更优的结果。

表1 3种算法检测识别率、漏检率及误检率的统计结果Table 1 Statistical results of detection and recognition rate, omission rate and error rate of the three algorithms %

5 结 论

本文主要研究基于深度学习的SAR图像目标识别算法,将深度学习中全卷积网络框架应用于SAR图像识别中。首先通过图像增强的方法对数据库进行扩增,引入迁移学习方法训练改进R-FCN模型实现对SAR图像的识别。通过对实验结果对比分析,可以看出改进后的R-FCN网络模型的目标识别率略大于原始的R-FCN模型的图像识别率,同时也减少了训练需要的时间。所以当数据集较小时,本文所提方法很好地满足了目标识别的精度和效率。

在本文的基础上,还可以对R-FCN网络作进一步改进,除了将迁移学习运用到R-FCN中,还可以改变残差网络的部分或者改变损失函数的参数值,进而改善图像识别的准确性。由于现阶段R-FCN网络应用于SAR图像识别的研究相对较少,大多数还用于识别光学图像,所以在这方面还需要更加深入的研究,希望能设计出更适用于SAR图像识别并且识别率更高的算法。