短视频推荐算法的运行逻辑与伦理隐忧

——基于行动者网络理论视角

2022-02-11温凤鸣解学芳

温凤鸣 解学芳

[提要]从行动者网络理论视角探寻短视频推荐算法的“黑箱”与运行逻辑,以及由此带来的算法伦理问题在智能时代尤为重要。短视频推荐算法是由短视频平台管理者主导的,与用户、商业资本、行业政策等行动者相互影响和动态建构而成的,并非纯然中立的客观物,而是具有价值观的行动者。短视频推荐算法中内嵌了用户偏好、社交关系、公共议题、场景、差异化和平台优先级六大价值观念要素,反映出流量至上和商业利益优先的算法价值观,以此为依据的短视频推荐算法实践带来了隐私泄露、信息窄化和算法歧视等伦理问题,亟需短视频平台公开并优化算法、用户改变信息消费习惯和提升算法素养、行业协会和政府部门加强算法审查与监督,从而促进算法“向善”更好地造福人类。

当算法介入媒体信息传播过程中时,媒体信息把关的权力逐渐由人(编辑)转移到了算法机器,算法对信息的筛选和过滤决定了人们接触信息的类型,同时也为人们设置了个性化的议程。由算法驱动的个性化短视频推荐系统根据用户特征进行相应内容匹配,暗含“你是谁”决定“给你推荐什么”的逻辑,而这一决策过程是在“黑箱”中进行的。为了揭开推荐算法的神秘面纱,了解推荐算法的决策依据,本文以抖音短视频推荐算法为研究对象,从行动者网络理论视角探究短视频推荐算法的运行原理及其与其他行动者的联动机制,考察内嵌于推荐算法设计中的价值观,以及在此价值观下短视频推荐算法实践产生的伦理困境,从而系统审视“算法分发”问题。

一、算法:非人类的网络行动者

20世纪80年代中期,社会学家布鲁诺·拉图尔(Bruno Latour)、卡龙(Michel Callon)、劳(John law)等巴黎学派代表在科学知识产生的问题上批判了英国科学知识社会学家大卫·布鲁尔(David Bloor)的“强纲领”,进而提出一种新的研究纲领,即行动者网络理论(Actor Network Theory)。该理论突破传统二元论模式下的自然实在论和社会建构论之争,认为社会因素、科学实践是产生于同一进程的一体两面,二者相互影响、相互建构[1](P.4)。作为一种研究方法,行动者网络理论把社会看成是一种互相联结的科学(而非涂尔干所说的社会实体),并认为社会是由许多异质性事物之间联系构成的复杂网络,包含“行动者”“转译”和“网络”三个核心概念。其中“行动者”指科学实践中的一切参与要素,包括人类的和非人类的,能对事物状态改变起作用的要素都纳入行动者之中。因此,行动者不仅指人,还包括了技术、资本、仪器、程序、观念等非人类因素,非人类因素会寻找代言人来获得主体地位、资格和权利。在康德的主客二分的认知模式下,人们习惯性地将现象划分为人类与非人类、社会与自然等二元对立模式,而“以人为中心”的习见使技术、资本等非人类因素视为认知上的客体而非行动者,但它们对科学实践却具有重要的影响[2]。“行动者网络”是由异质行动者建立的,指通过相互联结的“网线”使资源集中到少数结点,使分散的资源通过该网络而扩散到各个地方。每一个行动者都会在自己的周围建立一个网络,使其他要素依赖自己。“转译”指行动者把其他行动者的问题和兴趣(利益)通过自己的语言翻译和转换出来的过程。所有行动者都处于转译和被转译之中,转译是行动者网络得以形成的原因,也是维系行动者网络的动态机制[3]。转译过程通过问题呈现、利益赋予、招募成员和动员四个步骤实现[4](P.121)。

根据拉图尔对行动者的定义,行动者要能改变事物状态、能造成差异。而推荐算法能够改变到达用户的内容性质,算法设计方法不同,到达用户的内容就不同,内容在算法这里发生了转化,同时算法本身也随着用户的变化而处于动态变化之中。因此,在信息分发的网络中,推荐算法是一个非人类的网络行动者。

拉图尔认为行动者必须到行动的过程中去寻找。在社交短视频内容分发的网络中,除了推荐算法之外,行动者还包括推荐算法的管理者即短视频平台的管理者、为推荐算法提供短视频内容的专业、非专业、职业内容生产者(PGC/PUGC)和运营者,以及通过浏览、点赞、评论、转发短视频进而给推荐算法提供接收反馈的用户。推荐算法作为一种非人类的行动者,与短视频平台、短视频内容生产者和运营者、用户共同构成一张短视频内容分发之网。那么,在这张网络中推荐算法与平台、内容生产者与运营者、用户之间形成了何种关系?推荐算法作为非人类的行动者是否和人类行动者一样具有价值倾向?本研究试图打开短视频推荐算法的“黑箱”。所谓“黑箱”原本是控制论者用来表示任何一部过于复杂的机器或任何一组过于复杂的指令,拉图尔借用此概念表示那些影响科学知识和科学理论产生的各种不透明因素的总称,认为科学史上的好结果往往是由打开黑箱造成的,只有打开黑箱才能指出混乱并使事情朝向另一种可能的秩序发展[1](P.7)。鉴于此,打开推荐算法的“黑箱”主要是通过揭示推荐算法内容分发背后的运行逻辑以及在此运行逻辑之下的算法实践带来的伦理隐忧,进而推动短视频推荐算法朝着更好地服务人类的方向进化。为此,本文以当前国内用户规模最大的短视频平台“抖音”(日活用户6亿)为例,运用网络民族志方法,对短视频推荐算法进行参与式观察①,着重分析“推荐”栏目黄金时段②的短视频内容,结合笔者对抖音的使用情况③(注册账号、发布内容、关注、点赞、收藏等情况),从行动者网络理论视角考察短视频推荐算法的运行逻辑和内嵌于短视频推荐算法中的价值观念,以及以此为依据的算法实践带来的伦理问题。

二、“代言”:短视频推荐算法的运行逻辑

推荐算法作为非人类的行动者,其能动性通过“代言”机制实现,换言之,推荐算法被短视频平台管理者、算法设计者代言,从而获得主体地位,具有筛选、定义、推送信息和记录、存储个人数据的能动性即特殊权力,取代传统媒体中把关人角色的价值判断和把关权力[6]。从行动者网络理论角度看,算法的运行逻辑是以“代言人”的价值观念为基础的,算法执行的是“代言人”的意志。因此,推荐算法的运行逻辑包含技术逻辑和价值逻辑两部分,其中技术逻辑指的是算法对推荐内容的过滤、筛选机制;价值逻辑是指算法推荐内容的“把关”标准或价值依据。前者体现为协同过滤推荐机制,后者体现为推荐算法价值观念要素。

(一)算法和用户“互为主体”:短视频协同过滤推荐机制

推荐算法是一种借助大数据分析和信息过滤机制从而将信息内容和用户进行精准匹配的技术,已广泛应用于资讯、电商、搜索引擎、短视频等互联网平台中,算法内容推荐已占整个互联网内容分发的70%[6]。算法技术对于内容分发的重要意义在于实现从“人找信息”到自动“信息找人”的转变,既极大地解放了人力,还大大提高了人们获取信息的效率。当前短视频的推荐算法有多种类型,如基于内容、用户关系、创作时间与内容质量权重、地理位置等推荐,一个短视频平台不是局限于一种推荐算法,而是同时采用多种推荐机制,使用户(接收者)对算法所推荐的内容感到“千人千面”或个性化。当前短视频平台大多采用了协同过滤(CF)推荐算法,包括基于记忆(用户和内容)和基于模型的协同过滤两种类型,推荐核心是相似度,即依据相似度对用户和内容进行分类后再进行推荐。协同过滤算法的思想,即“用户分类中属于同一类别的用户会对同一类内容感兴趣,或者内容分类中属于同一种类的内容将受到同一用户的喜爱”[7],具体而言,就是当用户上传的短视频内容通过机器审核并加内容标签之后,平台推荐算法会将短视频匹配给相关用户人群,从而易于找到用户的兴趣和爱好,带来推荐结果的丰富多样。

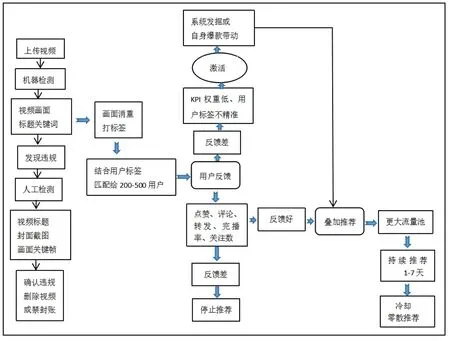

协同过滤算法对短视频内容的推荐主要以用户画像和用户反馈为依据,即根据算法对用户画像所形成的标签与内容标签进行大致匹配,随后根据用户对所推荐内容的反馈(浏览、点击、点赞、转发、评论、关注)调整下次推送的内容以及与之匹配的用户人群,从而实现算法的不断优化。以抖音为例,笔者结合网络有关资料,整理出该平台的算法推荐流程(见图1):首先推荐算法会根据视频内容标签推送给对视频可能感兴趣的200-500个在线用户,并计算单位时间内(一般1小时)用户的完播率、点赞数、关注数及关注主页数、评论数及评论点赞数、转发数(权重依次递减),据此计算所推送短视频内容的热度,若热度较高则进行多次叠加推荐,推荐给更多潜在用户;第二次推荐给1000-5000人,第三次推送1.5-2万人,第四次12-15万人,第五次60-80万人,第六次300-500万人,第七次800-1300万人,第八次即标签人群推荐,推送给5000万人以上,直至成为热门短视频。与此同时,那些在第一次推荐中被过滤掉的短视频内容被爆款内容带动获得巨大关注(赞评转)时,算法还会据此(即流量)重新放入推荐池进行推荐。由此可见,抖音算法的协同过滤推荐机制本质上就是一种流量至上的推荐方法,需要以算法与用户之间的互动为前提。在短视频内容分发的行动者网络中,作为非人类行动者的推荐算法与人类行动者——用户的关系是“互为主体”,一方面算法对用户的动作特征及行为数据进行收集并算出用户的需求,再根据用户需求进行个性化内容推荐;另一方面用户行为也在调整和修改算法并影响算法的下一次推送。算法和用户始终处于动态的变化之中,二者的实践呈现出结构二重性特征。

图1 抖音算法推荐流程

(二)行动者的价值逻辑:短视频推荐算法价值观念六要素

在将短视频内容匹配给用户的过程中不仅仅以用户反馈作为推送依据,同时还涉及了推荐算法作为行动者的价值逻辑及价值观念。在这一过程中,算法进行“内容-用户”精准匹配的标准,即算法行动的根本依据是平台管理者、算法设计者等“代言人”的价值逻辑,而算法“代言人”的价值观又受到了商业逻辑、行业政策、用户等行动者的影响。

算法自动决策主要通过排序、分类、关联和过滤四个过程实现[8]。尽管算法看起来是一套计算机程式,大部分人也都将它看作不涉及价值的技术工具,如技术决定论者认为,和人类的主观价值判断相比较,算法是公平的、中立的。国内较早采用推荐算法技术的网络平台今日头条也宣称“没有采编人员,不生产内容,没有立场和价值观,运转核心是一套由代码搭建而成的算法”[9]。然而从行动者网络理论来看,算法并非中立的,而是由行动者共同建构出来的,算法的设计研发、更迭等过程受到许多社会性因素的影响。如判断标准的选择、数据提取、语用分析、结果解读等都会对算法施加重要的影响,这些人为因素内嵌于算法规律之中。叶夫根尼·莫洛佐夫在《技术至死:数字化生存的阴暗面》一书中以“自动完成”功能为例揭示了google搜索引擎算法并非客观中立而是有价值观的事实[10](P.151-152)。美国学者迈克尔·德维托(Michael DeVito)通过对公开发布的专利、新闻稿、博客等进行内容分析,总结出Facebook内容推荐算法的九大价值要素,分别是朋友关系、用户公开表达的兴趣、用户先前的参与、用户含蓄表达的偏好、发布时间、平台优先级、页面关系、用户的负面表达、内容本身的质量[11]。国内学者王茜通过定量法揭示了今日头条平台推荐算法的价值观四要素,即场景、内容、用户偏好和平台优先级[12]。而具体到短视频平台的推荐算法,其价值观体现在用户偏好、社交关系、公共议题、场景、差异化和平台优先级六个维度(见表1)。

表1 抖音推荐算法价值观念六要素及权重④

1.用户偏好:基于用户显性或隐性表达偏好的相似性推荐

用户偏好是抖音推荐算法的首要价值要素。在参与式观察中,研究者每日统计抖音“推荐”栏目推送的内容,包括短视频内容的类型、内容描述(视频标题、文字描述)、条数和内容来源(企业、PUGC博主、UGC博主、传统媒体、电商、政务号、明星、其他视频平台),共获得推荐短视频229条,其中基于笔者“偏好”或兴趣⑤推荐的内容最多,为115条,占所有推荐内容的50.2%。在所有推荐内容中包括广告或卖货视频52条,占推荐内容的23.1%;好友日常生活44条,占推荐内容的19.2%;育儿/教育类视频27条、知识分享19条、新闻资讯17条、视频特效16条、美食11条、搞笑/土味视频10条、心灵鸡汤3条、微综艺4条(均来自传统媒体)、微剧3条、明星娱乐2条、电影解说1条、舞蹈2条、读书2条、猎奇2条、情感正能量3条、时尚美妆2条、运动健身2条、艺术表演2条、风景3条、热点1条、萌宠1条,共涉及23个类别。同时,为了避免手动分类统计的误差,研究者还运用“图悦”词频软件对推荐短视频内容描述进行了词频统计,得到抖音推荐视频内容的热频词汇,排名前五的热频词汇分别是:孩子(13次)、教育(12次)、精锐(7次)、日常(6次)、娱乐(5次)。反映出亲子、教育、广告、泛生活、泛娱乐是抖音推荐给研究者的五类主要短视频内容。

算法对用户内容偏好或兴趣的判断是以用户画像为依据的,而用户画像又以用户显性或隐性表达的偏好为根据,用户偏好价值要素实际上就是算法基于用户显性或隐性表达偏好的相似或相关性推荐。抖音短视频沿袭了其母公司“今日头条”的推荐算法机制:“当用户绑定微博登录后的5秒钟之内,系统会为用户建立起一个DNA兴趣图谱。这个图谱类似于一个数学模型,主要根据用户SNS账号上的标签、关注人群、好友、评论/转发、收藏等数据,以及用户的手机、位置、使用时间等数据提取而来。其中包括可视的兴趣(兴趣、爱好等比较好衡量的因素)和不可视的兴趣(清新、文艺等主观因素)两大主题,上万个维度。随后系统会自动记录用户的阅读情况,不断摸索用户兴趣,同时算法也在不断优化。六七次之后,机器就能基本判断用户的兴趣了”[13]。参与式观察发现,用户偏好是抖音算法系统依据用户基本信息、环境终端、动作特征进行综合用户画像的结果。如研究者在浏览过“魔性摇摆头”特效视频后,抖音随后立马推荐了“好玩特效”的相似短视频,推荐算法会根据用户的浏览记录(显性偏好)即时调整和更新算法,重新匹配与之前浏览内容相似的内容。算法还会根据用户之前所发布内容的类型进行相关性推荐。如抖音根据研究者之前发布的亲子短视频而推荐了亲子互动内容及与孩子相关的广告。除了浏览记录、发布内容等用户主动表达的内容偏好之外,算法还会根据用户注册信息中的性别、年龄推荐相关内容,心灵鸡汤、时尚美妆短视频即是基于此而推荐的。相似或相关性推荐与抖音采用的协同过滤推荐算法有关,其原理前文已论述,即从用户侧寻找用户间的相似性,给兴趣相同或相似的用户进行相关推荐,或者从内容侧寻找内容的相似性,给曾浏览过相似内容的不同用户进行相关性推荐。由此可见,用户偏好是短视频推荐算法最显著也是最核心的价值观要素。

2.社交关系:基于用户社交相关性的圈层化推荐

基于用户的社交关系进行相关性、圈层化内容推送是抖音推荐算法的另一个显著行动逻辑。抖音算法基于社交关系一周内给笔者共推送了65条短视频内容,占所有推荐内容的28.4%,主要以用户在抖音平台上所关注的好友、用户手机通讯录好友这两类一级社交关系为主,通过参与式观察发现,抖音算法每天推送给笔者的第一条短视频即为笔者所关注好友的内容;除此之外,抖音还会推送用户关注好友的好友、通讯录好友的好友即二级社交关系中的内容,基于一级社交关系和基于二级社交关系推送的条数分别为58条(关注好友内容21条、通讯录好友内容37条)和7条,说明与一级社交关系的强关系相比较,二级社交关系与用户的连接较弱,不能产生很强的影响力。在社交关系价值维度,还发现一个值得关注的现象——抖音会基于关注好友、通讯录好友、关注好友的好友的兴趣进行“用户-内容”匹配,换言之,抖音算法会基于用户好友兴趣的数据分析而将用户好友的兴趣转移给用户。这也是为什么有些学者将社交关系维度纳入用户偏好范围进行考察的主要原因。将社交关系单独作为一个价值要素进行考量,一方面是要突出社交关系维度在算法推荐机制中的显著性,另一方面说明基于社交关系特别是基于通讯录好友及二级社交关系的内容推荐并非出于用户兴趣的考虑,而是对用户与多层“好友”相关性的权衡,然而这种相关性与用户兴趣之间并没有必然的联系,因此基于社交相关性的内容匹配度并不高,因为通讯录好友及二级社交关系的内容并不是用户真正感兴趣或真实的内容偏好,而算法硬将通讯录好友及二级社交关系的内容匹配给用户,把用户信息接触的范围限制在特定社交圈层内,严重影响用户接触其他内容的机会。在参与式观察中还发现,算法推荐的通讯录好友及二级社交圈的短视频内容大多为闲碎的日常生活,内容价值并不高,并不能激发用户的好奇心和观看兴趣。

基于社交关系推送短视频内容的价值逻辑背后,还有一个值得深思的问题:推荐算法是如何获取用户手机通讯录好友信息的呢?在用户下载短视频App时,选择或默认了允许平台访问通讯录,相当于给平台算法“赋权”,同时用户毫无意识、稀里糊涂地被动成为算法的“代言人”。用户在使用中会发现,这种基于通讯录好友的内容推送方式可能带来个人隐私泄露问题,一方面使用户发布的短视频内容暴露在了用户通讯录好友这一熟人圈层中,而这种暴露是平台对“推荐给可能认识的人”这一功能默认开启的结果,只有深度用户或算法素养较高的用户才会有意识地在“隐私设置”中关闭这一功能,没有隐私保护意识的大多数用户则选择了默认算法将自己发布的内容推送给可能认识的其他人。另一方面,基于二级社交关系的推送还会暴露用户的社交关系隐私,好友的好友、通讯录好友的好友关系、共同好友等原本属于用户个人隐私的信息却在算法推荐之下暴露在了公共空间之中。

3.场景:基于用户所处位置和情境的相关性推荐

罗伯特·斯考伯等人提出的场景理论认为,“移动设备、社交媒体、大数据、传感器和定位系统是场景时代的五种技术力量,五种原力正在改变作为消费者、患者、观众或在线旅行者的体验,同样也改变着大大小小的企业。”[14](P.11)学者彭兰认为“场景”概念包含空间与环境、用户实时状态、用户生活惯性和社交氛围四个要素。进入移动互联网时代,移动传播的本质是基于场景的服务,即对场景(情境)的感知和信息(服务)适配[15]。短视频作为一种移动社交媒体,其推荐算法不仅会根据用户所处的地理位置即GPS定位和用户使用网络的IP地址判断用户所处的方位和空间进行同城或本地内容推送,同时还会根据用户的生活惯性判定用户所处的特定情境而进行相应内容推送。

抖音推荐算法的场景价值要素主要体现为向受众推送本地内容以及基于情境——特定节日或用户处于“休息”情境而进行相关内容推送。一是推送了本地内容(以研究者所处上海为例),包括上海企业广告(教培类为主)、上海美食、上海网红直播卖货、上海@罗先生讲段子搞笑内容。本地内容推荐是抖音算法基于用户GPS定位而推送的,借助于LBS、物联网等技术实现的信息与位置场景的适配。二是推送了娱乐、情感消遣和直播卖货内容,包括微剧、微综艺、搞笑/土味短视频、心灵鸡汤、卖货视频等,呈现出较强的娱乐性、情感性和商业化特征,而算法对这部分内容的推送是根据用户所处的特定情境,即晚上八点至十点对于大多数人而言正是休息的时候,据此而给用户推送泛娱乐、情感或购物内容,供用户消遣或消费。因此,基于场景的算法推荐本质上是短视频内容与用户所处的地理位置或特定情境的相关性匹配。

4.差异化:探索用户兴趣边界的推荐

差异化内容推荐是与用户偏好、社交关系、场景等相似性或相关性推荐相区别的一个价值要素,以用户以往完全没有接触过且并非用户已有偏好的短视频作为推送内容。从理论上而言,差异化内容推送既可以平衡用户接触信息的类型,使之更为多样化;还可以用于试探和拓展用户的兴趣边界。根据研究者的参与式观察,在抖音算法推荐的内容中,还有一些难以找出算法推荐依据的内容,如户外活动钓鱼、萌宠(猫)、才艺表演对口型、瑜伽等差异化内容,从数量上看并不多,且大多只推送过一次。这些内容既非笔者的偏好,也不是社交关系圈的内容,更非场景化或平台优先级推送的内容。分析发现,抖音算法之所以会推荐这些差异化的内容,其最大可能性是用来试探用户兴趣边界的。

对于初级用户,短视频推荐算法在无法获得准确的用户偏好和兴趣图谱的情况下,算法会推送一些与用户兴趣和偏好不一样的内容来观察用户的反应,再根据用户反馈数据进而调整推荐算法,从而形成“差异化内容-反馈-新的兴趣-相似性内容推荐”的闭环。差异化内容推荐在用户与算法的互动中通过确认用户兴趣最终走向相似性推荐。因此,以用户反馈(即流量)至上的算法推荐逻辑实际上并不能真正有效平衡用户接触内容的多样性,而要达成这一目的,需要以降低推荐算法中的用户反馈权重为前提。由此可见,差异化内容本质上只不过是短视频平台用以探索用户兴趣边界的“诱饵”,据此发掘和培养用户新的兴趣。从这个角度而言,推荐算法在人性面前就犹如钓饵,一步一步吊出人的欲望和本能。换言之,人们对信息的“偏好”或“需求”一定程度上是算法培养的结果,并非人们主观上的真实需求。

5.公共议题:PGC传媒机构转型与行业政策影响的结果

公共议题是短视频平台传播的以新闻资讯为主的、具有公共性质、能为公众设置议程的视频内容。短视频迅猛发展使用户注意力从传统媒体转向移动网络平台,传统媒体迫于生存压力不得不向新媒体转型。随着主流媒体入驻抖音等短视频平台,越来越多的新闻资讯也在短视频中出现,使短视频平台愈发具有媒体属性。与此同时,为了引导短视频内容向主流价值和正能量方向发展,《网络短视频平台管理规范》要求“短视频平台在内容版面设置上,应当围绕弘扬社会主义核心价值观……应遵守国家新闻节目管理规定,不得转发UGC上传的时政类、社会类新闻短视频节目”[16],因而算法只能推荐传统媒体机构发布的PGC新闻内容。由此,短视频算法对新闻资讯为主的公共议题的推荐一定程度上是传媒机构转型与行业政策共同影响的结果。

新闻资讯与用户接触的主要以个人兴趣为主的个性化内容不同,它是一种公共议题,具有公共性,不仅能够传递新近发生的事实,还能够为公众设置议程。从传播效果的角度而言,公共议题的推荐是对基于个人偏好与兴趣的个性化内容推荐的一种调和与补充,能够扩大用户的信息视野,避免信息窄化带来的茧房效应——个体只关注自己感兴趣和偏好的内容而导致的认知窄化、视野偏狭和思想封闭。有研究者认为在当前算法推荐内容过于个人化、内容质量不高的现状下,短视频平台应提高公共议题和主流价值的算法权重,以平衡推荐内容的类型和质量[17]。据参与式观察统计,抖音算法推荐的新闻资讯占所有推荐内容的7.8%,与基于用户兴趣的个性化内容(50.2%)推荐相比较,抖音算法推送的新闻资讯数量要少得多,算法推荐的新闻资讯主要来自央视新闻、人民日报、人民网、新华网、澎湃新闻、四川日报、重庆电视台、环球网、羊城晚报等中央和省级新闻媒体;推送的新闻内容均为当天的热点新闻,从新闻类型上看,抖音推送的新闻类型较少,以社会新闻为主。新闻内容推送中,算法未体现出明显的用户偏好,如研究者仅关注了央视新闻、人民日报、澎湃新闻,其余媒体并未关注,也未曾主动搜索过相关新闻内容或主动浏览过这些媒体账号却得到了推荐,可见抖音算法对新闻资讯的推荐主要以时效性和热门程度(流量)为依据。

6.平台优先级:商业逻辑之下的推荐策略选择

平台优先级是影响信息流呈现的因素之一。所谓平台优先级是指在信息流中优先呈现平台自身产制、与平台活动相关、与平台合作的其他平台或机构生产的内容。对于抖音算法而言,会优先推送抖音平台本身的活动、抖音旗下另一个短视频平台“西瓜视频”中的内容,以及与抖音平台合作的MCN机构的内容,平台优先级因此也成为抖音推荐算法的价值观念要素之一。平台优先级这一价值观念要素,是商业资本这一不可见的行动者隐秘操纵的结果。

具体而言,推荐算法对短视频内容的推送受到商业逻辑和商业资本的影响,对来自不同平台或生产者的短视频内容在推送的优先顺序和数量上呈现出差异性。尽管普通内容生产者发布的短视频也属于抖音平台,但是并没有得到算法同等概率的推荐。与普通内容生产者发布的短视频内容相比较,抖音算法对平台自身或平台合作机构生产的短视频内容进行了优先推荐,一是优先推送了平台本身的活动视频。例如抖音推出了“doudream创作者计划”,为了宣传这个活动,抖音优先推送了由粉丝量五十万以上的多个博主拍摄与宣传该计划的短视频,如“2.8亿流量扶持,破500W播放春天来了”“抖音千亿流量扶持计划来了”等。二是优先推送了抖音旗下另一个短视频平台“西瓜视频”中的短视频内容。如推送来自西瓜视频的“718磅艾伦的故事”“千斤男人”等猎奇性内容。三是优先推荐了平台合作机构广告商、MCN机构包装的网红博主(粉丝量十几万以上的)所发布的内容。这些企业和MCN机构与抖音平台建立了商务合作关系,算法对他们的优先推荐是以商业逻辑为前提的。平台算法会对短视频平台签约的MCN账号给予加权,将其生产的短视频内容优先推荐给更大数量规模和相关度更高的用户流量池。这也是抖音推送内容中为什么有高达23.1%比例的广告或卖货视频,以及推送内容大多来自高粉丝博主的根本原因。然而高粉丝博主发布的短视频并非都是优质、高质量的内容。由此可见,推荐算法在技术中立的表象下隐秘地实施着算法权力,算法所使用的加权、降权即是算法权力控制的具体体现。算法权力所体现的恰恰是商业资本的意志和一种隐蔽的商业逻辑。

拉图尔认为行动者网络是由异质行动者共同建构而成的,行动者之间相互作用,彼此影响。综上可知,在短视频内容分发的网络中,推荐算法这一行动者的价值观受到了用户、资本、制度等其他行动者的影响。在短视频推荐算法的六大价值要素中,用户偏好、社交关系、场景、差异化四个价值要素受到用户喜好和内容需求的影响,公共议题则是受行业政策影响的结果,平台优先级是平台管理者商业逻辑之下的推荐策略选择,平台为了自身商业利益而优先推荐平台自身的活动、内容或与平台有商业合作的MCN机构产制的短视频内容。因此,在短视频内容分发的行动者网络中,除了平台管理者、内容生产者与运营者、用户等可见的行动者之外,还存在行业政策和商业逻辑这两个“不可见”的行动者,可见和“不可见”的行动者共同影响和形塑了短视频推荐算法的价值观并最终体现为价值观念六要素。如果说公共议题这一价值要素反映的是公众利益和公共价值,那么,其余五大要素所反映的则是流量至上和商业利益优先的算法价值观,从用户角度出发的无论是用户喜好还是用户需求的短视频内容推荐依据,本质上都是为了流量和商业价值最大化。因此,短视频推荐算法六大价值要素所形成的是一种商业利益为主,公共利益为辅的算法价值观。

三、短视频推荐算法实践的伦理隐忧

从短视频推荐算法“黑箱”中揭示的商业利益优先的算法价值观,实际上已深深嵌入进了推荐算法设计之中,无论是算法中“推荐给可能认识的人”功能的“巧妙”设计,还是以用户兴趣偏好为主的个性化推荐功能设计,抑或是以用户画像为前提的算法设计,都是为迎合用户与获取流量这一商业目的。因此在短视频推荐算法实践中也暴露出了算法技术推荐机制不完善、人机互动形成信息闭环、用户画像不精准等缺陷,由此带来了用户隐私泄露、信息窄化、算法歧视等伦理问题。从行动者网络理论角度看,当算法获得主体地位,取代传统媒体把关人为人们进行信息把关,以用户兴趣图谱和流量至上的商业逻辑进行短视频内容推送时,算法技术也偏离了技术理性,引发诸多伦理问题堪忧。

(一)算法缺陷与隐私泄露

短视频平台算法以隐蔽或强势方式获取用户数据和个人隐私,算法推送中存在用户数据隐私泄露的问题。首先,短视频算法推荐需要以收集用户的个人数据为前提,而平台对用户数据的采集并非均得到用户授权,有些数据是以隐蔽方式或者以平台上的某些功能默认开通而获取的,用户并不知情。其次,推荐算法设计使用户不得不让渡一部分隐私数据使用权,方可获得更加精准的信息推送或者平台上的特定功能,如用户只有打开算法系统对相机、相册、麦克风的访问权限才能使用发布音视频内容的功能;只有开通通讯录访问权限,所发布的内容才能被算法推荐给可能认识的人。最后,在基于社交关系的算法推荐中存在个人隐私泄露的风险,当算法系统获得用户手机通讯录权限,加之用户个人账号默认开通“推荐给可能认识的人”功能时,用户发布的视频内容及用户的社交关系隐私将随着算法内容推荐而被泄露。

短视频内容推送中导致用户隐私泄露主要有两个方面的原因:一是算法技术本身存在缺陷。基于社交关系的推荐机制不完善,当算法在获得用户通讯录权限后,尽管用户在个人账号“隐私设置”中关闭了“推荐给可能认识的人”的功能,算法系统还是会根据其他用户通讯录中的联系方式信息而向你推荐朋友或把你推荐给相应用户。换言之,只有所有用户都同时关闭了手机通讯录权限和“推荐给可能认识的人”的功能,算法无法从通讯录信息中获取社交关系相关性,才可避免个人数据隐私不被推荐算法暴露在社交圈层中。因此,在现有的基于社交关系的算法推荐系统下用户隐私很难得到保护。二是当短视频平台将用户数据共享给其他的平台服务提供者或合作者(如广告商)时,也存在泄漏用户隐私的可能和风险。

(二)同类推送与茧房效应

研究发现,短视频推荐算法存在同类推送和信息窄化现象,并由此可能带来信息茧房效应。尽管有研究认为抖音短视频内容类型丰富,已形成海量内容规模,人均消费视频数目达到80个[18]。但是研究者在参与式观察中却发现抖音算法所推送的内容过于个性化,内容的多样性却不足,主要体现为推荐内容的类型化特征显著。例如推送给研究者的229条短视频主要为亲子、教育、广告、泛生活、泛娱乐5大类型和育儿、广告、新闻资讯、知识分享、视频特效、美食、搞笑、心灵鸡汤、微综艺、微剧、明星娱乐等23小类,除了三个教培广告重复推送之外,其余内容尽管没有重复但却存在同类推送的情况,如在5月13日推送了3条“家长应该怎样引导和教育孩子”的同类短视频,5月17日推送了4条“80岁的你”的同类特效视频(占当日推荐总数的13%),5月18日推送了3条介绍抖音推出的“doudream创作者计划”的同类推广视频。可见,抖音的推荐算法并未实现完全的“千人千面”,从个人用户内部(与用户间相对)角度来说,存在一定程度的信息窄化现象或茧房效应。

以用户兴趣和偏好为主的信息推送本质上是一种相似性推荐,因此用户接触内容的类型化或同类化是个性化算法推荐的必然结果。信息类型的窄化容易限制受众认知的视野,“兴趣-点击-相似内容推荐”形成无限循环的闭环,使用户困于算法过滤后的单一信息环境之中,久而久之会造成个体认知的狭隘化和极端化,产生“孤岛效应”,而且还可能带来个体间知识鸿沟的扩大。因此,从这个意义上说,算法并未让人们见到更广阔的世界,反而将人禁锢在封闭的狭窄空间中,隔绝了多元化的信息和多元化的世界,算法推荐的“千人千面”实质上造就的并不是完整的人,而是“单向度的人”。

(三)用户画像与算法歧视

算法歧视用户的现象已成为算法社会面临的又一个重要伦理问题。算法技术可在信息采集、特定推送和个性定价三个阶段对用户实施显性或隐性歧视,如“今日头条”在个性化推荐中存在用户身份歧视,携程、滴滴在差异化定价中存在价格歧视等[19]。英国学者阿里尔·拉扎奇等在《算法的陷阱》一书中分析了优步(Uber)等多家互联网平台企业利用动态定价算法对用户实施价格歧视的现象,并认为充当“中间人”的算法的存在,会大大减轻企业管理者对消费者实施价格操纵和价格歧视所带来的负罪感[20](P.58)。算法歧视现象见诸于就业、信用、投资、公共服务等多个领域。亚马逊2014年开发的筛选简历的算法会歧视女性求职者,只要求职者毕业于女校或者简历中带有“女性的”字样,就会受到算法的负面评价[21]。美国学者弗吉尼亚·尤班克斯在《自动不平等》中通过田野调查揭示了印第安纳州福利资格处理系统的算法ICES(Indiana Client Eligibility System)存在黑人和穷人歧视。在ICES算法系统中,福利申请者的镜像是懒惰而狡猾、需要政府督促以实现自给自足、喜欢福利欺诈、对于公共资源的滥用必须给予反复劝阻。因此她认为,算法歧视的本质是算法设计者对于种族、阶层的刻板印象[22](P.33-45)。短视频推荐算法也存在用户身份歧视现象。从抖音算法推荐的短视频内容镜像中发现,推荐算法把作为母亲身份的研究者限定在亲子、育儿和生活三个领域内,由此反推出研究者的算法身份标签是“家庭主妇”,将母亲等同于家庭主妇,再将家庭主妇视为只有亲子育儿和家庭生活信息需求的人,本质上是算法对母亲形象的刻板化和对母亲身份的一种偏见或隐性歧视。

从技术角度看,造成算法歧视的原因是算法对用户画像的不精准和简单化。本研究中的短视频推荐算法通过对用户使用过程中的社交手势进行抓取和分析,对浏览行为和主动表现的偏好与用户注册信息中的性别、年龄、注册地点等元数据相融合,构成一幅简单而粗糙的用户画像,并据此进行内容匹配和分发。将用户复杂丰富的动机、行为、情感简单化为社交手势这一单一维度,正如有学者指出的,人们高估了数据和算法对人类情感的量化能力[23]。基于简单、不精确的用户画像而将用户限定在特定的某几类内容中,忽视了用户作为整体的人应有的多样化的信息需求。进而言之,算法偏见或算法歧视会抑制用户真实的、多样化和高阶的信息需求,如用户长期接触算法推荐的个人化信息会抑制用户对公共信息、圈外信息的需求。推荐算法对用户画像的表层分析难以识别用户的高阶内容需求,也就无法提供给用户更高阶的内容,这种基于用户非真实需求的算法推荐,会进一步强化用户的被歧视感。

四、算法优化:人工智能时代短视频推荐算法的伦理规范与价值引导

人工智能技术逐步向社会全面渗透,一个由算法技术主导的智能时代已经来临。同时伴随而来的人工智能伦理和价值观导向问题也越来越突出,国际社会开始共同关注这一问题并相继发布了《美国人工智能研究和发展战略规划》、联合国《机器人伦理初步报告草案》、欧洲政治传播中心《人工智能时代:确立以人为本的欧洲人工智能战略》、欧盟《可信AI的伦理指南草案》、欧盟《人工智能法》提案等[24]。在此背景下,基于当前短视频推荐算法存在隐私泄露、信息窄化、算法歧视等伦理问题,以及伴随短视频走向全民性的应用,对其推荐算法的伦理规范和价值引导显得尤为迫切。鉴于此,在算法社会正在到来的新时期,智媒治理的动力机制应从市场逻辑向公益逻辑转变[25],需要短视频平台、用户、行业协会和政府管理部门等多个行动者共同参与算法优化和完善,促进算法朝着更加有利于人类社会的方向发展。

(一)增强平台社会责任,公开并优化算法

基于当前日益突出的算法伦理问题,开发并使用算法的短视频平台应正视推荐算法给社会带来的不良影响,承担起相应的社会责任,一方面公开算法,使算法更加透明化。短视频平台可以在客户端公布推荐算法的工作原理,对算法如何使用用户个人数据进行解释,包括哪些信息是被个性化的,个性化到什么程度,筛选的原则是什么,相应功能是否有提供退出机制等,把知情权与控制权还给用户;使用户明晰平台算法使用个人数据和信息中预设的价值,用户也能够据此调整与算法的互动行为,自主地控制自己的个人数据和信息。如美国互动广告局鼓励其成员在每个广告上增添一个小图标,表明该广告使用了用户的哪些个人数据,以及如何改变或选择退出该功能。另一方面需要平台完善和优化推荐算法,在算法技术模型的优化中,将内容多样性放在重要的位置,调整“用户偏好”和“差异化内容”的占比权重,使二者达到一个平衡,让用户能够接触到更多样化的短视频内容。美国学者伊莱·帕里泽提出了平台通过设计“可证伪性”的算法,即反证用户画像的算法,增加用户意外发现的可能,让用户能够接触到自己兴趣之外的、日常经验之外的内容[26](P.171-172)。总之,推荐算法优化应同时兼顾个性化和多样性,提升“用户-内容”匹配的精准度。

尽管短视频平台采用了算法技术与人工审核相结合的内容把关机制,但人工审核只是作为次要的、辅助性的把关手段,而算法实施的恰恰是流量至上的推荐逻辑,首推之后只有那些有足够流量、足够热度的短视频内容才有机会获得更多推荐和更多流量加持。然而基于流量推荐的内容并不都是优质内容,也可能是博人眼球的低俗、猎奇性内容。基于此,只有倡导人机结合,才能达成价值平衡[27]。在短视频个性化内容推送中,算法不能仅仅以流量作为内容推荐的衡量指标,同时还应该考虑内容质量;鉴于算法对内容质量无法全面而科学地判断,因此需要短视频平台在内容推送中增加人工干预,提升人工介入的比例和权重。唯有如此,才能弥补个性化推荐算法带来的内容类型化和单一化的不足,让用户有机会接触到更优质和更多元的短视频内容。

(二)优化用户信息消费习惯,培养算法素养

信息茧房是人与算法互动导致的结果,茧房效应与人的心理、认知和行为习惯密切相关。因而改变人的行为模式可以在一定程度上减少形成茧房效应的可能性。一方面用户可以将自己的兴趣范围扩展至更多元的新的方向,使算法难以把你归类为某一类人,从而接触到更多类型的短视频内容,扩大对世界的感知;另一方面用户可以规范短视频媒介使用行为,对于劣质、不感兴趣的内容可以选择不播放或拒绝浏览,通过长按短视频画面,选择“不感兴趣”;此外,不主动发布或搜索猎奇、低俗性内容,减少给算法提供主动表达偏好的信息反馈,从而减少同类内容推荐。用户只有积极主动提升反算法的能力,才能为预防消极的“信息茧房”提供更多的可能性。

思维培养和风险教育是算法素养培养的两大基本面向[28],提升用户隐私保护意识和防范隐私泄露的能力是培养算法素养的重要内容之。为规避短视频推荐算法可能带来的隐私泄露风险,用户可以在抖音账户中的“隐私设置”中关闭“推荐给可能认识的人”这一功能,使自己发布的内容不被算法推荐到用户不愿意公开或暴露的社交关系中。同时,在手机“设置”—“应用”—“权限管理”中关闭用户无意识授权给短视频平台的一些权限,如获取通讯录、电话、位置信息等,进而保护个人电话、通讯录、位置等隐私信息,既不被平台算法暴露,还可以减少基于社交关系或地理位置的内容推荐。然而当前我国网民的隐私保护意识薄弱,因此,要规避平台推荐算法带来的伦理困境,亟需短视频用户有意识培养基本的算法素养,了解算法运行机制和算法推荐背后的逻辑,主动使用和驾驭算法,提升短视频用户作为人的主体性和自主性,而不是被动接受算法“投喂”,把一切决策权都交给算法,任由算法控制和“囚禁”。

(三)加强算法审查与监督,促进算法向善

算法伦理作为全社会的一个公共性问题,仅从道德层面要求平台企业承担社会责任,进行行业自律,或仅仅指望通过培养网民的算法素养解决一切算法风险和伦理困境显然是不够的。学者张涛甫在“算法善用 智能人文”论坛上指出,“算法价值问题不是某一个环节的问题,要实现算法的系统性优化,一方面要技术往前推进,另一方面要有系统性合力……算法优化需要平台、管理者、用户等多方‘共治’”。在短视频内容产业发展过程中,除了平台层面的算法公开与优化、用户层面提升算法素养,还需要视听行业协会和广电、互联网监管部门加强短视频平台算法审查与监督,从制度和政策法规层面预防算法歧视和隐私泄露,保障网民利益。

在算法公开透明的前提下,一方面,中国网络视听节目服务协会作为短视频行业协会可对平台算法设计的潜在缺陷进行审查,或在算法运营中不定期进行审查,预防或减少算法可能带来的伦理风险和问题。尽管算法技术不可避免地受到商业价值的影响,正如加拿大当代哲学家安德鲁·芬伯格所强调的“在技术和社会共同建构的领域中,技术理性和社会经验处于相互纠缠的状态”[29](P.198),但是行业协会仍然可以对算法价值进行引导,使算法运行逻辑同时符合商业伦理和社会伦理。另一方面,国家广电总局和国家网信办作为网络短视频企业的监管机构,针对算法泄露用户隐私、超出权限收集用户个人信息、算法歧视等问题,应加强对短视频平台算法操作和实践的监督与治理,可以通过划定平台主体责任范围、建立用户举报机制、约谈、罚款等行政手段与辅助技术手段进行治理。我国《互联网信息服务算法推荐管理规定(征求意见稿)》也提出要定期审核、评估、验证算法机制机理,加强用户模型和用户标签管理,预防算法歧视。总而言之,在算法社会,唯有让算法“黑箱”处于阳光之下,倡导算法理性,秉持“科技向善”的价值导向,充分发挥算法技术外在的工具价值和道德层面的终极价值,才能使算法技术更好地造福于人类。

注释:

①参与式观察的时间为2021年5月11日-24日,为期两周,带着“短视频算法推荐逻辑是什么?”的问题进入抖音进行参与式观察,时间为每天晚上八点至八点十五分共15分钟,参与式观察的内容主要包括短视频内容类型、内容描述、条数和内容来源。每天结束观察后结合研究者的使用行为(包括关注、浏览、点赞、评论、发布)和账号情况(包括IP地址、性别、年龄、身份),根据推送内容与研究者使用行为、账号情况的最大匹配度,推测算法推荐每一类短视频内容的推荐逻辑。参与式观察的时长和程序符合网络民族志专家罗伯特.V.库兹奈特(Robert V.Kozinets)对网络民族志方法实践的要求。

②晚上8-10点是大部分用户的休息时间,也是抖音流量的晚高峰期,因此本文将这一时段视为抖音的黄金时段。

③研究者的抖音账号使用情况为:注册时长2年,只发布了四条孩子活动视频,点赞和收藏了“分身尬舞术”“AR恐龙”特效视频,关注好友8个,账号显示性别(女)和所在地(上海.杨浦)。

④权重大小为参与式观察中以不同价值要素为依据推荐的内容条数占样本总数的比例。

⑤研究者的“偏好”或兴趣指研究者主动或被动呈现的内容偏好,主要指基于研究者的浏览、点赞、发布、评论等动作特征或以研究者的性别(女)、身份(母亲)、手机号归属地(江西.吉安)为依据而推荐的短视频内容,包括亲子育儿、儿童教培广告、生活知识、美食、心灵鸡汤、美妆穿搭、电商直播等内容。