机器学习在信道建模中的应用综述

2021-03-09刘留张建华樊圆圆于力张嘉驰

刘留,张建华,樊圆圆,于力,张嘉驰

(1.北京交通大学电子信息工程学院,北京 100044;2.北京邮电大学网络与交换技术国家重点实验室,北京 100876)

1 引言

信号在发射机天线发送后到达接收机天线所经历的通道就是无线信道,无线通信正是利用电磁波信号在此通道的传播特性进行信息交换的一种通信方式,其特性决定了无线通信系统的性能限[1]。信道建模就是在真实环境中探索和表征信道特性的过程,它可以揭示无线电磁波在不同场景中的传播方式。借助信道模型来了解信道的传播特性,可以为通信系统的设计和优化提供指导[2],因此,信道建模是无线通信中最重要的研究方向之一,是评估、设计和部署任何无线通信系统的前提。

从国内外研究现状来看,面向5G 信道特性的研究主要是在某个场景或频段下采用传统的手段进行统计分析的,缺少自动学习规律技术的支持,难以应对海量化、时变性、特征多样化的无线信道数据变化趋势。因此,为了更好地了解信道的传播特性,需要一种高效且具有自适应和自学习能力的技术[3]。机器学习(ML,machine learning)是一种可以自动地从数据中发现规律,并利用此规律对未知数据进行预测的算法,已经在学术界和工业界得到了广泛的应用。作为人工智能的一个重要分支,机器学习具有以下几点优势。

1)强大的学习能力和预测能力。相关研究表明,与现有的确定性和随机性信道建模方法相比,基于机器学习的模型在准确性、复杂性和灵活性之间具有较好的权衡。传统的信道建模方法依赖于不同的信道配置(载波频率、发射端/接收端位置等),比较复杂且耗时。基于机器学习的信道模型可以直接学习数据集的特征,以一种更简单的方式直接获得信道的统计特性,从而使结果更加准确。例如,在射线追踪中需要构造不同的环境,在类似WINNER(wireless world initiative new radio)的模型中需要获得不同的参数集,而基于机器学习的信道模型则从不同场景中收集数据来建立通用性更强的模型架构。

2)良好的非线性拟合及自适应能力。高速移动、大规模天线等带来的信道在时域和空域的非平稳特性,使实际应用的无线信道都是非线性的,而机器学习恰恰在模拟非线性系统上有着良好的性能。因此,只需要利用实测数据对基于机器学习的信道模型进行足够多的训练,就可以用来模拟实际应用中的无线信道。此外,大规模复杂场景导致各种通信链路的信道条件迅速变化,此时严重依赖信道状态信息(CSI,channel state information)的信道模型性能会大幅降低[4],而利用机器学习对其训练以适应新的信道条件,可以建立泛化能力更好的信道模型。

3)擅于挖掘高维度和高冗余数据中的复杂特征,可以高效地处理海量数据。5G 应用场景中提出了增强型移动宽带(eMBB,enhanced mobile broadband)、高可靠低时延(uRLLC,ultra reliable and low latency communication)及海量机器通信(mMTC,massive machine type communication)三大典型应用场景,为了实现这一目标,5G 系统需要成为一个范式转变,包括带宽很高的载波频率、极端基站和设备密度以及前所未有的天线数量。相关的关键技术包括毫米波通信、大规模多输入多输出(massive MIMO)以及超密集组网,其中,毫米波通信利用超大带宽提升网络吞吐量,massive MIMO利用超高天线维度充分挖掘利用空间资源,超密集组网利用超密基站提高频谱利用率,这使所需测量的数据量和维度迅速增加[5]。随着数据的爆炸式增长,在获取、存储和处理大量数据的过程中给传统的信道建模方法带来了很大的挑战,而基于机器学习的相关算法(如聚类、神经网络、粒子群算法等)在处理大数据上却具有得天独厚的优势,例如文献[6]对179 个测量点进行测量,得到的频域信道冲激响应(CIR,channel impulse response)的数据量为320 768×254 维矩阵。通过主成分分析(PCA,principal component analysis)进行信道建模,不仅可以将信道参数降低为6 维的主成分,而且信道容量、特征值分布等方面比TR36.873 标准更接近实际测量的结果。因此无线大数据时代给机器学习在5G 及之后的信道建模的应用研究带来了机遇。

综上,机器学习被认为是分析测量数据、理解传播过程和构造模型的有力工具[7]。迄今,国内外已经对高铁通信[8-9]、毫米波通信[10-11]、4G/5G/6G[5,12-13]、V2V 通信[14]、无人机通信[15]、massive MIMO[16]等应用场景的信道模型进行了综述,而本文就机器学习如何与信道建模进行有机结合展开讨论,主要可以分为以下三大类。

1)信道多径分簇及参数估计。在MIMO 中出现了以簇为核心[2]的信道模型,这是因为研究簇的特性可以简化建模过程。簇是一组具有相似的时延、角度等参数的多径分量(MPC,multipath component),因此,为了在接收端识别出簇,需要一种与多径传播特性相对应的聚类算法,从而提高簇核心模型的精度。自动聚类算法(如k-power means 算法)近年来得到了广泛应用,但仍然需要簇的数量等先验假设信息。信道建模需要从大量实测数据中提取表征信道衰落特性的各个关键特征参数的随机分布,再根据信道特征参数的随机分布来量化各个参量,在这些参量的基础上构建的信道模型才能真正体现和反映真实信道传输的特性,进而通过信道参数估计算法来提取信道特征的关键技术。随着无线通信的发展,信道特征的维度由最初的时-频二维扩展到时-频-空三维,所需提取的参数的数据量呈现出爆炸式增长,这给传统的信道参数估计带来了很大挑战。然而许多分簇算法需要在聚类之前通过高分辨率参数估计算法提取MPC,这些算法的计算复杂度普遍较高,难以在时变信道中进行实时操作。因此,基于机器学习的MPC 自动聚类算法和参数估计算法受到了广泛的关注。

2)信道模型构造。5G 及未来通信系统将支持更大规模的天线阵列、更高的频段、更大的带宽及更加复杂多样的应用场景,信道数据量也随之激增。传统的基于簇的统计性建模方法较难找出抽头簇与实际散射体之间的映射关系;确定性建模方法预测准确但复杂度高,且依赖于环境信息精度。随着人工智能的飞速发展,国内外提出了基于神经网络(NN,neural network)[17]和基于簇核的信道建模方法[2]。前者利用神经网络在描述数据特征和提取系统输入与输出之间的映射关系展现出良好的性能,可以使用实测数据集对神经网络进行充足的训练,从而模拟实际场景的无线信道,寻找输入层变量和输出层信道特征参数的相互关系。该方法利用了神经网络自学、自适应和非线性拟合的特点,这对时变信道的建模特别重要,尤其是在分析实际信道数据时可以减少重新建模的成本。后者利用机器学习算法从海量信道数据中挖掘信道特性,找到统计性簇和确定性散射体之间的匹配映射关系,并通过有限数量有物理意义的簇核进行信道建模。该方法同时结合了统计性建模和确定性建模的优势,既解决了确定性模型复杂度高的问题,又解决了统计性模型缺乏物理含义的问题。

3)信道状态分类/场景识别。信道状态分类/场景识别是信道建模和通信系统部署的重要依据,不同场景下的信道模型也不一致。另外,由于信道的复杂性,实际测量所需的时间长且难度高,那么精确的信道场景识别对系统进行分析和评估可以大大提高工作的效率。然而,在传播环境多变的情况下,使用基于单一度量的假设检验对场景进行分类是不够准确的;另一方面,一些机器学习算法对于数据的分类具有很大的优势,比如支持向量机(SVM,support vector machine)、神经网络、随机森林、决策树等。在这种情况下,学习和提取不同场景下的信道属性差异有助于自动将测量的数据分类到不同场景中,建立相应的信道模型,并发现用于资源分配、系统优化或本地化的场景特征。

本文概述了机器学习应用于信道建模过程中的相关研究。首先,介绍了利用机器学习优化传统的信道参数估计,总结了国内外针对分簇所采用的聚类算法,并从多个角度对不同聚类算法进行比较。其次,总结了在大尺度衰落和小尺度衰落信道下,神经网络对不同环境、场景和频段下的建模,归纳出可优化模型的算法和通用的模型结构,介绍了一种以簇为核心的智能化建模过程。再次,提出了无线信道场景识别的研究难点以及目前的一些研究方案。最后,对全文工作进行总结,并对未来进行展望。

2 信道多径分簇及参数估计

对多径分量的统计特性进行建模通常有2 类方法:非簇结构建模与簇结构建模。非簇结构建模着眼于每个多径分量,簇结构建模则把多径分量划分成簇,用以研究簇内和簇间的统计特性,诸如簇数、时延扩展、角度扩展等。簇结构的使用得益于5G系统有更多的MIMO 信道数和更大的带宽推动,并且大量测量分析显示,多径分量在实际环境中是以簇状分布的[18-19]。开展对簇特性的研究,前提是从电磁波中识别出簇,也即将CIR 中的MPC 一一划分到相应的簇中。然而,在很长一段时间内,分簇都是通过将测量的数据转换为图片再进行人工划分的,这种方法没有一个准则来衡量效果,并且无法观测高维结果。从2006 年Czink 等[20]将机器学习算法引入信道多径参数分析,提出自动多径聚簇,解决了传统人工分簇准确性低、效率低、难以应对高维大数据量参数等问题后,k-means 算法等机器学习算法就成为信道多径分簇的主流分析方法。但是k-means 算法只基于多径距离,并没有考虑到信道多径的物理传播特性,因此,选择一种优秀的分簇算法对基于簇的信道建模是十分关键的。

无线信道中MPC 特性的挖掘深度和提取精度决定了信道建模的精度和复杂度。随着无线通信的发展,人们对无线信道特征的认知和利用也从单一的大尺度衰落层面的功率距离关系逐步发展到空-时-频多维的小尺度衰落层面,对MPC 的描述也从幅度-时延-多普勒的三维精确到幅度-时延-水平离开角(AAOD,azimuth-angle of departure)−水平到达角(AAOA,azimuth angle of arrival)-垂直离开角(EAOD,elevation-angle of departure)−垂直到达角(EAOA,elevation-angle of arrival)-多普勒的七维特性。如果考虑极化特性,信道特征维度会再增加,而且时延域分辨率的提高(时延为1 ns 或者更低)带来的必然结果是可分辨多径的增多,比如对于一个采样点所提取的MPC 可能从50 条增加到200 多条,而每条MPC 至少有7 个参数需要估计,这样每个采样点的信道数据要提取的信道参数则扩大到1 400 个,那么对不同位置的采样点提取的参数总和可以扩大到以万为单位。面对信道的大数据量,寻找高速、精确的多维无线信道特征提取算法显得尤其迫切。

2.1 信道多径分簇

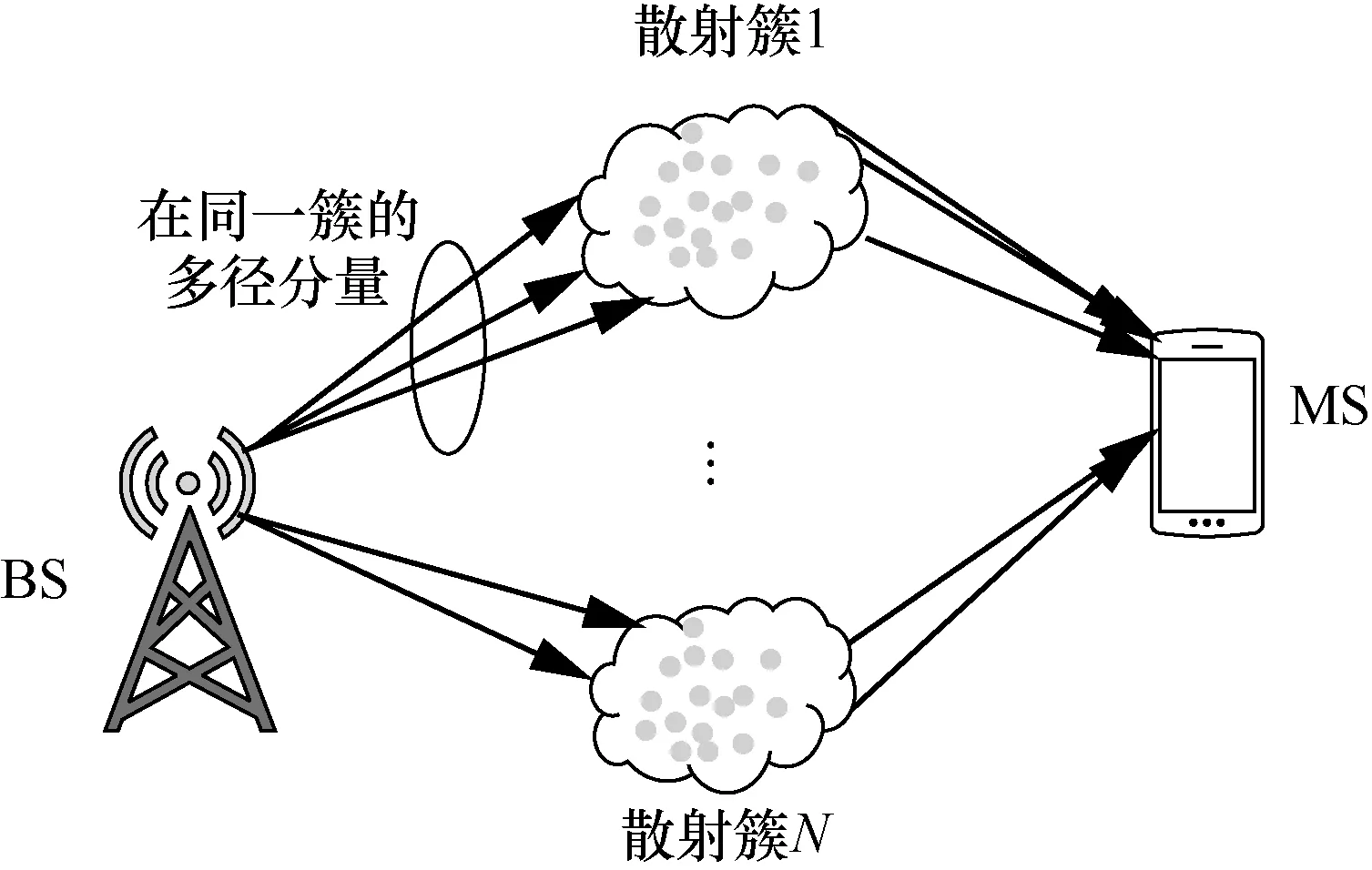

随着MIMO 技术的成熟,多天线技术也更加普遍地应用于通信系统的收发端,这为通信系统带来了频谱效率和传输可靠性的提高。关于MIMO 信道的建模,国内外已经取得了一些显著的进展,出现了以簇为基本单元的模型,如欧盟信息社会技术项目组IST(Information Society Technology)提出的WINNER 模型、3GPP 开发的空间信道模型(SCM,spatial channel model)[18]。这是因为通过对簇内特征参数的研究,可以降低MIMO 信道建模的复杂度。基站(BS,base station)和移动端(MS,mobile station)之间的多径聚类现象如图1 所示。相同时延格里的MPC 经过同一个散射体反射、绕射、折射到达接收端,那么这些MPC 的时延、离开角和到达角就会具有相似性,本文称之为簇。因此,簇与确定性环境中的散射体存在一种必然的联系。

图1 BS 和MS 之间的多径聚类现象

在机器学习领域,分簇也称为聚类,属于无监督学习的一种。通过某些物理特征(如多径分量距离、功率、时延等)将样本划分成多个簇,属于同一个簇的样本具有相似性。良好的聚类算法应具有以下特征。1)MPC 聚类算法需要少量参数且易于调整。在大多数情况下,一些算法的初始化和参数调整需要通过实验来完成,这使实现过程变得烦琐,不易自动挖掘信息,例如,k-power means 算法需要一个定义好的簇的数量和聚类中心的位置,并且需要仔细调整算法中时延和角度的权重因子,才能得到合理的输出。2)选择合适的距离度量。使用特征空间上定义的距离度量来计算两点之间的差异,簇聚类中常用的距离度量包括欧几里得距离、曼哈顿距离、切比雪夫距离等,不同的距离度量通常会对结果产生不同影响。3)MPC 聚类算法需要考虑其物理传播特性。现实中由物理环境生成的MPC 具有某些固有的特性(如附加时延越大,MPC的功率越小),因此即使是视觉检测也可以很容易地聚类MPC。然而为了更好地反映信道的传播特性,降低模型复杂度,可以考虑信道统计特性的建模行为,例如,MPC 簇的角度分布通常建模为拉普拉斯分布,MPC 的这种预期行为可以进一步纳入分簇算法来提高分簇算法的精度。

2.1.1 经典的分簇方法

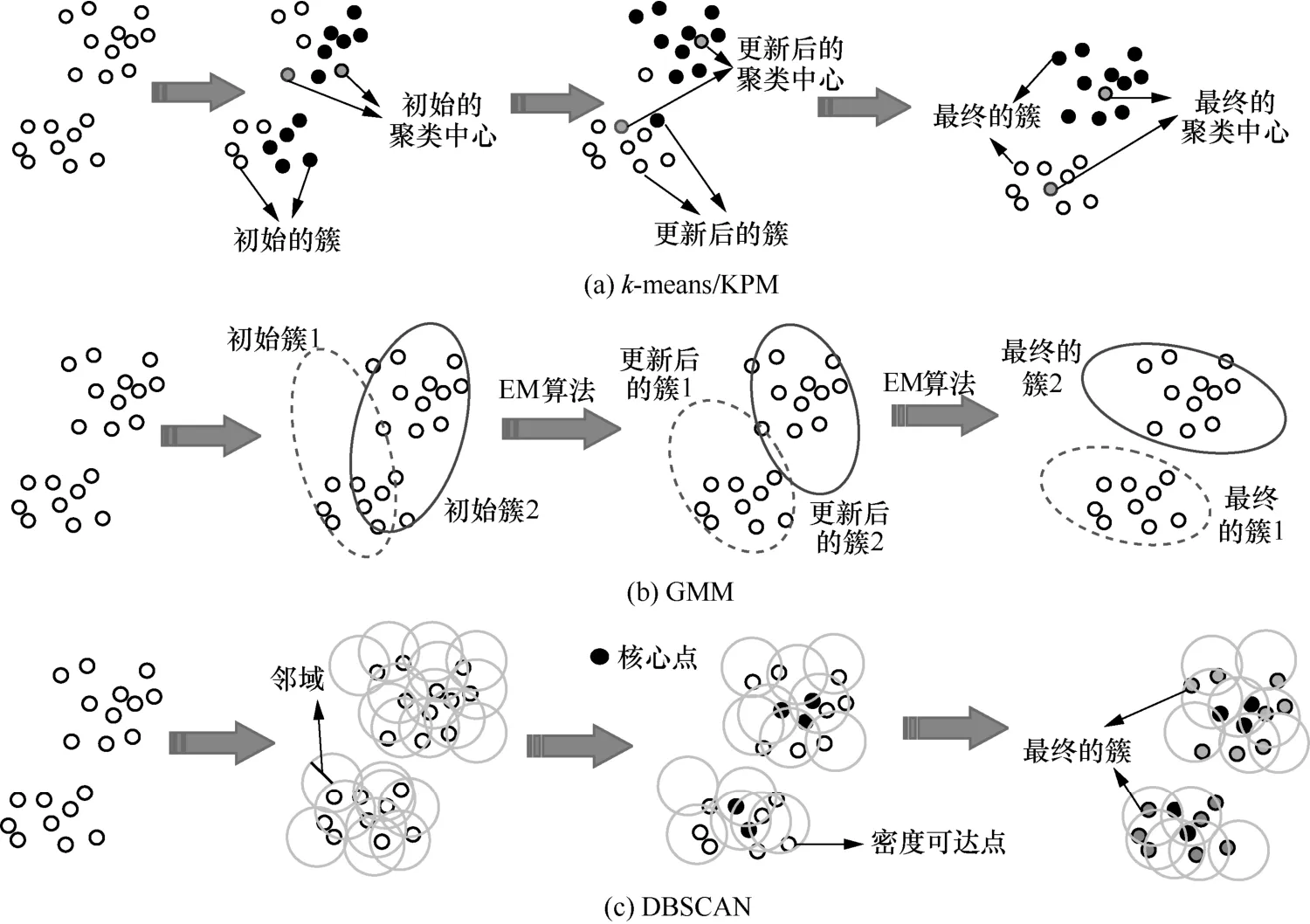

基于簇的信道建模,首先要对多径分量进行分簇,进而簇数、位置、时延扩展、角度扩展等都可以参数化,因此对于优秀的分簇算法的研究一直是一个热门的课题。本节将主要介绍可用于分簇的三大经典聚类算法——k-means 算法/KPM(k-power means)算法、高斯混合模型(GMM,Gaussian mixture model)算法、基于密度的含噪空间聚类(DBSCAN,density-based spatial clustering of applications with noise)算法,并从信道应用的角度对这3 类聚类算法进行对比。

k-means 算法[21]基于欧氏距离对数据进行聚类识别,算法过程如图2(a)所示。该算法首先确定簇的数目和聚类中心,再根据欧氏距离对簇进行初始聚类;然后通过迭代更新聚类中心的位置以达到收敛,得到最终的聚类中心和簇。KPM 算法[22]是一种基于k-means 算法的聚类算法,整合了功率对聚类的影响。这2 种聚类算法中簇数量的上界和下界必须是先验的,最终簇的数量是通过使用一些有效性指标来确定的。然而KPM 算法存在参数敏感性太强、结果合理性欠佳、多径簇数目判定方法不合理的问题。

GMM 算法是一种基于统计分布的多径分簇算法[23],如图2(b)所示。文献[24]引入GMM 算法实现信道的多径分簇,在GMM 算法中,MPC 假设由若干个高斯分布组成,其分布的概率满足最大似然函数。为了估计GMM 算法的参数,文献[23]首先采用期望最大化(EM,expectation maximization)算法求解GMM 算法参数的最大后验概率估计。然后利用变分贝叶斯(VB,variational Bayesian)算法对GMM 算法优化参数求解,以增强EM 的全局搜索能力,避免局部最优和过拟合,进而在不需要交叉验证的前提下确定了高斯分布的最优个数。最后提出了新的分簇评价指标——紧凑指数(CI,compact index),同时考虑了簇内均值和方差信息来评价分簇结果,进而发现多径传播特性、GMM 算法分簇机制和CI 评价指标之间的密切联系。

DBSCAN 算法[25]考虑所有的数据点被划分为核心点、密度可达点和离群点,其主要思想如图2(c)所示。DBSCAN 算法可以吸收其邻域半径内的所有对象(即密度可达),并且邻域需要满足用户指定的密度阈值(即组成一个簇所需的最小点数)。DBSCAN 算法对密度阈值很敏感,因而选择合适的密度阈值将是一个挑战。

k-means 算法是基于欧氏距离的,该算法容易实现、收敛快,但无法捕捉到信道多径的传播特性且适用于凸形簇,然而在信道建模中簇的存在形式是否为凸形尚无定论。GMM 算法是基于数据统计分布的。DBSCAN 算法是基于密度的。这些算法都考虑了MPC 的统计特性,对任意形状的稠密数据集都可以进行聚类,但当簇分布不均匀时,DBSCAN 算法分簇效果欠佳。通过比较图2中k-means 算法与GMM 算法的分布数据可以发现,在k-means 算法中,每一路径分量仅属于一个簇;在GMM 算法中,同一路径分量可以属于不同的簇,也即它可以同时具有不同的相似度,这使GMM 算法比k-means 算法更灵活。另外,k-means 算法和GMM 算法需要簇数量的先验信息,如何选择簇数量仍然是一个开放的话题,因此当前需要更好的多径聚类算法服务于基于簇结构无线信道模型的开发。

2.1.2 改进的分簇方法

图2 经典MPC 聚类算法的思想

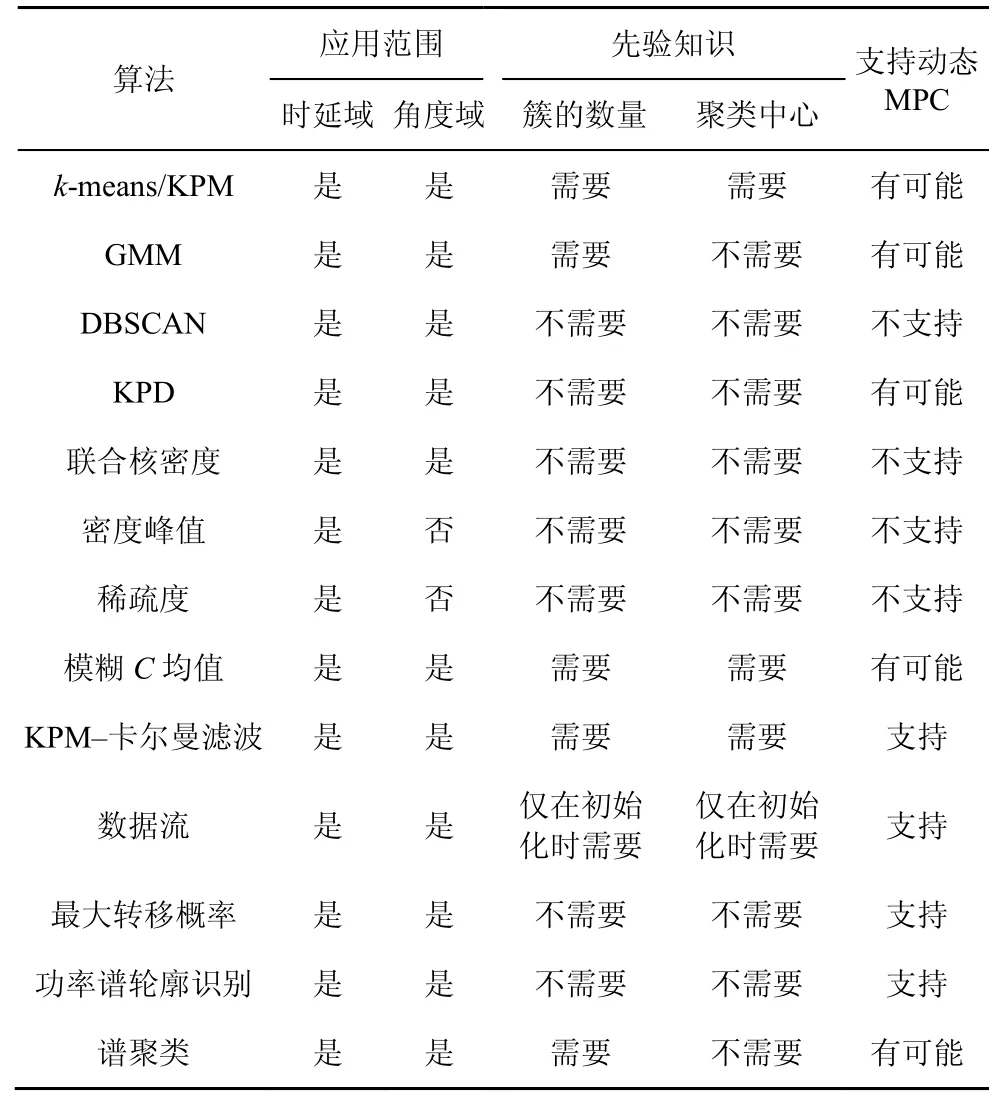

文献[26]提出了一种基于核功率密度(KPD,kernel power density)的分簇算法,该算法同时考虑了MPC 的功率和密度,这使分簇结果与多径统计特征紧密结合,且能更好地识别MPC 的局部密度变化。另外,当大量的簇出现角度扩展的现象时,算法性能也没有明显的下降。文献[27]提出了一种改进的KPD 分簇算法,不需要手动调整就可以得到各个MPC 的自适应分簇个数k,以解决KPD 中无法准确区分密度相近、多径较小的簇的问题。文献[28-29]提出了一种基于功率谱轮廓识别的分簇方法,该算法是适于时变信道目标识别的分簇算法,它能够较好地识别视距环境和非视距环境下的主簇,复杂度低且不需要进行高分辨率的参数估计,便可以清晰地观察到实时信道测量中簇的动态变化。文献[30]提出了一种基于联合核密度的分簇算法,该算法考虑了MPC 的统计特性,通过改进核方程并利用各参数的实际统计分布形成联合核密度,自动得到最优分簇数的同时使聚类结果也更加准确。文献[31]提出了一种基于稀疏度的信道冲激响应分簇算法,该算法改进了现有分簇算法中没有充分考虑分簇形状而使分簇性能降低的缺点,并提供了一种启发式的方法来识别恢复CIR 中的簇,与直接识别簇算法相比,其准确性更高。文献[32]提出了一种基于KPM-卡尔曼滤波的分簇算法,其适于大规模MIMO 的城市宏蜂窝行人移动场景,可以在测量过程中清晰地描述不同簇的轨迹,包括簇的产生、消失率和存留时长。文献[33]提出了一种基于数据流的分簇算法,该算法考虑了多径的时延、到达角、离开角和功率,且基于信道的时域动态特性,能够自然地反映MPC 的动态行为,因此可以对时变信道进行分簇。文献[34]提出了一种基于模糊C 均值的分簇,这是一种基于划分的分簇算法,该算法建立了样本对类别的不确定描述,实验结果表明其性能优于KPM 算法,从而成为分簇分析方向的主流方法。文献[35-36]提出了一种基于密度峰值的分簇算法,该算法具有自动获取簇数和分簇中心的能力,且适用于任何分布的数据集,但只支持时延域。文献[37]提出了一种基于最大转移概率相似性的多径分簇算法,建立了时变信道动态多径的分簇关系。另外,一种由图论演化而来的谱分簇算法[19]能够深入挖掘信道测量数据中的特征和规律,因此效果表现良好,但仍需要预先设置簇数。上述聚类算法的特点如表1 所示。

对于SISO(single input single output)信道的聚类,仅考虑时延与功率2 个维度,因此相应的聚类算法仅需要支持时延域,并且能够充分挖掘簇在时延维上的特点;对于MIMO 信道,由于其多径分布于时延、空间维度,物理特征更加复杂,因此聚类时还需要考虑角度域,例如KPD、KPM 算法都可以应用于MIMO 信道。另外,在4G LTE 通信中采用了二维MIMO,聚类算法仅需要考虑水平维度的角度域,而在5G通信系统中MIMO扩展到了三维,这时MPC 的聚类就需要考虑俯仰维度的角度域[32]。此外,若聚类算法不需要预先设定簇的数目和聚类中心,则意味着该算法可以在MPC 数目较大的情况下,提高聚类的效率和准确性。

表1 MPC 聚类算法的特点

在时间或者空间上具有非平稳特性的信道,其聚类算法需要支持动态MPC。其中,时间非平稳特性称为时变特征,指的是信号特征随时间发生变化。适用于时变信道的聚类算法包括基于概率的、基于功率谱轮廓识别的和基于数据流的聚类算法。空间非平稳性是指描述空间关系的参数会在空间上发生变化,如大规模MIMO 信道。适用于空变信道的聚类算法包括基于KPM-卡尔曼滤波的分簇算法、一种结合KPM 和分区的算法[38]。这些适用于非平稳信道的聚类算法可以清晰并实时地观察到信道测量中簇的动态变化,包括簇的产生、消失和存留时长等。由上述分析可知,合适的聚类算法和参数设置通常依赖于数据集,但由于MPC 数据种类繁多,寻找一种适用于多频段或者多场景通用的聚类算法仍然是具有挑战性的。另外,由于分簇在机器学习中属于无监督学习的范畴,数据中没有标签,因此需要一些衡量指标来评判分簇效果,比如通过簇内的紧凑程度以及簇间的离散程度,但这种评价指标没有将簇与散射体之间的关系纳入评价体系中,希望在未来的研究中可以获得可解释的、具有物理意义的评价指标。

2.2 信道参数估计

若已知CSI,就可以采取相应的措施来抵抗信道衰落,从而在接收端降低误码率、提升系统性能。信道参数估计正是实现这一目标的关键技术。目前,应用最广泛的信道参数估计算法是空间交替的广义期望最大化(SAGE,space-alternating generalized expectation-maximization)算法,该算法可以实现MIMO 系统的高精度联合估计,而且可以获取MPC 及其多维特征。与早期的参数估计算法相比,SAGE 算法收敛速度更快,但其仍然存在着受初始精度影响大、对于低信噪比的MPC 容易出现局部收敛最优的问题,而且随着天线数量、带宽和应用场景的增加,算法复杂度随之增大[39]。随着无线信道建模的大数据化,传统的信道参数估计算法在速度、准确度上已经很难满足研究的预期。为了解决这一问题,科研人员对传统算法进行了改进,为多径分簇和建模研究打下坚实基础。相关研究将遗传算法[40-42]、粒子群算法[43]和稀疏贝叶斯算法[44]应用到MPC 特征的提取,实验结果表明,这些进化计算方法可以在准确性不降低的前提下,节约特征提取的时间。

针对MIMO 信道,若要贴近实际三维MIMO信道场景,垂直维度的俯仰角参数等相关信道特征也应该纳入无线信道的统计特性描述中,这就需要通过信道参数提取技术获得多径时延、水平维度的到达/离开方位角、垂直维度上的到达/离开俯仰角等基本信道参数。传统参数提取方法中的信道估计算法性能较差且需要空间平滑处理技术的配合,因此只能对水平维度的参数进行特征提取,不能很好地拟合实际三维系统。文献[45]利用神经网络对非线性系统具有极强的自学习和自适应特性的优点,研究了反向传播神经网络(BPNN,back propagation neural network)在信道参数提取中的应用。该文首先利用QuaDriGa 仿真平台生成市区场景下的信道冲激响应,并通过SAGE 算法对时延扩展、水平维度的方位角及垂直维度的俯仰角等信道参数进行提取;然后利用样本数据训练BPNN 对信道参数进行提取,并与SAGE 算法的效果进行比较。结果表明,BPNN 模型的预测效果与SAGE 算法的估计效果之间差异很小。因此,该模型有望克服现有统计建模方法的不足,能与实际测量环境相匹配,对5G系统和链路级仿真非常有用。此外,本文还对BPNN和SAGE 算法的时间复杂度进行了比较,结果表明,BPNN 的时间复杂度为O(n3),SAGE 算法的时间复杂度为O(nlogn),其中n为输入的参数的个数。BPNN 的计算量大于SAGE 算法,但其普适性和灵活性却优于SAGE 算法。

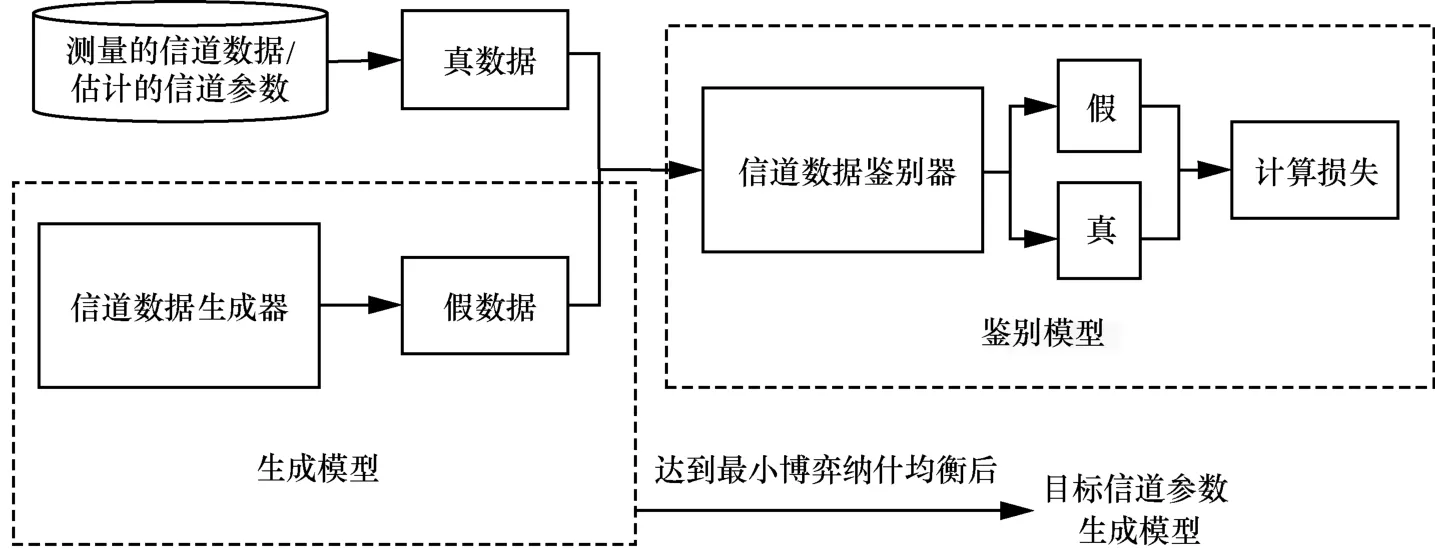

在动态应用场景中,对大规模MIMO 系统进行大范围精确的信道测量是非常困难、耗时和昂贵的。另外,对庞大的测量数据进行全面分析,快速估计出一套完整的信道参数,这需要复杂的科学理论以及在电磁波领域丰富的实践经验。为了减少信道测量以及参数估计的工作量,文献[46]提出了一种如图3 所示的智能且通用的信道参数生成模型——生成式对抗网络(GAN,generative adversarial network)模型,该模型用了2 个神经网络:信道数据生成器和信道数据鉴别器。具体来说,GAN 模型利用测量的信道数据(或者估计的信道参数)进行训练,达到信道数据生成器和数据鉴别器之间的最小博弈纳什均衡的目的。一旦这个过程收敛,就表示信道数据生成器已经学习到了特定应用场景中原始数据的特征,那么此时信道数据生成器就是目标信道参数生成模型。

图3 基于GAN 的信道参数生成框架

GAN 模型能够从有限的数据中学习到其内在特征并生成逼近真实可靠的信道数据,并不需要针对某一场景进行大规模的测量或者完整的参数估计,进而简化信道建模的过程,但仍然存在一些技术壁垒,主要体现在以下几个方面。1)收敛困难。与传统的机器学习问题不同,这种基于GAN 的模型是利用信道数据生成器和鉴别器相互竞争实现的,也即生成器和鉴别器需要自身的损失值减小、对方的损失值增大。另外,GAN 的训练通常采用梯度下降算法,该算法擅长于识别损失值的最低值,而非博弈中的纳什均衡,因此当训练过程需要纳什均衡时,这些算法可能会出现不收敛的情况。2)模型泛化能力有待提高。由于训练时数据类型的不同,该模型只能学习到特定测量环境的参数特性,也即该目标信道模型不能推广到其他具有不同信号传播条件的通信环境中,例如,适用于具有丰富多径的室内信道参数生成模型不适用于室外城市环境。尽管GAN 模型还有一些地方(比如合适的神经网络的参数设置、训练方法等)需要完善,但还是为未来多样化且复杂化的信道参数估计提供了一种很好的思路。

3 信道模型构造

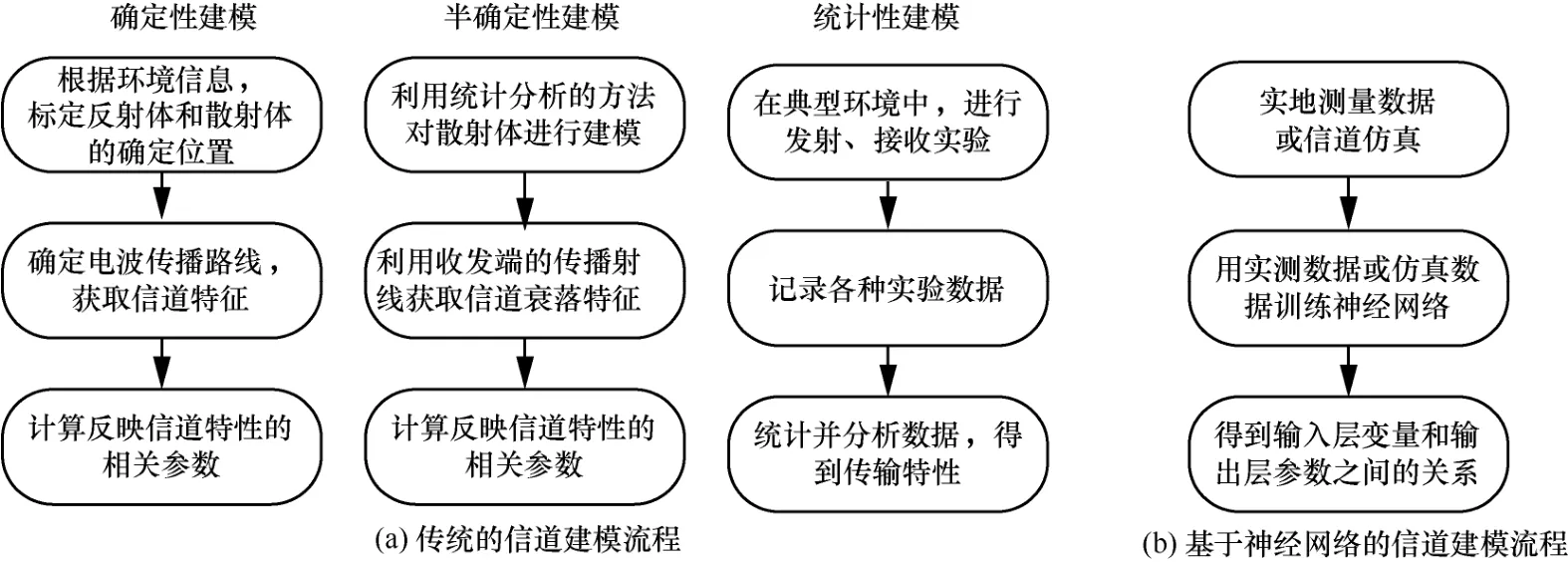

传统的信道建模分为确定性建模、统计性建模和半确定性建模。其中,确定性建模遵从电磁场传播理论,通过求解Maxwell 方程组来得到电磁波传播特性,典型的方法包括射线追踪法和时域有限差分法。这种建模方式依赖于场景信息,预测结果准确,但计算复杂度高。统计性建模建立在大量实测数据上,由统计分析归纳得到信道模型,因此在相似的传播环境中预测值与实际值相近。这种建模方式不需要详细的环境特征参数,但需要大量测量,既耗时又费力,并且传统的统计方法在回归拟合上具有一定的局限性[47]。半确定性建模兼具确定性建模和统计性建模的特点,典型模型为 GBSM(geometry based stochastic model)。这种建模方式比确定性模型复杂度低,对某一类环境具有适用性,当前一些国际标准信道模型大多使用该模型,但由于半确定性建模利用随机分析的方法来重构CIR,故不能准确地预测某个传播场景的无线信道[48-50]。因此,信道模型如何在准确度和复杂度之间做好权衡成为一个值得探讨的课题,如图4(a)所示。

信道建模经过长期发展已经拥有了较完备的经典设计和处理方法。大量实践证明,这些经典方法在工程上极其有效,且易于实现。例如,文献[51]提出了一种基于GBSM可以直接获取CSI的信道模型的方法,该方法和机器学习类似,具有自学习的优点,且适用于时变信道,实验结果也表明该模型的适用范围较广。这意味着,即使采用先进的机器学习算法,也可能无法超越这些经典算法,而且机器学习学习本身也有明显的局限性,无论是BP 算法还是强化学习算法均存在训练的收敛时间问题,能否满足移动通信系统实时处理的需求,需要进行较充分的评估[52]。但是5G 系统存在大量传统方法难以建模、求解或高效实现的问题,例如大规模多用户的聚类、新的复杂应用场景的信道建模等,这为机器学习在5G 系统的有效应用提供了可能。同时,一些新的机器学习算法还在不断发展,为机器学习算法在5G 系统的信道建模提供了新的机遇。因此,机器学习技术在5G 系统及6G 系统的信道建模设计与优化都具有很高的潜在价值。

3.1 基于神经网络的信道建模

图4 传统的信道建模流程与基于神经网络的信道建模流程

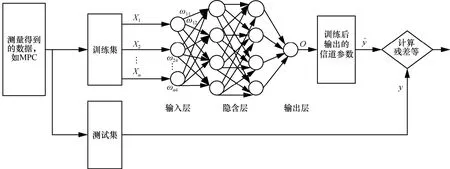

考虑到神经网络优异的学习机制,前人基于实测的信道数据使用神经网络来进行信道建模。一方面,对于已有的各种无线信道模型(它们属于线性模型),只需要用相应模型产生的数据对神经网络进行训练,便可以使神经网络在最小均方误差的准则下逼近实际的信道模型。另一方面,当实际的无线信道都是非线性/非平稳的,而神经网络恰恰在模拟非线性系统上有着良好的性能。使用神经网络的方法还有一个优势,即神经网络的网络结构相对固定,如果需要重新对一个无线信道进行建模,只需要用不同的数据对其训练就可以做到,也就是说神经网络具有自适应的特点,这个特点对信道建模特别重要。神经网络采用普适结构,减少了重新建模的代价,尤其是在对实际信道数据的分析建模中。如图4(b)所示,基于神经网络的信道建模利用实测数据来训练,不需要确定电磁波的传播路径,故不会受到环境的约束,更适用于各种复杂的场景。神经网络通过不断的训练,建立了表征输入层变量(训练集)和输出层变量(大尺度衰落参数、小尺度衰落参数)关系的模型,那么根据已知的输入层变量,就可以精准地预测相应的信道参数。通过对比神经网络的预测参数和实测参数,可以评估基于神经网络建立的信道模型的性能。因此,在无线信道建模中,以神经网络为代表的机器学习算法不仅是对模型进行适当的参数拟合的最佳方法,更是对模型进行更新以获得更精确的无线通信系统的方式。

当今用于信道建模的神经网络类型分别有前馈神经网络(FNN,feed forward neural network)[53]、反向传播神经网络[54]、径向基神经网络(RBFNN,radial basis function neural network)[55-56]和卷积神经网络(CNN,convolutional neural network)[57]。一个完整的神经网络包括输入层、隐含层和输出层,基本元件为神经元。当神经网络用于回归拟合时,其输入层的数据称为训练集,训练集通过不断的训练,使输出层得到的参数逼近于实测值。隐含层中的神经元数量和层数根据一些规则和目标进行设置[58]。

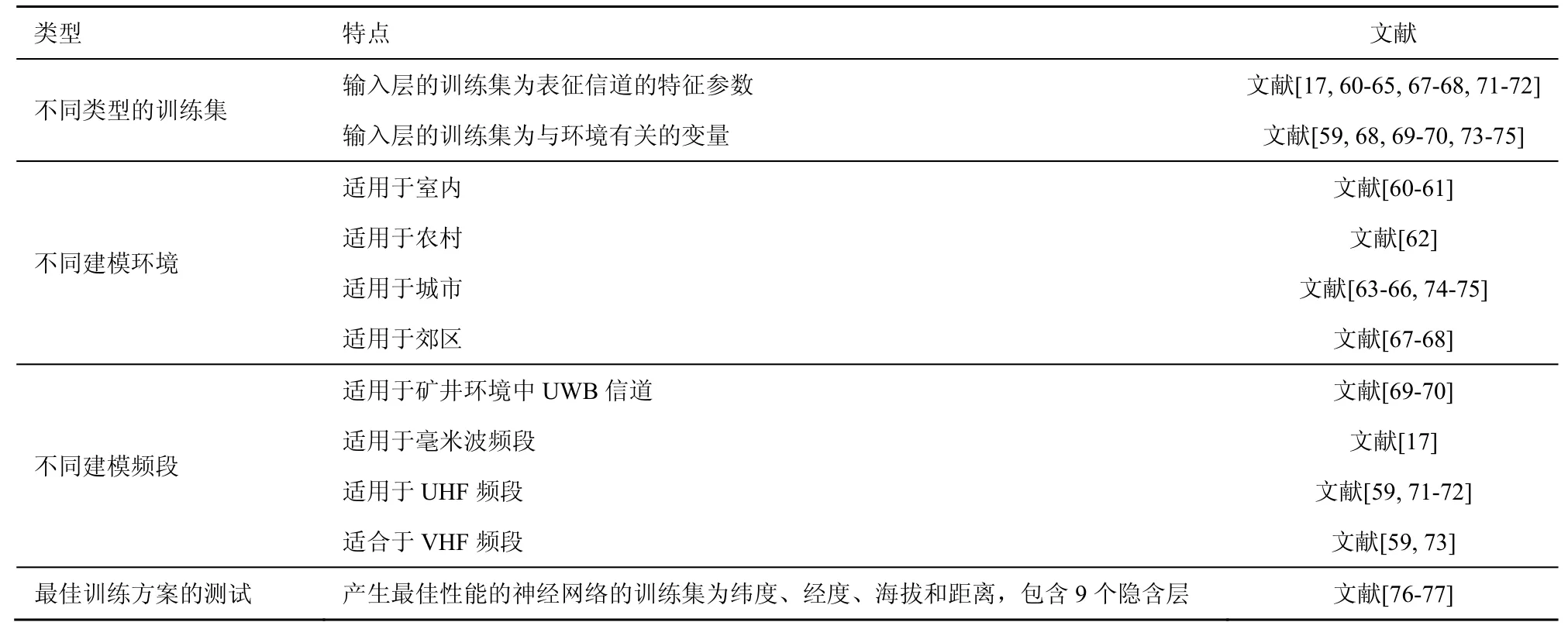

电磁波在传输中会经历大尺度衰落和小尺度衰落,大尺度衰落描述了长距离内接收信号强度的缓慢变化,小尺度衰落则描述了短距离或短时间内信号强度的剧烈变化。大尺度衰落特性的研究有助于分析信道的可用性、载波频率的选择以及无线网络的优化,小尺度衰落特性的研究则有利于移动通信中传输技术的实现及数字接收机的优化[47]。本节根据输出层所拟合的特性参数的不同,将神经网络在信道建模中的应用分为大尺度衰落建模和小尺度衰落建模。目前,现有的研究根据训练集、应用环境及频段的不同对路径损耗进行了建模。另外,为了得到性能最佳的训练方案,有学者针对不同训练集及神经网络的结构做出了测试。相应地,小尺度衰落包含信道冲激响应、时延扩展、多普勒频偏角度扩展等参数。最后,本节归纳出了神经网络在信道建模中的3 类模型结构。

3.1.1 大尺度衰落建模

如图5 所示,针对大尺度衰落,可以得到路径损耗和阴影衰落。路径损耗决定了蜂窝网络的覆盖距离和受干扰的程度,其依赖于传播环境、频带及天线增益。阴影衰落在对数域服从均值为0 的正态分布,其标准差σ由路径损耗模型的预测值和实测数据的统计偏差来表示[11]。传统大尺度衰落中对路径损耗和阴影衰落进行建模时,都是基于统计分布、经验值进行通用计算的,而实际中不同场景的物理传播环境、收发天线等参数对信道模型有着重要影响,传统经验公式很难体现这些维度的信息。神经网络可以对高维度数据以及非线性映射关系进行训练和计算,解决了传统

图5 神经网络在信道建模中的应用

、建模方法几乎无法解决的问题[59]。研究表明,神经网络适用于多种传播环境下的路径损耗建模,比如室内[60-61]、农村[62]、城市[63-66]和郊区[67-68]。如表2 所示,文献[69-70]提出了一种用于矿井环境中超宽带(UWB,ultra-wideband)信道路径损耗的神经网络模型,重点研究了路径损耗衰减随着时间和距离变化的情况。Ferreira 等[71]和Ayadi等[72]利用神经网络来改善对超高频(UHF,ultra high frequency)频段(300~3 000 MHz)中室外信号强度的预测,测量是在城市环境中以1 140 MHz进行的,绕射损耗和信号强度被输入神经网络中,输出层接收信号的强度来源于ITU-R 模型的计算结果,结果表明神经网络可以改善UHF 频带中室外信号强度的预测。Faruk 等[59,73]研究了在甚高频(VHF,very high frequency)频段(30~300 MHz)下,路径损耗与传播距离之间的关系。Zhao 等[17]研究了在毫米波频段(30~300 GHz)下路径损耗与传播距离之间的关系。

在信道建模中,神经网络的训练集通常为表征信道的特征参数,比如信号的幅值、频率、相位等,但其并没有综合地理因素,而环境中的障碍物导致电磁波在传播过程中发生了能量损耗,因此神经网络的训练集可以加入与地形地貌有关的变量。Lee等[74]提出了一种基于CNN 的毫米波路径损耗的模型,该模型将三维地图根据相应的特征(建筑物高度转换为RGB(red,green,blue)的红色通道值,发射机和地平面的高度转化为RGB 的绿色通道值)转化成二维RGB 图,并以此作为输入,利用三维射线追踪算法来生成毫米波信道和相应的路径损耗值(作为训练输出),测试表明,环境的变化对该模型的影响并不大,因此该模型具有较好的适应环境变化能力。文献[75]中针对视距(LOS,line of sight)和非视距(NLOS,non-line of sight)建立了不同的城区路径损耗预测模型。对于LOS,利用相关数据(如发射器和接收器的距离、建筑物的高度、街道的宽度、建筑物的分离度及相对于屋顶的发射天线的位置)训练模型;对于NLOS,建立了2 个神经网络模型,第一个模型使用LOS 中的相同参数进行训练,第二个模型除了使用上述参数以外,还包括通过经典模型计算的绕射损耗,这种神经网络和物理数据相结合的混合系统使结果更准确。文献[71]则将深度神经网络中的多层感知机(MLP,multi-layer perceptron)应用于UHF 频段,输入层为接发端的距离和绕射损耗,利用ITU-R 模型计算出的结果来训练神经网络的输出层,神经网络训练后的平均偏差与ITU-R 模型相比降低了约8 dB。

对于路径损耗模型的建立,训练集的选择及神经网络参数的设置是影响性能的关键因素,在这种情况下,为了建立有效的模型并正确地进行路径损耗预测,必须设计合适的训练方案[76]。Popoola 等[77]使用实测数据训练NN 模型,以了解输出变量(路径损耗)与输入变量(训练集)之间的非线性关系,例如传输频率、建筑物高度、接收器天线高度、发射器天线高度等,从而确定实现最佳路径损耗预测时的输入向量和所需的神经网络参数。结果表明,产生最佳性能的NN 模型采用4 个输入变量(纬度、经度、海拔和距离),包含9 个隐含层,激活函数为双曲线正切S 型。

表2 基于神经网络的大尺度衰落建模分类

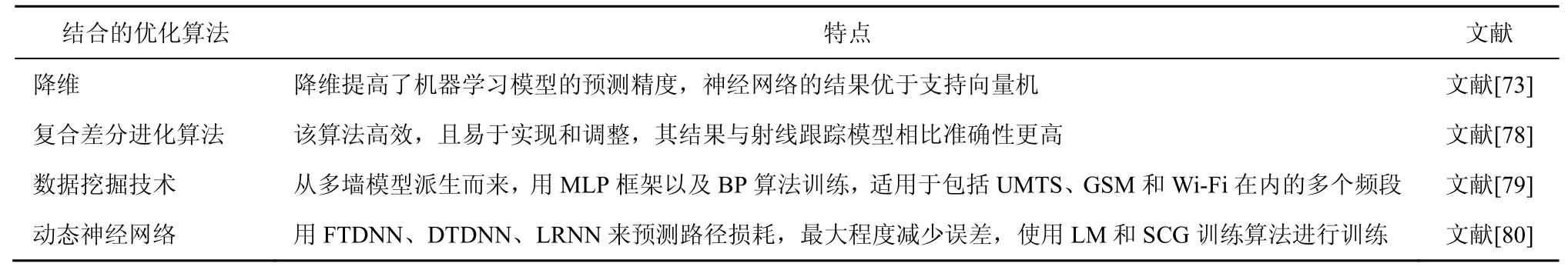

此外,神经网络还可以与一些算法或者技术相结合来优化路径损耗模型的性能来提高模型的预测精度、效率或者扩展其适用的场景、频段,如表3所示。Salman 等[73]评估了降维对路径损耗预测精度的影响,通过实验表明降维提高了机器学习模型的预测精度,且神经网络预测路径损耗的性能优于支持向量机。Sotiroudis 等[78]结合了复合差分进化(CDE,composite differential evolution)算法来构造模型,结果表明,CDE 算法高效、易于实现和调整,Sotiroudis 等还建议通过构建非均匀的环境数据集来提高NN 的泛化性和逼近能力。Zineb 等[79]构造了一种将神经网络和数据挖掘技术相结合的新模型,该模型从多墙模型派生而来,适用于包括UMTS、GSM 和Wi-Fi 在内的多个频带,使用MLP框架以及BP 算法对测量数据(包括频率、楼层衰减、收发器距离和频率)进行训练,该多频段的多墙模型相比校正后的多墙模型表现出更好的性能和更高的精度。Bhuvaneshwari 等[80]评估了3 个动态神经网络,即聚焦时延神经网络(FTDNN,focusing on the time delay neural network)、分布式时延神经网络(DTDNN,distributed delay neural network)和分层递归神经网络(LRNN,layered recursive neural network)在路径损耗预测中的应用,每个动态神经网络都使用 LM(levenbergmarquardt)优化算法和 SCG(scaled conjugate gradient)算法进行训练。结果表明,随着计算时间的增加,LRNN 的性能最佳,FTDNN 的性能优于DTDNN。

3.1.2 小尺度衰落建模

目前,神经网络在小尺度衰落建模的研究体现在对于不同场景和不同特征参数的建模,其特性参数和特点如表4 所示。Zhao 等[17]和Sun 等[81]利用RBFNN 对基于26 GHz 的5G 毫米波时变信道进行建模,并利用SAGE 算法提取出信道的多径数和到达角来训练RBFNN,从而实现可分辨的每一条路径的接收功率和到达角的预测,最后将预测结果重新放到GBSM 中进行验证。结果表明,提取的参数与实测数据吻合较好。Liu 等[54]为了得到信道传递函数,采用学习机和极限学习机(ELM,extreme learning machine)训练神经网络,结果表明ELM提供毫秒级学习的能力使它非常适于高速情况下的衰落信道建模。Bai 等[57]提出了一种针对毫米波频段的三维MIMO 室内信道建模方法,该方法基于CNN 模型,输入数据为发射机和接收机的坐标,输出的特征参数包括接收功率、时延、发射方位角、发射仰角、到达方位角和到达仰角。

另外,也有文献研究结合其他技术来优化小尺度衰落信道的建模。文献[6,82]首先利用BPNN 去除实际测量中所带来的噪声,再利用PCA 提取CIR在频域的幅值的主要特征,并根据子信道的相关性及CIR 在时域的统计特性得到其在频域的相位,由此可以重构出时域的CIR。与GBSM 相比,该模型提升了MIMO 信道的容量。此外,还可以将神经网络和三维射线跟踪算法相结合[83],以计算室内无线信道的性能。该方法可以在仿真场景中使用较少的发射射线,并且利用神经网络对射线发射中的中间点进行预测,从而降低计算复杂度,提高处理效率。

表3 模型的优化算法及特点

表4 基于神经网络的小尺度衰落建模的特性参数和特点

3.1.3 通用的模型结构

由上述研究可知,在信道建模中神经网络可用于信道特征回归分析和参数预测,因此可以得到如图6 所示的基于神经网络的回归模型,训练该模型还用于信道估计、链路预算等。这种信道模型结合了神经网络和回归分析的优势,可以更好地揭露复杂信道环境中变量之间的定量关系。该神经网络输出层的训练参数来源于实测或者经典模型的计算值,其可以根据残差、均方根误差、回归系数、标准偏差等评价指标来判断信道性能的好坏,从而求得无线信道建模的精度。另外,还可以利用交叉验证法来验证模型的泛化能力[84]。

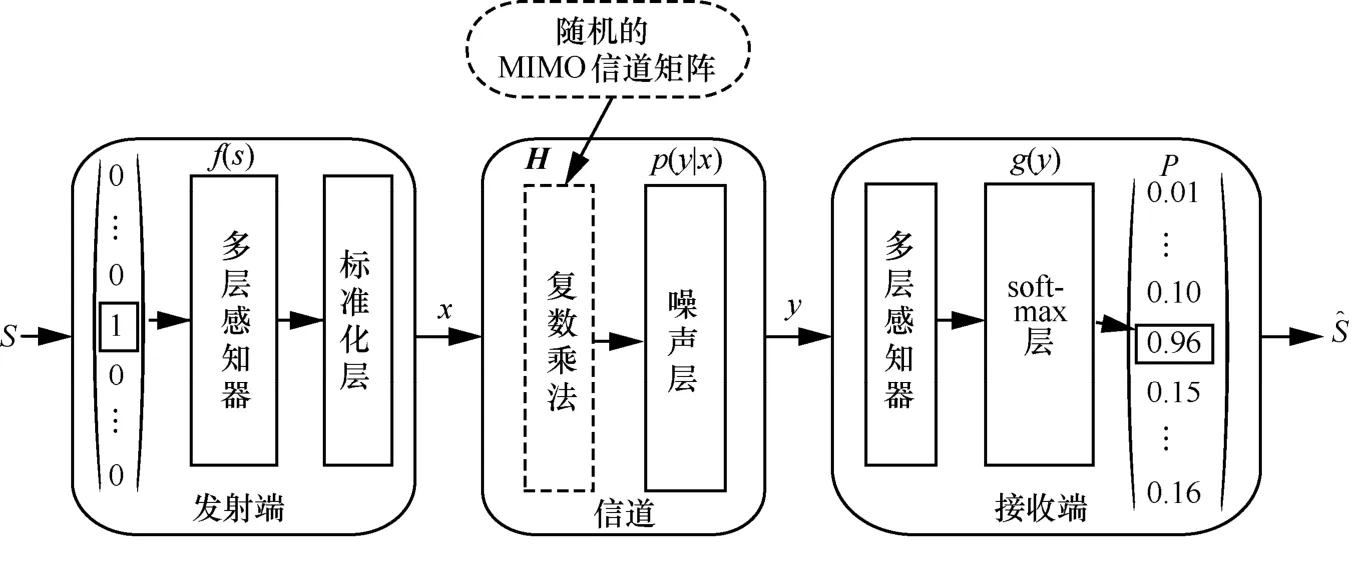

另一种信道模型结构端到端的自编码器[4]如图7所示。该自编码器的发射端连接多层感知器和一个归一化层,中间的加性白高斯噪声信道用神经网络的噪声层表示,接收端则由MLP 和softmax 激活函数组成,该自编码器基于端到端的误比特率或误块率进行训练。文献[85]针对通信系统中数据速率受限的问题,对上述自编码器结构进行了优化,提出了2 种新的传输方案。文献[86]通过增加信道矩阵和复数乘法相关模块,将这种自编码器优化方法推广到MIMO 上。

除了神经网络以外,国内外的研究表明,SVM也可以应用在信道建模上[87],这体现在特定的场景中,比如多径衰落信道[88]和矿井信道[89]。这是因为SVM 是建立在统计学习理论中VC 维(vapnik-chervonenkis dimension)理论和结构风险最小化原则基础上的机器学习算法,它在解决小样本、非线性和高纬度的问题上表现出独特的优势[90],并且SVM 已经成功地应用在无线通信、模式识别、生物信息等多个领域。

图6 基于神经网络的回归预测信道参数的流程

图7 端到端的自编码器架构

3.2 基于簇核的信道建模

与统计性建模相比,基于神经网络的信道建模方法虽然提高了模型预测的准确度,但其复杂度和计算量通常较高。在应对未来移动通信系统需求的复杂多样的应用场景上,其在建模高效性和模型通用性方面存在一定的局限性。而传统基于簇的GBSM 虽然复杂度低,但难以应对大规模天线、高频段大带宽、应用场景多样化等挑战带来的信道数据量激增,而且“簇”是从角度、时延等参数的统计定义,缺乏物理含义[2]。因此,以上2 种模型都难以同时满足5G 系统对信道模型的高精度、低复杂、通用性的需求。

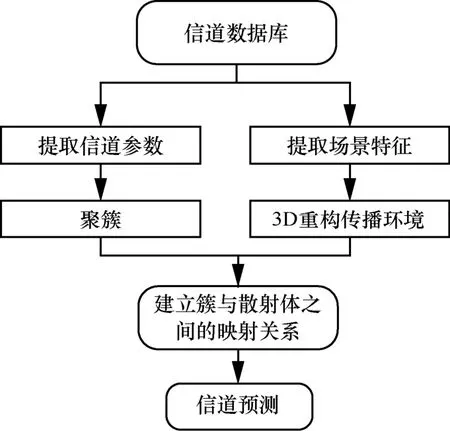

为了解决此问题,Zhang[2]提出了一种基于“簇核”的智能化信道建模新方法。簇核被定义为一种具有某种形状,与传播环境中散射体具有一定映射关系,且在各种场景下能够主导CIR 生成的簇。基于此,提出了“多径波、簇核、信道”的三层结构。由此结构出发,通过数据挖掘和机器学习,得到多样场景、频段、配置下簇核变化和生成信道的规律,从而预测出各种环境下的信道响应。

基于“簇核”的智能化信道建模方法的关键步骤是研究多径簇与实际物理传播环境中的散射体之间的匹配映射关系,而准确、自动地获取传播环境信息和散射体纹理信息是研究匹配映射关系的前提。

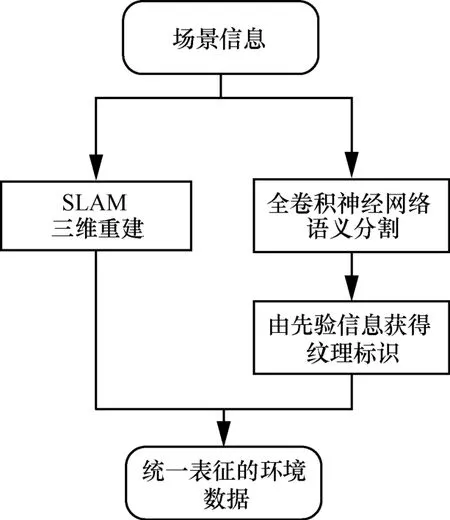

从电磁波传播环境角度出发,通过机器学习算法获取不同典型传播环境中的物体类别标识,进而通过一定先验知识获得纹理标识,同时并行地对环境进行三维重构[41,91]。首先需要采用 SLAM(simultaneous localization and mapping)对场景的三维结构进行恢复[92]。然后对于每张图片采用基于全卷积网络的方法对环境照片进行语义分割,找到照片中每一个像素点所对应的最有可能的物体类别,再利用对物体的先验知识对纹理材质进行标定。获取每个像素点所代表的纹理标识之后即可将该标识与重构所得到的三维模型进行融合,得到统一表征的环境数据。所得到的传播环境纹理可进行标识及寻找传播环境中主要的散射体,为信道模型的学习提供环境模型。传播环境的三维重构基本思路如图8 所示。

图9 为基于簇核的信道建模基本流程[2]。一方面,通过对不同场景和不同频段进行信道测量,然后通过高精度参数估计算法,如SAGE,估计得到每条多径的参数,并对MPC 进行分簇,类似于传统的统计性建模过程。另一方面,利用计算机视觉和图像处理方法识别环境中的纹理信息,并对实际传播环境进行三维重构得到主要散射体,类似于确定性建模的过程。最关键的步骤是基于簇的特征和散射体的属性,利用机器学习算法找到簇和散射体之间的匹配映射关系,建立确定性环境和统计簇之间的联系。通过对多种场景、频段、天线配置信道数据进行特性挖掘,可以得到相应场景的簇核,并通过有限数量的簇核得到信道CIR,实现信道建模。

图8 传播环境的三维重构基本思路

图9 基于簇核的信道建模基本流程

由上述可知,无论是基于数据集的神经网络建模,还是基于簇核的智能化建模,其模型能否满足未来多样化场景实时处理的需求,还需要进行较充分的评估。对于模型的评估,一个重要的参考项就是模型的泛化能力。尽管数据库十分庞大,但是不能保证某一情境或者频段下的数据一定是完整的,因此,是否可以通过改进模型的训练方法使其能够学习不同的数据空间,提高其泛化能力,使模型具有更好的扩展性,这对评估性能具有重要意义。另外,对于神经网络建模来讲,合适的网络参数设置对模型的构造是十分重要的,但是目前并没有完备的理论说明如何进行参数设置才有更好的输出,通常都是人为调试,选择结果较理想的一组参数用于最终模型的构造,那么对于参数的选择还需要进行测试,这对建模来讲仍然是一个较烦琐的工作。

4 信道状态分类/场景识别

无线信特征的差异可以用来区分不同的传播模型,进而优化所属的通信网络。若能提取不同区域内无线信道的差异化特征,并根据实际情况进行必要的识别,则具有重要的科学意义与工程价值。比如列车由开阔地段进入隧道时可能会造成通信中断,如果能识别对应的场景,进而针对不同场景进行具体分析,则对优化无线传输网络的设计及模型的构造都具有重要意义。另外,对于精确的室内定位来说,视距和非视距信道产生的测量误差相差很大[93],因此需要对信道进行识别。尤其是在5G 技术不断发展的今天,为了能够保证用户在500 km/h 的速度下有更好的体验,利用机器学习的方法迅速、准确地识别出无线信道场景,从而在不同环境下高效地完成信息传输任务,是非常值得研究探索的。

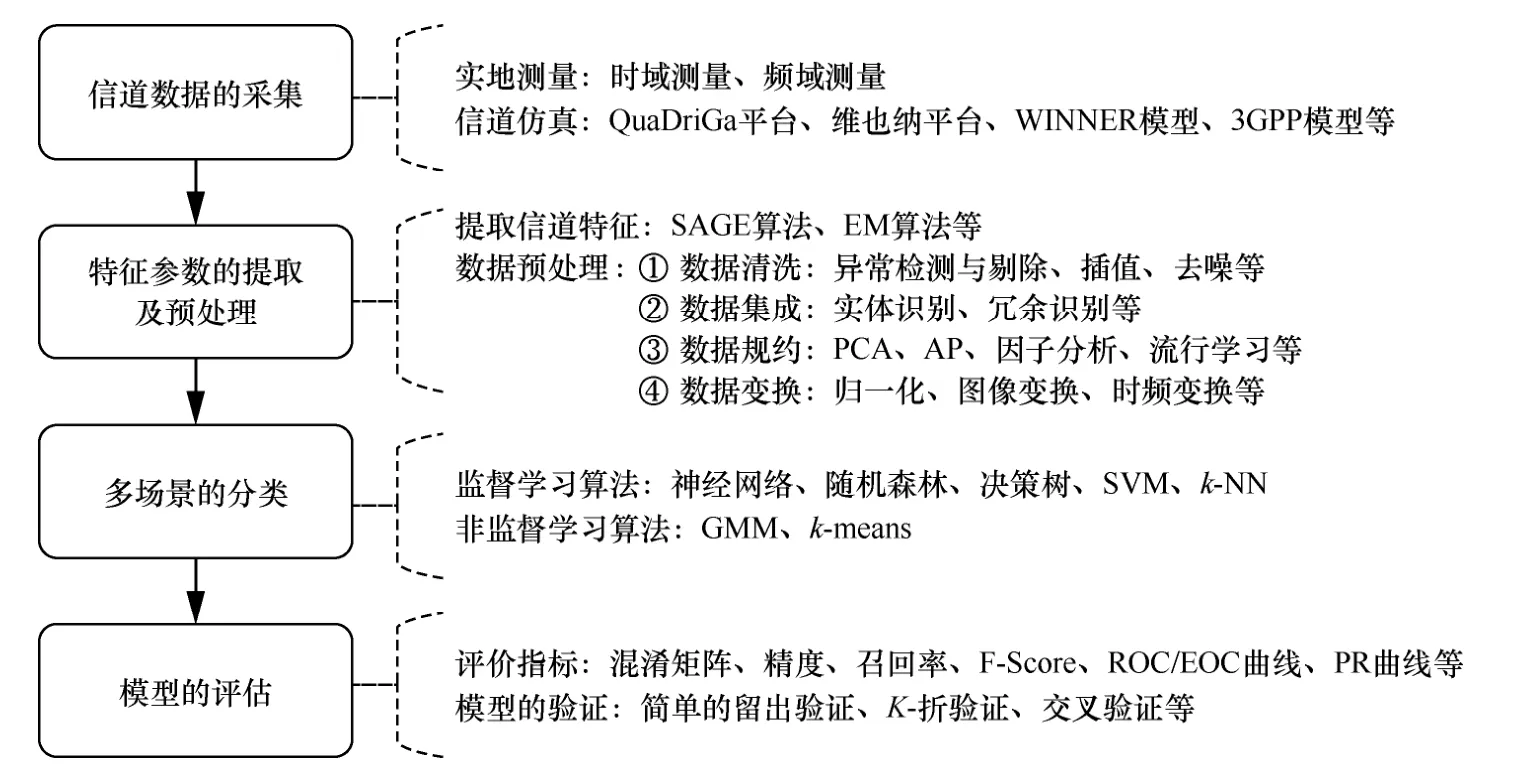

信道场景识别和信道状态分类的核心思想是通过提取信道的差异化特征,并加以区分,从而判断出目前信道所处的场景或状态[94]。因此,该研究的难点包括以下2 个方面。1)信道特征参数的选择及预处理。表征信道的参数有很多,比如路径损耗、K因子、多普勒频移等,考虑到实际测量的难度以及模型的识别效率,需要选择具有代表性的信道参数。另外,还要根据数据的特征及选定的识别算法进行数据的预处理,比如当原数据有缺失或者异常时,可以对其进行清洗、进行插值或者异常值剔除,甚至需要对数据进行一定的变换,如傅里叶变换等。2)高效的分类算法。可用于场景识别的算法有很多,其大多来源于机器学习中的监督学习和非监督学习,比如SVM、神经网络、GMM 算法等。因此要针对不同的应用场景,选择合适的机器学习算法,并对其进行合理的训练,从而构造具有高精度和高效率的无线信道场景识别模型。基于机器学习的无线信道场景识别的流程如图10 所示。

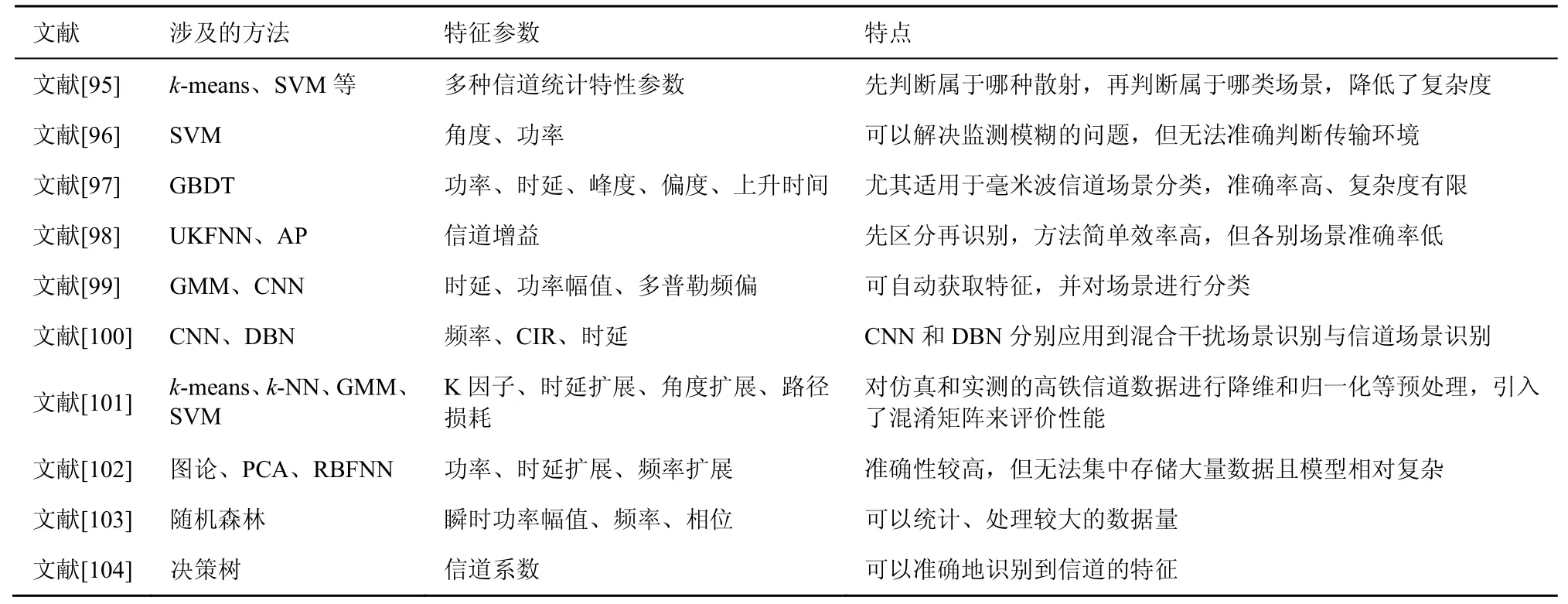

目前,国内外针对无线信道场景识别的研究方法如表5 所示。

无线信道受到周围环境的影响造成信道特征的差异,因此可以利用这些差异性的信道特征来区分不同的通信场景。由表5 可以发现,国内外针对无线信道场景识别的研究采用了神经网络、决策树、SVM、图论等方法,基本思路可以概括为以下几个方面。

图10 基于机器学习的无线信道场景识别的流程

表5 国内外针对无线信道场景识别的研究方法

1)构造分类模型,即将数据分成某一大类(路段、区域等),再利用ML 细化识别为某一场景。周涛等[95]提出的高铁信道场景下识别方案是先利用k-means 算法判断其属于哪类传播场景,再利用相应的ML 算法判断所处的原始场景。黄晨等[96]提出了一种基于SVM 的无线信道场景识别方法,该方法将采集的信道数据人为地分为LOS和NLOS两类,再分别对两类信道数据进行了特征提取和转化,从而构造分类模型,最后对所构造的模型进行测试。Huang 等[97]提出了一种基于梯度提升决策树(GBDT,gradient boosting decision tree)针对毫米波信道LOS 和NLOS 场景的分类方法。该方法首先从信道冲激响应中提取多种信道特征参数,然后分析不同特征参数相关性及对信道场景分类准确度的影响,并基于此建立了联合多维参数的GBDT 信道场景分类方法,具有较高的识别准确率。李太福等[98]提出了一种基于无迹卡尔曼滤波神经网络(UKFNN,unscented Kalman filtering neural network)和近邻传播(AP,affinity propagation)算法的识别方案,此方案根据信道状态建立动态实时滤波效果的分段模型和分区模型,复杂度低,但个别场景下的准确率较低。

2)基于神经网络的场景分类,先对数据进行一系列变换以满足不同类型的神经网络对输入层的要求,再利用神经网络进行分类。Li 等[99]利用GMM 算法获取信道状态信息,再将CSI 组成的信道特征矩阵输入CNN 进行分类识别,该方案可以在较少的导频资源下自动提取无线信道特征,从而降低计算复杂度和节约存储资源。刘祥[100]使用2 种深度学习的算法识别无线信道场景:第一种是针对混合干扰信号建立了基于CNN 的复合干扰场景识别模型;第二种是基于测量的数据提取信道的时域、频域及图像域特征,引入深度信念网络(DBN,deep belief network)模型进行分类识别。

3)先利用PCA 等方法实现数据降维,提取有效特征,再利用SVM/神经网络/随机森林等进行分类。Zhang 等[101]利用PCA 对仿真数据和实测的高铁信道数据降维,利用混淆矩阵来评判识别结果,结果表明k-近邻(k-NN,k-nearest neighbor)和SVM的准确率都超过了90%,GMM 算法的准确率可达89%。姚碧圆[102]依照图论的知识剖析信道传输特性,利用PCA 对特征参数进行降维,再利用RBFNN对参数进行分类从而实现场景识别,该模型准确性较高,但无法集中存储大量数据且模型相对复杂。陈能美等[103]根据随机向量决策树和多分类集成的构造原理,针对降维后的参数创建了识别信道场景的随机森林分类模型,该模型可以高效地处理较大的数据量,但是模型准确率仅为89.9%。Wu[104]根据无线信道的特征建立了相应的决策树分类模型,并在真实数据测试了模型,该模型可以更准确地识别出无线信道的特征。

与图像、语音和文字等数据相比,高质量的信道测量数据很难获取,一方面是由于信号的采集依赖于价格高昂的信号采集设备,另一方面则是在实际通信系统中,存在较多热噪声和突发干扰等因素,加大了信号采集的难度。而且,为了提高模型的识别范围,多种场景、状态下的通信数据是必不可少的。然而现在已公开的通信数据集较少,这给基于机器学习的模型训练和测试带来了难度,导致模型场景的识别效果很差,这就要求所建立的模型能够从有限的数据中学习到其内在特征,同时要提高其泛化能力。因此,可以考虑将深度学习应用到信道场景识别中,这样可以深入地挖掘信道特征,提高识别精度,比如结合图神经网络、递归神经网络等,当然这对数据的处理也提出了较高的要求。

5 未来工作

本文综述了机器学习应用于无线通信信道建模的理论框架。机器学习在无线通信信道建模中的科学解释已经有了依据和理由,也带来了更多的技术机遇。因此,与传统的信道建模方法相比,即使人们对建模领域的机器学习提出了很高的要求,仍然可以通过采用有效的预测模型和方法来降低复杂性、提高准确性。但是,无线通信信道建模仍然存在一些需要解决的挑战和阻碍,具体如下。

1)构建一个包含各种场景、配置、频段的可信的海量信道数据库。尽管一些科研组织具备的信道测量平台及相关条件,但是不同的科研机构、单位、院校在数据的格式、标签、整理方式上各不相同,如果将各种数据整理在统一要求的数据库中将存在较大的挑战。

2)特定场景下的有效信道建模,比如针对V2V信道、高铁信道及大规模MIMO 信道的建模。与传统场景下的信道模型相比,V2V 信道具有快速时变的特性,高铁信道的传播环境更复杂,大规模MIMO 信道具有空间非平稳特性,那么结合机器学习算法开发准确的参数提取算法并对不同场景有针对性地建模,有利于保证用户有更好的情景体验,因此如何利用机器学习的算法替代传统的信道模型,仍是一个值得研究的课题。

3)结合大数据技术来改进信道建模,随着5G时代的到来,天线数量、带宽以及应用场景在不断增加,这使信道测量和估计的数据量呈爆炸式增长,给数据的分析和处理带来了很大的挑战。是否可以通过结合统计分析技术和分布式计算技术来构建更高级的机器学习模型,以此提高训练海量数据的预测准确性,还存在许多未解决的问题。

4)建立多径簇与传播环境散射体的匹配映射机理,掌握簇核的属性和分布规律并实现自动匹配。利用计算机领域的数据挖掘和机器学习算法,适用于无线信道样本中无线电磁波传播特性的精确、高效挖掘,准确揭示出簇核在不同场景、频段、移动速度、天线等参量下的簇核变化规律;基于簇核的信道建模理论达到“各种场景、各种配置”下的信道衰落预测的最高目标。

5)当前信道场景识别方案大都是利用监督学习的算法进行分类,然而通信数据集的标签往往是缺失的,这对识别效果的影响很大,为了解决上述问题,也有研究使用非监督学习的算法比如GMM算法,但识别精度不是很理想,所以如何提高非监督学习算法在无线信道场景识别的精度是值得探索的。另外,目前的研究方法尚没有对多种带宽的场景进行讨论,未来的研究可以以此来展开。

6 结束语

本文探讨了机器学习在信道建模过程中的应用。首先介绍了信道多径的分簇方法,这是为了识别出簇,进而为构建以簇为核心的信道模型的研究提供基础,还介绍了利用机器学习优化经典的参数估计算法,从而帮助传统参数估计算法应对信道大数据化的挑战。其次,介绍了将神经网络用以信道建模的优势并总结了利用神经网络构造大尺度衰落和小尺度衰落信道模型的过程,给出了其适用范围和通用的模型结构。再次,提出了一种基于簇核的智能化信道建模方法,该方法结合了统计性建模和确定性建模的优势,用以实现多种场景、配置、频段的信道建模。最后,介绍了通过信道场景的识别,可以有针对性地根据不同场景选择合适的模型,进而提高无线通信系统的传输效率。本文讨论了在无线通信领域机器学习中一些有用的方法,如回归拟合,可以得到性能更好、复杂度更低的信道参数;聚类,可以在复杂多变的环境中识别出簇;分类,对多样的场景进行精准的分类识别。这些算法可以实现对测量数据的预处理,提取MPC 的特征,以及通过直接寻找环境和多径簇之间的映射关系来对信道进行建模,可以有效地降低模型复杂度的同时实现准确建模。这些研究结果可以为未来5G之后的信道建模研究提供理论基础。

到目前为止,即便学术界和工业界在利用机器学习对无线信道进行建模方面投入了大量的人力和物力,但涉及机器学习的无线信道建模领域仍处于初级阶段。本文期望通过综述机器学习在信道建模领域应用的已有研究成果,探讨分析研究目标和方法,总结研究思路,从而为相关领域的研究人员提供参考和帮助。