自然场景车标数据集的构建及其应用*

2021-02-01邹北骥雷太航廖望旻姜灵子

邹北骥,雷太航,刘 姝,廖望旻,姜灵子

(1.中南大学 计算机学院,湖南 长沙 410083;2.中南大学 湖南省机器视觉与智慧医疗工程技术研究中心,湖南 长沙 410083)

近年来,智能监控技术不断发展,越来越普及。在涉及汽车违法犯罪的事件中,对车辆信息的采集格外重要。为了更好地获取车辆信息,人们在城市街道路口和高速公路出入口设置了许多摄像头,对来往车辆进行采集作业。借助车牌、车标、车型等关键标识来监控车辆,在打击各种违法犯罪活动中发挥着重要作用。考虑城市道路场景中存在着车牌污损、套牌和恶意遮挡等情况,基于机动车品牌、型号和颜色进行识别的应用往往更加广泛[1]。因此,车标识别具有很高的实用价值,不仅能在交管部门、停车区域、维修中心等场所为车辆的管理与引导提供依据,还能为车牌和车型识别提供支持[2]。

面向真实拍摄的自然场景,车标识别是一项具有挑战性的任务,这是因为:道路场景复杂,摄像头多为广角镜头且距离较远,可能导致车辆并非图像中的主体[2-3],如图1所示;车标作为车身中一小块区域,其主体性更无法突出。此外,由于汽车通常处于高速运动状态,拍摄图像很可能出现动态模糊;同时受到光线、天气、角度等众多因素影响,成像质量也将下降。最先兴起的车标识别依赖人工对图像进行核查,耗费了大量的人力物力,促使着国内外专家学者对智能化车标识别开展研究工作。

图1 真实拍摄的道路场景,车辆的主体性不显著Fig.1 Road scene captured by a real camera,where vehicles are not the main parts

现有的自然场景车标识别方法主要分为两类:基于传统特征的方法和基于深度学习的方法。基于传统特征的方法先采用直方图、纹理、不变矩等传统特征描述车标,再使用机器学习算法对其进行分类预测。罗彬等[4]结合边缘直方图与模版匹配算法对17类车标进行识别,准确率达到91%。刘嘉敏等[5]采用Hu不变矩提取车标图像特征,在识别种类很少的车标时性能优越;随着车标种类增多,某些不变矩特征较为接近,从而影响了识别力。文献[6]通过车标车灯的拓扑结构先对车标进行定位,再利用边缘不变矩实现车标分类。Psyllos等[7]提出一种基于尺度不变特征变换的增强匹配框架,在1 200幅共10类的车标数据集上取得了97%的平均准确率。此类方法简单、高效,但对种类偏多的车标识别效果较差。此外,传统特征的构建依赖于各自数据库,鲁棒性不足。

基于深度学习的车标识别方法无须人为设计特征,而是从车标数据中自动学习特征表达。Huang等[8]引入预训练策略,将卷积神经网络(Convolutional Neural Network,CNN)迁移至车标识别任务中,在一个大规模10分类数据库上获得了突破性成果。近些年,多种CNN结构及其变体的有效性也得到证实,如残差网络(ResNet)与Inception网络联合模型[9]、多通路树状CNN[10]等,均取得了比传统CNN更好的车标识别性能。值得一提的是,上述两项工作仅针对车标区域图像开展研究,跳过了车标检测步骤,对真实拍摄的复杂场景适用性不强。此类方法能自动学习车标特征,与传统特征相比预测效果更为出色,但深层网络部署较复杂,训练时间较长。

车标数据是训练车标识别模型并且保证其泛化力的关键。不同工作所使用的数据库[7-9,11]规格不一,来源也不尽相同,对于静态、近距离、光线好等实验室环境下获取的车标样本,识别算法的准确率与实用性均有待考证[12]。据目前所知,公开的数据库包括Medialab LPR[11]、XMU车标库[8]和HFUT-VL[13],分别存在数据量小、车标种类少、样本仅涉及车标区域的问题,在现实应用中的适用度不高[14-15]。为填补这些不足,本文建立了一个面向自然场景的大型车标数据集。与文献[7,9,16]相比,数据规模扩充了近10倍,包含10 324幅真实拍摄的车辆图片,且场景分布更为复杂;与文献[8-9,11]相比,车标种类扩大了近7倍,覆盖我国路面约95%的汽车品牌。此数据集可为车标、车牌、车型识别等相关研究奠定数据基础。

作为上述数据集的直接应用成果,本文提出了一个基于目标检测和深度学习的车标识别方法,包括车标检测(Vehicle Logo Detection,VLD)与车标识别(Vehicle Logo Recognition,VLR)两大步骤。车标检测算法采用YOLOv3框架[17],并结合仿射变换矩阵,快速准确地从自然场景的车辆图像中定位车标感兴趣区域;车标识别算法利用50层ResNet(ResNet-50)[18],实现对车标的分类预测。实验结果表明,本文方法能有效应对复杂自然场景中的车标识别问题,对于涉及多种类的车标识别任务达到了89.0%的准确度。

1 自然场景车标数据集

车标数据的获取是整个识别过程的根基。本领域内采用的数据通常来源于已公开的LPR库[11]和其他采集途径,各自存在着数据规模小、车标种类少、成像环境部分理想化等问题,使得车标识别方法缺乏可信度和实用性。因此,本文构建了一个自然场景下的全新实验数据库,所有车辆图片均由作者拍摄所得,并标注了车标位置和种类。

1.1 车标数据的获取

本文精心设计了数据采集与过滤标准,主要考虑以下三个方面。

1)图片分辨率:本研究的应用场景定位为道路监控,真实监控摄像头拍摄的道路图片大多在500万像素或者更高,选用分辨率与之接近的拍摄设备以获取贴近现实采集环境的车辆数据。由于苹果和华为手机的拍摄分辨率足够适应当前先进的监控系统,本研究利用这两款手机摄像头完成数据采集工作。

2)拍摄光线、距离、角度:为了使后续研究的车标识别方法能够有效应对复杂多变的成像环境,提高其鲁棒性,研究对拍摄光线、距离和角度不做过多限制。采集过程中选择在不同天气、时间或场地进行拍摄,以保证不同光照强度下都有充足的样本量。如图2所示,为获取暗光、较暗光和强光下的车辆图像,可分别在夜晚或地下停车场、阴雨天和晴天采集数据。同时兼顾多距离拍摄条件,采用定点拍摄方式,对近距离(1~5 m)和远距离(5~40 m)的来往车辆进行采集作业,如图3所示。此外,为了避免自然场景过于相似,还需经常调整拍摄位置和角度,通常选择在道路左、右侧和车辆前、后方获取多个角度的拍摄样本,如图4所示。

(a) 夜晚 (b) 地下停车场 (c) 阴天 (d) 晴天(a) Night (b) Underground parking (c) Cloudy day (d) Sunny day 图2 不同光线下拍摄的车辆数据示例Fig.2 Examples of vehicle images captured under different illuminations

(a) 近距离 (b) 远距离(a) Short distance (b) Long distance图3 不同距离下拍摄的车辆数据示例Fig.3 Examples of vehicle images captured under different distances

(a) 前方 (b) 左前方 (c) 右前方 (d) 俯视(a) Front (b) Front left (c) Front right (d) Overlooking图4 不同角度下拍摄的车辆数据示例Fig.4 Examples of vehicle images captured under different views

3)各类车标数据量:大规模、多样化的车标数据集是有效训练识别模型并且增强其泛化力的关键。数据集中各类车标应保持充足的样本数,考虑到车标种类繁多,采用“地毯式”与“针对式”相结合的拍摄方式。首先通过“地毯式”拍摄高效地获取大量自然场景中的车辆图像,并对品牌进行划分与整理。其中,采集数排名前30的车标已经涵盖我国路面约90%的品牌,期望这些种类都有100幅以上的样本量。对于数量未达标的车标种类(如图5中的标致、五菱、起亚等),赴对应品牌经销商或修理厂进行“针对式”拍摄。其他非主流品牌(如图5中的中华、江淮等),同样需经过“针对式”拍摄,保证其20~80幅采集量即可。

图5 “地毯式”拍摄后,部分品牌采集量的分布直方图Fig.5 The number of some vehicle brands after the “blanket” collection

1.2 数据集指标与对比

本研究共采集了10 324幅自然场景车辆图片,涉及67类车标,多种光线强度、远近距离和拍摄角度。借助labelme工具对图像中车标位置进行手工标定,数据集按照车标种类分别存放于对应文件夹,总大小为35.1 GB。

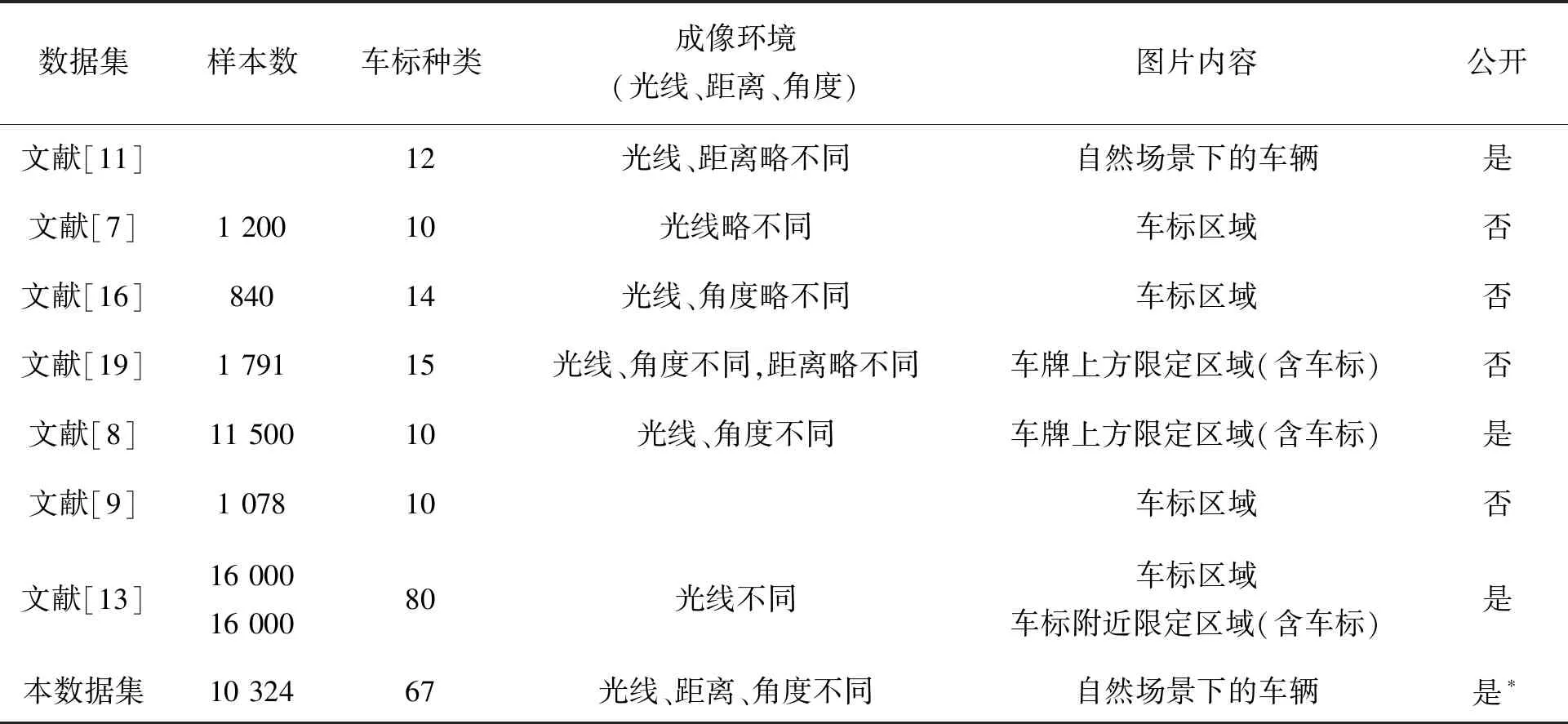

表1简要描述了车标识别研究中的现存数据库。显然,它们各自存在着一些问题,包括数据规模偏小、车标种类少、成像环境较单一、仅含车标区域样本、公开性较差。大部分工作所使用的样本数为几百到几千不等;虽然文献[8]包含一万余个样本,其中却只有1 000个是真实拍摄所得,其余则由数据增广等手段获取。文献[13]公布了目前最大的数据库HFUT-VL,但32 000幅图像均为车标或其附近限定区域,由此建立的车标识别模型对真实场景的适用性不强;文献[7-9,16,19]同样存在这一局限性(如图6所示)。LPR库[11]提供了自然场景下的车辆数据,但部分样本不具有车标区域。

图6 仅含车标区域的样本示例Fig.6 Examples of samples with only vehicle logos

表1 数据集各指标对比Tab.1 Comparison of datasets

此外,车标多样性不足、成像复杂性不高也是大多数数据库的共性问题[7,11,16,19]。

本文在扩充数据量和车标数的基础上,综合复杂多变的拍摄环境与背景,获取了自然场景中的车辆图片,并给出车标位置和标签,以期望提高分类预测的鲁棒性。本数据集的各项指标如表1所示。考虑到样本的图片内容,还可衍生出诸多应用场景,如自然场景车辆、车牌和车型的检测与识别。

2 自然场景车标数据集的应用——车标识别方法研究

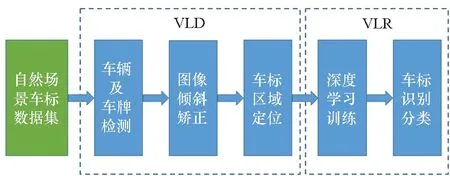

数据集的创建对于车辆及其属性(如车牌、车标、车型等)研究有着重要的意义。作为其直接应用成果之一,本文还开展了面向自然场景的车标识别方法研究。整体框架如图7所示,分为VLD和VLR两大部分。

图7 车标识别整体框架Fig.7 Framework of vehicle logo recognition

2.1 VLD算法

VLD包括车辆及车牌检测、图像倾斜矫正、车标区域定位三个步骤,实现了从复杂背景的车辆图像中快速准确地提取车标感兴趣区域,有效应对自然场景下车标主体不突出的问题。

首先利用YOLOv3及Poly-YOLO框架[17,20]检测车辆以及车牌角点。YOLOv3是一种高效且高精度的小目标检测框架,核心结构为Darknet-53网络,其原理为对目标所在的边界框在3个特征层上进行卷积预测,并预测边界框内包含目标的概率;Poly-YOLO具有针对旋转矩形框进行检测的能力,能高效准确获取车牌区域及角点。将原始图片送入YOLO训练,并获取车辆和车牌角点,如图8所示。

图8 车辆及车牌检测Fig.8 Vehicle and license plate detection

考虑车辆区域可能存在倾斜,借助车牌角点坐标关系进行仿射变换,实现车辆整体的方向修正[21]。假设点a、c、d分别位于车牌左下角、左上角、右上角,点A、C、D为仿射变换后对应点,两者间变换公式为:

(1)

(2)

(3)

其中,440/140为我国车辆牌照尺寸。将这三组点的坐标值输入式(4),求得仿射变换矩阵的参数θ11、θ12、θ13、θ21、θ22、θ23:

(4)

其中,[x,y]和[x′,y′]分别表示矫正前、后点坐标。对车辆区域的每个点均按照式(4)进行方向修正,尽可能消除图像倾斜导致的背景复杂性。

最后,根据车牌与车标的一般相对位置关系,将车牌上方1倍车牌宽度和3倍车牌高度的范围圈定为车标感兴趣区域(如图9所示),用于后续的识别模型训练。

图9 车标感兴趣区域的定位效果示例Fig.9 Examples of vehicle logo region localization

2.2 VLR算法

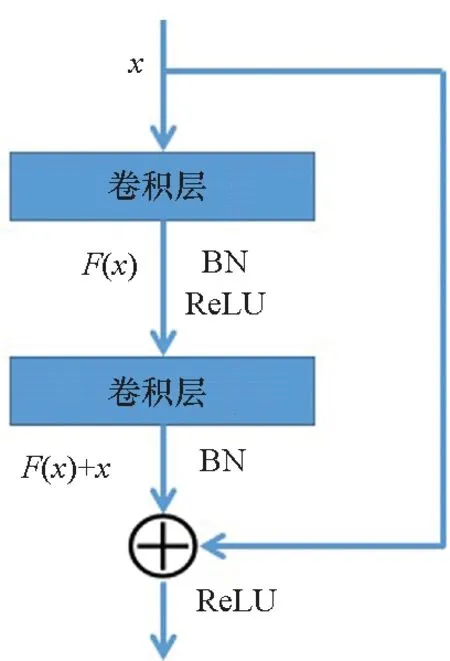

VLR包括深度学习训练和车标识别分类两个步骤,基于深度残差网络[18]得以实现。该网络在前向卷积层外部引入恒等映射越层连接,构成如图10所示的残差单元块,使得网络能直接对残差F(x)=H(x)-x进行学习,而无须再拟合原始映射H(x),从而解决由于层数增加带来的退化问题。

图10 残差单元块Fig.10 Residual block

经过对不同层数ResNet的初步试验,对比发现ResNet-50的预测性能优于ResNet-34和ResNet-101,可能的原因为:50层ResNet比34层网络更深,特征识别力更强;而ResNet-101对于本数据集而言结构又过于复杂,更容易出现过拟合问题。因此,后续实验使用ResNet-50进行车标识别分类。

将车标图像分辨率归一化至224×224×3,送入卷积层,卷积核大小为7×7×64,填充深度为3,步长为2,输出为112×112×64;再进入最大池化层,池化核为3×3,填充深度为0,步长为2,该层输出为56×56×64;接着经过4个卷积块,其中每一块卷积12次,再进入平均池化层,池化核为7×7,填充深度为0,步长为1,输出为1×1×2 048;每个卷积层后连接了批量标准化BN层和修正线性单元ReLU;最后通过全连接层再次卷积,经由Softmax得到车标分类的预测概率。

3 实验结果与分析

3.1 车标识别结果

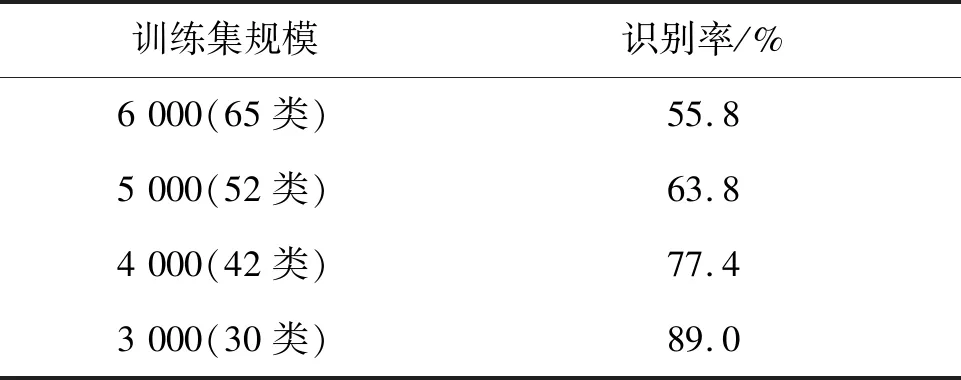

本数据集涉及众多车标,且每一种类的样本量不一。为测试本文车标识别方法的有效性,依次筛选了包含65、52、42、30类车标的6 000、5 000、4 000、3 000幅图像作为训练集,以及包含各自车标种类的1 000个样本作为测试集,分别进行深度学习训练。识别结果如表2所示,鉴于前三个训练集涉及车标种类较多,而部分种类没有充足的数据量,即数据分布不均衡,使得模型训练受限,因此后续实验将在仅含30类车标的3 000幅训练图像上开展,训练后的识别模型则在互不重叠的1 000幅测试图像上得以确立。

表2 不同训练集下的车标识别性能对比Tab.2 Comparison of vehicle logo recognition on different training sets

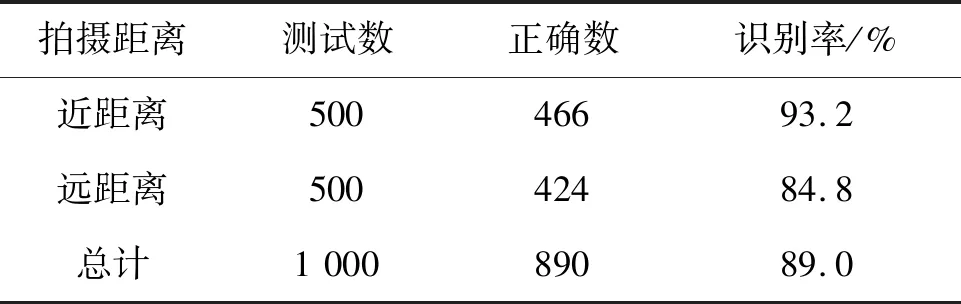

测试集中,近距离和远距离拍摄样本均有500幅,强光、弱光和暗光拍摄样本分别有357、366和277幅。表3和表4展示了成像距离和光照条件对车标识别准确率的影响。对于近距离拍摄的车辆图像,其车标识别率达到了93.2%,远高于远距离拍摄样本,原因在于远距离车辆的主体性不明显,使得车标区域太小且分辨率较低,一定程度上影响了预测结果。对于强光拍摄的车辆图像,其车标识别率为92.4%,随着光照变暗,识别率逐渐降低。尽管如此,本识别算法对自然场景下的车辆图像仍有85%以上的准确率,对距离和亮度变化有着较好的鲁棒性。

表3 不同距离拍摄下的车标识别性能对比Tab.3 Comparison of vehicle logo recognition under different shooting distances

表4 不同光线拍摄下的车标识别性能对比Tab.4 Comparison of vehicle logo recognition under different shooting illuminations

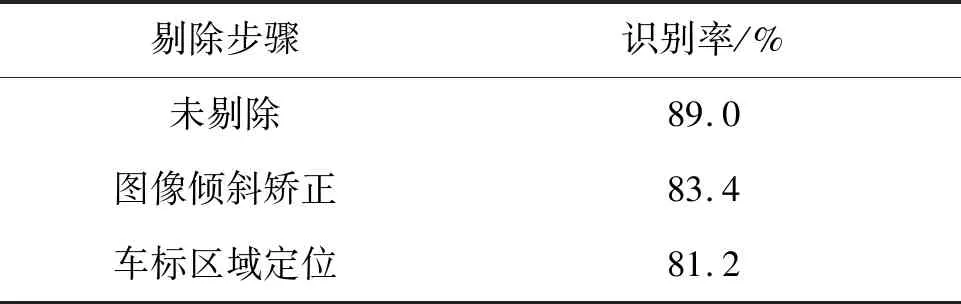

3.2 剔除部分VLD步骤的车标识别结果

若剔除车辆检测步骤,直接对原始图像进行车牌检测及后续处理,研究发现其对近距离拍摄的样本影响不大,对远距离样本(特别是包含多辆汽车时)影响较大,大大降低了车标的辨识效果。若剔除图像倾斜矫正或车标区域定位步骤,而直接进行其他操作,车标识别的总体准确率均呈现不同程度的下降(如表5所示),这也从侧面烘托了VLD算法在车标识别中的有效性。

表5 剔除部分VLD步骤下的车标识别性能对比Tab.5 Comparison of vehicle logo recognition after removing some VLD steps

3.3 车标误识别分析

对车标误识别数据进行统计后发现,当其形状和尺寸相近时,更容易出现被错误分类的情况。这主要体现在奇瑞与英菲尼迪,以及传祺与雷克萨斯这两组车标种类上,如图11所示。对奇瑞的误识别共有7个样本,其中6个被预测为英菲尼迪,而对英菲尼迪的误识别共有5个样本,全被预测为奇瑞;对传祺的误识别中,被预测为雷克萨斯的概率为3/5,反之为3/4。

上述实验结果表明,本文车标识别方法能有效应对复杂多变的自然场景,获得较好的车标识别效果。与其他相关工作相比,本研究覆盖了较多的车标种类和多样的场景分布,保留了一个完整的从目标检测到分类的车标识别全过程,具有更强的实用性。

(a) 奇瑞与英菲尼迪(a) CHERY versus INFINITI

4 结论

本文详细叙述了自然场景车标数据集的创建过程,包括数据获取的环境、条件及各项指标对比。作为其应用成果,提出了一种融合目标检测和深度学习的车标识别方法,实现了对自然场景中的车辆进行车标区域定位和分类预测的全过程。实验结果表明,该方法在处理复杂自然场景且涉及多类车标的识别任务时,仍具有较好的准确度,能够满足实际应用的需要。

在未来的研究中,将从以下几个方面进行展开:继续扩充自然场景车标数据集的规模及多样性,期望提高自然场景车标数据集的科研价值;使用更大规模的数据进行车标识别模型的训练,期望提高自然场景中的车标识别方法的准确率;考察车标种类之间的关联性,针对车标误识别情况,通过设计并调整损失函数的方法,期望减少相关车标种类之间误识别现象的发生。