基于最优子集选择的水稻穗无人机图像分割方法

2020-08-27曹英丽刘亚帝马殿荣许童羽

曹英丽 刘亚帝 马殿荣 李 昂 许童羽

(1.沈阳农业大学信息与电气工程学院, 沈阳 110866;2.沈阳农业大学农业农村部东北水稻生物学与遗传育种重点实验室, 沈阳 110866)

0 引言

水稻产量主要由单位面积稻穗数量、穗粒数和千粒质量3个因素决定,水稻产量的早期预测对育种专家准确评估种质资源,对农业生产者及时调整水肥管理、提高产量等具有重要意义[1]。水稻穗是与产量最直接相关的生理器官,其准确识别与提取不仅有助于产量估测,还对病虫害检测、营养诊断、生育期判断等起到重要作用[1-3]。水稻穗数识别方法主要包括传统人工统计法、基于地面冠层数码影像识别法、基于遥感影像识别法等。传统的水稻穗人工统计方法劳动强度大、耗费时间长、易产生人为误差,难以满足现代化精准农业生产实际需求。基于地面冠层数码影像与计算机视觉、深度学习等技术相结合在水稻穗提取以及作物其他表型信息采集方面取得了长足的进展[4-6]。文献[4]利用长短聚焦镜头双目相机系统,连续采集水稻数码影像,从而实现了水稻穗长度的自动计算,取代了人工测量方式;文献[5]设计了全自动的田间作物表型平台,用于连续、高通量监测作物长势、判断作物的生育期;文献[6]利用地面冠层数码影像数据,提出了一种麦穗计数算法,实现了大田环境下小麦穗密度的估算。

基于地面作物表型信息系统的稻穗识别仍不能满足高通量、快速、大面积田间信息采集的需要,农业遥感技术的不断发展为大面积田间作物信息获取提供了新途径。无人机低空遥感具有灵活性高、影像获取时间短、成本低、地面分辨率高等优点[1,7],在作物覆盖度提取、氮素含量反演、产量估计、株高生物量估测等方面得到了广泛应用[8-17],从图像中准确地分割出水稻穗是基于无人机数码影像的产量估测、病虫害分析、精准施肥等信息化管理的关键。常用的图像分割方法有阈值分割法、人工神经网络、卷积神经网络等[18-23]。文献[18]利用ExG指数法和最大似然监督分类法对无人机数码影像进行处理,提出利用颜色转换空间HSI(H-A 法)从无人机数码影像中快速提取马铃薯覆盖信息;文献[19]基于棉花无人机可见光遥感影像,分析了Lab 颜色空间a通道、RGB颜色空间2G-R-B指数和HIS颜色空间H通道对棉花的识别能力,研究了苗期和蕾期覆盖度的提取方法;文献[20]运用基于逻辑回归算法的自适应阈值分割方法,提取棉田冠层区域,基于棉田冠层图像在HSV颜色空间中分别提取叶片冠层和地表背景两类像素的H通道值,在RGB颜色空间中提取绿色占比值G/(G+R+B)作为颜色特征,利用逻辑回归算法确定各颜色特征的分割阈值,实现数码图像的初次分割,并采用形态学滤波方法对分割结果进行优化;文献[21]利用深度学习方法实现数码影像的分割,解决了作物表型信息提取的问题;文献[22]利用人工神经网络(ANN)设计了图像分割和稻穗识别算法,可实现齐穗期水稻穗数量的自动识别;文献[23]基于卷积神经网络(CNN)设计了一种图像分割算法panicle-SEG,实现了水稻穗超像素分割;文献[1]为了提高田间水稻穗的检测精度,利用改进的区域全卷积神经网络设计了一种水稻穗计数系统,并应用无人机搭载RGB数码相机获取水稻数码影像,进行了现场测试与分析。

以上研究在利用无人机数码影像实现水稻穗分割与提取方面开展了大量工作,在东北粳稻无人机数码影像的数据积累与样本库构建、颜色空间各个通道或指数对水稻穗识别能力的分析、水稻穗提取算法的定量评估等方面仍需要继续开展相关研究。本文以东北粳稻为研究对象,采集和积累水稻冠层数码影像,寻求有效、稳定的图像分割特征与模型,实现复杂田间条件下水稻穗的快速提取,以期为未来智慧农业水稻产量估测、病虫害分析等提供支撑。

1 材料与方法

1.1 试验材料与数据采集

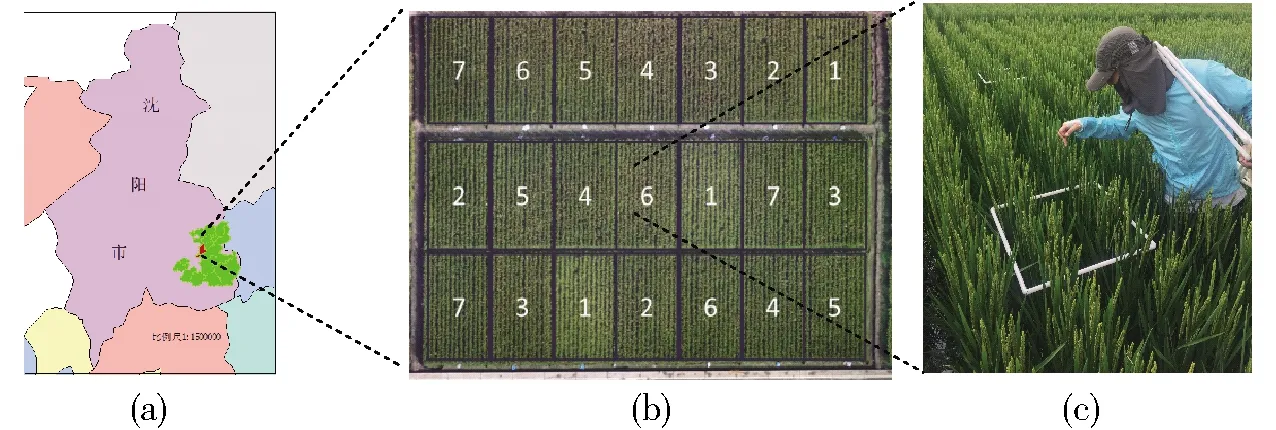

水稻无人机数码影像拍摄与稻穗提取试验于2017年和2018年在辽宁省沈阳市沈阳农业大学超级稻成果转化基地(123°55′85″E,41°81′63″N)进行。该基地位于东北地区南部(图1a),属于温带半湿润大陆性气候,年平均气温6.2~9.7℃,年降水量600~800 mm。试验时期内小区设计一致,均采用裂区试验设计,选取当地主栽水稻品种沈农9816,设置7个施氮水平:无氮处理(0 kg/hm2)、低氮处理(150 kg/hm2)、中氮处理(240 kg/hm2)、高氮处理(330 kg/hm2)、有机肥替代10%、有机肥替代20%、有机肥替代30%,试验重复3次,共21个小区随机排列(不同施氮水平小区如图1b所示),小区面积为30 m2(4.2 m×7.61 m),不同施肥处理小区间采用土埂隔离。

图1 水稻试验田位置及小区分布图Fig.1 Fields location and plots distribution of experiment

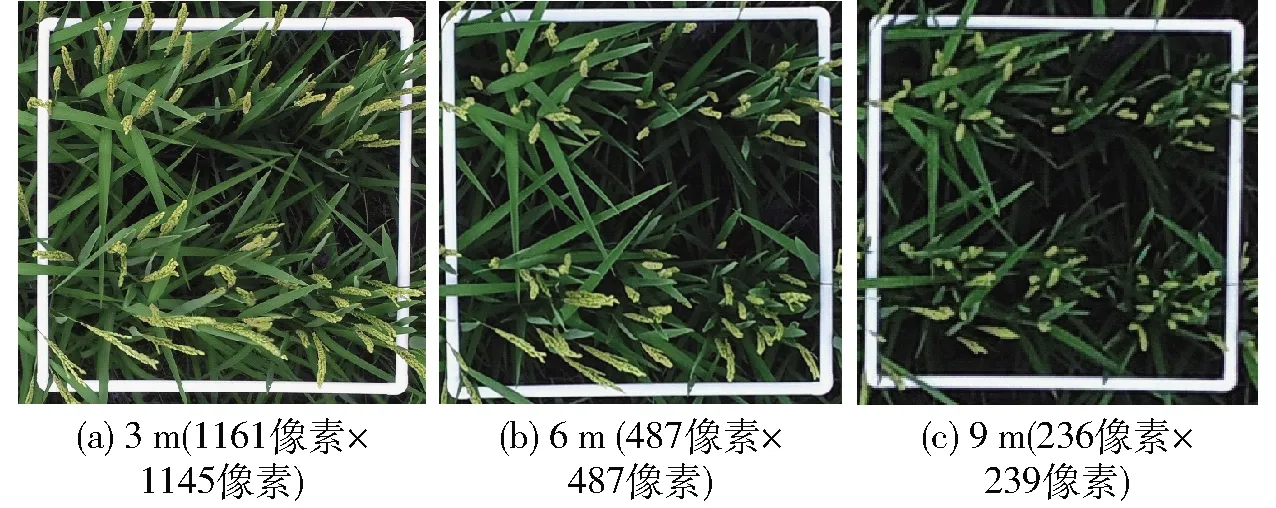

无人机数码影像采集与地面测试分别于2017年8月21日和2018年9月2日水稻齐穗期进行(依据文献[24]试验结果,基于齐穗期水稻冠层数码影像的产量估测精度最高)。在21个小区的边角区域和中心区域分别布设2个面积为0.5 m×0.5 m的白色样方(图1c),应用四旋翼无人机搭载高清数码相机(PHANTOM 4型,1 240万像素,图像分辨率为4 000像素×3 000像素),采集白色样方内水稻冠层正射数码影像,拍摄时间为10:00—14:00,天气晴朗、无云。无人机分别从2、3、6、9 m飞行高度进行拍摄,由于2 m飞行高度无人机旋翼风场影响拍摄,误差过大,舍弃该飞行高度拍摄数据。试验共获取3个飞行高度的21×2×3=126幅RGB数码影像,2年累计252幅影像。地面测试同步开展:人工数出42个样方内水稻穗的数量。获取同一个样方3、6、9 m 3个飞行高度的正射数码影像如图2所示。

图2 同样方3、6、9 m飞行高度数码影像Fig.2 Digital images of one sampling region at altitudes of 3 m, 6 m and 9 m

图4 水稻穗、叶、背景的部分训练样本Fig.4 Partial training samples of rice panicle, leaf and background

1.2 研究方法与验证

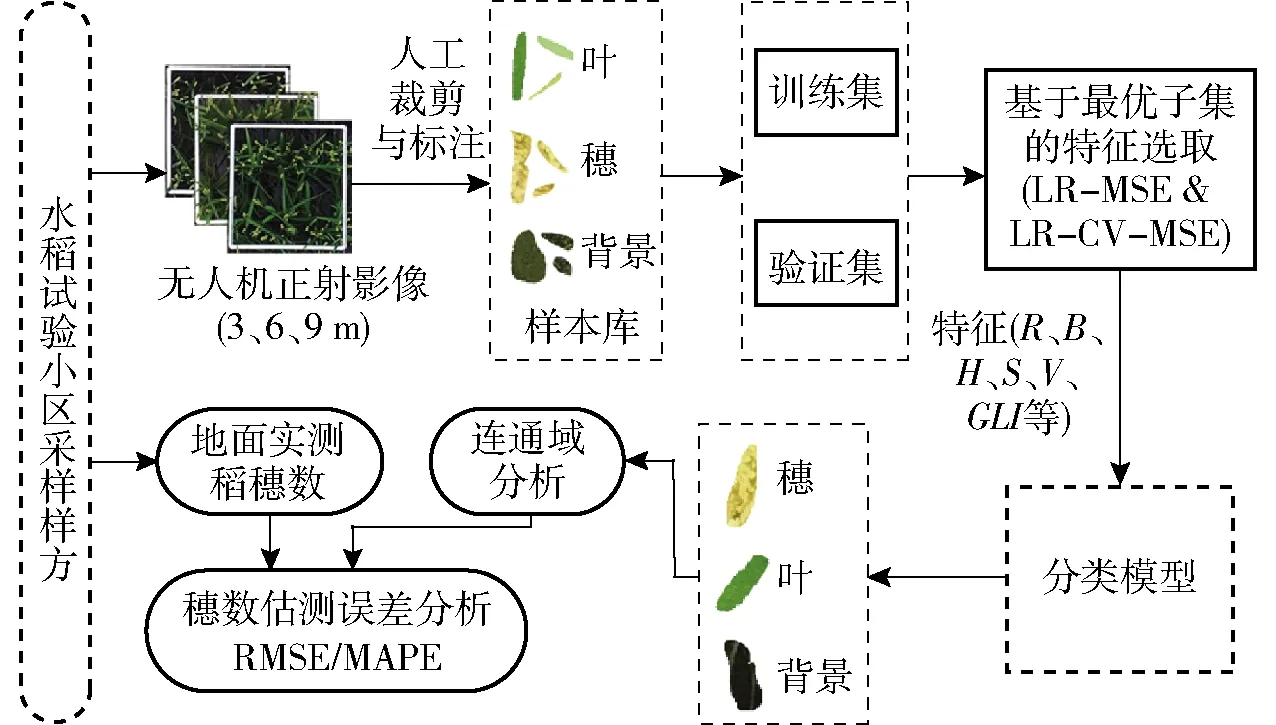

本文主要技术流程如图3所示。

图3 水稻稻穗分割特征选取与模型构建技术流程图Fig.3 Feature selection and model construction for panicle segmentation

(1)将不同飞行高度拍摄的水稻小区样方正射数码影像进行人工裁剪与标定,构建了水稻穗、叶、背景3类图像样本库,计算不同颜色空间各个通道或指数R、B、H、S、V、GLI等,并将其分为训练集和验证集。

(2)应用最优子集选择算法探索不同颜色空间各个通道对水稻穗识别的能力,提取有效的稻穗分割特征,作为稻穗分类模型的输入。

(3)为定量测试无人机不同飞行高度影像水稻穗分割精度,分别采取图像像素分类精度和稻穗数量估测误差评估:①图像像素分割精度:基于线性回归构建水稻穗、叶及背景的分类模型,采用5折交叉验证算法评估模型精度。②对水稻穗图像像素分割结果进行连通域分析,获取水稻穗数量估测值,并与地面实测数据对比分析,用均方根误差(RMSE)和平均绝对百分误差(MAPE)评价和判断3个飞行高度拍摄的图像水稻穗分割精度。

1.3 基于颜色空间的图像特征提取

2017—2018年累计获取水稻试验小区样方正射RGB数码影像252幅,采用人工标注的方法,在每幅图像上随机选取水稻穗、叶及背景区域,标识出水稻穗、叶及背景3类图像各300幅,构建了由水稻穗、水稻叶和背景组成的3分类图像库,用于水稻穗提取模型的训练,部分水稻穗、水稻叶和背景标注样本示意图如图4所示。

RGB、HSV等颜色空间的单通道及其组合指数常被用来作为图像不同对象分割的特征参数[25-26],其中包括RGB颜色空间的R、G、B通道和HSV投影空间的H、S、V通道,以及归一化绿红差异指数(NGRDI)、红绿比值指数(RGRI)、绿叶指数(GLI)和过绿指数(ExG)等,计算公式分别为

NGRDI=(G-R)/(G+R)

(1)

RGRI=R/G

(2)

GLI=(2G-R-B)/(2G+R+B)

(3)

ExG=2g-r-b

(4)

其中

r=R/(R+G+B)g=G/(R+G+B)b=B/(R+G+B)

式中R、G、B——红色波段、绿色波段和蓝色波段像素值

r、g、b——R、G、B标准化值

NGRDI——归一化绿红差异指数

RGRI——红绿比值指数

GLI——绿叶指数ExG——过绿指数

应用Matlab对标定的水稻穗、叶、背景3类图像样本进行处理,计算每一类对象像素级的R、G、B、H、S、V、NGRDI、RGRI、GLI和ExG等10个参数值,作为备选的对象识别特征参数,待后续应用最优子集选择算法对特征进行优选,从而简化水稻穗识别模型。从每类对象样本库中取出相同个数的像素级样本,分别用y=0、y=1和y=2表示水稻穗、叶、背景3类对象的回归值,将特征参数值矩阵X与回归值向量Y归一化到0~1范围(即水稻穗、叶、背景3类y分别为0、0.5和1)。

1.4 基于最优子集选择算法的特征选择

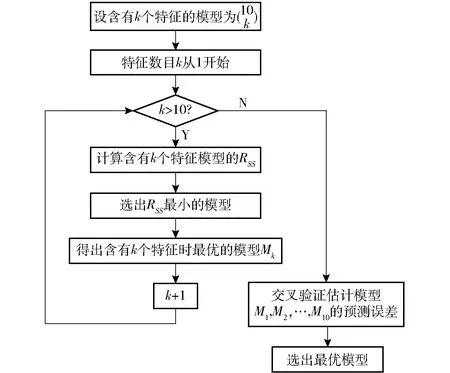

最优子集选择(Best subset selection)算法对特征参数矩阵X中的p个特征变量的所有可能组合分别使用最小二乘法拟合多元线性回归模型,从所有可能模型(2p)中选择一个最优模型,即优选出与响应变量Y最相关的特征子集,本研究待分析特征为10个,特征数较少,最优子集算法计算效率可以满足需求。利用最优子集选择算法选择分类模型,对10个分类特征参数R、G、B、H、S、V、NGRDI、RGRI、GLI、ExG进行优化选择,剔除模型中不相关的特征从而简化分类模型,产生的所有组合共有2p=1 024种,最优子集选择算法流程如图5所示。

图5 最优子集选择算法流程图Fig.5 Flow chart of best subset selection

(2)对于包含k个特征的初选模型M1,M2,…,M10应用交叉验证(Cross-validation)的方法进一步进行特征优选:将样本数据集(包括10特征的测试值及其对应的分类值)分成5组,以其中4组数据为训练集进行最小二乘法的线性回归,用第5组数据作为测试集,计算模型的测试误差;选取5种组合情况下获取的平均测试误差最小作为最优模型。

线性回归基本模型可表示为

(5)

其中,X代表10个分类特征参数:R、G、B、H、S、V、NGRDI、RGRI、GLI和ExG,Y代表3个分类对象(水稻穗、水稻叶和背景,归一化后分别为0、0.5和1);β0,β1,…,β10为线性回归模型的回归系数,其最小二乘法估计值为

(6)

其中

Xbig=[1X]

2 结果与分析

2.1 稻穗分割特征提取

应用2017—2018年的试验数据与构建的水稻穗、水稻叶和背景组成的3分类图像库,基于最优子集选择算法对3、6、9 m 3个无人机飞行高度拍摄的数码影像进行水稻穗分割的特征优化选择:

(1)为降低算法复杂度,评价遍历特征数为k的水稻穗分割特征时,采用最小二乘的线性回归模型,直接选取测试误差最小的为最优模型,选取水稻穗分割特征数为k时(k=1,2,…,10)对应最优模型Mk与精度。

(2)在上述结果基础上,以筛选的10个过程最优模型Mk为对象,进一步采用5折交叉验证(5-fold cross-validation)的方法从模型M1,M2,…,M10中选取最优分类模型,选取的特征及对应误差列于表1(以3 m为例)。从表中特征数变化与分类测试误差关系可知,当特征数p=7时的模型交叉验证误差随特征数量变化最小,对应的误差(MSE)为0.036 3,因此选取该模型特征参数R、B、H、S、V、GLI和ExG作为水稻穗图像分割的特征。6 m飞行高度最优特征参数为G、B、H、S、V、RGRI、GLI,对应稻穗分类误差为0.038 2;6 m飞行高度最优特征参数为R、G、B、H、S、V、RGRI,对应稻穗分类误差为0.046 9。不同飞行高度稻穗分类精度MSE随着各自的特征数变化如图6所示,由图可以看出,随着特征数的增加,稻穗分类精度有所提高,误差MSE减小,当特征数到7时,变化趋于平缓,因此兼顾模型复杂度和精度,特征数为7时模型效果最佳;对比不同飞行高度获取数据可知,飞行高度为9 m时稻穗分类误差最大,3 m时误差最小,6 m时比3 m略大,选取7个特征时3个高度的分类模型误差分别为0.036 3、0.038 2和0.046 9,因此在生产中利用无人机遥感影像识别稻穗时建议飞行高度为3~4 m,分类模型特征参数选取R、B、H、S、V、GLI和ExG。

表1 最优子集特征选择过程结果与误差Tab.1 Results of selected features and error by best subset selection

2.2 稻穗分割结果

对于不同飞行高度测试的无人机数码图片,以对应的最优子集特征选择算法优选出的7个稻穗分割特征为输入,构建的水稻穗、叶、背景分类效果如图7所示。从图中可以直观看出3、6 m的分割效果较好,尤其是水稻穗的分割,基本识别出全部稻穗;但是9 m水稻穗分割效果较差,对应的叶片分割效果更差。

图7 3个飞行高度的水稻图像分割结果Fig.7 Segmentation results for images at altitudes of 3 m, 6 m and 9 m

2.3 稻穗数量识别结果分析

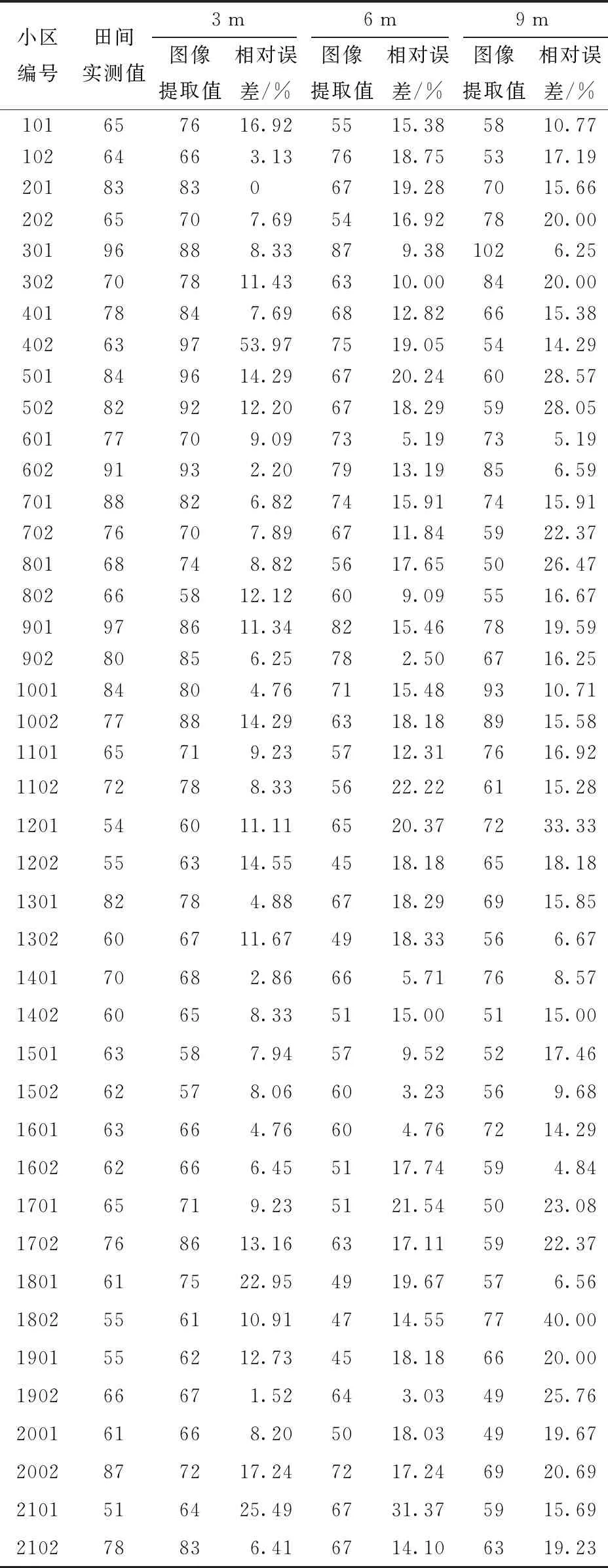

为了进一步定量比较无人机数码影像稻穗分割的准确度,通过连通域分析的方法将水稻穗像素转化为水稻穗数量,与同步实测的21小区42个样方内水稻穗数量进行比较,具体方法为对分割出的水稻穗图像进行二值化处理,利用8连通区域的方法计算图像中连通区域的个数,同时计算连通域的面积,设定临界值来去除一些细小的孤立点,大于临界值的连通域个数即为水稻穗数量,各个小区样方2017年和2018年数据平均计算结果如表2所示。

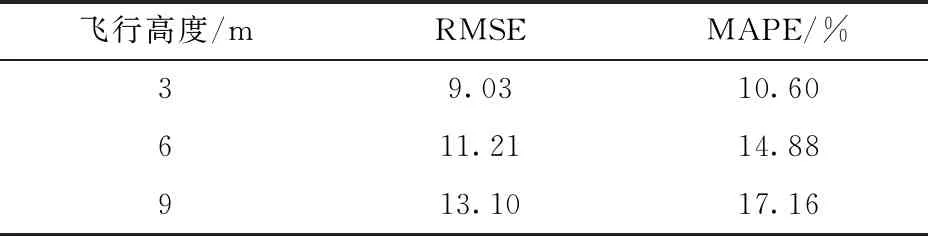

计算出水稻穗数量实测值与提取值的均方根误差(RMSE)和平均绝对百分误差(MAPE),综合2017—2018年重复试验,3个无人机飞行高度数码影像水稻穗识别精度如表3所示。

由表3可知,3 m高度图像水稻穗提取效果较好,实测值与提取值的RMSE、MAPE最小(分别为9.03和10.60%),均小于6、9 m高度,表明3 m高度图像水稻穗识别精度高于6、9 m高度。

表2 不同飞行高度数码影像的水稻穗数量识别结果Tab.2 Panicle number recognizing results for images at altitudes of 3 m, 6 m and 9 m

表3 不同高度影像水稻穗识别精度Tab.3 Accuracy of panicle number recognizing for images at altitudes of 3 m, 6 m and 9 m

3 结论

(1)利用2年不同施氮水平的水稻小区无人机低空遥感数码影像数据,构建了水稻穗、叶、背景样本库,探索了东北粳稻冠层RGB和HSV颜色空间各个通道或指数对水稻穗的识别能力,应用最优子集选择算法提取了适合东北粳稻稻穗图像分割的特征,为建立稻穗分割模型提供输入特征参数。

(2)采集和扩增东北粳稻齐穗期冠层数码影像样本库,逐步剔除光照、风速等环境变化所引起的噪声干扰,提升水稻穗分割模型的提取精度;为定量检测稻穗分割模型精度,利用稻穗像素人工标注数据及样方内稻穗数量地面实测调查数据进行检验。

(3)以RGB和HSV颜色空间各个通道或指数为特征的水稻穗分割结果差异较大,应用最优子集选择算法优选的R、B、H、S、V、GLI和ExG7个特征参数组合,对水稻穗识别能力最强,适合东北粳稻水稻穗分割。

(4)以优选的7个特征参数为输入,构建稻穗分割模型,可有效实现无人机不同拍摄高度获取的水稻冠层数码图像的分割,在3、6、9 m飞行高度下,数码影像稻穗像素分割对应误差MSE分别为0.036 3、0.038 2和0.046 9,飞行高度3 m时分割效果最佳。

(5)所提出的最优子集选择与多元线性回归相结合的方法可准确实现水稻穗数量的提取,在3、6、9 m飞行高度下平均提取误差RMSE分别为9.03、11.21、13.10。