基于教师表情的教学情境理解

2019-01-18陈良波许维胜

陈良波, 许维胜

(1.同济大学 电子与信息工程学院,上海 201804; 2.同济大学 信息化办公室,上海 200092)

2015年“互联网+教育”被写进政府工作报告[1],随后智慧教育、智慧校园、智慧教室等研究热潮持续上升。目前,对智慧教室的研究多关注智慧教室的概念界定、技术空间设计、配备标准、互动方式、教学模式等层面[2],而对于如何利用人工智能技术对教学情境进行理解以促进教学向智能化迈进的研究至今鲜见报道。

国内高校对教师的教学评价主要有以下3种方式:教学督导定期听课抽查、学生网上评教、通过学生期末成绩进行考核。前两种方式容易受到主观因素的影响,使结果真实性降低;后一种方式只注重过程,是一种结果性评价,但忽略了教学过程的重要性。

在人工智能高速发展的今天,研究如何使用人工智能技术来促进教育智能化发展显得意义非凡。

本文将深度学习算法应用到智慧教室中,数据化呈现教师表情状况,为教学考核提供数据支持,而且可以用于分析学生对教学内容的感兴趣程度,是深度学习的应用扩展和创新。

1 研究依据和基础

全国许多高校都在致力于建设智慧教室,同济大学部分教室已配备具有跟随录播功能的高清摄像头,对教室教学过程进行跟随拍摄,获得1 920×1 080分辨率的教学视频,为本文研究提供数据支持。心理学研究表明:人的情感有55%通过面部表情展现,38%通过语言表达方式呈现,而言语本身仅传达8%的信息量[3]。该研究成果为本文研究提供了理论依据。

对视频中教师表情进行分析,根据表情结果推断教师在上课过程中的情绪状况、课堂氛围、教学情绪积极程度等数据化指标,并结合教学视频人为评价和学生课堂情况满意度调查,可以检验教学情境理解的结论与实际情况的相符合程度。

人脸检测算法大致分为以下2类:一类是通过模式设计进行特征提取,并采用AdaBoost算法将弱分类器训练为强分类器以实现人脸检测;另一类是使用端到端的深度学习模型。综合考量了当前主流算法在人脸检测精确度、召回率和速度方面的性能,本文选择MTCNN[4](multi-task convolutional neural network)作为人脸检测算法。

表情识别是一个图像分类任务,对该任务的研究也可以分为以下2类:一类是设计模式、提取特征、选择特征、确定分类器来完成分类的传统方式;另一类是使用深度学习模型。考虑到深度学习模型在图像分类任务上的优良表现,比较了各大主流图像分类深度神经网络模型的性能、结构和参数量,本文选择Xception[5]模型完成表情识别。人脸检测技术和表情识别构成了本文研究的技术基础。

2 核心技术

2.1 人脸检测

人脸检测使用多任务级联神经网络MTCNN,其结构如图1所示。首先,通过P-Net模型生成初步人脸候选框和边界回归向量,并使用非极大值抑制去除重复的候选框;然后,使用R-Net模型改善候选框;最后,采用O-Net模型输出人脸、人脸位置和5个特征点的位置坐标。使用FDDB标准数据集和WIDER FACE数据集进行测试,MTCNN性能和速度都具有优越性。在实际教室中,采用教室监控获得的教室图片进行测试,测试所得ROC曲线(受试者工作特征曲线)如图2所示。由图2可知,平均真阳性率为93.6%,性能满足本文研究的需求。

通过测试得到以下检测结果:①MTCNN对人脸检测效果非常可靠,检测到的人脸图片直接预处理后输入后续表情识别模型;②由于MTCNN的召回率和精确度都很高,因此部分人脸图片存在角度偏转较大、遮挡等情况,在表情识别之前需要对这些情况进行判断清理后,方可将检测到的人脸图片输入表情识别模型。

图1 MTCNN结构Fig.1 Structure of MTCNN

图2 人脸检测ROC曲线Fig.2 ROC curve of face detection

2.2 表情识别

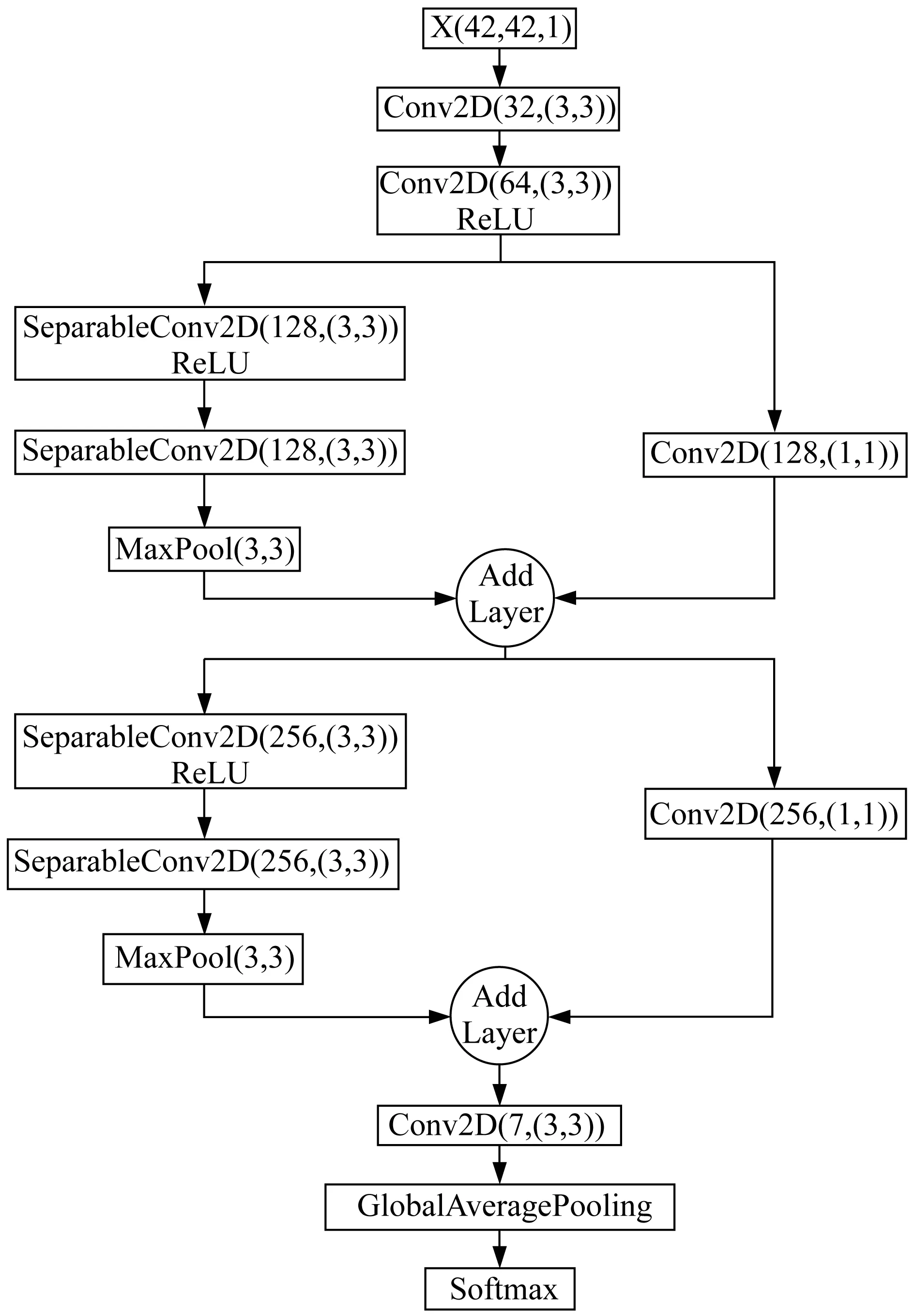

采用常用的7类表情划分方法,将表情分为生气、厌恶、恐惧、高兴、忧伤、惊奇、中性。本文采用FER2013数据集训练模型,数据集采集自非限制条件,相对于标准姿态数据集有更好的鲁棒性和通用性。使用Xception模型实现表情分类,Xception模型的结构如图3所示。

参考Zhang等[4]的工作,使用42×42的灰度图作为输入。Conv2D(32,(3,3))指用32个3×3的卷积核进行普通卷积操作,ReLU则表示对卷积结果使用ReLU激活函数进行非线性处理;MaxPool表示最大值采样,采样核为3×3;SeparableConv2D表示深度可分离卷积操作;在Conv2D和SeparableConv2D之后进行批规范化处理;Add Layer表示融合层,采用相加融合;GlobalAveragePooling表示全局均值池化;Softmax表示采用Softmax作为激活函数。

图3 Xception模型结构Fig.3 Structure of Xception model

(1)训练数据准备

FER2013数据集分为训练集、验证集和测试集3个部分,各部分的数据量是28 709、3 584、3 584,将训练集和验证集2个部分合并为训练集。对训练集进行扩展,分别做20°内小角度随机旋转3次,水平镜像变换、亮度随机调整、对比度随机调整、剪切变换各1次,再将原始48像素表情图片随机缩放为42到56像素并随机裁剪其中42×42部分作为训练数据重复2次,最后扩展得到训练集图片共计355 278张,大小为42×42,拆分其中的10%作为模型训练过程中的验证集。

(2)模型训练

使用小批量数据集训练,batch size设置为64。

使用Adam优化算法和交叉熵损失函数,学习率为0.001。

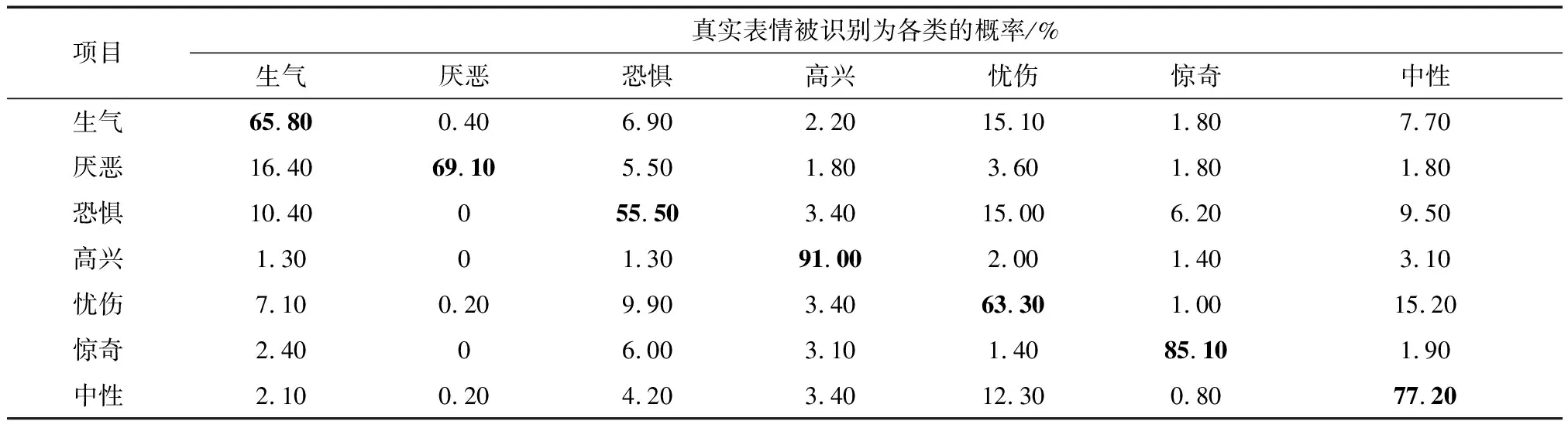

采用Early Stop机制。验证集上的准确率10个epoch后没提升,学习率变为0.1倍,50个epoch后验证集上的准确率不再提升或者损失函数值不再降低,训练结束。训练到258个epoch后模型收敛,独立训练4个模型以建立投票机制,得到最后的表情识别结果,如表1所示。

表1 FER2013测试集混淆矩阵Tab.1 Obfuscation matrix of FER2013 test set

表1中数值表示真实表情被识别为各类的概率,对角线上黑体数值表示各类表情被正确识别的概率。从表1可以得到:平均正确率为74.31%,比当前最好的研究成果Sang等[6]的71.19%提升了3.12%;“高兴”表情识别效果最好为91.00%,教学情境理解由“高兴”表情得出的结果可靠性高;“惊奇”、“中性”、“厌恶”等3类表情识别效果非常好地满足研究需求;“生气”和“忧伤”表情表达的情绪都是消极情绪,对表情分析的结果没有影响。Xception单独模型参数量只有20.6×103个,4个模型的投票机制参数量也仅有82.4×103个,Sang等[6]的最优模型参数量4.19×106个,为本文模型参数量的50.8倍,因此本文所使用模型在计算上更具优势。

本文中:“高兴”、“中性”和“惊奇”表情的识别正确率满足研究需求;“生气”和“忧伤”为相近表情,传递的情绪特征都为消极情绪,对表情分析的结果没有影响;“厌恶”和“恐惧”在教室中出现的概率非常小,对表情分析的影响可以忽略。

在实际教室环境中对师生表情识别情况测试的结果表明:“生气”和“忧伤”表情更接近“中性”表情。

3 教学情境理解与验证

3.1 表情分析与情境理解

智慧教室中的教学情境理解通过表情分析实现,表情分析的对象是教师。对教学视频以一定采样间隔进行分析,计算教师每一类表情总数在所有表情总数中的比例。图4展示了一个教师各类表情情况,图5展示了3个教师“高兴”表情对比情况。

图4 一个教师各类表情情况Fig.4 Emotion expression of one teacher

图5 3个教师的“高兴”表情情况Fig.5 Happy expression of three teachers

从图4可以看出:①不同表情所占的比例不同,而且各类表情比例存在明显差别,“恐惧”、“厌恶”和“惊奇”等3类表情所占比例非常少,与实际情况相符;②受算法对“生气”和“忧伤”2类表情识别效果的影响,“生气”和“忧伤”表情比例偏高,实际情况更接近“中性”;③“高兴”表情检测正确率、可靠性都非常高,可以反映教师在上课过程中上课情绪的积极程度、情感投入度、课堂气氛活跃情况。

从图5可以看出:①不同教师在授课过程中“高兴”表情的比例不同;②部分教师进入课堂后“高兴”表情比例会发生显著变化。

由教师的表情分析结果理解以下教学情境:

(1)各类表情的比例分布情况展现的是教师的上课风格。“高兴”表情比例高,课堂氛围活跃度高。“中性”表情比例是一种基准,用来衡量一个教师的情感基调,是一个参考指标。

(2)“高兴”表情的识别效果最好,结果最可靠。同一个教师“高兴”表情的变化情况反映的是课堂上情绪活跃度的变化情况。“高兴”表情比例降低,教师情感向着呆板、深沉方向转变,相应地引导课堂氛围活跃度降低;“高兴”表情比例变高,教师情绪向着激昂方向转变,相应地引导课堂氛围活跃度提升。

(3)上课后“高兴”表情的变化趋势反映的是从课堂开始到逐步进入上课教学过程中教师情感积极程度的变化。“高兴”表情比例变化平缓或者趋于稳定则教师上课情绪平稳,波动不大;“高兴”表情比例显著升高则教师上课积极情绪提升,活跃度提高,由平稳变得更有激情。

3.2 教学情境验证

为了验证模型对教学过程中表情分析得出的教学情境与实际情况是否相符,采取人为观察教学过程中教师的表情状况,对教学视频进行主观评价,以验证模型可靠性。

邀请了同济大学大数据与网络安全实验室的1名教师、4名同学(2男2女)观看教学视频,给教学过程独立评分,分为以下3种情况:①教师情感积极程度,0~5;②教师积极情感变化情况,-1、0、1;③课堂氛围活跃状况,0~5。图5中3名教师相应的平均得分情况如表2所示。

表2 教师主观评价得分情况Tab.2 Teacher’s subjective evaluation score

从表2可以看出,在情感积极程度上由高到低是教师1 > 教师3 > 教师2,3个指标得出的结论与图5所展示的结果相一致。通过主观验证,主观结果与表情分析得出的教学情境相符合,证明了通过表情分析对教学情境理解的可靠性和科学性。

4 分析与总结

从智慧教室现有的教学条件出发,以同济大学教室内安装的跟随录播摄像头拍摄的视频为数据源,以现阶段深度学习算法为手段,以教师表情为研究对象,通过课堂上教师的表情分析实现了对教学情境中教师情感积极程度、课堂氛围等教学情境的理解,不仅可以为教学考核提供参考,还能够用于分析学生对教学内容的感兴趣程度。

本文研究是对深度学习算法应用领域的扩展,更是当下为智慧教室研究提供的一种新视角,有助于推动深度学习算法在智慧教育中的应用,促进教育智慧化。然而,教室内得到的视频存在模糊、太远等情况,表情识别模型在实际应用中还需要改进和优化。在以后的工作中可以从改善教学中数据采集条件、提升表情识别算法和增加教室内其他特征如教师的肢体语言等方面进行完善,以更高性能的算法提升情境理解与实际状况的符合程度,以多维视角对教学情境进行全面理解。