空时上下文模型下基于多种特征融合的监控目标跟踪

2018-07-04

(华南理工大学 土木与交通学院,广州 510640)

0 引言

伴随着信号处理技术和数字技术的成熟,视频监控系统在数字化、网络化、智能化和集成化方向飞速发展,整个视频监控行业已经快速进入了智能监控的时代。智能视频监控中的目标检测与跟踪技术是当今前沿的研究课题,有着重要的实际应用价值和研究意义。目标检测和跟踪作为智能视频监控的核心技术,其性能好坏直接影响着目标识别与理解的准确性[1]。

目前对于智能视频监控系统没有一个统一的定义,一般为人们所理解的是指利用计算机视觉技术对视频信号进行处理、分析和理解,在不需要人为干预的情况下,通过对序列图像自动分析,对监控场景中的变化进行定位、识别和跟踪,并在此基础上分析和判断目标的行为,能在异常情况发生时及时发出警报或提供有用信息,有效地协助安全人员处理危机的系统。因此目标跟踪使整个系统的核心步骤,其性能好坏直接影像后续的分析处理。

尽管目标跟踪领域提出大量的算法提升跟踪性能,然而监控环境的复杂性以及待跟踪目标的多样性,使得目标跟踪仍然是一个具有挑战性的研究课题。现有的目标跟踪算法大致上可分为三类:基于生成模型的目标跟踪[2]、基于判别模型的目标跟踪[3],以及基于二者混合模型的目标跟踪[4],其中基于生成模型的跟踪算法利用相似匹配的原则,通过在图像中搜索出与保存的模板最相似的区域来鉴别目标,但生成模型只是利用目标模板特征搜寻与模板最相似的区域,并没有考虑目标的背景信息[5-6]。目前多目标检测跟踪领域,大多数算法都集中在在线学习方向[7],并提出许多优秀的跟踪算法[8-9]。由于目标形态千差万别,背景信息复杂多变,无法囊括所有的样本进行训练,因此正负样本欠采样是阻碍跟踪性能的主要因素[10-12]。尽管近年来图像跟踪领域提出了许多卓有成效的跟踪算法,大大地改善了跟踪的视觉效果与性能,然而目标跟踪在实际应用中仍然在较多的挑战性问题[13]。

为了实现监控领域复杂背景条件下对目标稳定跟踪,本文以空时上下文跟踪模型为基础框架,利用多特征的互补特性,提出了一种鲁棒有效的基于多特征融合的自适应模型更新的空时上下文目标跟踪算法,该算法不仅具有空时上下文目标算法跟踪的实时性,还具有鲁棒的跟踪能力,能够在复杂背景条件下对目标稳定跟踪。实验结果表明,本文提出的算法的跟踪性能优于现有的KCF, MFC和STC跟踪算法。

1 基于时空上下文的目标跟踪算法

在时空上下文目标跟踪(STC)算法中,跟踪问题被描述为估计目标位置似然的置信图m(x)的过程,即:m(x)=p(x|o),其中x是疑似目标位置,o是目标信息。为了便于描述,假设目标位置为x*,因此上下文特征集合Xc={c(z)=(I(z),z)|z∈Ωc(x*)},其中,I(z)表示图像中z点的特征;Ωc(x*)则表示目标中心x*附近区域。

STC算法充分利用目标局部上下文区域信息建立时空上下文模型计算置信图,将置信图中概率最大的位置作为目标位置。大量定性定量仿真实验表明STC算法能够很好地解决微弱形变、目标旋转等常见的跟踪问题,但是在目标运动过程中,如果目标被遮挡,或对比度差异较大,那么目标及局部背景区域灰度会发生波动,获得的置信图不准确,导致目标漂移甚至跟踪失败。

2 基于多特征融合的自适应模型更新的目标跟踪算法

STC算法的关键核心是通过目标周围的上下文区域,通过寻找置信图的最大置信度来预测跟踪目标在下一帧的位置。整体框架是在贝叶斯框架下进行了,利用贝叶斯概率,计算时空上下文信息的置信度,最大置信度的位置即为目标位置。通过STC置信度方程可以看出,目标特征条件下的上下文先验概率是该算法模型的关键。因此,本文将从多特征出发,通过相关学习对本文提出的算法进行改进。

由于相关模型设计问题是代价函数中损失项与正则项之间的折中。因此,对所有训练样本X和期望输出Y通过求解以下线性回归的目标函数:

(1)

其中:λ是其正则参数防止过拟合;f为分类函数,用以调节分类器的泛化性能;xi和yi分别表示第i个训练样本和期望输出。考虑线性回归的目标函数的最小化输出均方和误差来获得初始的滤波器H,该最优优化Hopt可以表示如下:

(2)

通过对等式(2)最优求导,可以得到Hopt的解析解,其表达式如下:

(3)

可以看出,本文在空时上下文模型基础上引入了一个时空多特征滤波模型。在不同的假设条件下,本文提出的模型可以等效成不同的算法。一般情况下,常见的相关滤波最小化如下代价函数:

(4)

(5)

可以看出,等式(4)的代价函数的最小化为:

(6)

(7)

众所周知,特征提取是目标检测与识别的基础,鲁棒的特征可以提升应用的能力。图像特征可以包括区域特征、颜色特征、纹理特征、形状特征、低秩特征以及局部特征点等,然而单一特征表征能力不足,本算法主要利用多特征的互补特性辅助解决单一特征无法完全表征目标的所有形态的问题。最终利用等式(6)获得的最大值为最终跟踪结果。

3 基于峰值旁瓣比的自适应模型更新

由于监控领域目标跟踪过程中目标及背景是动态变化的,跟踪算法要对目标表观模型进行实时更新。现有的模型参数的更新都是通过线性插值,利用学习因子调节模型的泛化能力。通常情况下,学习因子的选取需要根据经验设置,然而固定学习因子的方式比较机械,不能完全适应复杂背景与显著的外观变化。本文将在传统更新模型的基础上提出基于峰值旁瓣比的自适应模型更新策略,在常规更新模型中引入自适应权值因子,其模型如下:

(8)

(9)

mt表征目标跟踪质量情况,p、μ和σ分别表示以峰值为中心的窗口11×11内像素的峰值、均值与方差;x∈[x1,x2],α∈[α1,α2],i和ρ分别表示帧数和学习因子。如果权值较大,表明跟踪过程出现波动,必须增大学习因子,适应目标快速的形态变化,增强模型泛化能力。

4 实验与结果分析

为了验证本文提出的目标跟踪算法,采用标准数据集与外场采集真实视频结合的具有各种挑战性的多段视频作为测试用例,其中序列囊括了遮挡,尺度变化,低对比度,目标旋转变形和运动模糊等各种现象。由于本章主要验证本文提出的多特征融合的自适应模型更新的跟踪性能,因此对比算法只选取了KCF[14], MFC[15]和STC[16]; 本文外场试验分析均来自于东莞交管局监控系统2016年5月采集的监控视频,保证了对比基准数据的一致性,以及工程应用适应性。本文所有实验都在东芝Intel i5 CPU, 8 GB内存的台式机进行,算法通过MATLAB2013实现。

4.1 定性定量对比

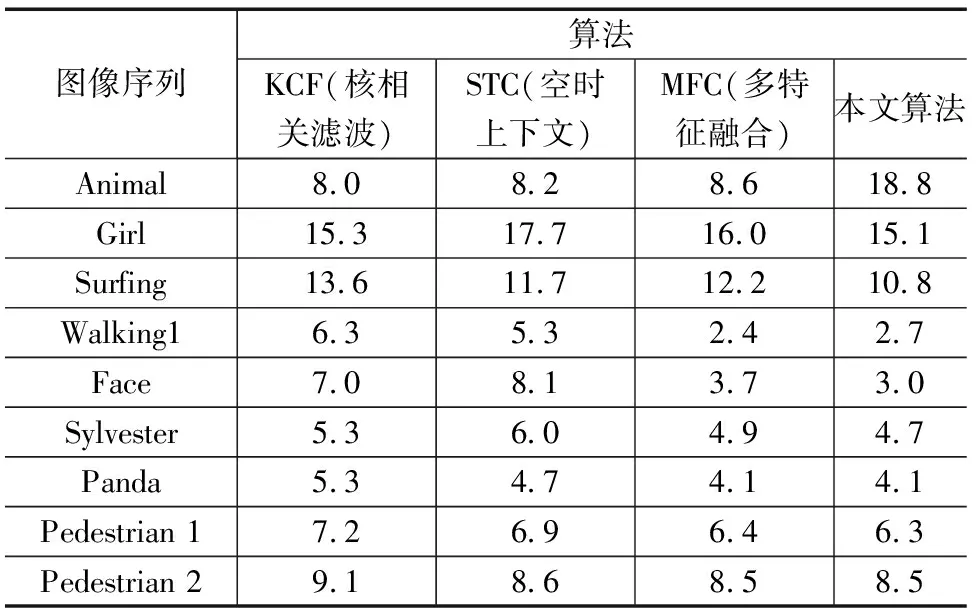

为了对跟踪性能进行量化比较,本文采用重叠率准则和跟踪中心误差两种评价准则。表1和表2分别展现了所有算法在测试基准视频序列上的平均OR和CLE跟踪性能,其中前七个视频序列来自于OTB-2013基准数据库,后两个序列是交管局的行人监控数据。可以看出,本文提出的跟踪算法性能在Face等多个视频序列上的效果优于其他算法,而在Sylvester视频序列上的效果与其他算法类似。

表1 各跟踪算法的中心位置误差

表2 各跟踪算法的重叠精度对比

为了验证在遮挡、光照等干扰因素影响下目标跟踪性能的精度,本文利用多组基准视频序列进行对比试验,部分试验结果如图1所示。可以看出,在Animal序列1中,第 323帧以前目标没有被光线,本文算法与对比算法都能很好地进行跟踪,其跟踪指标基本一致,但是当目标运动时出现了光线干扰,背景干扰后,STC与KCF跟踪算法出现了跟踪漂移,而本文提出的算法则稳定跟踪目标。充分说明了本文提出的算法对干扰因素的适应性能力。判别相关滤波器 ( KCF ) 在视觉跟踪中是很高效的,但是会受到边界效应的影响。核相关正则化 通过对 KCF 系数施加空间惩罚来解决这一问题,在提高了跟踪性能的同时不可避免地增加了复杂度。

图1 不同跟踪算法对监控视频的定性结果

为了解决在线更新问题,本文在多特征训练图像上建立模型,进一步增加了提高效率的难度。通过将时间正则化方法引入到单样本模型中,提出了一种时空正则化相关多特征融合跟踪模型。在在线被动攻击算法的启发下,我们将时间正则化引入到单特征模型中,得到了时空正则化相关滤波器。通过结合时间和空间正则化,我们的算法可以处理边界效应,同时不损失效率,并且在准确率和速度上优于其他对比算法。实验在多个基准数据集上进行。与STC相比,本文采用多个设计的特征,速度提高了 5 倍, CLE分数分别提高了5.4%和3.6%。此外,与HOG特征相结合的 KCF与基于时空上下文的STC相比,性能良好,尤其在Walking 序列上指标提升了68.3%。

部分跟踪结果如图1所示。图1(a)的序列3视频,跟踪目标的快速移动造成运动模糊,不同目标间也存在互遮挡。 STC、KCF和我们的算法都可以稳定跟踪到目标,但我们的算法更靠近目标中心。由于我们算法采用了提出模型自适应学习因子更新机制,以此减弱模型泛化能力不强产生的跟踪漂移。由图可以看出,基于STC的方法对于目标大部分长时间遮挡情况,会出现跟踪漂移,而本文方法,则能较好地克服目标大部分被遮挡情况。目标在相互遮挡时,目标本文算法利用多特征的互补特性会增强抗干扰的能力。

5 结论

为了解决单一特征在空时上下文模型中跟踪不稳的问题,我们提出了一种基于多特征融合的自适应模型更新的空时上下文目标跟踪算法,该算法利用多特征丰富多样的特征信息,将不同特征整合到空时是上下文模型中,并利用多特征加权融合来消除不同特征差异性,同时也采用自适应参数更新策略,来提升目标表征的泛化能力。大量的定性定量实验表明本文所提的算法对复杂的跟踪场景具有更强的鲁棒性与抗干扰能力。

参考文献:

[1] 王 欢,王江涛,任明武,等.一种鲁棒的多特征融合目标跟踪新算法[J].中国图象图形学报,2011,14(3):489-498.

[2] Wang L X, Chen Y P, High-speed residual resampling scheme for hardware implementation of particle filter[J]. Signal Processing 2017,30(1):97-100.

[3] Wang T H, Chen J T. Survey of research on kernel selection[J]. Computer Engineering and Design, 2012,33(3):25-28.

[4] Hare S, Saffari A, Torr P H S. Struck:structured output tracking with kernels[A]. ICCV[C]. 2011:263-270.

[5] Zhang K, Zhang L, Yang M H. Real-time compressive tracking[A]. ECCV[C]. 2012:864-877.

[6] 吴宝成.粒子滤波重采样算法研究及其应用[D].哈尔滨:哈尔滨工业大学,2011.

[7] Yao J M. Particle filter tracking method[D]. Changchun, Changchun Institute of Optics, Fine Mechanics and Physics, Chinese Academy of Sciences,2011.

[8] Bolme D S, Beveridge J R, Draper B A, et al. Visual objecttracking using adaptive correlation on filters[A]. IEEE Conference on Computer Vision and Pattern Recognition[C].Los Alamitos: IEEE Computer Society Press, 2010: 2544-2550.

[9] Henriques J F, Caseiro R, Martins P, et al. Exploiting the circulantstructure of tracking-by-detectionwithkernels[A]..Proceedings of the 12th European Conference on Computer Vision[C].New York: ACM Press, 2012, Part IV: 702-715D.

[10] Zhang S, Benenson R, Schiele B, et al. Filtered channel features for pedestrian detection[J]. computer vision and pattern recognition, 2015: 1751-1760.

[11] Guo L, Ge P S, Zhang M H, Li L H. Pedestrian detection for intelligent transportation systems combining AdaBoost algorithm and support vector machine[J]. Expert Syst. Appl. 2012, 39(4):4274-4286.

[12] Hosang J H, Benenson R, Dollar P, et al. What Makes for Effective Detection Proposals[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 38(4): 814-830.

[13] Girshick R B, Donahue J, Darrell T, et al. Region-Based Convolutional Networks for Accurate Object Detection and Segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 38(1): 142-158.

[14] Kieritz H, Becker S,et al. Online multi-person tracking?using integral channel feature[A]. 13th IEEE International Conference on Advanced Video and Signal Based Surveillance (AVSS)[C]. 2016: 122-130.

[15] Danelljan M, Khan F S,et al. Adaptive color attributes for real-time visual tracking[A]. Computer Vision & Pattern Recognition[C]. 2014 :1090-1097.

[16] Zhang K H, Zhang L, Yang M H,et al. Fast trackingvia spatio-temporal context learning[J]. Computer Science,2013.