人数统计与人群密度估计技术研究现状与趋势

2018-03-06张君军石志广李吉成

张君军,石志广,李吉成

(国防科技大学电子科学学院ATR实验室,湖南 长沙 410073)

1 引言

随着人口的增长以及人群活动的多样化,人群拥挤的场景随处可见,如机场、车站、景点等,这将成为公共管理以及公共安全巨大的挑战。人群密度与人群安全密切相关,当人群密度过高时,容易引起恐慌、拥挤以及踩踏。在很多场合中,都曾因人群密度过高而引发灾祸。随着人们对安全性要求的提高以及经济条件的改善,监控摄像头越来越多,覆盖范围也越来越广。传统的视频监控系统需要监控人员一刻不停地值守,但长时间盯着画面,人容易疲惫,很难对一些异常事件及时做出反应。为防止人群踩踏等致命事故的发生,研究人员转向了基于计算机视觉的人数统计和人群密度估计领域。自动可靠地获取监控中的人数或者人群密度,不仅能对一些人群异常情况进行自动预警和报警,而且还能用于人群模拟、人群行为和人群心理学的研究。

人数统计和人群密度估计属于智能监控范畴,目前已有较多的工作对智能监控和人群分析方面进行了总结和阐述。黄凯奇等人[1]从底层、中层、高层对智能监控计数进行了分类,并分析了一些典型算法的优缺点以及总结了待解决的问题和难点;文献[2-4]阐述了很多人群分析技术,文献[2]从人群特征提取、人群建模和人群事件推理方面进行了介绍;文献[3]对人数统计/人群密度估计、人群跟踪以及人群行为理解这三个重要的人群分析问题进行了详细的介绍,并将人数统计算法分为基于像素的方法、基于纹理的方法以及基于目标检测的方法;文献[4]从运动模式分割、人群行为识别以及异常检测三个方面对人群分析的现状进行了详细的综述。虽然以上这些综述性论文介绍了很多智能监控和人群分析方面的优秀算法,但他们并没有特别关注人数统计和人群密度估计技术。为弥补这一漏洞,文献[5]对人群计数中所用的特征以及回归模型做了详细的评价,给出评估准则,并对不同方法的性能进行了评估,香港中文大学Loy[6]也做了类似的工作。另外,文献[7]对基于计算机视觉的人群密度估计和计数技术进行了总结,涉及的方法主要有直接法(即基于检测的方法)和间接法(如基于像素的方法、基于纹理的方法以及基于角点的方法)。以上综述论文虽然将重点放在了人群密度估计和计数上,但所总结的方法都是基于浅层学习模型的,本文将在上述综述论文的基础上,补充深度学习在人群密度估计和计数上的应用。

具体地,本文从机器学习角度,把人数统计与人群密度估计算法分为浅层学习的方法和深度学习的方法。同时,从学习到的人群模型角度,将其分为直接法和间接法。本文第2节介绍人数统计与人群密度估计技术的兴起;第3节系统地介绍基于浅层学习模型的人数统计与人群密度估计算法,包括直接法和间接法;第4节从深度学习的角度入手,阐述人数统计与人群密度估计算法;第5节给出人群密度估计过程中常用的性能评估方法和基准数据集;第6节总结了人数统计与人群密度估计存在的挑战以及未来的研究方向。

2 人数统计/人群密度估计技术的兴起

视频监控是安防的重要组成部分,而人数和人群密度是视频监控所关注的一个重要因素。为了清楚地介绍人数统计/人群密度估计技术的发展历程,我们从监控设备的发展进行阐述。

20世纪70年代开始出现电子监控系统,至今视频监控技术的发展可分为三个阶段:(1)第一代模拟视频监控系统。20世纪70年代,依赖同轴电缆传输的闭路电视监控系统CCTV(Closed Circuit TeleVision)开始出现,这一代技术传输的图像质量差,难以适应大规模监控。(2)第二代数字视频监控系统。20世纪90年代中期,得益于数字编码技术和芯片技术的进步,数字视频监控系统应运而生,这一代技术图像质量好,城市级规模的安防系统也适用。(3)第三代智能视频监控系统。第二代数字视频监控系统催生了大规模的视频监控,人们对视频监控系统的需求空前高涨,人们所感兴趣的“是谁,在哪,干什么”的问题,智能视频监控系统通过对原始视频图像进行一系列的基于计算机视觉的算法分析,使得自动回答这些问题成为可能。

第二代数字视频监控系统的出现使得监控规模越来越大,当监控人员面对多路监控视频时就会应接不暇,而且长时间盯着画面人也容易疲惫。为解放监控人员,减轻监控人员的负担,研究人员开始关注基于计算机视觉的监控领域,而人数和人群密度一直都是视频监控中的一个比较重要的内容。另一方面,第二代数字视频监控系统图像画质的变好,也使得基于计算机视觉的人数统计与人群密度估计成为可能。1995年,英国学者开始研究人群运动估计和密度估计,以及潜在的人群危险情形,其中最主要的研究者是Davies等人[8]。之后,相继出现了Marana等[9 - 12]重要学者。Davies和Marana可以说是基于计算机视觉进行人群密度估计领域的鼻祖。Davies的研究工作关注人数统计,代表定量统计领域;而Marana将人群分为不同的密度等级,是定性估计领域的代表。

第三代智能视频监控系统提供了海量的监控数据,为发展基于深度学习的人数统计和人群密度估计技术提供了条件。而深度学习算法的发展,也使得视频监控系统越来越智能。

可以看出,随着视频监控设备的更新,以及人们对安防领域的重视,使得智能监控技术蓬勃发展。下面我们分别从浅层学习和深度学习方面,对人数统计和人群密度估计技术进行详细介绍。

3 浅层学习的方法

一般来说,基于浅层学习的人数统计与人群密度估计技术的具体流程包括图像获取、预处理、特征提取、特征分类和结果输出,如图1所示。

Figure 1 Process of crowd counting and crowd density estimation algorithm图1 人数统计与人群密度估计算法基本流程

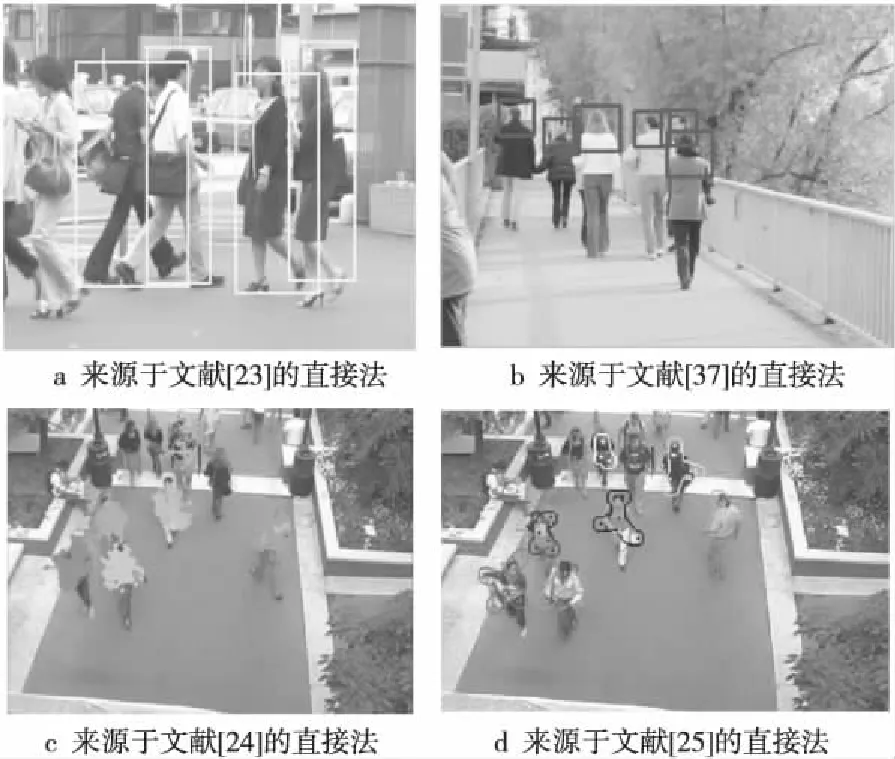

通过摄像机获取人群图像,人群密度估计中摄像机的位置一般固定不变,因此可用一些能达到实时性要求的基于背景建模的方法提取前景,常用的有基于时空背景随机更新的VIBE(VIsual Background Extractor)方法[13]、混合多高斯背景GMM(Gaussian Mixture Model)建模方法[14,15]等。人群密度估计的过程中常用几何矫正[16,17]对图像进行预处理,以减小由摄影畸形带来的误差。特征提取、特征分类是人群密度估计的核心部分。如何设计出有区分度的特征以便更好地进行人群密度估计,一直以来都是学者们所关注的内容。常用的特征有Edgelet特征[18]、梯度统计特征[16,19,20]、局部二值模式LBP(Local Binary Pattern)特征[21,22]、Harris特征[23]等。特征分类则是根据提取到的特征采用机器学习的方法学习一个分类模型或分类函数来拟合分类对象。目前主要有两种人群密度估计的方法:直接法和间接法。特征分类的过程中,如果学习的是一个分类模型则为直接法,若学习的是一个分类函数则为间接法(或基于特征的方法),如图2所示。直接法学习到的可以是人的整体模型,也可以是部分模型。针对运动个体,还可利用其运动信息进行轨迹聚类分析[24,25]。间接法中根据特征提取的不同,可将其分为基于像素的方法、基于纹理的方法以及基于角点的方法。

Figure 2 Examples of direct method图2 直接法示例

3.1 直接法

直接法试图检测图像中每一个体,直接法又可进一步分为基于模型的方法和基于轨迹聚类的方法。基于模型的方法利用图像的局部信息,训练出一个人体模型检测器来检测个体。基于轨迹聚类的方法假定人群由单个个体组成,且每一个个体都有着独特而连贯的运动模式,通过对轨迹进行聚类就可以得到近似的人数。

3.1.1 基于模型的方法

人体模型可以指整体模型,也可以指头部等部件模型,模型也称为检测器。通过在图像空间上滑动检测器来检测图像中的每一个个体,以达到统计人数的目的。

(1)整体检测。最直观、最直接的方法就是整体检测[26],通过一组行人图像训练出一个行人检测器,如图2a所示。通常可以用来表示行人整体的特征有Haar小波[27]、梯度方向直方图HOG(Histograms of Oriented Gradients)[28]、edgelet[18]以及shapelet[29]。Haar小波是较早用于行人检测的特征,HOG、edgelet以及shapelet都是基于梯度的特征,其中Dalal等人[28]提出的HOG影响最大,HOG特征也成为行人检测中的主流特征。分类器的选择对检测速度和检测的正确率的影响很大,通常速度和正确率无法兼得,比如径向基函数RBF(Radial Basis Function)、支持向量机的检测正确率比较高,但是却面临检测速度慢的问题。行人检测中常用的分类器有Boosting、线性支持向量机、随机森林以及霍夫森林[30]等。当人群比较稀疏、人与人之间不存在较大的重叠时,利用整体检测能得到一个比较准确的人数,但当人群变得比较密集时,这种方法得出的结果将不可信。

(2)部件检测。部件检测能在一定程度上解决人群密集情况下的人数统计的问题,当人与人之间存在部分遮挡时,部件模型[31 - 37]同样有效。文献[31,32]通过检测监控区域内的人头来实现人数统计,在其工作中,Haar小波变换用于提取人头的轮廓特征。单纯利用人头模型来进行人数统计结果精度不高,如果加入肩膀区域,通过检测人头和肩膀区域类似于Ω的形状,统计结果将变得更加准确[37],如图2b所示。

3.1.2 基于轨迹聚类的方法

基于轨迹聚类的方法依赖于假定个体运动场或视觉特征相对一致,因此相干的特征轨迹可以被聚合到一起表示移动的个体。遵循这一范式的研究包括:Brostow和Cipolla[24]提出非监督的贝叶斯聚类方法跟踪局部特征,并将其聚合成簇,如图2c所示;Rabaud和Belongie[25]利用KLT(KanadeLucasTomasi)跟踪器来获取一组丰富的低级跟踪特征,然后通过对轨迹聚类来推断监控区域中的人数,如图2d所示,类似的工作还可参考文献[38-40]等。

基于轨迹聚类的方法依赖于非监督的对个体的运动进行聚类,避免了显式地对个体的外观进行建模。然而,如果场景中两个个体具有共同的轨迹,统计结果将变得不可信。

3.2 间接法

间接法又被称为基于回归的方法或基于映射的方法,一般通过回归模型求出人群特征与人数之间的函数或利用分类器将人群特征映射到对应的人群密度等级。前者为定量估计,主要代表人物为Davies;后者为定性估计,主要代表人物为Marana。定性估计一般分为五个不同的密度等级,分别为很低、低、中等、高以及很高。其均参照1983年Polus[41]定义的服务级别,如表1所示。

Table 1 Service levels defined by Polus

间接的人数统计与人群密度估计方法中,常用的人群特征有前景像素特征、纹理特征和角点特征,分类器有支持向量机SVM(Support Vector Machine)、反向传播BP(Back Propagation)神经网络以及自组织映射SOM(Self Organizing Maps)神经网络等,回归模型有高斯处理回归、线性回归、SVM回归等。根据特征提取的不同,可将人数统计与人群密度估计方法分为基于像素的方法、基于纹理的方法以及基于角点的方法。

3.2.1 基于像素的方法

像素统计特征最先被用于人数统计,Davies等人[13]利用图像和背景相减的方法得到运动前景,然后以前景像素面积和前景边缘为特征做线性回归。Yang和Ma等人[42,43]则仅提取人群图像的前景面积特征,其系统分别针对室内以及室外监控。Cho等[44 - 46]同样利用前景像素面积和前景边缘特征基于前向神经网络估计人群密度。Regazzoni等人[47]则认为前景像素与人数是非线性的关系,尽管作了一些改进,但他们的方法主要专注于室内的场景,人群数量也有限(30人)。Damian等人[17]于2007年提出射影畸形矫正方法,通过对每个网格内的像素赋予不同的权值的方法,提取出像素统计特征,最后采用SVM进行分析,得出相应的人群密度信息。而Hussain等人[48]组合使用背景消除和边缘检测来进行特征提取,并对前景像素块进行缩放以矫正透视失真,然后输入BP神经网络进行人群密度估计,将人群分为“很低”“低”“中”“高”和“很高”五个密度等级。

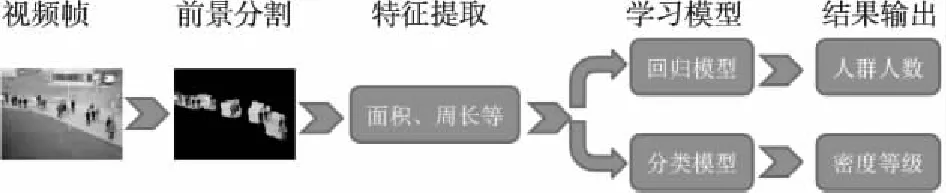

综上所述,像素统计特征不仅可用于人数统计,还可以用来进行密度估计。基于像素的方法的一般流程包括:前景分割、人群特征提取以及学习分类或者回归,如图3所示。

Figure 3 Process of pixel based method图3 基于像素的方法流程

总体上来说,基于像素统计的算法比较直观,易于理解。其基本思想是:人群越密集,分离出人群前景的像素点或边缘像素点的数量就越大。像素统计特征与人群密度或者人群数量之间的关系比较简单,容易训练,并且训练后的分类器或者函数关系的泛化能力强。但是,该类方法依赖于提取前景,若前景提取不好则估计结果将失效,而且高密度人群环境下正确率低。

3.2.2 基于纹理的方法

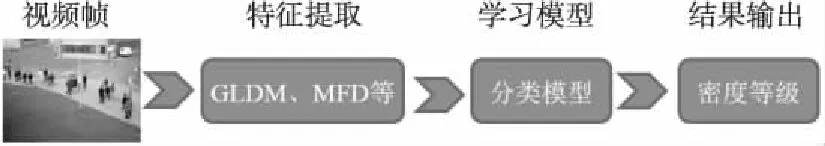

Marana认为人群图像具有纹理特征,低密度的图像具有较粗的纹理模式,而高密度的人群图像具有较细的纹理模式,根据这个特点,统计人群纹理图像的灰度共生矩阵GLDM(Grey Level Dependence Matrices)[9 - 11]或闵科夫斯基分形维数MFD(Minkowski Fractal Dimensions)[12]作为特征,利用SOM神经网络进行分类,将人群分为“很低”“低”“中”“高”和“很高”五个密度等级。随后Marana又引入信号处理的方法,将小波变换应用到人群密度估计中。他首先对人群图像进行二级小波包分解,得到小波系数矩阵,然后计算小波系数矩阵的能量,最后将能量值作为特征值送入自组织神经网络进行分类。小波包的多尺度分类特性能有效解决图像的透视效果,该算法的精度比较高。Li[49]追随Marana的工作,同样将二维离散小波变换引入人群密度估计中,并基于SVM将人群密度分为四个等级。Rahmalan等人[50]提出基于切比雪夫平移正交不变矩TIOCM(Translation Invariant Orthonormal Chebyshev Moments)的人群纹理描述特征,同样用SOM神经网络将人群密度分为五个范围。并将TIOCM与GLDM和MFD特征做比较,在其数据集上TIOCM取得了较好的效果,而MFD效果最差。Wu等人[51]同样结合GLDM和SVM进行自动的人群密度估计,并能检测出不正常的人群密度。

当前的研究工作中,纹理特征主要用于人群密度估计。该类方法一般在原始图像上提取纹理特征,然后进行特征分类得到相对应的人群密度等级,如图4所示。

Figure 4 Process of texture based method图4 基于纹理的方法流程

基于图像的纹理特征对人群密度进行估计虽在一定程度上解决了基于像素的方法在高密度人群场景中估计效果差的问题,但此方法在低密度人群环境下表现不是太好。此外,由于直接在原始图像上提取纹理特征,容易被背景纹理干扰。

3.2.3 基于角点的方法

Albiol等人[23]最先将Harris角点特征引入人数统计中,其方法以优越的性能在PETS2009(Performance Evaluation of Tracking and Surveillance)胜出。2010年,Conte等人[52,53]在Albiol的方法基础上做了改进,他们选用了加速稳健特征SURF(Speeded Up Robust Feature)点作为特征点来解决Harris角点检测的不稳定性问题,同时引入逆投影变换IPM(Inverse Perspective Mapping)来解决透视效应。吕济民等人[54]在Albiol和Conte的方法的基础上,使用了“非最大抑制聚类”——对不同拍摄距离的人群采取不同的聚类标准,该研究成果在处理远距离人群上的精度比较高。

目前,大多数人用此类方法进行人数统计,其一般经过角点检测、背景角点剔除,然后以前景角点个数进行回归得出相应的人数,如图5所示。

Figure 5 Process of corner point based method图5 基于角点的方法流程

角点特征被最后引入人群密度估计领域,从2009年出现后,以其优越的性能获得了大量学者的关注。

4 深度学习的应用

2006年以来,深度学习(尤其是卷积神经网络)迅速成为研究的热点,已被广泛应用到目标检测和识别、图像分割等领域。研究人员也开始转入到基于深度学习的人数统计与人群密度估计技术,基于深度学习的方法同样包括直接法和间接法。接下来将介绍一些经典的算法。

4.1 直接法

基于深度学习的直接法试图训练出行人检测器,检测出图像中的每一个个体,文献[55]最先将卷积神经网络应用于行人检测,该方法也被称为ConvNet。ConvNet混合使用了监督学习和非监督学习,该项工作还提供了有限的样本(614个正样本,1 218个负样本)训练深度网络的策略。另一项经典的工作是将2007~2009年连续三年获得VOC(Visual Object Class)冠军的目标检测算法DPM(Deformable Parts Model)用于行人检测。文献[56]通过一组受限玻尔兹曼机RBM(Restricted Boltzmann Machine)扩展DPM,来解决行人检测中的遮挡问题。其后,文献[57]又在此基础上训练出多人的检测器,该算法可以正确检测出人群中无法通过单人检测器检测出的行人。一些学者将深度学习模型视为黑盒子,事实上这种看法并不全面。联合深度学习[58]则利用传统计算机视觉系统与深度模型之间的密切联系,成为行人检测方面的一个成功例子。联合深度学习包括特征提取、部件几何形变建模、部件检测器、部件遮挡处理以及分类器等组成模块。文献[59]提出的多尺度相关池化MultiSDP(Multi Scale Dependent Pooling)网络组合使用多级分类器和深度模型对网络进行优化,该方法能有效避免训练的过拟合。SDN(Switchable Deep Network)[60]是目前行人检测领域表现最好的算法,其引入了一个可切换的受限玻尔兹曼机来自动学习层次特征、显著图以及身体部位的混合表示。

4.2 间接法

除此之外,还有一类方法通过深度网络直接回归出人数或给出一个密度等级。Fu等人[61]提出了一个多级的卷积神经网络,将人群分为“很低”“低”“中”“高”“很高”五个密度等级,且分类正确率能达到96.8%。中国科学院自动化研究所录制了包括不同天气条件的人群视频,且视频来源于不同地点共6个场景。黄凯奇的研究团队[62]以6个场景的视频切片的源图像以及光流图像分别作为卷积神经网络的输入,回归出了场景中两个不同方向(进入以及离开)的人数。另一项比较新的工作来自于香港中文大学的王晓刚的研究团队[63],他们提供的方法不仅能同时估计出人群密度以及人数,而且还能够适用于不同的场景。

当前,大多数基于深度学习的人数统计方法为直接法,为解决人数统计中的遮挡问题,很多学者做了大量的研究工作。但是,这种基于检测的直接法最大的缺点就是在检测的过程中,需要大量的候选窗口,这样大大降低了算法的时效性。通常,人数统计或者密度估计不应该关注个体,近两年也有部分工作开始注重基于深度学习回归的人数统计和人群密度估计算法。

5 性能评估与基准数据集

5.1 性能评估方法

为了对人群人数统计和密度估计算法进行性能评估,需要一些有效的评价指标。对于人数统计,常用的评价指标有三个,分别为平均绝对误差MAE(Mean Absolute Error)、均方误差MSE(Mean Squared Error)以及平均偏差误差MDE(Mean Deviation Error)[6]。

MAE的定义如式(1)所示:

MSE的定义如式(2)所示:

MDE的定义如式(3)所示:

MAE和MSE被广泛用于评价算法的性能,但对于人数统计,这两项指标无法反映密度的变化,而MDE不仅能评测算法性能,还可以反映出密度的变化,因此被大量用于评价人数统计算法。

对于人群密度估计,常常被看作是一个分类问题,因此一般都用正确率来评价算法的性能。

5.2 基准数据集

人数统计和人群密度估计技术常用的基准数据集如下:

(1)PETS2009[64]:第11届国际跟踪与监控性能评价研讨会上引入的数据集,包含3个不同的人群场景S1、S2和S3,其中S1主要用于人数统计和密度估计,S2用于行人跟踪,S3用于光流分析以及事件识别。

(2)Fudan[65]:录制于上海复旦大学光华楼的入口,总共1 500帧,被分为5个不同的部分。这个数据集不仅提供了原图像,而且还提供了分割出的前景二值图,以及一些提取的人群特征供研究者使用。

(3)Grand Central[66]:由香港中文大学Zhou提供,拍摄了一段包含33 min的纽约中央火车站的人群视频,监控的范围比较大,且行人比较多。

(4)UCSD[67]:包含2 000帧标记好的行人视频,视频中行人相向而行,且人群密度从稀疏到密集变化。

(5)Mall[68]:由香港中文大学Loy提供,是一段通过公共监控摄像头拍摄的商场的行人视频。

(6)Chunxi_Road[69]:由成都电子科技大学的付敏提供,拍摄于春熙路,包含的行人比较多,且行人姿态(有运动的也有静止的)和着装各异,该数据集更接近于真实的人群场景。

6 人数统计/人群密度估计技术的挑战及方向

基于计算机视觉的人数统计与人群密度估计历来都是一项比较富有挑战性的任务,主要需要克服以下几方面的困难:

(1)监控图像(尤其是室外监控)容易受到光照、天气等因素的影响;

(2)对于不同的场景,相机参数的不同使得人群图像有着不同程度的摄影畸形;

(3)人群姿态各异,有拥挤以及遮挡现象的存在。

以上是几个常见的挑战,这些因素要么影响人群的分割,要么使得模型在不同场景中无法通用,要么使得检测个体变得很困难。

现有的算法大多数仅仅针对运动人群,且依赖于人群分割,若无法正确分割出人群,将无法有效地估计出人数。传统的背景建模方法无法克服人群分割中的所有问题,FCN(Fully Convolutional Networks)[70]是一个比较优秀的用于分割的深度网络,未来将应用于人群分割。

监控摄像头日益增多,要想让自己的算法得到大范围的推广,唯有设计出只需轻微修改参数就能应用的算法。现阶段这方面的研究工作还很少,且现有的基准数据集也很少有提供多个场景的,多场景的人数统计与人群密度估计技术将成为未来的热点。

人群姿态与遮挡一直以来是研究者所关心的问题,并且有大量的研究用于解决这方面的问题。香港中文大学的王晓刚等人对DPM的应用一定程度上解决了此问题,而这两年目标检测领域的另几个优秀的算法分别为R-CNN[71]、SPP-NET[72]、Fast R-CNN[73]以及FasterR-CNN[74],如何将这些算法应用于行人检测也是一个值得研究的课题。

总之,人数统计与人群密度估计的首要任务是设计出能更好表征人群的方法,Sermanet等人[75]指出,深度学习在很多应用上比人工设计的特征表现更优异,近几年来,也有很多学者转向研究基于深度学习的人群密度估计算法,未来人数统计与人群密度估计领域也将涌现出更多的基于深度学习的方法。

7 结束语

作为人群分析方面的一项富有挑战性的任务,人数统计与人群密度估计吸引了大量学者的注意力。20世纪90年代出现的数字视频监控系统,使得学者们开始研究基于计算机视觉的人数统计与人群密度估计。从这二十多年的发展来看,人数统计与人群密度估计技术经历了从基于浅层学习的方法到基于深度学习的方法两个阶段。近些年来,基于浅层学习的方法的发展速度开始放慢,该领域具有影响力的研究成果大多集中在深度学习方面。随着人们对安防方面要求的提高,基于计算机视觉的人数统计与人群密度估计系统势必会得到大范围的应用。而现有的方法普遍存在无法适用于不同场景的问题,这给系统的安装带来了不便,从而影响系统的推广。但是,目前也有学者关注这个问题,相信在不久的将来,视频监控将变得更加智能。

[1] Huang Kai-qi, Chen Xiao-tang, Kang Yun-feng, et al. Intelligent visual surveillance: A review[J]. Chinese Journal of Computers, 2015,38(6):1093-1118.(in Chinese)

[2] Zhan B,Monekosso D N,Remagnino P,et al.Crowd analysis: A survey[J].Machine Vision & Applications,2008,19(5-6):345-357.

[3] Jacques Junior J C S,Musse R S,Jung C R.Crowd analysis using computer vision techniques[J].Signal Processing Magazine IEEE,2010,27(5):66-77.

[4] Li T, Chang H, Wang M,et al.Crowded scene analysis: A survey [J].IEEE Transactions on Circuits & Systems for Video Technology,2015,X(1):367-386.

[5] Ryan D,Denman S,Sridharan S,et al.An evaluation of crowd counting methods,features and regression models[J].Computer Vision & Image Understanding,2015,130(C):1-17.

[6] Loy C C,Chen K,Gong S,et al.Crowd counting and profiling: Methodology and evaluation[M]∥Ali S, Nishino K, Manocha D,et al.Modeling,Simulation and Visual Analysis of Crowds.Berlin:Springer,2013:347-382.

[7] Saleh S A M,Suandi S A,Ibrahim H.Recent survey on crowd density estimation and counting for visual surveillance [J].Engineering Applications of Artificial Intelligence,2015,41:103-114.

[8] Davies A C,Jia H Y A V.Crowd monitoring using image processing [J].Electronics & Communications Engineering Journal,1995,7(1):37-47.

[9] Marana A N, Velastin S A,Costa L F,et al.Estimation of crowd density using image processing[C]∥Proc of IEE Colloquium on Image Processing for Security Applications 1997,Digest No.074.

[10] Marana A N,Velastin S A,Costa L F,et al.Automatic estimation of crowd density using texture[J].Safety Science,1998,28(3):165-175.

[11] Marana A N,Costa L F,Lotufo R A,et al.On the efficacy of texture analysis for crowd monitoring[C]∥Proc of the 25th International Symposium on Computer Graphics, Image Processing, and Vision,1998:354-354.

[12] Marana A N, Da Fontoura Costa L,Lotufo R A,et al.Estimating crowd density with Minkowski fractal dimension[C]∥Proc of 1988 International Conference on Acoustics,Speech,and Signal Processing(ICASSP’88),1999:3521-3524.

[13] Wang Qiang, Sun Hong. Crowd density estimation based on pixel and texture[J]. Electronic Science and Technology, 2015,28(7):129-132.(in Chinese)

[14] Shen Na-li, Li Ning, Chang Qing-long. Crowd density estimation based on improved Gaussian mixture model[J]. Computer & Digital Engineering, 2012, 40(7):108-111. (in Chinese)

[15] Zhang Ying, Chen Lin-qiang, Yang Li-kun. People counting based on object segmentation and SVM[J]. Journal of Hangzhou Dianzi University, 2013,33(6):86-90.(in Chinese)

[16] Chan A B,Liang Z S J,Vasconcelos N.Privacy preserving crowd monitoring: Counting people without people models or tracking[C]∥Proc of IEEE Conference on Computer Vision and Pattern Recognition(CVPR), 2008:1-7.

[17] Roqueiro D, Petrushin V A. Counting people using video cameras [J].International Journal of Parallel Emergent & Distributed Systems,2007,22(3):193-209.

[18] Wu B,Nevatia R.Detection of multiple,partially occluded humans in a single image by Bayesian combination of edgelet part detectors[C]∥Proc of the 10th IEEE International Conference on Computer Vision(ICCV’05),2005:90-97.

[19] Chan A B, Vasconcelos N.Counting people with low-level features and Bayesian regression [J].IEEE Transactions on Image Processing,2012,21(4):2160-2177.

[20] Kong D,Gray D,Tao H.A viewpoint invariant approach for crowd counting[C]∥Proc of the 18th International Conference on Pattern Recognition(ICPR 2006),2006:1187-1190.

[21] Qin Xun-hui, Wang Xiu-fei, Zhou Xi, et al. Counting people in various crowed density scenes using support vector regression[J]. Journal of Image and Graphics, 2013,18(4):392-398. (in Chinese)

[22] Li Xue-feng, Li Xiao-hua, Zhou Ji-liu . Crowd density estimation based on completed local binary pattern[J]. Computer Engineering and Design, 2012, 33(3):1027-1031.(in Chinese)

[23] Albiol A,Silla M J,Mossi J M.Video analysis using corner motion statistics[C]∥Proc of IEEE International Workshop on Performance Evaluation of Tracking and Surveillance,2009:31-38.

[24] Brostow G J,Cipolla R.Unsupervised Bayesian detection of independent motion in crowds[C]∥Proc of 2006 IEEE Computer Society Conference on Computer Vision and Pattern Recognition(CVPR’06),2006:594-601.

[25] Rabaud V,Belongie S.Counting crowded moving objects[C]∥Proc of 2006 IEEE Computer Society Conference on Computer Vision and Pattern Recognition(CVPR’06),2006:705-711.

[26] Leibe B, Seemann E, Schiele B. Pedestrian detection in crowded scenes[C]∥Proc of 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR’05), 2005:878-885.

[27] Jones M J,Snow D.Pedestrian detection using boosted features over many frames[C]∥Proc of the 19th International Conference on Pattern Recognition(ICPR 2008),2008:1-4.

[28] Dalal N,Triggs B.Histograms of oriented gradients for human detection[C]∥Proc of IEEE Computer Society Conference on Computer Vision and Pattern Recognition,2005:886-893.

[29] Sabzmeydani P,Mori G.Detecting pedestrians by learning shapelet features[C]∥Proc of 2013 IEEE Computer Society Conference on Computer Vision and Pattern Recognition,2010:1-8.

[30] Juergen G,Angela Y,Nima R,et al.Hough forests for object detection,tracking,and action recognition[J].IEEE Transactions on Software Engineering,2011,33(11):2188-2202.

[31] Lin S F,Chen J Y,Chao H X.Estimation of number of people in crowded scenes using perspective transformation [J].IEEE Transactions on Systems Man & Cybernetics Part A Systems & Humans,2001,31(6):645-654.

[32] Lin S F,Lin C D.Estimation of the pedestrians on a crosswalk[C]∥Proc of 2006 SICE-ICASE,2006:4931-4936.

[33] Felzenszwalb P F,Girshick R B,David M A,et al.Object detection with discriminatively trained part-based models[J].IEEE Transactions on Pattern Analysis & Machine Intelligence,2010,32(9):1627-1645.

[34] Lin T Y,Lin Y Y,Weng M F,et al.Cross camera people counting with perspective estimation and occlusion handling[C]∥Proc of 2011 IEEE International Workshop on Information Forensics and Security (WIFS’11),2011:1-6.

[35] Wu B,Nevatia R.Detection and tracking of multiple,partially occluded humans by Bayesian combination of edgelet based part detectors [J].International Journal of Computer Vision,2007,75(2):247-266.

[36] Wu B,Nevatia R,Nevatia R.Detection and tracking of multiple,partially occluded humans by Bayesian combination of edgelet based part detectors[J].International Journal of Computer Vision,2007,75(2):247-266.

[37] Li M,Zhang Z,Huang K,et al.Estimating the number of people in crowded scenes by MID based foreground segmentation and head-shoulder detection[C]∥Proc of the 19th International Conference on Pattern Recognition(ICPR’08),2008:1-4.

[38] Sidla O,Lypetskyy Y,Brandle N,et al.Pedestrian detection and tracking for counting applications in crowded situations[C]∥Proc of 2013 10th IEEE International Conference on Advanced Video & Signal Based Surveillance,2006:70.

[39] Cheriyadat A M,Bhaduri B L,Radke R J.Detecting multiple moving objects in crowded environments with coherent motion regions[C]∥Proc of 2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition,2008:1-8.

[40] Cheriyadat A M,Radke R J.Detecting multiple moving objects in crowded environments with coherent motion regions: US,US8462987[P].2013.

[41] Polus A, Livneh M,Craus.Geometry-flow-speed relationships and their effect on level of service[J].Publication of Council for Scientific & Industrial Res S Africa,1983(S316):253-260.

[42] Yang D B,Gonzalez-Banos H H,Guibas L J.Counting people in crowds with a real-time network of simple image sensors[C]∥Proc of the 9th IEEE International Conference on Computer Vision,2003:122-129.

[43] Ma R,Li L,Huang W,et al.On pixel count based crowd density estimation for visual surveillance[C]∥Proc of 2004 IEEE Conference on Cybernetics and Intelligent Systems,2004:170-173.

[44] Chow T W S,Yam Y F,Cho S Y.Fast training algorithm for feedforward neural networks:Application to crowd estimation at underground stations [J].Artificial Intelligence in Engineering,1999,13(3):301-307.

[45] Cho S Y,Chow T S,Leung C T.A neural-based crowd estimation by hybrid global learning algorithm[J].IEEE Transactions on Systems Man & Cybernetics Part B Cybernetics,1999,29(4):535-541.

[46] Chow T W S,Cho S Y.Industrial neural vision system for underground railway station platform surveillance[J].Advanced Engineering Informatics,2002,16(1):73-83.

[47] Regazzoni C S,Tesei A.Distributed data fusion for real-time crowding estimation[J].Signal Processing,1996,53(1):47-63.

[48] Hussain N, Yatim H S M,Hussain N L,et al.CDES: A pixel-based crowd density estimation system for Masjid al-Haram[J].Safety Science,2011,49(6):824-833.

[49] Li X,Shen L,Li H.Estimation of crowd density based on wavelet and support vector machine[J].Transactions of the Institute of Measurement & Control,2006,28(3):299-308.

[50] Rahmalan H,Nixon M S,Carter J N.On crowd density estimation for surveillance[C]∥Proc of 2006 the Institution of Engineering and Technology Conference on Crime and Security,2006:540-545.

[51] Wu X,Liang G,Lee K K,et al.Crowd density estimation using texture analysis and learning[C]∥Proc of IEEE International Conference on Robotics and Biomimetics(ROBIO 2006),2006:214-219.

[52] Conte D,Foggia P,Percannella G,et al.A method for counting people in crowded scenes[C]∥Proc of 2010 7th IEEE International Conference on Advanced Video and Signal Based Surveillance (AVSS 2010),2010:225-232.

[53] Conte D, Foggia P,Percannella G,et al.Counting moving people in videos by salient points detection[C]∥Proc of International Conference on Pattern Recognition,2010:1743-1746.

[54] Lü Ji-min,Zeng Zhao-xian,Zhang Mao-jun. Counting pedestrains in video sequences based on non-maxima suppression clustering[J].Pattern Recognition and Artificial Intelligence, 2012, 25(1):150-156.(in Chinese)

[55] Sermanet P,Kavukcuoglu K,Chintala S,et al.Pedestrian detection with unsupervised multi-stage feature learning[C]∥Proc of 2013 IEEE Computer Society Conference on Computer Vision and Pattern Recognition(CVPR 2013),2013:3626-3633.

[56] Ouyang W.A discriminative deep model for pedestrian detection with occlusion handling[C]∥Proc of 2012 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR 2012),2012:3258-3265.

[57] Ouyang W, Wang X.Single-pedestrian detection aided by multi-pedestrian detection[C]∥Proc of IEEE Conference on Computer Vision and Pattern Recognition(CVPR 2013),2013:3198-3205.

[58] Ouyang W,Wang X.Joint deep learning for pedestrian detection[C]∥Proc of 2013 IEEE International Conference on Computer Vision, 2013:2056-2063.

[59] Zeng X, Ouyang W,Wang X.Multi-stage contextual deep learning for pedestrian detection[C]∥Proc of 2013 IEEE International Conference on Computer Vision (ICCV 2013),2013:121-128.

[60] Luo P,Tian Y,Wang X,et al.Switchable deep network for pedestrian detection[C]∥Proc of 2014 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR 2014),2014:899-906.

[61] Fu Min, Xu Pei, Li Xu-dong,et al.Fast crowd density estimation with convolutional neural networks[J].Engineering Applications of Artificial Intelligence,2015,43:81-88.

[62] Cao L,Zhang X,Ren W,et al.Large scale crowd analysis based on convolutional neural network[J].Pattern Recognition,2015,48(10):3016-3024.

[63] Zhang C,Li H,Wang X,et al.Cross-scene crowd counting via deep convolutional neural networks[C]∥Proc of 2015 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR 2015),2015:833-841.

[64] Pets2009 dataset[DS/OL].[2016-01-20].http://ftp.pets.rdg.ac.uk/pub/PETS2009/Crowd_PETS09_dataset/a_data/a.html.

[65] Fudan dataset [DS/OL].[2016-01-20].http://www.iipl.fudan.edu.cn/~zhangjp/Dataset/fd_pede_dataset_intro.htm.

[66] Grand central dataset [DS/OL]. [2016-01-20].http://www.ee.cuhk.edu.hk/~xgwang/grandcentral.html.

[67] UCSD dataset[DS/OL].[2016-01-20].http://www.svcl.ucsd.edu/projects/peoplecnt/.

[68] Mall dataset[DS/OL].[2016-01-20].http://www.eecs.qmul.ac.uk/~ccloy/downloads_mall_dataset.html.

[69] Chunxi_Road[DS/OL].[2016-01-20].http://cvlab.uestc.edu.cn/CDE_CNN/Dataset_Chunxi_Road.zip.

[70] Long J, Shelhamer E,Darrell T.Fully convolutional networks for semantic segmentation [J].IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017,39(4):640-651.

[71] Ross Girshick,Jeff Donahue,et al.Region-based convolutional networks for accurate object detection and segmentation[C]∥Proc of 2014 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR 2014), 2014:1.

[72] He K,Zhang X,Ren S,et al.Spatial pyramid pooling in deep convolutional networks for visual recognition[J].IEEE Transactions on Pattern Analysis & Machine Intelligence,2015,37(9):1904-1916.

[73] Girshick R.Fast r-cnn[C]∥Proc of IEEE International Conference on Computer Vision,2015: 1440-1448.

[74] Ren S,He K,Girshick R,et al.Faster R-CNN: Towards real-time object detection with region proposal networks[C]∥Proc of Advances in Neural Information Processing Systems,2015: 91-99.

[75] Sermanet P,Eigen D,Zhang X,et al.Overfeat: Integrated recognition,localization and detection using convolutional networks.arXiv preprint[J].2014: arXiv:1312.6229v4.

附中文参考文献:

[1] 黄凯奇,陈晓棠,康运锋,等.智能视频监控技术综述[J].计算机学报,2015,38(6):1093-1118.

[13] 王强,孙红.基于像素统计和纹理特征的人群密度估计[J].电子科技,2015,28(7):129-132.

[14] 沈娜黎,黎宁,常庆龙.基于改进混合高斯模型的人群密度估计方法[J].计算机与数字工程,2012,40(7):108-111.

[15] 张英,陈临强,杨礼坤.基于目标分割与SVM的人数统计[J].杭州电子科技大学学报,2013,33(6):86-90.

[21] 覃勋辉,王修飞,周曦,等.多种人群密度场景下的人群计数[J].中国图象图形学报,2013,18(4):392-398.

[22] 李雪峰,李晓华,周激流.基于完全局部二值模式的人群密度估计[J].计算机工程与设计,2012,33(3):1027-1031.

[54] 吕济民,曾昭贤,张茂军.基于非最大抑制聚类的视频人数估测方法[J].模式识别与人工智能,2012,25(1):150-156.