一种脑电信息监督人脸图像的注意力分析方法

2018-03-06刘冀伟史尹嘉严朝雯

刘冀伟,史尹嘉,白 羽,严朝雯

(1.北京科技大学自动化学院,北京 100083;2.北京科技大学计算机与通信工程学院,北京 100083)

1 引言

目前对人状态的识别主要有人脸表情的识别、语音语调的识别、人体姿态的识别以及人体生理信号(如肌肉电、脉搏波、皮肤电、血压、呼吸等)的识别。相关的研究领域主要是驾驶员疲劳检测分析。疲劳表情识别已成为国外学者及研究机构的研究热点,日本、美国及欧洲国家的研究者最为活跃,研究主要有:文献[1]旨在提出一种检测是否疲劳驾驶的系统,来阻止潜在的驾驶危险。这个系统通过网络摄影来获得驾驶员脸部图像。综述了现有常见的人脸识别和眼部跟踪技术,通过在实验室和现实中的测试给出了测试结果。文献[2]基于眼睑运动的算法来实现对是否疲劳驾驶的测定。文中利用层叠分类器的算法来识别人脸,然后通过分析不同图片得出疲劳状态下的眼睑运动规则。文中更深层地建立了相应的规则来判断一个司机是否疲劳驾驶。实验结果表明,该算法满足对驾驶员疲劳状态检测的需求。文献[3]通过眼睛的状态来判断司机的疲劳驾驶状况,为了提高实时反应和可靠性建立了一种基于眼部状态的监测疲劳驾驶状态的算法。眼部的感兴趣区域通过最优几何知识从脸部获取,利用Sobel算子识别边缘信息来判断眼部状态。文中利用了一种新的整数估计算法来定位眼部边缘。

以上研究都是针对特征变化明显的情况进行处理,两极分化较为严重,处于中间过渡特征的情况较少。并且专注度的分析研究没有客观的监督作为标准,只是使用人为设计的样本。本文探索性地提出并设计了一种人脸表情识别和脑电信息监督面部图片专注度的对应模型,通过捕捉和识别任务人的面部表情判断和理解任务中人的专注度。

本文主要采用与专注度判定关系非常密切的两个生理指标:面部信息与脑电信息。脑电信息能够准确地反映任务人的精神状态,首先对任务人不同状态下人脸视频和脑电信息标识的专注度进行样本采集。接着对人脸视频进行人脸检测跟踪和特征提取,并将同时刻对应的脑电波专注度作为客观监督。最后设计支持向量机SVM (Support Vector Machine)分类器进行样本训练和测试,得到专注度判定分类器,并分析人脸面部与专注度之间相关关系。

本文结构如下:第1节建立实验样本库;第2节是面部信息建模;第3节是面部特征提取;第4节是SVM面部特征分类;第5节是实验与结果分析;第6节是总结研究。

2 建立实验样本库

由于本文需要建立面部信息与脑电信息监督下的专注度的相关关系,从而利用面部信息进行专注度判定,所以就需要专门建立一个面部信息与脑电信息标识的专注度相对应的样本库。所需硬件设备主要有单目摄像头和脑电信息采集设备,脑电信息标识的专注度采集设备主要选用名为佰意通的便携式脑电生物反馈系统。主要步骤如下:

(1) 调试设备,对脑电信息检测设备以及摄像设备进行调试。样本采集需要在同样的环境条件下,保证被试者不受周围环境干扰。

(2) 确定脑电信息诱发内容,刺激内容分别为放置于测试人员对面的剧情影片、愉快类影片等内容相对比较明确的视频。

(3) 每次进行15 min录像以及脑电信息标识的专注度记录,需要注意表情与脑电信息标识的专注度采集时间必须严格同步。采集结束后明确脑电信息记录数值的输出位置以及摄像的每段时间。

(4) 获取到足够的样本后,对视频进行人脸跟踪。通过30 fps(30帧/秒)的频率,以1 s为间隔进行连续采样并截取面部图像。

(5) 将每张面部图片以及对应1 s采样的脑电信息标识的注意力数据进行整理,作为实验样本库。

3 面部信息建模

表情信息是人情绪的面部表现,据美国心理学家阿尔伯特所列出的公式:表情=55%面部表情+38%语气+7%语言,所以本文主要考虑人脸表情信息。据人脸面部表情编码系统FACS(Facial Action Coding System)的实验结果,在没有其它诱导作用下,如果被试者对自己的体验表达正确,从面部表情到单一的具体情绪状态映射的正确率为88%[4],因此可以认为面部表情可以识别情绪状态。Ekman设定了6种最基本的表情:惊奇、厌恶、恐惧、愤怒、高兴和悲伤[5,6],在不同种族和文化的人中,该6种不同的表情都是比较常见的。考虑到判定注意力的特点,我们没有必要研究所有的表情信息,只需能够识别与注意力相关的表情信息即可。为了建模方便,又不失一般性,本文定义了专注、非专注和中性3种与专注度相关的表情,通过判断这三种表情去判断目标人的专注度。

3.1 面部信息特征分析

对与注意力相关的特征分析后获得如表1所示的结果。

3.2 面部信息特征表示

根据表1内容分析可知,与专注度判定相关性最大的表情特征相对集中在任务人的眉毛、眼睛以及嘴巴这几个主要部位。针对这些特征部位,我们定义如下特征表示:

(1)特征一:面部特征点坐标集合;

(2)特征二:眼睛大小,嘴巴张开大小,嘴巴宽度;

Table 1 Facial feature information classification analysis

(3)特征三:眼睛张开程度,嘴巴张开程度,嘴角上下朝向。

本文主要通过以上特征的变化,来进行专注度判定。

4 面部特征提取

由于人脸检测跟踪算法已经相对成熟,所以本文直接采用以Harr[7]特征进行人脸检测的Adaboost人脸识别算法,对样本视频人脸表情进行截取处理,得到表情图片集。

4.1 人脸归一化

由于采集图像时人脸的偏转容易造成特征点位置的变化,为了让不同图像的人脸区域尽量相符,消除不同特征点的位置差异。归一化主要有两个方面的要求:第一是图像大小的归一化,即图像缩放到相同的大小;第二是人脸对齐的归一化,将人脸的主要特征点放置在相同的位置[8]。具体步骤如下:

Step1以鼻尖为中心,做仿射变换,将左右偏移人脸拉正,保证人脸的方向一致性。

Step2设两眼之间平均距离为d,其鼻尖点为O。

Step3根据面部特征点确定包含所有特征的最小矩形特征区域,以O为基准,按照左右各取d、上下各取1.5*d、1*d的矩形区域进行裁剪。

Step4将截取区域的图像通过尺度变换形成统一尺寸,这样即实现了图像大小归一化。得到一个长为2*d,宽为2.5*d的矩形区域作为归一化的人脸图片。

归一化处理前后的图片分别如图1和图2所示。

Figure 1 Face image before normalized图1 归一化前人脸图片

Figure 2 Face image after normalized图2 归一化后人脸图片

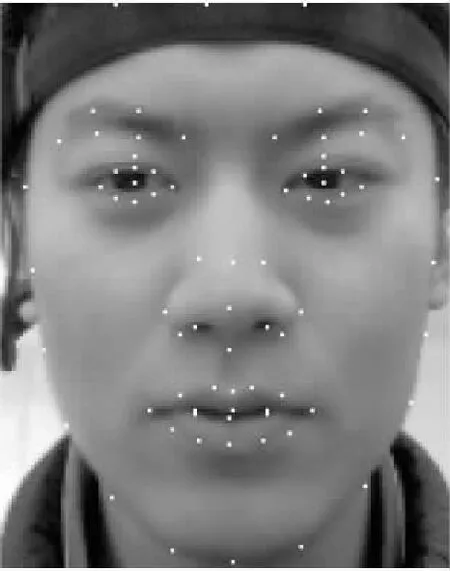

4.2 ASM特征点匹配

主动形状模型ASM(Active Shape Model)[9,10]是一种点分布模型,最早被Cootes等人研究提出。ASM是一种基于模型的特征匹配方法,它不但可以灵活地改变模型的形状来适应目标形状不确定的特点,还可将形状的变化控制在模型允许的范围内,进而保证模型变化时不会受各种因素干扰而出现不合理的形状。

ASM 实际使用时包含训练和搜索两步,其原理是:使用对目标形状样本训练的方法获得目标形状的统计知识,用统计知识建立由一系列坐标点的集合表示的形状模型[11]。ASM利用先前训练得到的可变模型,去自动搜索由特征点组成的归一化后的面部图片。

如图3所示,当对特征点定位后,提取情感几何特征。

Figure 3 ASM matching facial feature points图3 ASM匹配人脸特征点

与特征二、三相关的特征点分布如图4和图5所示。

Figure 4 Eye feature points distribution图4 眼部特征点分布

Figure 5 Mouth feature points distribution图5 嘴部特征点分布

4.3 面部信息特征提取

(1)输入人脸形状77个特征点坐标:

(1)

其中,xi是第i个点的横坐标,yi是第j个点的纵坐标。

(2)初步计算。

左右眼中心垂直高度:

zy=|y36-y32|

yy=|y46-y42|

(2)

左眼左右开度分别为:

zy1=|y35-y33|

zy2=|y37-y31|

(3)

右眼左右开度分别为:

yy1=|y45-y43|

yy2=|y47-y41|

(4)

左右眼宽度分别为:

zyk=|x34-x30|

yyk=|x44-x40|

(5)

嘴巴左右开度分别为:

zk1=|y69-y68|

zk2=|y71-y66|

(6)

(3)进一步计算。

由式(2)~式(6)可以得到整体眼睛张开程度:

(7)

眼睛平均大小:

yd=(zy+yy)/2

(8)

上嘴唇与下嘴唇的垂直距离:

zk=|y70-y67|

(9)

嘴巴左右边角的水平距离:

zd=|x65-x59|

(10)

由式(6)、式(9)和式(10)可得到嘴巴张开程度:

(11)

嘴角的上下弯曲程度:

g=(y59+y65)-(y67+y70)

(12)

(4)最终输出。

根据以上160维表情特征,构成人脸特征向量表达式:

X=[x1,…,xi,…,x77,y1,…,yj,…,y77,

e,f,g,yd,zk,zd]T

(13)

5 SVM表情特征分类

本文主要采用SVM[12,13]作为表情识别的分类器。由于专注度的监督没有客观数据予以支持,所以为了训练有监督学习分类器,本文选取基于脑电波的专注度监督方式,这使得分类器的训练数据更具有客观性。支持向量机刚开始是设计解决两类分类问题,不能直接解决多类分类问题,而本文是人脸表情多类别分类问题。目前将SVM推广到多分类问题的方法主要有两种[14,15]:一种是通过设计和结合一系列的两类分类器构成多类分类器;另一种是将多个分类面的参数求解融合到一个最优化问题中,经过求解该最优化问题一并解决多分类问题。第二种方法尽管感觉简单,但在实际求解最优问题时变量远多于第一种方法,训练速度不快,而且在分类精度上也不具优势。因此,本文采用第一种多分类SVM算法。用投票法来组合这些两类分类器,所属的类由得票最多的类判定。

6 实验与结果分析

6.1 实验环境与操作

实验中共采集5个实验者的面部视频和脑电信息数据,使用的表情数据集由6 000幅200*200的图像组成,共展示了3类表情,分别为专注、非专注和中性。图片选取相对垂直方向倾角在[-15°,+15°]的基本无遮挡的正面人脸,包括不同光照条件下的图片。

所需实验环境:佰意通脑电生物反馈系统、Opencv 2.4.9、VS2010、Libsvm-3.0。

本文SVM分类器采用Libsvm软件进行训练和测试,需要将数据处理成以下指定格式:[label][index1]:[value1][index1]:[value2]…。其中,label指分类的种类,通常取一些整数。本文将表情分为3类,则label的值分别定义为1、2和3。index为顺序的索引,通常取实数。value是要训练的数据值,即各个特征点对应的坐标值,用空格隔开各数据。最后使用分类器对测试样本进行分类的结果也是通过生成label的方式。在训练表情分类器之前,为了避免由于某个特征值过大或者过小,造成在训练不平衡状况,我们将对全部数据进行归一化处理,也就是对原始样本进行缩放。归一化处理特征点,不但便于数据处理,而且能加速训练网络的收敛性。本文将缩放范围设定在[-1,1]。值得注意的是,在归一化处理过程中要将原始训练集和原始测试集作为同一个数据集来处理。

根据佰意通对专注度指标的定义“eSense专注度参数”,指示使用者当前的专注度,该参数反映了使用者当前的注意力集中程度,eSense参数以1~100的具体数值来指示用户的专注度水平。由此本文将采集到的脑电波专注度进行如下标记划分:[0,30],[30,70],[70,100],其中,[0,30]为非专注,label设为1;[30,70]为中性,label设为2;[70,100]为专注,label设为3。

实验中使用4个人的数据训练,1个人的数据测试,进行轮换训练和测试。训练和测试数据比例为4∶1,对训练数据5倍交叉验证,得到最优参数后进行训练。本文采用的表情分类器核函数为径向基函数RBF(Radial Basis Function),创建表情分类器使用核函数时,主要考虑c和γ两个参数,其中,c是惩罚系数,γ隐含地决定了数据映射到新的特征空间后的分布。因参数的选取并不具有一定的先验知识,所以要做参数搜索,以便获得最优的(c,γ)。选取适合创建本文分类器的c和γ,能使分类器更好地预测测试集数据,从而提高分类器识别率。

6.2 结果分析

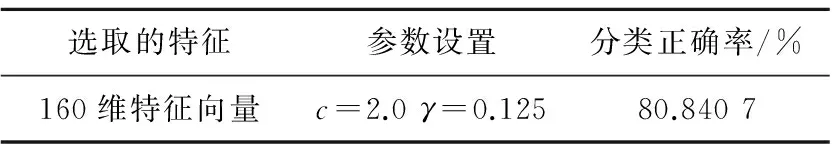

本文在实验过程中分别进行过两种分类方式的实验,首先是将专注度分为三类进行训练和测试,实验结果如表2所示。发现分类正确率十分高,经过分析主要是因为佰意通软件在专注度标记中数据条的来回波动,导致数据条经常处于过渡中间范围。数据中存在大量中性数据,三种状态数据比例相差过大,所以分类器正确率过高。

Table 2 Test results of three classes classifier

于是本文采取将中性值去掉,只保留专注和不专注的数据进行训练和测试。严格控制数据比例,只对专注和非专注状态进行分类识别,得到的结果如表3所示。

Table 3 Test results of two classes classifier

由以上分类结果可知:面部表情与专注度是存在一定的相关关系的,但为弱相关关系。本文训练的分类器正确率为65%,识别率虽然没有其他检测方法高,但是由于使用在脑电信息监督下的样本,所以包含了很多基本状态和中间状态,样本内容更为丰富实际,基本可以满足对专注度判定的要求。

7 结束语

本文主要介绍了一种利用人脸面部表情判断专注度的方法,建立了连续的人脸面部图像对应脑电信息的样本库,变化覆盖范围大,样本信息丰富,更加符合实际应用。方法上主要通过预先的脑电信息专注度来监督面部特征训练,得到面部表情对应专注度的分类器。研究完成了面部表情与专注度对应关系的建立,解决了智能化判定专注度的问题,为后续的监测评价系统提供了有力的数据支持。根据分类器的识别率,可以看出面部表情信息与专注度是存在一定的相关关系的。但是,从取得的数据结果来看,面部表情信息与专注度分类工作准确率有待提高,对于特征提取方面可以继续改进,比如加入权值进行训练。而且专注状态的判断和行为分析还有很多方面,需要后续对专注度判定行为进行更深一步的挖掘。

[1] Cristiani A,Porta M,Gandini D,et al.Driver drowsiness identification by means of passive techniques for eye detection and tracking [C]∥Proc of the 4th IEEE International Conference on Self-Adaptive and Self-Organizing Systems Workshop,2010:142-146.

[2] Liu Dang-hui,Sun Pen,Xiao Yan-qing,et al.Drowsiness detection based on eyelid movement[C]∥Proc of the 2nd International Workshop on Education Technology and Computer Science,2010:49-52.

[3] Sun Wei, Zhang Xiao-rui,Zhuang Wei,et al.Driver fatigue driving detection based on eye state [J].International Journal of Digital Content Technology & its Applications(JDCTA),2011,5(5):307-314.

[4] Ekman P,Friesen W V.Facial action coding system [M].Palo Alto,CA: Consulting Psychologists Press,1978.

[5] Ekman P,Friesen W.Unmaking the face,a guide to recognizing motions from facial expressions [M].Palo Alto,CA: Consulting Psychologists Press,1975.

[6] Ekman P.An argument for basic emotions [J].Cognition & Emotion,1992,6(3-4):169-200.

[7] Lienhart R,Maydt J.An extended set of Haar-like features for rapid object detection [C]∥Proc of ICIP 2002,2002: 900-903.

[8] Wu Ying-ming,Wang Hsueh-wu,Lu Yen-ling,et al.Facial feature extraction and applications: A review [M]∥Intelligent Information and Database Systems.Berlin:Springer Berlin Heidelberg,2012:228-238.

[9] Cootes T F,Taylor C J,Cooper D H,et al.Active shape models: Their training and application [J].Computer Vision and Image Understanding,1995,61(1): 38-59.

[10] Yu Zhi-wen, Wong Hau-san,Peng Hong,et al.ASM: An adaptive simplification method for 3D point-based models [J].Computer-Aided Design,2010,42(7):598-612.

[11] Sung J W,Kanade T,Kim D J,et al.A unified gradient-based approach for combining ASM into AAM [J].International Journal of Computer Vision,2007,75(2):297-310.

[12] Vapnik V. The nature of statistical learning theory [M].New York:Springer-Verlag,1995.

[13] Patil R A, Sahula V, Mandal A S. Features classification using geometrical deformation feature vector of support vector machine and active appearance algorithm for automatic facial expression recognition [J].Machine Vision and Applications,2014,25(3):747-761.

[14] Khan N M,Ksantini R,Ahmad I S,et al.A novel SVM+NDA model for classification with an application to face rec-ognition [J].Pattern Recognition: The Journal of the Pattern Recognition Society,2012,45(1):66-79.

[15] Owusu E,Zhan Yon-zhao,Mao Qi-rong.An SVM-AdaBoost facial expression recognition system [J].Applied Intelligence,2014.40(3): 536-545.