基于V-视差算法的自动驾驶中障碍物躲避软件设计

2018-03-06袁海根

袁 海 根

(滇西科技师范学院 信息工程学院, 云南 临沧 677000)

随着经济和人们生活水平的高速发展,汽车在人们生活中的应用价值逐渐提升.我国汽车数量大幅增加的同时,也给交通安全带来了较大威胁.因此,无人驾驶车辆的研发逐渐被相关研究人员重视.无人驾驶汽车也称为智能汽车,智能汽车根据部署在车辆中的不同传感器采集和分析道路环境信息,为汽车自主选择安全路径提供数据.但是,相关研究表明,以图像处理和模式识别技术为主的技术中,车辆对路径的选择会受到不同障碍物的干扰,影响行车安全[1].因此,采用有效的方法准确识别并躲避障碍物,成为相关人员研究的关键技术.

当前的车辆自动驾驶对障碍物的识别过程中,还存在较大的困难.以模式识别和图像处理方法为主的技术中,存在对障碍物识别定位偏差较大的问题,例如,文献[2]提出基于三维激光雷达和深度图像的自动驾驶汽车障碍物检测方法,虽然能够准确获得障碍物的深度信息,但是在其他信息获取上,存在偏差,另外,需要借助外部设备,增加了识别成本.文献[3]的轨迹规划方法能够在一定区域内躲避障碍物,但是,采用预估区域的方式造成障碍物定位不准的问题.文献[4]的识别方法虽然考虑了三维坐标的因素,但是是从空中采集,大幅度限制了其应用范围.文献[5]以无人机的角度对障碍物进行了识别,但是,这种动态性和汽车的动态性差异较大,一旦速度过快,会大幅降低算法鲁棒性.文献[6]以颜色作为特征进行识别,忽略了障碍物的三维特性,误差较大.为了解决这一问题,提出一种新的智能视觉图像自动驾驶障碍物躲避软件设计方法,实现高质量的自主导航,增强车辆的行驶安全性.

1 基于智能视觉图像的自动驾驶中障碍物的躲避

1.1 V-视差算法软件逻辑结构设计

为了解决传统的智能视觉图像视觉误差的问题,在障碍物检测过程中,建立道路V-视差图,对车辆自动驾驶中的障碍物进行检测.采用V-视差进行障碍物检测,运算简单,实用性强,在不同道路条件下都能得到很好的效果.

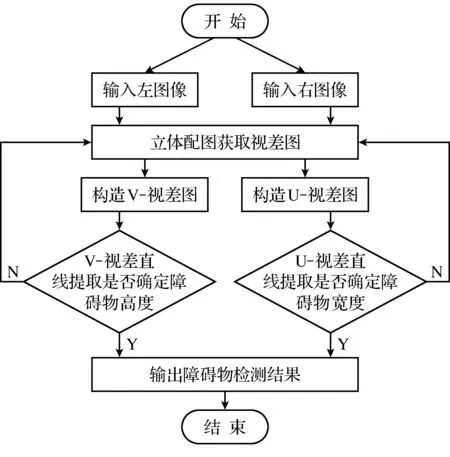

图1为智能车辆自动驾驶中障碍物检测算法逻辑流程图.车辆中的摄像头采集道路双目视觉图像后,得到道路左图像以及右图像构造道路V-视差图以及U-视差图,采用Hough变换直线拟合分别对两种视差图直线提取得到障碍物的高度和宽度,最终得到障碍物位置检测结果.

图1 障碍物检测算法软件设计流程图

(1) 构造V-视差图.V-视差图是在视差图的基础上产生的,道路视差图中颜色的深浅表示障碍物与相机间距离的远近.根据视差中的颜色信息,将每一行中具有相同视差值的像素记作countn,用(Δp,νr)表示新像素的坐标,该像素颜色的灰度为countn,宽度为256,产生高度与原图相同的新图像,该新道路图像为视差图.

在道路图像I(u,v)中,u和v分别表示该图像的横纵坐标,得出视差公式为

(1)

式中:d为视差;x1和xr表示对应点的坐标;f表示相机焦距;b表示相机基线距离;z为场景到相机的距离.

因此可得出以相机为中心的新道路图像坐标(U,V),其表达式如下:

式中:(Xw,Yw,Zw)表示该点的世界坐标;ul.r表示移动目标;θ表示相机与水平面的夹角,因此由式(3)可导出视差Δ:

(4)

由式(4)可以得出在世界坐标系的水平投影到道路V-视差图结果,可以看作一条有固定角度的直线.

(2) 障碍物平面在V-视差图中的坐标投射.现实环境中障碍物的存在形式有垂直障碍物、倾斜障碍物和道路平面.行人、车辆等都属于垂直障碍物,它们可以在原图中表示为垂直平面;斜坡、凹陷等属于倾斜障碍物,用倾斜面表示;道路平面用水平面表示.3种平面都可用V-视差图表示.

① 在理想状态下,道路可以看成是水平面,在世界坐标下

Yw=h.

(5)

根据式(3)和式(4),可得:

(6)

式(6)说明世界坐标下水平投影投射到V-视差图,其结果可当成一条有固定角度的直线.

② 垂直障碍物可表示为垂直平面.在世界坐标下

式(8)表示世界坐标下垂直障碍物投射到V-视差图,其结果可当成一条垂线[7].因为该直线是垂线,所以将sinθ看作0,因此式(8)可化简为

(9)

V-视差图中所有垂直面的视差是固定不变的,因此垂直面为一条垂直的直线.

③ 倾斜障碍物可表示为倾斜面,在世界坐标下

Zw=αYw+β.

(10)

组合式(7)~式(10),得到

p=Yw+β.

(11)

式(11)表示世界坐标下倾斜面障碍物投射到V-视差图,其结果可当成一条倾斜的直线.

(3) V-视差图下障碍物的检测.V-视差图的检测过程是对同一行中相同的视差值的点进行检测,原图中的平面进行V-视差图投射形成一条直线,就是将原图中障碍物和路面投射成直线.转换过程将平面检测转变成线段的检测,检测过程得到简化[9].因此对V-视差图障碍物的检测过程只需要获取V-视差图中的直线,从直线的位置即能确定路面和障碍物所在的位置.

本文进行障碍物检测的算法基于Hough进行直线检测,这种算法在保证检测效果的同时还可以保证检测出直线能通过拟合[10],方便车辆对障碍物进行躲避.

1.2 障碍物避障算法软件设计

基于以上获取的障碍物位置,设计障碍物避障方案,实现智能车辆自动驾驶中障碍物的成功躲避[11],具体的过程如下.

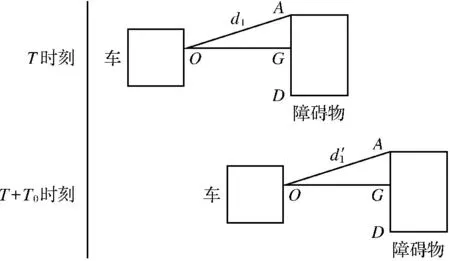

(1) 障碍物在车辆行驶的方向上直线运动,根据车速和T0时间内车与障碍物的2次距离求出车辆相对于障碍物的速度,如图2所示.车辆相对障碍物的速度分为2种:障碍物的运动速度大于车速,车辆无需避让,正常行驶即可;障碍物运动速度小于车速[12],按照下文障碍物躲避方法进行避让.

图2T0时间间隔车辆与障碍物的距离

Fig.2 The distance between the vehicle and the obstacle at time interval ofT0

采用维氏硬度计(FUTURE-TECH/LC-200RB)测量断裂行星齿轮轴的表面硬度、基体硬度,检测前先用标准试块进行校准;对断裂轴的断口进行金相取样,经镶嵌、打磨、抛光、腐蚀后,采用光学显微镜(ZEISS/HAL100)进行显微金相组织检测,结果如表2所示,表面硬度、基体硬度、氮化层深、氮化物和脆性级别等均符合技术要求,但表面疏松达到4级,不符合技术要求,这直接导致零件表面强度下降,在使用过程易产生裂纹,降低零件的疲劳寿命。

(12)

计算图2中AG和GD间的距离,由此判断车辆从哪个方向超车.

一种情况下AG>GD,车辆遵循图2所示进行躲避,假设车辆宽度为2b,长为2l,车辆与障碍物的相对距离为

(13)

式中λ表示安全系数,通常为1.2.则车辆行驶时间为

(14)

车辆躲避障碍物的转弯角和车辆行驶距离为

行驶时间t2为

(17)

车辆躲避障碍物,回到原始行驶路线,转弯角θ2=-θ1,行驶时间t1=t2.

由上文可得,障碍物与车辆行驶方向相同时,车辆以v相对行驶,右方向转角θ1,行驶t1时间;接着以v相对行驶t2时间;最后以v相对左方向转角θ1,行驶t1时间,回到原始行驶路线.

另一种情况是AG≤GD,按照上文步骤进行障碍物躲避.

(2) 障碍物在车辆行驶的方向上横向运动,假设障碍物以v障向左行驶,根据图2中车辆对静态障碍物的躲避[13],得出无论AG和GD大小如何,车辆只能向右躲避,车辆长2l,宽2b,当车辆刚绕过障碍物时,二者行驶关系如下:

(18)

当v障>v车,行驶时间为

(19)

当v障 (20) 转弯角为 (21) 综上可得,车辆面对向左方向行驶的动态障碍物,车辆以v0向右转向θ1,行驶t1时间;再以v0向左转θ1,行驶t1时间,回到原来的行驶路线[14].当障碍物向右行驶时,车辆的躲避方式一样,只是方向不同. 为验证本文方法对智能车辆自动驾驶中障碍物躲避的有效性,进行相关的实验分析.实验基于某实验室内路面的稠密视差,构建智能车辆运行路面的V-视差图和U-视差图,并对其进行Hough直线拟合,结果用图3和图4描述. 图3 V-视差图和其直线提取结果 Fig.3 V-disparity map and its straight line extraction results (a)—V-视差图; (b)—V-视差图直线提取结果. 图4 U-视差图及其直线提取结果 Fig.4 U-disparity map and its straight line extraction results (a)—U-视差图; (b)—U-视差图直线提取结果. 基于V-视差图以及U-视差图采集获取的直线,对实验室内锥形桶和两个纸箱障碍物的高度以及宽度进行标定,垂直线同斜线的交点是障碍物的位置,最终实现障碍物的检测, 分析上图中的检测结果可得,本文提出的基于V-视差的自动行驶中障碍物检测方法,可准确检测出智能车辆行驶过程中遇到的障碍物,准确检测出锥形桶和两个纸箱. 图5给出了本文方法下的智能小车动态避障路径规划结果.能够看出本文提出的基于智能视觉图像的自动驾驶中障碍物躲避方法,能够及时、稳定地形成智能小车运动最优避障路径,具有较高的动态避障性能,自主导航功能强. 为了检测本文方法在实际环境中的可行性,将Data set数据集内的数据当成数据对象,让某种型号的智能小车,在150 m×150 m的道路实施避障实验.实验公路中存在较多的树木,实验区域中存在140个障碍物.实验设置智能小车的速度噪声和角度噪声分别是σs=0.1 m·s-1和σr=2°,检测硬件是2.26 GHz,Intel Core i5 CPU,4 GB内存,实验结果用图6描述. 对比分析图6可得,通过传统基于地理门槛的障碍物躲避方法,智能车开始阶段远离真实路径,在中间阶段回到真实路径后又不断偏离真实路径,总共偏离真实路径12次,对周围环境和路径的识别准确率较低.而本文方法共偏离真实路径2次,并且偏离幅度较低,可在较低的时间内回归到实际路径[15],大部分时间内同真实路径相一致,说明本文方法对避障路径及对周围环境的识别准确率较高,能够大范围长时间使用,在自动驾驶中的障碍物检测和躲避过程中,具有较高的应用价值. 图5 动态避障路径规划结果Fig.5 Dynamic obstacle avoidance path planning results(a)—初始状态; (b)—运动状态1; (c)—终止状态. 图6 本文方法Fig.6 Method of this article 实验过程中将2种方法分别运行30次,对比2种方法的识别准确度和运行耗时,结果用图7和图8描述.分析图7能够看出,采用传统基于地理门槛的机器人障碍物躲避方法过程中,识别障碍物的平均准确度率72.1%,在10~20次实验时识别准确度呈现大幅度的降低趋势,20~30次实验时识别准确度出现小幅度上升趋势.采用本文方法识别障碍物的平均准确率是92.3%,比地理门槛方法高20.2%,并且随着实验次数的不断提升,本文方法的识别准确率也逐渐提升,具有较高的优势. 图7不同方法的识别准确度对比图 图8 不同方法的运行耗时对比图 分析图8能够看出,传统基于地理门槛障碍物躲避方法的智能小车在自动驾驶过程中的运行平均耗时是73 min,在第10~20次实验过程中平均运行耗时呈现大幅度提升趋势,而本文方法下的智能小车在自动驾驶过程中的平均运行耗时是34 min,并且随着实验次数的提升,本文方法的运行耗时提升幅度较低,本文方法的平均运行耗时比地理门槛方法少39 min,说明本文方法具有较高的鲁棒性. 文章提出的基于智能视觉图像的自动驾驶中障碍物躲避方法,采用智能视觉图像技术中的V-视差图像,通过Hough变换直线拟合采集V-视差图和U-视差图中的直线,获取障碍物的位置,采用合理的障碍物避障方案,实现障碍物的准确、高效躲避. [ 1 ] 周慧子,胡学敏,陈龙,等. 面向自动驾驶的动态路径规划避障算法[J]. 计算机应用, 2017,37(3):883-888. ZHOU H Z,HU X M,CHEN L,et al. Dynamic path planning for autonomous driving with avoidance of obstacles[J]. Computer Application, 2017,37(3):883-888. [ 2 ] 王新竹,李骏,李红建,等. 基于三维激光雷达和深度图像的自动驾驶汽车障碍物检测方法[J]. 吉林大学学报(工学版), 2016,46(2):360-365. WANG X Z,LI J,LI H J,et al. Obstacle detection based on 3D laser scanner and range image for intelligent vehicle[J]. Journal of Jilin University (Engineering and Technology Edition), 2016,46(2):360-365. [ 3 ] 梁广民. 一种新的自动驾驶轨迹规划方法[J]. 电子科技大学学报, 2017,46(4):600-606. LIANG G M. Novel trajectory planning method for autonomous driving[J]. Journal of the University of Electronic Science and Technology, 2017,46(4):600-606. [ 4 ] 汤一平,王伟羊,朱威,等. 基于机器视觉的茶陇识别与采茶机导航方法[J]. 农业机械学报, 2016,47(1):45-50. TANG Y P,WANG W Y,ZHU W,et al. Tea ridge identification and navigation method for tea-plucking machine based on machine vision[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016,47(1):45-50. [ 5 ] 卢清秀,陆兴华. 无人机快速逃逸过程中障碍物自动识别仿真[J]. 计算机仿真, 2015,32(5):51-54. LU Q X,LU X H. Unmanned aerial vehicle (UAV) rapid escape obstacles in the process of automatic identification simulation[J]. Computer Simulation, 2015,32(5):51-54. [ 6 ] 张开冉,邱谦谦,王若成,等. 驾驶员雨中面对不同颜色障碍物时制动点选择研究[J]. 中国安全科学学报, 2015,25(3):90-95. ZHANG K R,QIU Q Q,WANG R C,et al. Research on breaking point selection for driver encountering different color obstacles in the rain[J]. China Safety Science Journal, 2015,25(3):90-95. [ 7 ] KANG Y,LIMA D A D,VICTORINO A C. Dynamic obstacles avoidance based on image-based dynamic window approach for human-vehicle interaction[C]∥Intelligent Vehicles Symposium. IEEE, 2016:77-82. [ 8 ] FANG M C,WANG S M,WU M C,et al. Applying the self-tuning fuzzy control with the image detection technique on the obstacle-avoidance for autonomous underwater vehicles[J]. Ocean Engineering, 2015,93:11-24. [ 9 ] WU C H,JUANG J G. Application of image process and fuzzy theory to dynamic obstacle avoidance for an autonomous vehicle[C]∥Proceeding of National Symposium on System Science and Engineering, 2010. [10] MAN D W,KI H S,KIM H S. Collaborative obstacle avoidance method of surface and aerial drones based on acoustic information and optical image[J]. Transactions of the Korean Institute of Electrical Engineers, 2015,64(7):1081-1087. [11] 赵艳辉,闫亮,张公平. 基于切换增益变结构控制的导弹自动驾驶仪设计[J]. 弹箭与制导学报, 2016,36(5):1-4. ZHAO Y H,YAN L,ZHANG G P. Missile autopilot design based on switching-gain variable structure control[J]. Journal of Missile and Guidance, 2016,36(5):1-4. [12] 辛煜,梁华为,梅涛,等. 基于激光传感器的无人驾驶汽车动态障碍物检测及表示方法[J]. 机器人, 2014,36(6):654-661. XIN Y,LIANG H W,MEI T,et al. Dynamic obstacle detection and representation approach for unmanned vehicles based on laser sensor[J]. Robot, 2014,36(6):654-661. [13] MAN D W,KI H S,KIM H S. Collaborative obstacle avoidance method of surface and aerial drones based on acoustic information and optical image[J]. Transactions of the Korean Institute of Electrical Engineers, 2015,64(7):1081-1087. [14] MODI H,NIRAV V S,MALAV H S. Obstacle avoidance system in autonomous ground vehicle using ground plane image processing and omnidirectional drive[C]∥International Conference on Computing Communication Control and Automation. IEEE, 2015:594-601. [15] GUO J,HU P,WANG R. Nonlinear coordinated steering and braking control of vision-based autonomous vehicles in emergency obstacle avoidance[J]. IEEE Transactions on Intelligent Transportation Systems, 2016,17(11):3230-3240.2 实验分析

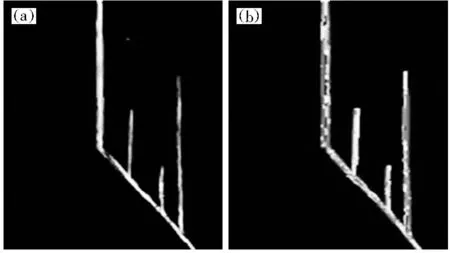

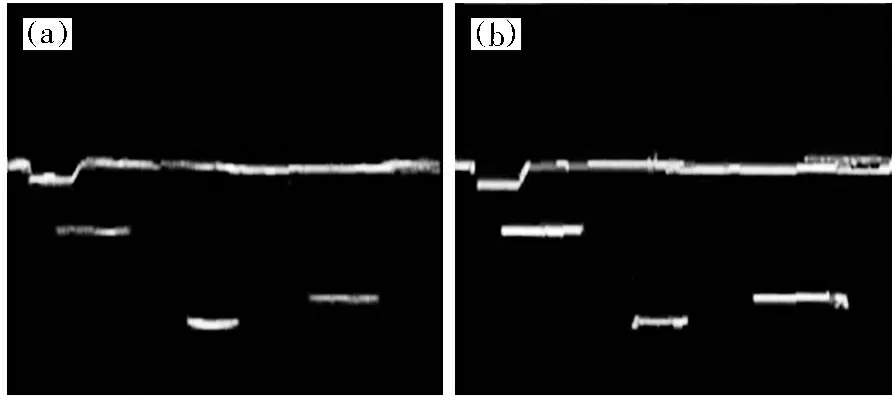

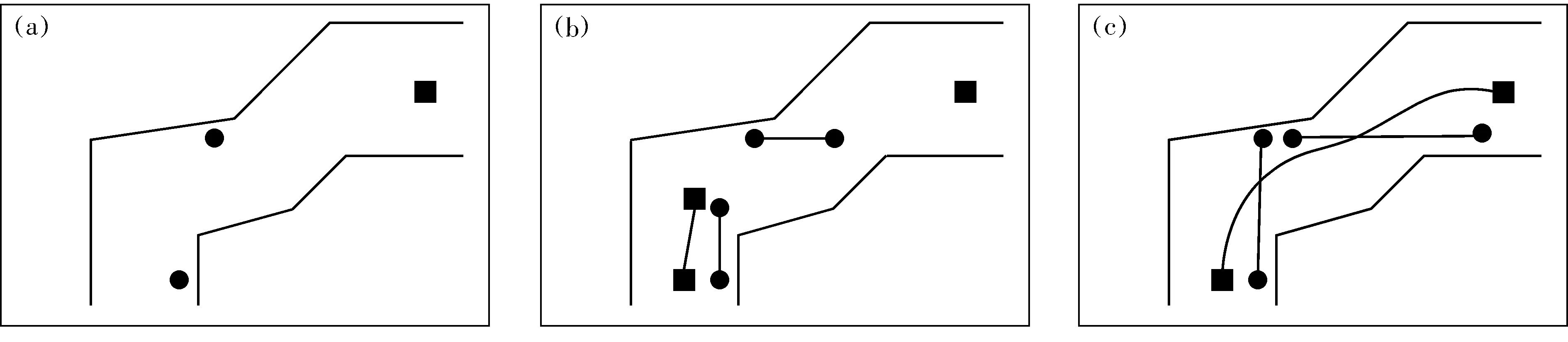

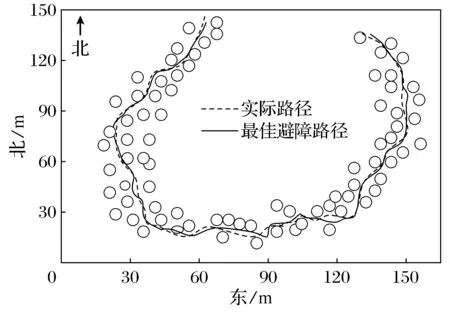

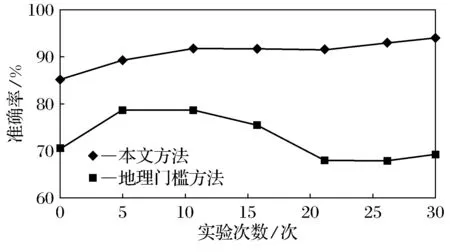

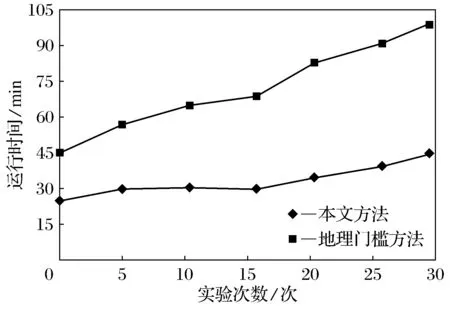

3 结 论