基于显著性检测的协同图像分割研究

2017-09-30李然李记鹏宋超

李然,李记鹏,宋超

基于显著性检测的协同图像分割研究

李然1,李记鹏1,宋超2

(1.四川大学计算机学院,四川 610065;2:95666部队)

传统的图像分割往往是从一幅图像中分割出显著性目标,但是随着视觉领域和人工智能的不断发展,对于分割的精度也有了更高的要求,为了提高对象分割的精度,可对多幅相似图像的显著性进行综合分析,利用它们之间的关联性与一致性,准确协同分割这些相似对象。多幅图像协同分割(简称协同分割)是近年来图像分割领域研究的热点和难点。设计一种基于视觉显著性检测的协同图像分割系统,在得到每幅图像的显著性区域以后,综合考虑多幅相似图像的显著性,构建用于图割的GMM,然后使用图割算法对每幅图像进行分割,最终得到相似对象分割结果。采用FlickrMFC数据库中的部分图像作为实验对象,并对实验结果进行较深入分析,总结未来进一步的研究方向。

显著性检测;协同分割;高斯混合模型;图割

0 引言

显著性检测作为计算机视觉中的一个研究方向是在模仿人类视觉系统中所产生的检测技术。随着计算机视觉技术的发展,有时需要利用多幅相似图像之间的一致性,检测出所包含相似对象,从而提高对象分割的精度,这一问题的提出促使协同图像分割技术的产生。实验证明采用协同图像分割技术对图像集进行处理要比单幅图像逐个处理的效果好,而且该方向仍具有较大的发展空间和应用价值。

目前关于图像的协同分割算法常见的问题是分割准确度与算法速度不可兼得,通常为了保证分割的准确度,可选用监督分割方法,但是这常常需要大量人工标记的训练集,不仅费时还不具有自动性;为了提高分割算法的执行效率,可采用半监督或者非监督的分割方法,但是由于缺乏上下文相关信息,分割的准确度通常会下降。本文引入图像的显著性检测技术,进行图像的协同分割,力求在保证准确度的前提下,在算法速度上取得一定突破。

1 方法

1.1 显著性检测方法

对比分析法是研究视觉显著性的常用方法,目前基于对比实现的显著性方法大致可以分为基于局部对比的方法和基于全局对比的方法两类。

(1)直方图对比方法

该方法是一种基于全局对比的显著性检测模型,该模型首先通过颜色直方图的对比方法计算像素级别的显著性特征值,为了减少颜色空间的量化所产生的误差,在得到像素的显著值之后进行一次平滑处理,得到最终的直方图对比显著图即HC maps(Histogram Contrast maps)。

直方图对比方法通过对输入图像的颜色进行统计,最终得到一个颜色直方图,然后使用该图定义图像中任意一点的显著性值。假设图像I中共有n像素点,我们使用Ik表示第k个像素点,S(Ik)表示该点的显著性值。则

其中D(Ik,Ii)表示图像I中第k个像素点与第i个像素点之间在lab颜色空间的距离,之所以使用lab空间是为了提高算法在视觉感知上的准确性。将公式(1)展开后我们可以得到公式(2):

由公式(2)我们可以很容易的得到如下结论即具有相同的颜色值得像素点的显著性值相同。因此我们可以将计算像素点的显著性值转化为计算图像中各个不同的颜色值的显著性值。假设图像I中共有m个不同的颜色值,如果我们用Cl表示第l个颜色值,则:

其中S(Cl)表示第l个颜色的显著性值,pi表示第i个颜色在图像I中的概率。通过公式(3),我们可以计算出各个颜色的显著性值,进而得到各个像素点的显著性值。

至此我们得到了计算图像显著性信息的两种方法,我们既可以采用公式(1)计算,同时也可以采用公式(3)计算。由公式(1)我们很容易得到计算显著性的时间复杂度为O(n2),如果我们使用公式(3)计算显著性首先我们需要得到各个颜色在图像I中的概率,即计算图像的颜色直方图,该操作的时间复杂度为O(n),然后我们使用颜色直方图计算各个颜色的显著性值,该操作的时间复杂度为 O(m2),因此 O(n)+O(m2)是使用公式(3)的时间复杂度。如果m2远小于n,则采用公式(3)的时间复杂度可以近似看为O(n),此时该算法的效率非常理想。然而实际输入的RGB图像I的颜色数目是2563,该数目远远大于图像I的像素数目n,因此我们需要减低图像I的颜色空间的数目。

首先我们对每个通道进行量化处理,得到12各个量化级,此时颜色数量降到123个,考虑到一般的自然图像中有好多颜色使用的概率较小,我们将量化以后使用最为频繁的颜色挑选出来并确保这些颜色在图像I中所对应的像素数目站到95%以上,剩余的不足5%的像素点,我们将其对应到挑选出来的颜色集合中与其距离最近的颜色。通过该方法我们可以保证在近似为线性时间复杂度的情况下计算出图像I的显著性信息。

通过分析可知我们使用基于颜色直方图对比的方法计算图像显著性信息时,需要对图像的颜色进行量化处理,然后才能计算显著性值。由于在对图颜色进行量化处理时会将相近的颜色分到不同的量化级中,会产生一定的量化误差,为了减小该误差的影响我们需要在图像I的颜色空间进行一次平滑处理。对于图像I中任意一个颜色c,我们选取距离它最近的m个颜色c1,c2,c3,…,cm的显著性值取加权平均值作为颜色c最终的显著性值,用wi表示第i个颜色的权值的得到如下公式:

实验表明对使用公式(3)计算出来的显著性值使用公式(5)进行一次平滑处理可以得到效果更佳的显著性信息。

(2)基于区域对比方法

在该方法中,首先我们将待检测图像I采用超像素方式分割成许多较小的区域,假设我们一共分割出n个区域,ri表示第i个区域,S(ri)表示该区域的显著性值则

其中wk是与rk的像素数目有关的一个权重值,如果rk中的像素数目多,其对应的权值更大,以强调与较大区域的颜色对比,D(ri,rk)表示两个区域之间的颜色距离,

公式(7)中n1,n2分别表示区域ri,rk中颜色的数量,pi,jpk,m分别表示第i个区域中的第j个颜色,第k个区域的第m个颜色,D(ci,j,ck,m)表示两个颜色之间的距离。然而公式(6)在进行显著性计算时没有考虑到区域之间的距离关系,因此会有一定的误差,将距离信息融入到公式(6)中,我们可以得到更加合适的显著性值:

其中Ds(ri,rk)表示两区域之间的距离,在公式(8)中一共有两个权值,一个与区域rk中的像素数目有关,一个与区域rk和待检测区域ri之间的空间距离有关,而参数σ的大小可以控制两个权值的相对比重。ws(ri)可以看做是待检测区域显著性值的一个调整参数,在具体实现时,实现将所有的像素坐标的模值调整到[0 1],然后计算区域ri中的所有像素点到图像中心的距离,求其平均值记为dk,取ws(ri)=exp(-9dk2),并取σ2=0.4。

在使用公式(8)计算出来各个区域的显著性值以后,再经过两个步骤可以得到最终的基于区域对比的显著性图,首先我们利用之前使用的空间关系估计出图像中所有非显著性区域,然后使用公式(5)在颜色空间进行一次平滑处理减小误差。

1.2 协同分割方法

目前关于图像协同分割的方法大致可以分为基于交互、训练的协同分割方法和非监督式协同分割方法。文献[5]描述了完全非监督的分割方法一般依赖于局部图像特征,因此缺少必要的上下文信息,以准确地把图像分成同质的区域(Coherent Regions)。另外一方面监督图像分割方法能够得到较好的结果,但常常需要大量人工标记的训练数据集。不仅训练数据比较费时,收集比较乏味,而且大部分训练集只是几个数量级的,相对于人类识别水平还是太少了。该文献所提出的方法流程大致为:首先进行全局图像聚类,然后进行多级超像素分割;完成预处理步骤,构建规范化拉普拉斯算子矩阵(Normalized Laplacian Matrix),使用多级超像素加以限制,并使用图像间和图像内的链接进行加权;最后使用有效的优化方法解决前K(=2)拉普拉斯矩阵的特征向量问题。文献[6]所提方法不同于其他方法,在对象检测方面,并没有使用显著性初始分割,而是使用的共享区域的统计显著性(Statistical Saliency),这样的好处是可以避免一些协同对象在他们所在的图像中并不是显著的。为了处理尺度不变性,该方法先生成原始图像的多尺度图像,然后利用检测方法检测所有尺度的图像。对于相似场景的情况,这种方法不太合适,因为背景和对象在多幅图像都非常相似,所以用统计的方法不能简单确定出对象来。

1.3 基于显著性的协同分割的实现

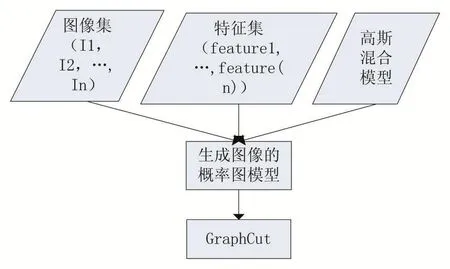

实现图像的协同分割大致可以分为三个步骤,首先对待分割的图像集使用1.1的方法进行显著性检测,得到每幅图像的显著性映射图,然后将其值调整到[0,255],取固定的阀值T=70,将每幅图像分割成前景,背景两部分。然后将所有图像的前景区域,背景区域分别融合构建前景、背景的高斯混合模型,最后使用图割算法对所有图像进行协同分割。

(1)构建高斯混合模型

高斯混合模型在工程领域具有广泛的应用,EM(Expectation Maximum)算法是训练高斯混合模型的传统方法,后来随着机器学习的兴起于发展,相关学者将聚类分析算法与EM算法有机的结合起来提出了一种基于聚类分析的高斯混合模型的构建方法。我们在进行协同分割时,首先提取像素级别的特征,然后将所有图像的前景区域特征、背景特征分别放在一起构建用于图割的高斯混合模型。

图1 高斯混合模型建立流程图

(2)协同分割流程

图割算法是建立在图论基础上的一种交互式图像分割算法,将图像的分割问题转化为带权无向图的切割问题,理论证明通过求解无向图的最小分割可以得到原始图像的最佳分割即能量最小化分割。传统的图割算法是需要用户干预的,首先由用户大致指定图像中的前景区域,在这一硬性的约束下求解图的最大流得到能量最小化分割结果。本文中由于已经对图像进行了显著性检测,所以可以直接将显著性检测的结果用于图割,分割具体实现步骤如下:

①对于输入的图像I1,I2,I3,…,In分别使用基于区域对比的方法进行显著性检测,得到显著性结果S1,S2,S3,…,Sn;

②分别提取图像I1,I2,I3,…,In像素级别的特征例如lab颜色特征、稠密sift特征,并根据显著性检测结果分别建立5个组件的前景、背景的高斯混合模型;

③对于每幅图像,使用建立好的高斯混合模型求解概率图,并使用图割算法求解其最终的分割结果。

图2 分割流程图

2 实验结果与分析

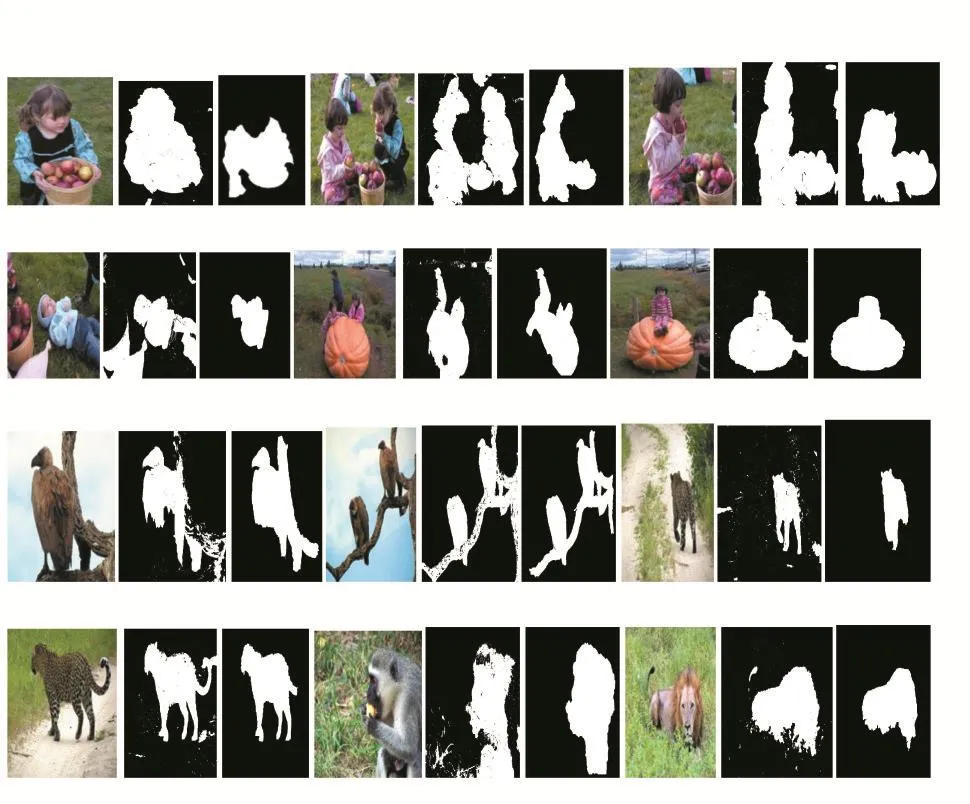

本文首先对比了协同分割和独立分割的实验结果,然后把基于全局的直方图对比和基于区域的对比方法用于协同分割,分析比较两种显著性检测用于协同分割的效果。

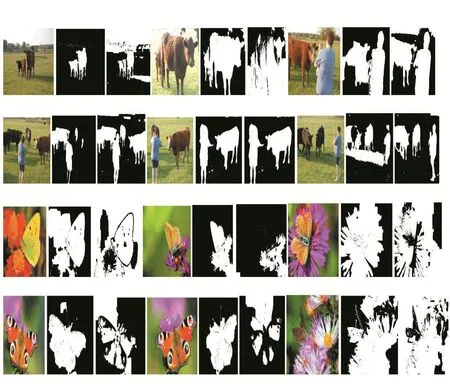

图3 分割方法对比实验图

通过使用FlickrMFC数据集中的部分图像对协同分割算法进行测试,我们发现当对一个图像相似性较强的图像集进行分割时,协同图像分割能够得到更加准确的分割结果,因为协同分割算法建立分割模型时,不仅考虑图像自身的显著性信息,还会考虑该图像与其余图像的关联性、一致性,进而使用整个图像集的显著性进行建模。对于第四组图片而言,使用传统的分割算法进行分割时,只能分割出小孩,事实上苹果相对于整个图像集而言也是非常重要的对象;在第一组图像中,苹果以及人物都是重要的分割对象,当我们使用协同分割算法进行分割时,综合考虑图像集的显著性,比较准确的分割出了所有的前景,但是当我们独立分割该图像时,却只能得到部分前景信息。经过在Flick⁃rMFC数据集上的测试,我们发现当待分割的图像集中的图像就有较高的相似性时,使用协同图像分割算法可以得到更加符合实际的结果,随着图像集合相似性的降低协同分割的准确度会逐渐降低,当图像集的相似性非常低时,独立分割图像可能会得到更加准确的效果。当我们在选用分割算法时,除了图像之间的相似性外,图像中显著性区域的分布也是应该考虑的因素,当图像中的显著性区域相对比较集中时,尽管图像之间的相似性较高,我们独立分割图像也可以得到理想的效果,有时甚至可以得到比协同分割更好的结果。

图4 基于两种显著性检测方法的协同分割图

除了将协同图像分割与传统的图像分割算法进行对比分析以外,我们还将基于直方图对比的检测结果和基于区域对比的检测结果分别用于协同分割。分析实验结果我们发现基于直方图对比的图像显著性信息用于协同图像分割时,分割结果的错误率有所上升即背景标记为前景以及前景标记为背景的几率增大了。实际上,基于直方图对比的方法在进行显著性检测时就具有一定的不合理性,首先以像素为基本单位进行检测不符合生物的视觉注意机制;其次在计算像素显著性时考虑的因素太少,所以我们使用该方法检测的图像显著性信息不准确甚至会出错,即将主要的显著性区域标记为次要区域,这也是将其用于协同分割错误率上升的原因。为了得到更加准确的协同分割结果,我们选取显著性检测方法时首先应该以区域为基本单位检测显著性以更好的符合视觉注意机制;其次应该将影响显著性的因素如颜色、距离、强度考虑完善;最后综合考虑图像集中每幅图像的显著性信息进行联合显著性检测。

3 结语

本文通过研究图像的显著性检测方法,了解了对象检测在计算视觉中的重要意义,该技术是机器视觉领域的一项基础技术,同时也是保证对象分割准确性的重要前提。通过实验对比分析,我们发现使用基于区域对比的显著性检测方法可以得到更加准确的显著图。同时本文将显著性检测的结果用于协同分割,利用多幅图像之间的关联性、一致性准确协同分割这些相似的对象。将实验结果与传统的单幅图像独立分割的结果进行比较发现协同分割对于相似性较高的图像集具有更好的分割效果。协同分割进一步的研究方向首先应该注重分割准确度的提高,在建立高斯混合模型时我们可以通过训练找到最适合前景、背景的参数;其次为了提高协同分割的效率,我们后续应该引入超像素技术。

[1]张艳邦,陈征,张芬,汪熊,彭朝洋.基于颜色和纹理特征的显著性检测算法.计算机应用研究,2015:284-290.

[2]张巧荣,冯新扬.利用视觉显著性和粒子滤波的运动目标跟踪.中国图象图形学报,2013:515-522.

[3]江晓莲,李翠华,李雄宗.基于视觉显著性的两阶段采样突变目标跟踪算法.自动化学报,2013:1098−1107

[4]罗雷,蒋荣欣,田翔,陈耀武.融合颜色与运动信息的视频显著性滤波器.华中科技大学学报(自然科学版),2014:81-85

[5]Kim E,Li H,Huang X.A Hierarchical Image Clustering Cosegmentation Framework.In:IEEE Conference on Computer Vision and Pattern Recognition.IEEE,2012:686-693.

[6]Faktor A,Irani M.Co-Segmentation by Composition.In:IEEE International Conference on Computer Vision.IEEE,2013:1297-1304.

Design and Implementation of Image Cosegmentation System Based on Saliency Detection

LI Ran1,LI Ji-peng1,SONG Chao2

(1.College of Computer Science,Sichuan University,Chengdu 610065;2.95666 Army)

The typical targets of image segmentation are usual some salient objects in a single image.However with the constant development of com⁃puter vision and artificial intelligence,puts forward a higher requirement to precision of object segmentation.To achieve this target,we need comprehensive analysis of the salient objects in these images and then segment the objects with similar or same features in these imag⁃es.In recent years this has been a popular and challenging topic about image segmentation namely multiple foreground segmentation and we call it as image cosegmentation.The cosegmentation method proposed is based on saliency detection.It takes all salient regions into con⁃sideration after getting salient regions of each image to build the Gaussian Mixture Model(GMM)used in the process of graph cut algo⁃rithm.Finally,after experimenting with Flickr image database,compares the outcomes of our method with the outcomes of single image seg⁃mentation method and analyzes the advantages and disadvantages of the proposed method to get the further research direction of this topic.

Saliency;Detection;Co-Segmentation;Gaussian;Mixture Model;Graph Cut

1007-1423(2017)24-0019-05

10.3969/j.issn.1007-1423.2017.24.005

李然(1988-),云南宣威人,本科(硕士在读),助理工程师,研究方向为计算机视觉

李记鹏(1994-),河南夏邑人,本科(硕士在读),研究方向为计算机视觉

宋超(1983-),山东泰安人,硕士,助理工程师,研究方向为指挥自动化

2017-06-02

2017-08-10