喷杆式施药机对行喷雾控制系统设计与试验

2017-03-16翟长远蔡吉晨

张 波,翟长远,蔡吉晨,杨 硕,王 秀

(1.西北农林科技大学 机械与电子工程学院,陕西 杨凌 712100;2.北京农业智能装备技术研究中心,北京 100097;3.国家农业智能装备工程技术研究中心,北京 100097;4.农业部农业信息技术重点实验室,北京 100097;5.农业智能装备技术北京市重点实验室,北京 100097)

喷杆式施药机对行喷雾控制系统设计与试验

张 波1,2,翟长远1,2,蔡吉晨2,5,杨 硕1,2,王 秀2,3,4

(1.西北农林科技大学 机械与电子工程学院,陕西 杨凌 712100;2.北京农业智能装备技术研究中心,北京 100097;3.国家农业智能装备工程技术研究中心,北京 100097;4.农业部农业信息技术重点实验室,北京 100097;5.农业智能装备技术北京市重点实验室,北京 100097)

针对现有大田喷杆式施药机喷雾过程中喷头无法精准对行喷施造成农药浪费的问题,基于机器视觉技术设计了喷杆式施药机对行喷雾控制系统。该系统包括作物行中心线位置提取上位机软件和电动喷杆控制系统,利用工业相机获取作物行RGB图像,采用G-R>T&G-B>T算法及形态学处理实现作物行分割,基于改进的垂直投影法获取作物行中心线,利用坐标系转换实现将作物行中心线位置信息转化为喷杆横向偏移量,并经RS232串口传输至ATMega16控制器,控制推杆电机带动喷杆在滑轨上左右移动,借助位移传感器实时监测喷杆移动距离,以实现作物行追踪和对行喷雾控制。实验室和田间试验表明:改进的作物行中心线提取算法平均耗时12.51ms,喷杆横向偏移量计算误差小于0.44cm;电动喷杆右移最大误差0.3cm,左移最大误差0.5cm;小车速度为0.26m/s时,对倾角为5°、10°、15°模拟作物行的最大对行误差分别为3.22、2.86、2.51cm;小车速度为0.24m/s,最大偏移14.02cm时,对田间玉米幼苗的对行喷雾最大误差为4.86cm,为实现作物行追踪和对行喷雾控制提供了一种有效的解决方案。

喷杆式喷雾机;对行喷雾;机器视觉;中心线提取;相机标定

0 引言

农药的使用是防治病虫草害、提高粮食产量的重要手段,而喷杆式喷雾已成为大田施药作业的主要方式[1-3]。作物封田后普遍采用宽角度喷头对大田进行全覆盖喷雾,针对厚冠层作物增加风幕系统辅助以穿透作物冠层[4-6],降低了药液飘移,提高了农药利用率。但幼苗期宽行距作物,采用全覆盖式喷雾大量药液会喷施到行间土壤中,造成巨大农药浪费和环境污染,如果根据行距手动安装低流量喷头则无法保证作物位于喷雾范围之内。

针对目前喷雾机靶标外喷施问题,学者通过增加对靶控制系统实现精准喷雾以降低田间靶标外药液沉积。刘雪美等设计了喷杆喷雾精确对靶施药系统,通过沿喷杆方向安装超声波测距传感器探测有效靶标,控制电磁阀开关进行精确对靶施药,有效节省药液30%左右[7];宋淑然等将类似的控制系统应用于果园对靶喷雾中以提高靶标上雾滴沉积率[8]。但这些控制系统只通过电磁阀开闭控制喷雾时间,没有追踪喷雾对象。大田宽行距作物实施精准对靶喷雾还需要实时调控喷杆的位置以追踪作物行对象,实现对行喷雾作业。

近年来,国外内研究学者发现利用机器视觉技术对早期幼苗作物实施对行喷雾作业可有效提高农药使用率,减少环境污染。中国农业大学张漫等研究了GPS与视觉导航相结合的多传感器组合导航定位系统,并将粒子群、遗传等算法用于导航基准线提取,取得了良好的效果[9-13];Hossein Behfar等利用灰度直方图和Hough直线检测实现对作物行中心线的提取[14];N.D.Tillett等与农机公司Ganford合作设计了基于机器视觉的对行控制系统,通过提取作物行中心线控制液压回路移动作业机具实现除草、喷雾作业等,具有较高的准确性[15];Bjorn Astrand等为农田作业机械设计了对行控制系统,利用Hough变换识别作物行,并将该系统应用于除草机械与作业机器人上,证明该系统能适用于不同宽度作物[16]。目前,国内农场采用精量播种机进行大田播种,苗期作物行平且行距相等,使对行窄角度精准喷雾成为可能。

本文基于机器视觉技术设计一种喷杆式喷雾机对行喷雾控制系统,为实现作物行实时追踪和对行喷雾控制提供一种解决方案。

1 对行喷雾控制系统设计

1.1 电动喷杆机械结构设计

电动喷杆机械结构如图1所示。喷杆总长度为140cm,下方可安装喷头,它的伸展和收拢可以通过伸缩推杆电机进行控制;滑块与喷杆连接,使其可以在对行推杆电机带动下在滑轨上左右移动;位移传感器可以实时采集对行推杆电机的伸缩长度。

1.喷杆 2.滑轨 3.对行推杆电机 4.滑块 5.位移传感器 6.伸缩推杆电机

1.2 控制系统设计

基于机器视觉的喷杆式施药机对行喷雾控制系统整体结构如图2所示。

图2 控制系统整体结构图

工作时,由MV-VD030SC工业相机(维视图像公司)采集的作物行RGB图像经USB传输至笔记本电脑,上位机软件实时计算喷杆横向偏移量并经RS232串口传输至下位机控制器(ATMega16控制板);下位机控制器通过AQMH2403ND电机驱动模块(成都爱控电子科技有限公司)控制推杆电机左右移动,WXY15M-400-R1N位移传感器(台州市椒江西域电子厂)实时地将推杆电机伸缩长度反馈给下位机控制器,从而精确控制喷杆移动位置;速度传感器(E6B2-CWZ6C1000P相对式编码器,欧姆龙公司)实时采集作业行驶速度,从而计算喷杆横向偏移延时时间。工业相机采集图像尺寸为640×480;推杆电机最大行程为30cm,最大伸缩速度为9cm/s。

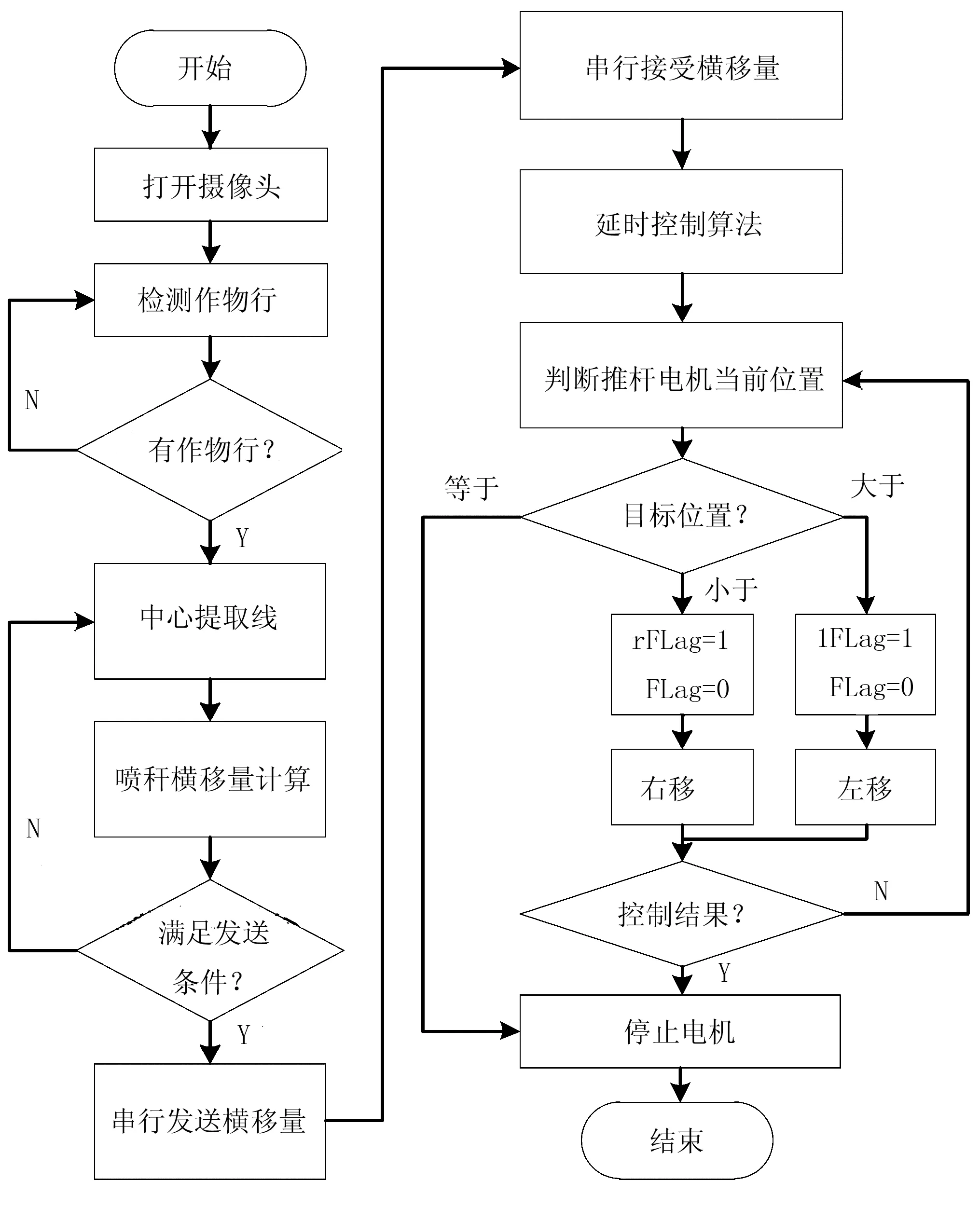

系统程序流程图如图3所示。

图3 系统程序流程图

系统开启后,首先由相机检测是否存在作物行,如果存在则对作物行进行中心线提取及喷杆横向偏移量计算,为避免频繁启停损坏直流推杆电机,对计算得出的喷杆横移量进行一次条件判断,如果满足当前计算偏移量大于之前传输偏移量+0.5cm或小于之前传输偏移量-0.5cm则满足传输条件;偏移量经RS232串口传输至下位机,进入偏移延时控制算法,当延时到达时取出偏移量,将偏移量接收标志位Flag置1;在Flag置1的情况下判断对行推杆电机当前位置,如果当前位置小于目标位置,则将右移标志位rFlag置1,偏移量接收标志位Flag=0,喷杆开始右移;如果当前位置大于目标位置,则将左移标志位lFlag置1,偏移量接收标志位Flag=0,喷杆开始左移。这样既不会进行重复判断,也可以在有新的偏移量传输时立即开始新的横移判断。位移传感器对推杆电机的位置进行实时检测,当推杆电机实际位置与目标位置相等时,控制电机驱动板使推杆电机刹车。

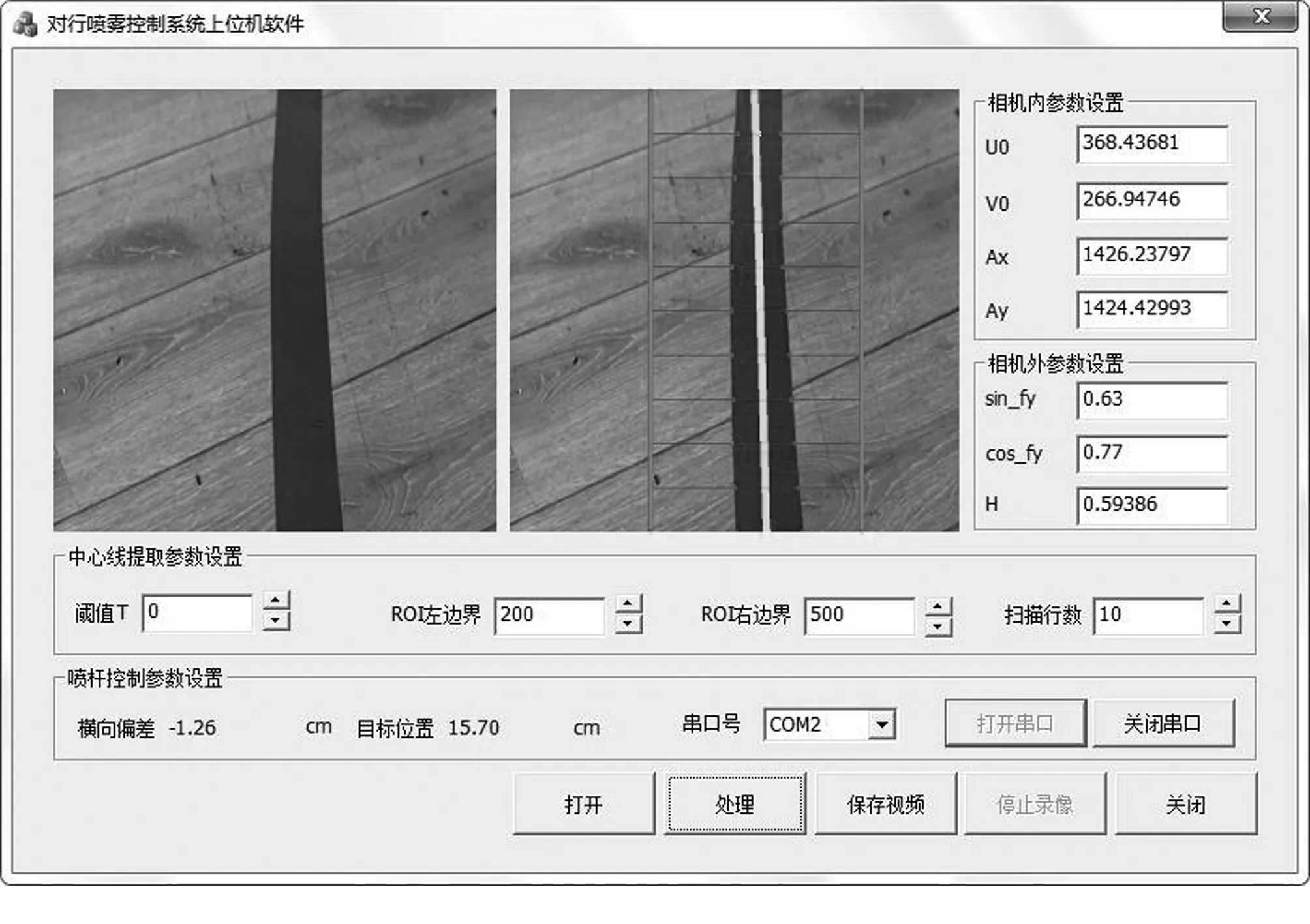

上位机软件界面如图4所示。利用MFC与Opencv相结合进行界面设计和算法实现,开发环境为Visual Studio 2012,操作系统为Windows7。上位机软件使用过程如下:首先设置相机内外参数,然后点击“打开”相机,左侧显示RGB图像,根据作物行位置设置ROI左边界和右边界值;右侧显示二值化的分割图像,根据实际作业时的光照条件,修改分割阈值达到最佳分割效果。以上设置完成后选择并打开下位机串口,点击“处理”,左侧显示原RGB图像,右侧显示作物行中心线提取结果,同时计算喷杆横向偏移量,并通过RS232串口进行发送。

图4 上位机软件界面

2 作物行中心线提取

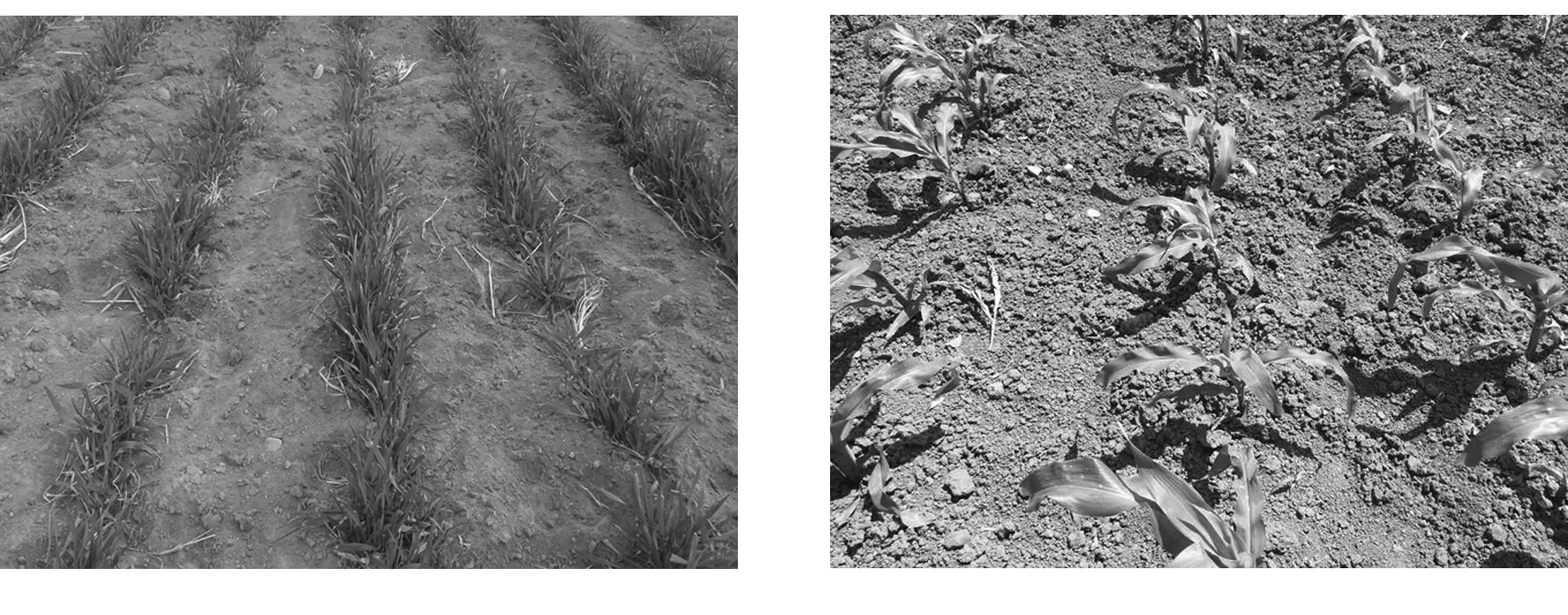

用于进行作物行中心线提取算法试验的图像取自国家农业智能装备工程技术研究中心试验田,如图5所示。

2.1 图像预处理方法

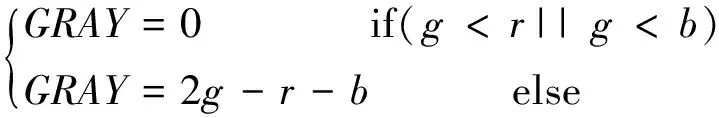

由相机直接获取的作物图像背景较复杂,主要包括土壤、杂草和枯枝等,图像预处理的目的是将作物行和背景进行分割。针对绿色作物,常用的图像预处理方法有以下两种[25-30]:

1)基于超绿特征法(2G-R-B)的图像预处理方法。首先采用超绿特征法对获取的作物图像进行灰度化,其算法为

(1)

其中,GRAY为图像某点灰度值;r、g、b分别为该点红色、绿色和蓝色分量。然后,利用最大类间方差法自动获取最佳分割阈值实现图像二值化处理,最后利用形态学处理方法去除细小对象物以及孔洞填充,分割效果如图6(a)、(b)所示。

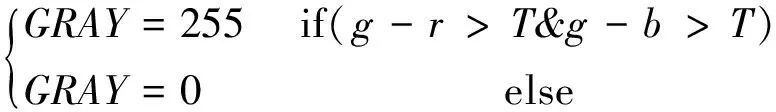

2)基于G-R>T&G-B>T算法的图像预处理方法。首先采用如下方法对图像直接进行二值化处理,有

(2)

其中,T为分割阈值,然后利用形态学处理对二值图像进行进一步优化,分割效果如图6(c)、(d)所示。

(a) 小麦田 (b) 玉米田

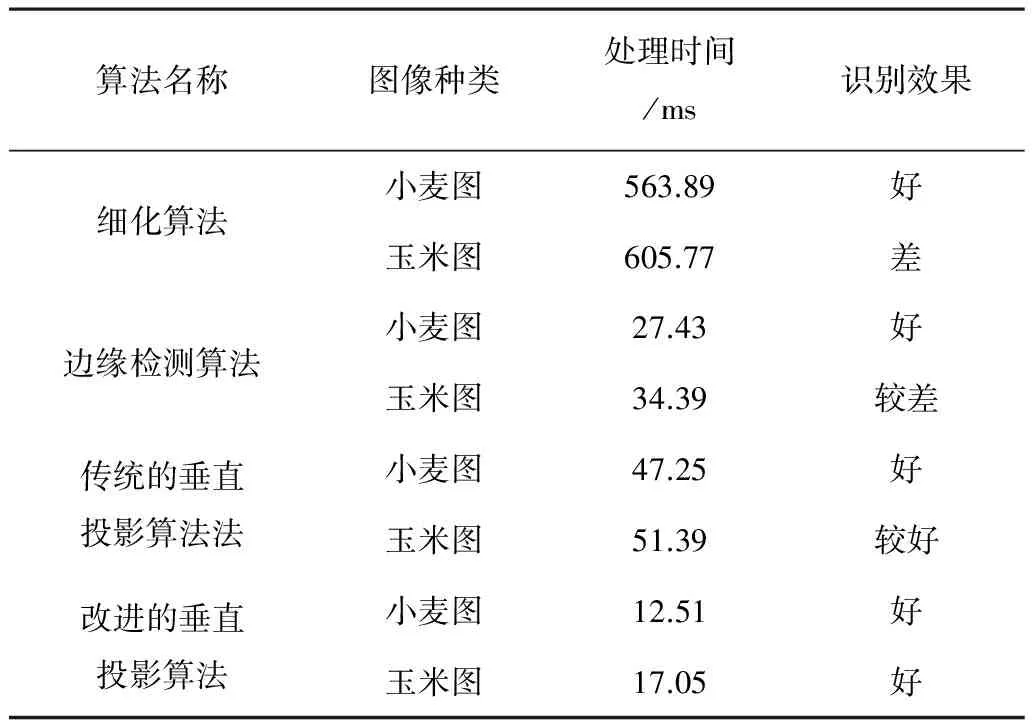

(a) 小麦行预处理(方法1) (b) 玉米行预处理(方法1)

(c) 小麦行预处理(方法2) (d) 玉米行预处理(方法2)

由图6可以看出:两种图像预处理方法均达到很好的分割效果,但在CPU主频2.4 GHz,内存4 G电脑上运行结果显示,方法1平均耗时31.96ms,方法2平均耗时12.06ms,同时方法2中分割阈值T可根据不同光照条件进行调节,方法2具有更好的实时性以及对复杂作业环境的适应性。因此,本文中图像预处理方法选择方法2,分割阈值T选择范围-10~10,默认值为0。

2.2 中心线提取算法

以上图像预处理对作物行和背景进行了很好的分割,但喷杆横向偏移量提取还需要在其基础上实现对作物中心线的提取。许多学者针对作物行中心线提取进行了研究,其过程可大致概括为首先对作物行进行特征点提取,然后利用Hough直线检测或最小二乘法拟合作物行中心线[25-33]。

对作物行特征点提取方法有:垂直投影法、边缘检测法和骨架提取法等,如刁智华等采用骨架提取算法对作物行进行细化处理,然后采用Hough变换进行直线检测,实现多行作物的中心线提取[19],但该算法对一副图像的处理时间较长,使系统出现较大滞后性。另外,该方法在对类似如图5(b)叶子散开,单株间隙较大的作物细化之后直线检测效果不理想。曹倩等通过逐行扫描判断作物行边界并求取中心点的方法提取作物行若干特征点,利用Hough变换进行直线检测,同样实现对多行作物中心线提取[32],并且具有较快的处理速度;但该方法同样在针对单株间隙较大的作物时利用边界点求取的中心线准确性不高,进而使中心线提取效果较差,也容易受细小对象物的干扰。相比以上方法,垂直投影法在拥有较快处理速度的基础上对作物行特征点提取具有较高的准确性[30-31],本文采用垂直投影法进行作物行中心线检测,并对传统方法做出如下改进:

1)感兴趣区域ROI提取。在作业过程中利用相机拍摄的图像往往是多行作物,而用于对行控制的基准线仅需要一行,一般处理方法是以距图像中心最近的中心线为基准,这样的处理方法容易在作物行距较小和相机摆动过程中判断出错。为了进一步提高导航线提取处理速度和准确性,本文采用首先根据行距对拍摄图像进行感兴趣区域提取的方法,如图7(a)、(b)所示。

2)作物行特征点提取。为减小运算量,首先将图像感兴趣区域划分为N个图像条,N可根据作物形态进行选择,文本N默认值取10。从左往右扫描,对图像条每一列有效像素点数进行统计,即

(3)

其中,I(j)为第h个图像条中第j列有效像素点数;H为每个图像条行数;s(i,j)为图像第i行第j列像素点灰度值。为避免细小对象物干扰,规定当I(j)>M或j等于ROI左边界时,为作物行左边界,本文M取15,此时得到该图像条内作物行左边界点P1;在获得左边界的基础上,当I(j)=0或j等于ROI右边界时,得到该图像条内作物行右边界点P2,该图像条内作物行中心点P3坐标为

(4)

3)特征点直线拟合。利用Hough变换进行作物行直线检测时,容易出现一行作物多条检测直线的情况[33],本文利用最小二乘法进行特征点直线拟合,并得出作物行中心线在图像中的直线方程,如图7(c)、(d)所示。

(a) 小麦行感兴趣区域提取 (b) 玉米行感兴趣区域提取

(c) 小麦行中心线提取 (d) 玉米行中心线提取

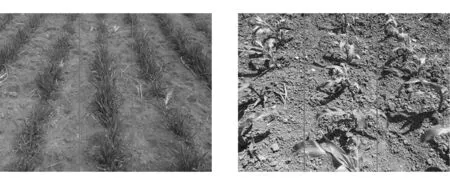

将改进的垂直投影法与其他几种常用的作物行中心线提取算法处理效果进行比较,比较结果如表1所示。运行计算机配置为:CPU主频2.4 GHz,内存4G;平均处理时间为10次处理耗时平均值,识别效果评价标准为提取中心线与实际作物行中心线的偏离程度,规定:好、较好、较差、差4个标准分别表示提取中心线与实际中心线所成角度为0°~5°、5°~10°、10°~15°,以及大于15°。

由表1可以看出:改进的垂直投影法较其他几种算法提高了图像处理时间,并在针对如图5(b)这种单株间隙较大的作物也具有好的提取效果。

表1 不同算法处理效果对比

3 电动喷杆横移控制算法

3.1 坐标系转换

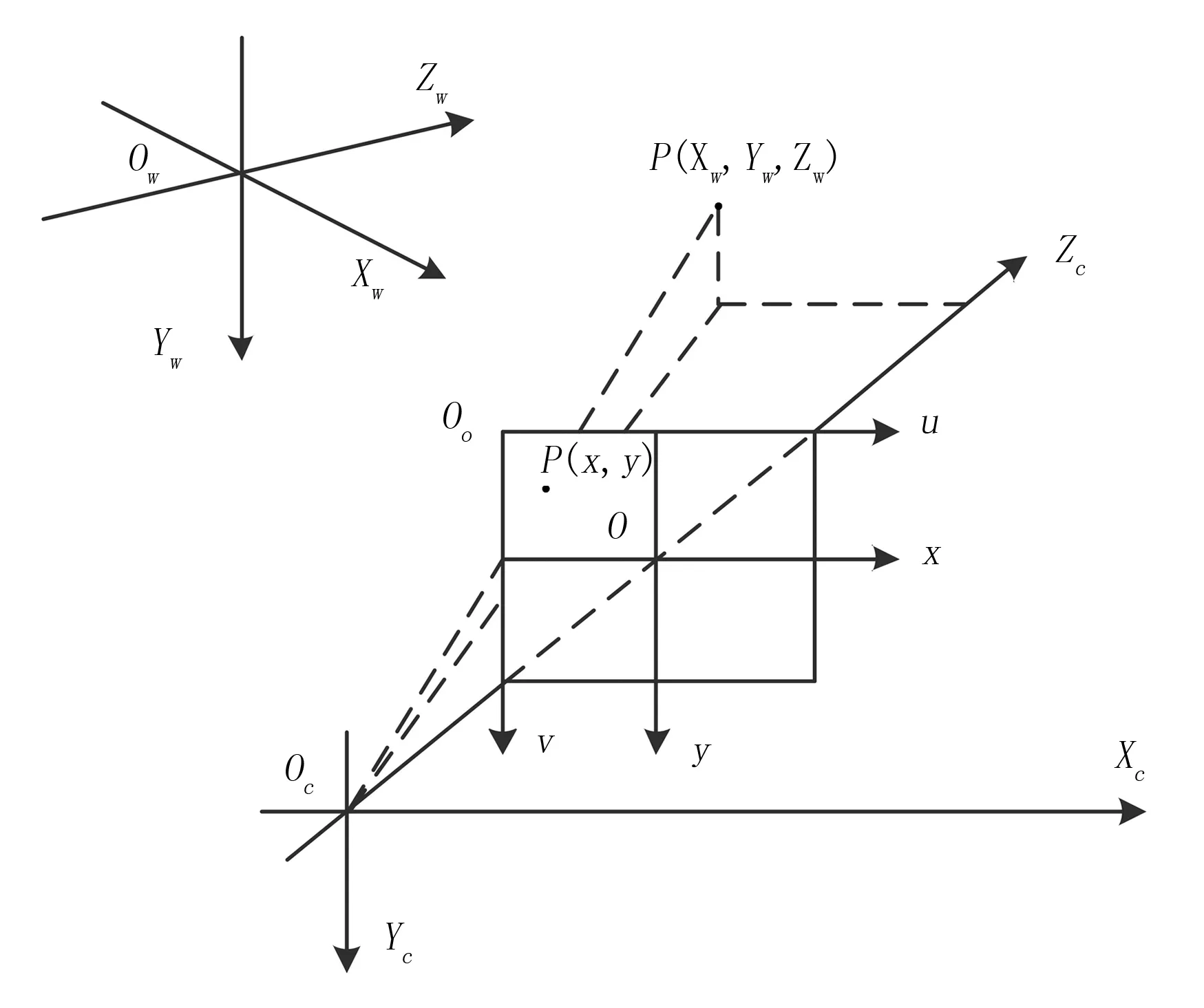

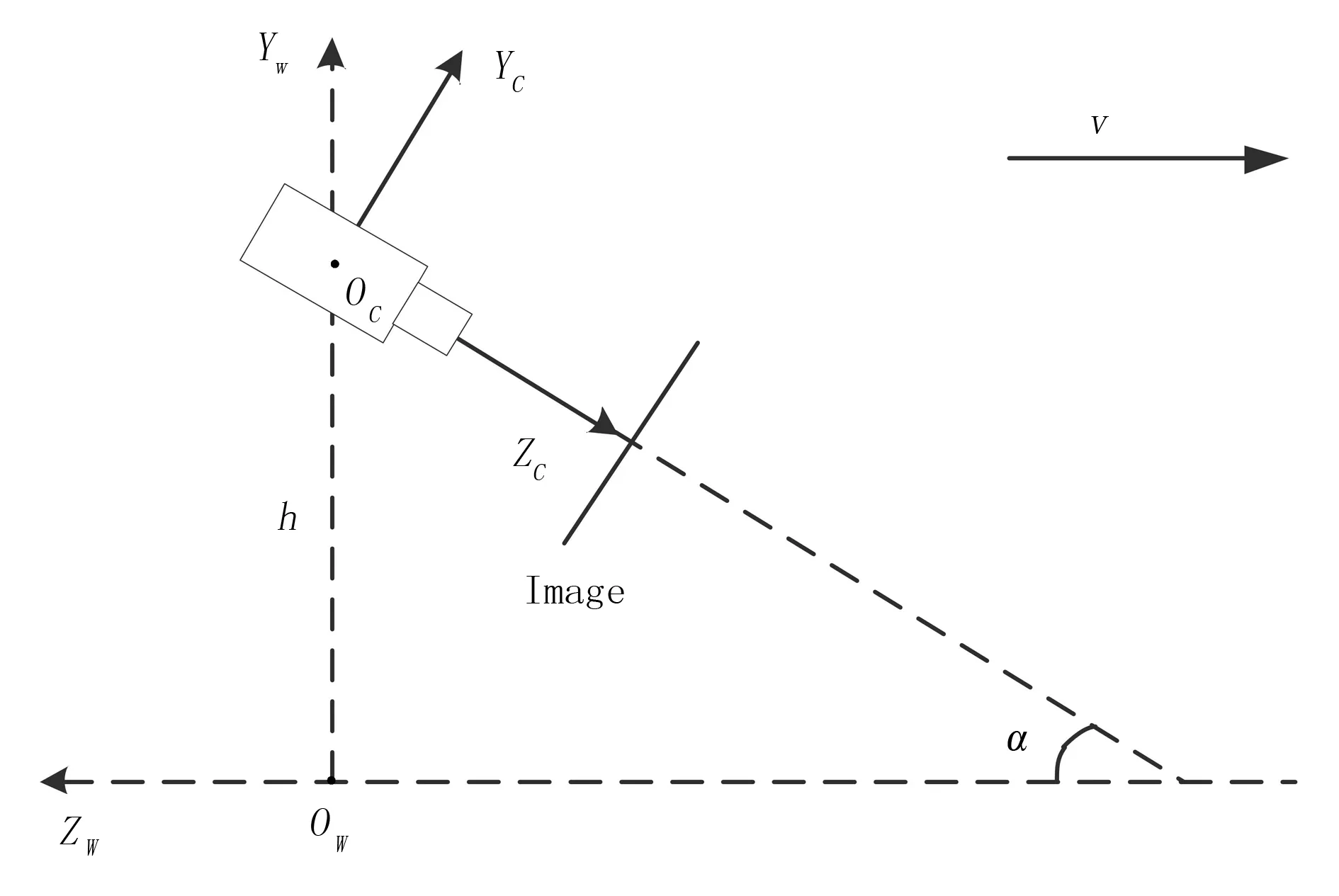

机器视觉应用中包括4种坐标系:图像坐标系UO0V、图像物理坐标系XOY、相机坐标系XcOcYc和世界坐标系XwOwYw,如图8所示。图像坐标系下任意一点坐标与其在世界坐标系下对应的坐标转换关系为

(5)

其中,(u,v)为图像坐标系下一点的坐标;(Xw,Yw,Zw)为该点在世界坐标系下对应坐标;M1为内参数矩阵;fx和fy分别表示以X轴与Y轴方向上的像素为单位表示的等效焦距;(u0,v0)为图像物理坐标系原点坐标;M2为外参数矩阵包括旋转矩阵R和平移矩阵T。

图8 4种坐标系相对位置关系

相机标定的目的是确定内参数矩阵和外参数矩阵,本文采用张正友标定法,利用MatLab下的Calibration工具箱实现对相机的标定。通过calib_gui命令调用标定工具箱,首先导入3张以上(本文采用9张)在不同角度下拍摄的棋盘标定板照片,要包括至少一张摄像头在实际工作位置拍摄的标定照片,如图9所示。通过该工具箱下的标定函数可自动获取相机内参数矩阵及实际工作时的外参数矩阵。

图9 标定图片

实际作业过程中相机坐标系与世界坐标系选取如图10所示[29-30]。以相机光心在地面投影为世界坐标系的原点,世界坐标系Zw轴与运动方向相反,Xw轴垂直于运动方向向里,相机坐标系绕Xw轴逆时针旋转α角,再沿Yw轴负方向平移h得到世界坐标系,由式(5)得

(6)

图10 坐标系转换

由Yw=0,可以计算图像上任意一点坐标(u,v)对应的世界坐标Xw和Zw

(7)

(8)

3.2 喷杆横移延时控制算法

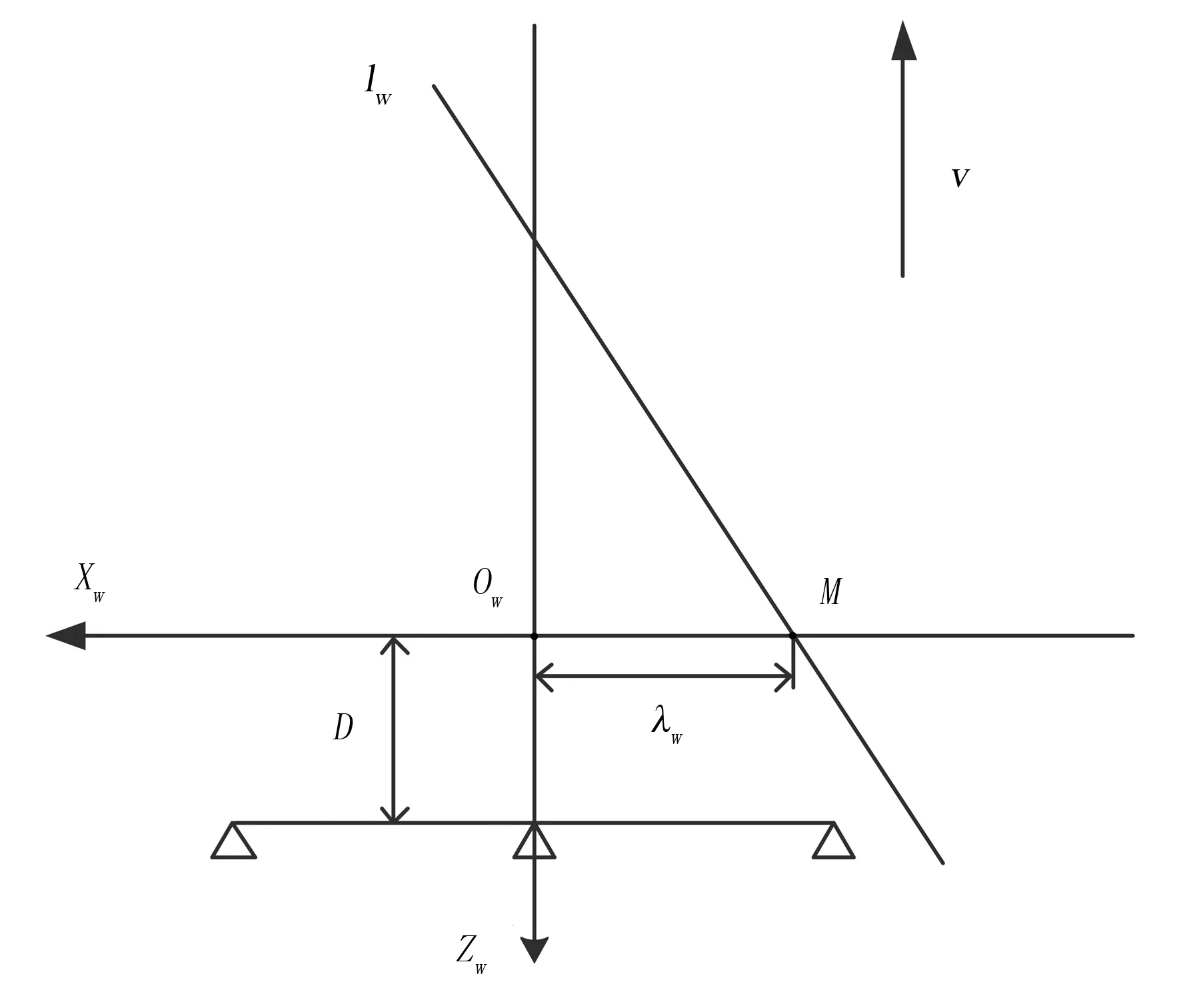

喷杆与作物行中心线位置关系如图11所示。其中,lw为作物行中心线在世界坐标系下所在的直线,已知作物行中心线在图像坐标系下的方程可由该直线上的任意两点求出其在世界坐标系下对应的直线方程,直线lw与Xw轴截距λw即喷杆横向偏移量,当λw>0时喷杆左移,λw<0时喷杆右移。喷杆安装在作业车辆的后面,与相机存在一定距离D,由上位机计算的横移量需要一定延时才能控制喷杆开始移动。设计延时控制策略如下:利用下位机控制器ATMega16产生定时中断,定时时间为10ms,则延时需要的定时器中断数计算式为

Delay_Count=(D/v)×100

(9)

其中,v为作业行驶速度。定义两个数组Delay_Time[i]和Shift_Buffer[i]分别暂存第i个偏移量需要的延时定时器中断数和偏移值。上位机计算的横移量经RS232串口传输至下位机ATMega16控制器,每300ms传输一次,下位机接收横移量后,暂存到横移数组Shift_Buffer[i]中,同时让延时数组Delay_Time[i]等于需要的定时器中断数Delay_Count,Delay_Time[i]初始值为-1。在定时中断函数中,对数组Delay_Time[i]进行循环减1操作,当Delay_Time[i]<0时,使Delay_Time[i]初始化为-1,不做任何操作;当Delay_Time [i]=0时,取出横移数组Shift_Buffer[i]中相应的横移值,控制直流推杆电机开始横移。

图11 喷杆与作物行中心线位置关系

4 试验及结果分析

4.1 喷杆横向偏移量计算试验

为验证喷杆横向偏移量计算准确性,设计喷杆横向偏移量计算试验如图12所示。

1.棋盘标定板 2.笔记本电脑 3.绿色胶带 4.固定支架 5.工业相机

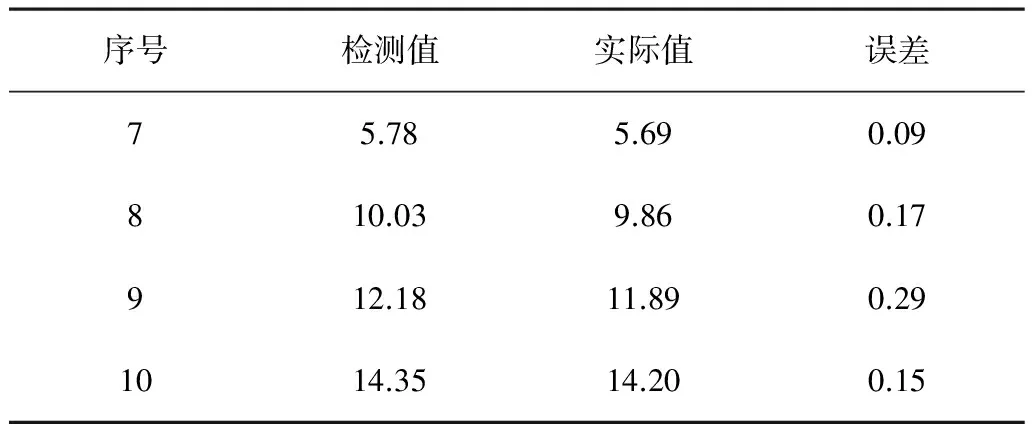

将工业相机安装在支架上,固定于某一高度并调整好俯仰角;利用铅锤确定相机光心在地面上的投影得到(见图11)Ow;将棋盘标定板平放在相机视野内,得到一张标定照片,利用Matlab工具箱及先前得到的8张不同角度的标定照片得出相机内参数:fx=1 426.24、fy=1 424.43、u0=368.44、v0=266.95以及外参数:安装高度h=59.39cm、俯仰角α=39.65°。将一截绿色胶带贴在相机视野中模拟绿色作物行,打开上位机软件提取模拟作物行中心线同时得到喷杆横向偏移量;用直尺测量绿色胶带中心线所在直线与Xw轴的交点M到相机光心投影Ow的实际距离λw,改变绿色胶带与相机的相对位置,重复试验,试验结果如表2所示,由试验结果可以看出,用该方法得出的喷杆横向偏移量最大误差为0.44cm。

表2 喷杆横向偏移量计算试验结果

Table 1 Results of movement spray boom parameter calculation

cm

续表2 cm

4.2 电动喷杆移动位置测试试验

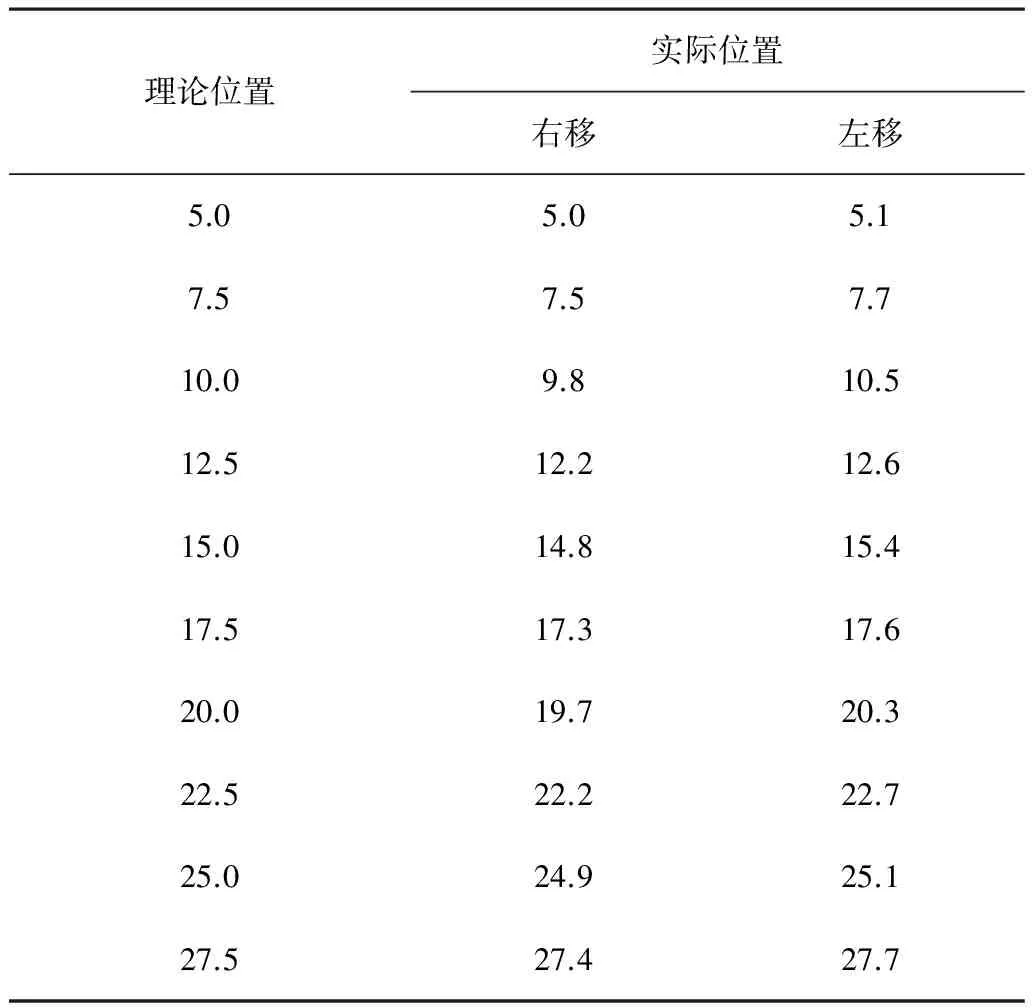

为验证电动喷杆位移距离准确性,设计了电动喷杆移动位置测试试验,首先将电动喷杆平放在地面上,下位机串口与笔记本电脑相连,打开串口调试助手,手动输入位移字符串使推杆电机移动到相应位置,用直尺测量喷杆移动距离。输入不同横移距离进行重复试验,试验结果如表3所示。从结果可以看出:右移时电动喷杆移动距离最大误差0.3cm,左移时电动喷杆移动距离最大误差0.5cm,电动喷杆控制系统符合试验要求。

表3 电动喷杆移动位置测试试验结果

4.3 对行控制实验室试验

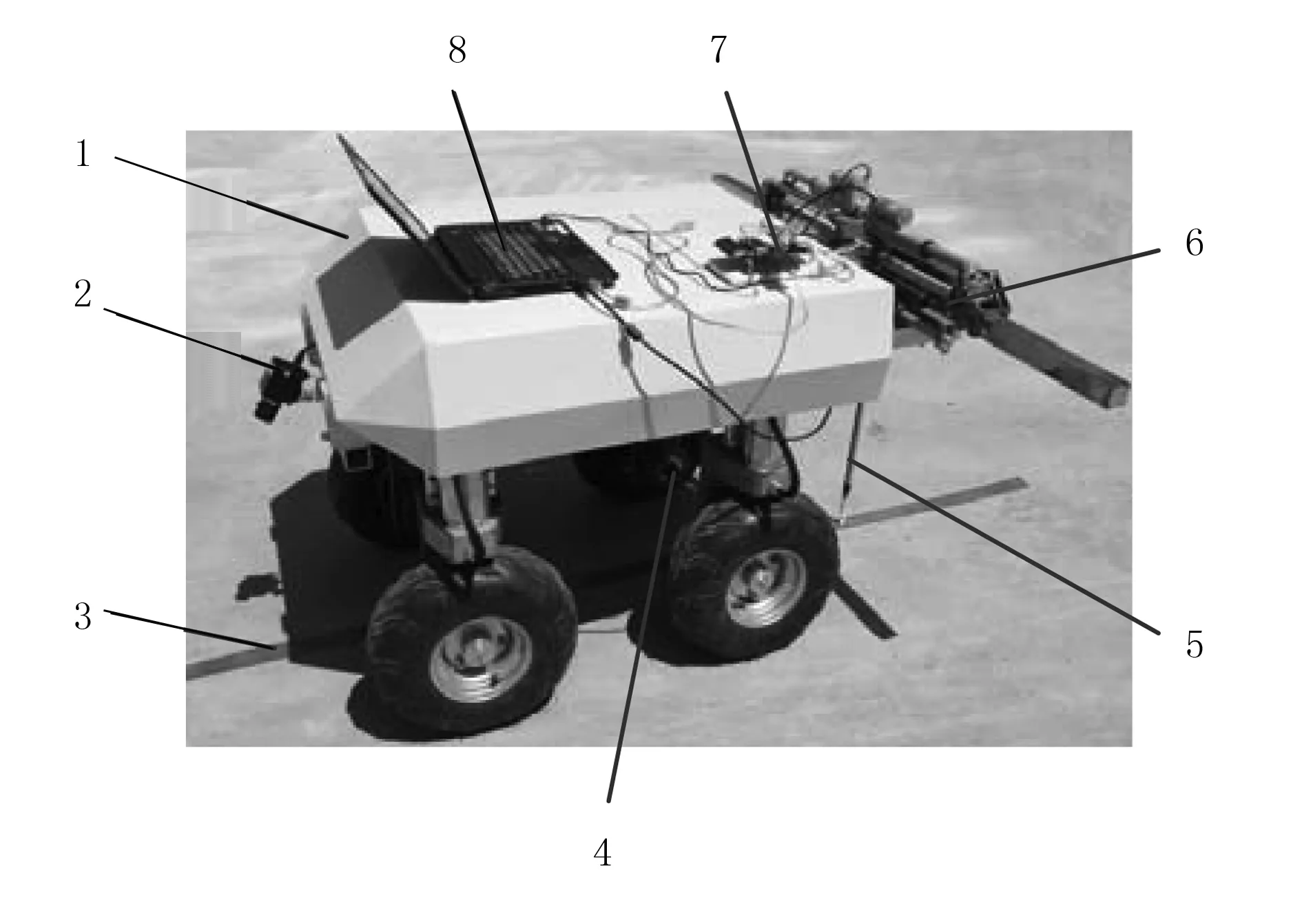

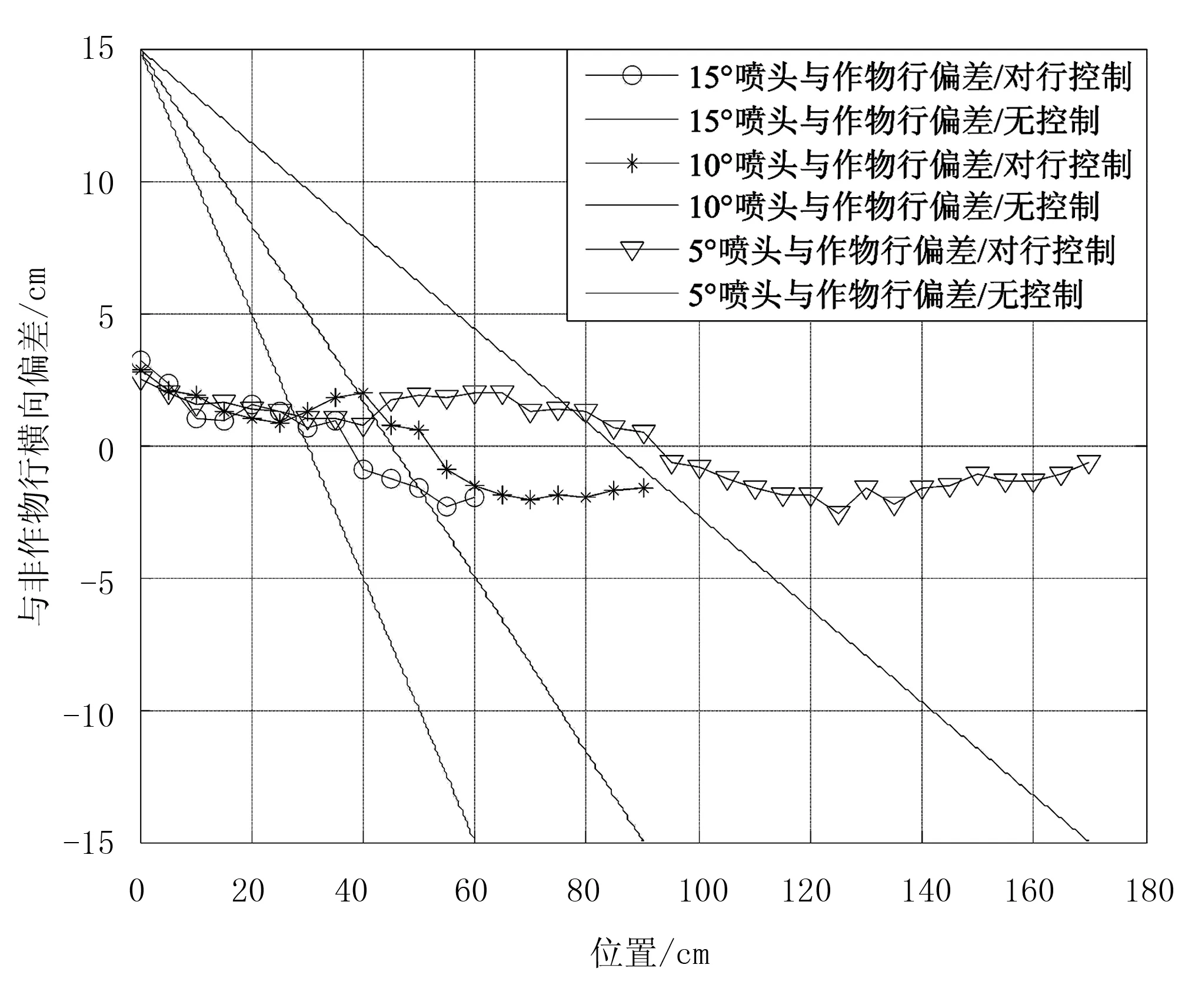

为验证系统对作物行的追踪控制精度,设计了对行控制实验室试验,将电动喷杆和相机安装在四轮驱动农用试验小车上,喷杆中间喷头位置和相机光心在同一直线上,如图13所示。利用绿色胶带模拟作物行,将一端固定有粉笔的直杆垂直固定于中间喷头位置,直杆随着电动喷杆左右移动,粉笔会在地面上画出中心喷头移动轨迹即喷杆移动轨迹。对行喷雾控制实验室试验方法如图14所示。其中,Ds为喷杆最大移动距离30cm;De为视场宽度80cm;L1、L2、L3为绿色胶带模拟作物行,与竖直方向分别呈5°、10°、15°夹角。为了保证喷杆横向偏移量小于喷杆移动最大行程30cm,将模拟作物行L1、L2、L3长度分别设置为170、90、60cm。遥控小车沿直线lv行驶,电动喷杆控制电路通过相对式编码器采集小车速度,每隔5cm测量粉笔绘制轨迹与绿色胶带实际中心线偏差,试验结果如图15所示。小车平均速度为0.26m/s,对L1、L2、L3的最大横移误差分别为3.22、2.86、2.51cm。

1.农用试验小车 2.工业相机 3.绿色胶带 4.相对式编码器 5.粉笔固定杆 6.电动喷杆 7.电动喷杆控制电路 8.笔记本电脑

图14 对行控制实验室试验方法

图15 对行控制实验室试验结果

4.4 对行喷雾控制田间试验

为验证系统在田间作业时的对行喷雾控制精度,设计了对行喷雾控制田间试验,试验地点为北京市小汤山国家精准农业研究示范基地玉米地,追踪对象为玉米幼苗行,单株高度约10cm,如图16所示。选用12V直流泵搭建喷雾系统,调节回流量和喷头压力使中间喷头形成垂直细水柱,喷杆左右移动在泥土上会形成水迹,从而记录喷杆移动轨迹。遥控小车跨行呈“S”形行驶,由两边轮子在泥土上压出的轨迹取中点求出小车中心行进轨迹,每隔20cm分别记录小车轨迹和水迹与作物行实际中心线的横向偏差。试验结果如图17所示。试验结果显示:小车平均速度0.24m/s,最大偏移14.05cm,最大对田间玉米幼苗的最大对行误差为4.86cm。

1.12V直流电机泵 2.相机固定杆 3.回流调节阀 4.药箱 5.玉米幼苗 6.喷头

从试验结果图15和图17可以看出:喷杆对作物行进行了良好的追踪,但由于直流推杆电机运动速度有限,同时上位机为避免频繁启停推杆电机存在对计算横移是否满足小于之前发送偏移量-0.5cm或大于之前发送偏移量+0.5cm的条件判断,使喷杆追踪存在一定滞后。

5 结论

1)基于机器视觉技术设计了喷杆式施药机对行喷雾控制系统,通过相机获取作物行RGB图像,提取作物行中心线并转换为喷杆横向偏移量,使喷头始终处于作物行正上方,实现了作物行实时追踪。

2)优化了以垂直投影法为基础的作物行中心线提取算法,提高了处理时间和识别准确性。试验表明:改进的垂直投影法平均耗时12.51ms,喷杆横向偏移量计算误差小于0.44cm。

3)基于AVR系列单片机ATMega16设计了电动喷杆控制系统,通过RS232串行接收上位机发送的喷杆横向偏移量,设计了延时策略和基于位移传感器的直流推杆电机位置控制方法,实现了对电动喷杆位置的精确控制。试验表明:电动喷杆右移最大误差0.3cm,左移最大误差0.5cm。

4)以四轮驱动农用小车为平台开展了对行喷雾控制实验室和田间试验,试验表明:小车平均速度为0.26m/s时,对倾角为5°、10°、15°的模拟作物行最大对行误差分别为3.22、2.86、2.51cm;小车平均速度为0.24m/s、最大偏移14.05cm时,对田间玉米幼苗的对行最大误差为4.86cm。

[1] 张铁,杨学军,严荷荣,等.超高地隙喷杆喷雾机风幕式防飘移技术研究[J].农业机械学报,2012(12):77-86.

[2] 刘慧,夏伟,沈跃,等.基于实时传感器的精密变量喷雾发展概况[J].中国农机化学报,2016,37(3):238-244,260.

[3] 苑进,赵新学,李明,等.高地隙喷杆式与隧道式一体喷雾机的设计与试验[J].农业工程学报,2015,31(S2):60-68.

[4] 王俊,董祥,严荷荣,等.风幕式喷杆喷雾机玉米田间施药试验[J].农业机械学报,2015,46(7):79-84.

[5] 燕明德,贾卫东,毛罕平,等.风幕式喷杆喷雾雾滴粒径与速度分布试验[J].农业机械学报,2014,45(11):104-110.

[6] 燕明德,毛罕平,贾卫东,等.风幕式喷杆喷雾气液两相流数值模拟[J].农业机械学报,2013,44(10):68-74.

[7] 刘雪美,李扬,李明,等.喷杆喷雾机精确对靶施药系统设计与试验[J].农业机械学报,2016,47(3):37-44.

[8] 宋淑然,陈建泽,洪添胜,等.果园柔性对靶喷雾装置设计与试验[J].农业工程学报,2015,31(10):57-63.

[9] 陈艳,张漫,马文强,等.基于GPS和机器视觉的组合导航定位方法[J].农业工程学报,2011,27(3):126-130.

[10] 何洁,孟庆宽,张漫,等.基于边缘检测与扫描滤波的农机导航基准线提取方法[J].农业机械学报,2014(S1):265-270.

[11] 项明,魏爽,何洁,等.基于DSP和MCU的农机具视觉导航终端设计[J].农业机械学报,2015(S1):21-26.

[12] 孟庆宽,仇瑞承,张漫,等.基于改进粒子群优化模糊控制的农业车辆导航系统[J].农业机械学报,2015(3):29-36,58.

[13] 孟庆宽,张漫,仇瑞承,等.基于改进遗传算法的农机具视觉导航线检测[J].农业机械学报,2014(10):39-46.

[14] 孟庆宽,何洁,仇瑞承,等.基于机器视觉的自然环境下作物行识别与导航线提取[J].光学学报,2014(7):180~186.

[15] Hossein Behfar, HamidReza Ghasemzadeh, Ali Rostami, et al.Vision-based row detection algorithms evaluation for weeding cultivator guidance in lentil[J].Modern Applied Science, 2014, 8(5): 224-232.

[16] N D Tillett, T Hague, S J Miles, et al.Inter-row vision guidance for mechanical weed control in sugar beet[J].Computers and Electronics in Agriculture, 2002, 33(1): 163-177.

[17] Bjorn Astrand, Albert-Jan Baerveldt.A vision based row-following system for agricultural field machinery[J].Mechatronics, 2005, 15(1): 251-269.

[18] Yutaka Kaizua, Kenji Imou.A dual-spectral camera system for paddy rice seedling row detection[J].Computers and Electronics in Agriculture, 2008, 63(1): 49-56.

[19] 刁智华,吴贝贝,毋媛媛,等.基于最大正方形的玉米作物行骨架提取算法[J].农业工程学报,2015,31(23):168-172.

[20] 李景彬,陈兵旗,刘阳,等.采棉机视觉导航路线图像检测方法[J].农业工程学报,2013,29(11):11-19.

[21] 冯娟,刘刚,司永胜,等.果园视觉导航基准线生成算法[J].农业机械学报,2012(7):185-189,184.

[22] Tijmen Bakker, Hendrik Wouters, Kees van Asselt, et al.A vision based row detection system for sugar beet[J].Computers and Electronics in Agriculture, 2008, 60(1): 87-95.

[23] Thomas Bak, Hans Jakobsen. Agricultural robotic platform with four wheel steering for weed detection[J].Biosystems Engineering, 2004, 87 (2): 125-136.

[24] Fernando A Auat Cheein, Gustavo Scaglia, Miguel Torres-Torriti, et al. Algebraic path tracking to aid the manual harvesting of olives using an automated service unit[J].Biosystems Engineering, 2016, 142: 117-132.

[25] Sogaard HT, Lund I. Application accuracy of a machine vision-controlled robotic micro-dosing system, Biosystems Engineering, 2007, 96(3): 315-322.

[26] M Guijarro, G Pajares, I Riomoros, et al. Automatic segmentation of relevant textures in agricultural images[J].Computers and Electronics in Agriculture, 2011, 75(1): 75-83.

[27] Sorense CG, Jorgensen RN, Maagaard J.Conceptual and user-centric design guidelines for a plant nursing robot[J].Biosystems Engineering, 2010, 105(1): 119-129.

[28] Perez-Ruiz Manuel, Slaughter David C, Fathallah Fadi A, et al.Co-robotic intra-row weed control system[J].Biosystems Engineering, 2014, 128: 45-55.

[29] 侯学贵,陈勇,郭伟斌.除草机器人田间机器视觉导航[J].农业机械学报,2008(3):106-108,112.

[30] 张春龙,黄小龙,刘卫东,等.苗间锄草机器人信息获取方法的研究[J].农业工程学报,2012,28(9):142-146.

[31] 司永胜,姜国权,刘刚,等.基于最小二乘法的早期作物行中心线检测方法[J].农业机械学报,2010(7):163-167,185.

[32] 曹倩,王库,杨永辉,等.基于TMS320DM642的农业机器人视觉导航路径检测[J].农业机械学报,2009(7):171-175.

[33] 陈娇,姜国权,杜尚丰,等.基于垄线平行特征的视觉导航多垄线识别[J].农业工程学报,2009,25(12):107-113.

Design and Experiment of Row-follow Control System for Boom Sprayer

Zhang Bo1,2, Zhai Changyuan1,2, Cai Jichen2,5, Yang Shuo1,2, Wang Xiu2,3,4

(1.Collage of Mechanical and Electronic Engineering, Northwest A&F University, Yangling 712100, China; 2.Beijing Research Center of Intelligent Equipment for Agriculture, Beijing 100097, China; 3.National Research Center of Intelligent Equipment for Agriculture, Beijing 100097, China; 4.Key Laboratory of Agri-informatics, Ministry of Agriculture, Beijing 100097, China; 5.Beijing Key Laboratory of Intelligent Equipment Technology for Agriculture, Beijing 100097, China)

Spraying in fields using a boom sprayer whose nozzles couldn’t follow crop rows precisely always causes environmental pollution and much waste of pesticides. In order to solve that problem, a row-follow control system for boom sprayer was designed based on machine vision, which included a upper computer software for crop rows centerline position extracting and an electric boom control system. Crop rows RGB images acquired by a CCD camera were analyzed by G-R>T&G-B>T algorithm, morphology processing and centerline extracting based on a modified vertical projection method. Then the line of the crop row was obtained, and the electric boom adjustment parameters were calculated by means of axes transfer. An ATMega16 controller received the parameters through an RS232 serial port form upper computer, and adjusted the electric boom to the left or right with movement monitoring by a displacement sensor. Experiments were conducted in the lab and field. The results showed that the modified algorithm of crop row centerline extracting cost 12.51ms in average with calculation errors of 0.44 cm. The electric boom adjustment error was less than 0.3 cm when shifting right, and less than 0.5 when shifting left. The row-follow control error was less than 3.22cm, 2.86cm and 2.51cm under the speed of 0.26m/s, when following simulated crop rows with obliquity of 5°, 10° and 15°, while less than 4.86cm when following the rows of corn seedings with the speed of 0.24m/s and the shifting of 14.02cm. It provided an effective solution for crop rows tracting and row-follow spraying.

boom sprayer; row-follow spraying; machine vision; centerline extracting; camera calibration

2016-09-11

北京市农林科学院科技创新能力建设专项(KJCX2015141 0);国家自然科学基金资助项目(31201128)

张 波(1992-),男,四川乐山人,硕士研究生,(E-mail) zhangbo_609@163.com。

翟长远(1982-),男,河南驻马店人,副教授,博士,硕士生导师,(E-mail)zhaichangyuan@163.com。

S491;TP242.6

A

1003-188X(2017)11-0049-10