基于混合势场的移动机器人视觉轨迹规划

2016-08-04丁夏清杜卓洋陆逸卿

丁夏清,杜卓洋,陆逸卿,刘 山

(浙江大学 控制科学与工程学院,浙江 杭州 310027)

基于混合势场的移动机器人视觉轨迹规划

丁夏清,杜卓洋,陆逸卿,刘山

(浙江大学 控制科学与工程学院,浙江 杭州 310027)

摘要:针对载有单目相机的非完整移动机器人,提出基于混合人工势场的能够满足非完整约束的路径规划方法,能够解决移动机器人运行过程中的视野约束问题.在传统人工势场的基础上,提出混合人工势场的概念,势场中一部分是只对角速度起作用的目标点偏转势场和视野约束排斥势场,另一部分是同时影响线速度和角速度的目标位姿吸引势场;其中视野约束排斥势场定义在图像空间内;目标位姿吸引势场和目标点偏转势场定义在笛卡尔空间,利用单应性矩阵三维重建的结果构造势场函数.在混合人工势场的控制下,机器人能够在同时满足视野约束和无侧滑约束的条件下平滑地移动到目标位姿.仿真结果证明了该方法的有效性.

关键词:移动机器人;非完整约束;视野约束;人工势场;单应性矩阵

在移动机器人视觉伺服控制策略的研究中,视野约束(field-of-view constrains,FOV)和机器人运动的非完整约束是需要解决的两个重要问题[1]. 视野约束问题是指机器人利用视觉信息进行反馈控制时,控制策略须保证目标维持在视野范围内;当目标移出视野范围时,控制策略仍能保证机器人移动到正确的位姿.针对该问题,目前主要的解决方案有基于切换控制的视觉伺服策略[2]、基于预测控制的视觉伺服策略[3]和结合轨迹规划的视觉伺服策略等,其中轨迹规划可以细分为基于图像插值的轨迹规划[4]、基于优化的轨迹规划[5-7]和基于势场的轨迹规划等.

基于人工势场路径规划的方法是机器人路径规划中的常用方法,基本思想是在机器人工作空间内施加虚拟势场,并将任务目标设计为势场的极值点,使机器人在势场力的作用下运动到目标位姿.目前,基于人工势场法的轨迹规划策略多是针对可产生任意方向加速度的机器人设计的,不适用于非完整移动机器人.针对该问题,Borenstein等[8]提出利用合力的大小和方向解耦地控制机器人的线速度和角速度的方法;朱毅等[9]对人工势场法进行改进,利用模糊控制的方法,根据环境信息调整控制律中的参数.

在单目相机视觉系统中,单目相机无法获取目标深度信息,机器人的位姿是不完全可测的.很多学者对于如何从单目相机中获取机器人的位姿信息进行了研究.Gonzalo等[2]根据单应性矩阵中的元素设计控制器,可以使运动过程中特征点始终在机器人视野内;Fang等[10]基于单应性矩阵设计切换控制器,可以使机器人以最短路径运动到期望位姿处;李宝全等[11]基于二维三焦张量设计反馈线性化控制器,实现了机器人的位置镇定.本文引入单应性矩阵,通过分解单应性矩阵得到机器人的轨迹规划所需的相关参数,可以避免估计目标深度信息.

本文提出基于混合人工势场的方法,分别构造影响角速度的偏转势场与视野约束排斥势场以及同时影响线速度和角速度的目标位姿吸引势场.其中,偏转势场和目标位姿吸引势场定义在笛卡尔空间,并利用基于单应性矩阵的三维重建结果构造势场函数;视野约束的斥力势场定义在图像空间,基于特征点到图像边缘的距离构造势场函数.本文在笛卡尔空间内规划机器人的线速度和角速度,以保证控制律满足非完整约束,并针对势场中存在的局部极值的问题给出解决方法.在该控制方法下,机器人的线速度和角速度连续,并且能够稳定地移动到目标位姿.通过仿真验证了该方法的有效性.

1问题描述

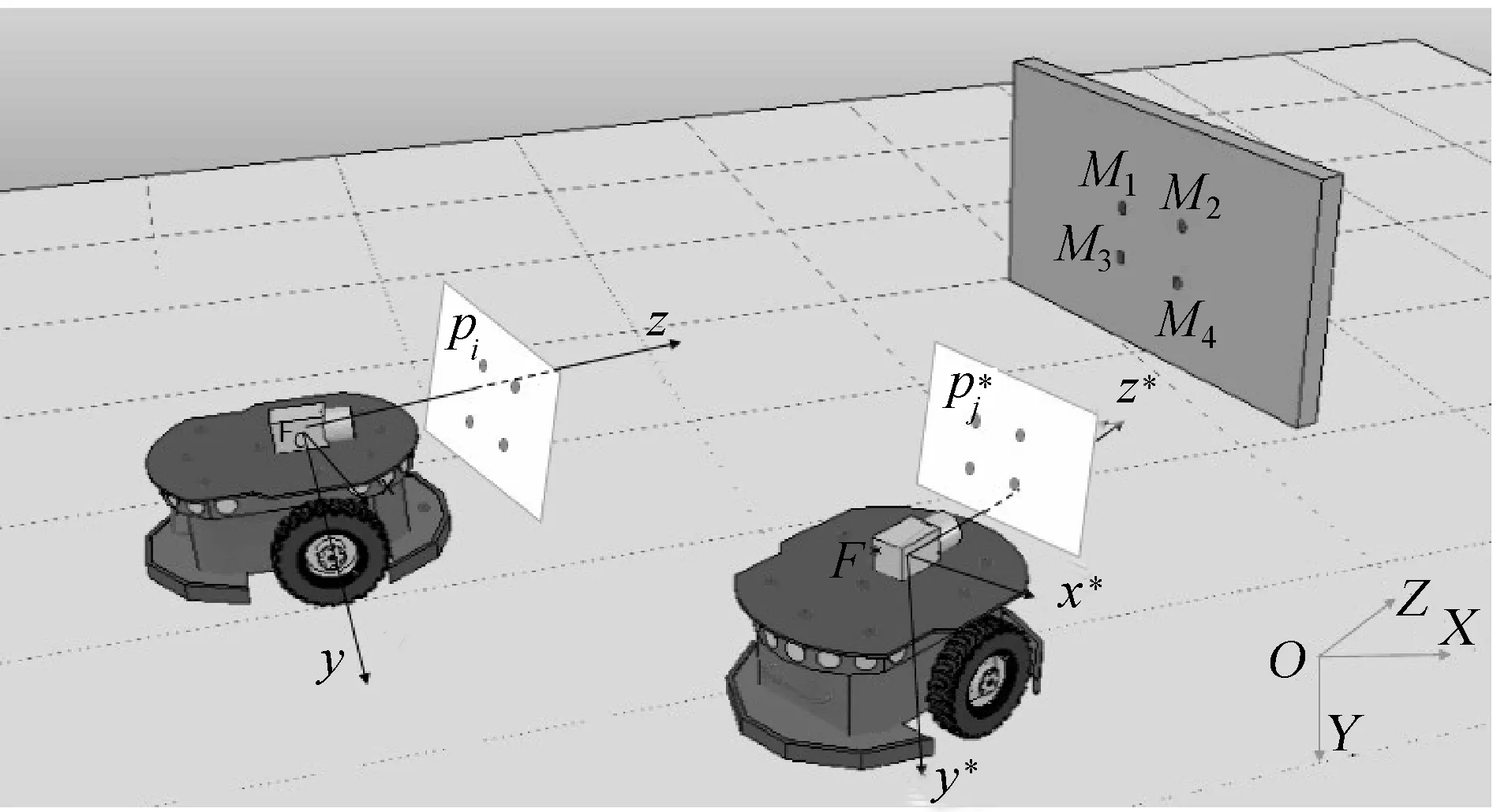

图1 差动轮式机器人及目标平面示意图Fig.1 Schematics of differential wheeled robots and target plane

如图1所示,考虑载有单目相机的非完整移动机器人的视觉伺服任务,空间中存在平面的目标物体,给定机器人在期望姿态下相机拍摄的目标物体图像,利用视觉反馈使机器人从目标可见的任意初始位姿调整到期望位姿.

对于图1所示的差动轮式机器人,单目相机固定在机器人轮轴的中点,相机光轴与机器人坐标系z轴平行,Fc和F*分别为机器人在当前位姿和期望位姿下的相机坐标系,原点在机器人轮轴的中心,xz平面定义了机器人的运动平面,其中x轴平行于机器人轮轴线,z轴垂直于机器人轮轴线.

在机器人的控制过程中,存在以下两个约束.

1)非完整约束:在运动过程中,轮式机器人无法侧向滑动,存在非完整约束.

2)视野约束:在机器人运动过程中,须保持目标图像始终在视野内.

本文提出混合的人工势场,将人工势场分成两部分.一部分是只对角速度起作用的目标点偏转势场和视野约束排斥势场;另一部分是同时影响线速度和角速度的目标位姿吸引势场,利用合势场对机器人的作用效果在笛卡尔空间中进行轨迹规划,使机器人平滑地移动到目标位姿.

2系统模型

2.1视觉模型

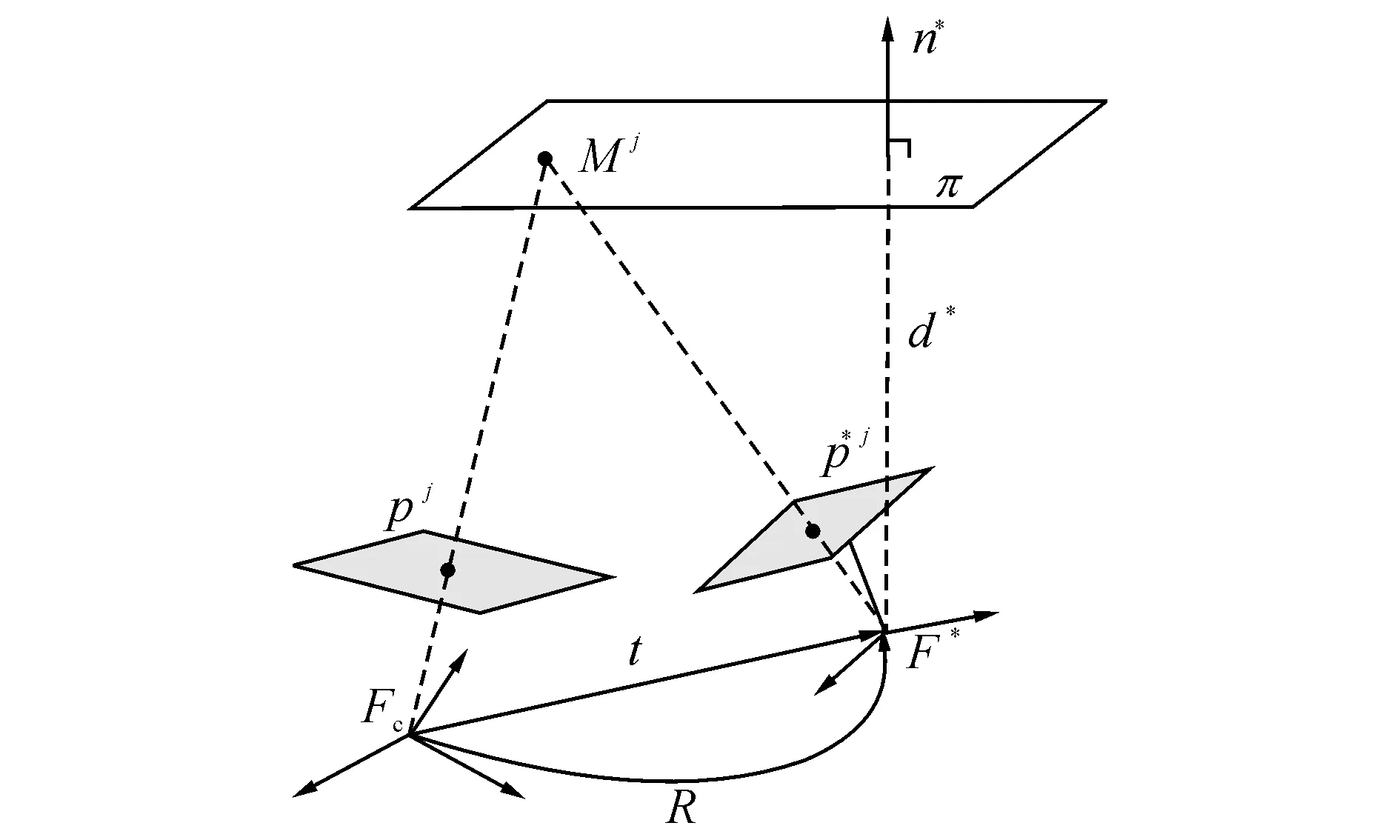

如图2所示,π为空间中一平面,Mj=[Xi,Yj,Zj]T(j=1,2,…,n,n为特征点总数)为平面上一点,n*为在F*下π平面的单位法向量,d*为F*原点到平面π的距离,mj=[xj,yj,1]T为点Mj的归一化坐标,其中xj=Xj/Zj,yj=Yj/Zj,pj=[uj,vj,1]T,和p*j=[u*j,v*j,1]T分别为当前图像和目标图像中点Mj的像素齐次坐标,s=[(p1)T,(p2)T,…,(pn)T]T为特征向量.

图2 当前位姿和期望位姿的相机坐标系Fig.2 Desired and current camera frames

两幅图像中共面的特征点可以用一个映射单应性矩阵G关联[12]:

αjpj=Gp*j.

(1)

式中:αj为正比例系数.

G=AHA-1=A(R+tdn*T)A-1.

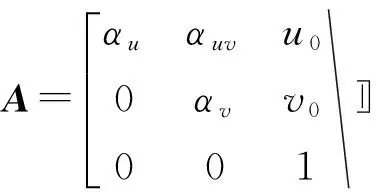

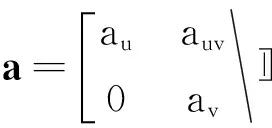

(2)式中:td=t/d*;H为当前图像和期望图像间的单应性矩阵;R为两个坐标系之间的旋转矩阵;t为两个坐标系间的平移向量;矩阵A为相机的内参矩阵,

(3)

其中αu、αv为用像素单位表示的相机焦距长度,αuv为倾斜因子,[u0,v0]为相机主点坐标.

假设目标点始终在前方,并且已知法向量(n*)T的方向,可以分解单应性矩阵,得到关于R和td的唯一解[13].

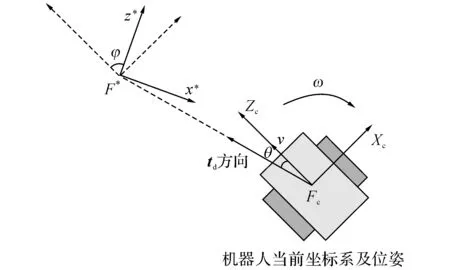

2.2机器人模型

如图3所示为差动机器人运动学模型.图中,v为机器人瞬时线速度,ω为瞬时角速度,ζ为世界坐标系与机器人当前坐标系的夹角.

图3 差动机器人运动学模型Fig.3 Kinematic model of wheeled mobile robot

在左、右驱动轮滚动无滑动的假设下,机器人存在如下的非完整约束:

vxcosζ-vzsinζ=0

(4)

式中:vx为机器人速度在目标位姿机器人坐标系F*下x*轴的分量,vz为机器人速度在F*下z*轴的分量.

3基于混合人工势场法的轨迹规划

人工势场法的基本思想是在机器人工作空间内施加虚拟人工势场,并设计任务目标为势场的极值点,使机器人在势场力的作用下运动到目标位姿.人工势场包括目标对机器人产生的吸引势场和障碍物对机器人产生的排斥势场,机器人在合势场的作用下完成避障并到达目标位姿的任务.

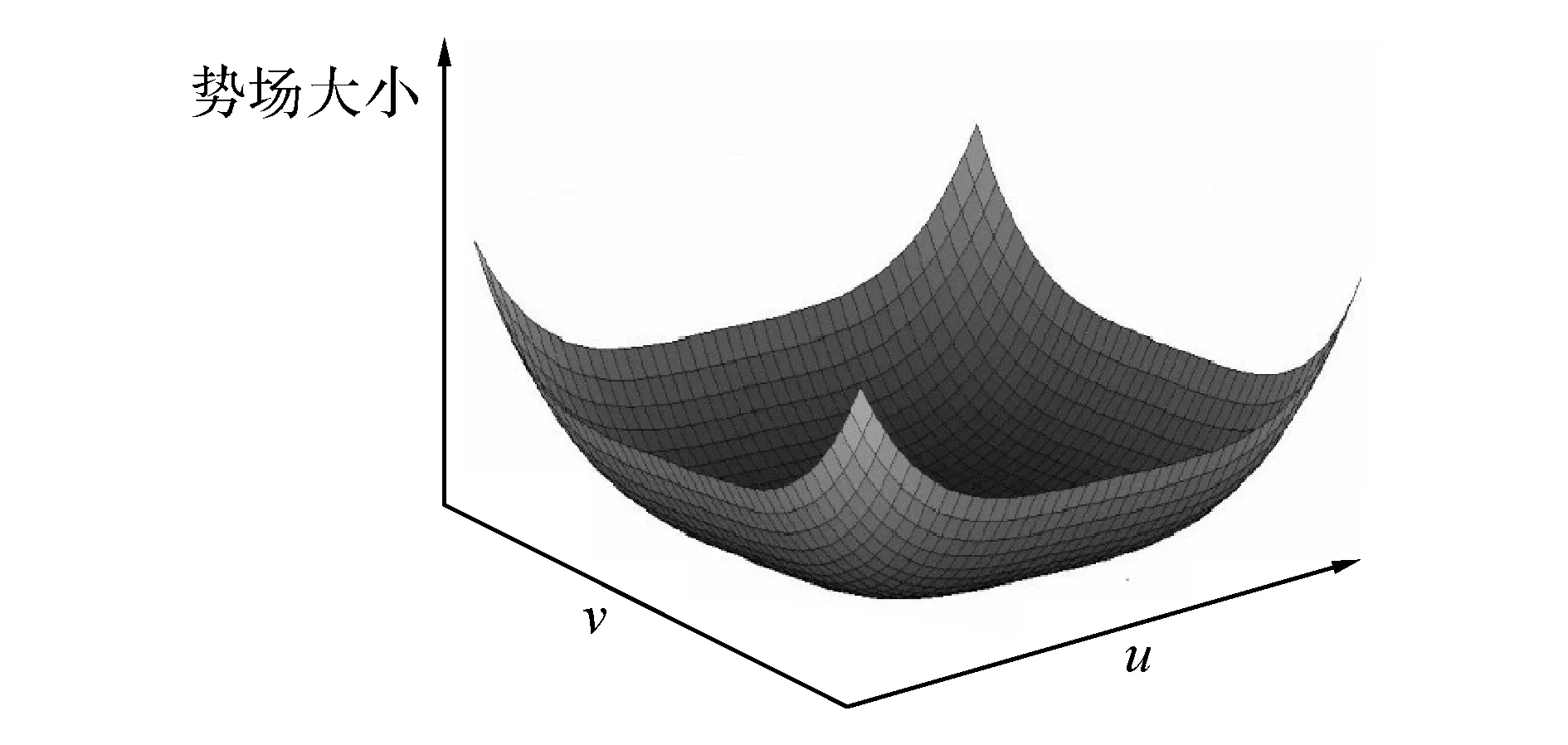

为了使机器人在人工势场作用下的运动满足视野约束和非完整约束,本文对传统的人工势场函数加以改进,分别针对机器人的速度和角速度设计了混合人工势场,其中包括只对角速度起作用的目标点偏转势场Vθ和视野约束排斥势场Vs以及同时影响线速度和角速度的目标位姿吸引势场Va.

3.1混合人工势场模型

3.1.1目标位姿产生的吸引势场在传统人工势场中,目标对机器人的吸引势场多由两者之间的距离定义得到.考虑到单目相机无法获取目标的深度信息,即目标与机器人间的距离无法计算,因此利用单应性矩阵分解的结果进行三维重建,构造人工势场中的目标位姿吸引势场函数.

将机器人位姿的矢量定义为γ=[xd,zd,φ]T,其中xd为单应性矩阵分解得到的平移向量td在机器人坐标系X轴上的投影,zd为td在机器人坐标系z轴上的投影,φ为从F系绕y轴顺时针旋转到F*系的角度.目标位姿为γ*=[0,0,0]T.

定义目标位姿对机器人的吸引势场为

(5)

该吸引势场产生的吸引力为

(6)

目标位姿产生的吸引势场作用在机器人上,同时影响线速度和角速度,引导机器人运动到目标位姿.

对于具有非完整约束的移动机器人,无法瞬时产生任意方向的加速度,只利用目标位姿吸引势场产生的作用力无法保证机器人能够到达目标位姿,机器人可能最终停止在与目标位姿平行的状态;在运动的过程中,无法保证特征点始终不会脱离视野范围.本文引入克服非完整约束的偏转势场和克服视野约束的图像空间斥力场.由于非完整约束和视野约束可以通过调整机器人的前进方向解决,为了减少线速度和角速度控制之间的耦合,将偏转势场和视野约束的斥力势场定义为只影响机器人角速度的势场函数.

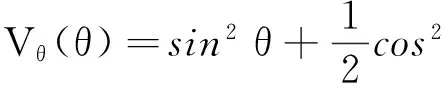

3.1.2偏转势场由于研究的机器人存在非完整约束,无法侧向滑动,为了使机器人能够运动到目标点,且减少非完整约束对吸引势场的作用效果的影响,应使机器人在运动过程中的前进方向指向目标位置.为此,引入影响机器人角速度的偏转势场Vθ,将其定义为

(7)

式中:θ为机器人当前位姿与机器人和目标点的连线之间的夹角.

偏转势场如图4所示,偏转角越大,机器人受到的偏转力越大,机器人朝指向目标位姿的方向偏转,并且由于势场函数中cos2φ的存在,φ和θ会产生相互约束的作用,机器人不会迅速地直接转向目标点,而是沿着光滑曲线运动,最终到达目标姿态.

利用单应性矩阵分解得到的td,计算θ为

(8)

式中:ε为一较小阈值.

由式(7)可得偏转势场对机器人产生的偏转力为

[0,0,2sinθcosθ+cosφsinφ]T.

(9)

图4 偏转势场示意图Fig.4 Illustration for deflection potential field

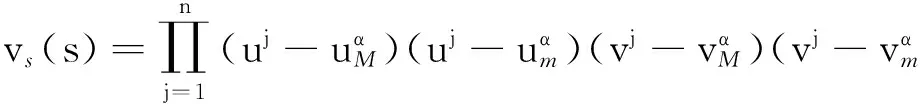

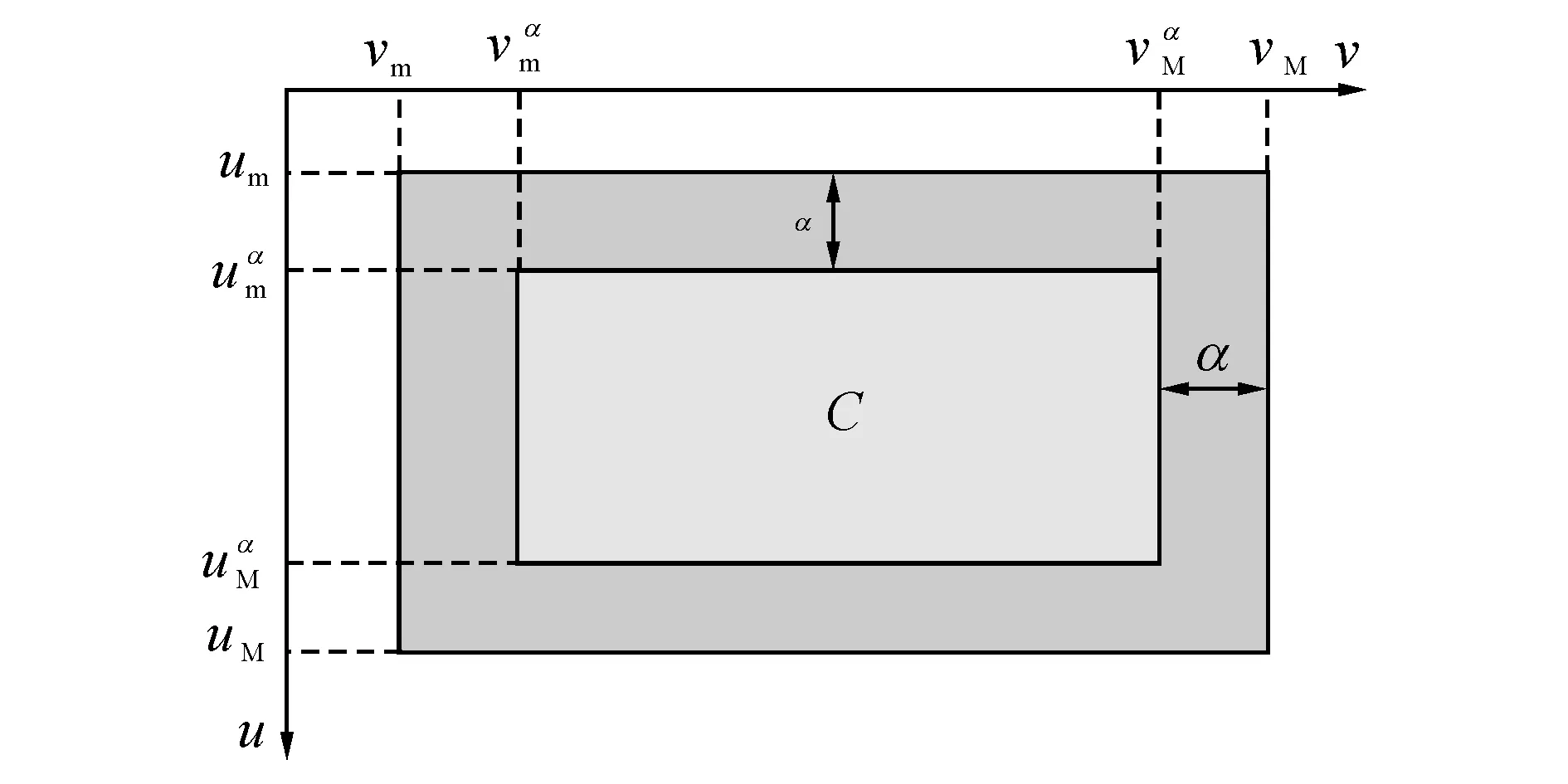

3.1.3视野约束的排斥势场为了防止机器人在运动过程中目标点移出视野范围,定义了图像空间中的排斥势场.当特征点距图像边缘的距离小于一定值时,斥力势场的作用将使其向图像中部运动.排斥势场函数的表达式[12]如下:

(10)

式中:

斥力场函数示意图如图6所示,当图像特征点在工作区域C内时,斥力势场对机器人不产生作用力,当特征点距图像边缘的距离小于边界宽度α时,斥力势场产生作用使特征点向图像中部运动,并且特征点越靠近图像边缘,斥力势场越大.

当视野约束的斥力势场存在时,由式(10)可得

(11)

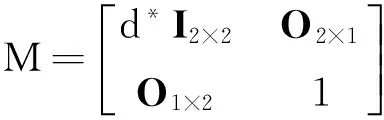

M矩阵的表达式为

(12)

图5 斥力场示意图Fig.5 Repulsive potential field for visibility

图6 斥力场函数示意图Fig.6 Repulsive potential function for visibility

(13)

式中:

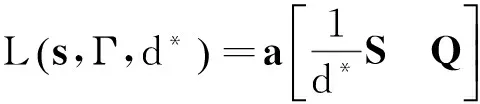

图像雅可比矩阵的计算需已知目标深度信息,只凭单目相机无法准确获取深度信息,因此无法直接根据公式计算图像雅克比矩阵和视野约束排斥力.

通过分解单应性矩阵得到的R、t/d*和n*,可以计算出

(14)

利用ρj可以将图像雅克比矩阵改写成:

(15)

式中:

(16)

S矩阵和Q矩阵中的元素可以通过图像信息计算得到,从而得到包含d*的L矩阵.

L(s,Z)=[LT(p1,Z1),…,LT(pn,Zn)]T.

(17)

Fs(γ)=[0,0,Fsω]T.

(18)

3.2非完整约束下的实现方法

在不考虑视野约束时,针对具有非完整约束的移动机器人,传统的基于人工势场法的2种控制策略[8]如下.

(19)

2) ω=k1β, v=k2F.

(20)

式中:β为机器人当前速度方向与受到的合力间的偏转角,α为斥力方向与当前速度方向的夹角,vmax为机器人最大运动速度,F和Fγ分别为合力和斥力,k1、k2为控制参数.

这两种控制方法都存在一些弊端.第一种控制方案无法保证机器人在目标点停止,并且在受到斥力时,速度完全取决于斥力方向,可能会造成前方没有障碍物的情况下斥力方向相互抵消,导致机器人陷入局部极值无法到达目标点;第二种控制方法在k1和k2选取不恰当时会造成机器人的运动发散.

本文提出以下的控制策略,能够有效地解决上述问题,使机器人最终停止在目标位姿.

(21)

式中:δ1、δ2、δ3为每个势场的比例因子.

机器人的瞬时速度vc和角速度ωc的表达式为

(22)

3.3势场的极值问题

在混合势场中,机器人可能陷入混合势场的局部极小值点,此时机器人受到的合力为0,无法到达目标位姿.由式(22)可知,当F2=0,Fω=0时,机器人陷入混合势场的局部极值点.

在设计混合势场时,为了使规划出的轨迹更接近于非完整约束移动机器人运动的轨迹,当偏转角较大时,偏转势场对角速度的作用效果应大于吸引势场对角速度的作用效果,即须满足

(23)

当机器人陷入局部极值时,偏转角θ为最大值π/2.在满足式(23)的前提下,吸引势场和偏转势场产生的作用力无法使机器人平衡,即此时视野约束的势场一定已经发生作用,特征点在图像边缘.

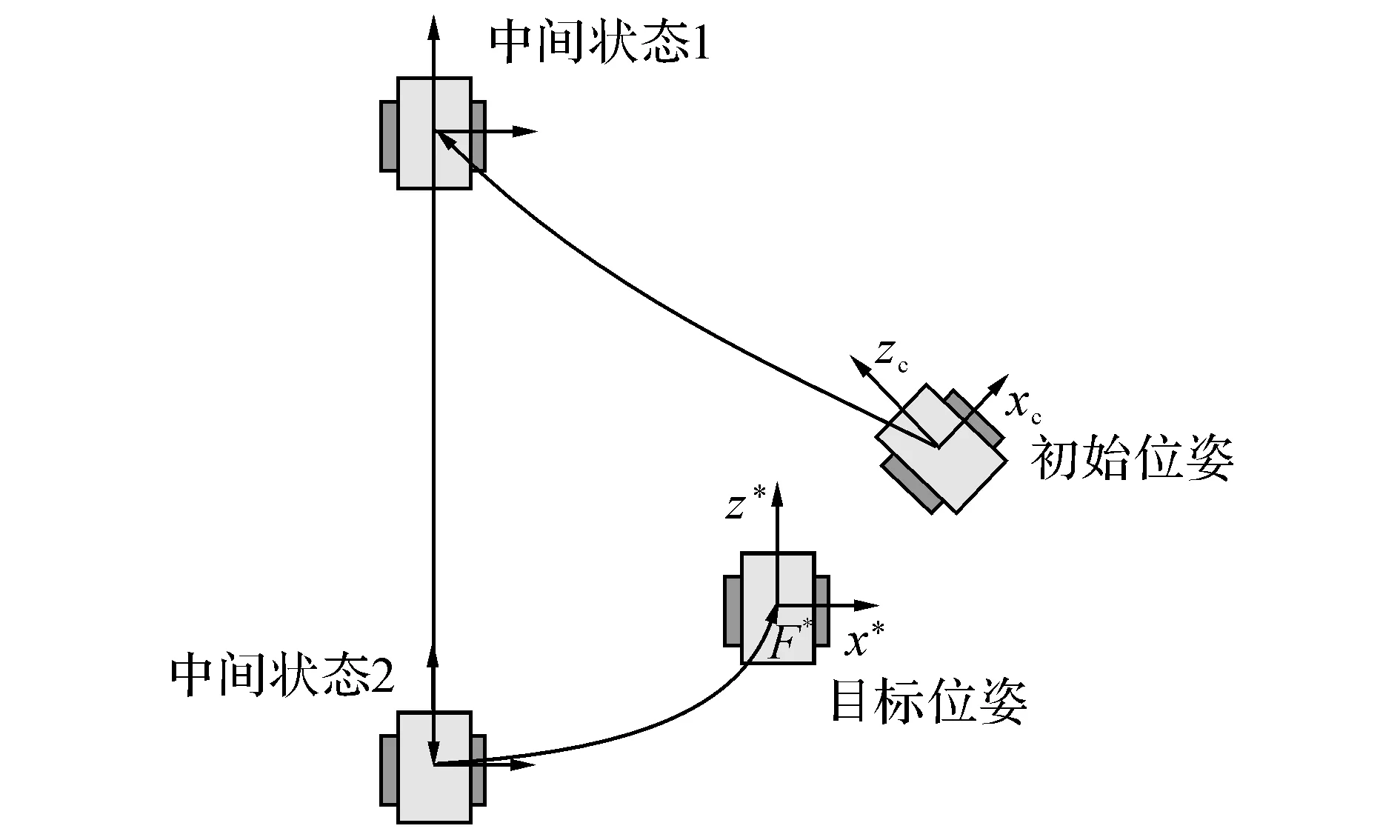

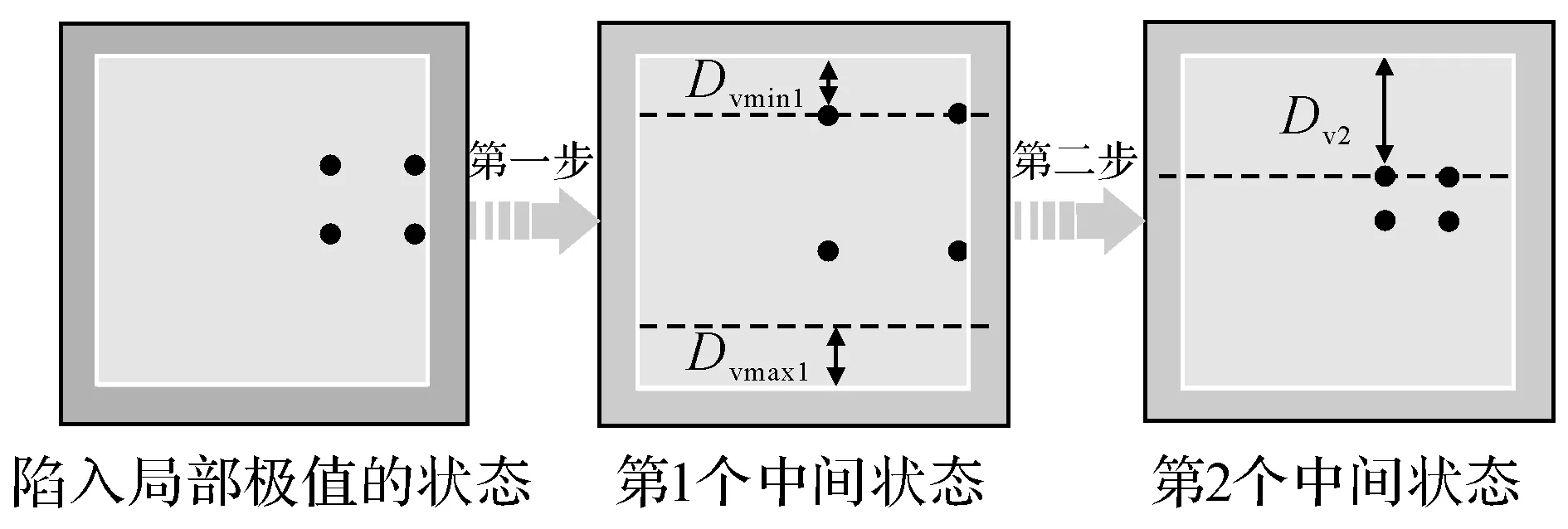

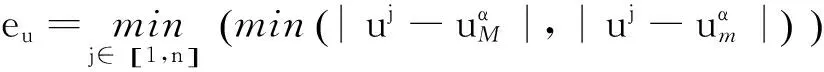

为了解决局部极值点的问题,当机器人陷入局部极值时,基于图像信息规划了如图7所示的轨迹,以使机器人脱离局部极值,并最终正确移动到目标位姿.

图7 机器人跳出局部极值点的轨迹示意图Fig.7 Special paths for robot to get rid of local minimums

图8 机器人跳出局部极值点过程中图像特征点变化示意图Fig.8 Illustration of features’ movements during robots getting rid of local minimum

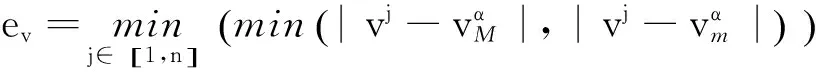

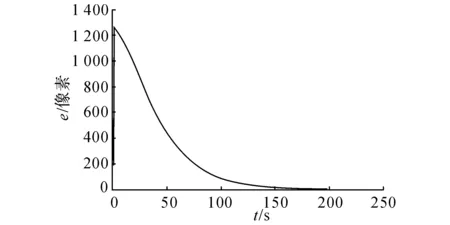

图8中浅灰度和深灰度部分的定义同图5,其中黑色圆点表示特征点在相机图像平面上的投影.设目标图像中,垂直方向上坐标值最小的特征点为p*min=[u*min,v*min,1]T,坐标值最大的特征点为p*max=[u*max,v*max,1]T;设图像空间中,特征点在水平和垂直方向上距边界的最小距离分别为

(24)

(25)

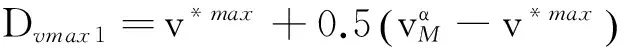

当机器人陷入局部极小值时,图像平面如图8的第1幅图所示,部分特征点处于图像边界.此时保持这部分特征点的横坐标处于图像边界处,使机器人向前运动直至特征点触及垂直方向上第1个中间状态设置的边界值,则图像平面如图8的第2幅图所示.垂直方向的第1个中间状态定义了特征点在图像空间垂直方向的边界值Dvmin1、Dvmax1,

Dvmin1=0.5v*min,

(26)

(27)

则这一阶段的速度表达式为

(28)

ωc=kA·eu.

(29)

该轨迹规划的效果是使图像特征点运动到与第1个中间状态定义的最近的边界重合.

Dv2=1.5vmid-v*min.

(30)

该阶段的速度表达式为

vc=kc(vmin-Dv2).

(31)

ωc=0.

(32)

此时,机器人已经退回到目标位姿的后方,机器人可以切换回原有的基于混合势场的轨迹规划策略,图像平面如图8的第3幅图所示.若机器人再次陷入局部极值点,则继续利用该策略跳出极值点.

4仿真研究

为了验证本文方案的有效性,基于MATLAB/Simulink[15]对所提算法进行仿真验证.

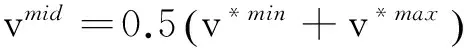

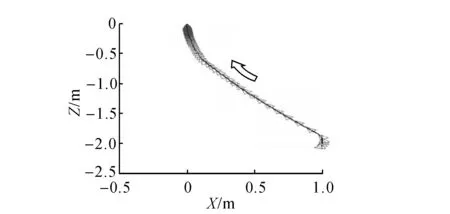

不失一般性,设机器人的目标位姿坐标系与世界坐标系重合,图9中的网格区域为相机可见的视野范围在图像平面的投影.设目标平面上提取的特征点有4个,当机器人在初始位姿和目标位姿时,特征点在相机图像平面上的成像分别用圆点和三角点表示.图9的3幅图像表示了机器人初始时刻视野约束势场不产生作用、视野约束势场产生作用和机器人处于局部极值点的3种情况下的相机图像平面示意图.

图9 机器人位于初始位姿和目标位姿时特征点的成像Fig.9 Features in images taken at initial and desired pose

在满足初始时特征点在相机视野范围内的条件下,机器人的初始位姿可以任意选取. 根据实验结果调整参数,以优化轨迹和稳态误差.最终选取的参数为:δ1=0.32,δ2=19.25,δ3=0.96,kv=0.3,kω=6,k=2.2,km=0.01,kA=0.01,kB=0.01,kc=0.03.

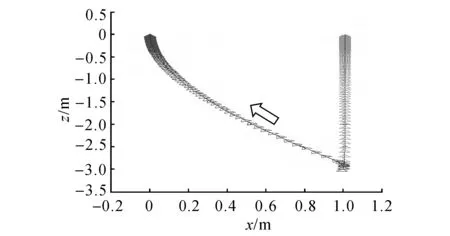

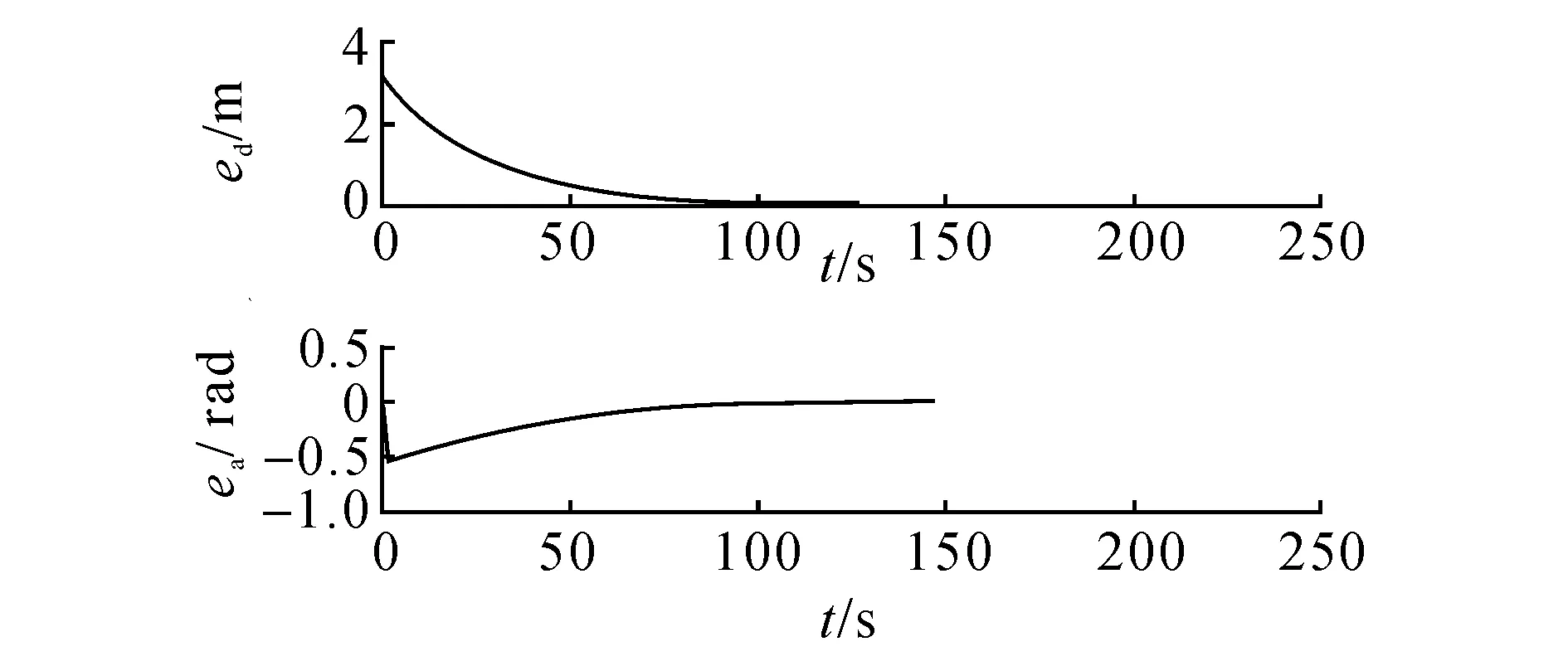

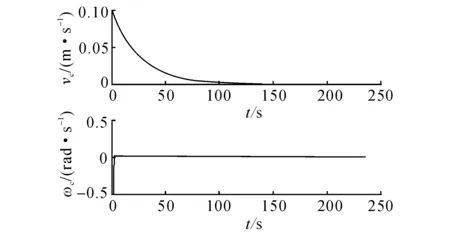

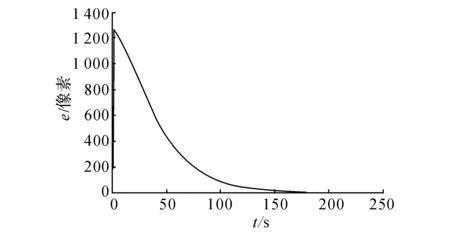

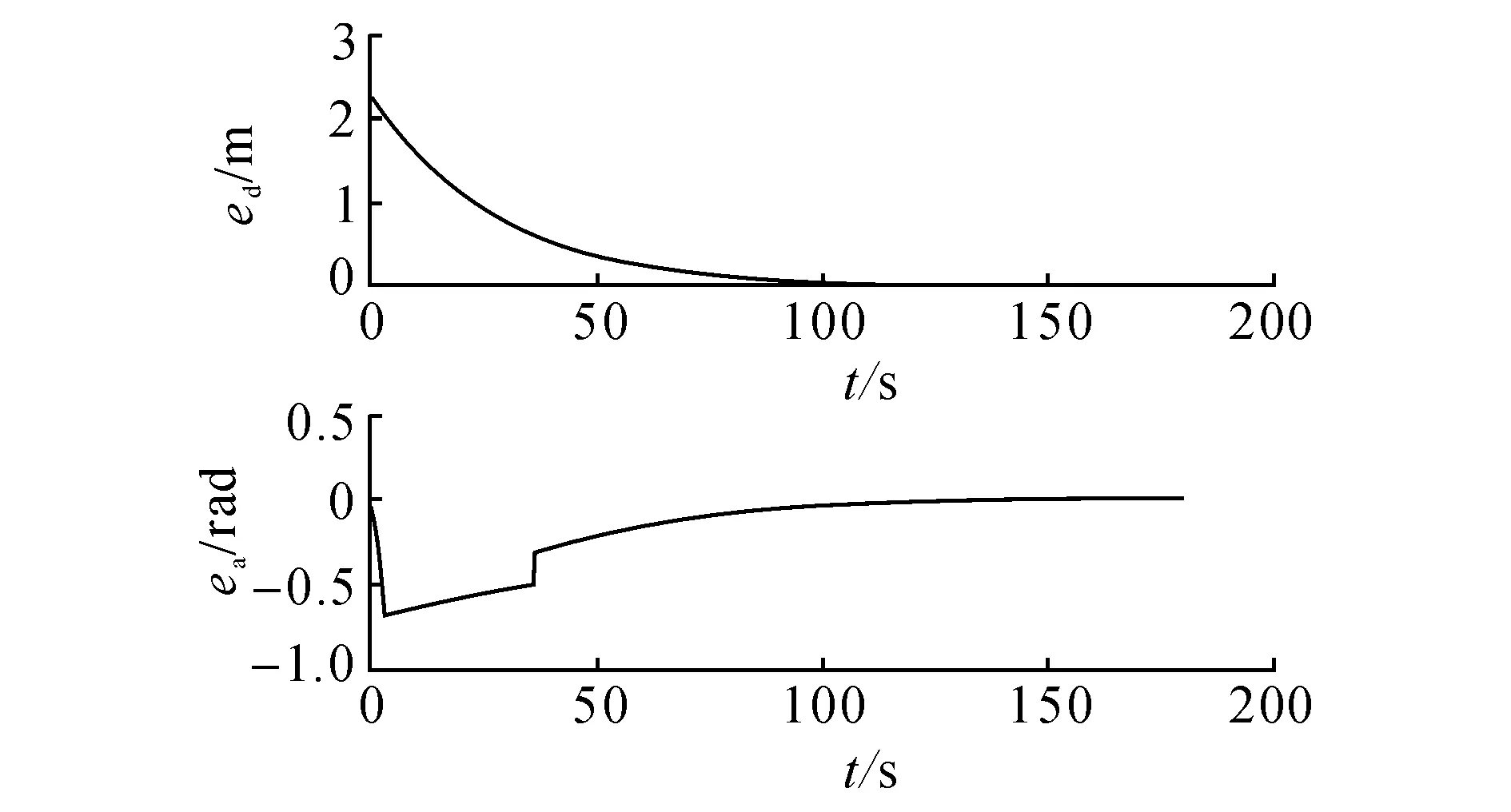

定义图像空间误差e为所有特征点像素误差的和,笛卡尔空间误差为ed和ea,其中ed为当前位姿与目标位姿的距离,ea为当前位姿与目标位姿的夹角.

下文分别通过运动过程中视野约束斥力场不产生作用力、运动过程中视野约束斥力场产生作用力和运动过程中陷入局部极小值并跳出3种情况验证混合势场的有效性,并通过在第1种情况下进行有、无偏转势场的对比验证引入偏转势场对路径规划结果的作用.

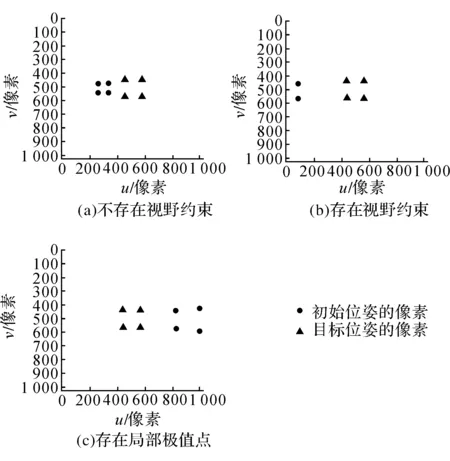

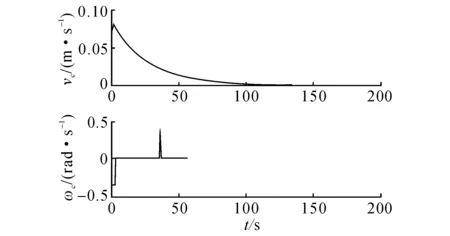

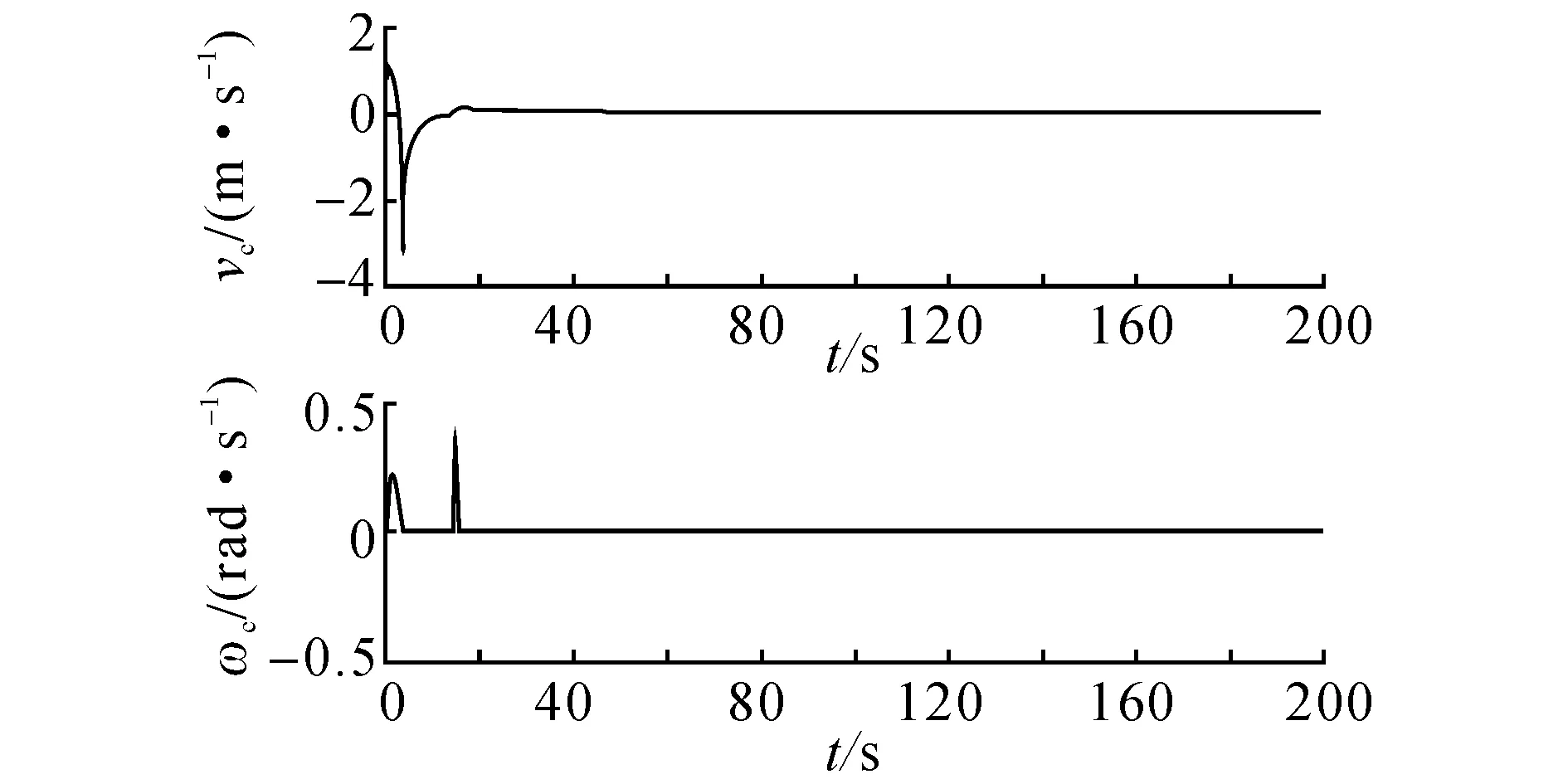

4.1运动过程中视野约束斥力场不产生作用

选取机器人在世界坐标系下的初始位置为[1,0,-3]T,旋转角为0.1rad.在移动向目标位姿的过程中,特征点没有运动到相机图像平面的边缘,视野约束斥力场未产生作用,机器人的运动轨迹如图10的左侧轨迹所示,特征点误差的收敛曲线如图11所示.图10中右侧的运动轨迹没有引入偏转势场的运动轨迹,对于具有沿轮轴向非完整约束的移动机器人,偏转势场的引入具有重要作用. 机器人运动过程中平移距离和旋转角度的收敛曲线如图12所示,机器人运动过程中速度和角速度的变化曲线如图13所示.

在改进人工势场的控制下,机器人能够沿着较光滑的曲线移动向目标位姿,运动过程满足非完整约束的限制条件,最终特征点的像素误差可以收敛到零.

图10 机器人运动轨迹示意图Fig.10 Trajectory of mobile robot

图11 特征点的像素误差收敛曲线Fig.11 Pixel error in image space

图12 机器人运动过程中平移距离和旋转角度的收敛曲线Fig.12 Convergence curves of translation error and rotation error during movement

图13 机器人运动过程中速度和角速度的变化曲线Fig.13 Velocity and angular velocity in process of movement

在机器人运动过程中,线速度和角速度由式(21)计算出的合力决定.当偏转角θ过大时,混合势场的控制效果应使机器人快速转向前进方向指向目标位置,所以开始阶段在Fa和Fθ的共同作用下,机器人迅速调整前进方向,这段过程中角速度较大.

在机器人逐渐接近目标位姿的过程中,td、θ和φ逐渐减小.由式(6)、(9)可知,受到的吸引力和偏转力逐渐减小,即机器人的线速度和角速度逐渐减小.当机器人到达目标位姿时,合外力中的各分量为零,即机器人可以停止在目标位姿.

4.2运动过程中视野约束斥力场产生作用

选取机器人的初始平移向量为[1,0,-2]T,旋转角为0.1rad,在运动过程中,特征点有移出视野的趋势,视野约束斥力场产生作用效果.机器人的运动轨迹如图14所示,特征点误差的收敛曲线如图15所示,机器人运动过程中平移距离和旋转角度的收敛曲线如图16所示,速度和角速度的变化曲线如图17所示.

图14 受视野约束作用时机器人在笛卡尔空间内的轨迹Fig.14 Moving trajectory in Cartesian space with FOV constraints

图15 受视野约束下特征点的像素误差收敛曲线Fig.15 Pixel error in image space with FOV constraints

图16 受视野约束下机器人运动过程中平移距离和旋转角度的收敛曲线Fig.16 Translation error and rotation error with FOV constraints

图17 受视野约束下机器人运动过程中速度和角速度的变化曲线Fig.17 Velocity and angular velocity with FOV constraints

当特征点脱离工作空间C时,斥力场产生排斥作用,使机器人回到安全视野范围.偏转势场和吸引势场对机器人的运动产生作用,使机器人在移向目标位姿的同时,前进方向指向目标位置.此时,这三个势场对角速度产生的作用效果相互平衡,特征点维持在图像平面的边界处.由于此时吸引势场对机器人的作用效果使机器人移动向目标位置,机器人将沿笛卡尔空间内的弧线移动向目标位姿,偏转角度不断变化,最终的偏转势场和吸引势场的合作用效果不再使特征点有移出工作空间C的趋势.此时,特征点回到不受视野约束斥力的图像空间,机器人此后的运动与上一部分的运动相似,最终停止到目标位姿.

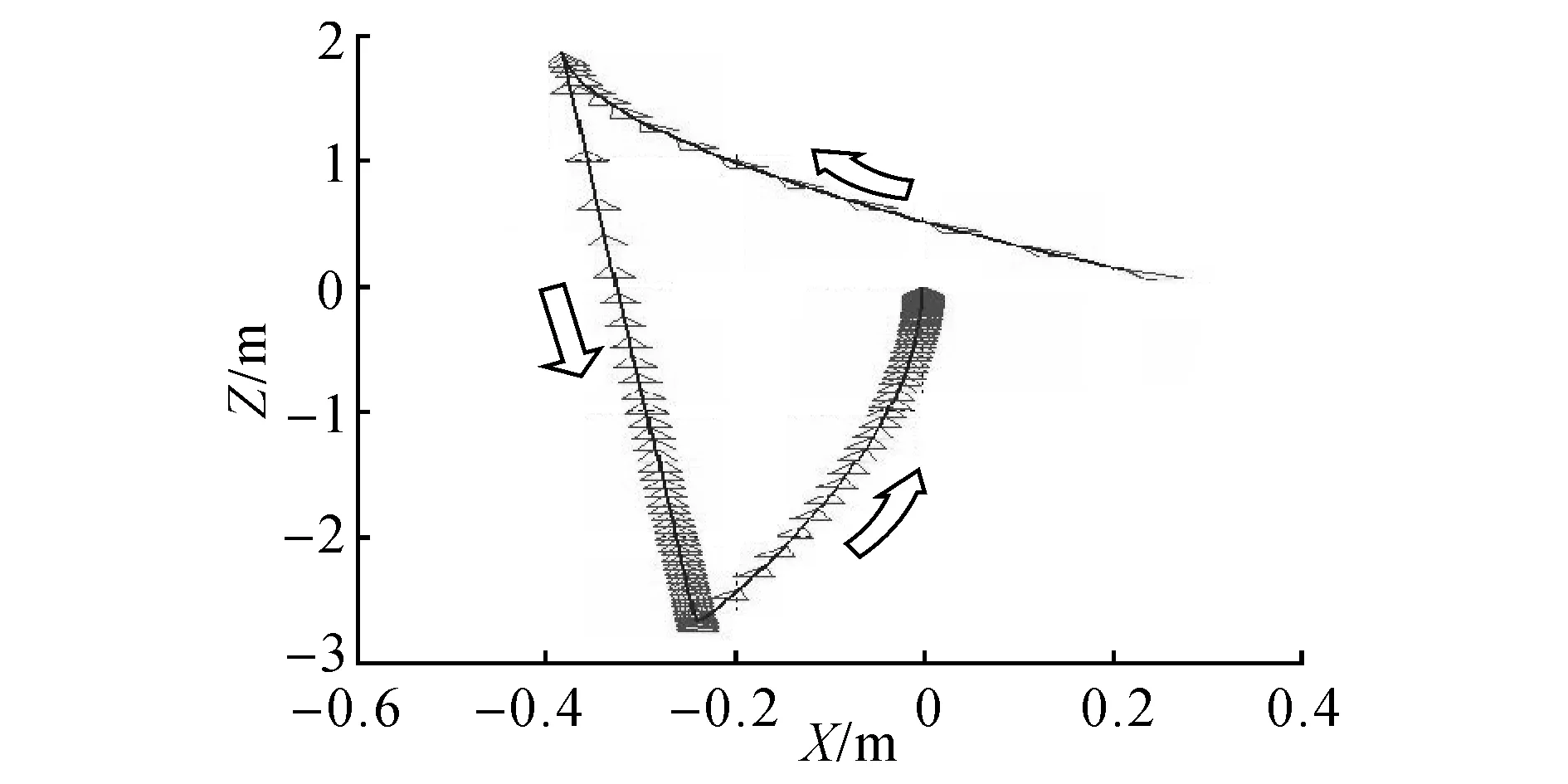

4.3跳出局部极值

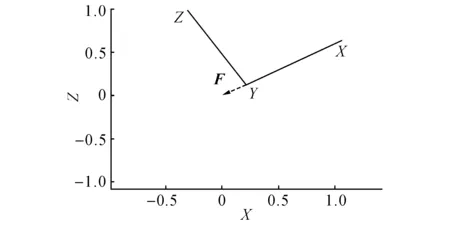

机器人在陷入局部极值后,将切换到针对该情况的轨迹规划方法中.此时,机器人将向前运动到第1个中间状态,然后向后退到第2个中间状态.选取机器人陷入局部极值时的位姿如图18所示,则这一过程中,机器人的运动轨迹如图19所示,机器人的速度和角速度的变化如图20所示.在前进过程中,机器人需要维持特征点在图像空间的边界处,且此时机器人较靠近目标点,调整特征点位置所需的角速度较大.当机器人后退到第2个中间状态后,以此时的状态作为新的初始位姿,此后的运动过程与上文讨论的过程相似.

图18 陷入局部极值时的机器人位姿Fig.18 Robot pose with local extremum

图19 笛卡尔空间内机器人跳出局部极值时的运动轨迹Fig.19 Moving trajectory in Cartesian space for robot to get rid of local minimums

图20 机器人跳出局部极值的过程中速度和角速度的变化曲线Fig.20 Velocity and angular velocity during robot getting rid of local minimums

5结语

本文针对载有单目相机的非完整移动机器人的视觉轨迹规划问题,提出基于混合人工势场的方法,将人工势场分为以下2个部分.一部分是只对机器人角速度起作用的目标点偏转势场和视野约束排斥势场;另一部分是同时影响线速度和角速度的目标位姿吸引势场,使机器人能够在满足视野约束和无侧滑约束的条件下运动到目标位姿.当陷入局部极值时,引入基于中间状态轨迹的规划方法,解决势场局部极小值问题.通过仿真验证了该轨迹规划方法的有效性.

参考文献(References):

[1] 贾丙西,刘山,张凯祥,等. 机器人视觉伺服研究进展:视觉系统与控制策略[J]. 自动化学报,2015,41(5): 861-873.

JIABing-xi,LIUShan,ZHANGKai-xiang,etal.Surveyonrobotvisualservocontrol:visionsystemandcontrolstrategies[J].ActaAutomaticaSinica, 2015, 41(5): 861-873.

[2]GONZALOLN,GANSNR,SOURABHB,etal.Homography-basedcontrolschemeformobilerobotswithnonholonomicandfield-of-viewconstraints[J].IEEETransactionsonSystemsManandCyberneticsPartBCybernetics, 2010, 40(4): 1115-1127.

[3]CAOZC,YINLJ,FUYL,etal.Predictivecontrolforvisualservostabilizationofnonholonomicmobilerobots[J].ActaAutomaticaSinica, 2013, 39(8): 1238-1245.

[4]SCHRAMMF,MORELG.Ensuringvisibilityincalibration-freepathplanningforimage-basedvicsualservo-ing[J].IEEETransactionsonRobotics, 2006, 22(4): 848-854.

[5]CHESIG,PRATTICHIZZOD,VICINOA.Straightlinepathplanninginvisualservoing[J].JournalofDynamicSystemsMeasurementandControlTransactionsoftheASME, 2007, 129(4): 541-543.

[6]CHESIG.VisualservoingpathplanningviahomogeneousformsandLMIoptimizations[J].IEEETransactionsonRobotics, 2009, 25(2): 281-291.

[7]CHESIG,HUNGYS.Globalpath-planningforconstrainedandoptimalvisualservoing[J].IEEETransactionsonRobotics, 2007, 23(5): 1050-1060.

[8]BORENSTEINJ,KORENY.Real-timeobstacleavoidanceforfastmobilerobots[J].IEEETransactionsonSystems,Man,andCybernetics, 1989, 19(5): 1179-1187.

[9] 朱毅,张涛,宋靖雁. 非完整移动机器人的人工势场法路径规划[J],控制理论与应用,2010,27(2): 152-158.

ZHUYi,ZHANGTao,SONGJing-yan.Pathplanningfornonholonomicmobilerobotsusingartificialpotentialfieldmethod[J].ControlTheoryandApplications,2010, 27(2): 152-158.

[10]FANGYong-chun,ZHANGXue-bo.Adaptiveactivevisualservoingofnonholonomicmobilerobots[J].IEEETranscationsonIndustrialElectronics, 2012, 59(1): 486-497.

[11] 李宝全,方勇纯,张雪波.基于2D三焦点张量的移动机器人视觉伺服镇定控制[J],自动化学报,2014,40(12): 2706-2715.

LIBao-quan,FANGYong-chun,ZHANGXue-bo. 2Dtrifocaltensorbasedvisualservoregulationofnonholonomicmobilerobots[J].ActaAutomaticaSinica, 2014,40(12): 2706-2715.

[12]MEZOUARY,CHAUMETTEF.Pathplanningforrobustimage-basedcontrol[J].IEEETransactionsonRoboticsandAutomation, 2002, 18(4): 534-549.

[13]ZHANGXue-bo,FANGYong-chun,MABo-jun,etal.Afasthomographydecompositiontechniqueforvisualservoofmobilerobots[C]∥Proceedingsofthe27thChineseControlConference.Beijing:BeihangUniversityPress, 2008: 404-409.

[14]CHAUMETTEF,HUTCHINSONS.Visualservocontrol.I.basicapproaches[J].IEEERoboticsandAutomationMagazine, 2006, 13(4): 82-90.

收稿日期:2015-06-25.浙江大学学报(工学版)网址: www.journals.zju.edu.cn/eng

基金项目:国家自然科学基金资助项目(61273133)

作者简介:丁夏清(1994-),女,本科生,从事视觉伺服的研究. ORCID:0000-0001-7802-0130.E-mail: xqding@zju.edu.cn 通信联系人:刘山,男,副教授.ORCID:0000-0003-1504-341X.E-mail: sliu@iipc.zju.edu.cn

DOI:10.3785/j.issn.1008-973X.2016.07.011

中图分类号:TP 242

文献标志码:A

文章编号:1008-973X(2016)07-1298-09

Visual trajectory planning for mobile robots based on hybrid artificial potential field

DING Xia-qing, DU Zhuo-yang, LU Yi-qing, LIU Shan

(CollegeofControlScienceandEngineering,ZhejiangUniversity,Hangzhou310027,China)

Abstract:A visual trajectory planning method was proposed based on hybrid artificial potential field for a nonholonomic mobile robot equipped with a monocular camera in consideration of field-of-view (FOV) constraints. A hybrid model was designed based on the concept of conventional artificial potential field. The model consisted of two parts. One part only affects the angular velocity and involves the terms for target deflection and field of view constraints, and the other part affects both the linear velocity and the angular velocity. The potential field for field of view constraints was defined based on the feature point coordinates in the image space. The potential fields for target deflection and the relative pose were calculated based on the scaled three-dimensional reconstruction results obtained from the decomposition of homography. The robot can be regulated to the desired pose with the targets kept in the field of view under the hybrid artificial potential field. Simulation results were provided in some representative circumstances to show the effectiveness of the proposed method.

Key words:mobile robot; nonholonomic constraint; field of view constraints; artificial potential field; homography matrix