基于小波光照归一化和高判别力特征的人眼定位算法

2015-07-18

(西华大学无线电管理技术研究中心,四川 成都 610039)

·计算机软件理论、技术与应用·

基于小波光照归一化和高判别力特征的人眼定位算法

高志升,岳 桢,张铖方,胡占强

(西华大学无线电管理技术研究中心,四川 成都 610039)

人眼定位是人脸识别、人脸分析等的前提,但是人眼定位的精度极易受到非均匀光照和噪声的影响。针对这一问题,提出一种结合小波变换光照归一化和高判别力特征的人眼定位算法。首先通过小波变换对人脸图像进行光照归一化处理,然后对人眼候选区域提取LTP和LPQ特征,对每个候选人眼区域计算SVR分类响应值得到人眼概率图,最后对人眼概率图进行高斯拟合,完成人眼精确定位。在人脸数据集CMU-PIE、Yale B和AR上的实验结果表明,该算法能有效克服非均匀光照对人眼进行精确定位的影响,具有光照变化鲁棒性,比同类算法有更高的定位精度。

小波;LTP;LPQ;SVR;高斯拟合

人脸识别作为目标识别的一个特例,涉及图像处理、模式识别、神经网络等学科,受到研究人员的广泛重视。人脸对齐是高精度人脸识别的一个前提。人眼作为人脸图像中最重要的特征,在人脸中占据比较固定的位置,且双眼间的距离刻画了人脸的大小,是人脸识别中尺度归一化的依据。

人眼定位近年来得到广泛的研究,取得了一系列成果[1-5],但是光照变化问题依然是影响人眼定位精度的主要因素;因此,很多学者致力于非均匀光下的人眼定位研究。非均匀光照环境中人眼定位算法主要有2种手段:1)首先对人脸图像进行去光噪预处理,然后再进行人眼定位;2)提取具有光照不变性的人眼特征进行人眼定位。Retinex算法[6]是基于视网膜理论的一个关于人类视觉系统如何调节感知物体颜色和亮度的模型,该方法是光照归一化的代表性方法。Jung等[7]提出一种基于Retinex理论的光照变化的人眼定位算法,通过Retinex理论进行人脸光照校正,然后提取边缘直方图特征并采用SVM进行人眼定位。文献[8]采用自商图像方法(SQI)通过矫正光照进行人眼定位。文献[9]在人眼定位处理之前,采用快速对数总变差方法(FLTV)进行光照归一化处理。SQI和FLTV均在Yale B数据库上取得了较好的效果。

本文提出一种融合LTP和LPQ特征算子的非均匀光照环境下人眼定位方法。该算法利用小波变换的优点,将其用于人脸图像光照归一化处理,然后在处理后的人脸图像中,提取候选人眼区域的具有光照不变性的LTP和LPQ特征,对每个候选人眼区域计算SVR分类响应值得到人眼概率图,最后对人眼概率图进行高斯拟合,完成人眼的定位。该方法利用小波变换对人脸图像进行光照归一化处理,同时利用LTP和LPQ特征使其具有光照不变性、噪声不变性的优点,能够很好地克服光照的影响,对人眼进行精确定位。

1 小波变换光照归一化算法

根据Retinex理论[6],图像由入射光分量和反射光分量组成:

(1)

(2)

(3)

结合Retinex理论,光照大多数处在图像的低频部分,而与光照无关的细节部分主要存在于图像的高频部分;因此,在对数域中对图像进行小波分解,将得到的低频系数置零,即可得到人脸图像的光照不变分量,完成人脸图像的光照归一化处理,其过程如图1所示。

图1 人脸图像光照归一化处理

2 高判别力特征提取

2.1局部三元模式特征

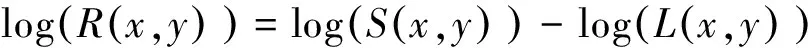

本文在每幅图像区域上采用局部三元模式(LTP,local ternary pattern)抽取局部邻域关系模式,并由这些模式的区域直方图形成特征序列来描述人眼[12]。与局部二元模式(LBP,local binary pattern)算子[13-14]类似,LTP算子对图像中每个像素ic的8邻域采样,每个采样点u与中心像素ic作灰度值三值化运算:

(4)式中:s′(u,ic,t)为三值函数;t为阈值。本文将每个LTP描述符分解为正负2部分,如图2所示,随后将这2个LTP描述符作为2个独立的通道,分别计算直方图,最后再将两者结合起来得到LTP特征序列。

图2 LTP算子计算

2.2局部相位量化特征

局部相位量化(LPQ,local phase quantization)是一种基于局部图像离散傅里叶变换的频域相位特征提取方法,对运动、失去焦点和大气湍流造成的中心对称模糊具有不敏感性[15-16]。

首先利用局部相位信息,计算图像上每个像素点的M×M邻域Nx来获取局部相位信息。

(5)

(6)

(7)

其中,Re{·},lm{·}分别表示一个复数的实部和虚部,其对应的8×M2转换矩阵是

W=[Re{wu1,wu2,wu3,wu4},lm{wu1,wu2,wu3,wu4}]T。

(8)

可得

Fx=Wfx。

(9)

通过一个简单的分级量化方法进行量化:

(10)

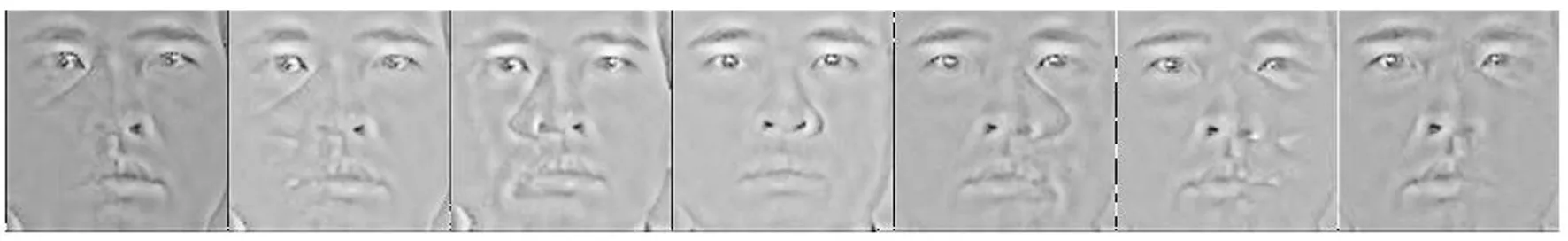

其中,fj表示Fx的第j个分量。量化后,Fx变为1个8位二进制数的向量,对每一个分量赋予权系数2j,通过式(11)计算出该点对应的LPQ值,最后,生成量化的256维直方图。

(11)

3 人眼定位算法

本文提出的融合小波和LTP、LPQ算子的人眼定位算法,首先从原始光照图像中检测出人脸区域,并归一化到大小为100×100的人脸图像I,然后利用小波变换对I进行去光噪(本文采用3级小波分解,小波选用‘db8’),得到去光噪图像Irex,如图3所示,接着选取部分图像为训练样本集,其余的为测试样本集。在训练样本集中,手动截取大小为10×20的人眼正负样本Ig,如图4所示。针对Ig,本文采用半径R为1、采样点P为8和半径R为2、采样点P为16的2种不同参数的LTP特征算子(分别定义为LTP8和LTP16),阈值t=3,进行人眼特征提取。同时,为更好地表达人眼,本文还结合LPQ(其中,参数选取高斯导数正交滤波器)特征进行人眼特征提取。在特征提取过程中,把人眼特征系数4等分,然后分别提取特征直方图,最后级联一起,得到本文采用的人眼描述特征Fe,如图5所示。

(a)原始人脸图像

(b)小波光照归一化图像

(a)正样本

(b)负样本

(a)正样本特征

(b)负样本特征

完成特征提取后,通过训练数据训练人眼检测器,然后在测试人脸图像中定位人眼。这一过程,选用支持向量回归完成人眼检测定位。

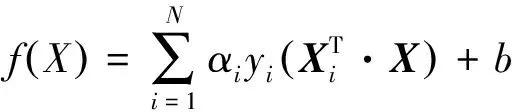

支持向量回归是支持向量机的一个分支。支持向量机是Vapnik[17]提出的二值分类器。它的中心思想是找到一个超平面,通过最大化2种样本的间距,从而达到分离2种样本的目的。这个超平面的决策函数可以表示为

(12)

式中:f是样本与超平面之间的距离函数;X是输入的特征向量;α是拉格朗日乘数;Xi是第i个支持向量;yi是支持向量的标签;N是支持向量的总个数。考虑到非线性条件,采用非线性核函数,转换至高维空间,然后进行分类[18]。式(12)可以转换为

(13)

其中k是核函数。

在归一化人脸图像中定位人眼,对于右眼定位,选取大小为10×20的矩形窗口在人脸图像左上角进行滑动,窗口覆盖的区域作为候选人眼区域,将每个候选区域提取人眼特征Fe并输入SVR得到分类响应值。每个候选人眼区域的分类响应值构成人眼概率图,最后通过二维高斯拟合定位出人眼的精确位置,二维高斯的中心点作为最终的人眼位置,如图6所示,白色方框为高斯拟合结果,白色圆圈为最大值定位结果。对于左眼的定位,对人脸图像进行对称变换后采用右眼定位方法完成。针对支持向量机的参数,核函数选取径向基函数。为获得更好效果的核函数参数g和C,进行10倍交叉验证,结果g=2-12,C=10。f样本与超平面之间的距离函数通过文献[19]求得。

4 测度验证

为了验证人眼定位的准确性,常用的算法是Jesorskey等[20]提出的Hausdorff距离误差法。定义e=max(dl,dr)/d,其中dl和dr分别是算法定位到的左、右眼和真实左、右眼位置的欧氏距离,d是真实左、右眼之间的欧氏距离。同时,经过大量实验验证,e取为0.25(内眼间距的1/4)。当e≤0.25时,算法定位到的人眼位置认定为成功。此时,d近似等于单眼宽度的2倍。在实验中,采取

(a)高斯拟合示意图 (b)高斯拟合的结果

abs(dx-px)≤disparity && abs(dy-py)≤disparity。

(14)

其中,(dx,dy)是算法获取的点,(px,py)是人工标注的点,disparity分别取为0.25R、0.3R、0.35R、0.4R、0.45R、0.5R,R是人眼的宽度。

5 实验结果

笔者将通过实验来评估所提方法的有效性。在熟知的3个人脸库CMU PIE、Yale B和AR上进行人眼定位实验,以此来论证该方法的鲁棒性。CMU PIE数据库包含68个对象的4万1 368张图片,对每个对象,选取21种不同光照环境下的正面照,共计1 428张图像。Yale B数据库包含10个对象576种观测条件(即9种姿态,64种光照条件)的5 760张图片,选取10个对象正面姿势的64种光照条件的640张图片。AR数据库包含126个对象的26种正面照,选取120个对象的6种光照下的720张图片。其中,每个库选取500张图片用于训练,其余的用于测试。

在实验中,为使实验过程简便,把人脸图像进行左右翻转,这样提取的数据都是图片右眼的位置。手工截取的人眼图像和近似人眼图像作为训练样本的部分样本如图4所示。测试样本通过人工标注方式给出人眼的参考位置,然后采用本文算法定位人眼位置,最后根据式(14)判定定位正误。图7、8展示了部分代表性的定位结果,白色圆圈为本文算法定位结果,白色方框为人工标注位置。图7展示了本文方法正确定位人眼的结果;图8展示了本文方法错误定位人眼的部分样本,这里disparity取值为0.5R。

图7 本文算法正确定位人眼

图8 本文算法错误定位人眼

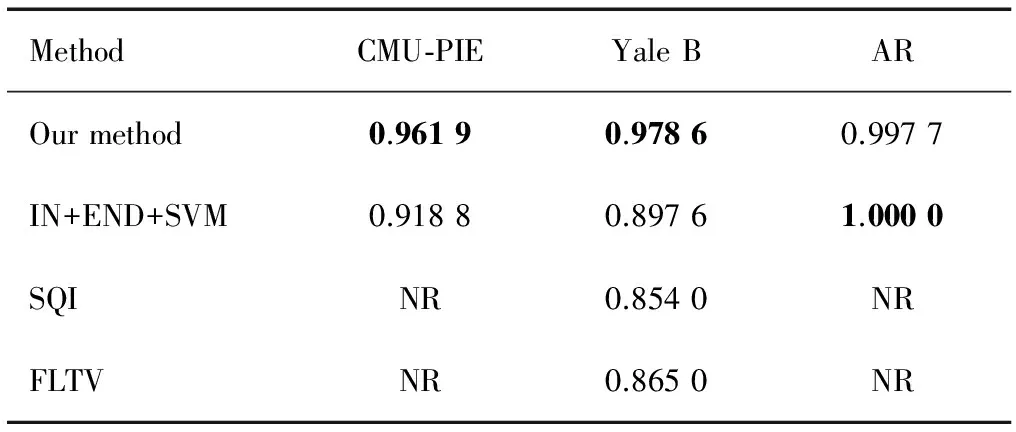

将当前经典方法与本文方法进行定位准确率的比较。文献[7]提出IN+END+SVM的方法;文献[8]采用自商图像方法(SQI)通过矫正光照,从而进行人眼定位;文献[9]采用快速对数总变差方法(FLTV)进行光照归一化处理。SQI和FLTV均在Yale B数据库上进行实验,与本文的Yale B数据一致。表1给出了不同方法得到的人眼定位成功率,其中,黑体代表在每个数据库取到的最好准确率。可以看出,与经典方法相比,本文方法在CMU-PIE、Yale B和AR 这3个数据集上都获得了最高的准确率,即使在复杂光下也有很明显的优势(Yale B数据库光照比较复杂):比SQI和FLTV方法高10%,比IN+END+SVM方法高8%。

表1 各个方法的准确率

注:NR表示没有提及。

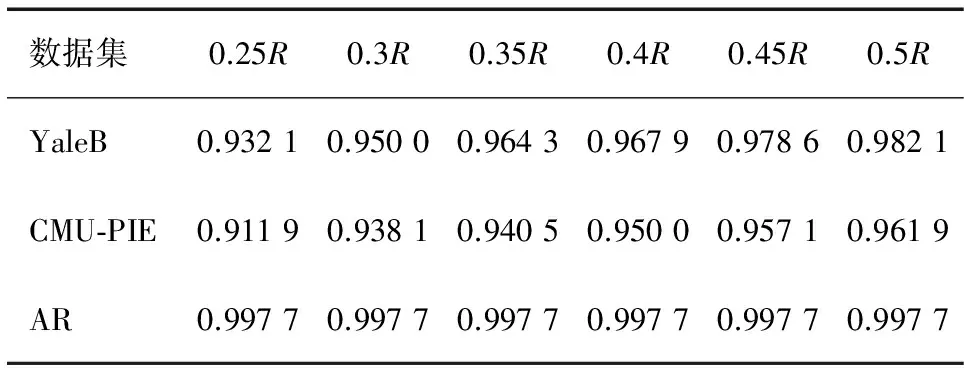

为了更直观、有效地表达本算法的有效性,在(0.25R,0.3R,0.35R,0.4R,0.45R,0.5R)条件下,对定位到的人眼进行人眼测度验证,其结果如表2和图9所示。可以得出:本文方法在0.25R条件下,在AR数据集上获得了接近100%的准确率,在Yale B和CMV-PIE数据集上也得到超过90%的准确率;在0.5R条件下,在YaleB和CMV-PIE数据集得到超过96%的准确率。这说明本文采用小波算法对人脸图像进行光照归一化处理并采用具有光照不变性的LTP和LPQ特征进行人脸定位,具有高的准确率、正确率及很好的鲁棒性。

表2 各个测量值下的准确率

图9 各个测量值下的准确率

6 结论

本文在利用小波变换对人脸图像进行光照归一化的基础上,提取人眼LTP和LPQ特征,最后结合SVR得到候选人眼位置概率图,通过二维高斯拟合完成非均匀光下人眼定位。与当前其他经典方法相比,本算法获得了较好的鲁棒性。相信本算法,可以在以后的非均匀光下人眼定位方面取得广泛的应用。如何解决时间开销长的问题,怎样结合人眼结构特征,进一步细化定位位置,精确定位到眼球中心位置都值得进一步研究。

[1]Weimin Huang, Robert Mariani. Face Detection and Precise Eyes Location[C]//Proc IEEE Int Conf Pattern Recognition. [S.l.]:IEEE,2000: 722-727.

[2]Liang Tao, HK Kwan. Automatic Localization of Human Eyes in Complex Background[J].IEEE International Symposium on Circuits and Systems, 2002,5: 669-672.

[3]Fengyi Song, Xiaoyang Tan, Songcan Chen, et al. A Literature Survey on Robust and Efficient Eye Localization in Real-life Scenarios[J].Pattern Recognition, 2013, 46 (12): 3157-3173.

[4]谢春芝.基于Eye Map和SIFT特征的人眼定位[J].西华大学学报:自然科学版,2012,31(3):7-10.

[5]舒梅,董秀成.基于累积帧差的人眼定位及模板提取[J].西华大学学报:自然科学版,2008,27(6):25-27.

[6]Land E. An Alternative Technique for the Computation of the Designator in the Retinex Theory of Color Vision[J]Proc Natl Acad Sci, 1986, 83(10):3078-3080.

[7]Jung C, Sun T, Jiao L. Eye Detection under Varying Illumination using the Retinex Theory[J]Neurocomput, 2013, 113 (8):130-137.

[8]Jung S U, Yoo J H. A Robust Eye Detection Method in Facial Region[J]Lect Notes Comput Sci, 2007, 4418: 596-606.

[9]Yang F, Su J. Fast Illumination Normalization for Robust Eye Localization under Variable Illumination[J].Electron Imaging, 2009, 18 (1):25.

[10]Donoho D L. De-Noising by Soft-Thresholding[J]. IEEE Transactions on Information Theory, 1995, 41 (3): 613-627.

[11]Mallat S. A Theory for Multiresolution Signal Decomposition: The Wavelet Representation[J].IEEE Trans Pattern Anal Mach Intel, 1989, 11 (7): 674-693.

[12]Tan X, Triggs B. Enhanced Local Texture Feature Sets for Face Recognition Under Difficult Lighting Conditions[J].IEEE Trans on Image Processing, 2010,19(6):1635-1650.

[13]Ojala T, Pietikainen M, Harwood D. A Comparative Study of Texture Measures with Classification Based on Feature Distributions[J].Pattern Recognition, 1996, 29(1):51-59.

[14]Ojala T, Pietikainen M, Maenpaa T. Multiresolution Gray-scale and Rotation Invarianattexture Classification with Local Binary Patterns[J].IEEE TPAMI, 2002, 24 (7): 971-987.

[15]Ojansivu V, Heikkila J. Blur Insensitive Texture Classification Using Local Phase Quantization[C]//Proc Int’l Conf Image and Signal Processing(ICISP).[S.l.]:Springer-Verlag, 2008: 236-243.

[16]GAO Zhisheng, YUAN Hongzhao ,YANG Jun. Search of Face Verification Algorithm Based on RILPQ Descriptor[J]. Application Research of Computers, 2012, 29 (1): 352-355.

[17]Vapnik V N. Statistical Learning Theory[M]. New York: John Wiley and Sons, 1998: 23-730.

[18]Jung C, Jiao LC, Sun T. Illumination Invariant Eye Detection in Facial Images Based on the Retinex Theory[C]//Proceeding of IscIDE. Xi’an:Springer, 2011: 175-183.

[19]Wang P. Automatic Eye Detection and Its Validation[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. San Diego, CA, USA:IEEE, 2005:164.

[20]Jesorsky O, Kirchberg K, Frischholz R. Robust Face Detection using the Hausdorff Distance[J]. Audio-and Video-Based Biometric Person Authentication Lecture Notes in Computer Science, 2001,2091: 90-95.

(编校:饶莉)

EyeLocationAlgorithmBasedonWaveletTheoryandHighDiscriminationFeatures

GAO Zhi-sheng, YUE Zhen, ZHANG Cheng-fang, HU Zhan-qiang

(CenterofRadioAdministratorandTechnologyDevelopment,XihuaUniversity,Chengdu610039China)

Eye location is the prerequisite for face recognition and face analysis. However, the accuracy of eye location is vulnerably affected by non-uniform illumination changes and noise. To solve this problem, this paper proposes an algorithm based on wavelet theory and high discrimination features for eye location. Firstly, face images undergo illumination normalization utilizing wavelet theory. Secondly, the LTP and LPQ features are extracted from the eye-candidate regions. and then the eye probability map is subsequently obtained from the calculation of the responding classification value of SVR for each eye-candidate point. Lastly, applied Gaussian fitting method to the eye probability map and the human eye is located accurately. Extensive experiments on CUM PIE, Yale B and AR Face Databases demonstrate that our method can effectively overcome the bad effects of non-uniform illumination changes and noise for the accurate eye location, and improve the robustness to changes in illumination and outperform the state-of-the-art approaches in terms of the accuracy of eye localization.

wavelet; LTP; LPQ; SVR; Gaussian fitting

2014-06-27

国家自然科学基金项目(61372187,61473239);四川省教育厅重点项目(14ZA0118)。

高志升(1977—),男,副教授,博士,主要研究方向为图像理解、机器学习等。E-mail:gzs_xihua@mail.xhu.edu.cn

TP391.41

:A

:1673-159X(2015)03-0001-05

10.3969/j.issn.1673-159X.2015.03.001