结合图像特征比的红外与可见光图像融合算法

2013-06-07叶仕通

叶仕通

结合图像特征比的红外与可见光图像融合算法

叶仕通

(广东工业大学华立学院,广东广州511325)

针对现有图像融合算法得到的融合图像清晰度不高以及边缘模糊等问题,提出了一种结合图像特征比的红外与可见光的图像融合算法,通过小波变换将图像进行分解,并通过计算低频分量中空间频率比与能量比,来对低频分量中的有效信号进行保留,而对高频分量则是通过边缘检测算法计算出高频分量中的边缘信号比,来对高频分量的边缘信号进行保留;实验结果表,该算法能够得到相比其他算法更为清晰的融合图像,具有一定的实用价值。

图像融合算法;小波变换;红外图像;可见光图像;边缘检验

1 引 言

面对复杂多变的工作环境,如果单一地采用一种图像传感器来对外界环境进行描述很难,根据多传感器信息之间的互补性与冗余性,能够有效地解决单一成像传感器的不全面与不准确等问题。但根据多成像传感器输出信息的不可交替显示与简单叠加特点,人们通过采用图像的融合技术来保留每一个成像传感器所获取的重要信息。因此,图像的融合技术成为了现如今的研究热点,其中根据信息表征层次可以将图像的融合算法分为像素级融合、特征级融合和决策级融合这三大类[1-5]。比较具有代表性的融合算法大多为像素级融合算法,如小波变换[6-7]、Contourlet变换[8-9]以及IHS变换[10]等。本文通过研究红外与可见光传感器这两类常见的传感器,将红外传感器探测性高,清晰度低的特点与可见光传感器清晰度高、探测性低的特点进行融合,从而得到更为丰富的图像信号。

根据红外图像与可见光图像的不同特点[11],为更加有效的将这两种图像进行的融合,本文提出了一种结合子带间空间频率比与边缘比的图像融合算法。采用小波变换将图像分别低频分量与高频分量并对其进行分类处理,对于图像的低频分量,通过计算其图像间的空间频率比与能量比来对低频分量中的有效信号进行保留。而多于图像的高频分量则是采用边缘检测算法,计算出图像间的边缘信号比进行筛选,从而保护图像中边缘信号,来实现红外图像与可见光图像间的有效融合。

2 小波算法

根据Campbell和Robson的实验表明,图像融合算法的小波分解过程与人的视网膜在不同的频道中进行处理是相类似的,因此,通过采用小波变换的图像融合算法可以获得与人的视觉特性接近的融合效果。在L2(R)空间中的任意函数都可以由一组称为小波函数的分解来表征,即给定一个基本小波函数ψ,对于任意的f∈L2(R),定义二元函数:

其中,f为连续小波变换。

3 基于小波变换的图像融合

基于快速小波变换的融合算法的流程阐述如下:首先,对已配准的源图像进行小波分解,通过使用一组高低通滤波器进行滤波,分离出图像的高频信息和低频信息;其次,对每层分解得到的高频信息和低频信息依据所得到的信息特点,采取不同的融合策略,在各自的变换域进行特征信息抽取,分别进行融合;最后,采用第一步的小波变换的重构算法对处理后的小波系数进行反变换重建图像,即可得到融合图像。图1为图像的融合流程图。

图1 图像的融合流程图

通过小波变换后能有效的将图像分为低频子图像以及高频子图像,如何有效的设计与选择合理的融合规则对图像的融合质量影响很大。而传统的融合算法大多都只是简单的提取图像中的细节提取以及采用简单的加权算法对低频信号进行处理,使得到的融合图像不能得到最佳的融合效果。因此,针对红外图像与可见光图像的图像特性,本文对图像的低频分量与高频分量进行分类处理,通过计算其图像的空间频率比与能量的大小来保留低频子带的特征,而高频子带则是采用边缘检测算法来提升高频分量中细节信号的利用率,进而提高算法的信息提取效率。

4 低频分量

4.1 空间频率比

图像的空间频率是与梯度相关的指标,它反映了图像的边缘化程度,能很好地描述图像的灰度突变信息。其中图像的空间频率越大,则表明图像越活跃、越清晰[12]。对M×N的图像空间频率定义为:

其中,RF和CF分别表示行频率和列频率。

其中,f(x,y)表示像素位置(x,y)处的灰度值。

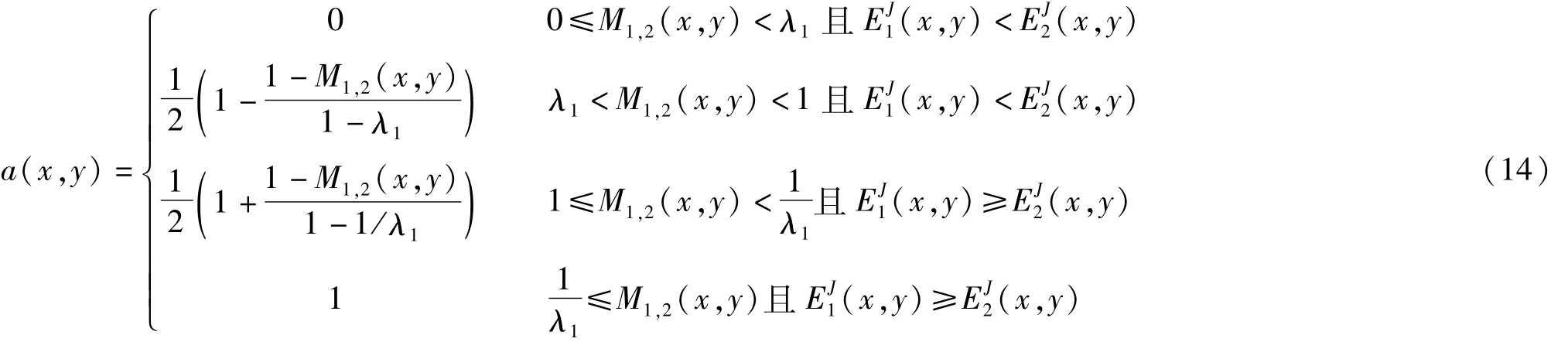

根据上述定义不难得出,以M×N为区域大小以及以(x,y)为中心的空间频率为:

其中,i的取值为1和2,RF2i(x,y)与CF2i(x,y)分别表示的是图像i在的行频率域列频率。

通过对图像1与图像2进行空间频率计算,可以得到:

图像1的空间频率为:

图像2的空间频率为:

进而可以定义图像1与图像2的空间频率比,即:

根据得出的图像的空间频率比来很衡量两幅图像的相关程度,进而反映图像间的相似性。为了方便计算,文章引入阈值λ来对图像的相似性进行分类,其中λ∈(0,1),本文λ取0.68。

1,2像的空间特性差异较小,即相似程度比较大。

1,21,2则说明两幅图像在该位置的空间特性差异较大。

4.2 融合规则

通过小波变换分解后,可以采用低频分量对原始图像进行近似描述;因此,通过考虑低频系数间的相关性,采用基于能量与空间频率比的加权算法与进行图像的融合:

而通过仅采用加权算法对图像的低频分量进行融合定义,图像容易出现亮度无法预测等现象。为了更好地保护红外图像中得到图像信号,使融合图像能够有一个较好的融合质量,对该加权算法引入了基于能量的计算函数,如下所示。

能量计算函数:

其中,i为原始图像的编号,即i=1,2;J为当前所在层数。则可得图像能量如下:

图像1能量:

图像2能量:

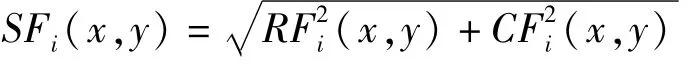

为了使其更好地进行融合处理,采用选择模式对α(x,y)值进行定义,具体形式如下所示:

通过根据M1,2(x,y)值的大小以及能量的大小来对图像的加权系数进行定义,以便函数能够最大限度的保留源图像的低频部分的特征。

5 高频分量

图像的高频分量主要存储的是图像中的细节分量,即包括图像的边缘信号等,而对于边缘信号提取质量的好坏对图像的整体质量影响很大[13]。因此,为了更好地提取图像中的边缘信号,采用基于边缘检测算法的高频融合方法。

5.1 边缘检测算法

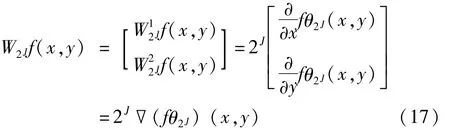

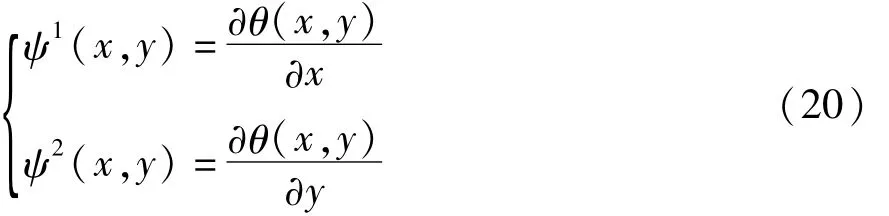

定义尺度2J时函数f(x,y)小波变换小波系数模与幅角表达函数如下所示:

模:

幅角:

其中:

ψ1(x,y)、ψ2(x,y)作为二维小波变换的基函数;θ(x,y)为二元平滑函数,且满足小波函数为:

为了能够更好地对边缘信号进行表述,本文令MJif(x,y)=M2Jf(x,y),其中i表示图像编号,J为所在的层数。

通过图像的边缘检测算法,来有效的对图像高频分量中的边缘信号进行提取,进行减少算法中的一些不必要的计算法,并将两幅图像所提取的边缘信号采用融合规则进行融合,实现图像的有效融合。

5.2 融合规则

通过采用边缘检测算法来对图像1与图像2的边缘信号进行边缘检测,设MJ1f(x,y)与MJ2f(x,y)为图像1、2的边缘信号模值,MJFf(x,y)为融合后的边缘模值,则有:

图像1的边缘模值:

图像2的边缘模值:

即可得边缘信号的模值比:

为了提高算法对边缘信号的处理速度,对其进行分类,即引入判断边缘强度的阈值λ2,其中λ2∈(0,1);通过对检测后的所得到的图像边缘信号的模值比进行判断,来获得融合后的边缘信号,其具体形式如下所示:

其中阈值λ2取0.85。基于图像边缘检测的融合方法通过针对高频分量中的边缘信号来重构生成融合图像,比较两幅图像中的边缘信号的强弱来实现对强边缘信号的保护,并将图像的重构误差控制在一个合理的范围内。有效地减少参加融合算法的像素点个数来提高的算法的融合速率。

6 图像融合效果的客观评价

图像的融合算法是通过加强信息量获取以及对保护边缘细节来改善图像视觉效果的。而图像的融合算法是通过消除同一场景下的多幅图像的冗余性,来使其合成的图像更加清晰以及全面的。为了检验算法是否符合以上优点,选用了以下指标对其进行评价。

6.1 熵

熵值的大小表示图像所包含的平均信息量的多少,图像的熵定义为:

其中,L为图像的总灰度级数;而Nl为灰度值为i的像素,而N为图像的总像素。

对图像的熵值进行计算,通过比较图像的熵值可以更好的展示图像额细节表现能力,其中融合后的图像的熵值越大,则表示其融合后的信息量也就越多。

6.2 标准差

均值定义为:

其中,N为图像的像素总数;xi为第i个像素的灰度值。

则图像的标准差为:

由于小波分解后的高频分量存储着图像的细节特征,即边缘信号等,而局部区域的标准差能够很好的反映各像素灰度对应于区域灰度均值的离散情况;其中标准差越大,其灰度级分布的越分散,则图像的灰度级出现的概率越接近;从而可以更好的反映融合后图像的边缘、纹理等信息。

6.3 相关函数

假设Ff表示融合后的图像,而Fp为图像融合的理想结果。

则他们之间的互相关函数为:

其中,M,N为图像的大小,通过计算法其图像的相关性,来研究图像的融合效果,其中互相关函数值越大,其表示的融合效果越好[14]。

7 仿真实验

为了验证算法的可行性,选用小波变换融合算法、提升小波融合算法以及文献[1]算法与本文算法进行比较,采用MATLAB 7.10.0进行算法的仿真实验,并给出了两组同一场景且大小相同的可见光图像和红外图像为待融合源图像。其中选取较为简单的红外图像A为与可见光图像B,其大小都为352×240;而第二组则是采用图像较为复杂的红外图像C与可见光图像D,其大小都为352×288;通过仿真实验,得图2和图3为各算法的仿真效果图,如下所示。

图2 各算法的仿真效果图

图3 各算法的仿真效果图

由融合后的效果图可以看出,本文算法的图像融合效果优于其他算法,可以看出采用本算法所得到的融合图像的视觉效果最佳,图像的清晰度以及亮度都优于其他算法,从图2的(f)中可以看到,本文算法能有效地保留可见光图像中的背景信号,且红外图像中的信号也能被很好的表现出来,从而在融合图像中能够较好的看到红外图像中的发热源;而图3的(f)中,也可以清楚地看到,本文算法能够保持较高的清晰度,有效地将红外图像与可见光图像进行融合,具有较高的信息融合效果。

根据上述的几种评价标准,对仿真后的图像进行熵值、标准差、以及相关系数的测量,得表1为图像A与图像B融合数据表,表2为图像C与图像D融合数据表,如下所示。

表1 图像A与图像B融合数据表

由表1可看出,当所采用的待融合图像较简单时,本文所提出的方法在标准差、熵值以及相关系数上优于其他算法,其中相关系数优势明显。有效证明了算法优于其他算法,并证实了本文算法能够有效的对图像进行细节提取。

表2 图像C与图像D融合数据表

由表2可看出,当所采用的待融合图像较复杂时,本文所提出融合算法依然能够保持加高的标准差、熵值以及相关系数,其中标准差与相关系数优势明显。有效证明了算法优于其他算法,并证实了本文算法能够有效的对图像进行细节提取,使得融合后的图像具有清晰度高,携带信息丰富的特点。

进而有效地证明了本文算法能够很好的利用可见光图像与红外图像的不同特性对图像进行融合,做到优势的互补,虽然由表1与表2中可以看出本文算法所消耗的时间与小波变换融合算法的时间一样长,但其良好的融合效果与预期的效果相符,具有一定的实用价值。

8 结束语

提出了一种结合图像特征比的红外与可见光的图像融合算法,根据红外图像与可见光图像的不同特性,分别计算出图像中的低频分量与高频分量中的特征比,并通过合理的进行筛选,来实现图像的优势互补。实验结果表明,该算法不仅能够有效的保证融合图像清晰度,而且能够有效保留图像中的重要信息,但算法中的融合速度有待提高,将作为以后的研究目标对其进行深入的研究。

[1] Jamal Saeedi,Karim Faez.Infrared and visible image fusion using fuzzy logic and population-based optimization[J].Applied Soft Computing,2012,12(3):1041-1054.

[2] Wang Haihui.A new multiwavelet-based approach to image fusion[J].Journal of Mathematical Imaging and Vision,2004,21(2):177-192.

[3] SH Chen,B Su,H Zhang.Feature space and metric measures for fusingmultisensory images[J].International Journal of Remote Sensing,2008,29(11):3257-3270.

[4] Wang Zhaobin,Ma Yide,Gu Jason.Multi-focus image fusion using PCNN[J].Pattern Recognition,2010,43(6):2003-2016.

[5] Chen Musheng.Image fusion based on contourlet transform and fuzzy theory[J].Laser&Infrared,2012,42(6):695-698.(in Chinese)陈木生.基于Contourlet变换和模糊理论的图像融合算法[J].激光与红外,2012,42(6):695-698.

[6] Richa Singh,Mayank Vatsa,Afzel Noore.Hierarchical fusion ofmulti-spectral face images for improved recognition performance[J].Information Fusion,2008,9(2):200-210.

[7] Jing Tian,Li Chen.Adaptive multi-focus image fusion using a wavelet-based statistical sharpness measure[J]. Signal Processing,2012,92(9):2137-2146.

[8] Shuyuan Yang,Min Wang,Licheng Jiao.Contourlet hidden markov tree and clarity-saliency driven PCNN based remote sensing images fusion[J].Applied Soft Computing,2012,12(1):228-237.

[9] Zhang Qiang,Guo Baolong.Multifocus image fusion using the nonsubsampled contourlet transform[J].Signal Processing,2009,89(7):1334-1346.

[10]He Chu,Liu Mengling,LiNa,etal.Multiple input tomultiple output images fusion based on turbo iteration[J]. EURASIP Journal on Advances in Signal Processing,2010,2010(6):1-12.

[11]PJamesW Davis,PVinay Sharma.Background-subtraction using contour-based fusion of thermal and visible imagery[J].Computer Vision and Image Understanding,2007,106(2-3):162-182.

[12]Li Shutao,Yang Bin.Multifocus image fusion using region segmentation and spatial frequency[J].Image and Vision Computing,2008,26(7):971-979.

[13]Bai Xiangzhi,Zhou Fugen,Xue Bindang.Edge preserved image fusion based on multiscale toggle contrast operator[J].2008,29(12):829-839.

[14]Wei Chuanming,Rick SBlum.Theoretical analysis of correlation-based qualitymeasures forweighted averaging image fusion[J].Information Fusion,2010,11(4):301-310.

Infrared and visible image fusion algorithm based on combined image characteristics ratio

YE Shi-tong

(Huali College Guangdong University of Technology,Guangzhou 511325,China)

Aiming at low definition and blurred edges of the fusion image that obtained by existing image fusion algorithm,an infrared and visible image fusion algorithm based on combined image characteristics ratio is putout.The image is decomposed by wavelet transform,and the valid signal in the low frequency component is retained through calculating the low-frequency component of the spatial frequency ratio and the energy ratio.And in the high-frequency components,edge ratio is calculated by using the edge detection algorithm.At last,the edge of the image signal is retained.Experimental results show that this algorithm can get the clearer fusion image than other algorithms.

image fusion algorithm;lifting wavelet;infrared image;visible image; edge inspection

TP391

A

10.3969/j.issn.1001-5078.2013.11.07

1001-5078(2013)11-1234-06

叶仕通(1981-),男,讲师,硕士,研究方向为视频信号处理,计算机视觉,模式识别,图形图像处理及数据挖掘。E-mail:yst888_0@126.com

2013-04-09;

2013-05-03