基于改进YOLOv8的X线安检图像违禁品检测方法

2025-01-12毛玮杨杨军刘栩栋梁道正

人工安检效率低,易出错,实现基于人工智能的自动安检是安检的发展趋势.针对YOLOv8目标检测模型在X线违禁品检测中检测精度低和对少量类别漏检率高的问题,对YOLOv8模型进行改进.在YOLOv8n的基础上修改网络结构,引入注意力机制,提出带有通道注意力(efficient channel attention,ECA)的YOLOv8-ECA目标检测模型,以便更好地提取X线图像中违禁品的特征,同时采用图像旋转等一系列数据增强方法,对少量类别样本进行样本扩充.在自建的X线安检图像数据集上进行实验.实验结果表明,改进后的算法较原始YOLOv8n模型在检测精度上提升6%,在检测速度上较原始YOLOv8n模型提升15.7%,同时降低少量类别的漏检率.

YOLOv8n; ECA注意力; 深度学习; X线图像; 违禁品检查

O357.5 A 0253-08 02.010

伴随着社会科技的不断发展,人们的出行方式变得更加多元化.同时,违禁品的种类也变得更加复杂.因此,在如今的社会中,安检是一项不可或缺的工作.安检被广泛应用于飞机、火车和地铁等场所,在人们的生活中发挥着非常重要的作用[1].

X线安检图像通过安检仪生成,安检仪是安检程序中最常用的设备,X线安检图像具有以下特点:1) 重叠性:安检图像中存在一定的区域,这块区域中会有很多物品重叠在一起,从而产生严重干扰.2) 多尺度性:安检物品种类繁多,形状也各不相同,甚至可能因外力导致物体变形,导致同一类别的违禁品在外观上出现较大差异[2-4].

目前,我国的X线安全检查主要是通过安全检查人员和设备共同进行.在这一工作方式中,安全检查人员的工作状况常常决定着安全检查的质量.人工检查受到精力的限制,还会造成工作效率低下,很有可能出现误检和漏检的情况[5-7]. 因此,使用现有的目标检测网络并不能更加精确地检测出违禁品.

本文主要从以下2个方面进行研究:1) 针对YOLOv8n目标检测模型在X线违禁品检测中检测精度低和对少量类别漏检率高的问题,在YOLOv8n模型的基础上修改模型结构,加入ECA注意力机制,提出带有注意力机制的目标检测网络模型,命名为YOLOv8n-ECA,并与原模型YOLOv8n进行对比实验分析.2) 针对X线图像类别数量不均衡问题,利用数据增强的方法,对少量类别样本进行样本扩充,提高模型的鲁棒性.

实验结果表明,加入ECA注意力机制后的YOLOv8n-ECA网络的性能相较于YOLOv8n网络有明显提升,在检测精度上提升了6%,检测速度提升了15.7%,更适合用于违禁品检测.本文主要贡献有:1) 针对YOLOv8n网络精确度较低的问题,通过改进激活函数、添加注意力机制以获得更佳效果.2) 针对X线图像类别数量不均衡问题,进行数据增强处理,均衡不同种类的数量,提高模型的鲁棒性.

1 相关工作

1.1 目标检测算法

神经网络和深度学习算法已广泛运用在许多任务上[8-11],在目标检测任务上,当前主流的方法是基于深度学习的方法.目前的目标检测算法主要分为单阶段和双阶段2类检测算法.

1) 单阶段方法:2016年,文献[12]提出了关于目标检测YOLO(you only look once)的概念和一种单阶段主要算法,之后文献[13-14]提出了SSD算法,随后文献[15-17]的网络精确度也在不断提升,版本也升级到2023年的YOLOv8,YOLOv8n是YOLOv8系列的一种.

2) 双阶段方法:文献[18]提出的RCNN模型为以后的双阶段目标检测技术的开发打下了坚实的基础.后续时间里依次出现了快速的Fast R-CNN[19]网络、更快速的Faster R-CNN[20-22]网络,以及兼顾目标分割的Mask R-CNN[23-24]网络.这些方法有着精度高但检测速度慢的特点[25].

1.2 基于深度学习的X线目标检测研究现状

Ak ay等[26]首次将深度学习应用于X线图像的行李分类检测,并使用迁移学习将AlexNet网络应用于研究.研究结果表明,深度学习在行李分类检测中对比传统机器学习具有优秀的性能和鲁棒性.Mery等[27]通过基于词袋模型、稀疏表示、深度学习和经典模式识别多种方法进行了行李检测实验,并发现AlexNet和GoogleNet能够达到相当高的识别率,这证明了深度学习方法在设计自动违禁品识别设备方面的可行性.文献[28-29]将深度学习分类网络与视觉词袋模型进行了对比研究,并发现深度学习分类性能优于视觉词袋模型,表明深度学习适合于设计自动的X线图像分类任务.吉祥凌等[30]在SSD基础上使用了多尺度特征融合的方法,以提高小目标检测的效果.郭守向等[31]在YOLOv3基础上修改了骨干网络,并引入了特征增强模块,以提高小目标检测的效果.张友康等[32]提出了空洞多视野卷积模块和注意力模块,以解决目标遮挡问题.Li等[33]将语义分割网络与Mask R-CNN组合成双阶段CNN模型,以改善X线图像中物体重叠导致的性能下降问题.李文强等[34]在YOLOv8n模YOLOv5基础上引入Swin Transformer模块和注意力模块,提升了网络性能和X线图像全局特征的提取能力.

1.3 YOLOv8n模型结构

模型结构分为几个部分(如图1所示):1) 输入端:自适应调整输入图片的大小,对图片进行预处理.2) 主干网络:进行下采样特征提取,获得图片的细节信息.3) Neck部分:采用feature pyramid networks(FPN)和path aggregation networks(PAN)相结合的方式,但是YOLOv8n去掉了PAN中的2个上采样卷积操作.这样既能获得图片的语义信息和获得定位信息,又可以减少计算量.4) Prediction部分:采用了解耦头的结构,2条并行的分支分别提取类别特征和位置特征.同时采用anchor-free方式对小、中、大目标检测,并在原图上对检测物进行锚框标注.虽然YOLOv8模型在COCO等公开数据集上的性能有所提升,但YOLOv8模型在X线违禁品数据集上进行实验,性能并不是很好.本文在YOLOv8模型的基础上修改了模型结构,加入ECA注意力机制,提出了带有注意力机制的YOLOv8n-ECA目标检测模型,提高了YOLOv8模型在X线违禁品数据集上性能.

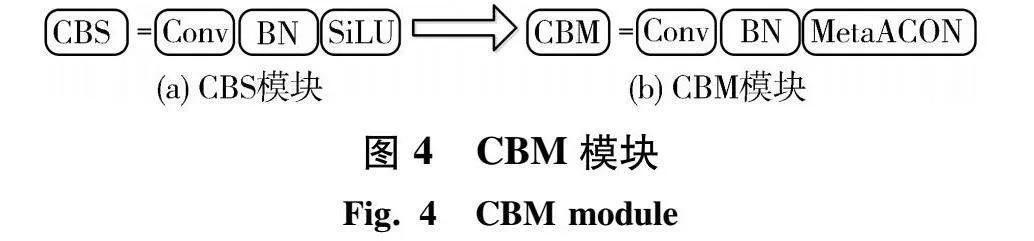

图1为YOLOv8的基本网络架构,主干网(Backbone)通过C2f模块来提取特征图片,C2f模块是由CBS模块和x个Bottleneck1组件拼接而成,而CBS模块是由标准卷积、归一化和SiLU激活函数组成.

2 带有注意力机制的YOLOv8模型

2.1 输入数据集增强

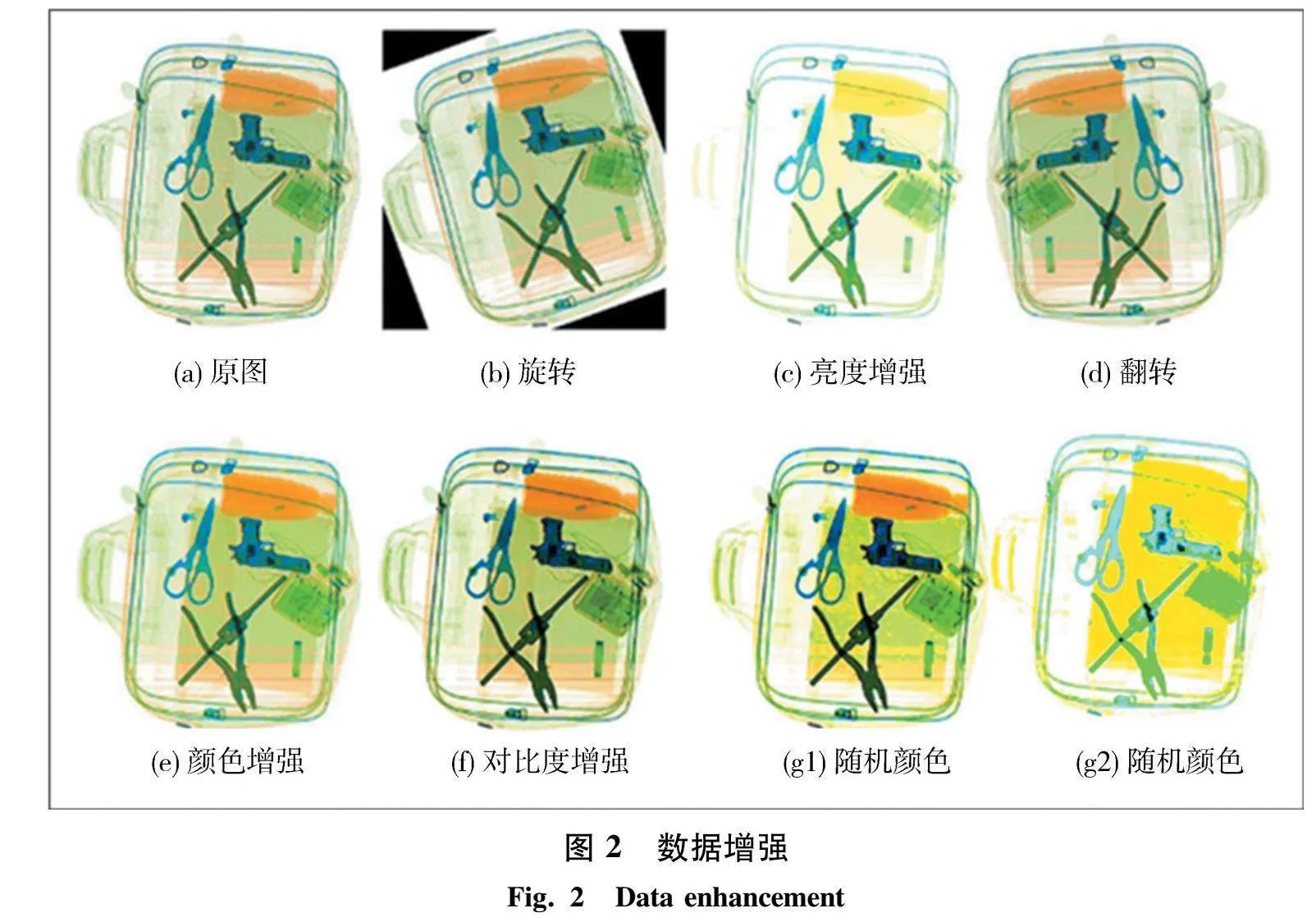

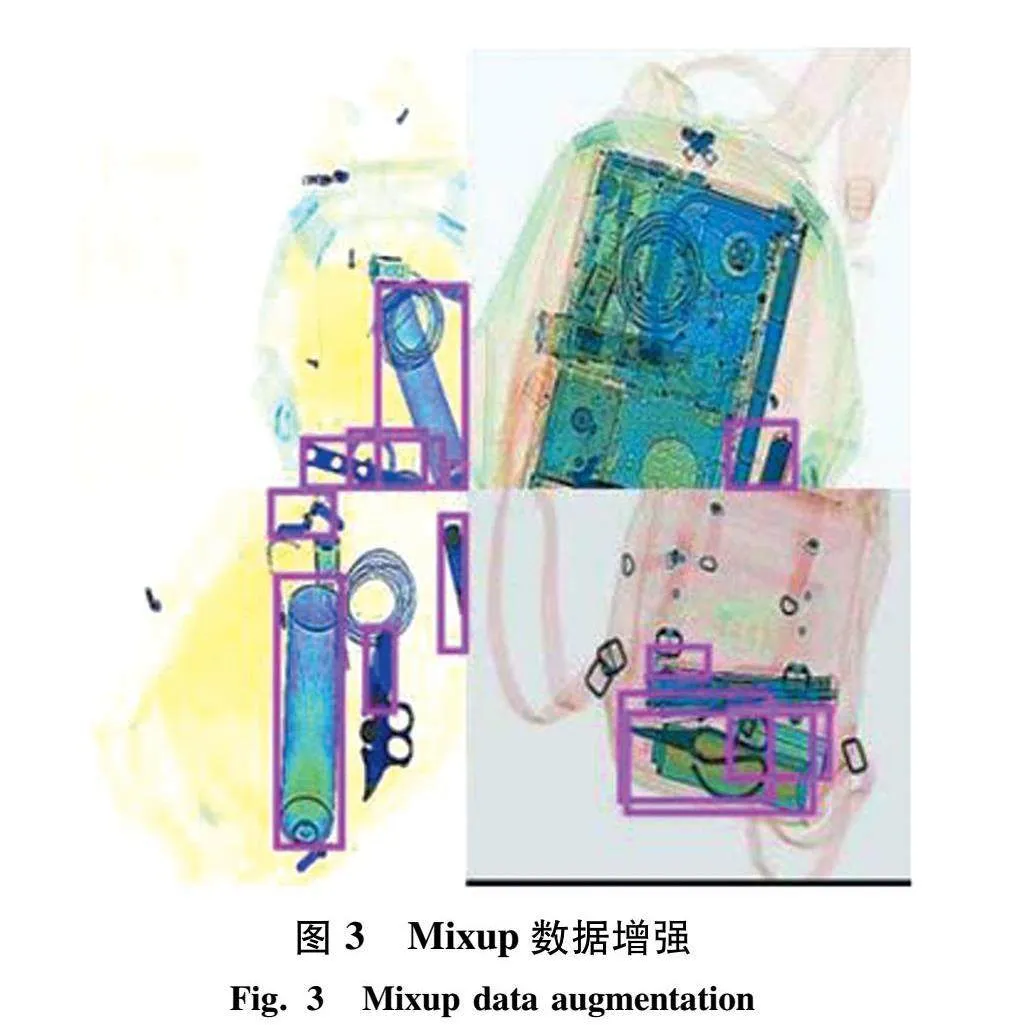

针对剪刀这类数据集比其他类别的数量少的问题,使用数据增强的方法,对剪刀这类数据集进行图像扩增,来提高数据集的可靠性.扩充的途径包括:1) 图像的翻转、图像的缩放和色彩空间的变换.在图像翻转方面,考虑到真实安检过程中物体会发生不同角度的翻转,对X线图像进行左右、上下、45°、135°、225°等翻转,增加不同角度X线图像的多样性.2) 对X线图像进行色彩调节,可以使图像的边缘更深,并能使图像的特点更加明显.样本扩充后的效果图如图2所示.3) 使用Mixup方法[35],从训练集中挑选带有剪刀类的图像和不带有剪刀类的图像,然后将它们通过Mixup逐像素线性相加(如图3所示),得到混合后的图像,同时把对应的标签也加在没有剪刀类的图像上.

2.2 网络优化

通过对网络中使用的激活函数进行分析,选择更优的激活函数来代替原有的激活函数,提高网络的精确度,解决对于复杂场景的处理效果不佳的问题.通过加入注意力机制到不同的网络层,来进一步提高网络的精确度,解决对遮挡目标检测效果不佳的问题.

2.2.1 [WTBZ][STBZ]改进YOLOv8模型的激活函数[WT][ST]

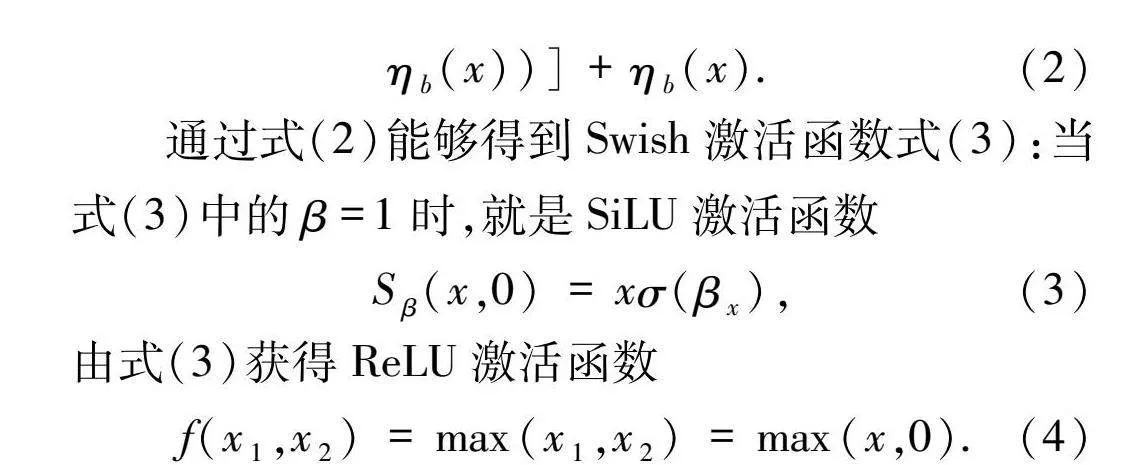

YOLOv8n网络使用的是SiLU激活函数,它是Swish激活函数[36]中的一个特例.Swish激活函数是ReLU激活函数[37]的平滑近似,使用Swish激活函数性能更好.但是,Swish只能激活非线性的网络节点,一些线性的节点就会被忽略,从而使得网络的性能受到影响.

Meta-ACON激活函数[38]是在ACON激活函数的基础上提出的一种自适应激活函数.ACON激活函数是一种可以自适应地选择是否激活神经元的激活函数,Meta-ACON激活函数通过引入开关因子来学习非线性(激活)和线性(非激活)之间的参数切换.它能够自适应地选择是否激活神经元,通过替换原网络的激活层,能提升网络精度.它是基于个激活函数ReLU和Swish得来的.ReLU的平滑近似函数

Sβ(x1,x2,…,xn)=∑[DD(]n[]i=1[DD)]xieβxi∑[DD(]n[]i=1[DD)]eβxi,

(1)

根据式(1)得

Sβ(ηa(x),ηb(x))=

(ηa(x)-ηb(x))σ[β(ηa(x)-ηb(x))]+ηb(x).

(2)

通过式(2)能够得到Swish激活函数式(3):当式(3)中的β=1时,就是SiLU激活函数

Sβ(x,0)=xσ(βx),

(3)

由式(3)获得ReLU激活函数

f(x1,x2)=max(x1,x2)=max(x,0).

(4)

此时Swish和ReLU激活函数只能通过非线性的方式激活神经元.(2)式中的β就是决定是否激活线性或非线性的参数.当β为常量时,式(2)就已经明确了线性或非线性,此时需要动态学习β,使得网络有着能够自适应线性或非线性的能力,从而提高网络泛化能力和精确度.

将主干网中的CBS模块里的SiLU激活函数替换成Meta-ACON,可以在参数量增加不大的情况下很好地提升性能,形成新的CBM模块,如图4所示.

2.2.2 对[WTBZ]ECA注意力模块的改进[WT]

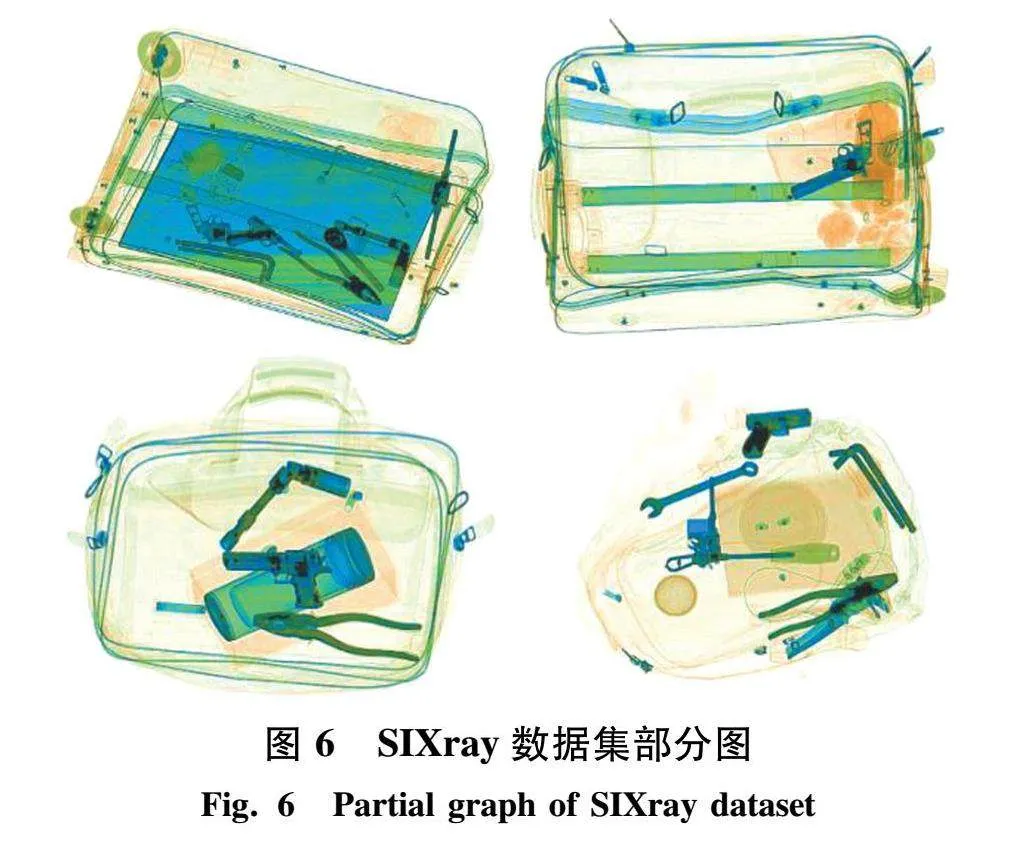

ECA注意力[39]解决了通道间的注意力问题,采用一维卷积核提取明显的特征,再利用Sigmoid激活函数将特征归一化,将得到的通道注意力信息与原始输入的特征图相结合,得到具有不同权重的特征图.

Sigmoid激活函数中包含指数计算,会造成计算量增大,那么将Sigmoid激活函数替换成Meta-ACON激活函数,得到ECA_M模块(如图5所示),可以避免出现指数计算,从而减低计算量.

2.2.3 [WTBZ][STBZ]将ECA_M模块引入YOLOv8n网络[WT][ST]

为了在特征提取过程中让网络模型能够着重提取到所标注的物品的特征,将优化后的ECA_M模块加入到已经修改过的YOLOv8n网络中.

为了使网络的优化有更好的效果,本文设计了多种实验进行对比,即在主干网络不同的层中添加若干注意力模块.具体方法如下:首先,分别将ECA_M模块连接在主干网的P3、P4、P5层后端,此时网络中就加入了一层注意力模块,得到网络YOLOv8n-E3、YOLOv8n-E4、YOLOv8n-E5;再次,同时将ECA_M模块连接在P3和P4、P3和P5、P4和P5层后端,此时网络中加入了2层注意力模块,得到网络YOLOv8n-E34、YOLOv8n-E35、YOLOv8n-E45;然后,将ECA_M模块同时加入到P3、P4和P5层后端,此时网络中加入了3层注意力模块,得到网络YOLOv8n-E345;最后,在3层注意力模块的基础上,将ECA_M模块加到SPPF层的后端,此时网络中加入了4层注意力模块,得到网络YOLOv8n-ECA.

利用Prediction部分对获得的特征进行预测,并解码预测结果,从而在原图上绘出预测框并标注类别.

YOLOv8n-En网络相较于YOLOv8n网络,在理论上可以获得更好的检测效果,对X线安检图像中违禁品的检测精度更高.同时,YOLOv8n-En网络因增加注意力模块使得单张图片的检测速度减慢.不过在X线安检场景中更注重检测的精确度性能,适当的降低检测速度是能够接受的,YOLOv8n-En网络仍具有可行性,这里的n代表ECA_M模块加入的情况.

3 实验测试与结果

本节先对剪刀这种类别进行数据扩充,在YOLOv8n模型的基础上将扩充后的数据集与原数据集进行对比实验,分析实验结果.

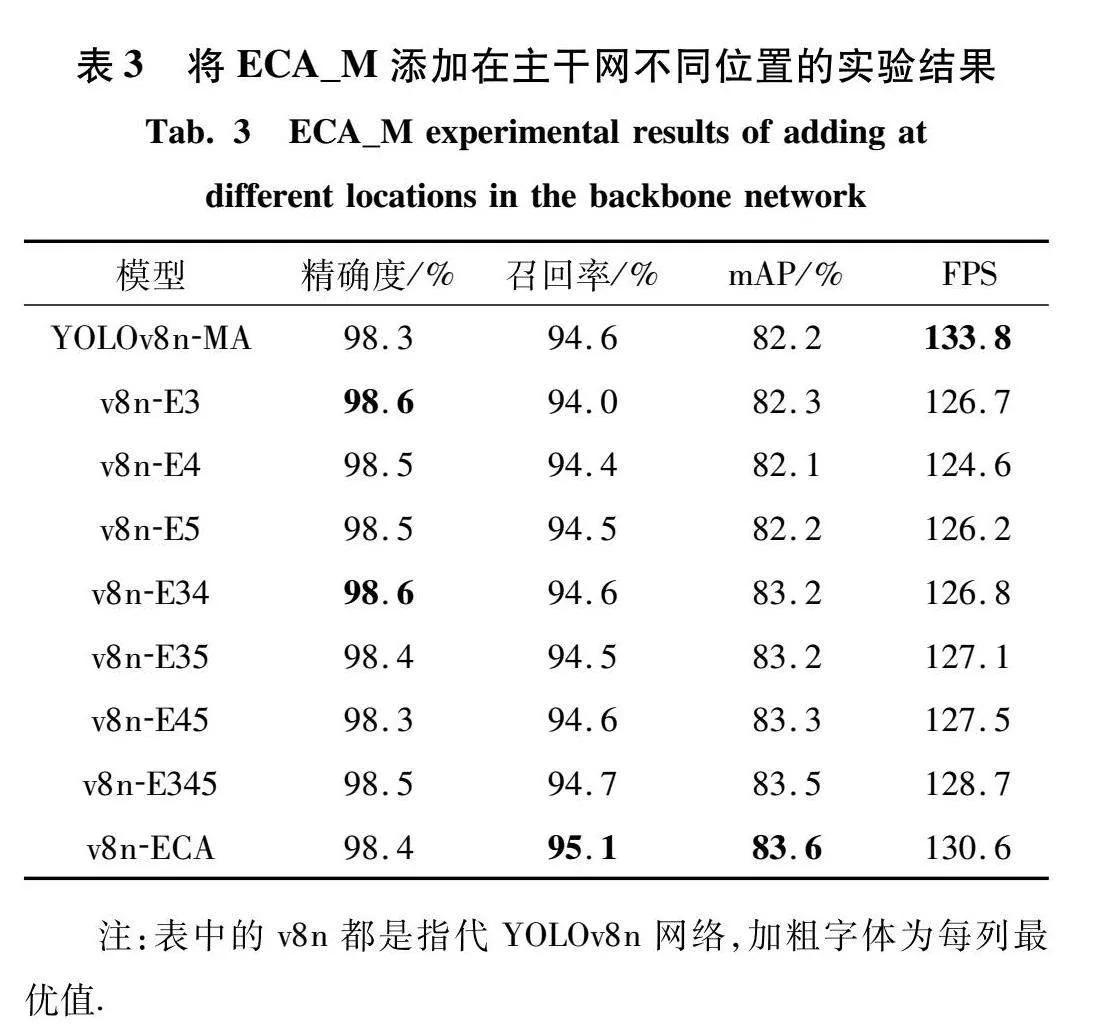

然后将YOLOv8n中的激活函数替换成Meta-ACON,得到YOLOv8n-MA,再针对优化激活函数后的网络YOLOv8n-MA、YOLOv8n-E3、YOLOv8n-E4、YOLOv8n-E5、YOLOv8n-E34、YOLOv8n-E35、YOLOv8n-E45、YOLOv8n-E345以及YOLOv8n-ECA进行对比实验,分别比较它们检测各种违禁品的性能和网络平均精确度.

3.1 实验准备

3.1.1 数据集选择

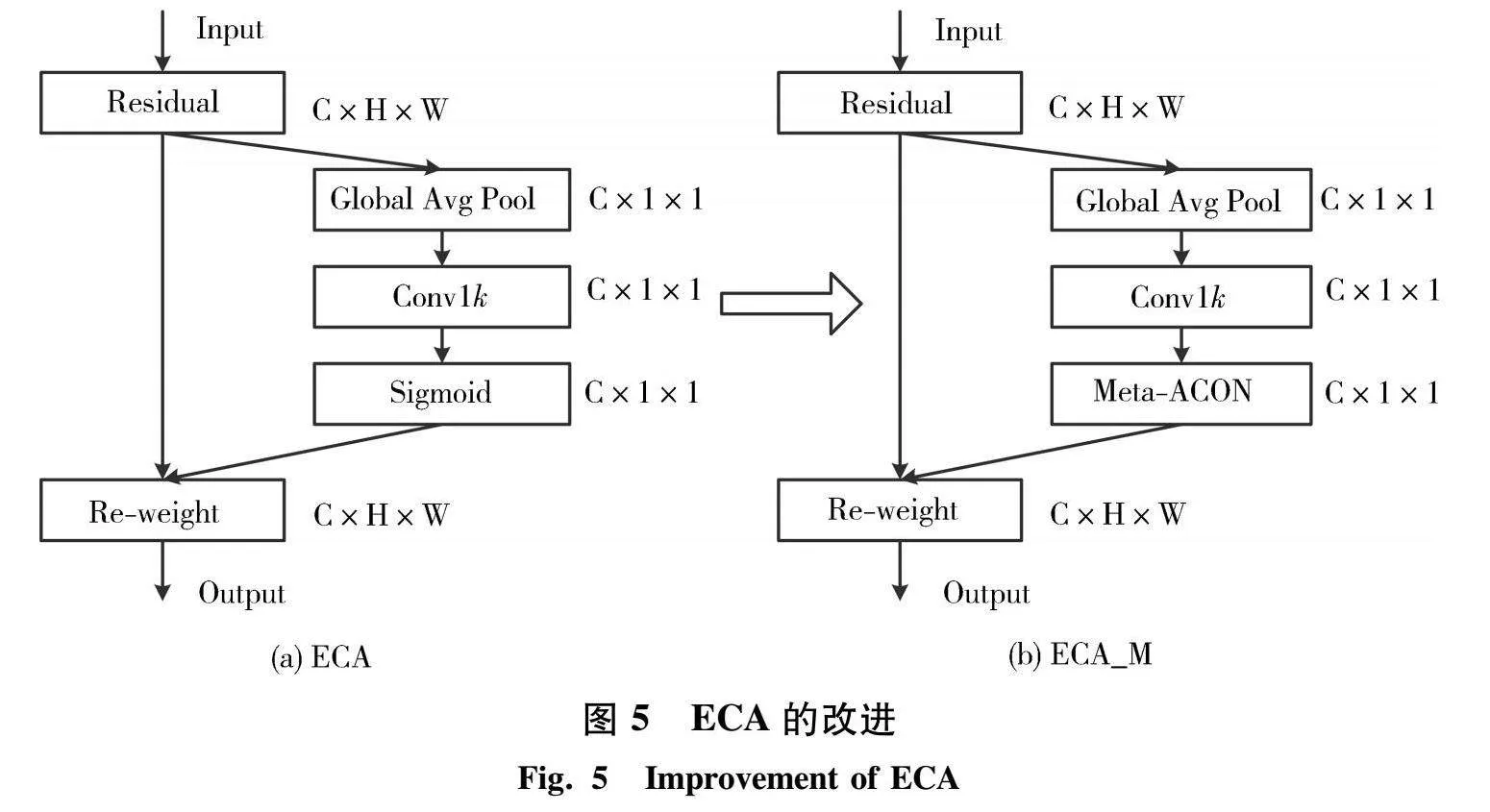

1) 目前公开的X线安检图像数据集有以下2种:a) GDXray数据集[40],此数据集的图片是单色图像,包含违禁品5类,且形状过于少量,数量有8 150张;2) SIXray数据集[41],此数据集是由中国科学院大学收集并整理的,样本标签数有8 929个,共有6种类别,分别为手枪(Gun)、刀具(Knife)、扳手(Wrench)、镊子(Pliers)、剪刀(Scissor)和锤子(Hammer).此数据集内容比较复杂,图片色彩丰富,种类多样,包含物品重叠等干扰,符合实验需求.SIXray数据集部分图片如图6所示.实验中去掉了锤子这一类,并通过数据增强的方式,将剪刀这类的数量趋向其他类别的数量.使用增强后的数据集来进行实验.

3.1.2 超参数设置

batch_size设置为8,epoch为200轮,图片的初始大小为640 dpi×640 dpi,学习率设为0.01.

3.1.3 评估指标

TP(真正例)为模型正确预测为正例的样本数,TN(真负例)为模型正确预测为负例的样本数,FP(假正例)为模型错误地预测为正例的样本数,FN(假负例)为模型错误地预测为负例的样本数.

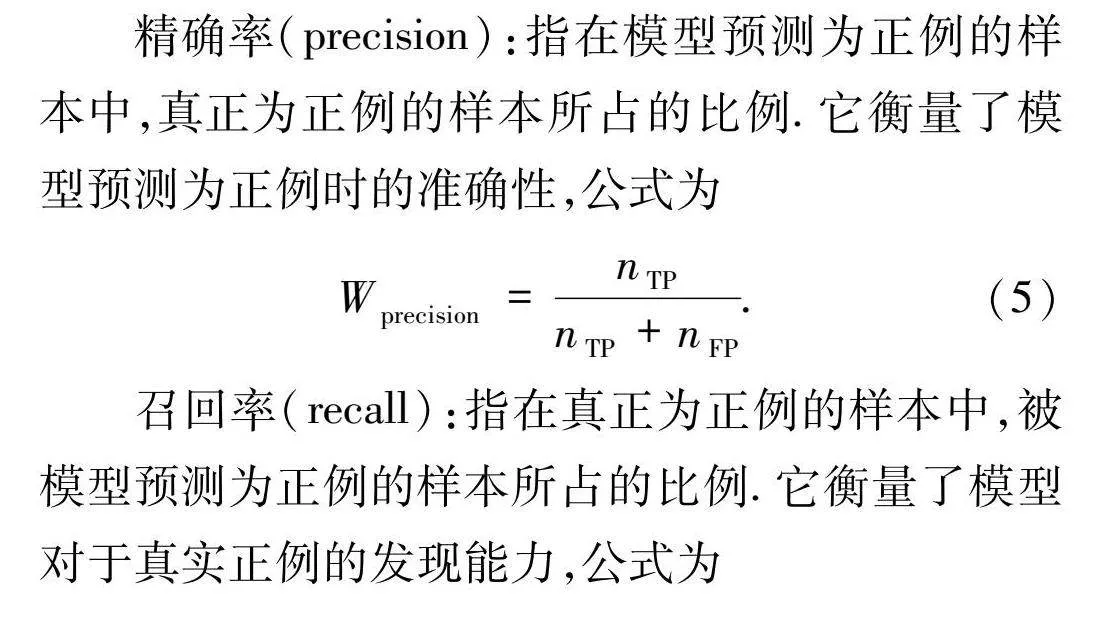

精确率(precision):指在模型预测为正例的样本中,真正为正例的样本所占的比例.它衡量了模型预测为正例时的准确性,公式为

Wprecision=nTPnTP+nFP.

(5)

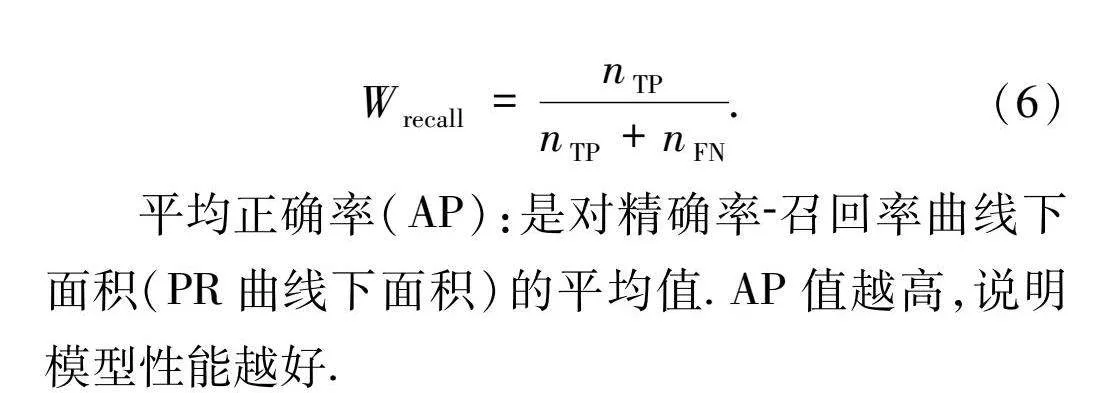

召回率(recall):指在真正为正例的样本中,被模型预测为正例的样本所占的比例.它衡量了模型对于真实正例的发现能力,公式为

Wrecall=nTPnTP+nFN.

(6)

平均正确率(AP):是对精确率-召回率曲线下面积(PR曲线下面积)的平均值.AP值越高,说明模型性能越好.

交并比(IoU):交并比是指预测框与真实框之间的交集与并集之比.当交并比大于等于某个阈值时,认为预测框与真实框匹配成功.

mAP@0.5:0.95指将交并比的临界值设置在0.5~0.95时,所有类别的平均精确度.本文将选择mAP@0.5:0.95作为模型性能的评判指标.

FPS:检测每秒能处理的图片数量.

3.2 少类样本扩充对比实验

剪刀是该数据集中的较少类别,所以使用在2.1节中提到的数据增强方法,对剪刀这种少类数据进行扩充,然后使用YOLOv8n模型将扩充后的数据集与原数据集进行对比,得到的对比结果如表1所示.

根据表1,剪刀类别通过数据增强后,召回率提升了8.4%,有效地降低了少量类别的漏检率.

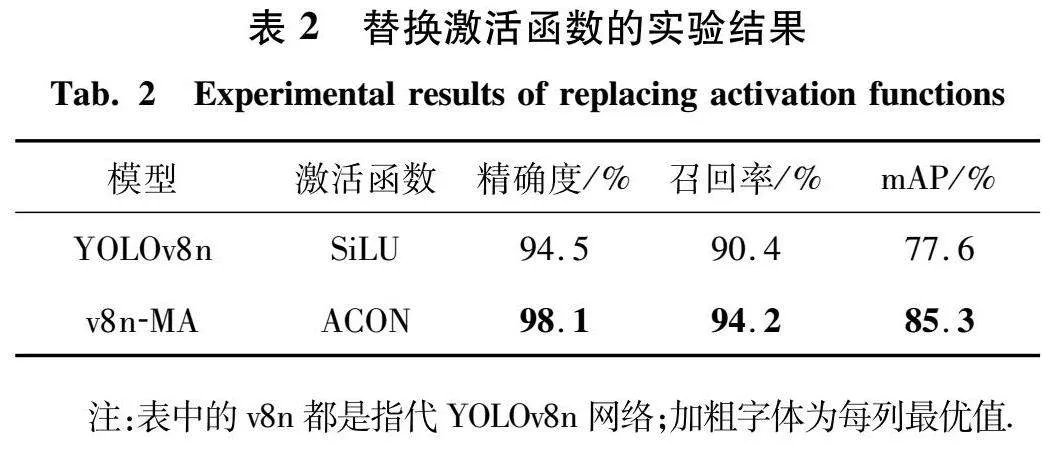

3.3 各模型性能对比实验

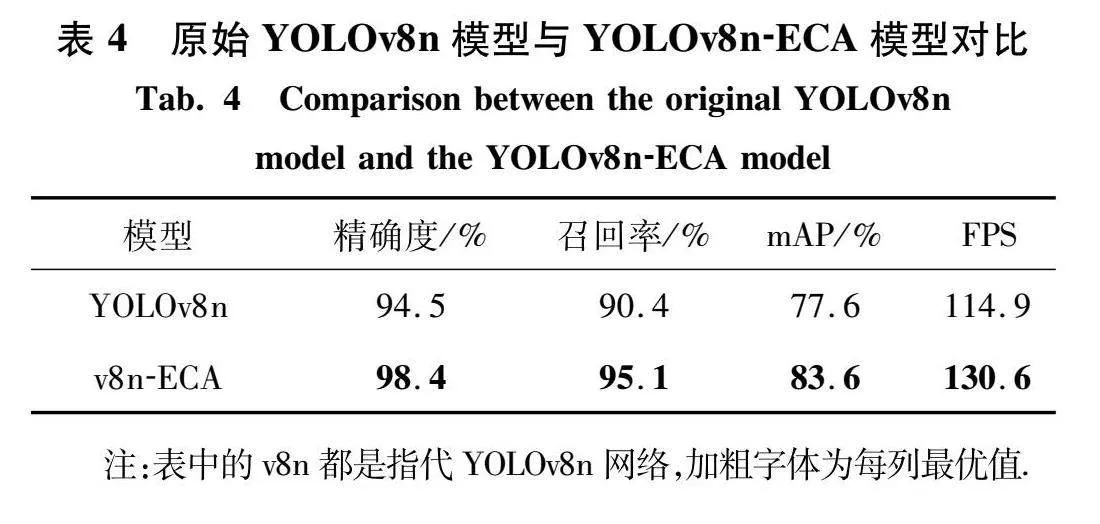

在训练后测试同一组测试集,先列出YOLOv8n原网络与替换激活函数后的YOLOv8n-MA网络的对比实验(见表2),再分别列出YOLOv8n-MA、YOLOv8n-E3、YOLOv8n-E4、YOLOv8n-E5、YOLOv8n-E34、YOLOv8n-E35、YOLOv8n-E45、YOLOv8n-E345以及YOLOv8n-ECA等9个模型的性能指标:精度、召回率、mAP值和每秒处理的图片数量(FPS),检测结果分别如表3所示.

根据表2可以看到,替换后的YOLOv8n-MA网络在精度、召回率和mAP方面比YOLOv8n网络的表现要好,分别提高了3.6%,3.8%和7.7%,表明替换激活函数可以显著提高目标检测网络的性能.

根据表3,得到以下结论:

1) 精度方面,各个网络的差异不大,表现较好的是YOLOv8n-E3和YOLOv8n-E34,精确度达到98.6%;

2) 召回率方面,网络的差异值不大,而YOLOv8n-ECA有着更好的召回率,达到95.1%;

3) mAP值,本实验使用的是IoU在0.5~0.99范围的平均精确度,YOLOv8n-ECA有着更好的mAP,相对于YOLOv8n-MA提高了1.4%;

4) FPS,加入注意力模块后每秒处理图片的数量有所下降,这在预期内,可以看到YOLOv8n-ECA下降的幅度最小.综上,YOLOv8n-ECA总体的性能超过了YOLOv8n-MA网络.

根据表4,YOLOv8n-ECA网络模型相较于原始YOLOv8n网络模型在X线安检数据集上的精确度提升了3.9%,召回率提升了4.7%,mAP提升了6%,FPS提升了15.7%.

4 结束语

本文旨在提高处于X线安检图像数据的情况下目标检测模型的精确度,在原YOLOv8n网络的基础上进行激活函数的改进以及加入注意力模块,构建了YOLOv8n-ECA等一系列网络.根据对比实验,得到结论:YOLOv8n-ECA网络的总体性能较YOLOv8n提升了6%,且每秒处理图片的数量为130.6,符合安检工作中的要求.综上所述,YOLOv8n-ECA网络符合安检工作时的帧数要求,能够更精确地识别违禁品,为公共环境提供安全保障.

参考文献

[1] 陈燕蝶. 人工智能在安检工作的应用研究[J]. 电大理工,2022(2):65-71.

[2] 钟健,甘玉凤,高向东. 违禁品安检技术现状与展望综述[J]. 传感器世界,2022,28(7):1-7.

[3] 杨嘉诚,黄佳慧,韩永麟,等. 优化YOLOv4算法的安检X线图像检测网络[J]. 计算机系统应用,2021,30(12):116-122.

[4] 曹洋,张莉,孟俊熙,等. 针对X线安检场景的多目标违禁品识别算法[J]. 激光与光电子学进展,2022,59(10):324-332.

[5] MERY D, MONDRAGON G, RIFFO V, et al. Detection of regular objects in baggage using multiple X-ray views[J]. Insight- Non-Destructive Testing and Condition Monitoring,2013,55(1):16-20.

[6] 张伟烽. 基于深度学习的X线安检图像危险品检测算法及其应用[D]. 深圳:中国科学院大学(中国科学院深圳先进技术研究院),2022.

[7] 任杰. 基于YOLOv5的X线安检图像违禁品检测[D]. 北京:中国地质大学,2021.

[8] 代伟,刘洪. 基于神经网络的中文语音识别技术[J]. 四川师范大学学报(自然科学版),2022,45(1):131-135.

[9] 林秀丽,李均利,田竟民,等. 基于卷积神经网络的算法选择研究[J]. 四川师范大学学报(自然科学版),2022,45(6):830-838.

[10] 郭逸凡,裴瑄,王大寒,等. HyperSegUNet:基于超网络的超参自学习医学图像分割模型[J]. 四川师范大学学报(自然科学版),2024,47(1):127-135.

[11] 刘星宇,程建,牛艺晓,等. 基于AGA-RBF神经网络模型的叶绿素a质量浓度预测研究[J]. 四川师范大学学报(自然科学版),2024,47(5):670-675.

[12] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Las Vegas: IEEE,2016:779-788.

[13] 杨高坤. 单阶段法目标检测技术研究[J]. 电子世界,2021(3):77-78.

[14] 魏泽发,崔华. 基于 SqueezeNet 卷积神经网络的车辆检测[J]. 物联网学报,2020,4(3):120-125.

[15] KANG JC, ZHAO L J, WANG K T, et al. Research on an improved YOL0v8 image segmentation model for crop pests[EB/OL]. (2023-04-13)[2023-10-24]. http://166.62.7.99/assets/defaulV/article/2023/04/13/article_1681397118. pdf.

[16] 袁红春,陶磊. 基于改进的Yolov8商业渔船电子监控数据中鱼类的检测与识别[J]. 大连海洋大学学报,2023,38(3):533-542.

[17] LI Y T, FAN Q S, HUANG H S, et al. A modified YOLOv8 detection network for UAV aerial image recognition[J]. Drones,2023,7(5):304.

[18] 吴健生,王健全,付美霞,等. 基于改进Faster-RCNN算法的带钢缺陷检测[J]. 鞍钢技术,2022(6):23-28.

[19] GIRSHICK R. Fast R-CNN[EB/OL]. Computer Science,2015. https://ar5iv.labs.arxiv.org/html/1504.08083.

[20] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. Advances in Neural Information Processing Systems,2016,39(6):1137-1149.

[21] 赵留阳. 基于改进的Faster-RCNN的中药检测[J]. 现代信息科技,2022,6(17):71-74.

[22] 刘德祥,梁苗,王钰棋. 改进Faster-RCNN的工程车辆识别方法[J]. 城市勘测,2023(1):110-113.

[23] HE K M, GKIOXARI G, DOLLR P, et al. Mask R-CNN[C]//2017 IEEE International Conference on Computer Vision (ICCV). Venice: IEEE,2017:2980-2988.

[24] 游江川. 基于改进Mask-RCNN的路面裂缝检测[J]. 电视技术,2022,46(6):7-9.

[25] 路斯棋,管凤旭,赖海涛,等. 基于卷积神经网络的双阶段水下图像增强方法[J/OL]. 北京航空航天大学学报,(2022-01-15)[2023-08-22].https://doi.org/10.13700/j.bh.1001-5965.2022.1003.

[26] AKAY S, KUNDEGORSKI M E, DEVEREUX M, et al. Transfer learning using convolutional neural networks for object classification within X-ray baggage security imagery[C]//2016 IEEE International Conference on Image Processing (ICIP).Phoenix: IEEE,2016:1057-1061.

[27] MERY D, SVEC E, ARIAS M, et al. Modern computer vision techniques for X-ray testing in baggage inspection[J]. IEEE Transactions on Systems, Man, and Cybernetics: Systems,2017,47(4):682-692.

[28] AKCAY S, BRECKON T P. An evaluation of region based object detection strategies within X-ray baggage security imagery[C]//2017 IEEE International Conference on Image Processing (ICIP). Beijing: IEEE,2017:1337-1341.

[29] AKCAY S, KUNDEGORSKI M E, WILLCOCKS C G, et al. Using deep convolutional neural network architectures for object classification and detection within X-ray baggage security imagery[J]. IEEE Transactions on Information Forensics and Security,2018,13(9):2203-2215.

[30] 吉祥凌,吴军,易见兵,等. 基于深度学习的管制物品自动检测算法研究[J]. 激光与光电子学进展,2019,56(18):76-86.

[31] 郭守向,张良. Yolo-C:基于单阶段网络的 X 光图像违禁品检测[J]. 激光与电子学进展,2021,58(8):67-76.

[32] 张友康,苏志刚,张海刚,等. X线安检图像多尺度违禁品检测[J]. 信号处理,2020,36(7):1096-1106.

[33] LI J C, LIU Y H, CUI Z C. Segmentation and attention network for complicated X-ray images[C]//2020 35th Youth Academic Annual Conference of Chinese Association of Automation (YAC). Zhanjiang: IEEE,2020:727-731.

[34] 李文强,陈莉,谢旭,等. 改进 YOLOv5 的X光图像违禁品检测算法[J]. 计算机工程与应用杂志,2023,59(16):170-176.

[35] 张京爱,王江涛. 基于多尺度卷积神经网络和类内mixup操作的磁瓦表面质量识别[J]. 计算机应用,2021,41(1):275-279.

[36] RAMACHANDRAN P, ZOPH B, LE Q V. Searching for activation functions[EB/OL]. (2017-10-27)[2023-10-24]. https://arxiv.org/pdf/1710.05941v1.pdf.

[37] GLOROT X, BORDES A, BENGIO Y. Deep sparse rectifier neural networks[C]//Proceedings of the Fourteenth International Conference on Artificial Intelligence and Statistics. Fort Lauderdale: JMLR,2011:315-323.

[38] MA N N, ZHANG X Y, LIU M, et al. Activate or not: learning customized activation[C]//2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR). Nashville: IEEE,2021:8028-8038.

[39] WANG Q L, WU B G, ZHU P F, et al. ECA-net: efficient channel attention for deep convolutional neural networks[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Seattle: IEEE,2020:11531-11539.

[40] MERY D, RIFFO V, ZSCHERPEL U, et al. GDXray: the database of X-ray images for nondestructive testing [J]. Journal of Nondestructive Evaluation,2015,34(4):42.

[41] MIAO C J, XIE L X, WAN F, et al. SIXray: a large-scale security inspection X-ray benchmark for prohibited item discovery in overlapping images[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR). Long Beach: IEEE,2019:2114-2123.

A Contraband Detection Method for X-ray Security ImagesBased on Improved YOLOv[STHZ]8[STBZ]

MAO Weiyang1, YANG Jun1,2, LIU Xudong1, LIANG Daozheng1

(1. School of Computer Science, Sichuan Normal University, Chengdu 610101, Sichuan;

2. Key Laboratory of Visual Computing and Virtual Reality, Sichuan Normal University, Chengdu 610101, Sichuan)

The efficiency of manual security checks is low and prone to errors. Implementing automatic security checks based on artificial intelligence is the development trend of security checks. The YOLOv8 object detection model has been improved to address the issues of low detection accuracy and high missed detection rate for a small number of categories in X-ray prohibited item detection. On the basis of YOLOv8n, the network structure was modified, attention mechanism was introduced, and a YOLOv8n-ECA object detection model with Efficient Channel Attention (ECA) was proposed to better extract the features of prohibited items in X-ray images. At the same time, a series of data augmentation methods such as image rotation were used to expand the sample size for a small number of category samples. Experiments were conducted on a self-building X-ray security inspection image dataset, and the results showed that the improved algorithm enhanced detection accuracy by 6% compared to the original YOLOv8n model, increased detection speed by 15.7% compared to the original YOLOv8n model, and reduced the missed detection rate of a small number of categories.

YOLOv8n; ECA attention; deep learning; X-ray images; prohibited goods inspection

(编辑 郑月蓉)