人工智能教育立法:基于教育法典的体系化编纂路径

2024-10-11刘旭东

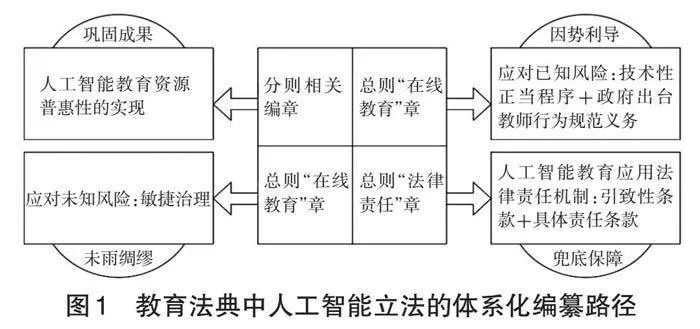

摘要:人工智能在赋能教育的同时,也显著提升了教育立法的难度。相比于教育单行法,作为教育领域“根本法”的教育法典将能够对人工智能教育应用展开最为周延科学的规范,助益人工智能教育应用的健康发展。作为体系型法典,教育法典必然采用“总分架构”。教育法典中人工智能立法可通过总则的“在线教育”“法律责任”以及分则的相关编章进行体系化编纂。首先,教育立法的核心及编纂主线是保障公民的受教育权,故教育法典分则相关编章需分别为政府及学校设定人工智能教育资源普惠性的促进义务,使教育主体能平等享有人工智能的教育红利。其次,针对人工智能教育应用可能引发的风险,教育法典可在总则“在线教育”章,一方面引入技术性正当程序,设定算法和数据的透明义务和审计义务,以及教育标准事务不得自动化决策义务等,明确教师使用人工智能的行为规范与专业操守;另一方面,依托敏捷治理手段,构筑多元主体参与的事前监测预警平台、事中快速响应的因应机制、事后动态完善的持续发展机制,应对人工智能教育应用未知风险。最后,为了确保义务条款得以顺利实施,教育法典可在总则“法律责任”章通过引致性条款与具体责任条款的妥适选用,构筑健全的人工智能教育应用法律责任机制。

关键词:教育法典;人工智能教育立法;编纂路径;技术性正当程序;敏捷治理

中图分类号:G40-011.8 文献标识码:A 文章编号:1009-5195(2024)05-0061-12 doi10.3969/j.issn.1009-5195.2024.05.007

基金项目:2022年度国家社会科学基金教育学一般课题“我国教育法典编纂的框架体系研究”(BAA220169)。

作者简介:刘旭东,博士,副教授,江苏师范大学法学院(江苏徐州 221116);特邀研究员,南京师范大学中国法治现代化研究院(江苏南京 210097)。

一、问题的提出

当前,人工智能重塑社会结构与治理形态的功用愈发显著,特别是以ChatGPT为代表的生成式人工智能实现了人工智能从感知世界到创造世界的历史性跃迁,标志着人工智能技术应用的重大范式转变(龙卫球,2020)。人类社会已然进入人工智能时代。人工智能正广泛以知识生产者与教育决策者的姿态深度嵌入教育系统,在显著影响教育理念与教育方式的同时,未来也有可能彻底改变当前的教育实践(杨九诠,2024)。但是,人工智能在赋能教育的同时,也带来了教育公平与教育安全等挑战。习近平总书记指出:“要整合多学科力量,加强人工智能相关法律、伦理、社会问题研究,建立健全保障人工智能健康发展的法律法规、制度体系、伦理道德。”(新华社,2018)人工智能在教育领域引发的机遇与挑战需要获得法治的回应。

通过立法对人工智能教育应用展开系统规划,是推动中国式教育现代化的重要实践路径。《中华人民共和国民法典》(以下简称《民法典》)的颁布标志着我国进入法典化时代,在这一背景下,实现“教育法法典化”(Codification of Education Law)的呼声愈加强烈。现阶段,编纂教育法典已被纳入全国人大常委会的立法工作计划,相关前期准备工作已经开启。可以预见,相比于教育单行法,作为教育领域“根本法”的教育法典将能够对人工智能教育应用展开最为周延科学的规范,助益人工智能教育应用的健康发展。目前,学术界专门探讨人工智能教育立法的成果相对较少,既有成果的措施建议仍较为碎片化,没有从教育法典“总分架构”的视角出发提出系统化的立法对策,亦未就如何规制算法与数据这两项人工智能的技术基础作出研判。基于此,本文将依托技术性正当程序和敏捷治理的经验范式,尝试提出教育法典中人工智能教育立法的体系化路径,为促进教育法典的科学编纂及人工智能在教育中的规范应用贡献学理智识。

二、人工智能教育应用的规范意涵与风险研判

人工智能教育应用在为教育活动带来全新技术便利、显著提升教育质效的同时,也带来了多方面的严峻挑战。如何巩固人工智能教育应用的成果,并应对其风险与挑战,成为了教育法典中人工智能立法的核心关切。

1.人工智能教育应用的规范意涵

人工智能是用于模拟、延伸和扩展人类智能的人工技术产物。人工智能教育应用是指人工智能技术在教育领域的适用活动,主要体现为学生、教师、研究者等教育主体对这一技术的运用。规范人工智能教育应用,首先必须捋清其在教育活动中的应用情况。具体来看,人工智能教育应用主要呈现出如下实践理路。

第一,赋能学习,为学生提供智能化的自适应学习系统(戴岭等,2023)。人工智能基于强大的数据收集、分析与输出能力,可以根据学生的学习能力、兴趣志向等特质自动调整学习内容,为学生提供更符合个人能力与发展走向的“私人定制”式学习产品,如科大讯飞的“畅言智慧校园”;亦可根据学生的能力与需求为其提供个性化辅导与反馈,为学生课程作业自动评分,如北京词网科技有限公司的“批改网”。由此,教育范式实现了从被动性、标准性向主动性、多样性的转型,实现了从“供给驱动”向“需求驱动”的跃迁(祝智庭等,2022)。

第二,赋能教学,为教师提供综合性的教学辅助。当前,教师已然可以通过人工智能优化课程设计与课堂教学方案,使其更符合学生的学习状况与发展走向。人工智能可将教师从重复性且技术含量不高的事务中解放出来,使教师可以将更多的精力投入到提升教学技能、扩容教学知识、培养学生健全人格等更重要的事务上。人工智能亦可协助教师处理繁杂且机械的行政工作,如令中小学教师苦不堪言的各类表格填写、活动策划等,都可交由人工智能完成,如日本东京理科大学设计的“Saya教师”即可完成此类工作。

第三,赋能科研,为研究者提供强大的科研辅助。一则,在知识获取阶段提供“自动生成式”信息源,研究者仅需发出指令,无需进行精准的关键词输入等工作,即可获得丰富且分类的目标知识。二则,在研究设计阶段打通不同学科之间的专业壁垒与工具限制,为研究者提供多维视角的思路设计。三则,在创作阶段实现深度参与及辅助。例如,针对理工科研究者,人工智能可通过定性、定量或系统分析为其呈现各类研究数据的分析结果(刘宝存等,2023);针对文科研究者,人工智能可通过海量文本数据的预训练,深度参与研究者学术论文的创作,甚至为其提供特定语言风格的文字段落,并对学术论文提出修改意见。

第四,赋能管理,有效实现学校行政管理的自动化。教师管理方面,人工智能可通过强大的数据分析与筛选能力,助益学校更精准地遴选符合本校要求的师资,并根据数据分析对教师展开个性化培训;亦可在后续教师管理进程中,形成全面动态的评价体系,辅助学校在教学评估、绩效考核、聘期考核、职称评聘等方面展开智能化管理(余南平等,2023)。学生管理方面,人工智能在课程规划、考勤管理、心理评估、贷款管理等事务上可为学校提供更加精准科学的数据,避免学校误判。行政管理方面,人工智能可以破除各部门、各系统之间的信息壁垒,实现学校教育管理信息的汇总整合,达成业务处理的协同化、高效化,即实现所谓的“一张表管理”。校园管理方面,智能化的校园核查及安保系统亦可从源头降低安全隐患,从整体上提升学校的安全系数。

人工智能技术的基础是算法与数据(贾开等,2017),算法是人工智能开展计算须遵循的规则,起着“引擎”的作用;数据则是人工智能生成相关内容的资料基础,起着“燃料”的作用。基于人工智能的教育产品都是在数据“喂养”的基础上根据特定算法而生成的。可以看到,人工智能技术需要海量的数据进行训练,而海量数据被高效便捷地获取、存储、处理及传输靠的正是数字技术。数字技术通过将现实物理世界数字化的方式为人工智能技术的发展奠定基础。可见,人工智能技术包含了数字技术与算法技术,而实践中的教育风险问题是由数字技术和算法技术共同引发的,故教育法典应将人工智能技术作为规制对象,以此确保教育法典在风险规制方面的涵摄能力。

2.人工智能教育应用的风险研判

人工智能教育应用的风险可以从教育公平备受挑战、教育安全遭遇威胁、教育伦理发生偏差以及教育立法难度陡升四个方面予以审视。这也就意味着,教育法典对人工智能应用展开规范时,既需要在内容方面保障教育公平与教育安全,维系教育伦理,也需要在技术方面克服人工智能引发的立法难题。

(1)人工智能教育应用带来教育公平新挑战

一方面,人工智能时代的教育数字鸿沟存在扩大化的趋势。表面上,人工智能在普及教育资源、缩小教育差距进而确保教育公平方面具备显著优势,但人工智能是基于算法与数据的革命,实践中,数字化基础雄厚的地区可借助人工智能助益其区域教育的发展,而数字能力薄弱的地区,尤其是广大农村地区,因数字建设能力的低下导致本地教育主体无法享受人工智能带来的教育红利。这进一步扩大了地区间的教育数字鸿沟,阻碍了教育机会平等权的实现。

另一方面,人工智能隐而不彰的技术偏见亦会加剧教育不公平。作为人工智能技术基础之一的算法难免会受到设计者特定价值观的左右,教育领域的各类数据样本亦存在参差不齐的问题,由算法偏见与数据偏见叠加而成的技术偏见将导致人工智能教育产品在群体、性别、职业等方面表现出一定的偏见与歧视,影响教育的公正。举例而言,若某一行业中男性从业者居多,则人工智能可能会认为该行业不适合女性参与,进而拒绝向女性学习者推荐该行业相关的教育资源,从而加剧该行业的性别歧视或失衡。

(2)人工智能教育应用加剧教育安全威胁

首先,人工智能可能侵犯教育主体的隐私权。人工智能需要不断获取新的数据从而提高其智能性,而海量数据的获取难免带来教育主体隐私权被侵犯的结果。当前诸多校园已普及化的人脸识别设备、监控设备,无不在时刻记录着教育主体的生物信息等数据。以ChatGPT为例,教育主体在与其开展互动时,极有可能在不经意间将个人信息尤其是敏感信息泄露给ChatGPT,从而使上述信息成为ChatGPT语料库的组成部分,进而在与其他主体展开对话时泄露这些信息(李世瑾等,2021)。

其次,人工智能生成的信息未必准确,可能误导学生并对其世界观产生负面影响,管理者也有可能据此作出错误的教育决策,最终影响教育安全。这是因为人工智能生成信息的质量取决于其使用数据之优劣。一方面,若语料库中存有主流观点,则人工智能大概率会给出符合主流观点的回答,但少数观点未必就是错的。另一方面,若语料库中的观点本就存有重大分歧,则人工智能给出的答案可能是随机的。此外,实践中教育数据的品质参差不齐,但人工智能算法会对其“照单全收”,导致人工智能生成的信息往往存在事实性错误、概念混用等问题,尤其是面对前沿领域和高深知识时,人工智能给出的答案通常并不可靠(周洪宇等,2023)。

最后,人工智能亦有导致学术不端泛滥的风险。学术创作是一种凝结了研究者精神活动的专业创造性过程,但在人工智能超强算力辅助下,研究者仅需输入基本的数据,无需亲自参与理解、构思与创作,人工智能即可给出完整的“科研成品”。研究者很有可能直接将此类成品据为己有,从而构成剽窃、抄袭等学术不端。事实上,实践中已然出现了大量此类情况。这显然败坏了学术风气,背离了科学研究严谨诚信的原则,导致学术成果的真实性与价值贡献难以评估,使得学术研究偏往了错误方向,严重损及了学术系统的健康发展。

(3)人工智能教育应用引发教育伦理偏差

一方面,人工智能教育应用内含促使教育主体自我意识逐步封闭的风险。随着人工智能为教育带来的便利与日俱增,教师与学生对技术的依赖也显著增强(申灵灵等,2022)。对学生及研究者而言,他们可以十分轻松地通过人工智能获取答案,这种吹糠见米的显功之效诱使教育主体愈发依赖人工智能(雷磊,2023)。由此,教育主体必将丧失反思与创新能力,最终成为人工智能的附庸。对教师而言,试图通过人工智能将特定的教学、管理方式一劳永逸地应用下去,本就是不切实际的自负。这种方式既忽视了受教育者的个体差异、自由发展以及教育现实的复杂性与创造性,也可能导致教师在技术反噬下逐步失去与时俱进、教育革新的意识与能力。

另一方面,人工智能亦可能导致教育主体的道德情感逐步钝化。人工智能无法产生自我意识,无法开展情感价值的人文教育(赵磊磊等,2022),不具备道德是非感,无法独立且逻辑地作出道德判断,更不会主动启迪教育主体开展道德反思。长此以往,依赖于人工智能的教育主体将失去道德判断的自觉与能力,成为“道德无感”(Morally Indifferent)者。

(4)人工智能技术应用提升教育法典编纂难度

与传统人工智能更新迭代较慢相异,当前生成式人工智能已然开启了快速更新的“敏捷迭代”模式。从迭代历程来看,GPT-1仅用了不到5年时间就迭代到了GPT-3.5(代表为众所周知的ChatGPT),GPT-3.5更是在发布3个月后便迭代到了GPT-4,迭代速度远非传统人工智能可比。GPT-3.5因而也成为了生成式人工智能快速迭代升级的分水岭。自此以后,人工智能的迭代周期不再以年为单位,而是以季度、月为单位,甚至未来还有可能以天为单位。这不可避免地导致因技术迭代而产生的风险亦愈加频繁化且具有高度不确定性。

人工智能教育应用风险的高度不确定性,无疑为教育法典的编纂带来了巨大挑战。实践中,法律的正式出台往往要经历漫长的审议程序,如在我国全国人大常委会的立法程序中,一部法律至少要经过3次上会审议,通常需要3~5年的时间方能获得通过。同时,法律出台以后还必须尽可能保持稳定,以此维护立法权威。故相较于社会的快速发展,法律天然地具有滞后性。具体到教育法典的编纂问题上,时下人工智能应用带来的风险更加变动不居且难以预测,教育法典的编修速度很有可能落后于人工智能的迭代发展速度,导致教育法典甫一出台便有可能面临无法应对大量全新风险的被动局面,从而严重影响法典的实效性。譬如,ChatGPT的出现就导致欧盟《人工智能法案》在即将出台之际不得不暂缓发布,并针对ChatGPT带来的新技术与新风险作出相应的内容调整。因此,如何确保教育法典通过宏观擘画与微观规定并举的方式来应对变动不居的技术风险,是人工智能时代教育法典编纂的核心挑战。

三、教育法典中人工智能立法的编章布局

教育法典采用“体系型法典”的体例结构,并通过总则与分则的配合共同维系法典的体系性。鉴于人工智能教育应用的广泛性,教育法典中人工智能立法也需要从总则与分则两方面共同应对,在防范人工智能教育应用风险的同时,促进人工智能教育资源的公平、合理应用。

1.教育法典“体系型法典”的体例结构

根据体例结构的不同,法典可分为汇编型法典与体系型法典。所谓汇编型法典,是指对原有的单行法不做任何改变,而直接通过“复制粘贴”的方式将它们汇编成册并冠以法典之名,其目的主要在于方便人们查阅(朱明哲,2021)。美国《教育法典》即为该种类型的法典。与之相异,体系型法典遵循“综合、科学、系统”(Synthetic, Scientific,Systematic,SSS)的立法模式(米健,2013),强调立法者通过删繁就简、查漏补缺的方式对原有单行法加以系统整合,从而形成一部逻辑统一、结构完整的体系化法典。可见,体系型法典是原有单行法的逻辑化“重述”而非简单拼凑(刘兆兴,2008)。我国《民法典》即为体系型法典,该法典对原有的《中华人民共和国侵权责任法》《中华人民共和国婚姻法》等民事单行法展开了系统化重述,如删除了公证遗嘱效力优先的规定,新增了“离婚冷静期”等多项内容。国际上,法国与俄罗斯的教育法典为典型的体系型法典。当前,学术界的主流观点是我国教育法典应为体系型法典。体系型法典体例结构的合理性或必要性源于我国教育立法的如下三项现状。

其一,立法碎片化。立法碎片化意指同一法律制度的相关规定散落在不同的立法文件中。譬如,除了《中华人民共和国教师法》(以下简称《教师法》)第八章“法律责任”外,《教师资格条例》《中小学教育惩戒规则(试行)》《幼儿园教师违反职业道德行为处理办法》《中小学教师违反职业道德行为处理办法》《教育部关于高校教师师德失范行为处理的指导意见》等规范性法律文件中亦对教师法律责任从不同方面展开了规定,这种立法的碎片化亟须由体系型教育法典统一展开整饬。

其二,立法重复化。立法重复化是指不同立法文件对同一法律制度反复展开规定,如《中华人民共和国教育法》(以下简称《教育法》)与《中华人民共和国义务教育法》(以下简称《义务教育法》)同时都对政府的教育经费保障职责作出了规定。此外,立法重复化还包括立法矛盾现象(童云峰等,2021),如《教师法》《义务教育法》关于教师待遇问题就作出了不同规定,前者主张参照国家公务员工资水平,后者则主张参照地方公务员工资水平。立法重复化浪费了立法资源,损及了立法权威,这亦需体系型教育法典予以统筹克服,促进立法的集约化发展。

其三,立法原则化。立法原则化意味着本应为法律规则的立法条款因缺乏具体的行为模式、法律后果等法律规则的必备要素,而丧失了基本的可操作性。如《教育法》第46条规定相关部门应当为受教育者的身心健康成长创造良好的社会环境,但该条却并未规定具体的实施路径,以及上述主体未履行义务时应当承担的责任,因而无法为受教育者的权利维护提供明确的救济渠道。事实上,我国教育立法中立法原则化的现象较为普遍。这仍然需要体系型教育法典对相关条款展开系统整合,优化其逻辑结构,提升相关条款的可操作性。

2.“总分架构”下人工智能立法的编章安排

对于体系型法典而言,体系化是其生命所在(王利明,2020),否则将与汇编型法典无异。而为了维系体系化,体系型法典往往会选择“总分架构”,即通过“提取公因式”的方式将法典中的共通性内容汇合为法典的总则,其他内容则根据一定标准和逻辑分类编排为分则。其中,总则在确保法典的体系性上起着纲举目张的作用。其一,总则集中彰显了法典的指导思想、基本价值,并对分则起到统辖作用,从而巩固了法典的体系性与逻辑性(任海涛,2021)。其二,由于分则共通性的内容规定在了总则中,故分则展开相关规定时,即可省略该类内容,法典的简约性由此得到了保障(王万华,2021)。譬如,《中华人民共和国刑法》(以下简称《刑法》)分则各罪名都涉及“对人效力”“空间效力”等假定条件,《刑法》总则对此展开了专门规定,分则各条款即无需再次展开列举,分则由此更为简约。其三,通常而言,法典分则较为具体细致,而总则因一般性条款较多而呈现出相对原则化的特质,这确保了总则的开放性与回应性,使得总则可以较为方便地将新兴问题纳入其规制范畴,避免了法典的频繁修改。

根据人工智能教育应用的发展趋势,并参考我国教育立法的体例安排与内容设置,未来教育法典总则可设置“教育基本原则”“教育法律主体”“教育权利与义务”“教育类别”“教育与社会”“在线教育”“法律责任”七章,分则则分为“学前教育编”“义务教育编”“高级中等教育编”“高等教育编”“职业教育编”“终身教育编”“民办教育编”“学位编”“教师编”“国家考试编”“教育对外交流与合作编”等编章。就教育法典中人工智能立法的编章安排而言,由于人工智能立法涉及不同教育类型与教育阶段的人工智能使用问题,同时人工智能教育应用本身也具备一定的通用性内容,故人工智能教育应用应当获得教育法典总则与分则的同时规范。

一方面,教育法典总则“在线教育”“法律责任”等章节应规范人工智能教育应用的通用性问题,尤其应规定人工智能教育应用风险的防范措施。以“在线教育”章为例,由于人工智能的技术基础是算法与数据,无论何种教育类型或教育阶段的人工智能教育应用风险问题,多数情况下,其背后都是由特定的算法与数据所引发,故算法与数据构成了人工智能教育应用风险法律防治的核心客体,这是人工智能立法相较于传统立法最为鲜明的特质。而这亦表明,人工智能教育应用风险具有鲜明的共性表征,这就需要总则“在线教育”章对数据与算法问题展开统一规范,尽可能从源头规避人工智能教育应用的技术偏见、隐私侵犯、信息不准确以及学术不端等风险。同时,为了应对人工智能教育应用风险高度不确定性给教育法典稳定性维护带来的巨大挑战,教育法典总则“在线教育”章对算法与数据的规范可以是相对原则性与框架式的,具体的规范细节可以交由中央政策、法律解释、法规规章等文件予以专门规定。因为上述文件颁布周期短、灵活性大,可以有效因应人工智能教育应用风险变动不居的现实挑战,同时实现教育立法体系的稳定性与灵活性。另一方面,在人工智能时代,不同教育类型与教育阶段都对人工智能教育资源的普惠性有着切实需求,但不同教育类型与教育阶段的需求重点并不一致,故教育法典分则应根据实际情况制定与各编章相适配的人工智能教育资源普惠性的促进义务。

总之,当前人工智能应用贯穿于教育活动的全过程,试图通过教育法典某一个编章对其展开有效应对的思路缺乏可操作性。教育法典中的人工智能立法终究需要由总则与分则共同展开规范。换言之,教育法典中人工智能立法的体系化无法凭借单一编章展开规定的方式予以实现,而是需要依靠总则与分则相关规制措施间的逻辑关联予以动态维系。

四、教育法典中人工智能立法的内容部署

作为一把“双刃剑”,人工智能在赋能教育的同时,也为教育活动及立法带来了显著挑战。由此,在通过原则化与具体化条款的有效搭配确保法典稳定性的基础上,教育法典中人工智能立法的体系化可采用如图1所示的编纂路径:教育法典分则各编章依托义务条款,分别为相关主体规定人工智能教育资源普惠性的促进义务;教育法典总则“在线教育”章为相关主体设定人工智能教育应用已知风险和未知风险的防治义务;教育法典总则“法律责任”章则为上述义务条款设定对应的责任条款,避免义务条款的“空转”。

图1 教育法典中人工智能立法的体系化编纂路径

1.分则相关编章:人工智能教育资源普惠性的实现

教育立法的核心及编纂主线是保障公民的受教育权,教育法典概莫能外(鲁幽等,2021)。受教育权的首要属性是公平(龚向和,2021)。人工智能为教育实践带来了积极的教育变革,故教育法典首先需要通过实现人工智能教育资源的普惠性,来巩固此类积极变革,令全体教育主体能平等享有人工智能的教育红利。事实上,上文指出的人工智能教育应用风险中的教育数字鸿沟扩大化,也需要借助人工智能教育资源普惠性的实现来克服。2017年国务院印发的《国家教育事业发展“十三五”规划》即提出,“支持各级各类学校建设智慧校园,综合利用互联网、大数据、人工智能和虚拟现实技术探索未来教育教学新模式”(中华人民共和国中央人民政府,2017a)。同年,国务院在其印发的《新一代人工智能发展规划》中提出了“开源开放”的原则,“倡导开源共享理念,促进产学研用各创新主体共创共享”(中华人民共和国中央人民政府,2017b)。2018年教育部发布的《教育信息化2.0行动计划》亦提出“推动人工智能在教学、管理等方面的全流程应用,利用智能技术加快推动人才培养模式、教学方法改革,探索泛在、灵活、智能的教育教学新环境建设与应用模式”(中华人民共和国教育部,2018)。针对人工智能教育资源的普惠性,教育法典分则可作出如下针对性义务规定。

第一,“学前教育编”应规定教育行政部门建设学前教育阶段人工智能管理平台的义务,推动该阶段人工智能教育资源的普及。重点应关注四方面的立法议题:其一,通过管理平台动态呈现幼儿的在园状态,在安全事故发生时及时展开处理;其二,通过管理平台对幼儿的体温、睡眠数据等信息展开实时观测,分析幼儿的健康状况;其三,教师及时通过管理平台发布相关讯息,家长及管理者则可以跟踪并反馈,践行家校共育理念;其四,通过虚拟现实技术、智能语音机器人技术等,为幼儿提供模拟化、多样化的游戏学习场景,促使教育方式更符合儿童心理特征。

第二,“义务教育编”应基于义务教育的性质为教育行政部门设定明确且强制性的人工智能教育设施公平配置义务。“义务教育编”立法重点有二:一是促使学生更好地了解人工智能的基本原理与应用方式,培养学生利用人工智能自主学习的能力,进而培育其创新与实践技能,为后续教育阶段的发展奠定技术基础。二是确保上述教育资源的公平配置,尤其要为经济困难或偏远地区的学生提供保质保量的人工智能教育资源,实现义务教育阶段教育资源分配的实质平等。高中教育由于不属于义务教育阶段,故“高级中等教育编”的重点应在于第一项。当然,该编可设置高中阶段人工智能应用的最低标准,并督促政府对相关学校予以监督。

第三,鉴于高校在人工智能教育资源的获取与运用方面本就拥有较大优势,“高等教育编”及“学位编”的重点应在于提升人工智能教育资源的质量与针对性。譬如,通过人工智能构建共享包容的办学模式,推动教育资源的互联互通,实现教育资源的跨国共享,促进形成国际高等教育办学的新生态。再如,推动建立透明可靠的学习过程和学习成果认证,在确保学习成果真实的基础上,实现学习资历的互通、互认。又如,运用区块链技术颁发电子学位证书,借助区块链技术难以篡改、全程追溯的特质,有效化解传统学位证书遗失不予补发、容易被造假的缺陷。

第四,“职业教育编”的重点在于通过人工智能技术的运用推动产教融合,优化职业教育专业布局,提高职业教育专业设置与市场需求的匹配度,规避“结构性失业”或“技术性失业”,促进职业教育与产业发展之间的双向互动。“终身教育编”的重点在于依托人工智能技术整合社区、城乡、企业的集成化教育资源,突破时空限制实现教育资源的方便可及,为全体公民的终身学习提供更高品质的服务。“民办教育编”则应综合吸收上述规定,实现民办教育各阶段人工智能教育资源的普及化。

第五,“教师编”应设置督促教育行政部门加强对教师开展人工智能技术培训与研修的义务条款,从而使教师适应上述各编带来的教育方式的变革。同时,该编还应普及教师管理的智能化,如通过区块链技术实现教师档案管理的电子化,进而提升学校管理的效益。此外,教育法典总则“教育与社会”章还可以鼓励全社会在人工智能教育资源方面对各类教育活动给予协助。2023年国家互联网信息办公室起草完成的《生成式人工智能服务管理暂行办法》第5条第2款就规定:“支持行业组织、企业、教育和科研机构、公共文化机构、有关专业机构等在生成式人工智能技术创新、数据资源建设、转化应用、风险防范等方面开展协作。”

2.总则“在线教育”章:人工智能教育应用风险的应对

(1)已知风险的应对

诚如上文所述,人工智能的教育应用对教育公平与教育安全构成了挑战,进而引发了人类主体性自我消解的伦理隐忧,这是总则“在线教育”章需要集中应对的两类已知风险。

一方面,算法与数据的运作失范引发了教育公平与教育安全的问题,由此损及了教育主体的尊严和权利。在现代公法制度中,正当程序是维护人的尊严和权利的关键保障,但由于人工智能的运行往往缺乏(事实上也很难具备)事前告知、听取意见、说明理由等程序要素,故传统正当程序在瞬间作出决定的人工智能自动化决策场景中遭遇了“滑铁卢”(刘东亮,2020)。此时,技术性正当程序(Technological Due Process)就为促进算法和数据的规范运用提供了适配切入点。技术性正当程序能够深入到人工智能的技术环节,规范数据的收集和算法的设计、开发与应用(Reidenberg,1998),从而确保教育主体在人工智能自动化决策过程中享有充分的正当程序之保障,避免“代码即法律”(Code Is Law)(劳伦斯·莱斯格,2018)或“代码专横”等现象。技术性正当程序针对自动化决策提出了三方面的要求:首先,自动化决策系统必须以透明性为导向,保障公众的知情权;其次,自动化决策系统应保存“审计轨迹”,以此方便行政机关的监督审查;最后,自动化决策系统的应用应区分“规则”与“标准”,规则的适用可以由系统自动作出,但由于标准适用的主观性较强,故系统不得自动适用标准作出决定,而仅能作为辅助功能而存在(苏宇,2023)。由此,教育法典总则“在线教育”章应构建以算法、数据合规为核心的义务体系。

其一,设定算法透明度义务。算法透明度义务的履行是算法规制的核心议题(安晋城,2023),其意在指引人工智能服务提供者完整公开其算法或确保算法易于公众理解,从而在源头实现算法合规,避免算法歧视、侵犯教育主体隐私权或滋生学术不端。算法公开与算法解释是算法透明度义务的两项支柱内容。一方面,人工智能服务提供者应公开算法源代码,提升算法从设计到应用环节的透明度,解决一般性算法“黑箱”问题。这对于维护教育主体的知情权至关重要。另一方面,诸多算法即便公开,作为非专业人士的教育主体也很难理解其源代码的运作逻辑,因此需要引入算法解释。即人工智能服务提供者需要以可理解的方式向教育主体解释算法机制,从而尽早发现并排除由算法“黑箱”引起的歧视或隐私窥探等风险。总则“在线教育”章可通过第三方认证的方式倒逼人工智能服务提供者履行算法解释义务。

与算法透明度义务相关的立法议题还有学位论文创作中人工智能使用者履行透明度义务的问题。由于人工智能参与学位论文的创作过程极为隐蔽,故使用者履行透明度义务就为技术性正当程序所格外重视(Citron,2008)。透明度义务履行意指学位申请人公开其在论文写作中使用人工智能的具体情况,从而区分本人与人工智能的学术贡献,并由专业人员判断是否构成学术不端。透明度义务的履行意味着学位申请人完成了可信性验证程序,学位论文因此获得了初步的程序正当性。当然,除学位论文外,任何教育阶段任何类型的学术成果的创作皆应履行上述义务(只不过高等教育阶段更为显著),故透明度义务之履行仍应由总则“在线教育”章规定更为妥适。“在线教育”章应规定人工智能使用者在学术成果创作进程中须主动履行透明度义务,未履行该义务的,可直接判定为学术不端。当然,透明度义务在本质上对学术自由构成了一定限制,故透明度义务的具体履行标准问题,如究竟应采用“鱼缸透明度”(Fishbowl Transparency)还是“合理透明度”(Reasoned Transparency)标准等,应由教育法典授权学术共同体来制定(程睿,2023)。至于人工智能作品的著作权归属问题,则应通过著作权法予以解决,这不在本文的探讨范畴内。

其二,确立数据透明度义务。数据透明度义务包含确保数据合规和保障数据质量两方面要求。《生成式人工智能服务管理暂行办法》就体现了这两项要求:第7条第1项要求人工智能服务提供者应“使用具有合法来源的数据和基础模型”,第4项要求“采取有效措施提高训练数据质量,增强训练数据的真实性、准确性、客观性、多样性”。在确保数据合规方面,总则“在线教育”章应制定数据审理清单,明确个人数据、重要数据的范围,为人工智能服务提供者在数据收集、存储及使用过程中确立合法性指引,避免对教育主体隐私的侵犯。在保障数据质量方面,应鼓励相关行业制定适配的数据质量标准,并在数据质量出现问题时赋予数据主体以修正权,确保数据的无偏见性及准确性;同时,在内容生成环节,还应要求人工智能服务提供者履行可识别水印或有效警示信息的添加义务(张凌寒,2023),从而给予教育主体以充分的选择权。

其三,确立算法与数据的审计义务。人类的偏私性不可避免地会导致人类将自身的偏见导入到算法设计或数据选取上,资本的逐利性也进一步催生了上述可能。因此,算法与数据的合规不能仅依赖人工智能服务提供者自身的努力,还需引入审计制度进行兜底保障。算法与数据的审计制度重在由行政部门牵头,从他方的角度对人工智能服务提供者的算法与数据展开合规性审查。在审计主体方面,总则“在线教育”章可明确由行政部门或社会团体履行这一义务。在审计方式上,应更多地引入专门审计方法。如有学者指出,可通过代码审计法应对算法偏见,通过众包审计法应对隐私权侵犯问题;通过抓取审计法来验证算法与数据的真实性与完整性问题(张欣等,2022)。实际上,这亦说明了人工智能教育应用风险已突破传统教育问题的范畴,呈现出教育与科技交叠的状态,故教育法典的编纂也不应仅是教育学、法学专家的“自留地”,而是需要科技界人士鼎力相助方能完成的任务。

其四,设立教育标准事务不得自动化决策义务,其对应的权利即为教育主体的人工智能教育自动化决策拒绝权。人工智能教育自动化决策可用于作文评分等标准事务,以及学籍管理等规则事务。上文指出,标准问题见仁见智,这离不开教育共同体的主观判断,而人工智能不具备自主意识,故其无法妥适完成这一任务。以作文评分为例,人工智能评分可以避免因字迹不工整而导致的不合理低分问题,但亦有学生担心其难以对包含人类情感的作文给出合理评分。因此,教育法典应设定教育标准事务不得自动化决策义务。尽管《中华人民共和国个人信息保护法》第14、17、44条对上述内容有所规定,但相关条款关于教育主体的知情渠道和决定方式等事项的表述过于笼统,故该法及教育法典总则“在线教育”章还需作出进一步规定。

此外,人类主体性的自我消解这一伦理隐忧,也必须回归教育的本质方能获得彻底的化解。因为,无论人工智能的自动化决策能力多么强大,至少在看得见的未来,人工智能都不可能产生反思的能力与情感交流的功能。而真正的教育,绝不仅仅是知识的灌输,而是促进人与人之间心灵沟通的情感培育活动。它的目的是培养人的道德情操,形塑人的价值观念,慰藉人的心灵,充盈人的灵魂,让人变得更加情感充沛,而不是沦为技术的附庸或傀儡。是以,愈是在人工智能时代,教育就愈需要返璞归真,彰显人文关怀。

据此,教育法典总则“在线教育”章应规定教育行政部门须出台规范,明确教师在人工智能使用进程中的行为规范与专业操守,促使其有效培育学生正确积极的价值观。相关规范可要求教师坚持育人为本的价值导向,培育学生的道德感、同理心和健全的人格,促进学生的全面自由发展;激发学生的批判意识与创新精神,避免其浸染于对“技治主义”的狂热崇拜;坚持人与人之间现实的实践交往,促使教师与学生摆脱对虚拟空间的沉溺,融入真切的社会生活,感受真挚的人类情感。当然,教育法典不可能也不宜对上述具体的操作规范展开规定,其仅需以概括化的条款赋予教育行政部门以相应义务即可,以此维系教育法典本身的统摄性与稳定性。

(2)未知风险的应对

人工智能教育应用的另一重大风险即是其引发的教育风险的高度不确定性。《新一代人工智能发展规划》提出要“加强前瞻预防与约束引导,最大限度降低风险,确保人工智能安全、可靠、可控发展”,但由于人工智能迭代发展速度远高于法律出台速度等原因,传统立法治理路径在面对层出不穷的新风险时难免捉襟见肘。此时,“敏捷治理”(Agile Governance)就为应对这一困境提供了解决之道。

敏捷治理的概念于2018年世界经济论坛白皮书中提出,2019年国家新一代人工智能治理专业委员会发布的《新一代人工智能治理原则——发展负责任的人工智能》(以下简称《人工智能治理原则》)中再次提出了这一原则。敏捷治理内含三项实践优势:其一,治理主体多元化。敏捷治理强调多元主体的合作互动、反馈评估,重视决策参与的平等性(赵静等,2021)。其二,治理手段多样化。敏捷治理强调运用一切可运用的手段展开风险规制,规避传统治理手段的僵化。其三,治理范式全程化。传统治理方式属于被动响应式治理,是问题爆发后的事后处理,而敏捷治理则强调事前、事中与事后的全程治理,注重通过动态灵活的方式克服传统治理手段滞后性的不足(高进等,2024)。总之,立法并非一劳永逸之策,相关教育主体必须通过随机应变的动态治理模式,在出现新风险且立法难以跟进的情境中实现“兵来将挡水来土掩”。教育法典总则“在线教育”章应引入敏捷治理模式,初步搭建集众多主体为一体的治理平台。当然,出于维护教育法典统摄性与稳定性的考量,具体细致的敏捷治理操作细节则应交由其他规范性法律文件乃至灵活度更大的行业章程予以完成,教育法典对此无需具体展开规定。

首先,构筑多元主体参与的事前监测预警平台。教育行政部门应构筑包含各类教育主体以及相关社会组织在内的算法监测平台,利用平台的大数据优势实现对教育人工智能的全天候监测与感知预警,及时发现并弥补相关算法漏洞。譬如,针对医疗、环境、科技等专业性极强的问题,若人工智能无法获得足够客观的数据进行预训练,则其将难以为学生提供专业化、精准化回答。对此,政府及相关专业的教育主体应通过平台共享信息,为人工智能预训练阶段提供扎实的数据信息,从源头提升数据的应用质效。

其次,形成事中快速响应的因应机制。快速响应是敏捷治理相较于传统治理方式的核心优势。这一方面要求教育行政部门利用上述平台的信息收集及跟踪优势,及时推演或发现算法漏洞,并迅速与相关教育主体展开协作,规避由此发生的隐私权侵犯等风险。另一方面,这亦要求人工智能服务提供者构建全过程反馈机制。人工智能基于反馈机制而产生的各项风险,亦应通过后续的使用反馈来实现“以彼之道还施彼身”。申言之,教育主体不应被动等待算法漏洞的解决,而应结合自身专业特长并通过反馈机制及时反映算法歧视、隐私权侵犯等问题。在此基础上,人工智能服务提供者应迅速通过自动化工作流程归纳梳理反馈信息,形成有价值的改进意见并展开系统修补,动态完善人工智能的算法,同时将处理结果反馈给相关教育主体。

最后,构建事后动态完善的持续发展机制。人工智能服务提供者应在总结风险的基础上,于事后更新迭代其算法技术,不断动态完善其算法体系。同时,对于相对成熟的风险应对方法,相关部门可逐步将其纳入法律法规中。由此观之,敏捷治理并非是与立法规制畛域分明的对立概念,敏捷治理本身就包含了事后的立法规制,只是其更强调治理方式的全程性。

3.总则“法律责任”章:人工智能教育应用法律责任机制的建构

法律责任条款是确保上述义务条款得以顺利实施的制度性机制,《人工智能治理原则》即要求“建立人工智能问责机制,明确研发者、使用者和受用者等的责任”。法律责任的意义在于,作为教育司法的规范依据(程雁雷,2021),其为教育法典义务条款进入司法程序,即维护教育法典的可诉性(Justiciability),并进而为促进义务之履行、维护当事人权益提供了规范渠道。而在现代法治社会,司法是维护公平正义的最后一道防线(董储超,2023),责任条款的缺失将导致义务主体即便违反义务也无法被苛以责任,权利主体由此也就丧失了司法保障这一最有力度的兜底性权利救济机制。

教育法典的法律责任有其独特的编纂理路,这源于教育法“领域法”(Field of Law)的属性。传统部门法所调整的法律关系的主体、客体以及设置的法律责任皆是单一属性的,与之相异,教育法所包含的上述内容都是多元化的。梳理既有教育立法可知,教育法律关系主体既包括地位平等的主体,亦包括地位不平等的主体;教育法律关系客体则同时含纳了民事、行政以及刑事法律行为;教育法律责任亦囊括了民事、行政以及刑事法律责任。由此可见,教育法是横跨不同部门法的交叉法律领域,属于典型的领域法,故教育法典必然是领域型法典。

领域型法典的属性意味着教育法典法律责任条款有着固有的编纂理路(刘旭东,2023)。一方面,应运用引致性条款规定民事与刑事法律责任。作为典型的部门型法典,《民法典》《刑法》已然对民事与刑事法律责任的具体行为模式展开了细致规定,教育法典再次展开规定即属重复立法;同时,二者所规定的对象也具备较为鲜明的v2dRsui1uZWKIPri52dliHGVdUCQihMeLKxKnxSXNeU=专属性、闭合性特质,教育法典也不宜进行“染指”,否则即有可能造成《民法典》《刑法》的“解法典化”(Decodification)。另一方面,教育行政法律责任应通过引致性条款与具体责任条款展开灵活规定。根据责任主体与责任性质的不同,教育行政法律责任分为如下四种:行政部门承担的行政责任、公职人员承担的行政处分责任、其他主体承担的治安管理处罚责任、其他主体承担的行政处罚责任。其中,行政处分责任和治安管理处罚责任已经得到了《中华人民共和国公职人员政务处分法》《中华人民共和国治安管理处罚法》详尽的、闭合性的规定,故教育法典亦无需展开重复立法。而行政部门承担的行政责任、其他主体承担的行政处罚责任则需要完整进入教育法典,因为教育领域的这两类责任具有鲜明的领域属性,包括《中华人民共和国行政处罚法》等非教育立法对此都没有展开规定,它们仅出现于我国教育立法中,故此类责任应完整进入教育法典。

由此,教育法典总则“法律责任”章关于人工智能法律责任的编纂理路也就较为清晰了。一方面,通过引致性条款援引《民法典》《刑法》的相关责任规定。时下,《民法典》《刑法》关于人工智能教育法律责任的规定尚存立法空白,但正如上文指出,民事、刑事法律责任空白的填补显然不应由教育法典予以完成,这一工作只能依托《民法典》《刑法》的自我修补。当然,在立法修补完成前,司法机关可率先出台司法解释,从而为相关教育实践提供法律责任方面的规范依据。另一方面,人工智能教育法律义务主体主要分为人工智能服务提供者、教育主体以及教育行政机关(包括其工作人员),关于这三类主体的行政处分和治安管理处罚责任仅需通过引致性条款规定即可,而这三类主体承担的行政部门责任或行政处罚责任则应当完整保留。不过目前我国各教育单行法也尚未制定这两类责任,故教育法典总则“法律责任”章对此需进行补足:其一,规定人工智能服务提供者没有履行算法透明度义务、数据透明度义务时应承担的教育行政处罚责任;其二,规定教育主体在科研过程中没有履行透明度义务时应承担的学术责任;其三,规定教育行政机关没有履行人工智能教育资源普惠性促进义务、算法和数据审计义务,怠于出台教师人工智能使用的行为规范,以及怠于构建敏捷治理平台时应承担的教育行政责任。至于责任的具体种类,则显然应由立法者予以细致规划。

五、余论:人工智能时代受教育权概念的 意涵更新

上文指出,保障受教育权是教育法典的核心任务。人工智能时代的教育立法仍然要继续重申并进一步深描公民受教育权保障的根本立法宗旨。人工智能教育资源普惠性的促进义务以及人工智能教育应用风险的防治义务,无不体现了这一理念。然而,在人工智能时代,受教育权的内涵与外延都进一步发生着变化,这种变化主要源自人工智能时代人们学习方式的变革。由上文可知,人工智能教育应用导致人们的学习方式开始从被动型向主动型演进,人们的学习阶段也不再局限于特定教育阶段,而是呈现出鲜明的终身性特质。但是,作为一项基本权利,受教育权在我国立法文本中实际上被限定在了义务教育阶段,这一概念很难将公民终其一生所可能享有的教育权利涵摄在内,这在人工智能时代尤为明显。因此,教育法典如若仍采用狭义的受教育权概念,必然无法因应人工智能时代公民学习的自主性、终身性诉求,进而难以描摹并实现公民在教育领域的基本权利。在这一背景下,教育法典总则“教育权利与义务”章可明确扩大受教育权的概念外延,抑或采用全新的“学习权”概念(尹力,2010),使得这一权利的外延突破义务教育阶段的束缚,促进人工智能时代公民教育权利的系统整合。由此,上文的诸项措施方能得以真正落实,进而实现在巩固人工智能教育应用成果的同时,维系教育公平与教育安全,守护人类主体性的目标。

参考文献:

[1][美]劳伦斯·莱斯格(2018).代码2.0:网络空间中的法律[M].李旭,沈伟伟.北京:清华大学出版社:6.

[2]安晋城(2023).算法透明层次论[J].法学研究,45(2):52-66.

[3]程睿(2023).ChatGPT介入学术论文创作透明度义务的履行[J].中国高教研究,(11):62-69.

[4]程雁雷(2021).论教育法律责任的基本范畴[J].东方法学,(1):179-188.

[5]戴岭,胡姣,祝智庭(2023).ChatGPT赋能教育数字化转型的新方略[J].开放教育研究,29(4):41-48.

[6]董储超(2023).学位论文同行评阅的法理检视:功能指向与模式选择[J].大学教育科学,(6):32-42.

[7]高进,刘聪(2024).算法歧视的敏捷治理——以D短视频平台为例[J].西安交通大学学报(社会科学版),44(1):1-17.

[8]龚向和(2021).论新时代公平优质受教育权[J].教育研究,42(8):48-58.

[9]贾开,蒋余浩(2017).人工智能治理的三个基本问题:技术逻辑、风险挑战与公共政策选择[J].中国行政管理,(10):40-45.

[10]雷磊(2023).ChatGPT对法律人主体性的挑战[J].法学,(9):3-15.

[11]李世瑾,胡艺龄,顾小清(2021).如何走出人工智能教育风险的困局:现象、成因及应对[J].电化教育研究,42(7):19-25.

[12]刘宝存,苟鸣瀚(2023).ChatGPT等新一代人工智能工具对教育科研的影响及对策[J].苏州大学学报(教育科学版),11(3):54-62.

[13]刘东亮(2020).技术性正当程序:人工智能时代程序法和算法的双重变奏[J].比较法研究,(5):64-79.

[14]刘旭东(2023).领域型教育法典中法律责任的规范构造研究[J].中国高教研究,(12):32-39.

[15]刘兆兴(2008).比较法视野下的法典编纂与解法典化[J].环球法律评论,(1):48-56.

[16]龙卫球(2020).科技法迭代视角下的人工智能立法[J].法商研究,37(1):57-72.

[17]鲁幽,马雷军(2021).我国教育法法典化的路径、体例和内容——2021年中国教育科学论坛教育法法典化分论坛综述[J].湖南师范大学教育科学学报,20(6):116-120.

[18]米健(2013).比较法学导论[M].北京:商务印书馆:241.

[19]任海涛(2021).教育法典总则编的体系构造[J].东方法学,(6):123-140.

[20]申灵灵,卢锋,张金帅(2022).超越莫拉维克悖论:人工智能教育的身心发展隐忧与应对[J].现代远程教育研究,34(5):56-62.

[21]苏宇(2023).数字时代的技术性正当程序:理论检视与制度构建[J].法学研究,45(1):91-107.

[22]童云峰,欧阳本祺(2021).我国教育法法典化之提倡[J].国家教育行政学院学报,(3):26-34.

[23]王利明(2020).体系创新:中国民法典的特色与贡献[J].比较法研究,(4):1.

[24]王万华(2021).我国行政法法典编纂的程序主义进路选择[J].中国法学,(4):103-122.

[25]新华社(2018).习近平:加强领导做好规划明确任务夯实基础推动我国新一代人工智能健康发展[EB/OL].[2023-12-20].https://www.rmzxb.com.cn/c/2018-10-31/2205658.shtml.

[26]杨九诠(2024).想象的困境:生成式人工智能世代的价值教育[J].中国远程教育,44(2):12-23.

[27]尹力(2010).学习权保障:学习型社会教育法律与政策的价值基础[J].北京师范大学学报(社会科学版),(3):70-78.

[28]余南平,张翌然(2023).ChatGPT/生成式人工智能对教育的影响:大国博弈新边疆[J].华东师范大学学报(教育科学版),41(7):15-25.

[29]张凌寒(2023).深度合成治理的逻辑更新与体系迭代——ChatGPT等生成型人工智能治理的中国路径[J].法律科学(西北政法大学学报),41(3):38-51.

[30]张欣,宋雨鑫(2022).算法审计的制度逻辑和本土化构建[J].郑州大学学报(哲学社会科学版),55(6):33-42.

[31]赵静,薛澜,吴冠生(2021).敏捷思维引领城市治理转型:对多城市治理实践的分析[J].中国行政管理,(8):49-54.

[32]赵磊磊,吴小凡,赵可云(2022).责任伦理:教育人工智能风险治理的时代诉求[J].电化教育研究,43(6):32-38.

[33]中华人民共和国教育部(2018).教育部关于印发《教育信息化2.0行动计划》的通知[EB/OL].[2023-12-20].http://www.moe.gov.cn/srcsite/A16/s3342/201804/t20180425_334188.tml.

[34]中华人民共和国中央人民政府(2017a).国务院关于印发国家教育事业发展“十三五”规划的通知[EB/OL].[2023-12-20].https://www.gov.cn/zhengce/zhengceku/2017-01/19/content_5161341.htm.

[35]中华人民共和国中央人民政府(2017b).国 务 院 关 于 印 发新一代人工智能发展规划的通知[EB/OL].[2023-12-20].https://www.gov.cn/gongbao/content/2017/content_5216427.htm.

[36]周洪宇,李宇阳(2023).生成式人工智能技术ChatGPT与教育治理现代化——兼论数字化时代的教育治理转型[J].华东师范大学学报(教育科学版),41(7):36-46.

[37]朱明哲(2021).法典化模式选择的法理辨析[J].法制与社会发展,27(1):89-112.

[38]祝智庭,胡姣(2022).教育数字化转型的本质探析与研究展望[J].中国电化教育,(4):1-8,25.

[39]Citron, D. K. (2008). Technological Due Process[J]. Washington University Law Review, 85(6):1249-1313.

[40]Reidenberg, J. (1998). Lex Informatica: The Formulation of Information Policy Rules Through Technology[J]. Texas Law Review, 76(3):553-594.

收稿日期 2024-02-26 责任编辑 汪燕

Legislation of Artificial Intelligence in Education:

A Systematic Compilation Path Based on the Education Code

LIU Xudong

Abstract: Artificial intelligence not only empowers education, but also increases the difficulty of education legislation. Compared to the slip laws in education, the Education Code, as the fundamental law of education, will be able to regulate the application of artificial intelligence in education in the most appropriate way, achieving the healthy development of educational applications of artificial intelligence. As a systematic legal code, the Education Code must have general provisions and specific provisions. The Education Code can be systematically compiled through the general provisions of “online education” and “legal liability”, as well as the relevant chapters of specific provisions. Firstly, the main line of compiling and the essence of education legislation is to safeguard citizens’ right to education. Therefore, the relevant chapters of the Education Code need to establish the obligation for the government and schools to popularize artificial intelligence educational resources, so that educational subjects can equally enjoy the educational dividends of artificial intelligence. Secondly, in response to potential risks, the Education Code can introduce a general chapter on “online education”, which on the one hand introduces technical due process, establishes transparency and audit obligations for algorithms and data, and prohibits automated decision-making in educational standard affairs, to clarify the behavioral norms for teachers using artificial intelligence; and on the other hand, based on agile governance, builds a pre-detection and early warning platform, a response mechanism for rapid response during the event, and a sustainable development mechanism for dynamic improvement after the event, to address unknown risks in the educational application of artificial intelligence. Finally, in order to ensure the smooth implementation of the obligation clauses, the Education Code can establish a sound legal liability mechanism for the application of artificial intelligence in education through the reasonable use of causative clauses and specific liability clauses in the“legal liability”chapter of the general provisions.

Keywords: Education Code; Legislation of Artificial Intelligence in Education; Compilation Path; Technical Due Process; Agile Governance